WO2016158166A1 - 投影システム、プロジェクター装置、および、プログラム - Google Patents

投影システム、プロジェクター装置、および、プログラム Download PDFInfo

- Publication number

- WO2016158166A1 WO2016158166A1 PCT/JP2016/056253 JP2016056253W WO2016158166A1 WO 2016158166 A1 WO2016158166 A1 WO 2016158166A1 JP 2016056253 W JP2016056253 W JP 2016056253W WO 2016158166 A1 WO2016158166 A1 WO 2016158166A1

- Authority

- WO

- WIPO (PCT)

- Prior art keywords

- image

- projection

- point

- plane

- unit

- Prior art date

- Legal status (The legal status is an assumption and is not a legal conclusion. Google has not performed a legal analysis and makes no representation as to the accuracy of the status listed.)

- Ceased

Links

Images

Classifications

-

- G—PHYSICS

- G06—COMPUTING OR CALCULATING; COUNTING

- G06T—IMAGE DATA PROCESSING OR GENERATION, IN GENERAL

- G06T5/00—Image enhancement or restoration

- G06T5/80—Geometric correction

-

- H—ELECTRICITY

- H04—ELECTRIC COMMUNICATION TECHNIQUE

- H04N—PICTORIAL COMMUNICATION, e.g. TELEVISION

- H04N9/00—Details of colour television systems

- H04N9/12—Picture reproducers

- H04N9/31—Projection devices for colour picture display, e.g. using electronic spatial light modulators [ESLM]

- H04N9/3179—Video signal processing therefor

- H04N9/3185—Geometric adjustment, e.g. keystone or convergence

-

- G—PHYSICS

- G06—COMPUTING OR CALCULATING; COUNTING

- G06T—IMAGE DATA PROCESSING OR GENERATION, IN GENERAL

- G06T3/00—Geometric image transformations in the plane of the image

- G06T3/60—Rotation of whole images or parts thereof

-

- H—ELECTRICITY

- H04—ELECTRIC COMMUNICATION TECHNIQUE

- H04N—PICTORIAL COMMUNICATION, e.g. TELEVISION

- H04N9/00—Details of colour television systems

- H04N9/12—Picture reproducers

- H04N9/31—Projection devices for colour picture display, e.g. using electronic spatial light modulators [ESLM]

- H04N9/3191—Testing thereof

-

- H—ELECTRICITY

- H04—ELECTRIC COMMUNICATION TECHNIQUE

- H04N—PICTORIAL COMMUNICATION, e.g. TELEVISION

- H04N9/00—Details of colour television systems

- H04N9/12—Picture reproducers

- H04N9/31—Projection devices for colour picture display, e.g. using electronic spatial light modulators [ESLM]

- H04N9/3191—Testing thereof

- H04N9/3194—Testing thereof including sensor feedback

Definitions

- the present invention relates to a technique for appropriately displaying an image (video) projected by a projection type projector apparatus.

- Patent Document 1 Japanese Patent Laid-Open No. 2006-33357 discloses a video projection apparatus that can correct image distortion due to distortion of the screen itself.

- a test image is projected from a projector onto a screen, the projected test image is captured by a camera-equipped mobile phone, and geometric correction is executed based on the image captured by the camera-equipped mobile phone.

- image distortion geometric distortion due to distortion of the screen itself can be corrected.

- a projection type projector device is often a flat screen installed vertically. For this reason, even if projection without a geometric distortion is not realized, the projection type projector apparatus is adjusted to a projection state in which the geometric distortion of the projected image does not matter to the user. It is possible enough. This is because the user can correctly recognize that it is projected on a flat screen that is installed vertically, and it is easy to correctly recognize the vertical direction, so the image that is projected on the flat screen that is the vertical plane This is because there is no sense of incongruity even if some geometric distortion exists.

- the projection target is, for example, a ceiling (hereinafter referred to as “horizontal ceiling”) installed in parallel with the floor

- horizontal ceiling a ceiling

- an image is projected onto the horizontal ceiling from the projection type projector device.

- the surface is a vertical plane

- the present invention projects onto a horizontal projection plane (for example, a horizontal ceiling) or a plane parallel to a straight line connecting both eyes of the user (for example, a front inclined plane or a rear inclined plane) without using a device having a photographing function.

- An object of the present invention is to realize a projection system, a projector apparatus, and a program that can easily and appropriately reduce the geometric distortion of a captured image.

- the projection target is, for example, an inclined plane (for example, an inclined ceiling) inclined above a predetermined angle installed above the user, and an image is projected from the projection type projector device on the inclined plane

- the projection plane is a vertical plane

- the present invention provides a projection system, a projector apparatus, and a projection system that can easily and appropriately reduce geometric distortion of an image projected on an inclined plane (for example, an inclined ceiling) without using an apparatus having a photographing function.

- the purpose is to realize the program.

- the first invention uses a plane parallel to a straight line connecting the left eye viewpoint and the right eye viewpoint as a projection plane, and reduces geometric image distortion when viewed from the user's viewpoint.

- a projection system that projects an image so as to achieve the above state, and includes a projection unit, a three-dimensional shape measurement unit, a controller, and a projection image adjustment unit.

- the projection unit is a projection unit that projects an image on a projection surface, and projects a test image.

- the 3D shape measurement unit measures the 3D shape of the projection surface.

- the controller generates a control signal based on a user operation.

- the projection image adjustment unit passes through the projection center point that is the intersection of the projection axis of the projection unit and the projection plane based on the three-dimensional shape data measured by the three-dimensional shape measurement unit, and is on the normal line of the projection plane.

- the correction point which is an image conversion process, is executed on the test image so that the geometric image distortion is reduced.

- the projection image adjustment unit determines the rotation angle according to the control signal, and when the projection surface is viewed from the first point, the projection image of the test image after the correction processing on the projection surface by the projection unit is the projection center point

- a rotation process which is an image conversion process, is performed on the test image after the correction process so that the image is rotated by the rotation angle determined according to the control signal, centering on.

- a test image showing the upper part when displayed is projected onto a projection plane (for example, a horizontal projection plane such as a horizontal ceiling plane) parallel to a straight line connecting the left eye viewpoint and the right eye viewpoint.

- a projection plane for example, a horizontal projection plane such as a horizontal ceiling plane

- the geometric distortion of the image projected on the projection plane is eliminated by executing the process of rotating the projection image within the projection plane while the user confirms the change state of the test image with the controller ( Can be reduced).

- a plane parallel to the straight line connecting the left eye viewpoint and the right eye viewpoint is projected onto the projection plane (for example, a horizontal projection plane such as a horizontal ceiling plane) without using a device having a photographing function. Therefore, the geometric distortion of the image can be eliminated (reduced) easily and appropriately.

- the projection plane is a plane parallel to a straight line connecting the left eye viewpoint and the right eye viewpoint

- the projection plane is, for example, a projection plane, a front tilt plane, or a rear tilt plane that is a plane parallel to the floor.

- the “straight line connecting the left eye viewpoint and the right eye viewpoint” is, for example, a straight line parallel to the floor when the user stands upright with respect to the floor.

- Front inclined plane means that the floor and the horizontal plane are rotated about the axis that becomes a straight line parallel to the floor (or a straight line parallel to the straight line passing through the left eye viewpoint and right eye viewpoint of the user). It is a plane that is not inclined to the left or right as viewed from the user and is inclined in the forward direction (the direction that is forward when viewed from the user).

- Backward inclined plane means that the floor and the horizontal plane are rotated about the axis that is a straight line parallel to the floor (or a straight line parallel to the straight line passing through the left and right eye viewpoints of the user). It is a plane that is not inclined to the left or right as viewed from the user and is inclined backward (in the direction viewed from the user).

- the measurement of the “three-dimensional shape of the projection plane” includes, for example, (1) measurement for obtaining a normal line of the projection plane and clarifying the positional relationship between the projection section and (2) projection of the projection section. This is a concept including a measurement for obtaining an angle between an axis (optical axis of the optical system of the projection unit) and the projection surface and clarifying a positional relationship between the projection unit and the projection surface.

- the state in which geometric image distortion is reduced means that, for example, the geometric image distortion of the projection image caused by the positional relationship between the projection unit and the projection plane (the angle between the projection axis and the projection plane) is reduced.

- test image after the correction process so that the projection image of the test image after the correction process on the projection plane is an image rotated around the projection center point by the rotation angle determined according to the control signal

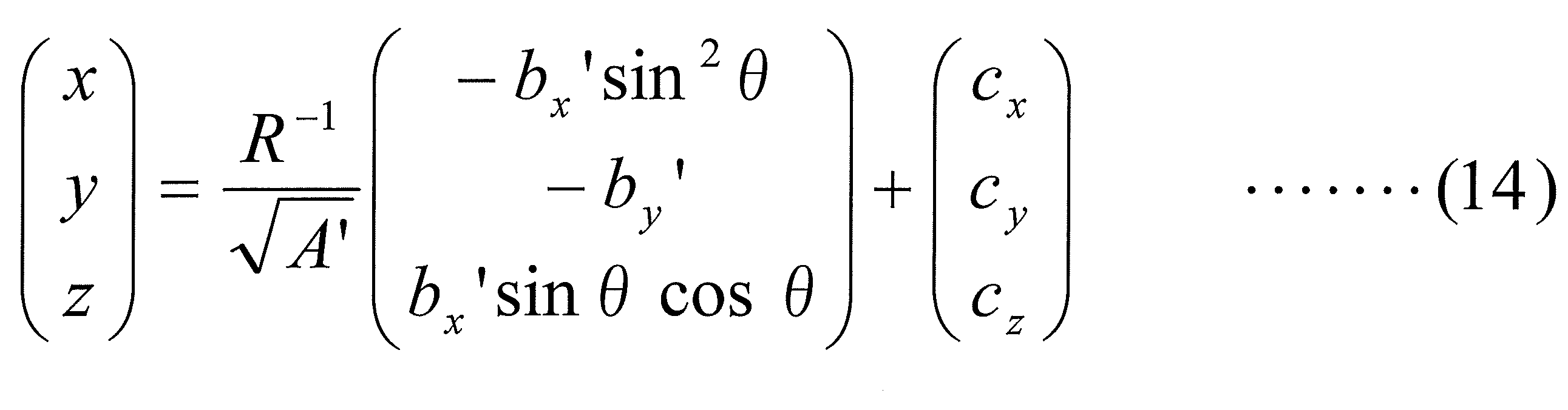

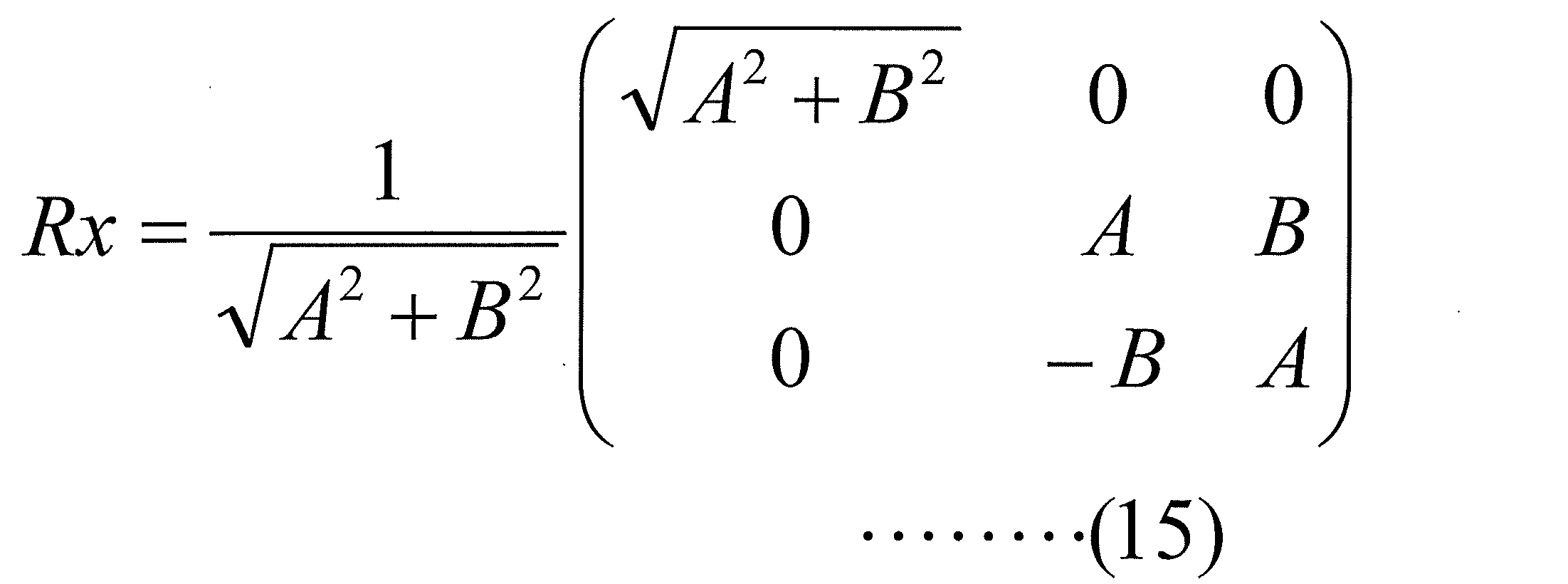

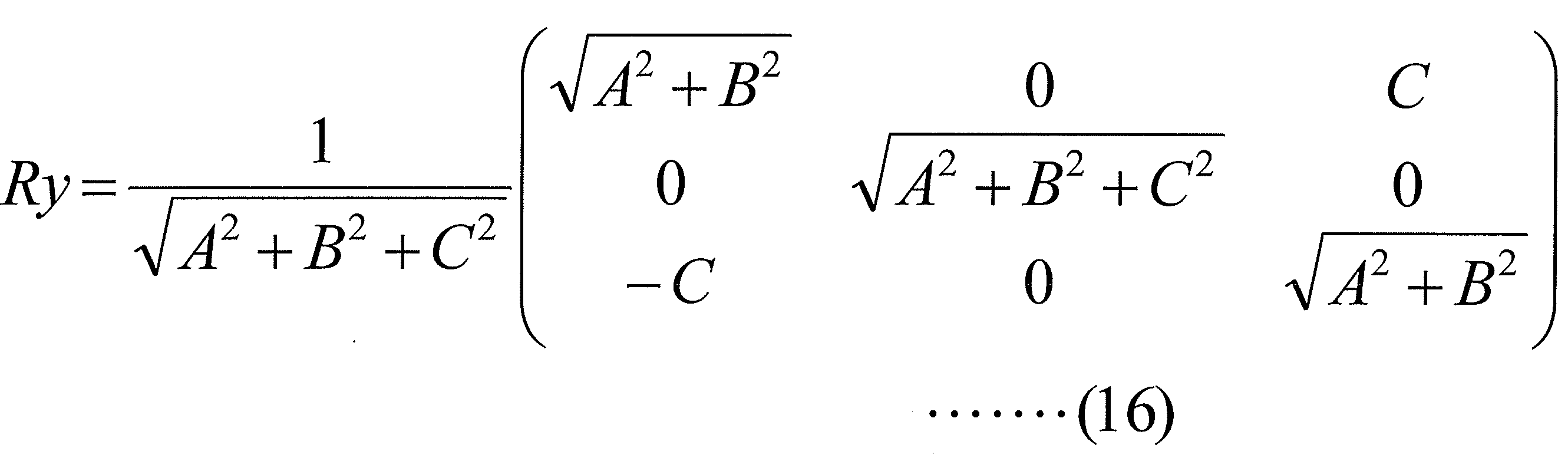

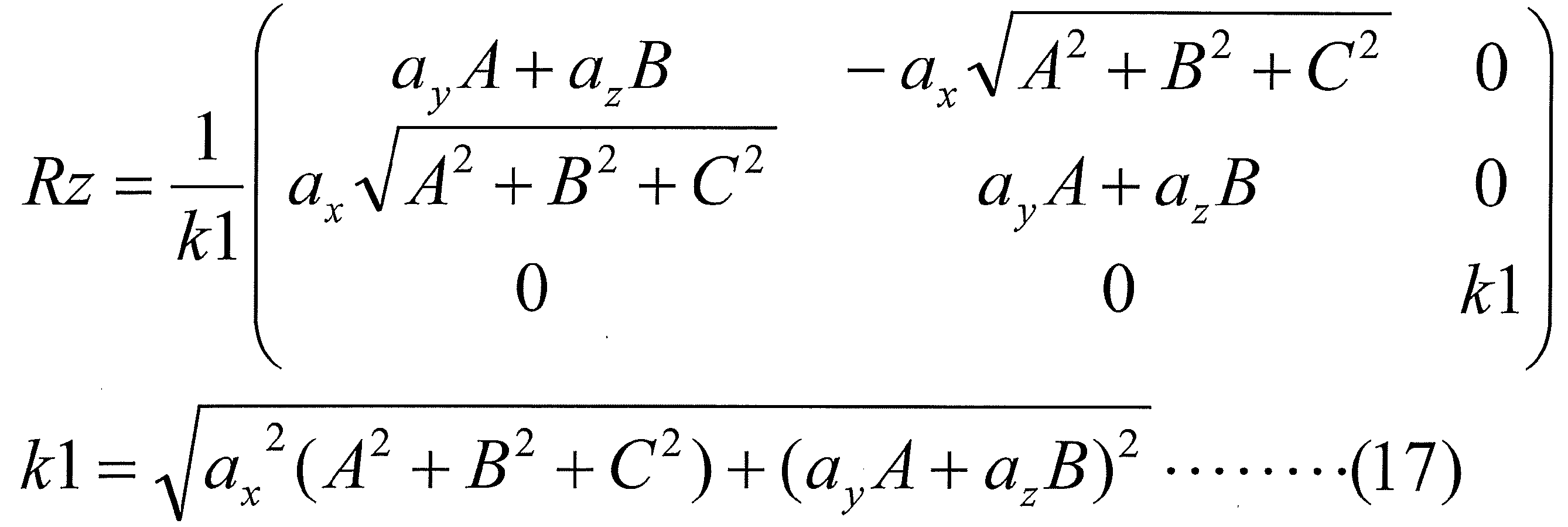

- image conversion process to be executed may be realized by the following process, for example.

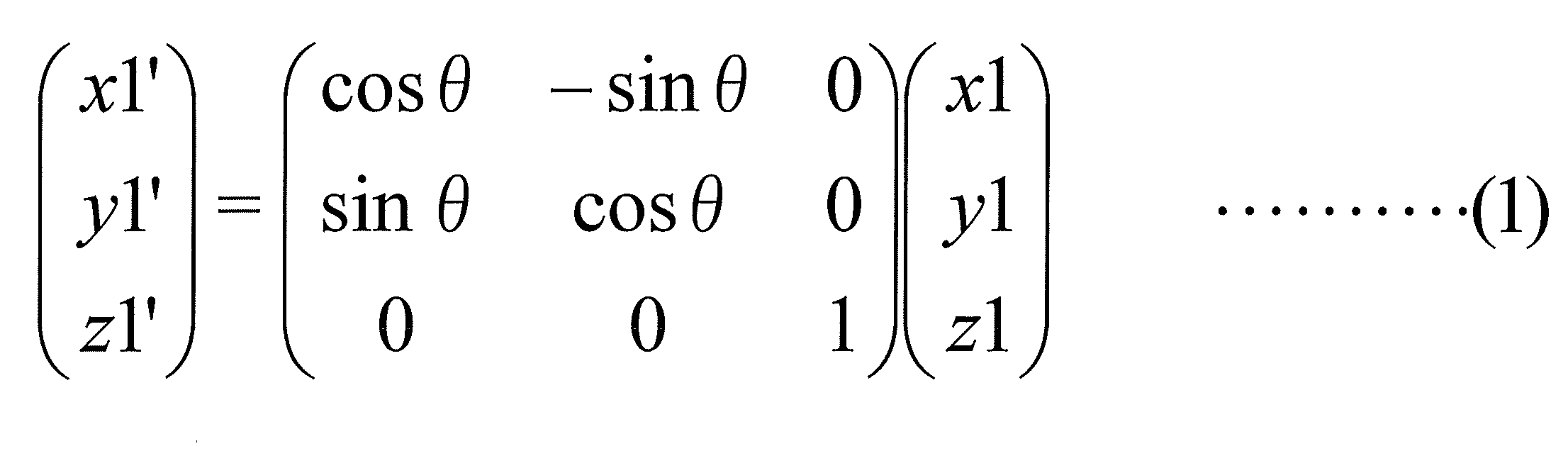

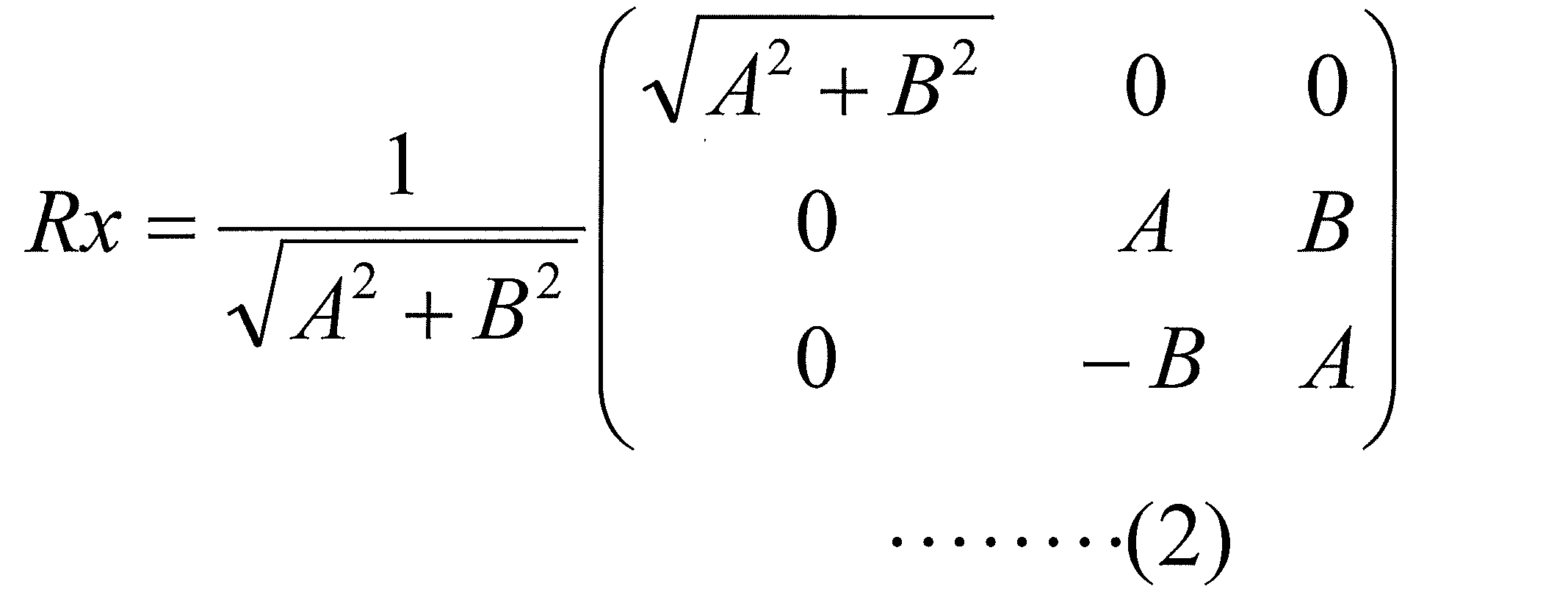

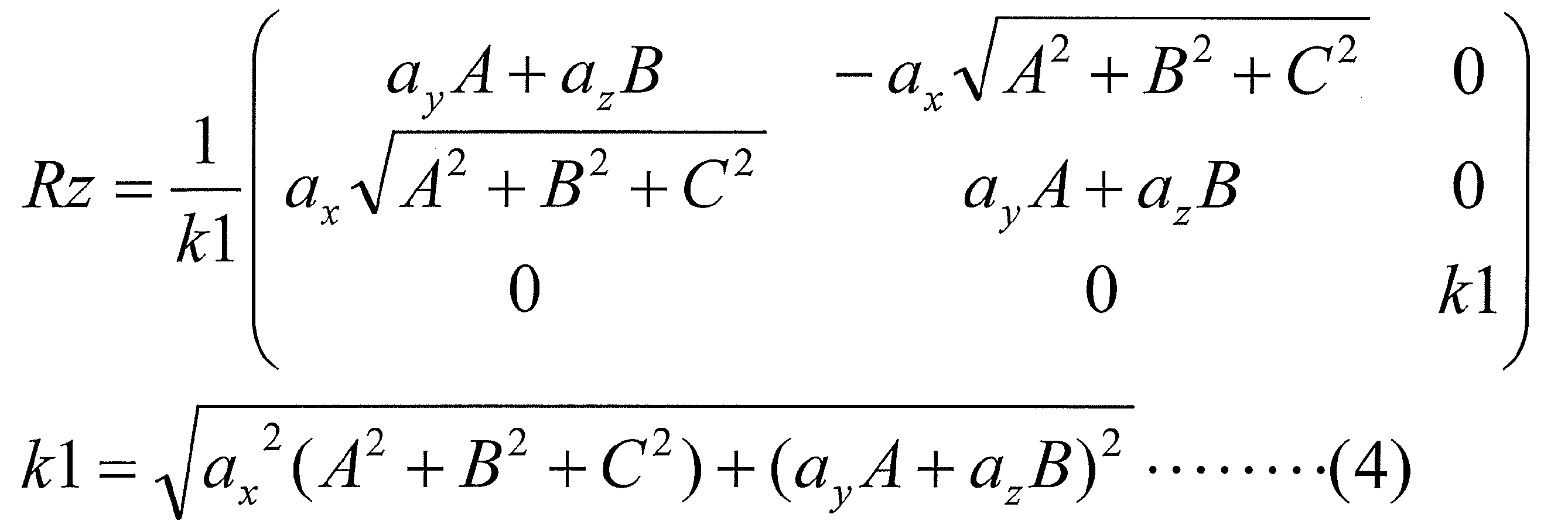

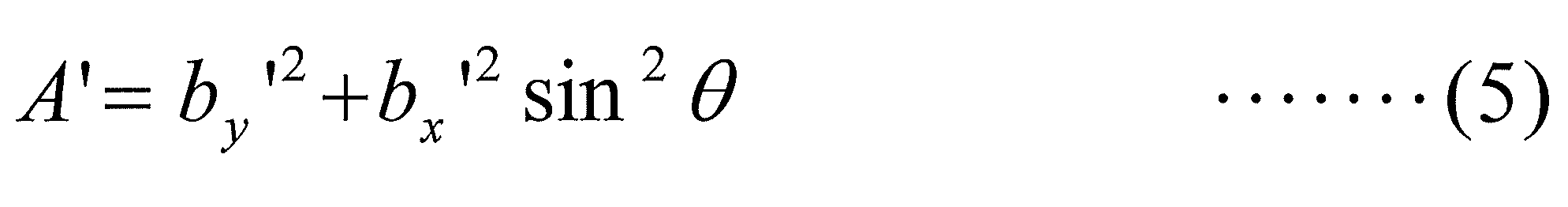

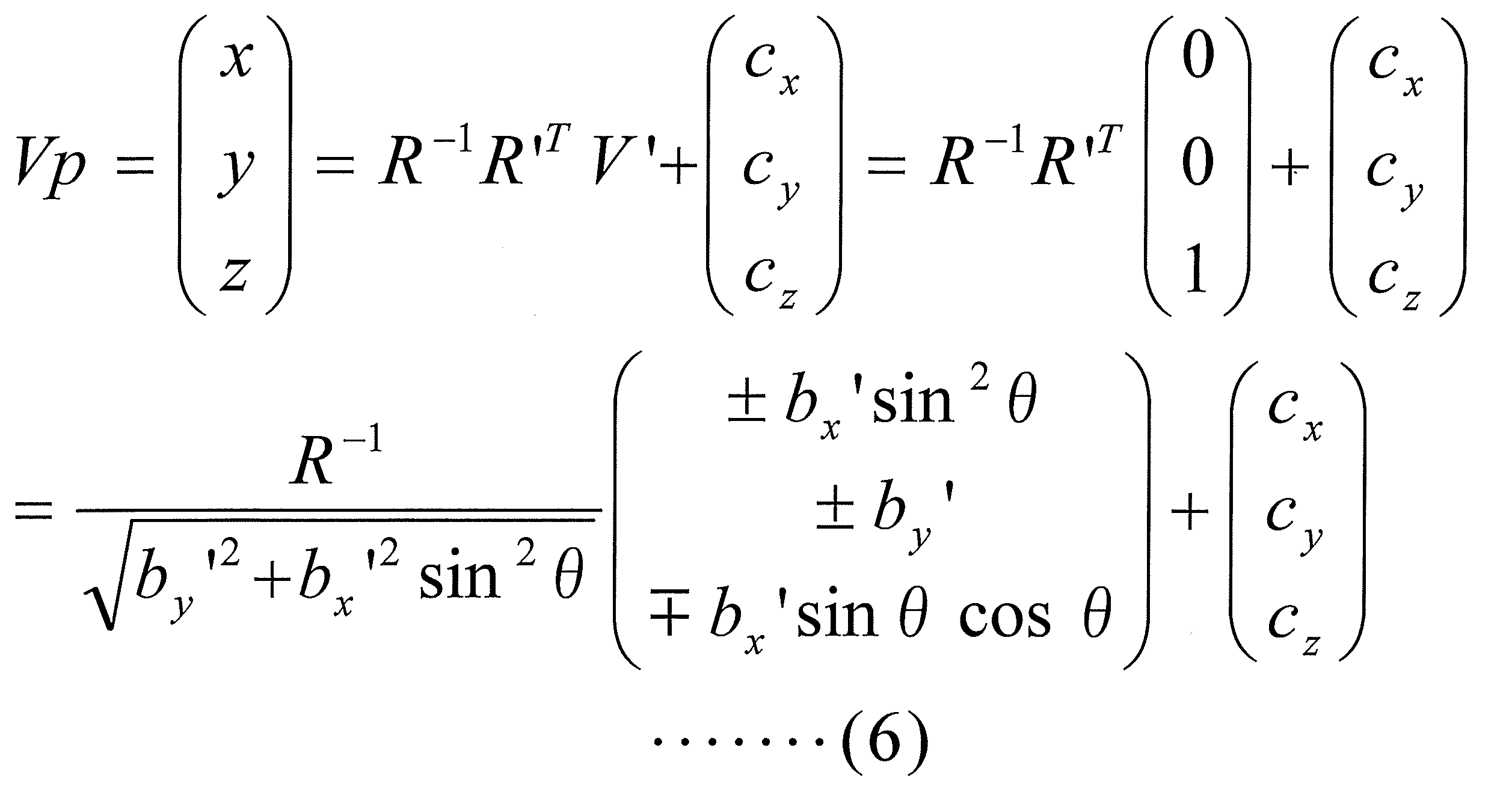

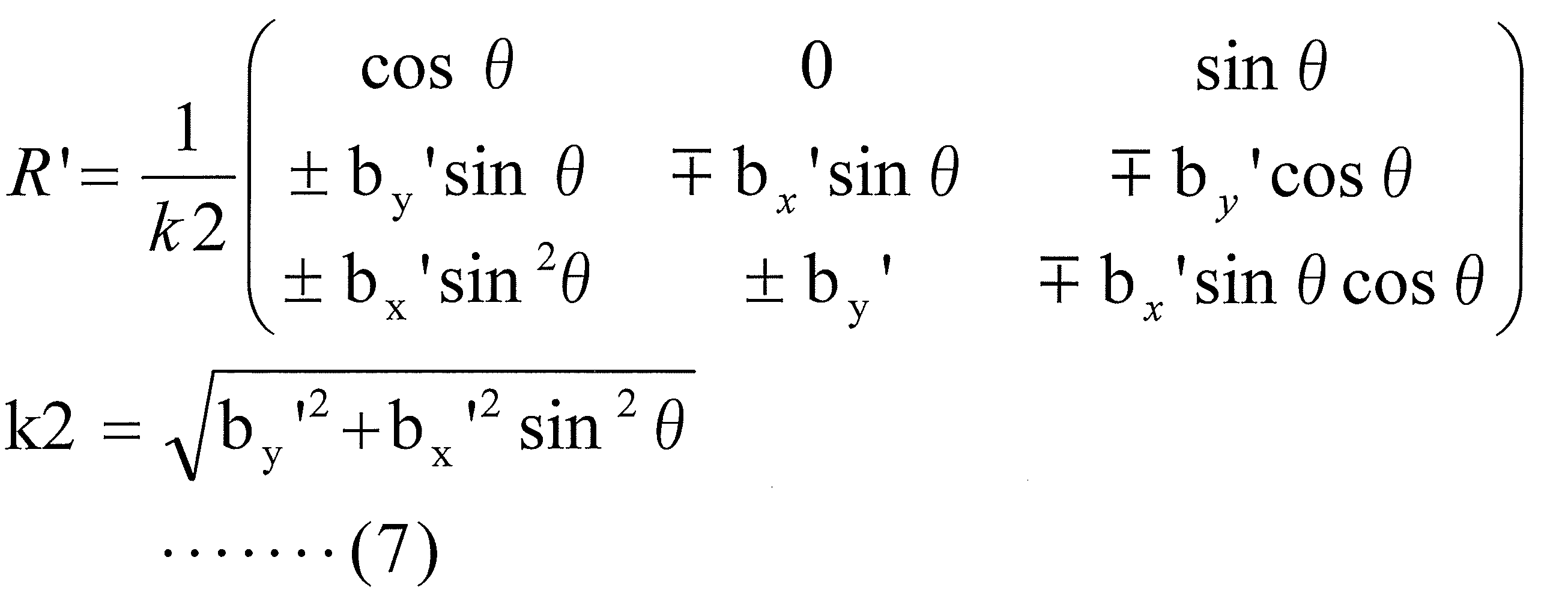

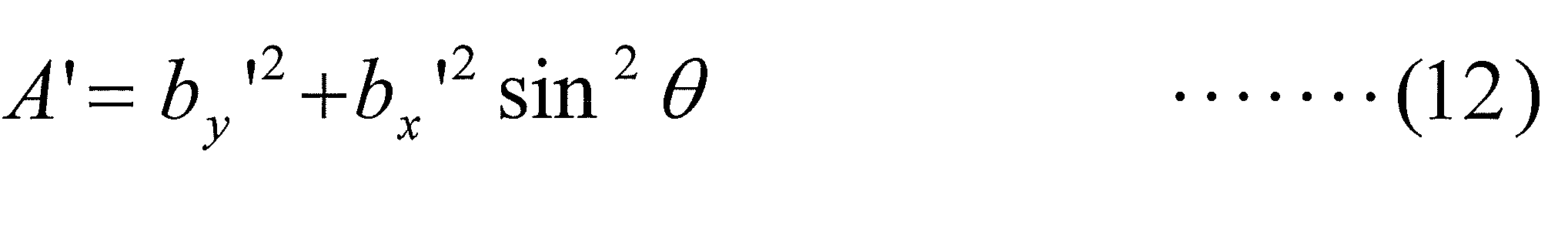

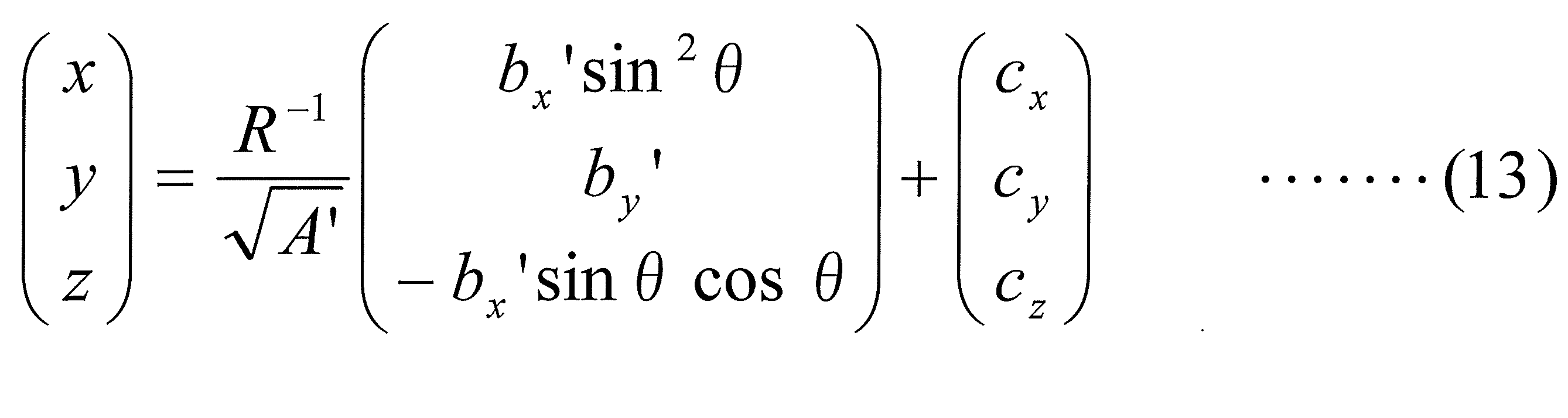

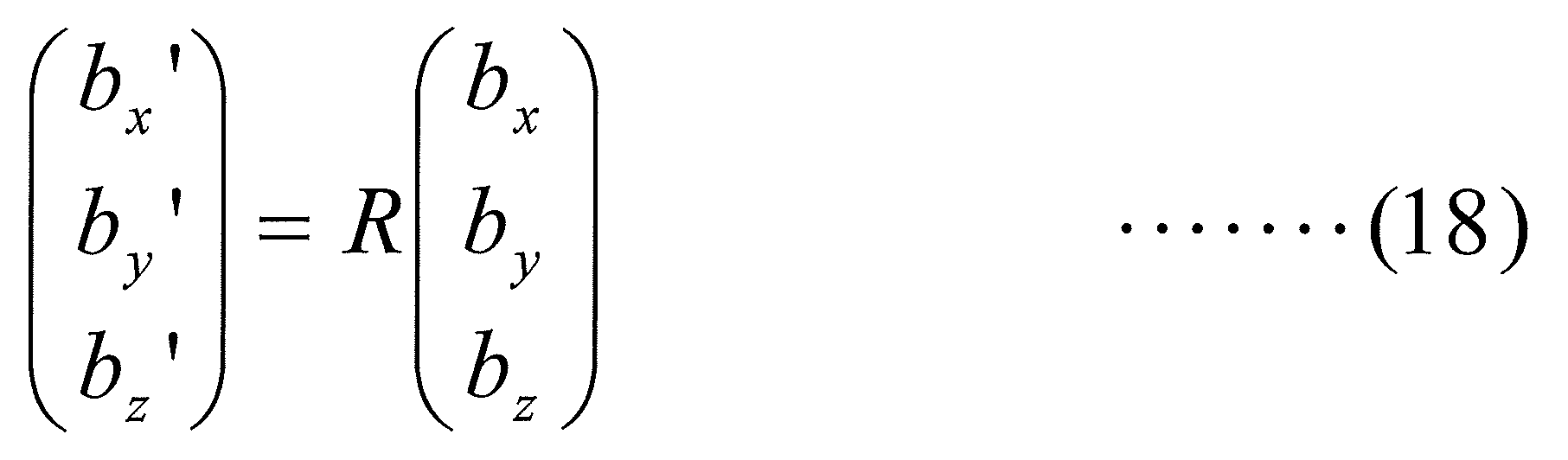

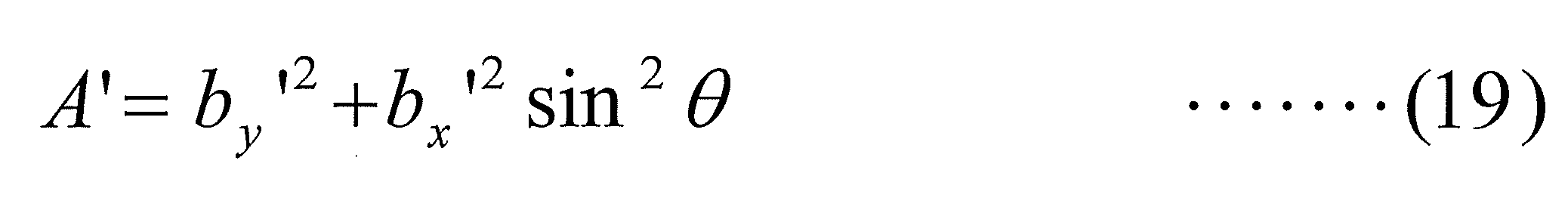

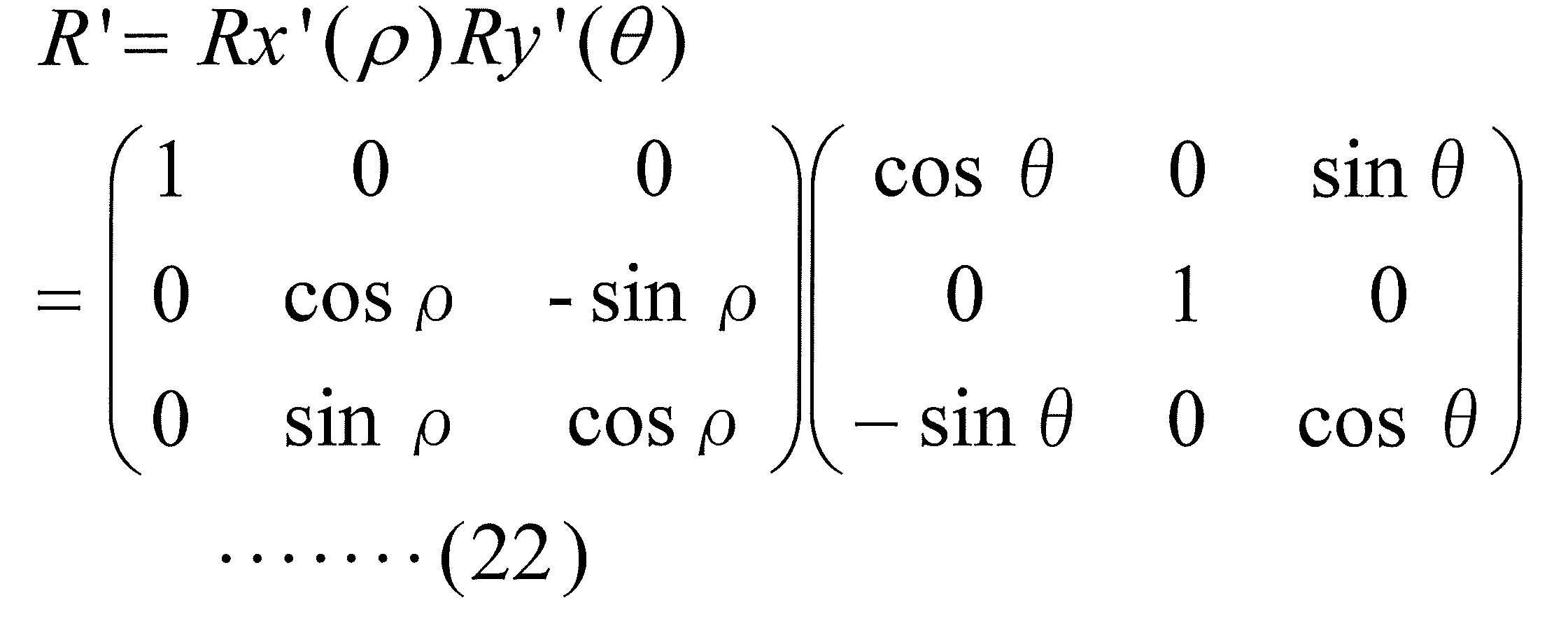

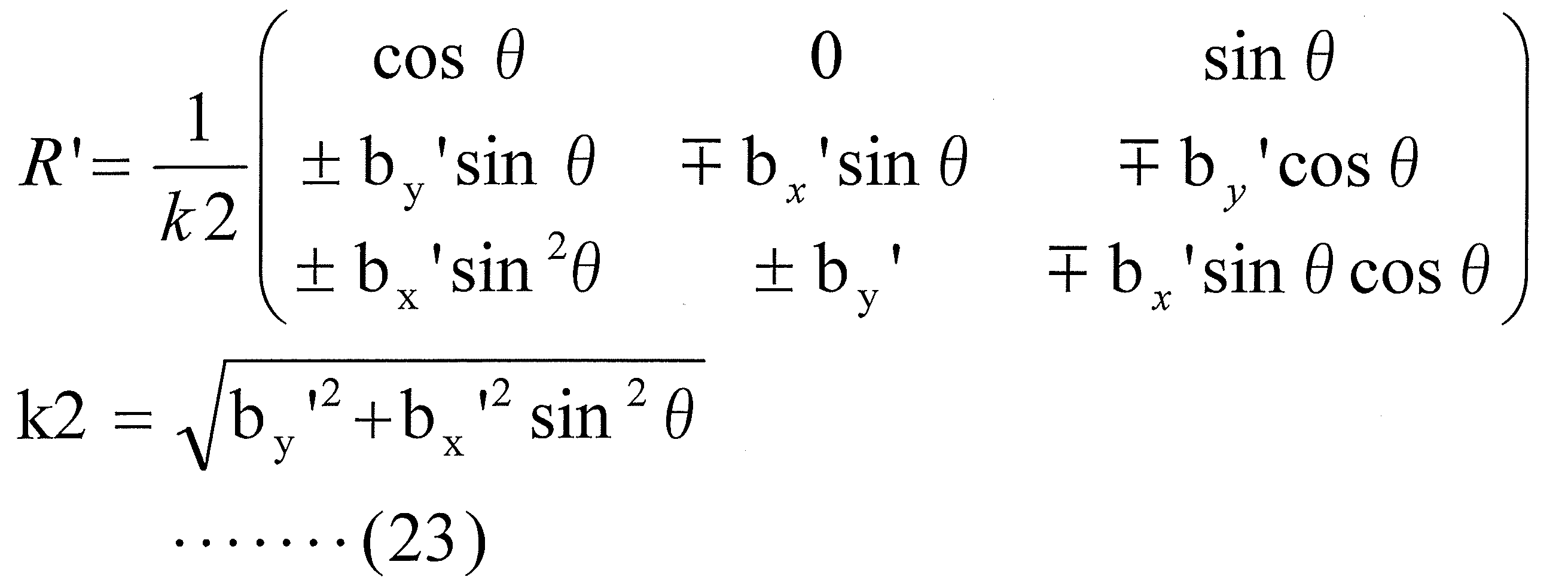

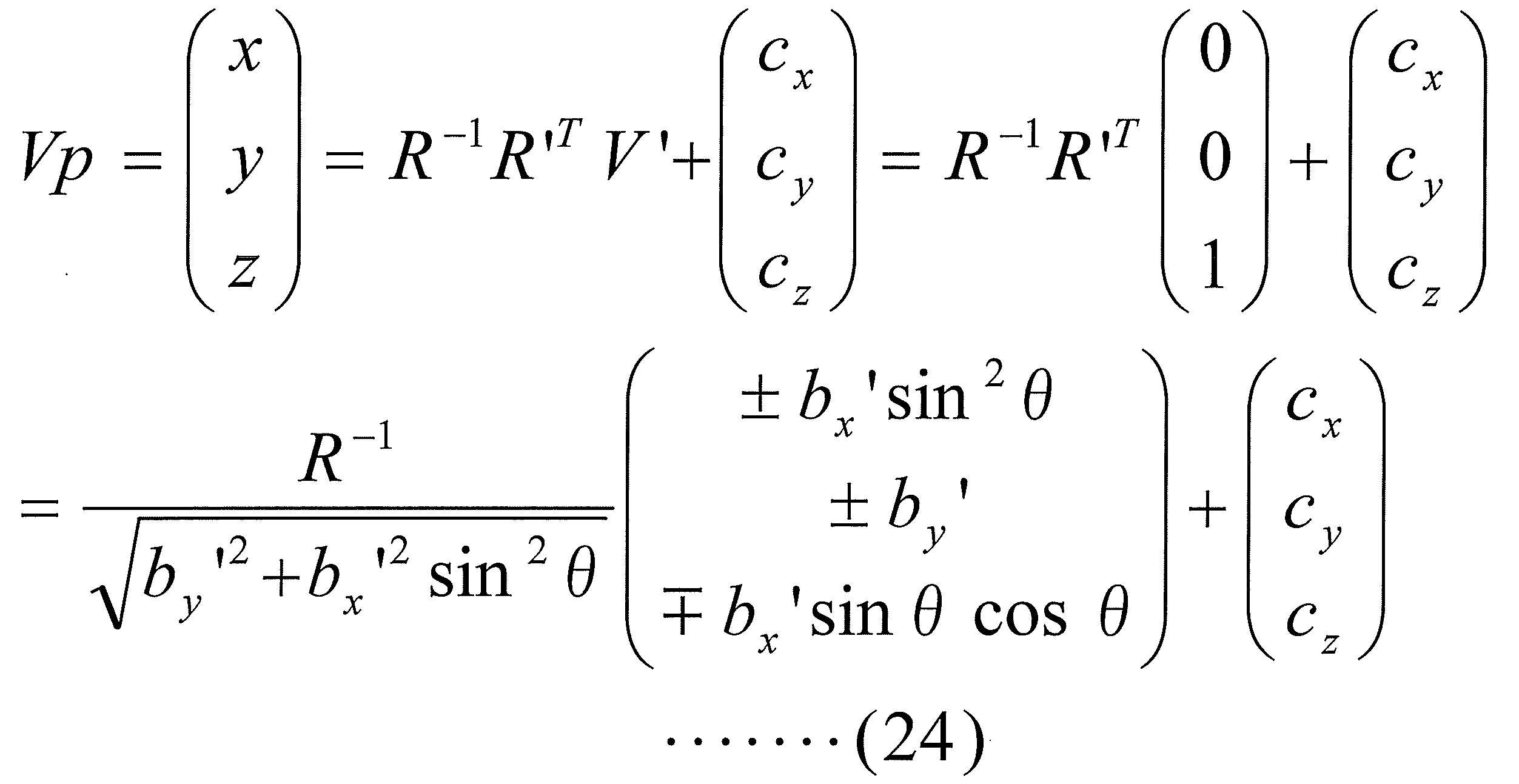

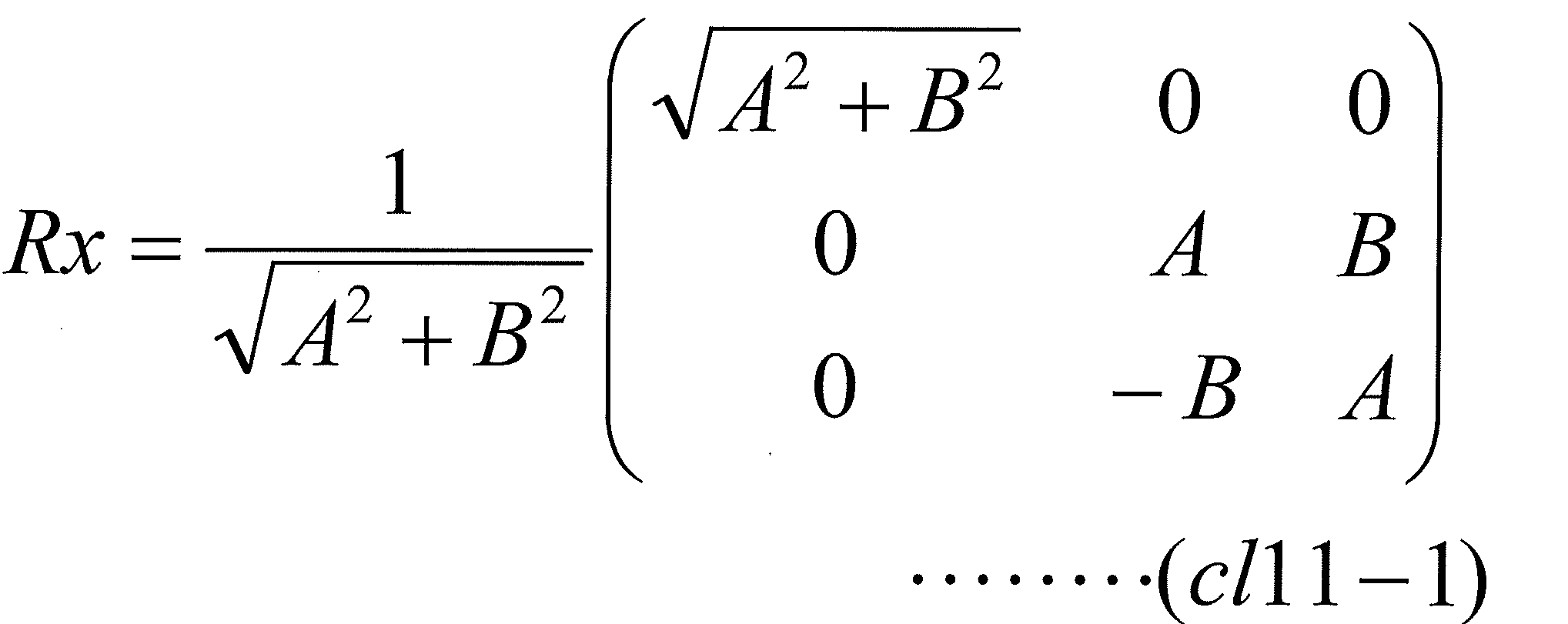

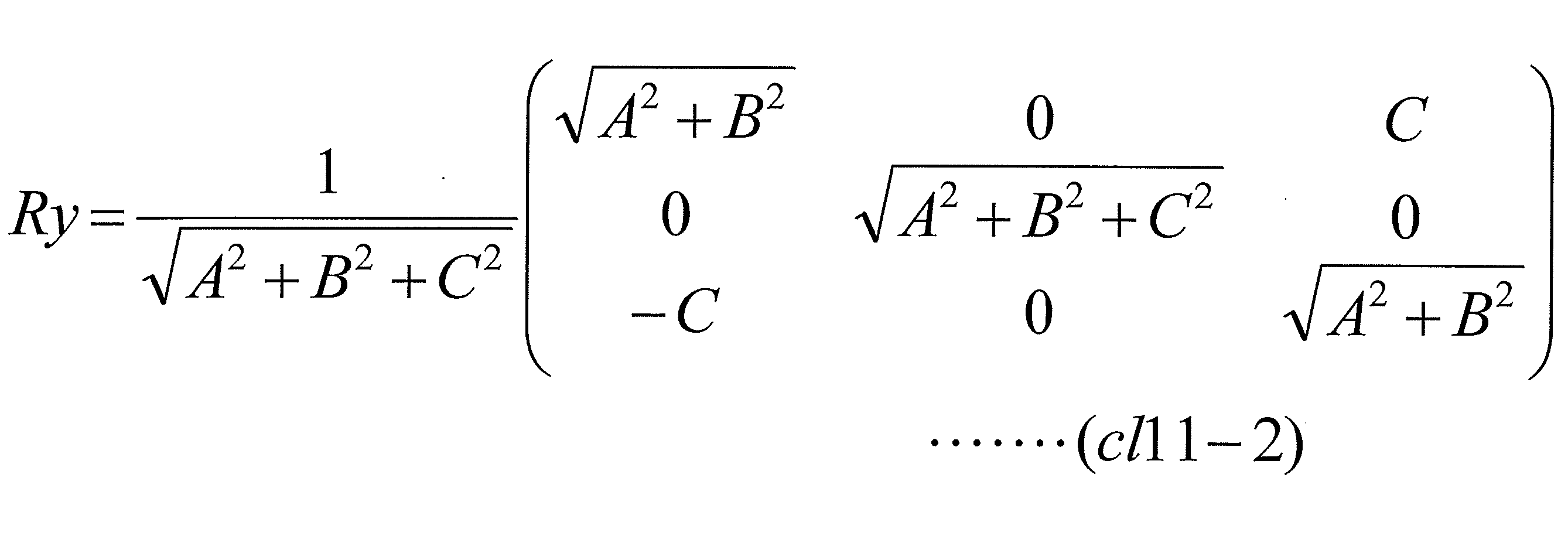

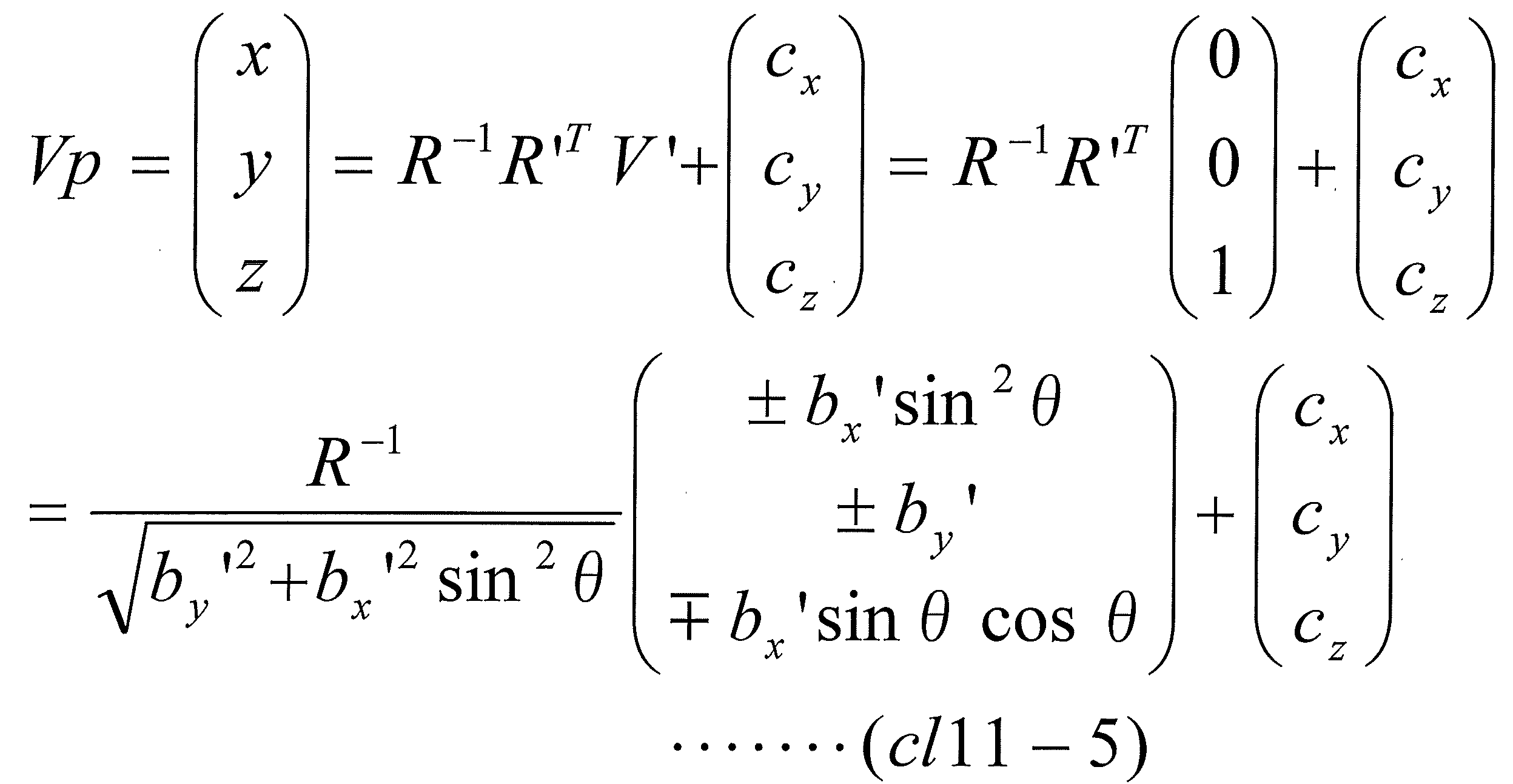

- the three-dimensional space is defined as xyz coordinates

- the projection plane is set on the xy plane, and after correction processing If the coordinates of the pixel Px of the test image of (x1, y1, z1) and (x1 ′, y1 ′, z1 ′) after the image conversion processing of the pixel Px are (x1 ′, y1 ′, z1 ′), the processing corresponding to the following (Formula 1) By performing the above, the “image conversion process” may be executed.

- test image after correction processing is rotated around the z axis by an angle ⁇ .

- a rotated image can be acquired.

- 2nd invention is 1st invention, Comprising:

- the test image is an image containing the vertical reference line extended in the vertical direction on an image in the state currently displayed on the display screen.

- the projection image adjustment unit determines a distortion reduction amount according to the control signal, and is a plane including a vertical reference line of the projection image projected on the projection plane, and determines the projection plane from a point included in the plane perpendicular to the projection plane.

- a first distance that is the length of the projected image in a direction orthogonal to the vertical reference line passing through the first orthogonal point that is one point on the vertical reference line by an amount corresponding to the distortion reduction amount;

- the difference from the second distance which is the length of the projected image in the direction orthogonal to the vertical reference line, passes through the second orthogonal point other than the first orthogonal point on the vertical reference line (the vertical reference line).

- the image conversion process is applied to the test image after the rotation process. Performing the keystone correction process.

- a test image showing the upper part when displayed is projected onto a projection plane (for example, a horizontal projection plane such as a horizontal ceiling plane) parallel to a straight line connecting the left eye viewpoint and the right eye viewpoint.

- the user uses the controller to (1) execute the process of rotating the projection image within the projection plane, and (2) execute the trapezoidal correction process for the image projected on the projection plane, thereby projecting onto the projection plane. It is possible to eliminate (reduce) the geometric distortion of the image.

- a plane parallel to the straight line connecting the left eye viewpoint and the right eye viewpoint is projected onto the projection plane (for example, a horizontal projection plane such as a horizontal ceiling plane) without using a device having a photographing function. Therefore, the geometric distortion of the image can be eliminated (reduced) easily and appropriately.

- the geometric distortion occurring in the direction orthogonal to the vertical reference line is reduced means, for example, above the projected image (upward in the vertical direction when the image is displayed)

- the length of the projection image in the direction orthogonal to the line (width of the projection image) and the length of the projection image in the direction orthogonal to the vertical reference line below the projection image (down in the vertical direction when the image is displayed) This includes the concept that the difference from the height (the width of the projected image) is small.

- 3rd invention is 2nd invention, Comprising:

- the projection image adjustment part shows the projection state of the image when projecting the test image in which at least one of the rotation process and the trapezoid correction process was performed on the projection plane.

- a fine adjustment unit for adjustment is provided.

- the fine adjustment unit performs the adjustment process. For example, an error in the three-dimensional shape measurement process is corrected, and a more accurate image projection process (a process for reducing image geometric distortion) is performed. Can be executed.

- test image is an image containing the pattern which can discriminate

- the processing in the projection system can be executed using the test image that can easily distinguish the upper part.

- the fifth invention is the invention of any one of the second to fourth inventions, wherein the test image is an image including a lattice pattern composed of a plurality of square lattice patterns.

- this test image (a grid-like image made up of a square grid) is projected, and, for example, an adjustment process (geometric image geometry) is performed by a controller so as to eliminate geometric distortion of the projected test image. Adjustment processing for reducing a significant distortion). For this reason, in this projection system, by using this test image, adjustment processing (adjustment processing for reducing geometric distortion of the image) can be easily performed by processing that is intuitively understandable.

- 6th invention is 5th invention, Comprising: As for a test image, the 1st grid pattern which has a 1st pattern, and the 2nd grid pattern which has a 2nd pattern have no geometric distortion

- the image includes a grid pattern formed by being alternately arranged in a first direction on the test image and in a second direction orthogonal to the first direction on the test image.

- this test image is projected, and adjustment processing (adjustment processing for reducing geometric distortion of the image) is performed by, for example, a controller so that the geometric distortion of the projected test image is eliminated. Can be executed. For this reason, in this projection system, by using this test image, adjustment processing (adjustment processing for reducing geometric distortion of the image) can be easily performed by processing that is intuitively understandable.

- a seventh invention is a projector device used in the projection system according to any one of the first to fifth inventions, and includes a projection unit and a projection image adjustment unit.

- the projection plane is a plane parallel to the straight line connecting the left-eye viewpoint and the right-eye viewpoint, and the image is such that geometric image distortion is reduced when viewed from the user's viewpoint.

- the projection method includes a projection step, a three-dimensional shape measurement step, a step of generating a control signal based on a user operation, and a projection image adjustment step.

- Projection step projects a test image onto the projection surface.

- the three-dimensional shape of the projection plane is measured.

- the projection image adjustment step is based on the three-dimensional shape data measured in the three-dimensional shape measurement step, passes through the projection center point that is the intersection of the projection axis and the projection plane in the projection step, and is on the normal line of the projection plane

- the correction point which is an image conversion process, is executed on the test image so that the geometric image distortion is reduced.

- the rotation angle is determined according to the control signal, and when the projection surface is viewed from the first point, the projection image on the projection surface in the projection step of the test image after the correction process is the projection center point

- a rotation process which is an image conversion process, is performed on the test image after the correction process so that the image is rotated by the rotation angle determined according to the control signal with the center as the center.

- the ninth invention is the eighth invention, wherein the test image is an image including a vertical reference line extending in a vertical direction on the image in a state of being displayed on the display screen.

- the projection image adjustment step determines a distortion reduction amount according to the control signal, and is a plane including the vertical reference line of the projection image projected on the projection plane, and the projection plane is determined from points included in the plane perpendicular to the projection plane.

- the test image after the rotation processing is reduced so that the geometric distortion occurring in the direction orthogonal to the vertical reference line is reduced by an amount corresponding to the distortion reduction amount determined according to the control signal.

- a keystone correction process which is an image conversion process, is executed.

- a tenth invention is a plane parallel to a plane including a left eye viewpoint and a right eye viewpoint, and projects an inclined plane onto the plane that is a common tangent plane of the right eye cornea and the left eye cornea

- a projection system that projects an image so that geometric image distortion is reduced when viewed from the user's viewpoint, the projection unit, a three-dimensional shape measurement unit, a controller, A projection image adjustment unit.

- the projection unit is a projection unit that projects an image on a projection plane, projects a first test image having a vertical reference line that defines a vertical direction of the image, and has a horizontal reference line that defines a horizontal direction of the image. A second test image is projected.

- the 3D shape measurement unit measures the 3D shape of the projection surface.

- the controller generates control signals based on user operations.

- the projection image adjustment unit performs the following processing.

- the correction point which is an image conversion process, is executed on the first test image so that the geometric image distortion is reduced.

- the projection image adjustment unit determines the first rotation angle according to the control signal, and when the projection surface is viewed from the first point, the projection image of the first test image after the correction processing on the projection surface by the projection unit A first rotation process, which is an image conversion process, is performed on the first test image after the correction process so that becomes an image rotated by the first rotation angle around the projection center point.

- the projection image adjustment unit passes through the projection center point that is the intersection of the projection axis of the projection unit and the projection plane based on the three-dimensional shape data measured by the three-dimensional shape measurement unit, and is on the normal line of the projection plane.

- the projection image adjustment unit determines the second rotation angle according to the control signal, and when the projection surface is viewed from the first point, the projection image of the second test image after the correction processing on the projection surface by the projection unit

- the second rotation process which is an image conversion process, is performed on the second test image after the correction process so that the image is rotated by the second rotation angle about the projection center point.

- the projection image adjustment unit includes a first straight line that is a straight line including a vertical reference line on a projection surface of the first test image after the first rotation process, and a projection surface of the second test image after the second rotation process.

- the viewpoint candidate point at which the first straight line and the second straight line appear to be orthogonal to each other is determined, and the geometry is determined when viewed from the determined viewpoint candidate point.

- the viewpoint specifying process for converting the image projected on the projection plane is executed so that the general image distortion is reduced.

- the viewpoint specifying process is executed as described above, and an image without geometric distortion (an image with reduced geometric distortion) when viewed from the user's viewpoint, for example, an inclined ceiling plane Can be projected.

- 11th invention is 10th invention, Comprising: A projection image adjustment part performs the following processes.

- a point on the first straight line that is a straight line including the vertical reference line on the projection plane of the first test image after the first rotation processing is defined as a point Pa, and the coordinates of the point Pa are defined as (ax, ay, az)

- a point on the second straight line that is a straight line including the horizontal reference line on the projection plane of the second test image after the second rotation processing is defined as a point Pb, and the coordinates of the point Pb are defined as (bx, by, bz)

- A ⁇ ax ⁇ by + ay

- the projection image adjustment unit obtains a point Pb ′ obtained by converting the coordinate (bx, by, bz) of the point Pb by the synthesis matrix, and sets the coordinates of the point Pb ′ as (bx ′, by ′, bz ′). )

- the angle ⁇ is determined based on a control signal from the controller.

- the viewpoint specifying process is executed as described above, and an image without geometric distortion (an image with reduced geometric distortion) when viewed from the user's viewpoint, for example, an inclined ceiling plane Can be projected.

- the twelfth invention is the tenth or eleventh invention, wherein the first test image includes a vertical reference line passing through the center point of the first test image in a state displayed on the display screen.

- the thirteenth invention is the tenth or eleventh invention, wherein the second test image includes a horizontal reference line passing through the center point of the second test image in a state where the second test image is displayed on the display screen.

- a fourteenth aspect of the invention is any one of the tenth to thirteenth aspects of the invention, wherein the first test image is an image including a pattern capable of discriminating an upper portion on the image in a state displayed on the display screen. It is.

- a fifteenth aspect of the invention is any one of the tenth to fourteenth aspects of the invention, in which the projection unit includes a third test image including a lattice pattern composed of a plurality of square lattice patterns when the viewpoint specifying process is executed. Project.

- the degree of distortion of the grid pattern can be easily grasped, and the degree of distortion of the projected image can be easily recognized.

- 16th invention is 15th invention, Comprising: As for 3rd test image, the 1st lattice pattern which has a 1st pattern, and the 2nd lattice pattern which has a 2nd pattern are geometric distortion.

- the image In a state where there is no image, the image includes a grid pattern formed by being alternately arranged in a first direction on the test image and in a second direction orthogonal to the first direction on the test image.

- the degree of distortion of the grid pattern can be easily grasped, and the degree of distortion of the projected image can be easily recognized.

- the seventeenth aspect of the invention is a projector apparatus used in the projection system according to any one of the tenth to sixteenth aspects of the invention, comprising a projection unit and a projection image adjustment unit.

- An eighteenth aspect of the invention is a projection method executed using a controller that generates a control signal based on a user's operation, and is a plane parallel to a plane including a left eye viewpoint and a right eye viewpoint, and the right eye With respect to the plane that is the common tangential plane of the cornea and the left eye cornea, the image is such that the inclined plane is the projection plane and geometric image distortion is reduced when viewed from the user's viewpoint.

- This is a program for executing a projection method for projecting with a computer.

- the projection method includes a projection step, a three-dimensional shape measurement step, a controller, and a projection image adjustment step.

- the projecting step is a projecting step of projecting an image on a projection surface, projecting a first test image having a vertical reference line that defines the vertical direction of the image, and having a horizontal reference line that defines the horizontal direction of the image.

- a second test image is projected.

- 3D shape measurement step measures the 3D shape of the projection surface.

- the projection image adjustment step executes the following processing.

- (1A) The projection image adjustment step passes through a projection center point that is an intersection of a projection axis and a projection plane for projecting an image in the projection step based on the three-dimensional shape data measured in the three-dimensional shape measurement step.

- a correction process that is an image conversion process is performed on the first test image so that geometric image distortion is reduced when viewed from the first point that is a point on the normal line of the projection plane.

- the projection image adjustment step determines the first rotation angle according to the control signal, and when the projection surface is viewed from the first point, the projection image on the projection surface by the projection step of the first test image after the correction processing

- a first rotation process which is an image conversion process, is performed on the first test image after the correction process so that becomes an image rotated by the first rotation angle around the projection center point.

- the projection image adjustment step passes through the projection center point that is the intersection of the projection axis and the projection plane for projecting the image in the projection step based on the three-dimensional shape data measured in the three-dimensional shape measurement step.

- a correction process which is an image conversion process, is performed on the second test image so that the geometric image distortion is reduced when viewed from the first point that is a point on the normal line of the projection plane.

- the projection image adjustment step determines the second rotation angle according to the control signal, and when viewing the projection surface from the first point, the projection image on the projection surface by the projection step of the second test image after the correction process.

- the second rotation process which is an image conversion process, is performed on the second test image after the correction process so that the image is rotated by the second rotation angle about the projection center point.

- the projection image adjustment step includes a first straight line that is a straight line including a vertical reference line on the projection surface of the first test image after the first rotation processing, and a projection surface of the second test image after the second rotation processing. Based on the second straight line including the upper vertical reference line, the viewpoint candidate point at which the first straight line and the second straight line appear to be orthogonal to each other is determined, and the geometry is determined when viewed from the determined viewpoint candidate point.

- the viewpoint specifying process for converting the image projected on the projection plane is executed so that the general image distortion is reduced.

- projection is performed on a horizontal projection plane (for example, a horizontal ceiling) or a plane parallel to a straight line connecting both eyes of the user (for example, a front tilt plane or a rear tilt plane) without using a device having a photographing function. It is possible to realize a projection system, a projector apparatus, and a program that can easily and appropriately reduce geometric distortion of a captured image.

- a horizontal projection plane for example, a horizontal ceiling

- a plane parallel to a straight line connecting both eyes of the user for example, a front tilt plane or a rear tilt plane

- a projection system and a projector apparatus that can easily and appropriately reduce geometric distortion of an image projected on an inclined plane (for example, an inclined ceiling) without using a device having a photographing function. And a program can be realized.

- FIG. 1 is a schematic configuration diagram of a projection system 1000 according to a first embodiment.

- 1 is a schematic configuration diagram of a projection image adjustment unit 1 of a projector apparatus 100 of a projection system 1000 according to a first embodiment.

- the figure which showed the three-dimensional space in the state 1 typically.

- FIG. The schematic block diagram of the projection system 1000A which concerns on the 1st modification of 1st Embodiment.

- the schematic block diagram of 1 A of projection image adjustment parts which concern on the 1st modification of 1st Embodiment.

- the schematic block diagram of the projection system 2000 which concerns on 2nd Embodiment.

- the figure which showed three-dimensional space typically.

- the figure which showed the three-dimensional space in the state 1 typically.

- FIG. The figure which shows 2nd test image Img1_T2.

- the figure which showed the three-dimensional space in the state 4 typically.

- FIG. 4 is a flowchart showing a projection method executed by the projection system 2000.

- FIG. The figure for demonstrating the principle of a viewpoint specific process.

- FIG. 1 is a schematic configuration diagram of a projection system 1000 according to the first embodiment.

- FIG. 2 is a schematic configuration diagram of the projection image adjustment unit 1 of the projector apparatus 100 of the projection system 1000 according to the first embodiment.

- the projection system 1000 includes a projector device 100 and a controller 200 as shown in FIG.

- the projector device 100 includes a projection image adjustment unit 1, a test image storage unit 2, a projection unit 3, a three-dimensional shape measurement unit 4, a three-dimensional shape data storage unit 5, and a first And an interface 6.

- the projection image adjustment unit 1 includes a first selector 11, a correction unit 12, a switch 13, a rotation processing unit 14, a second selector 15, a trapezoidal correction processing unit 16, A third selector 17 and a fourth selector 18.

- the first selector 11 inputs an image Din (image signal Din) input to the projector device 100, a test image Img1 output from the test image storage unit 2, and a selection signal sel1.

- the first selector 11 selects either the image Din or the test image Img1 according to the selection signal sel1, and outputs the selected image (image signal) to the correction unit 12 as an image D1 (image signal D1).

- the selection signal sel1 is a control signal generated by a control unit (not shown) that controls each functional unit of the projector device 100.

- the correction unit 12 inputs the image D1 output from the first selector 11, the three-dimensional shape data 3D_data output from the three-dimensional shape data storage unit 5, and the information P_prj about the projection point of the projection unit 3. .

- the correction unit 12 performs correction processing on the image D1 based on the three-dimensional shape data 3D_data and the information P_prj about the projection point. Then, the correction unit 12 outputs the corrected image as an image D2 (image signal D2) to the second selector 15 and the rotation processing unit 14.

- the switch 13 receives the signal Sig1 output from the first interface 6 and the selection signal sel2.

- the switch 13 outputs the signal Sig1 to the rotation processing unit 14 or the trapezoidal correction processing unit 16 in accordance with the selection signal sel2.

- the selection signal sel2 is a control signal generated by a control unit that controls each functional unit of the projector device 100.

- the rotation processing unit 14 includes an image D2 output from the correction unit 12, three-dimensional shape data 3D_data output from the three-dimensional shape data storage unit 5, information P_prj about the projection point of the projection unit 3, and a switch 13

- the signal Sig1 output from is input.

- the rotation processing unit 14 performs a rotation process on the image D2 based on the three-dimensional shape data 3D_data and the information P_prj about the projection point of the projection unit 3. Then, the rotation processing unit 14 outputs the processed image to the second selector 15 as an image D21 (image signal D21).

- the second selector 15 receives the image D2 output from the correction unit 12, the image D21 output from the rotation processing unit 14, and the selection signal sel3.

- the second selector 15 selects either the image D2 or the image D21 according to the selection signal sel3, and the selected image is set as the image D3 (image signal D3), the trapezoid correction processing unit 16, the third selector 17, Output to.

- the selection signal sel3 is a control signal generated by a control unit that controls each functional unit of the projector device 100.

- the trapezoidal correction processing unit 16 switches the image D3 output from the second selector 15, the three-dimensional shape data 3D_data output from the three-dimensional shape data storage unit 5, and the information P_prj about the projection point of the projection unit 3.

- the signal Sig1 output from the device 13 is input.

- the trapezoid correction processing unit 16 performs the trapezoid correction processing on the image D3 based on the three-dimensional shape data 3D_data and the information P_prj about the projection point of the projection unit 3. Then, the trapezoid correction processing unit 16 outputs the processed image to the third selector 17 as an image D31 (image signal D31).

- the third selector 17 receives the image D3 output from the second selector 15, the image D31 output from the trapezoid correction processing unit 16, and the selection signal sel4.

- the third selector 17 selects one of the image D3 and the image D31 according to the selection signal sel4, and outputs the selected image to the fourth selector 18 as an image D4 (image signal D4).

- the selection signal sel4 is a control signal generated by a control unit that controls each functional unit of the projector device 100.

- the fourth selector 18 inputs the image D4 output from the third selector 17, the test image Img0 output from the test image storage unit 2, and the selection signal sel5.

- the fourth selector 18 selects either the image D4 or the test image Img0 according to the selection signal sel5, and outputs the selected image to the projection unit 3 as an image Dout (image signal Dout).

- the selection signal sel5 is a control signal generated by a control unit that controls each functional unit of the projector device 100.

- the test image storage unit 2 stores a test image, and outputs a test image to the projection image adjustment unit 1 at a predetermined timing in accordance with a request from the projection image adjustment unit 1.

- the projection unit 3 has an optical system for projecting an image.

- the projection unit 3 receives the image Dout (image signal Dout) output from the fourth selector 18 of the projection image adjustment unit 1, and projects the input image Dout (image signal Dout) onto a projection target in a three-dimensional space. .

- the 3D shape measurement unit 4 acquires the 3D measurement data of the projection target in the 3D space, and outputs the acquired 3D measurement data of the projection target to the 3D shape data storage unit 5.

- the three-dimensional shape measurement unit 4 includes, for example, a camera, picks up a three-dimensional shape measurement test image projected from the projection unit 3, and based on the picked-up image of the three-dimensional shape measurement test image. The three-dimensional measurement data to be projected is acquired.

- the three-dimensional shape measurement unit 4 may, for example, (1) obtain a normal line of the projection plane and clarify the positional relationship between the projection unit 3 and the projection plane, or (2) a projection axis (projection unit) of the projection unit 3 3) is obtained, and the positional relationship between the projection unit 3 and the projection plane is clarified, thereby obtaining three-dimensional measurement data of the projection target (projection plane).

- the three-dimensional shape measuring unit 4 acquires three-dimensional measurement data to be projected by acquiring a distance image by a TOF (Time Of Flight) method (for example, a phase difference method of TOF method). Also good.

- the three-dimensional shape measuring unit 4 includes, for example, a light source that emits infrared rays and an image sensor for infrared rays. The reflected infrared rays emitted from the light sources are received by the image sensor and irradiated. The distance image is acquired by measuring the time until the infrared rays are reflected from the projection target and returned. Then, the three-dimensional shape measurement unit 4 acquires the three-dimensional measurement data to be projected from the acquired distance image.

- a TOF Time Of Flight

- the three-dimensional shape measuring unit 4 has a laser light source and a laser sensor, and acquires the three-dimensional measurement data of the projection target by measuring the distance of the projection target from the flight time of the laser light. There may be.

- the three-dimensional shape measuring unit 4 irradiates the laser light on the projection target while sequentially changing the irradiation direction (scanning the projection target with the laser light), and the laser light is reflected on the projection target and returns. By measuring the time until, the distance of the projection target is measured, and the three-dimensional measurement data of the projection target is acquired.

- the 3D shape data storage unit 5 receives the projection target 3D measurement data acquired by the 3D shape measurement unit 4 and stores the input projection target 3D measurement data.

- the three-dimensional shape data storage unit 5 outputs the three-dimensional measurement data to the correction unit 12, the rotation processing unit 14, and the trapezoid correction processing unit 16 in accordance with requests from the correction unit 12, the rotation processing unit 14, and the trapezoid correction processing unit 16. To do.

- the first interface 6 is an interface between the projector device 100 and the controller 200. For example, a signal output from the controller 200 can be input to the projector device 100 via the first interface 6.

- the controller 200 includes a second interface 21, a control unit 22, and a user interface 23.

- the second interface 21 is an interface between the controller 200 and the projector device 100.

- the control unit 22 is a control unit that controls each functional unit of the controller 200.

- the user interface 23 generates a signal corresponding to a user operation. For example, when the user presses a predetermined button provided on the controller, the user interface 23 generates a signal indicating that the button has been pressed.

- the operation of the projection system 1000 will be described assuming that the projection target is the three-dimensional space shown in FIG.

- FIG. 3 is a diagram schematically showing a three-dimensional space, and shows a ceiling CL (horizontal ceiling CL) to be projected, a projector device 100, and a user Usr on the floor FL.

- the ceiling CL horizontal ceiling CL

- the ceiling CL is a plane and is parallel to the floor FL that is a plane.

- the projection point of the projection unit 3 of the projector device 100 is indicated as a point P_prj

- the measurement point of the three-dimensional shape measurement unit 4 of the projector device 100 is indicated as a point P_msr.

- the intersection point between the optical axis (projection axis) Ax1 of the optical system of the projection unit 3 and the horizontal ceiling (plane) CL is defined as a point Pc, and the user's viewpoint position (the center point of both eyes of the user) is set. This is shown as a point Vp.

- an intersection point between a normal line Nm1 of the horizontal ceiling plane CL and a plane parallel to the floor plane FL and including the point Vp is indicated as a point P1.

- the distance between the position of the left eye of the user Usr and the point Pc is equal to the distance between the position of the right eye of the user Usr and the point Pc.

- the 3D shape measurement unit 4 has a camera, takes a test image for 3D shape measurement projected from the projection unit 3, and takes a test image for 3D shape measurement. The case where the three-dimensional measurement data to be projected is acquired based on the captured image will be described.

- the test image Img0 for measuring the three-dimensional shape is output from the test image storage unit 2 to the fourth selector 18 of the projection image adjustment unit 1.

- the control unit generates a selection signal sel 5 for selecting the terminal 0 of the fourth selector 18 shown in FIG. 2 and outputs the selection signal sel 5 to the fourth selector 18. Accordingly, the test image Img0 for measuring the three-dimensional shape is output from the fourth selector 18 to the projection unit 3 as the image signal Dout.

- the projection unit 3 uses the test image Img0 for measuring the three-dimensional shape as (A) the projection axis (the optical axis of the optical system of the projection unit 3) as the axis Ax1 shown in FIG. 3, and (B) the angle of view in FIG. And (C) a projection point is projected as a point P_prj shown in FIG. 3 onto the horizontal ceiling plane CL that is the projection target.

- the 3D shape measurement unit 4 captures the 3D shape measurement test image Img0 projected by the projection unit 3 with the 3D shape measurement camera whose imaging point is the point P_msr. Then, the three-dimensional shape measuring unit 4 acquires the three-dimensional measurement data to be projected by comparing the captured image with the test image Img0 for measuring the three-dimensional shape.

- the coordinates of the three-dimensional space of the projection point P_prj are known, the coordinates of the three-dimensional space of the imaging point P_msr of the three-dimensional shape measurement unit 4 are known, and a test image for three-dimensional shape measurement to be projected Since Img0 is known, the coordinates of the projection target three-dimensional space can be calculated from the image captured at the imaging point P_msr. That is, by examining which pixel of the image captured at the imaging point P_msr corresponds to each pixel of the test image Img0 for measuring the three-dimensional shape, a three-dimensional spatial position corresponding to each pixel (light corresponding to each pixel). Can be identified. Therefore, by specifying the three-dimensional space position corresponding to each pixel, the coordinates of the projection target three-dimensional space can be calculated.

- test image Img0 for three-dimensional shape measurement may be an image formed by a sine wave signal having a predetermined period, for example.

- a plurality of images in which the period and phase of the sine wave signal are changed at a predetermined timing are projected from the projection unit 3 onto the projection target, and the three-dimensional shape measurement unit 4 uses the projected plurality of images, You may make it acquire the three-dimensional shape data of a projection object.

- the 3D shape data to be projected acquired by the 3D shape measurement unit 4 is output from the 3D shape measurement unit 4 to the 3D shape data storage unit 5 and stored in the 3D shape data storage unit 5. Is done.

- the test image Img 1 is output from the test image storage unit 2 to the first selector 11. Then, the control unit generates a selection signal sel1 for selecting the terminal 0 shown in FIG. 2 of the first selector 11, and outputs the selection signal sel1 to the first selector 11. Thereby, the test image Img1 is output from the first selector 11 to the correction unit 12 as the image signal D1.

- FIG. 4 shows an example of the test image Img1.

- the test image Img1 includes a first grid pattern that is a white square pattern and a second grid pattern that is a black square pattern in the horizontal direction on the image and on the image. It has a lattice pattern formed by being alternately arranged in the vertical direction.

- the test image Img1 has a center line L1v at the center of the image, a circle C1 at the center point of the image Img1, and a horizontal (horizontal) direction at the top of the image Img1. It is an image of a pattern having a drawn line L1h.

- the portion where the intersection of the line L1v and the line L1h exists is the upper part of the image.

- the test image used for the projection system 1000 is an image that can easily recognize the upper part of the image, such as the test image Img1 shown in FIG. It is preferable that Note that the test image Img1 shown in FIG. 4 is an example, and other images may be used as long as the upper part of the image can be recognized.

- the test image includes a first grid pattern that is a white square pattern and a second grid pattern that is a black square pattern alternately in the horizontal direction on the image and in the vertical direction on the image.

- the lattice pattern formed by being arranged may be provided on the entire surface of the image area, and a specific pattern indicating the upper part of the image may be an image superimposed on a predetermined place of the test pattern image.

- test image Img1 shown in FIG. 4 is used as a test image.

- the correction unit 12 reads the three-dimensional shape data 3D_data from the three-dimensional shape data storage unit 5, and acquires the three-dimensional coordinate data of the horizontal ceiling plane CL that is the projection target. Then, the correction unit 12 displays the image D1 so that the image has no geometric distortion when viewed from the point P1, that is, the point P1 directly below the intersection Pc between the projection axis Ax1 and the ceiling plane CL. Correction processing is performed on Then, the correction unit 12 outputs the corrected image to the second selector 15 as an image D2.

- the control unit generates a selection signal sel3 for selecting the terminal 0 shown in FIG. 2 of the second selector 15 and outputs it to the second selector 15.

- the image D2 is output from the second selector 15 to the third selector 17 as the image D3.

- the control unit generates a selection signal sel4 for selecting the terminal 0 shown in FIG. 2 of the third selector 17 and outputs it to the third selector 17.

- the third selector 17 outputs the image D3 as the image D4 to the fourth selector 18.

- the control unit generates a selection signal sel5 for selecting the terminal 1 shown in FIG. 2 of the fourth selector 18, and outputs the selection signal sel5 to the fourth selector 18. Thereby, the image D4 is output from the fourth selector 18 to the projection unit 3 as the image Dout.

- the projection unit 3 projects the image Dout from the fourth selector 18 onto the horizontal ceiling plane CL by the projection axis Ax1 shown in FIG. This state is referred to as “state 1”.

- FIG. 5 shows the horizontal ceiling plane CL in the state 1, the floor FL, the viewpoint Vp of the user Usr, and the intersection Pc between the optical axis (projection axis) Ax1 of the optical system of the projection unit 3 and the horizontal ceiling (plane) CL. , Passing through the point Pc, the normal line Nm1 of the horizontal ceiling plane CL and the intersection point P1 of the plane parallel to the floor plane FL and including the point Vp from the positive x-axis direction to the negative x-axis direction. It is the figure (yz top view) seen.

- L1 indicates a plane parallel to the floor FL and including the viewpoint Vp.

- test image Img1 viewed from the viewpoint Vp in the state 1 is shown as an image Img1 (Vp).

- the test image Img1 viewed from the point P1 (a point directly below the point Pc) is shown as an image Img1 (P1).

- the image Img1 (Vp) viewed from the viewpoint Vp of the user Usr has a geometric distortion but is viewed from the point P1 (a point directly below the point Pc).

- the test image Img1 (P1) has no geometric distortion.

- the rotation process is executed.

- FIG. 6 is a diagram schematically showing the three-dimensional space in state 1, and is a diagram for explaining the rotation processing.

- the user operates the controller 200 to rotate the image Img1 projected on the horizontal ceiling plane CL in the direction indicated by the arrow Dir1 in FIG. 6 about the point Pc.

- the center line L1v of the image Img1 is made to appear as a vertical straight line when viewed from the user's viewpoint Vp. That is, the user operates the controller 200 so that the center line L1v of the image Img1 is within the plane including the point Pc, the point P1, and the viewpoint Vp, and the image Img1 projected on the horizontal ceiling plane CL is displayed.

- the user rotates the image Img1 so that the upper portion of the image of the image Img1 (the portion where the line L1v and the line L1h of the image Img1 intersect) is the upper portion when viewed from the user.

- the test image Img 1 is output from the test image storage unit 2 to the first selector 11. Then, the control unit generates a selection signal sel1 for selecting the terminal 0 shown in FIG. 2 of the first selector 11, and outputs the selection signal sel1 to the first selector 11. Thereby, the test image Img1 is output from the first selector 11 to the correction unit 12 as the image signal D1.

- the correction unit 12 performs the same correction process as the process executed in the state 1 on the image D1. Then, the correction unit 12 outputs the corrected image to the rotation processing unit 14 as an image D2.

- the user operates the controller 200 to cause the projector device 100 to execute the rotation process.

- the controller 200 has two buttons for performing rotation processing, and when the first button (one button) is pressed once, the test image Img1 is displayed in the left direction of the direction Dir1 in FIG. , A process of rotating the test image Img1 by a predetermined angle to the right of the direction Dir1 in FIG. 6 by pressing the second button (the other button) once. Can be executed.

- the user interface 23 When the first button of the controller 200 is pressed once, the user interface 23 generates a signal indicating that the first button has been pressed once. Based on the signal generated by the user interface 23, the control unit 22 of the controller 200 sends a signal indicating that the first button has been pressed once to the first interface of the projector device 100 via the second interface 21. Send.

- controller 200 can be operated by a user, and the controller 200 and the projector device 100 transmit and receive signals by wireless communication, for example.

- the user operates the controller 200 while holding the controller 200 in his / her hand while viewing the image Img1 projected onto the horizontal ceiling plane CL, and is projected onto the horizontal ceiling plane CL.

- the image Img1 is rotated.

- the first interface 6 of the projector device 100 receives the signal transmitted from the second interface 21 of the controller 200 and outputs the received signal to the switch 13 as the signal Sig1.

- the switch 13 selects the terminal 1 shown in FIG. 2 based on the selection signal sel2 generated by the control unit, and outputs the signal Sig1 to the rotation processing unit 14.

- the rotation processing unit 14 performs a rotation process on the image D2 output from the correction unit 12 based on the signal Sig1, the three-dimensional shape data 3D_data, and the information P_prj about the projection point of the projection unit 3.

- the rotation processing unit 14 views the horizontal ceiling plane CL from the point P1

- the image Img1 is determined by the signal Sig1 around the point Pc in the left direction of the arrow Dir1 illustrated in FIG.

- Conversion processing rotation processing

- the rotation processing unit 14 outputs the processed image to the second selector 15 as an image D21 (image signal D21).

- the second selector 15 selects the terminal 1 shown in FIG. 2 based on the selection signal sel3 generated by the control unit, and outputs the image D21 to the third selector 17 as the image D3.

- the image Img1 is an image rotated in the direction Dir1 by a predetermined angle with the point Pc as the center.

- the center line L1v of the image Img1 is made to appear as a vertical straight line when viewed from the user's viewpoint Vp.

- This state that is, a state in which the center line L1v of the image Img1 is in a plane including the point Pc, the point P1, and the viewpoint Vp is referred to as “state 2”.

- FIG. 7 is a diagram schematically showing a three-dimensional space in state 2.

- the test image Img1 viewed from the user's viewpoint Vp is shown as an image Img1 (Vp).

- the test image Img1 viewed from the point P1 is shown as an image Img1 (P1).

- test image Img1 when viewed from the user's viewpoint Vp, it appears as a trapezoidal image (image Img1 (Vp1)).

- the rotation process is executed as described above, and after the projection state of the projection system 1000 is changed to the state 2, the trapezoidal correction process is executed.

- FIG. 8 is a diagram for explaining the trapezoid correction process.

- 8 shows the horizontal ceiling plane CL, the floor FL, the viewpoint Vp of the user Usr, and the intersection Pc between the optical axis (projection axis) Ax1 of the optical system of the projection unit 3 and the horizontal ceiling (plane) CL in the state 2.

- L1 indicates a plane parallel to the floor FL and including the viewpoint Vp.

- 9 to 13 are diagrams for explaining the trapezoid correction process.

- 9 to 13 show the horizontal ceiling plane CL, the floor FL, the viewpoint Vp of the user Usr, the point Pc, and the intersection P1 from the positive x-axis direction to the negative x-axis direction, as in FIG. It is the figure (yz top view) seen.

- FIG. 14 is a diagram schematically showing a three-dimensional space in the state 3, and is a diagram for explaining a trapezoid correction process.

- the user operates the controller 200 to cause the projector device 100 to execute the keystone correction process on the image Img1 projected on the horizontal ceiling plane CL.

- the keystone correction process is executed by the following processes (1) and (2), for example.

- the image Img1 image Img1 in state 2 (this is the image Img1) projected onto the horizontal ceiling plane CL with the axis passing through the point Pc and parallel to the x axis as the rotation axis. (Denoted as (state2))) is set as a virtual projection plane (for example, virtual projection plane SF1 shown in FIG. 8) obtained by rotating a predetermined angle in the direction Dir2 (clockwise direction) shown in FIG. .

- Rotation processing so that an image without geometric distortion is obtained when viewed from a point on the normal line of the virtual projection plane set as described above (point P2 shown in FIGS. 8 and 9).

- Image conversion processing (trapezoid correction processing) is performed on the subsequent image Img1.

- the test image Img1 is output from the test image storage unit 2 to the first selector 11. Then, the control unit generates a selection signal sel1 for selecting the terminal 0 shown in FIG. 2 of the first selector 11, and outputs the selection signal sel1 to the first selector 11. Thereby, the test image Img1 is output from the first selector 11 to the correction unit 12 as the image signal D1.

- the correction unit 12 performs the same correction process as the process executed in states 1 and 2 on the image D1. Then, the correction unit 12 outputs the corrected image to the rotation processing unit 14 as an image D2.

- Rotation processing unit 14 executes the same rotation process as the process executed in state 2. Then, the rotation processing unit 14 outputs the image D21 after the rotation process is performed on the image D2 to the second selector 15.

- the second selector 15 selects the terminal 1 shown in FIG. 2 based on the selection signal sel3 generated by the control unit, and outputs the image D21 as the image D3 to the trapezoid correction processing unit 16.

- the user operates the controller 200 to cause the projector device 100 to execute a keystone correction process.

- the controller 200 has two buttons for performing keystone correction processing, and by pressing the buttons, for example, the following processes (1) and (2) are executed on the projector device 100.

- (1) By pressing the first button (one button) of the controller 200 once, the horizontal ceiling plane CL is virtually moved to a position rotated by a predetermined angle in the direction Dir2 (clockwise direction) shown in FIG.

- Dir2 clockwise direction

- a plane is set, and image conversion processing (trapezoid correction processing) is executed on the projector device 100 so that there is no geometric distortion when viewed from a point on the normal line of the virtual plane passing through the point Pc.

- the user interface 23 When the first button of the controller 200 is pressed once, the user interface 23 generates a signal indicating that the first button has been pressed once. Based on the signal generated by the user interface 23, the control unit 22 of the controller 200 sends a signal indicating that the first button has been pressed once via the second interface 21 to the first interface 6 of the projector device 100. Send to.

- controller 200 can be operated by a user, and the controller 200 and the projector device 100 transmit and receive signals by wireless communication, for example.

- the user operates the controller 200 while holding the controller 200 in his / her hand and sees the image Img1 projected on the horizontal ceiling plane CL, and is projected onto the horizontal ceiling plane CL.

- a process of reducing the geometric distortion of the image Img1 (trapezoid correction process) is executed.

- the first interface 6 of the projector device 100 receives the signal transmitted from the second interface 21 of the controller 200 and outputs the received signal to the switch 13 as the signal Sig1.

- the switcher 13 selects the terminal 0 shown in FIG. 2 based on the selection signal sel2 generated by the control unit, and outputs the signal Sig1 to the trapezoidal correction processing unit 16.

- the trapezoid correction processing unit 16 performs trapezoid correction processing on the image D3 output from the second selector 15 based on the signal Sig1, the three-dimensional shape data 3D_data, and the information P_prj about the projection point of the projection unit 3. Execute.

- the trapezoidal correction processing unit 16 determines the rotation angle ⁇ 1 when the first button (one button) of the controller 200 is pressed once from the signal Sig1. Then, the trapezoidal correction processing unit 16 sets the virtual plane SF1 at a position obtained by rotating the horizontal ceiling plane CL by the rotation angle ⁇ 1 in the direction Dir2 (clockwise direction) illustrated in FIG. 9, passes through the point Pc, and passes through the virtual plane. Image conversion processing is performed on the image D3 so that there is no geometric distortion of the image projected on the horizontal ceiling plane CL when the horizontal ceiling plane CL is viewed from the point P2 on the normal line of SF1. (Keystone correction processing) is executed. Then, the trapezoid correction processing unit 16 outputs the image after the trapezoid correction processing to the third selector 17 as an image D31.

- the third selector 17 selects the terminal 1 shown in FIG. 2 based on the selection signal sel4 generated by the control unit, and outputs the image D31 to the fourth selector 18 as the image D4.

- the image Img1 is projected as an image without geometric distortion. The state at this time is shown in FIG.

- the image Img_R1_CL shown in FIG. 10 is an image acquired as follows. That is, the image Img_R1_CL is the clockwise direction (direction Dir2) in the yz plane with the image Img (state 2) of the horizontal ceiling plane CL in the state 2 passing through the point Pc and having an axis parallel to the x axis as the rotation axis.

- the image (image Img_R1 in FIG. 10 (image Img_R1 on the virtual plane SF1) in FIG. 10) rotated by an angle ⁇ 1 is projected onto the horizontal ceiling plane CL from a point on the normal line of the virtual plane SF1 (eg, point P2). It is an image acquired by.

- FIG. 10 shows an image Img1 (state 2) when the horizontal ceiling plane CL is viewed from the point Vp in the state 2, and the trapezoid correction process is executed on the lower right side of FIG.

- the image Img1_R1_CL when the horizontal ceiling plane CL is viewed from the point Vp is shown.

- the image Img1_R1_CL shown on the lower right side of FIG. 10 has a reduced geometric distortion (trapezoidal distortion) than the image Img1 (state 2) shown on the upper right side of FIG.

- the user further presses the first button to execute a trapezoidal correction process in which the rotation angle ⁇ 1 shown in FIG. 10 is a larger angle, and the geometrical shape of the image projected on the horizontal ceiling plane CL. Distortion can be further reduced.

- the other button of the controller 200 is displayed.

- the projector device 100 can execute a trapezoid correction process for reducing geometric distortion (trapezoid distortion) of an image projected on the horizontal ceiling plane CL.

- the geometric distortion (trapezoidal distortion) of the image projected on the horizontal ceiling plane CL is reduced by pressing the first button of the controller 200.

- the user further presses the first button to cause the projector device 100 to execute the keystone correction process.

- the trapezoidal correction processing unit 16 executes a trapezoidal correction process in which the rotation angle ⁇ 1 shown in FIG.

- the rotation angle becomes ⁇ 2

- the horizontal ceiling plane CL passes through the point Pc

- the axis parallel to the x axis is the rotation axis.

- the normal line passing through the point Pc of the virtual plane SF2 rotated by the angle ⁇ 2 in the clockwise direction (direction Dir2) in the yz plane will be described as being in a state passing through the user's viewpoint Vp.

- the trapezoidal correction processing unit 16 determines the rotation angle ⁇ 2 when the first button (one button) of the controller 200 is further pressed from the signal Sig1. Then, the trapezoidal correction processing unit 16 sets the virtual plane SF2 at a position obtained by rotating the horizontal ceiling plane CL by the rotation angle ⁇ 2 in the direction Dir2 (clockwise direction) illustrated in FIG. 11, passes through the point Pc, and passes through the virtual plane. Image conversion processing is performed on the image D3 so that there is no geometric distortion of the image projected on the horizontal ceiling plane CL when the horizontal ceiling plane CL is viewed from the point Vp on the normal line of SF2. (Keystone correction processing) is executed. Then, the trapezoid correction processing unit 16 outputs the image after the trapezoid correction processing to the third selector 17 as an image D31.

- state 3 The image D31 generated by the trapezoid correction processing unit 16 in this way is projected onto the horizontal ceiling plane CL by the projection unit 3. This state is referred to as “state 3”.

- the image Img1 is projected as an image without geometric distortion (an image with reduced geometric distortion).

- the state at this time is shown in FIG.

- the image Img_R2_CL shown in FIG. 12 is an image acquired as follows. That is, the image Img_R2_CL is the clockwise direction (direction Dir2) in the yz plane with the image Img (state2) of the horizontal ceiling plane CL in the state 2 passing through the point Pc and having an axis parallel to the x axis as the rotation axis.

- the image (image Img_R2 in FIG. 12 (image Img_R2 on the virtual plane SF2) in FIG. 12) rotated by an angle ⁇ 2 is projected onto the horizontal ceiling plane CL from a point on the normal line of the virtual plane SF2 (for example, the viewpoint Vp). It is an image acquired by.

- the image Img1 (state 3) (image Img1_R2_CL) shown on the lower right side of FIG. 12 has less geometric distortion (trapezoidal distortion) than the image Img1 (state 2) shown on the upper right side of FIG. I understand).

- the user confirms the state (state 3) in which the geometric distortion of the image projected on the horizontal ceiling plane CL is sufficiently reduced, and performs adjustment processing (to reduce the geometric distortion of the image) in the projector device 100. Adjustment processing) is terminated.

- the user operates the controller 200 to end the adjustment process (the adjustment process for reducing the geometric distortion of the image) in the projector device 100.

- the projector device 100 receives from the controller 200 a signal for ending the adjustment processing (adjustment processing for reducing image geometric distortion) in the projector device 100.

- the projector device 100 When the projector apparatus 100 receives the signal from the controller 200, according to the current setting, the projector device 100 performs (1) correction processing by the correction unit 12, (2) rotation processing by the rotation processing unit 14, and (3) trapezoid correction processing unit.

- the adjustment process (the adjustment process for reducing the geometric distortion of the image) is completed in such a manner that the trapezoidal correction process according to 16 is executed.

- the first selector 11 selects the terminal 1 to correct the image signal Din. To the unit 12.

- the projector apparatus 100 is configured to select the terminal 1 in the second selector 15, the terminal 1 in the third selector 17, and the terminal 1 in the fourth selector 18.

- the correction unit 12, the rotation processing unit 14, and the trapezoidal correction processing unit 16 of the projector device 100 are based on the settings when the adjustment processing (adjustment processing for reducing geometric distortion of the image) is completed. Then, a correction process, a rotation process, and a trapezoidal correction process are executed.

- the image (video) after these processes are executed is projected from the projection unit 3 onto the horizontal ceiling plane CL.

- an image (video) obtained by projecting the image Din (or video Din) input to the projector device 100 onto the horizontal ceiling plane CL has no geometric distortion when viewed from the user's viewpoint Vp ( (Reduced) image (video).

- the test image showing the upper part when displayed is projected onto the horizontal ceiling plane CL, and the user performs (1) the process of rotating the projection image within the horizontal ceiling plane CL by the controller 200.

- (2) geometric processing of the image projected on the horizontal ceiling plane CL is performed by causing the projector apparatus 100 to perform trapezoidal correction processing of the image projected on the horizontal ceiling plane CL. Distortion can be eliminated (reduced).

- geometric distortion of an image projected onto a horizontal projection surface (for example, a horizontal ceiling) can be easily and appropriately eliminated (reduced) without using a device having a photographing function. it can.

- FIG. 15 is a schematic configuration diagram of a projection system 1000A according to a first modification of the first embodiment.

- FIG. 16 is a schematic configuration diagram of the projection image adjustment unit 1A of the projector device 100A of the projection system 1000A according to the first modification of the first embodiment.

- the projection system 1000A of the first modification has a configuration in which the projector device 100 is replaced with the projector device 100A in the projection system 1000 of the first embodiment.

- the projector device 100 ⁇ / b> A has a configuration in which a fine adjustment unit 19 is added between the third selector 17 and the fourth selector 18 in the projector device 100.

- the projector device 100 ⁇ / b> A is the same as the projector device 100.

- the fine adjustment unit 19 receives the image D4 output from the third selector 17 and the control signal ctl1 output from the control unit.

- the fine adjustment unit 19 uses the input signal as it is as the signal D4A (image D4A) until the adjustment process (adjustment process for reducing geometric distortion of the image) described in the first embodiment is completed. Output to the fourth selector 18. Then, when the adjustment process (adjustment process for reducing the geometric distortion of the image) is completed, the fine adjustment unit 19 projects the projection projected on the projection plane by the projection unit 3 in accordance with the control signal ctl1 from the control unit. Processing is performed on the image D4 so as to finely move each vertex of the image, and the processed image is output to the fourth selector 18 as an image D4A (image signal D4A).

- the fine adjustment unit 19 retains the setting of the fine adjustment process, and when the projector apparatus 100 is switched to the mode for displaying (projecting) the image signal (or video signal) Din, the input is performed according to the setting. Perform fine adjustment on the signal.

- the fine adjustment process is performed after the same adjustment process (adjustment process for reducing the geometric distortion of the image) as in the projection system of the first embodiment is executed.

- the processing amount (work amount) required to correct the error in the three-dimensional shape measurement process can be dramatically reduced as compared with the prior art.

- control signal ctl1 input to the fine adjustment unit 19 may be a signal based on a user operation by the controller 200.

- the user performs a fine adjustment processing operation using the controller 200, and the controller 200 generates a control signal based on the user operation, and transmits the generated control signal to the projector device 100A.

- the projector device 100A may receive the signal transmitted from the controller 200 as the signal Sig1 via the first interface 6, and use the received signal Sig1 as the control signal ctl1 input to the fine adjustment unit 19.

- FIG. 17 is a schematic configuration diagram of a projection system 2000 according to the second embodiment.

- FIG. 18 is a schematic configuration diagram of the projection image adjustment unit 201 of the projector apparatus 2100 of the projection system 2000 according to the second embodiment.

- FIG. 19 is a schematic configuration diagram of the viewpoint identification processing unit 215 of the projection system 2000 according to the second embodiment.

- FIG. 20 is a schematic configuration diagram of the viewpoint candidate acquisition unit 151 of the projection system 2000 according to the second embodiment.

- the projection system 2000 includes a projector device 2100 and a controller 200 as shown in FIG.

- the projector apparatus 2100 includes a projection image adjustment unit 201, a test image storage unit 2, a projection unit 3, a three-dimensional shape measurement unit 4, a three-dimensional shape data storage unit 5, and a first And an interface 6.

- the projection image adjustment unit 201 includes a first selector SEL1, a first switch SW1, a correction unit 211, a second switch 212, a first rotation processing unit 213, and a second selector.

- SEL2 a second rotation processing unit 214, a third selector SEL3, a viewpoint identification processing unit 215, a fourth selector SEL4, and a fifth selector SEL5.

- the first selector SEL1 inputs an image Din (image signal Din) input to the projector device 2100, a test image Img1 output from the test image storage unit 2, and a selection signal sel1.

- the first selector SEL1 selects either the image Din or the test image Img1 according to the selection signal sel1, and outputs the selected image (image signal) to the first switch SW1 as the image D1 (image signal D1).

- the selection signal sel1 is a control signal generated by a control unit (not shown) that controls each functional unit of the projector device 2100.

- the first switch SW1 receives the image D1 output from the first selector SEL1 and the switching signal sw1.

- the first switch SW1 outputs the image D1 (image signal D1) to any one of the correction unit 211 and the viewpoint identification processing unit 215 in accordance with the switching signal sw1.

- the switching signal sw1 is a control signal generated by a control unit that controls each functional unit of the projector device 2100.

- the correction unit 211 receives the image D1 output from the first switch SW1, the three-dimensional shape data 3D_data output from the three-dimensional shape data storage unit 5, and the information P_prj about the projection point of the projection unit 3. To do. The correction unit 211 performs correction processing on the image D1 based on the three-dimensional shape data 3D_data and the information P_prj about the projection point. Then, the correction unit 211 outputs the corrected image as an image D2 (image signal D2) to the second selector SEL2 and the first rotation processing unit 213.

- the second switch 212 receives the signal Sig1 output from the first interface 6 and the switch signal sw2.

- the second switch 212 outputs the signal Sig1 to any one of the first rotation processing unit 213, the second rotation processing unit 214, and the viewpoint identification processing unit 215 in accordance with the switching signal sw2.

- the switching signal sw2 is a control signal generated by a control unit that controls each functional unit of the projector device 2100.

- the first rotation processing unit 213 includes an image D2 output from the correction unit 211, 3D shape data 3D_data output from the 3D shape data storage unit 5, information P_prj about the projection point of the projection unit 3,

- the signal Sig1 output from the 2 switch 212 is input.

- the first rotation processing unit 213 performs the first rotation processing on the image D2 based on the three-dimensional shape data 3D_data and the information P_prj about the projection point of the projection unit 3. (Details will be described later).

- the first rotation processing unit 213 outputs the processed image to the second selector SEL2 as an image D21 (image signal D21).