WO2017187719A1 - 健康状態推定装置 - Google Patents

健康状態推定装置 Download PDFInfo

- Publication number

- WO2017187719A1 WO2017187719A1 PCT/JP2017/005089 JP2017005089W WO2017187719A1 WO 2017187719 A1 WO2017187719 A1 WO 2017187719A1 JP 2017005089 W JP2017005089 W JP 2017005089W WO 2017187719 A1 WO2017187719 A1 WO 2017187719A1

- Authority

- WO

- WIPO (PCT)

- Prior art keywords

- cow

- feature amount

- dimensional coordinate

- extraction unit

- score

- Prior art date

- Legal status (The legal status is an assumption and is not a legal conclusion. Google has not performed a legal analysis and makes no representation as to the accuracy of the status listed.)

- Ceased

Links

Images

Classifications

-

- A—HUMAN NECESSITIES

- A01—AGRICULTURE; FORESTRY; ANIMAL HUSBANDRY; HUNTING; TRAPPING; FISHING

- A01K—ANIMAL HUSBANDRY; AVICULTURE; APICULTURE; PISCICULTURE; FISHING; REARING OR BREEDING ANIMALS, NOT OTHERWISE PROVIDED FOR; NEW BREEDS OF ANIMALS

- A01K29/00—Other apparatus for animal husbandry

- A01K29/005—Monitoring or measuring activity

-

- A—HUMAN NECESSITIES

- A01—AGRICULTURE; FORESTRY; ANIMAL HUSBANDRY; HUNTING; TRAPPING; FISHING

- A01K—ANIMAL HUSBANDRY; AVICULTURE; APICULTURE; PISCICULTURE; FISHING; REARING OR BREEDING ANIMALS, NOT OTHERWISE PROVIDED FOR; NEW BREEDS OF ANIMALS

- A01K29/00—Other apparatus for animal husbandry

-

- A—HUMAN NECESSITIES

- A61—MEDICAL OR VETERINARY SCIENCE; HYGIENE

- A61B—DIAGNOSIS; SURGERY; IDENTIFICATION

- A61B5/00—Measuring for diagnostic purposes; Identification of persons

- A61B5/103—Measuring devices for testing the shape, pattern, colour, size or movement of the body or parts thereof, for diagnostic purposes

- A61B5/107—Measuring physical dimensions, e.g. size of the entire body or parts thereof

-

- A—HUMAN NECESSITIES

- A61—MEDICAL OR VETERINARY SCIENCE; HYGIENE

- A61B—DIAGNOSIS; SURGERY; IDENTIFICATION

- A61B5/00—Measuring for diagnostic purposes; Identification of persons

- A61B5/103—Measuring devices for testing the shape, pattern, colour, size or movement of the body or parts thereof, for diagnostic purposes

- A61B5/11—Measuring movement of the entire body or parts thereof, e.g. head or hand tremor or mobility of a limb

-

- G—PHYSICS

- G16—INFORMATION AND COMMUNICATION TECHNOLOGY [ICT] SPECIALLY ADAPTED FOR SPECIFIC APPLICATION FIELDS

- G16H—HEALTHCARE INFORMATICS, i.e. INFORMATION AND COMMUNICATION TECHNOLOGY [ICT] SPECIALLY ADAPTED FOR THE HANDLING OR PROCESSING OF MEDICAL OR HEALTHCARE DATA

- G16H50/00—ICT specially adapted for medical diagnosis, medical simulation or medical data mining; ICT specially adapted for detecting, monitoring or modelling epidemics or pandemics

- G16H50/30—ICT specially adapted for medical diagnosis, medical simulation or medical data mining; ICT specially adapted for detecting, monitoring or modelling epidemics or pandemics for calculating health indices; for individual health risk assessment

-

- G—PHYSICS

- G16—INFORMATION AND COMMUNICATION TECHNOLOGY [ICT] SPECIALLY ADAPTED FOR SPECIFIC APPLICATION FIELDS

- G16H—HEALTHCARE INFORMATICS, i.e. INFORMATION AND COMMUNICATION TECHNOLOGY [ICT] SPECIALLY ADAPTED FOR THE HANDLING OR PROCESSING OF MEDICAL OR HEALTHCARE DATA

- G16H30/00—ICT specially adapted for the handling or processing of medical images

- G16H30/40—ICT specially adapted for the handling or processing of medical images for processing medical images, e.g. editing

Definitions

- the present invention relates to a health condition estimation apparatus for estimating the health condition of a cow.

- cow signal score comprising a body condition score, a lumen fill score, and a locomotion score has been used for health management for cattle.

- cow signal scores are quantified by visual confirmation by veterinarians and dairymen, but problems such as the frequency of medical examinations and oversight by dairymen during daily busy work are problematic. Automation of management is desired.

- research which judges a hoof disease by attaching a 3-axis acceleration sensor to a cow and analyzing the signal is performed (refer nonpatent literature 1).

- such a wearable sensor is not desirable because of the high human cost of installation by dairymen and stress on cattle.

- Non-Patent Document 2 a technique for estimating a locomotion score effective for hoof disease diagnosis using a non-wearable sensor such as a camera has been developed (see Non-Patent Document 2).

- a technique based on image analysis using an RGB camera see Non-Patent Document 3 and Patent Document 1 has been proposed.

- Non-Patent Document 3 manually provides the features necessary for score estimation, and is not fully automated.

- the method of the nonpatent literature 3 and the patent document 1 is performing score estimation by processing the image imaged with the RGB camera, in order to estimate a score correctly, it is from a specific direction. It is necessary to observe the cow. However, it is difficult to stop the cow at a specific position according to human instructions, and stress the cow. In addition, special equipment or the like is required to stop the cow at a specific position with respect to the camera, and there is a problem in terms of cost.

- the present invention has been made in view of such circumstances, and an object of the present invention is to provide a health state estimation device that can accurately estimate the health state of a cow without the need for accurately positioning the cow.

- a health condition estimation apparatus is a health condition estimation apparatus that estimates a cow's health condition, and is a three-dimensional analysis of the cow extracted from the cattle distance image.

- a three-dimensional coordinate acquisition unit that acquires a three-dimensional coordinate group indicating a shape; a feature amount extraction unit that extracts the feature amount of the cow based on the three-dimensional coordinate group acquired by the three-dimensional coordinate acquisition unit; And a score calculation unit that calculates a score indicating the health state of the cow based on the feature amount extracted by the feature amount extraction unit.

- a health condition estimation apparatus is a health condition estimation apparatus that estimates a cow's health condition, and a three-dimensional coordinate group indicating a three-dimensional shape of the cow extracted from the distance image of the cow.

- a three-dimensional coordinate acquisition unit that acquires the standard model of the three-dimensional coordinate group of the cow classified for each score indicating the health state of the cow, and the three-dimensional coordinate group acquired by the three-dimensional coordinate acquisition unit

- a score calculation unit that calculates a score of the cow corresponding to the three-dimensional coordinate group acquired by the three-dimensional coordinate acquisition unit by performing the association.

- the present invention can be realized not only as a health state estimation device including such a characteristic processing unit, but also as a step with a process executed by a characteristic processing unit included in the health state estimation device as a step. It can be realized as a state estimation method. It can also be realized as a program for causing a computer to function as a characteristic processing unit included in the health condition estimation apparatus. Such a program can be distributed via a computer-readable non-transitory recording medium such as a CD-ROM (Compact Disc-Read Only Memory) or a communication network such as the Internet. .

- the present invention can be realized as a semiconductor integrated circuit that realizes part or all of the health condition estimation apparatus, or can be realized as a health condition estimation system including the health condition estimation apparatus.

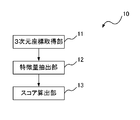

- FIG. 1 is a block diagram showing a functional configuration of a health condition estimation apparatus according to Embodiment 1 of the present invention.

- FIG. 2 is a diagram for explaining a method of specifying the torso position of the cow and the base position of the leg.

- FIG. 3 is a diagram for explaining a method of extracting a lumen region.

- FIG. 4 is a diagram for explaining a process of extracting a feature amount indicating the degree of lumen depression.

- FIG. 5 is a diagram for explaining a method of extracting a cow back line.

- FIG. 6 is a diagram for explaining the process of extracting the feature amount of the cow's walking state.

- FIG. 7 is a diagram for explaining processing for extracting the feature amount of the body width and the feature amount of the position of the spine.

- FIG. 1 is a block diagram showing a functional configuration of a health condition estimation apparatus according to Embodiment 1 of the present invention.

- FIG. 2 is a diagram for explaining a method of specifying the

- FIG. 8 is a diagram illustrating an example of a linear regression model.

- (A) of FIG. 9 is a figure which shows an example of the three-dimensional coordinate group of the cow acquired by the three-dimensional coordinate acquisition part 11,

- (b) is a figure which shows an average depth characteristic,

- (c) is It is a figure which shows a silhouette characteristic.

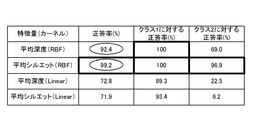

- FIG. 10 is a diagram illustrating a result of classifying a locomotion score using SVM (Support Vector Vector Machine).

- FIG. 11 is a diagram for explaining a method for specifying a lumen region by collation with a standard model.

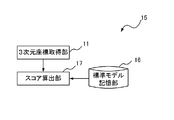

- FIG. 12 is a block diagram showing a functional configuration of the health condition estimation apparatus according to Embodiment 2 of the present invention.

- FIG. 13 is a diagram for explaining a lumen fill score and locomotion score calculation method using a standard model database.

- a health condition estimation apparatus is a health condition estimation apparatus that estimates the health condition of a cow, and the cow extracted from the distance image of the cow

- a three-dimensional coordinate acquisition unit that acquires a three-dimensional coordinate group indicating the three-dimensional shape of the worm, and a feature amount extraction unit that extracts the feature amount of the cow based on the three-dimensional coordinate group acquired by the three-dimensional coordinate acquisition unit

- a score calculation unit that calculates a score indicating the health state of the cow based on the feature amount extracted by the feature amount extraction unit.

- a feature amount is extracted from a three-dimensional coordinate group indicating the three-dimensional shape of a cow, and a score indicating the health state of the cow is calculated based on the feature amount.

- the three-dimensional coordinate group can be obtained from the distance image. For this reason, even if the posture of the cow is slightly inclined with respect to the camera, it is possible to calculate an accurate three-dimensional coordinate of the cow from the distance image. Therefore, it is not necessary to accurately position the cow, and the cow's health state can be estimated with high accuracy.

- the feature quantity extraction unit is a three-dimensional lumen region that is a region of the bovine body surface in the vicinity of the cattle lumen in the three-dimensional coordinate group acquired by the three-dimensional coordinate acquisition unit. Based on the coordinate group, a feature amount indicating the degree of depression of the lumen is extracted, and the score calculation unit is configured to extract the lumen of the cow based on the feature amount indicating the degree of depression of the lumen extracted by the feature amount extraction unit. Calculate fill score.

- the lumen fill score can be accurately calculated.

- the feature quantity extraction unit extracts a histogram of curvature in the lumen area as a feature quantity indicating a degree of depression of the lumen based on the three-dimensional coordinate group of the lumen area.

- the lumen fill score can be accurately calculated by using the curvature histogram as a feature amount indicating the degree of lumen depression.

- the feature amount extraction unit may calculate a distance between the lumen area and a predetermined plane assigned to the lumen area based on the three-dimensional coordinate group of the lumen area. May be extracted as a feature amount.

- the lumen fill score can be accurately calculated by using the distance as a feature amount indicating the degree of lumen depression.

- the feature amount extraction unit may calculate a volume of a space formed between the convex hull surrounding the lumen region and the lumen region based on the three-dimensional coordinate group of the lumen region. You may extract as a feature-value which shows a condition.

- the lumen fill score can be accurately calculated by using the volume as a feature amount indicating the degree of depression of the lumen.

- the three-dimensional coordinate acquisition unit acquires the time-series three-dimensional coordinate group from the time-series cattle distance image, and the feature amount extraction unit includes the time-series lumen region. Based on the three-dimensional coordinate group, a feature amount indicating the degree of depression of the lumen when the degree of depression of the lumen is maximized is extracted.

- the feature amount extraction unit detects the back line of the cow based on the three-dimensional coordinate group acquired by the three-dimensional coordinate acquisition unit, and applies a predetermined curve to the detected back line.

- the parameter of the curve obtained by fitting is extracted as a feature amount of the back line, and the score calculation unit is based on the feature amount of the back line extracted by the feature amount extraction unit. Calculate the score.

- the back line of the cow has a curved shape. For this reason, the parameter of the curve obtained by fitting a curve to the back line can be used as the feature amount of the back line. Therefore, the locomotion score can be accurately calculated based on the feature amount of the back line.

- the feature amount extraction unit detects the back line of the cow based on the three-dimensional coordinate group acquired by the three-dimensional coordinate acquisition unit, and the displacement of the detected back line from a predetermined line

- the amount may be extracted as a feature amount of the back line

- the score calculation unit may calculate the locomotion score of the cow based on the feature amount of the back line extracted by the feature amount extraction unit.

- the back line also bends, so that the amount of displacement from the predetermined line becomes relatively large.

- the displacement is relatively small because the spine is not bent too much. For this reason, the locomotion score can be accurately calculated by using the displacement amount as the feature amount of the back line.

- the three-dimensional coordinate acquisition unit acquires the time-series three-dimensional coordinate group from the time-series distance image of the cow, and the feature amount extraction unit includes the time-series three-dimensional coordinate group. Based on the above, the feature value of the cow is extracted.

- the time-series three-dimensional coordinate group indicates the three-dimensional movement of the cow.

- the characteristic amount of the cow based on the time-series three-dimensional coordinate group is a value that characterizes the movement of the cow. Therefore, the cow score can be calculated based on the cow movement. For this reason, the health condition regarding the movement of the cow can be estimated with high accuracy.

- the feature amount extraction unit extracts a feature amount of the cow's walking state based on the time-series three-dimensional coordinate group, and the score calculation unit includes the feature amount extraction unit.

- the locomotion score of the cow is calculated based on the extracted feature amount of the cow's walking state.

- the feature amount extraction unit may calculate a value indicating a variation in the degree of inclination in the left-right direction when the cow is walking based on the time-series three-dimensional coordinate group. It may be extracted as a quantity.

- the fact that the left shoulder is falling from the right shoulder and the user is walking while tilting to the left can be expressed as a feature amount. For this reason, the locomotion score of the cow can be accurately calculated based on the feature amount.

- the feature amount extraction unit extracts a value indicating leg transportation during the walking of the cow as a feature amount of the walking state of the cow based on the time-series three-dimensional coordinate group. Also good.

- the stride length of the cow and the protruding amount of the leg from the width of the torso can be quantified and expressed as a feature value. For this reason, the locomotion score of the cow can be accurately calculated based on the feature amount.

- the feature amount extraction unit may extract the cow's gait feature amount as a feature amount of the cow's walking state based on the time-series three-dimensional coordinate group.

- the feature amount extraction unit extracts a feature amount indicating a width of the bovine body or a position of a spine based on the three-dimensional coordinate group acquired by the three-dimensional coordinate acquisition unit, and

- the score calculation unit may calculate the bodily body condition score of the cow based on the feature quantity indicating the width of the bovine body or the position of the spine extracted by the feature quantity extraction unit.

- the maximum width of the cow's body and the height of the spine along the body can be quantified and expressed as a feature amount. Therefore, it is possible to accurately calculate the bodily body condition score based on the feature amount.

- a health condition estimation apparatus is a health condition estimation apparatus that estimates a cow's health condition, and shows a three-dimensional shape of the cow extracted from the cattle distance image.

- a three-dimensional coordinate acquisition unit that acquires a three-dimensional coordinate group, a standard model of the three-dimensional coordinate group of the cow classified for each score indicating the health state of the cow, and the three-dimensional coordinate acquired by the three-dimensional coordinate acquisition unit

- a score calculation unit that calculates the score of the cow corresponding to the three-dimensional coordinate group acquired by the three-dimensional coordinate acquisition unit by performing association with the coordinate group;

- the three-dimensional coordinate group closest to the three-dimensional coordinate group acquired by the three-dimensional coordinate acquisition unit can be selected from standard models of cow three-dimensional coordinate groups classified in advance for each score. Moreover, the score corresponding to the selected standard model can be used as the cow score.

- the three-dimensional coordinate group can be obtained from the distance image. For this reason, even if the posture of the cow is slightly inclined with respect to the camera, it is possible to calculate an accurate three-dimensional coordinate of the cow from the distance image. Therefore, it is not necessary to accurately position the cow, and the cow's health state can be estimated with high accuracy.

- a health state estimation device for estimating the health state of cows such as dairy cows. That is, a health condition estimation apparatus that calculates a cow signal score including a body condition score, a lumen fill score, and a locomotion score as a cow's health condition will be described.

- the body condition score is a score indicating the accumulation degree of bovine body fat.

- the lumen fill score is a score indicating the degree of dry matter fullness of the lumen (the cow's first stomach).

- the locomotion score is a score indicating the degree of cattle lameness.

- FIG. 1 is a block diagram showing a functional configuration of a health condition estimation apparatus according to Embodiment 1 of the present invention.

- the health state estimation device 10 is a device that estimates the health state of a cow, and includes a three-dimensional coordinate acquisition unit 11, a feature amount extraction unit 12, and a score calculation unit 13.

- the three-dimensional coordinate acquisition unit 11 acquires a three-dimensional coordinate group indicating the three-dimensional shape of the cow extracted from the cow distance image.

- a distance image sensor is attached to a position such as a robot milking machine or a milking parlor in the vicinity of a milking machine for milk in a barn where the upper left side of the cow can be imaged.

- the distance image sensor is a sensor that irradiates an object with infrared light and measures the distance from the reflection time to the object.

- the three-dimensional coordinate acquisition unit 11 acquires a three-dimensional coordinate group extracted from the distance image captured by the distance image sensor.

- the conversion from the distance image to the three-dimensional coordinates may be performed by the distance image sensor or the health condition estimation apparatus 10.

- the three-dimensional coordinate acquisition unit 11 can acquire the three-dimensional coordinate group of the cow by performing the background difference of the three-dimensional coordinate group.

- the feature amount extraction unit 12 extracts the feature amount of the cow based on the three-dimensional coordinate group acquired by the three-dimensional coordinate acquisition unit 11. That is, the feature quantity extraction unit 12 extracts any one of the following first to tenth feature quantities.

- the first to third feature amounts are feature amounts indicating the degree of depression of the cattle lumen, and are used to calculate a lumen fill score.

- the fourth and fifth feature amounts are feature amounts of the cow's back line, and are used to calculate a locomotion score.

- the sixth to eighth feature amounts are feature amounts indicating the cow's walking state, and are used to calculate the locomotion score.

- the ninth and tenth feature values are feature values indicating the body shape of the cow, and are used to calculate a body condition score.

- the feature amount extraction unit 12 is based on the three-dimensional coordinate group of the lumen area, which is the region of the bovine body surface in the vicinity of the cow lumen, among the three-dimensional coordinate group acquired by the three-dimensional coordinate acquisition unit 11. A feature amount indicating the degree of depression is extracted.

- the feature quantity extraction unit 12 specifies the torso position of the cow and the base position of the leg from the 3D coordinate group acquired by the 3D coordinate acquisition unit 11.

- FIG. 2 is a diagram for explaining a method of specifying the torso position of the cow and the base position of the leg.

- each three-dimensional coordinate of the cow is indicated by a white point. It is assumed that coordinate conversion has been performed in advance such that the front-rear direction of the cow is the X axis, the vertical direction is the Y axis, and the direction orthogonal to the X axis and the Y axis is the Z axis.

- the main axis direction of the three-dimensional coordinate group may be the X axis. This coordinate conversion may be performed by the feature amount extraction unit 12.

- the feature amount extraction unit 12 projects a three-dimensional coordinate group on a two-dimensional projection plane (YZ plane) perpendicular to the ground, and further projects it on the Y axis.

- the feature quantity extraction unit 12 counts the number of projection points for each height from the ground on the projection plane (along the Y axis) (curve 21). In the body part, since the number of projection points increases, when the total number of points constituting the shape of the cow is N and the number of projection points at the height is p, p / N> ⁇ (Formula 1)

- the feature quantity extraction unit 12 sets a set of point groups included in the height at which the body is present as a body point group, and sets a rectangular parallelepiped including the group as a body region 22.

- the feature quantity extraction unit 12 projects a three-dimensional point group located at a position lower than the height determined as the body region 22 onto a plane (XZ plane) equal to the ground surface (curve 23).

- the feature amount extraction unit 12 performs threshold processing in the same manner as (1), and specifies the regions 24A to 24C where the legs exist.

- the feature amount extraction unit 12 sets the areas 24A and 24B in the front half of the body as the front leg area and the area 24C in the back half as the rear leg area.

- the extraction unit 12 calculates the three-dimensional coordinates of the base 25A of the front leg as follows. (X g , Y bottom , Z g )

- the feature amount extraction unit 12 similarly obtains the coordinates of the base 25B of the rear leg.

- the feature amount extraction unit 12 extracts a three-dimensional point group (lumen region) around the lumen from the relative positional relationship between the detected trunk region 22 and the bases 25A and 25B of the legs.

- FIG. 3 is a diagram for explaining a method of extracting a lumen region.

- the feature amount extraction unit 12 extracts a region 26 included between the bases 25A and 25B of the front and rear legs in the body region 22.

- the feature amount extraction unit 12 is included in the region 26 when the X coordinate of the midpoint of the base of the leg is W h , the Y coordinate of the center of the trunk height is H h , and the Z coordinate of the center of the trunk depth is D h.

- a point p satisfying the condition x p > W h ⁇ y p > H h ⁇ z p ⁇ D h is included in the lumen region 27 Extract as

- the feature amount extraction unit 12 calculates the curvature of each point included in the lumen region 27 from the positional relationship with the neighboring point group. For example, as shown in FIG. 4A, the curvature of each point 32 is calculated.

- the feature amount extraction unit 12 generates a histogram of the calculated curvature. For example, as shown in FIG. 4B, a histogram is generated in which the horizontal axis indicates curvature and the vertical axis indicates frequency.

- the feature amount extraction unit 12 extracts the histogram of the curvature of each point 32 included in the lumen region 27 calculated in this way as a feature amount indicating the degree of depression of the lumen.

- the feature quantity extraction unit 12 may extract the following feature quantities as the feature quantities indicating the degree of lumen depression.

- the feature quantity extraction unit 12 assigns one plane to the lumen region 27 by the plane fitting method. For example, a plane that minimizes the sum of squares of the distances between the points included in the lumen region 27 may be applied to the lumen region 27 using the least square method.

- the feature amount extraction unit 12 is a binary that indicates whether each point 32 included in the lumen region 27 is on the front side or the back side of the plane 31 applied to the lumen region 27.

- the feature or the signed distance of each point from the plane 31 is calculated.

- the feature amount extraction unit 12 may extract, for each point 32, a binary feature indicating 1 when the point 32 is on the front surface of the plane 31 and 0 when it is on the back surface. Note that the value indicated by the binary feature is not limited to 1 and 0.

- the feature amount extraction unit 12 sets the distance to the plane 31 to be positive when the point 32 is located on the surface of the plane 31, and sets the distance to the plane to be negative when located on the back surface of the plane 31.

- the signed distance may be calculated. The sign distance may be reversed.

- the feature quantity extraction unit 12 extracts the extracted binary feature or signed distance histogram or the two-dimensional distribution on the plane 31 of the binary feature or signed distance as a feature quantity indicating the degree of depression of the lumen.

- the feature quantity extraction unit 12 may extract the following feature quantities as the feature quantities indicating the degree of lumen depression.

- the feature amount extraction unit 12 generates a convex hull 33 surrounding the lumen region 27.

- the convex hull 33 is formed of a plane or a part of an ellipsoid.

- the convex hull 33 can be calculated using a known three-dimensional convex hull calculation method.

- the feature amount extraction unit 12 extracts the volume of the space 34 formed between the three-dimensional coordinate group included in the lumen region 27 and the convex hull 33 as a feature amount indicating the degree of lumen depression.

- the feature quantity extraction unit 12 extracts a feature quantity indicating the degree of lumen depression when the lumen depression degree is maximized based on the three-dimensional coordinate group of the time-series lumen region.

- the feature amount extraction unit 12 extracts the feature amount of the cow's back line based on the three-dimensional coordinate group acquired by the three-dimensional coordinate acquisition unit 11.

- FIG. 5 is a diagram for explaining a method of extracting a cow's back line.

- the feature quantity extraction unit 12 projects all three-dimensional coordinate groups of cows on the XY plane.

- the feature amount extraction unit 12 passes through the points where the three-dimensional coordinates of the front and rear leg bases 25A and 25B are projected on the XY plane, and is the highest point on the straight lines 41A and 41B parallel to the Y axis (the Y coordinate is the maximum). The starting point 42A and the ending point 42B of the back line.

- the feature quantity extraction unit 12 determines the back line 43 connecting the start point 42A and the end point 42B by any of the following methods.

- the feature quantity extraction unit 12 sets the trajectory of the highest point (the point where the Y coordinate is maximum) along the X axis as the back line 43.

- a technique for removing the observation noise of the point group may be used in combination.

- the feature amount extraction unit 12 sets a straight line at a position sufficiently higher than the highest point and parallel to the straight line connecting the start point 42A and the end point 42B, and sets the set straight line as an initial value as an active control.

- the back line 43 may be fitted to a three-dimensional coordinate group using a method.

- the feature quantity extraction unit 12 extracts a parameter of the curve obtained by applying a predetermined curve to the detected back line 43 as a feature quantity of the back line 43.

- the feature quantity extraction unit 12 applies a quadratic curve, a circle, an ellipse, or a quartic curve to the back line 43, and extracts parameters representing these curves as the feature quantity of the back line 43.

- the feature quantity extraction unit 12 may apply a local quadratic curve to the back line 43 to calculate a histogram of local curvature, and extract the histogram as a feature quantity of the back line 43.

- the feature amount extraction unit 12 may extract the detected displacement amount of the back line 43 from a predetermined line as a feature amount of the back line. For example, a value obtained by normalizing the sum of the distances between the straight line connecting the start point 42A and the end point 42B of the back line 43 and each point on the back line 43 by the length of the straight line 43 is the feature amount of the back line 43. May be extracted as Each point on the back line 43 may be selected at equal intervals, for example. Further, instead of each point on the back line 43, a point on the curve fitted to the back line 43 may be used.

- the feature amount extraction unit 12 may extract a ratio between the length of the back line 43 and the length of a straight line connecting the start point 42A and the end point 42B of the back line 43 as the feature amount of the back line 43.

- the feature amount extraction unit 12 may acquire a time-series three-dimensional coordinate group from a time-series cow distance image, and may extract a cow feature amount based on the time-series three-dimensional coordinate group.

- a cow feature amount based on the time-series three-dimensional coordinate group.

- the feature quantity extraction unit 12 aligns the three-dimensional coordinate groups so that the position of the whole cow or the torso is associated between the three-dimensional coordinate groups in time series.

- the alignment of the three-dimensional coordinate group is performed using, for example, an ICP (Iterative Closest Point) method or a Coherent Point Drift method.

- the feature quantity extraction unit 12 extracts, as a feature quantity of the cow's walking state, a value indicating the variation in the degree of inclination in the horizontal direction when the cow is walking based on the time-series three-dimensional coordinate group. That is, one or both of the following method 1 and method 2 is extracted as a feature amount of the cow's walking state.

- the feature quantity extraction unit 12 passes through the base 25A of the front leg and cuts a three-dimensional coordinate group by a plane 51 parallel to the YZ plane, thereby including the three-dimensional included in the plane 51. Extract the coordinate group. Similarly, for the base 25B of the rear leg, a three-dimensional coordinate group included in the plane 51 is extracted.

- the feature quantity extraction unit 12 assigns a straight line 53 to the three-dimensional coordinate group belonging to the back among the three-dimensional coordinate groups belonging to the plane 51 for each plane 51, and calculates the inclination thereof. calculate. This is calculated over a predetermined number of walking cycles or a predetermined time. As a result, a graph is obtained in which the horizontal axis represents time and the vertical axis represents the slope as shown in FIG.

- the three-dimensional coordinate group belonging to the back may be, for example, a coordinate group within a predetermined distance in the Y-axis direction from a coordinate having a larger Y coordinate among the three-dimensional coordinate group belonging to the plane 51.

- the straight line 53 may be, for example, a straight line that minimizes the sum of squares of the distance to the three-dimensional coordinate group belonging to the back.

- the feature amount extraction unit 12 calculates a gait variation scale according to the following Equation 2, and uses the calculated variation measure as a feature amount of the cow's walking state.

- Walking variability scale

- the feature amount extraction unit 12 belongs to the back of the three-dimensional coordinate group belonging to the plane 51 for each of the plane 51 passing through the base 25A of the front leg and the plane 51 taking the base 25B of the rear leg, as in the method 1.

- a frequency of the time-series (one cycle or more) three-dimensional coordinate group is subjected to frequency conversion (for example, Fourier transform), thereby obtaining a vertical movement frequency of the three-dimensional coordinate group.

- Equation 3 indicates the magnitude of the vertical movement change, and it is considered that the larger the value of Equation 3, the more problematic the hoof is.

- Equation 4 indicates whether the change in vertical motion is close to a sine wave, and the value of Equation 4 increases as the user walks more unevenly.

- the feature amount extraction unit 12 extracts a value indicating the carry of the leg when the cow is walking based on the time-series three-dimensional coordinate group as the feature amount of the cow's walking state.

- the feature amount extraction unit 12 creates a slice cross section parallel to the ground surface (XZ plane) at the midpoint height between the ground surface (XZ plane) and the lower end of the body region 22 and is included in the cross section.

- the position of each leg is obtained from the three-dimensional coordinate group. For example, clustering of a three-dimensional coordinate group may be performed within the cross section, and the position of an area having a predetermined size or more may be used as the position of each leg.

- the feature quantity extraction unit 12 obtains the position of each leg over several walking cycles, and calculates the following stride or leg opening feature quantity from the trajectory.

- the feature amount extraction unit 12 calculates the shortest distance between the front legs and the rear legs during walking with the distance between the bases 25A and 25B of the front legs and the rear legs, and a value obtained by normalizing the shortest distance as the feature amount of the stride. .

- the stride obtained by averaging these may be calculated.

- the feature amount extraction unit 12 calculates how much each leg that is walking jumps out with respect to the maximum width of the body region 22 in the Z-axis direction. That is, the feature amount extraction unit 12 calculates the distance from the side surface of the body region 22 of the leg that protrudes most among the limbs or the variance of the distance from the side surface of the body region 22 of each leg, and calculates the calculated value of the leg. It is good also as an opening feature-value.

- the feature amount extraction unit 12 calculates a gait feature amount used for gait authentication of a person for a cow and sets it as a feature amount of a cow's walking state. This technique is applicable not only to a specific part but to the whole body or each part. Typical examples of gait features are as shown in the following a to d, but various other gait features can be used.

- the feature amount extraction unit 12 may use a gait (gait) fluctuation feature as a gait feature.

- gait gait fluctuation feature

- the feature quantity extraction unit 12 calculates gait fluctuation features between cycles as shown in e and f below. This technique is applicable not only to a specific part but to the whole body or each part.

- F The average silhouette difference between cycles is used as spatial fluctuation in the gait.

- the feature amount extraction unit 12 extracts a feature amount indicating the width of the cow's body based on the three-dimensional coordinate group acquired by the three-dimensional coordinate acquisition unit 11.

- FIG. 7A is a diagram showing a three-dimensional coordinate group belonging to the plane 51, as in FIG. 6B. As shown in FIG. 7A, the distance in the Z-axis direction between the three-dimensional coordinate with the largest Y coordinate and the three-dimensional coordinate with the smallest Z coordinate is extracted as the width of the body.

- the feature amount extraction unit 12 extracts the distance in the Z-axis direction between the three-dimensional coordinate having the maximum Y coordinate and the three-dimensional coordinate having the minimum Z coordinate when the cow is viewed from behind as the width of the body. Also good. At this time, processing is performed except for the three-dimensional coordinates of the neck and head.

- the feature quantity extraction unit 12 extracts a feature quantity indicating the position of the spine of the cow based on the 3D coordinate group acquired by the 3D coordinate acquisition unit 11.

- the feature amount extraction unit 12 sets a plurality of planes parallel to the YZ plane at predetermined intervals along a straight line connecting the start point 42A and the end point 42B of the back line shown in FIG. Each plane is called a slice.

- a three-dimensional coordinate group is extracted in each slice.

- the feature quantity extraction unit 12 sets, for each slice, the highest point of the three-dimensional coordinate group included in the slice (the point where the Y coordinate is maximum) and the left or right of the highest point. calculating the difference H x in height between the point separated to the right by a distance L.

- the feature amount extraction unit 12 obtains a feature amount indicating the position of the cow's spine by any of the following methods a to c.

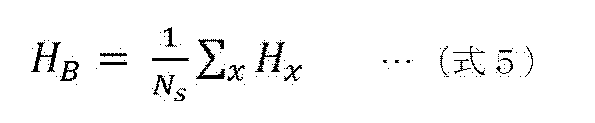

- the feature amount extraction unit 12 averages the height difference over the entire back line. That is, when the number of slices is Ns, the feature amount extraction unit 12 calculates the scale Hb according to the following formula 5, and sets the scale Hb as the feature amount indicating the position of the cow's spine.

- the feature quantity extraction unit 12 creates a histogram having the horizontal axis H x and the vertical axis frequency, and uses the histogram as a feature quantity indicating the position of the cow's spine.

- the feature amount extraction unit 12 uses a trajectory of a change in H x due to movement of a slice along the X axis as a feature amount.

- the score calculation unit 13 is based on any one of the first to tenth feature amounts calculated by the feature amount extraction unit 12, and the lumen fill score, the locomotion score, or the body condition score. Is calculated.

- the score calculation unit 13 calculates a score for each feature quantity based on a regression model obtained by regression analysis using each feature quantity 60 as an explanatory variable and the score as an objective variable.

- a regression analysis with a score having the feature amount as an explanatory variable is performed.

- feature extraction from cattle with non-stationary movements includes outliers and errors, so support vector regression considering outliers and estimation errors can be obtained in addition to score estimates.

- Gaussian process regression robust score estimation can be performed.

- the feature quantity is a time-series signal that does not have a fixed length dimension

- a regression analysis similar to the above is performed after resampling the feature quantity to a fixed length dimension using a technique such as self-dynamic time expansion / contraction. I do.

- the score is estimated using support vector regression or Gaussian process regression with non-linear expansion by the kernel, considering the degree of matching by dynamic time expansion and contraction for the learning set of the score and time series signal as the kernel function value. .

- the score calculation unit 13 calculates a score for each feature amount based on a linear regression model obtained by learning in advance.

- FIG. 8 is a diagram showing an example of a linear regression model. It is assumed that the linear regression model 61 is calculated in advance by performing regression analysis using each feature quantity 60 as an explanatory variable and a score as an objective variable.

- the score used is a score given in advance by a veterinarian or a dairy farmer. Thereby, for example, the score for the feature amount 62 can be calculated as 3.5 based on the linear regression model 61. When the score is shown in five stages, the calculated score may be rounded off.

- the score calculation unit 13 calculates a lumen fill score based on at least one of the first to third feature amounts.

- the score calculation unit 13 calculates a locomotion score based on at least one of the fourth to eighth feature amounts.

- the score calculation unit 13 calculates a body condition score based on at least one of the ninth and tenth feature values.

- the score calculation unit 13 may classify the cows into classes corresponding to any of the above scores based on any of the above feature quantities.

- the feature quantity extraction unit 12 classifies the cow into one of a class 1 having a locomotion score of 1 and a class 2 having a locomotion score of 2 or more based on any of the scores described above. It may be.

- calculation of a score includes classification into a class corresponding to the score.

- the feature amount extraction unit 12 calculates the above-described eighth feature amount (gait feature) from the three-dimensional coordinate group of the target cow acquired by the three-dimensional coordinate acquisition unit 11. Specifically, the feature amount extraction unit 12 calculates an average silhouette feature that is one of the two-dimensional silhouette features and an average depth feature that is one of the three-dimensional silhouette features among the gait features described above. .

- the score calculation unit 13 classifies the locomotion score of the target cow as 1 or 2 or more using the feature amount extracted by the feature amount extraction unit 12 using SVM (Support Vector Vector Machine). To do.

- SVM Small Vector Vector Machine

- FIG. 9A is a diagram illustrating an example of a three-dimensional coordinate group of a cow acquired by the three-dimensional coordinate acquisition unit 11.

- the three-dimensional coordinates of the cow are shown as whitish dots.

- Fig.9 (a) is the figure which looked at the cow from the side.

- the three-dimensional coordinate acquisition part 11 shall acquire the three-dimensional coordinate group for one walk period from a predetermined database for every cow.

- the feature amount extraction unit 12 converts the three-dimensional coordinate group shown in FIG. 9A to a camera when it is assumed that the cow is imaged by the camera 21 virtually installed above the cow.

- the depth data from 21 to the back of the cow is acquired.

- the feature amount extraction unit 12 calculates the average depth of each point on the back of the cow from the depth data for one walking cycle.

- FIG. 9B is a diagram showing the average depth characteristics, and each pixel arranged near the center of FIG. 9B shows the average depth of each point on the back of the cow. It shows that the distance from the camera 21 is larger as the dot is white except for the background portion other than the cow.

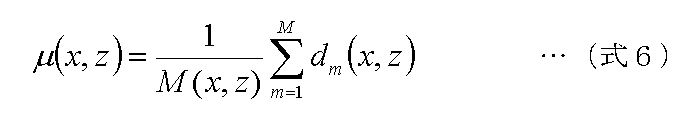

- Expression 6 is an expression for calculating the average depth.

- ⁇ (x, z) represents the average depth of the coordinates (x, z)

- d m (x, z) represents the depth data in the coordinates (x, z) of the m-th image

- M ( x, z) indicates the number of three-dimensional coordinate groups in which depth data is observed at coordinates (x, z) among the three-dimensional coordinate groups for one walking cycle.

- the roundness of the back can be expressed.

- FIG. 9C is a diagram showing silhouette features, and each pixel arranged near the center of FIG. 9C shows the appearance probability of a cow silhouette. Except for the background part other than the cow, the whiter the dots, the higher the appearance probability of the silhouette image.

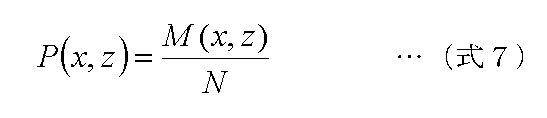

- Expression 7 is an expression for calculating the appearance probability of a silhouette.

- P (x, z) indicates the appearance probability of a silhouette at coordinates (x, z)

- N indicates the number of three-dimensional coordinate groups for one walking cycle

- M (x, z) is described above. Street.

- the score calculation unit 13 classifies the average depth feature or silhouette feature extracted by the feature amount extraction unit 12 into one of two classes using the learned SVM. That is, the score calculation unit 13 classifies the class 1 into a class 1 having a locomotion score of 1 and a class 2 having a locomotion score of 2 or more.

- SVM learning is performed using a locomotion score given by a dairy farmer and an average depth feature or an average silhouette feature extracted from a three-dimensional coordinate group for learning. At that time, each feature amount is high-dimensional data. For this reason, dimension compression using principal component analysis is performed before learning. The dimension-compressed data is learned as an average depth feature or an average silhouette feature, and an SVM is obtained as a two-class classifier.

- FIG. 10 shows the result of classifying the locomotion score using SVM.

- a classification experiment was performed on a sequence of a total of 523 sets of three-dimensional coordinate groups for 16 cows.

- the first column of the table shown in FIG. 10 shows the feature quantities used for class classification and the SVM kernel.

- the “correct answer rate (%)” in the second column indicates the correct answer rate (%) of the overall class classification.

- the “correct answer rate (%) for class 1” in the third column indicates the proportion of cattle correctly classified in class 1 for cattle to be classified in class 1.

- the “correct answer rate (%) for class 2” in the fourth column indicates the proportion of cattle correctly classified into class 2 for cattle to be classified into class 2.

- surface shown in FIG. 10 the thick frame has shown the highest correct answer rate in each column.

- the RBF Random R Basis Function

- the correct answer rate is higher than that of the linear kernel.

- SVM using a linear kernel is unsuitable for classification, it turns out that SVM using an RBF kernel shows a correct answer rate of 90% or more.

- classification can be performed with a correct answer rate of nearly 100%.

- Non-Patent Document 8 There is a method described in Non-Patent Document 8 as a conventional method.

- the conventional method is characterized by the bending of the back of the cow. Specifically, an ellipse is fitted to the position of the spine of the cow, and the positional relationship of the spine is expressed as an angle or length and used as a feature amount.

- two-class classification into a class having a locomotion score of 2 or less and a class of 3 or more is performed, and an accuracy of about 90% is obtained.

- the correct rate of classification into class 2 with a locomotion score of 2 or more is about 70% in the conventional method. Conceivable.

- the correct answer rate for class 2 classification with a locomotion score of 2 or more is about 97%. .

- the health condition estimation apparatus 10 disclosed in the present embodiment it was found that class classification based on the locomotion score can be performed with high accuracy.

- the lumen fill score can be accurately calculated by using the curvature histogram shown in the first feature amount as a feature amount indicating the degree of lumen depression.

- the lumen fill score can be accurately calculated by using the distance shown in the second feature amount as a feature amount indicating the degree of depression of the lumen.

- the volume of the space formed between the convex hull surrounding the lumen area and the lumen area shown in the third feature amount is relatively small, but the lumen area is recessed. In some cases, the volume is relatively large. For this reason, the lumen fill score can be accurately calculated by using the volume as a feature amount indicating the degree of depression of the lumen.

- the cow's spine has a curved shape.

- the parameter of the curve obtained by fitting the curve to the back line can be the feature amount of the back line. Thereby, the locomotion score can be calculated accurately.

- the spine also bends, so the amount of displacement from the straight line shown in the fifth feature amount is relatively large.

- the displacement is relatively small because the spine is not bent too much. For this reason, the locomotion score can be accurately calculated by using the fifth feature amount as the feature amount of the back line.

- the sixth feature amount for example, it can be expressed as a feature amount that the left shoulder is falling from the right shoulder and walking while tilting to the left. For this reason, the locomotion score of the cow can be accurately calculated based on the sixth feature amount.

- the seventh feature value for example, the stride length of the cow or the protruding amount of the leg from the width of the trunk can be digitized and expressed as the feature value. For this reason, the locomotion score of the cow can be accurately calculated based on the seventh feature amount.

- the eighth feature value it is possible to represent the way of walking the cow as a gait feature value. For this reason, the locomotion score of a cow can be accurately calculated based on such gait feature amount.

- the maximum width of the cow's body, the height of the spine along the body, etc. can be digitized and expressed as the feature quantity. Therefore, it is possible to accurately calculate the bodily body condition score based on the feature amount.

- This modification is different from the first embodiment in the method for specifying the position of the lumen area, the back line, and the like. That is, in this modification, the position of the lumen area, the back line, etc. is specified by aligning the three-dimensional coordinate group of the cow of interest with the model of the predetermined three-dimensional coordinate group of the cow.

- FIG. 11A shows an example of a standard model and tagged lumen regions.

- the feature quantity extraction unit 12 aligns the three-dimensional coordinate group of the cow to be feature extraction shown in FIG. 11 (b) with the standard model shown in FIG. 11 (a), and lumens tagged with the standard model. By specifying the position corresponding to the area or the back line, the position of the lumen area or the back line of the target cow is specified.

- a cow score was calculated by using regression analysis.

- the cow's score is calculated by comparing the standard model prepared for each score with the three-dimensional coordinate group of the cow whose score is to be calculated.

- FIG. 12 is a block diagram showing a functional configuration of the health condition estimation apparatus according to Embodiment 2 of the present invention.

- the health state estimation device 15 is a device that estimates the health state of a cow, and includes a three-dimensional coordinate acquisition unit 11, a standard model storage unit 16, and a score calculation unit 17.

- the three-dimensional coordinate acquisition unit 11 acquires a three-dimensional coordinate group indicating the three-dimensional shape of the cow extracted from the distance image of the cow, as in the first embodiment.

- the standard model storage unit 16 is a storage device that stores a standard model database indicating a standard model of cattle for each score, and is configured by a storage device such as an HDD (Hard Disk Drive) or a RAM (Random Access Memory). .

- a storage device such as an HDD (Hard Disk Drive) or a RAM (Random Access Memory).

- FIG. 13A shows an example of a standard model database.

- a standard model is stored for each combination of scores when the horizontal axis is the locomotion score and the vertical axis is the lumen fill score. That is, a locomotion score and a lumen fill score are given to each of the plurality of cows by a veterinarian or a dairy farmer.

- the three-dimensional coordinate group of the cow with the score of the combination is aligned using the ICP method or Coherent Point Drift method, etc. Assume that the average shape of the torso is prepared in advance as a standard model of cattle.

- the score calculation unit 17 aligns the three-dimensional coordinate group of the cow to be scored as shown in FIG. 13B with each standard model included in the standard model database shown in FIG. By doing so, the association is performed.

- the score calculation unit 17 selects a standard model that minimizes the residual of the associated distance as a result of the alignment, and selects a combination of the locomotion score and the lumen fill score corresponding to the standard model as a target cow. Calculated as the locomotion score and lumen fill score.

- a standard model is prepared for each combination of a locomotion score and a lumen fill score.

- a body condition score is added, and a locomotion score and a lumen fill score are added.

- a standard model may be prepared for each combination of body condition scores.

- a standard model may be prepared for each combination of a body condition score and a locomotion score or a lumen fill score.

- the standard model of cattle may be time-series data of a three-dimensional coordinate group. Thereby, the walking state of a cow can be expressed in detail.

- the standard model closest to the three-dimensional coordinate group acquired by the three-dimensional coordinate acquisition unit 11 can be selected from the standard model database.

- the score corresponding to the selected standard model can be used as the cow score.

- the three-dimensional coordinate group can be obtained from the distance image. For this reason, even if the posture of the cow is slightly inclined with respect to the camera, it is possible to calculate an accurate three-dimensional coordinate of the cow from the distance image. Therefore, it is not necessary to accurately position the cow, and the cow's health state can be estimated with high accuracy.

- the health state estimation devices 10 and 15 may be configured as a computer system including a microprocessor, a ROM, a RAM, a hard disk drive, a display unit, a keyboard, a mouse, and the like.

- a computer program is stored in the RAM or hard disk drive. Each device achieves its functions by the microprocessor operating according to the computer program.

- the computer program is configured by combining a plurality of instruction codes indicating instructions for the computer in order to achieve a predetermined function.

- LSI Large Scale Integration

- the present invention may be the method described above. Further, the present invention may be a computer program that realizes these methods by a computer.

- Each step included in the program may be executed by a plurality of computers. Furthermore, the above embodiment and the above modification examples may be combined.

- the present invention can be applied to a health condition estimation device for estimating the health condition of a cow.

Landscapes

- Life Sciences & Earth Sciences (AREA)

- Health & Medical Sciences (AREA)

- Environmental Sciences (AREA)

- Engineering & Computer Science (AREA)

- Medical Informatics (AREA)

- Public Health (AREA)

- Biophysics (AREA)

- Biomedical Technology (AREA)

- Pathology (AREA)

- General Health & Medical Sciences (AREA)

- Dentistry (AREA)

- Molecular Biology (AREA)

- Veterinary Medicine (AREA)

- Oral & Maxillofacial Surgery (AREA)

- Physics & Mathematics (AREA)

- Animal Behavior & Ethology (AREA)

- Surgery (AREA)

- Heart & Thoracic Surgery (AREA)

- Biodiversity & Conservation Biology (AREA)

- Animal Husbandry (AREA)

- Physiology (AREA)

- Databases & Information Systems (AREA)

- Epidemiology (AREA)

- Primary Health Care (AREA)

- Data Mining & Analysis (AREA)

- Measurement Of The Respiration, Hearing Ability, Form, And Blood Characteristics Of Living Organisms (AREA)

- Image Analysis (AREA)

Abstract

Description

図1は、本発明の実施の形態1に係る健康状態推定装置の機能的な構成を示すブロック図である。

p/N>θ …(式1)

(Xg,Ybottom,Zg)

歩行のばらつき尺度=|傾きが正である時間-歩行時間の半分の時間|

…(式2)

特徴量抽出部12は、高さの違いを背線全体で平均する。つまり、特徴量抽出部12は、スライス数をNsとしたとき、以下の式5に従い、尺度Hbを算出し、尺度Hbを牛の背骨の位置を示す特徴量とする。

特徴量抽出部12は、横軸をHx、縦軸を頻度とするヒストグラムを作成し、当該ヒストグラムを牛の背骨の位置を示す特徴量とする。

特徴量抽出部12は、X軸に沿ったスライスの移動によるHxの変化の軌跡を特徴量とする。

次に、健康状態推定装置10を用いたロコモーションスコアの算出についての実験結果について説明する。

以上説明したように、実施の形態1に係る健康状態推定装置10によると、牛の3次元形状を示す3次元座標群から特徴量を抽出し、その特徴量に基づいて牛の健康状態を示すスコアを算出している。3次元座標群は、距離画像から得ることができる。このため、牛の姿勢がカメラに対して多少傾いていたとしても、距離画像から牛の正確な3次元座標を算出することが可能である。よって、牛の位置決めを正確に行う必要なく、高精度に牛の健康状態を推定することができる。

次に、実施の形態1の変形例について説明する。

さらに、上記実施の形態および上記変形例をそれぞれ組み合わせるとしてもよい。

11 3次元座標取得部

12 特徴量抽出部

13、17 スコア算出部

16 標準モデル記憶部

Claims (15)

- 牛の健康状態を推定する健康状態推定装置であって、

前記牛の距離画像から抽出された当該牛の3次元形状を示す3次元座標群を取得する3次元座標取得部と、

前記3次元座標取得部が取得した前記3次元座標群に基づいて、前記牛の特徴量を抽出する特徴量抽出部と、

前記特徴量抽出部が抽出した前記特徴量に基づいて、前記牛の健康状態を示すスコアを算出するスコア算出部と

を備える健康状態推定装置。 - 前記特徴量抽出部は、前記3次元座標取得部が取得した前記3次元座標群のうち前記牛のルーメンの近傍の前記牛の体表面の領域であるルーメン領域の3次元座標群に基づいて、当該ルーメンの凹み具合を示す特徴量を抽出し、

前記スコア算出部は、前記特徴量抽出部が抽出した前記ルーメンの凹み具合を示す特徴量に基づいて、前記牛のルーメンフィルスコアを算出する

請求項1に記載の健康状態推定装置。 - 前記特徴量抽出部は、前記ルーメン領域の前記3次元座標群に基づいて、当該ルーメン領域における曲率のヒストグラムを、前記ルーメンの凹み具合を示す特徴量として抽出する

請求項2に記載の健康状態推定装置。 - 前記特徴量抽出部は、前記ルーメン領域の前記3次元座標群に基づいて、前記ルーメン領域と当該ルーメン領域に割り当てた所定の平面との間の距離を、前記ルーメンの凹み具合を示す特徴量として抽出する

請求項2に記載の健康状態推定装置。 - 前記特徴量抽出部は、前記ルーメン領域の前記3次元座標群に基づいて、前記ルーメン領域を囲む凸包と前記ルーメン領域との間にできる空間の容積を、前記ルーメンの凹み具合を示す特徴量として抽出する

請求項2に記載の健康状態推定装置。 - 前記3次元座標取得部は、時系列の前記牛の距離画像から時系列の前記3次元座標群を取得し、

前記特徴量抽出部は、時系列の前記ルーメン領域の3次元座標群に基づいて、前記ルーメンの凹み具合が最大となるときの前記ルーメンの凹み具合を示す特徴量を抽出する

請求項2~請求項5のいずれか1項に記載の健康状態推定装置。 - 前記特徴量抽出部は、前記3次元座標取得部が取得した前記3次元座標群に基づいて、前記牛の背線を検出し、検出した前記背線に所定の曲線を当てはめることにより得られる当該曲線のパラメータを、前記背線の特徴量として抽出し、

前記スコア算出部は、前記特徴量抽出部が抽出した前記背線の特徴量に基づいて、前記牛のロコモーションスコアを算出する

請求項1に記載の健康状態推定装置。 - 前記特徴量抽出部は、前記3次元座標取得部が取得した前記3次元座標群に基づいて、前記牛の背線を検出し、検出した前記背線の所定線からの変位量を、前記背線の特徴量として抽出し、

前記スコア算出部は、前記特徴量抽出部が抽出した前記背線の特徴量に基づいて、前記牛のロコモーションスコアを算出する

請求項1に記載の健康状態推定装置。 - 前記3次元座標取得部は、時系列の前記牛の距離画像から時系列の前記3次元座標群を取得し、

前記特徴量抽出部は、時系列の前記3次元座標群に基づいて、前記牛の特徴量を抽出する

請求項1に記載の健康状態推定装置。 - 前記特徴量抽出部は、時系列の前記3次元座標群に基づいて、前記牛の歩行状態の特徴量を抽出し、

前記スコア算出部は、前記特徴量抽出部が抽出した前記牛の歩行状態の特徴量に基づいて、前記牛のロコモーションスコアを算出する

請求項9に記載の健康状態推定装置。 - 前記特徴量抽出部は、時系列の前記3次元座標群に基づいて、前記牛の歩行時における左右方向への傾き度合いのばらつきを示す値を、前記牛の歩行状態の特徴量として抽出する

請求項10に記載の健康状態推定装置。 - 前記特徴量抽出部は、時系列の前記3次元座標群に基づいて、前記牛の歩行時における脚の運びを示す値を、前記牛の歩行状態の特徴量として抽出する

請求項10に記載の健康状態推定装置。 - 前記特徴量抽出部は、時系列の前記3次元座標群に基づいて、前記牛の歩容特徴量を、前記牛の歩行状態の特徴量として抽出する

請求項10に記載の健康状態推定装置。 - 前記特徴量抽出部は、前記3次元座標取得部が取得した前記3次元座標群に基づいて、前記牛の体躯の幅または背骨の位置を示す特徴量を抽出し、

前記スコア算出部は、前記特徴量抽出部が抽出した前記牛の体躯の幅または背骨の位置を示す特徴量に基づいて、前記牛のボディーコンディションスコアを算出する

請求項1に記載の健康状態推定装置。 - 牛の健康状態を推定する健康状態推定装置であって、

前記牛の距離画像から抽出された当該牛の3次元形状を示す3次元座標群を取得する3次元座標取得部と、

牛の健康状態を示すスコアごとに分類された当該牛の3次元座標群の標準モデルと、前記3次元座標取得部が取得した前記3次元座標群との対応付けを行うことにより、前記3次元座標取得部が取得した前記3次元座標群に対応する前記牛のスコアを算出するスコア算出部と

を備える健康状態推定装置。

Priority Applications (4)

| Application Number | Priority Date | Filing Date | Title |

|---|---|---|---|

| US16/097,557 US11166436B2 (en) | 2016-04-28 | 2017-02-13 | Health condition estimation device |

| JP2018514135A JP6777948B2 (ja) | 2016-04-28 | 2017-02-13 | 健康状態推定装置 |

| EP17789008.4A EP3449719A4 (en) | 2016-04-28 | 2017-02-13 | DEVICE FOR THE ASSESSMENT OF HEALTH |

| CN201780025605.8A CN109068613B (zh) | 2016-04-28 | 2017-02-13 | 健康状态推定装置 |

Applications Claiming Priority (2)

| Application Number | Priority Date | Filing Date | Title |

|---|---|---|---|

| JP2016-090680 | 2016-04-28 | ||

| JP2016090680 | 2016-04-28 |

Publications (1)

| Publication Number | Publication Date |

|---|---|

| WO2017187719A1 true WO2017187719A1 (ja) | 2017-11-02 |

Family

ID=60160280

Family Applications (1)

| Application Number | Title | Priority Date | Filing Date |

|---|---|---|---|

| PCT/JP2017/005089 Ceased WO2017187719A1 (ja) | 2016-04-28 | 2017-02-13 | 健康状態推定装置 |

Country Status (5)

| Country | Link |

|---|---|

| US (1) | US11166436B2 (ja) |

| EP (1) | EP3449719A4 (ja) |

| JP (1) | JP6777948B2 (ja) |

| CN (1) | CN109068613B (ja) |

| WO (1) | WO2017187719A1 (ja) |

Cited By (7)

| Publication number | Priority date | Publication date | Assignee | Title |

|---|---|---|---|---|

| JP2022096833A (ja) * | 2020-12-18 | 2022-06-30 | 国立大学法人広島大学 | 密集度推定装置、密集度推定方法及びプログラム |

| JP2022110224A (ja) * | 2021-01-18 | 2022-07-29 | 日本ハム株式会社 | 豚飼育支援装置、豚飼育支援方法、および豚飼育支援プログラム |

| US11423561B2 (en) * | 2018-02-09 | 2022-08-23 | Nippon Telegraph And Telephone Corporation | Learning apparatus, estimation apparatus, learning method, estimation method, and computer programs |

| JP2022125851A (ja) * | 2021-02-17 | 2022-08-29 | 国立研究開発法人農業・食品産業技術総合研究機構 | 発情検出装置、発情検出方法、発情検出プログラム、及び記録媒体 |

| JP2023041002A (ja) * | 2021-09-10 | 2023-03-23 | 国立研究開発法人農業・食品産業技術総合研究機構 | 評価装置、評価方法、評価プログラム、及び記録媒体 |

| JP2023066005A (ja) * | 2021-10-28 | 2023-05-15 | 国立研究開発法人農業・食品産業技術総合研究機構 | 牛の評価装置および牛の評価方法 |

| WO2026063054A1 (ja) * | 2024-09-19 | 2026-03-26 | 国立研究開発法人農業・食品産業技術総合研究機構 | 牛の座骨部推定装置及び腰角部推定装置、牛の評価システム、並びに牛の座骨部推定プログラム及び腰角部推定プログラム |

Families Citing this family (9)

| Publication number | Priority date | Publication date | Assignee | Title |

|---|---|---|---|---|

| WO2020109348A1 (en) * | 2018-11-28 | 2020-06-04 | Evonik Operations Gmbh | Method of controlling a livestock farm |

| NL2023104B1 (en) * | 2019-05-10 | 2020-11-30 | Lely Patent Nv | Ruminant animal monitoring system |

| EP3965561B1 (en) | 2019-05-10 | 2025-09-17 | Lely Patent N.V. | Ruminant animal monitoring system |

| CN111166338B (zh) * | 2019-12-24 | 2022-04-08 | 天津农学院 | 一种基于tof深度数据的妊娠母猪体尺计算方法 |

| CN112545492B (zh) * | 2020-11-27 | 2022-08-16 | 江西省农业科学院农业经济与信息研究所 | 一种牛瘤胃充盈度测量装置及牛瘤胃充盈度测量系统 |

| CN114299616A (zh) * | 2021-12-29 | 2022-04-08 | 内蒙古工业大学 | 一种基于机器视觉的奶牛步态评分方法和系统 |

| CN114642422B (zh) * | 2022-03-09 | 2025-04-11 | 内蒙古工业大学 | 基于机器视觉的奶牛步态的评分方法 |

| SE2450492A1 (en) * | 2024-05-08 | 2025-11-09 | Sleip Ai Ab | Motion analysis using computer vision with size scaling |

| CN121120922A (zh) * | 2025-08-12 | 2025-12-12 | 北京市农林科学院信息技术研究中心 | 奶牛体况自动化评分方法及装置 |

Citations (1)

| Publication number | Priority date | Publication date | Assignee | Title |

|---|---|---|---|---|

| JP2006218122A (ja) * | 2005-02-10 | 2006-08-24 | New Industry Research Organization | 脚状態診断システムとその診断方法 |

Family Cites Families (23)

| Publication number | Priority date | Publication date | Assignee | Title |

|---|---|---|---|---|

| US7399220B2 (en) * | 2002-08-02 | 2008-07-15 | Kriesel Marshall S | Apparatus and methods for the volumetric and dimensional measurement of livestock |

| US7039220B2 (en) * | 2002-08-14 | 2006-05-02 | C-Scan, L.L.P. | Methods and apparatus for the dimensional measurement of livestock using a single camera |

| US8374671B2 (en) * | 2006-02-27 | 2013-02-12 | Select Research Limited | Health indicator |

| US20090299232A1 (en) * | 2006-07-12 | 2009-12-03 | Koninklijke Philips Electronics N.V. | Health management device |

| US7601126B2 (en) * | 2006-07-21 | 2009-10-13 | The Curators Of The University Of Missouri | Lameness evaluation systems and methods |

| AU2009321691B2 (en) * | 2008-12-03 | 2014-02-27 | Delaval Holding Ab | Arrangement and method for determining a body condition score of an animal |

| MX2011009043A (es) * | 2009-02-27 | 2011-12-16 | Body Surface Translations Inc | Estimacion de parametros fisicos usando representaciones tridimensionales. |

| JP2011078728A (ja) * | 2009-03-10 | 2011-04-21 | Shinsedai Kk | 身体状態評価装置、状態推測装置、歩幅推測装置、及び、健康管理システム |

| JP5421179B2 (ja) * | 2010-04-09 | 2014-02-19 | 公立大学法人大阪府立大学 | 動物活動計測装置 |

| AU2010219406B2 (en) * | 2010-05-19 | 2013-01-24 | Plf Agritech Pty Ltd | Image analysis for making animal measurements |

| US9311556B2 (en) * | 2010-05-19 | 2016-04-12 | Plf Agritech Pty Ltd | Image analysis for making animal measurements including 3-D image analysis |

| EP2693870B1 (en) * | 2011-04-05 | 2016-11-16 | DeLaval Holding AB | Animal handling arrangement and method |

| CN202276716U (zh) * | 2011-08-25 | 2012-06-20 | 大连亿科信息技术有限公司 | 饲养奶牛用实时监测系统 |

| US9922242B2 (en) * | 2012-12-02 | 2018-03-20 | Agricam Ab | Systems and methods for predicting the outcome of a state of a subject |

| JP6402455B2 (ja) | 2014-03-13 | 2018-10-10 | 富士通株式会社 | 管理方法、管理プログラム、管理装置および管理システム |

| NL2012540B1 (en) * | 2014-04-01 | 2016-02-15 | Lely Patent Nv | An arrangement and method to determine a body condition score of an animal. |

| CN104008367B (zh) * | 2014-05-08 | 2018-05-01 | 中国农业大学 | 基于计算机视觉的育肥猪的自动行为分析系统及方法 |

| JP2016059300A (ja) * | 2014-09-17 | 2016-04-25 | 国立大学法人広島大学 | 牛体診断システムおよび牛体診断方法 |

| PL3316680T5 (pl) * | 2015-07-01 | 2023-10-30 | Viking Genetics Fmba | System i metoda identyfikowania pojedynczych zwierząt na podstawie obrazów grzbietów |

| SE1650117A1 (en) * | 2015-11-04 | 2017-05-05 | Delaval Holding Ab | System and Method for Imaging and Processing Animal Data |

| US9993182B2 (en) * | 2016-02-19 | 2018-06-12 | Conduent Business Services, Llc | Computer vision system for ambient long-term gait assessment |

| WO2018100883A1 (ja) * | 2016-11-29 | 2018-06-07 | ソニー株式会社 | 表示制御装置、表示制御方法およびプログラム |

| US10327697B1 (en) * | 2018-12-20 | 2019-06-25 | Spiral Physical Therapy, Inc. | Digital platform to identify health conditions and therapeutic interventions using an automatic and distributed artificial intelligence system |

-

2017

- 2017-02-13 CN CN201780025605.8A patent/CN109068613B/zh not_active Expired - Fee Related

- 2017-02-13 US US16/097,557 patent/US11166436B2/en not_active Expired - Fee Related

- 2017-02-13 EP EP17789008.4A patent/EP3449719A4/en not_active Withdrawn

- 2017-02-13 JP JP2018514135A patent/JP6777948B2/ja not_active Expired - Fee Related

- 2017-02-13 WO PCT/JP2017/005089 patent/WO2017187719A1/ja not_active Ceased

Patent Citations (1)

| Publication number | Priority date | Publication date | Assignee | Title |

|---|---|---|---|---|

| JP2006218122A (ja) * | 2005-02-10 | 2006-08-24 | New Industry Research Organization | 脚状態診断システムとその診断方法 |

Non-Patent Citations (4)

| Title |

|---|

| S.VIAZZI: "Comparison of a three-dimensional and two-dimensional camera system for automated measurement of back posture in dairy cows", COMPUTERS AND ELECTRONICS IN AGRICULTURE, vol. 100, January 2014 (2014-01-01), pages 139 - 147, XP055438233 * |

| See also references of EP3449719A4 * |

| T.VAN HERTEM: "Comparison of segmentation algorithms for cow contour extraction from natural barn background in side view images", COMPUTERS AND ELECTRONICS IN AGRICULTURE, vol. 91, February 2013 (2013-02-01), pages 65 - 74, XP055438436 * |

| TAMAKI KIDA: "A Technique for Measuring Grazing Cattle Form Using a 3D Digital Camera", JOURNAL OF JAPANESE SOCIETY OF GRASSLAND SCIENCE, vol. 60, no. 2, 2014, pages 85 - 90, XP055438435 * |

Cited By (12)

| Publication number | Priority date | Publication date | Assignee | Title |

|---|---|---|---|---|

| US11423561B2 (en) * | 2018-02-09 | 2022-08-23 | Nippon Telegraph And Telephone Corporation | Learning apparatus, estimation apparatus, learning method, estimation method, and computer programs |

| JP2022096833A (ja) * | 2020-12-18 | 2022-06-30 | 国立大学法人広島大学 | 密集度推定装置、密集度推定方法及びプログラム |

| JP7626366B2 (ja) | 2020-12-18 | 2025-02-04 | 国立大学法人広島大学 | 密集度推定装置、密集度推定方法及びプログラム |

| JP2022110224A (ja) * | 2021-01-18 | 2022-07-29 | 日本ハム株式会社 | 豚飼育支援装置、豚飼育支援方法、および豚飼育支援プログラム |

| JP7445612B2 (ja) | 2021-01-18 | 2024-03-07 | 日本ハム株式会社 | 豚飼育支援装置、豚飼育支援方法、および豚飼育支援プログラム |

| JP2022125851A (ja) * | 2021-02-17 | 2022-08-29 | 国立研究開発法人農業・食品産業技術総合研究機構 | 発情検出装置、発情検出方法、発情検出プログラム、及び記録媒体 |

| JP7527646B2 (ja) | 2021-02-17 | 2024-08-05 | 国立研究開発法人農業・食品産業技術総合研究機構 | 発情検出装置、発情検出方法、発情検出プログラム、及び記録媒体 |

| JP2023041002A (ja) * | 2021-09-10 | 2023-03-23 | 国立研究開発法人農業・食品産業技術総合研究機構 | 評価装置、評価方法、評価プログラム、及び記録媒体 |

| JP7553971B2 (ja) | 2021-09-10 | 2024-09-19 | 国立研究開発法人農業・食品産業技術総合研究機構 | 評価装置、評価方法、評価プログラム、及び記録媒体 |

| JP2023066005A (ja) * | 2021-10-28 | 2023-05-15 | 国立研究開発法人農業・食品産業技術総合研究機構 | 牛の評価装置および牛の評価方法 |

| JP7518541B2 (ja) | 2021-10-28 | 2024-07-18 | 国立研究開発法人農業・食品産業技術総合研究機構 | 牛の評価装置および牛の評価方法 |

| WO2026063054A1 (ja) * | 2024-09-19 | 2026-03-26 | 国立研究開発法人農業・食品産業技術総合研究機構 | 牛の座骨部推定装置及び腰角部推定装置、牛の評価システム、並びに牛の座骨部推定プログラム及び腰角部推定プログラム |

Also Published As

| Publication number | Publication date |

|---|---|

| US11166436B2 (en) | 2021-11-09 |

| US20190150405A1 (en) | 2019-05-23 |

| CN109068613A (zh) | 2018-12-21 |

| JPWO2017187719A1 (ja) | 2019-03-14 |

| EP3449719A4 (en) | 2020-03-18 |

| JP6777948B2 (ja) | 2020-11-11 |

| CN109068613B (zh) | 2021-06-01 |

| EP3449719A1 (en) | 2019-03-06 |

Similar Documents

| Publication | Publication Date | Title |

|---|---|---|

| JP6777948B2 (ja) | 健康状態推定装置 | |

| Shuai et al. | Research on 3D surface reconstruction and body size measurement of pigs based on multi-view RGB-D cameras | |

| JP7336691B2 (ja) | 遠隔から生体標本を特徴付ける方法と装置 | |

| Wongsriworaphon et al. | An approach based on digital image analysis to estimate the live weights of pigs in farm environments | |

| CN111542222B (zh) | 估计牲畜重量的系统和方法 | |

| Tafazzoli et al. | Model-based human gait recognition using leg and arm movements | |

| RU2543948C2 (ru) | Устройство и способ определения количественного показателя состояния тела животного | |

| EP3146474B1 (en) | Non-invasive multimodal biometrical identification method of animals | |

| JP2012123667A (ja) | 姿勢推定装置および姿勢推定方法 | |

| US20180329053A1 (en) | Human-body foreign-matter detection method and system based on millimetre-wave image | |

| CN112288793A (zh) | 畜类个体背膘检测方法、装置、电子设备及存储介质 | |

| JP7481550B2 (ja) | 体重推定装置、体重推定方法及びプログラム | |

| US12424017B2 (en) | Human skeleton image apparatus, method, and non-transitory computer readable medium | |

| JP2019211364A (ja) | 動物体の体重推定装置及び体重推定方法 | |

| JPWO2021084687A5 (ja) | 画像処理装置、画像処理方法及び画像処理プログラム | |

| Weales et al. | A robust machine vision system for body measurements of beef calves | |

| Nieto-Hidalgo et al. | Vision based gait analysis for frontal view gait sequences using RGB camera | |

| Higaki et al. | Objective dairy cow mobility analysis and scoring system using computer vision–based keypoint detection technique from top-view 2-dimensional videos | |

| Ascona et al. | A deep learning-based approach for unbiased kinematic analysis in CNS injury | |

| WO2021235440A1 (ja) | 皮膚情報を用いた運動特徴量の取得方法及び装置 | |

| CN114642422A (zh) | 基于机器视觉的奶牛步态的评分方法 | |

| Mealin et al. | Towards unsupervised canine posture classification via depth shadow detection and infrared reconstruction for improved image segmentation accuracy | |

| US20240127459A1 (en) | Method and apparatus for classifying and evaluating motion based on motion feature | |

| CN117456607A (zh) | 一种多目标小鼠行为在线识别和体温监控方法 | |

| Labaratory | 3D video based detection of early lameness in dairy cattle |

Legal Events

| Date | Code | Title | Description |

|---|---|---|---|

| WWE | Wipo information: entry into national phase |

Ref document number: 2018514135 Country of ref document: JP |

|

| NENP | Non-entry into the national phase |

Ref country code: DE |

|

| 121 | Ep: the epo has been informed by wipo that ep was designated in this application |

Ref document number: 17789008 Country of ref document: EP Kind code of ref document: A1 |

|

| WWE | Wipo information: entry into national phase |

Ref document number: 2017789008 Country of ref document: EP |

|

| ENP | Entry into the national phase |

Ref document number: 2017789008 Country of ref document: EP Effective date: 20181128 |