ES2717606T3 - Codificación y decodificación de audio escalable usando un banco de filtros jerárquico - Google Patents

Codificación y decodificación de audio escalable usando un banco de filtros jerárquico Download PDFInfo

- Publication number

- ES2717606T3 ES2717606T3 ES06848793T ES06848793T ES2717606T3 ES 2717606 T3 ES2717606 T3 ES 2717606T3 ES 06848793 T ES06848793 T ES 06848793T ES 06848793 T ES06848793 T ES 06848793T ES 2717606 T3 ES2717606 T3 ES 2717606T3

- Authority

- ES

- Spain

- Prior art keywords

- components

- residual

- samples

- signal

- tonal

- Prior art date

- Legal status (The legal status is an assumption and is not a legal conclusion. Google has not performed a legal analysis and makes no representation as to the accuracy of the status listed.)

- Active

Links

- 238000000034 method Methods 0.000 claims description 58

- 230000005236 sound signal Effects 0.000 claims description 46

- 230000002441 reversible effect Effects 0.000 claims description 31

- 230000015572 biosynthetic process Effects 0.000 claims description 15

- 230000000873 masking effect Effects 0.000 claims description 13

- 239000000872 buffer Substances 0.000 claims description 11

- 238000013139 quantization Methods 0.000 claims description 10

- 239000000284 extract Substances 0.000 claims description 8

- 230000009466 transformation Effects 0.000 claims description 7

- 230000003139 buffering effect Effects 0.000 claims description 4

- 230000008030 elimination Effects 0.000 claims description 3

- 238000003379 elimination reaction Methods 0.000 claims description 3

- 238000003780 insertion Methods 0.000 claims description 3

- 230000037431 insertion Effects 0.000 claims description 3

- 238000001228 spectrum Methods 0.000 claims description 3

- 238000000605 extraction Methods 0.000 claims description 2

- 230000002194 synthesizing effect Effects 0.000 claims 3

- 230000001131 transforming effect Effects 0.000 claims 2

- 239000012634 fragment Substances 0.000 description 37

- 230000006870 function Effects 0.000 description 20

- 238000010586 diagram Methods 0.000 description 17

- 238000000354 decomposition reaction Methods 0.000 description 15

- 230000003595 spectral effect Effects 0.000 description 12

- 238000004364 calculation method Methods 0.000 description 11

- 238000012545 processing Methods 0.000 description 8

- 230000007246 mechanism Effects 0.000 description 6

- 238000003786 synthesis reaction Methods 0.000 description 6

- 238000013459 approach Methods 0.000 description 5

- 230000006835 compression Effects 0.000 description 5

- 238000007906 compression Methods 0.000 description 5

- 230000008569 process Effects 0.000 description 5

- 230000001052 transient effect Effects 0.000 description 5

- 230000008901 benefit Effects 0.000 description 4

- 230000015556 catabolic process Effects 0.000 description 4

- 238000006731 degradation reaction Methods 0.000 description 4

- 230000004044 response Effects 0.000 description 4

- 238000000926 separation method Methods 0.000 description 4

- 230000005540 biological transmission Effects 0.000 description 3

- 238000013461 design Methods 0.000 description 3

- 239000011159 matrix material Substances 0.000 description 3

- 230000009467 reduction Effects 0.000 description 3

- 238000000844 transformation Methods 0.000 description 3

- 238000012937 correction Methods 0.000 description 2

- 238000004091 panning Methods 0.000 description 2

- 238000011002 quantification Methods 0.000 description 2

- 230000009471 action Effects 0.000 description 1

- 230000006978 adaptation Effects 0.000 description 1

- 230000003044 adaptive effect Effects 0.000 description 1

- 238000010420 art technique Methods 0.000 description 1

- 230000008859 change Effects 0.000 description 1

- 230000006837 decompression Effects 0.000 description 1

- 238000001514 detection method Methods 0.000 description 1

- 238000006073 displacement reaction Methods 0.000 description 1

- 230000000694 effects Effects 0.000 description 1

- 238000001914 filtration Methods 0.000 description 1

- 230000006872 improvement Effects 0.000 description 1

- 238000011326 mechanical measurement Methods 0.000 description 1

- 239000000203 mixture Substances 0.000 description 1

- 238000012986 modification Methods 0.000 description 1

- 230000004048 modification Effects 0.000 description 1

- 230000008447 perception Effects 0.000 description 1

- 230000000717 retained effect Effects 0.000 description 1

- 230000011218 segmentation Effects 0.000 description 1

- 238000006467 substitution reaction Methods 0.000 description 1

Classifications

-

- G—PHYSICS

- G10—MUSICAL INSTRUMENTS; ACOUSTICS

- G10L—SPEECH ANALYSIS TECHNIQUES OR SPEECH SYNTHESIS; SPEECH RECOGNITION; SPEECH OR VOICE PROCESSING TECHNIQUES; SPEECH OR AUDIO CODING OR DECODING

- G10L19/00—Speech or audio signals analysis-synthesis techniques for redundancy reduction, e.g. in vocoders; Coding or decoding of speech or audio signals, using source filter models or psychoacoustic analysis

- G10L19/02—Speech or audio signals analysis-synthesis techniques for redundancy reduction, e.g. in vocoders; Coding or decoding of speech or audio signals, using source filter models or psychoacoustic analysis using spectral analysis, e.g. transform vocoders or subband vocoders

-

- G—PHYSICS

- G10—MUSICAL INSTRUMENTS; ACOUSTICS

- G10L—SPEECH ANALYSIS TECHNIQUES OR SPEECH SYNTHESIS; SPEECH RECOGNITION; SPEECH OR VOICE PROCESSING TECHNIQUES; SPEECH OR AUDIO CODING OR DECODING

- G10L19/00—Speech or audio signals analysis-synthesis techniques for redundancy reduction, e.g. in vocoders; Coding or decoding of speech or audio signals, using source filter models or psychoacoustic analysis

- G10L19/02—Speech or audio signals analysis-synthesis techniques for redundancy reduction, e.g. in vocoders; Coding or decoding of speech or audio signals, using source filter models or psychoacoustic analysis using spectral analysis, e.g. transform vocoders or subband vocoders

- G10L19/0204—Speech or audio signals analysis-synthesis techniques for redundancy reduction, e.g. in vocoders; Coding or decoding of speech or audio signals, using source filter models or psychoacoustic analysis using spectral analysis, e.g. transform vocoders or subband vocoders using subband decomposition

-

- G—PHYSICS

- G10—MUSICAL INSTRUMENTS; ACOUSTICS

- G10L—SPEECH ANALYSIS TECHNIQUES OR SPEECH SYNTHESIS; SPEECH RECOGNITION; SPEECH OR VOICE PROCESSING TECHNIQUES; SPEECH OR AUDIO CODING OR DECODING

- G10L19/00—Speech or audio signals analysis-synthesis techniques for redundancy reduction, e.g. in vocoders; Coding or decoding of speech or audio signals, using source filter models or psychoacoustic analysis

- G10L19/02—Speech or audio signals analysis-synthesis techniques for redundancy reduction, e.g. in vocoders; Coding or decoding of speech or audio signals, using source filter models or psychoacoustic analysis using spectral analysis, e.g. transform vocoders or subband vocoders

- G10L19/0212—Speech or audio signals analysis-synthesis techniques for redundancy reduction, e.g. in vocoders; Coding or decoding of speech or audio signals, using source filter models or psychoacoustic analysis using spectral analysis, e.g. transform vocoders or subband vocoders using orthogonal transformation

-

- G—PHYSICS

- G10—MUSICAL INSTRUMENTS; ACOUSTICS

- G10L—SPEECH ANALYSIS TECHNIQUES OR SPEECH SYNTHESIS; SPEECH RECOGNITION; SPEECH OR VOICE PROCESSING TECHNIQUES; SPEECH OR AUDIO CODING OR DECODING

- G10L19/00—Speech or audio signals analysis-synthesis techniques for redundancy reduction, e.g. in vocoders; Coding or decoding of speech or audio signals, using source filter models or psychoacoustic analysis

- G10L19/02—Speech or audio signals analysis-synthesis techniques for redundancy reduction, e.g. in vocoders; Coding or decoding of speech or audio signals, using source filter models or psychoacoustic analysis using spectral analysis, e.g. transform vocoders or subband vocoders

- G10L19/022—Blocking, i.e. grouping of samples in time; Choice of analysis windows; Overlap factoring

-

- H—ELECTRICITY

- H03—ELECTRONIC CIRCUITRY

- H03M—CODING; DECODING; CODE CONVERSION IN GENERAL

- H03M7/00—Conversion of a code where information is represented by a given sequence or number of digits to a code where the same, similar or subset of information is represented by a different sequence or number of digits

- H03M7/28—Programmable structures, i.e. where the code converter contains apparatus which is operator-changeable to modify the conversion process

-

- H—ELECTRICITY

- H03—ELECTRONIC CIRCUITRY

- H03M—CODING; DECODING; CODE CONVERSION IN GENERAL

- H03M7/00—Conversion of a code where information is represented by a given sequence or number of digits to a code where the same, similar or subset of information is represented by a different sequence or number of digits

- H03M7/30—Compression; Expansion; Suppression of unnecessary data, e.g. redundancy reduction

-

- G—PHYSICS

- G10—MUSICAL INSTRUMENTS; ACOUSTICS

- G10L—SPEECH ANALYSIS TECHNIQUES OR SPEECH SYNTHESIS; SPEECH RECOGNITION; SPEECH OR VOICE PROCESSING TECHNIQUES; SPEECH OR AUDIO CODING OR DECODING

- G10L19/00—Speech or audio signals analysis-synthesis techniques for redundancy reduction, e.g. in vocoders; Coding or decoding of speech or audio signals, using source filter models or psychoacoustic analysis

- G10L19/02—Speech or audio signals analysis-synthesis techniques for redundancy reduction, e.g. in vocoders; Coding or decoding of speech or audio signals, using source filter models or psychoacoustic analysis using spectral analysis, e.g. transform vocoders or subband vocoders

- G10L19/032—Quantisation or dequantisation of spectral components

- G10L19/035—Scalar quantisation

-

- G—PHYSICS

- G10—MUSICAL INSTRUMENTS; ACOUSTICS

- G10L—SPEECH ANALYSIS TECHNIQUES OR SPEECH SYNTHESIS; SPEECH RECOGNITION; SPEECH OR VOICE PROCESSING TECHNIQUES; SPEECH OR AUDIO CODING OR DECODING

- G10L19/00—Speech or audio signals analysis-synthesis techniques for redundancy reduction, e.g. in vocoders; Coding or decoding of speech or audio signals, using source filter models or psychoacoustic analysis

- G10L19/04—Speech or audio signals analysis-synthesis techniques for redundancy reduction, e.g. in vocoders; Coding or decoding of speech or audio signals, using source filter models or psychoacoustic analysis using predictive techniques

- G10L19/16—Vocoder architecture

- G10L19/18—Vocoders using multiple modes

- G10L19/24—Variable rate codecs, e.g. for generating different qualities using a scalable representation such as hierarchical encoding or layered encoding

-

- G—PHYSICS

- G10—MUSICAL INSTRUMENTS; ACOUSTICS

- G10L—SPEECH ANALYSIS TECHNIQUES OR SPEECH SYNTHESIS; SPEECH RECOGNITION; SPEECH OR VOICE PROCESSING TECHNIQUES; SPEECH OR AUDIO CODING OR DECODING

- G10L25/00—Speech or voice analysis techniques not restricted to a single one of groups G10L15/00 - G10L21/00

- G10L25/03—Speech or voice analysis techniques not restricted to a single one of groups G10L15/00 - G10L21/00 characterised by the type of extracted parameters

- G10L25/18—Speech or voice analysis techniques not restricted to a single one of groups G10L15/00 - G10L21/00 characterised by the type of extracted parameters the extracted parameters being spectral information of each sub-band

Landscapes

- Engineering & Computer Science (AREA)

- Physics & Mathematics (AREA)

- Audiology, Speech & Language Pathology (AREA)

- Computational Linguistics (AREA)

- Signal Processing (AREA)

- Health & Medical Sciences (AREA)

- Spectroscopy & Molecular Physics (AREA)

- Human Computer Interaction (AREA)

- Acoustics & Sound (AREA)

- Multimedia (AREA)

- Theoretical Computer Science (AREA)

- Compression, Expansion, Code Conversion, And Decoders (AREA)

- Reduction Or Emphasis Of Bandwidth Of Signals (AREA)

Description

DESCRIPCIÓN

Codificación y decodificación de audio escalable usando un banco de filtros jerárquico

Antecedentes de la invención

Campo de la invención

La presente invención se refiere a la codificación escalable de una señal de audio y más específicamente a procedimientos de realización de este escalado de tasa de datos de una manera eficiente para señales de audio multicanal que incluyen filtrado jerárquico, codificación conjunta de componentes tonales y codificación conjunta de canal de componentes de dominio tiempo en la señal residual.

Descripción de la técnica relacionada

El principal objetivo de un algoritmo de compresión de audio es crear una representación sónicamente aceptable de una señal de audio de entrada usando tan pocos bits digitales como sea posible. Esto permite que una versión de tasa de datos baja de la señal de audio de entrada se distribuya a través de canales de transmisión de ancho de banda limitado, tal como internet, y reduce la cantidad de almacenamiento necesario para almacenar la señal de audio de entrada para reproducción futura. Para esas aplicaciones en las que la capacidad de datos del canal de transmisión es fija, y no varía con el paso del tiempo, o la cantidad, en términos de minutos, de audio que necesita almacenarse se conoce por adelantado y no aumenta, procedimientos de compresión de audio tradicionales fijan la tasa de datos y por lo tanto el nivel de calidad de audio en el momento de codificación de compresión. Ninguna reducción adicional en tasa de datos puede efectuarse sin o bien grabar la señal original a una tasa de datos menor o bien descomprimir la señal de audio comprimida y a continuación comprimir de nuevo esta señal descomprimida en una tasa de datos menor. Estos procedimientos no son "escalables" para abordar problemas de capacidad de canal variable, almacenamiento de contenido adicional en una memoria fija o extracción de flujos de datos a tasas de datos variables para diferentes aplicaciones.

Una técnica usada para crear un flujo de bits con características escalables, y evitar las limitaciones anteriormente descritas, codifica la señal de audio de entrada como un flujo de datos de tasa de datos alta compuesta de subconjuntos de flujo de datos de tasa de datos baja. Estos flujos de datos de tasa de datos baja codificados pueden extraerse de la señal codificada y combinarse para proporcionar un flujo de datos de salida cuya tasa de datos es ajustable en un amplio intervalo de tasas de datos. Un enfoque para implementar este concepto es decodificar primero datos a tasa de datos más baja soportada, a continuación codificar un error entre la señal original y una versión decodificada de este flujo de datos de la menor tasa de datos. Este error codificado se almacena y también combina con el flujo de datos de la menor tasa de datos soportada para crear un flujo de datos de la segunda menor tasa de datos. El error entre la señal original y una versión decodificada de esta señal de la segunda menor tasa de datos se codifica, almacena y añade al flujo de datos de la segunda menor tasa de datos para formar un flujo de datos de la tercera menor tasa de datos y así sucesivamente. Este procedimiento se repite hasta que la suma de las tasas de datos asociadas con flujos de datos de cada una de las señales de error así obtenidas y la tasa de datos del flujo de datos de la menor tasa de datos soportada es igual al flujo de datos de la mayor tasa de datos a soportar. El flujo de datos de tasa de datos alta escalable final se compone del flujo de datos de la menor tasa de datos y cada uno de los flujos de datos de error codificado.

Una segunda técnica, normalmente usada para soportar un número pequeño de diferentes tasas de datos entre menores y mayores tasas de datos ampliamente espaciadas, emplea el uso de más de un algoritmo de compresión para crear un flujo de bits escalable "por capas". El aparato que realiza la operación de cambio de escala en un flujo de bits codificado de esta manera elige, dependiendo de requisitos de tasa de datos de salida, cuál de los múltiples flujos de datos transportados en el flujo de datos por capas usar como la salida de audio codificada. Para mejorar la eficiencia de codificación y proporcionar un intervalo más amplio de tasas de datos escaldas, datos transportados en los flujos de datos de menor tasa pueden usarse por flujos de datos de mayor tasa para formar flujos de datos de mayor calidad y mayor tasa adicionales.

El documento DAUDET L ET AL: "Hybrid representations for audiophonic signal encoding", SIGNAL PROCESSING, ELSEVIER SCIENCE PUBLISHERS, vol. 82, n.° 11, 1 de noviembre 2002, páginas 1595-1617, XP004381254, ISSN: 0165-1684, DOI: 10.1016/S0165-1684(02)00304-3, desvela un procedimiento en el que componentes transitorios, tonales y estocásticos de una señal de audio se estiman y codifican usando una estrategia que incluye codificación por transformación asociada con espacios de representación excesivos. Entre espacios de representación, se usan una unión de coseno local y ondículas diádicas mostrando buenas propiedades de separación para características estructurales de señales de audio, su parte tonal y parte transitoria, respectivamente. La separación de estas dos capas se mejora mediante el uso de representaciones estructuradas. El enfoque descrito no se basa en ninguna segmentación anterior de la señal de audio.

El documento US 2002/0176353 A1 describe un procedimiento y sistema de codificación y decodificación de una señal de entrada en relación con los aspectos perceptualmente más relevantes de la señal de entrada. Más particularmente, se aplica una transformación bidimensional a la señal de entrada para producir una matriz de magnitud y una matriz de fase que puede cuantificarse inversamente mediante un decodificador. Una primera

columna de coeficientes de la matriz de magnitud representa una función de densidad espectral media de la señal de entrada. Aspectos relevantes de la función de densidad espectral media se codifican en un comienzo de un paquete de datos para un uso posterior por un decodificador para recrear la señal de entrada, a base de una codificación de las matrices de magnitud y fase con el resto del paquete de datos.

Sumario de la invención

La invención proporciona un procedimiento de reconstrucción de una señal de audio de salida de dominio de tiempo a partir de un flujo de datos codificado con las características de la reivindicación 1, un decodificador de reconstrucción de una señal de audio de salida de dominio de tiempo a partir de un flujo de datos codificado con las características de la reivindicación 9, un procedimiento de codificación de una señal de audio de entrada con las características de la reivindicación 11 y un codificador de flujo de bits escalable de codificación de una señal de audio de entrada y formación de un flujo de bits escalable con las características de la reivindicación 31. En este contexto, se observa que la invención se expone en las reivindicaciones independientes anteriormente mencionadas, y que todas las ocurrencias siguientes de la palabra "realización o realizaciones", si se refieren a combinaciones de características diferentes de las definidas por las reivindicaciones independientes, se refieren a ejemplos que se presentaron originalmente pero que no representan realizaciones de la invención reivindicada actualmente, en el que estos ejemplos se muestran aún únicamente para fines de ilustración.

Por consiguiente, la presente invención proporciona un procedimiento de codificación de señales de entrada de audio para formar un flujo de bits maestro que puede escalarse para formar un flujo de bits escalado que tiene una tasa de datos prescita arbitrariamente y de decodificación del flujo de bits escalado para reconstruir las señales de audio.

Esto se logra generalmente comprimiendo las señales de entrada de audio y disponiendo las mismas para formar un flujo de bits maestro. El flujo de bits maestro incluye componentes cuantificados que se clasifican sobre la base de su contribución relativa a calidad de señal decodificada. La señal de entrada se comprime adecuadamente separando la misma en una pluralidad de componentes tonales y residuales, y clasificando y a continuación cuantificando los componentes. La separación se realiza adecuadamente usando un banco de filtros jerárquico. Los componentes se clasifican y cuantifican adecuadamente con referencia a la misma función de enmascaramiento o diferente criterio psicoacústico. Los componentes pueden ordenarse a continuación a base de su clasificación para facilitar escalado eficiente. El flujo de bits maestro se escala eliminando un número suficiente de los componentes de baja clasificación para formar el flujo de bits escalado que tiene una tasa de datos escalada menor que o aproximadamente igual a una tasa de datos deseada. El flujo de bits escalado incluye información que indica la posición de los componentes en el espectro de frecuencia. Un flujo de bits escalado se decodifica adecuadamente usando un banco de filtros jerárquico inverso disponiendo los componentes cuantificados a base de la formación de posición, ignorando los componentes faltantes y decodificando los componentes dispuestos para producir un flujo de datos de salida.

En una realización, el codificador usa un banco de filtros jerárquico para descomponer la señal de entrada en una representación de tiempo/frecuencia de múltiples resoluciones. El codificador extrae componentes tonales en cada iteración del HFB a diferentes resoluciones de frecuencia, elimina esos componentes tonales de la señal de entrada para pasar una señal residual a la siguiente iteración del HFB y a continuación extrae componentes residuales de la señal residual final. Los componentes tonales se agrupan en al menos un subdominio de frecuencia por resolución de frecuencia y clasifican de acuerdo con su importancia psicoacústica a la calidad de la señal codificada. Los componentes residuales incluyen componentes de muestra de tiempo (por ejemplo una cuadrícula G) y componentes de factor de escala (por ejemplo cuadrículas G0, G1) que modifican los componentes de muestra de tiempo. Los componentes de muestra de tiempo se agrupan en al menos un subdominio de muestra de tiempo y clasifican de acuerdo con su contribución a la calidad de la señal decodificada.

En el decodificador, el banco de filtros jerárquico inverso puede usarse para extraer tanto los componentes tonales como los componentes residuales dentro de una estructura de banco de filtros eficiente. Todos los componentes se cuantifican inversamente y la señal residual se reconstruye aplicando los factores de escala a las muestras de tiempo. Las muestras de frecuencia se reconstruyen y añaden a las muestras de tiempo reconstruidas para producir la señal de audio de salida. Obsérvese que el banco de filtros jerárquico inverso puede usarse en el decodificador independientemente de si el banco de filtros jerárquico se usó durante el procedimiento de codificación.

En una realización ilustrativa, los componentes tonales seleccionados en una señal de audio multicanal se codifican usando codificación diferencial. Para cada componente tonal, se selecciona un canal como el canal primario. El número de canal del canal primario y su amplitud y fase se almacenan en el flujo de bits. Una máscara de bits se almacena que indica cuál de los otros canales incluyen el componente tonal indicado y, por lo tanto, deberían codificarse como canales secundarios. La diferencia entre las amplitudes primarias y secundarias y fases se codifican por entropía y almacenan para cada canal secundario en el que está presente el componente tonal.

En una realización ilustrativa, los componentes de muestra de tiempo y de factor de escala que componen la señal residual se codifican usando codificación conjunta de canal (JCC) extendida a audio multicanal. Un procedimiento de agrupamiento de canal primero determina cuál de los múltiples canales puede codificarse conjuntamente y todos los

canales se forman en grupos con el último grupo estando posiblemente incompleto.

Objetos, características y ventajas adicionales de la presente invención se incluyen en la siguiente descripción de realizaciones ilustrativas, cuya descripción debería leerse con los dibujos adjuntos. Aunque estas realizaciones ilustrativas pertenecen a datos de audio, se entenderá que video, multimedia y otros tipos de datos también pueden procesarse de maneras similares.

Breve descripción de los dibujos

La Figura 1 es una ilustración de diagrama de bloques de un codificador de flujo de bits escalable usando una topología de codificación residual de acuerdo con la presente invención;

Las Figuras 2a y 2b son representaciones de dominio de frecuencia y tiempo de una ventana de Shmunk para uso con el banco de filtros jerárquico;

La Figura 3 es una ilustración de un banco de filtros jerárquico para la provisión de una representación de tiempo/frecuencia de múltiples resoluciones de una señal de entrada desde la que pueden extraerse tanto componentes tonales como residuales con la presente invención;

La Figura 4 es un diagrama de flujo de las etapas asociadas con el banco de filtros jerárquico;

Las Figuras 5a a 5c ilustran una ventaja de formación de ventana de 'solapar-añadir';

La Figura 6 es un gráfico de la respuesta de frecuencia de banco de filtros jerárquico;

La Figura 7 es un diagrama de bloques de una implementación ilustrativa de un banco de filtros de análisis jerárquico para su uso en el codificador;

Las Figuras 8a y 8b son un diagrama de bloques simplificado de un banco de filtros jerárquico de 3 etapas y un diagrama de bloques más detallado de una única etapa;

La Figura 9 es una máscara de bits para la extensión de codificación diferencial de componentes tonales a audio multicanal;

La Figura 10 representa la realización detallada del codificador residual usado en una realización del codificador de la presente invención;

La Figura 11 es un diagrama de bloques para la codificación conjunta de canal para audio multicanal;

La Figura 12 representa esquemáticamente una trama escalable de datos producidos por el codificador de flujo de bits escalable de la presente invención;

La Figura 13 muestra el diagrama de bloques detallado de una implementación del decodificador usado en la presente invención;

La Figura 14 es una ilustración de un banco de filtros jerárquico inverso para la reconstrucción de datos de serie de tiempo a partir de tanto componentes de muestra de tiempo como frecuencia de acuerdo con la presente invención;

La Figura 15 es un diagrama de bloques de una implementación ilustrativa de un banco de filtros jerárquico inverso;

La Figura 16 es un diagrama de bloques de la combinación de componentes tonales y residuales usando un banco de filtros jerárquico inverso en el decodificador;

Las Figuras17a y 17b son un diagrama de bloques simplificado de un banco de filtros jerárquico inverso de 3 etapas y un diagrama de bloques más detallado de una única etapa;

La Figura 18 es un diagrama de bloques detallado del decodificador residual;

La Figura 19 es una tabla de correlación de G1;

La Figura 20 es una tabla de coeficientes de corrección de síntesis de función base; y

Las Figuras 21 y 22 son diagramas de bloque funcionales del codificador y decodificador, respectivamente, que ilustran una aplicación de la representación de tiempo/frecuencia de múltiples resoluciones del banco de filtros jerárquico en un codificador/decodificador de audio.

Descripción de realizaciones ilustrativas

La presente invención proporciona un procedimiento de compresión y codificación de señales de entrada de audio para formar un flujo de bits maestro que puede escalarse para formar un flujo de bits escalado que tiene una tasa de datos prescrita arbitrariamente y de decodificación del flujo de bits escalado para reconstruir las señales de audio. Un banco de filtros jerárquico (HFB) proporciona una representación de tiempo/frecuencia de múltiples resoluciones de la señal de entrada de la que el codificador puede extraer de forma eficiente tanto los componentes tonales como residuales. Para audio multicanal, se implementa codificación conjunta de componentes tonales y codificación conjunta de canal de componentes residuales en la señal residual. Los componentes se clasifican sobre la base de su contribución relativa a calidad de señal decodificada y cuantificada con referencia a una función de enmascaramiento. El flujo de bits maestro se escala eliminando un número suficiente de los componentes de baja clasificación para formar el flujo de bits escalado que tiene una tasa de datos escalada menor que o aproximadamente igual a una tasa de datos deseada. El flujo de bits escalado se decodifica adecuadamente usando un banco de filtros jerárquico inverso disponiendo los componentes cuantificados a base de posición información, ignorando los componentes faltantes y decodificando los componentes dispuestos para producir un flujo de datos de salida. En una posible aplicación, el flujo de bits maestro se almacena y a continuación se escala hacia abajo a una tasa de datos deseada para la grabación en otros medios o para la transmisión a través de un canal de banda limitada. En otra aplicación, en la que se almacenan múltiples flujos de bits escalados en medios, la tasa de datos de cada flujo se controla independiente y dinámicamente para maximizar la calidad percibida mientras se satisface una

restricción de tasa de datos agregada en todos los flujos de bits.

Como se usa en el presente documento los términos "Dominio", "subdominio" y "componente" describen la jerarquía de elementos escalables en el flujo de bits. Ejemplos incluirán:

Codificador de flujo de bits escalable con una topología de codificación residual

Como se muestra en la Figura 1, en una realización ilustrativa un codificador de flujo de bits escalable usa una topología de codificación residual para escalar el flujo de bits a una tasa de datos arbitraria eliminando selectivamente los componentes con la menor clasificación del núcleo (componentes tonales) y/o los componentes residuales (muestra de tiempo y factor de escala). El codificador usa un banco de filtros jerárquico para descomponer de forma eficiente la señal de entrada en una representación de tiempo/frecuencia de múltiples resoluciones de la que el codificador puede extraer de forma eficiente los componentes tonales y residuales. El banco de filtros jerárquico (HFB) descrito en el presente documento para la provisión de la representación de tiempo/frecuencia de múltiples resoluciones puede usarse en muchas otras aplicaciones en la que se desea una representación de este tipo de una señal de entrada. Una descripción general del banco de filtros jerárquico y su configuración para su uso en el codificador de audio se describen a continuación así como el HFB modificado usado por el codificador de audio particular.

La señal 100 de entrada se aplica tanto al calculador 101 de enmascaramiento como el extractor 102 de tonos de múltiples órdenes. El calculador 101 de enmascaramiento analiza la señal 100 de entrada e identifica un nivel de enmascaramiento como una función de frecuencia debajo de la cual frecuencias presentes en la señal 101 de entrada no son audibles para el oído humano. El extractor 102 de tonos de múltiples órdenes identifica frecuencias presentes en la señal 101 de entrada usando, por ejemplo, múltiples FFT superpuestas o como se muestra un banco de filtros jerárquico a base de MDCT, que cumplen el criterio psicoacústico que se han definido para tonos, selecciona tonos de acuerdo con este criterio, cuantifica la amplitud, frecuencia, fase y posición componentes de estos tonos seleccionados, y sitúa estos tonos en una lista de tonos. En cada iteración o nivel, los tonos seleccionados se eliminan de la señal de entrada para pasar una señal residual hacia delante. Una vez completado, se extraen de la señal de entrada todas las otras frecuencias que no cumplen el criterio para tonos y emiten desde el extractor 102 de tonos de múltiples órdenes, específicamente la última etapa del banco de filtros jerárquico MDCT(256), en el dominio del tiempo en la línea 111 como la señal residual final.

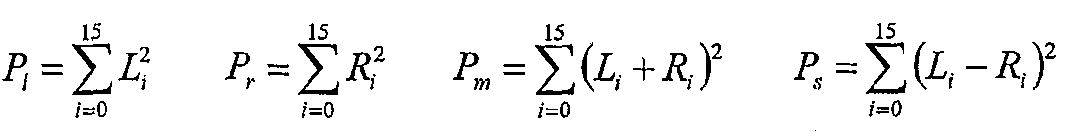

El extractor 102 de tonos de múltiples órdenes usa, por ejemplo, cinco órdenes de transformadas superpuestas, comenzando desde la mayor y trabajando hasta la menor, para detectar tonos a través del uso de una función base. Se usan transformadas de tamaño: 8192, 4096, 2048, 1024 y 512 respectivamente, para una señal de audio cuya tasa de muestreo es 44100 Hz. Podrían elegirse otros tamaños de transformada. La Figura 7 muestra gráficamente cómo las transformadas se superponen entre sí. La función base se define mediante las ecuaciones:

en las que:

Tonos detectados en cada tamaño de transformada se decodifican localmente usando el mismo procedimiento de decodificación que el usado por el decodificador de la presente invención, que se describirá más adelante. Estos tonos decodificados localmente se invierten de fase y combinan con la señal de entrada original a través de suma de dominio de tiempo para formar la señal residual que se pasa a la siguiente iteración o nivel del HFB.

El nivel de enmascaramiento del calculador 101 de enmascaramiento y la lista de tonos del extractor 102 de tonos de múltiples órdenes son entradas al selector 103 de tono. El selector 103 de tono primero clasifica la lista de tonos proporcionada al mismo desde el extractor 102 de tonos de múltiples órdenes mediante potencia relativa sobre el nivel de enmascaramiento proporcionado por el calculador 101 de enmascaramiento. A continuación usa un procedimiento iterativo para determinar qué componentes tonales encajarán en una trama de datos codificados en el flujo de bits maestro. La cantidad de espacio disponible en una trama para componentes tonales depende de la tasa de datos predeterminada, antes de escalado, del flujo de datos maestro codificado. Si toda la trama se asigna para componentes tonales entonces no se realiza ninguna codificación residual. En general, alguna porción de la tasa de datos disponible se asigna para los componentes tonales con el resto (menos sobrecarga) reservado para los componentes residuales.

Grupos de canales se seleccionada adecuadamente para señales multicanal y canales primarios/secundarios identificados dentro de cada grupo de canales de acuerdo con una métrica tal como contribución a calidad perceptual. Los componentes tonales seleccionados se almacenan preferentemente usando codificación diferencial. Para audio estéreo, el campo de dos bits indica los canales primarios y secundarios. La amplitud/fase y amplitud/fase diferencial se almacenan para los canales primarios y secundarios, respectivamente. Para audio multicanal el canal primario se almacena con su amplitud y fase y se almacena una máscara de bits (Véase la Figura 9) para todos los canales secundarios con amplitud/fase diferencial para los canales secundarios incluidos. La máscara de bits indica qué otros canales se codifican conjuntamente con el canal primario y se almacena en el flujo de bits para cada componente tonal en el canal primario.

Durante este procedimiento iterativo, algunos o todos los componentes tonales que se determinan que no encajan en una trama pueden convertirse de vuelta en el dominio del tiempo y combinarse con la señal 111 residual. Si, por ejemplo, la tasa de datos es lo suficientemente alta, entonces habitualmente todos los componentes tonales deseleccionados se recombinan. Si, sin embargo, la tasa de datos es menor, los componentes tonales relativamente fuertes 'deseleccionados' se excluyen adecuadamente de la residual. Se ha encontrado que esto mejora la calidad perceptual en tasas de datos menores. Los componentes tonales deseleccionados representados por la señal 110, se decodifican localmente a través del decodificador 104 local para volver a convertirlos en el dominio del tiempo en la línea 114 y combinarse con la señal 111 residual desde el extractor 102 de tonos de múltiples órdenes en el combinador 105 para formar una señal 113 residual combinada. Obsérvese que las señales que aparecen en 114 y 111 son ambas señales de dominio de tiempo de modo que este procedimiento de combinación puede afectarse fácilmente. La señal 113 residual combinada se procesa adicionalmente por el codificador 107 residual.

La primera acción realizada por el codificador 107 residual es procesar la señal 113 residual combinada a través de un banco de filtros que subdivide la señal en subbandas de frecuencia de dominio de tiempo críticamente muestreadas. En una realización preferida, cuando el banco de filtros jerárquico se usa para extraer los componentes tonales, estos componentes de muestra de tiempo pueden leerse directamente del banco de filtros jerárquico eliminando de este modo la necesidad de un segundo banco de filtros dedicado al procesamiento de señal residual. En este caso, como se muestra en la Figura 21, el combinador 104 opera en la salida de la última etapa del banco de filtros jerárquico (MDCT(256)) para combinar los componentes 114 tonales 'deseleccionados' y decodificados con la señal 111 residual antes de calcular la IMDCT 2106, que produce las muestras de tiempo de subbanda (véase también la Figura 7 etapas 3906, 3908 y 3910). Adicionalmente a continuación se realiza la descomposición, cuantificación y disposición de estas subbandas en orden psicoacústicamente relevante. Los componentes residuales (muestras de tiempo y factores de escala) se codifican adecuadamente usando codificación conjunta de canal en el que las muestras de tiempo se representan mediante una cuadrícula G y los factores de escala mediante las cuadrículas G0 y G1 (Véase la Figura 11). La codificación conjunta de la señal residual usa

cuadrículas parciales, aplicadas a grupos de canales, que representan la relación de energías de señales entre canal primario y grupos de canales secundarios. Los grupos se seleccionan (dinámica o estáticamente) a través de correlaciones cruzadas u otras métricas. Pueden combinarse más de un canal y usarse como un canal primario (por ejemplo L+R primario, C secundario). El uso de cuadrículas de factor de escala parciales, G0, G1 en dimensiones de tiempo/frecuencia es novedoso como se aplica a estos grupos multicanal y puede asociarse más de un canal secundario con un canal primario dado. Los elementos de cuadrícula individuales y muestras de tiempo se clasifican por frecuencia clasificando más alto las frecuencias más bajas. Las cuadrículas se clasifican de acuerdo con la tasa de bits. La información de canal secundario se clasifica con menor prioridad que la información de canal primario. El generador 108 de cadena de código toma una entrada del selector 103 de tono, en la línea 120, y codificador 107 residual en la línea 122, y codifica valores desde estas dos entradas usando codificación por entropía bien conocida en la técnica en el flujo 124 de datos. El formateador 109 de flujo de bits garantiza que aparezcan elementos psicoacústicos desde el selector 103 de tono y codificador 107 residual, después de codificarse a través del generador 108 de cadena de código, en la posición correcta en el flujo 126 de bits maestro. Las 'clasificaciones' se incluyen implícitamente en el flujo de bits maestro mediante la reordenación de los diferentes componentes.

Un escalador 115 elimina un número suficiente de los componentes codificados de menor clasificación desde cada trama del flujo 126 de bits maestro producido por el codificador para formar un flujo 116 de bits escalado que tiene una tasa de datos menor que o aproximadamente igual a una tasa de datos deseada.

Banco de filtros jerárquico

El extractor 102 de tonos de múltiples órdenes usa preferentemente un banco de filtros jerárquico 'modificado' para proporcionar una resolución de tiempo/frecuencia de múltiples resoluciones de la que pueden extraerse de forma eficiente tanto los componentes tonales como los componentes residuales. El HFB descompone la señal de entrada en coeficientes de transformada en resoluciones de frecuencia sucesivamente menores y de vuelta en muestras de subbanda de dominio de tiempo en resolución de escala de tiempo sucesivamente más fina en cada iteración sucesiva. Los componentes tonales generados por el banco de filtros jerárquico son exactamente los mismos que los generador por múltiples FFT superpuestas, sin embargo la carga de cálculo es mucho menor. El banco de filtros jerárquico aborda el problema de modelización de resolución de tiempo/frecuencia desigual del sistema auditivo humano analizando simultáneamente la señal de entrada en diferentes resoluciones de tiempo/frecuencia en paralelo para conseguir una descomposición de tiempo/frecuencia casi arbitraria. El banco de filtros jerárquico hace uso de una etapa de formación de ventana y superposición-adición en la transformada interior no encontrada en descomposiciones conocidas. Esta etapa y el diseño novedoso de la función de ventana permiten que esta estructura se itere en un árbol arbitrario para conseguir la descomposición deseada, y podría hacerse de una manera adaptativa a la señal.

Como se muestra en la Figura 21, un codificador 2100 de un solo canal extrae componentes tonales de los coeficientes de transformada en cada iteración 2101a,...2101e, cuantifica y almacena los componentes tonales extraídos en una lista 2106 de tonos. A continuación se analiza la codificación conjunta de los tonos y señales residuales para señales multicanal. En cada iteración la señal de entrada de dominio de tiempo (señal residual) se forma en ventana 2107 y se aplica 2108 una MDCT de N puntos para producir coeficientes de transformada. Los tonos se extraen 2109 de los coeficientes de transformada, cuantifican 2110 y añaden a la lista de tonos. Los componentes tonales seleccionados se decodifican localmente 2111 y restan 2112 de los coeficientes de transformada antes de realizar la transformada 2113 inversa para generar las muestras de subbanda de dominio de tiempo que forman la señal 2114 residual para la siguiente iteración del HFB. Una transformada 2115 inversa final con resolución de frecuencia relativamente menor que la iteración final del HFB se realiza en la residual 113 combinada y forma en ventana 2116 para extraer los componentes 2117 residuales de G. Como se describe anteriormente, cualquier tono 'deseleccionado' se decodifica 104 localmente y combina 105 con la señal 111 residual antes del cálculo de la transformada inversa final. Los componentes residuales incluyen componentes de muestra de tiempo (Cuadrícula G) y componentes de factor de escala (Cuadrícula G0, G1) que se extraen de la cuadrícula G en 2118 y 2119. La cuadrícula G se recalcula 2120 y la cuadrícula G y G1 se cuantifican 2121, 2122. A continuación se describe el cálculo de las cuadrículas G, G1 y G0. Los tonos cuantificados en la lista de tonos, cuadrícula G y cuadrícula de factor de escala G1 se codifican todos y sitúan en el flujo de bits maestro. La eliminación de los tonos seleccionados de la señal de entrada en cada iteración y el cálculo de la transformada inversa final son las modificaciones impuestas en el HFB por el codificador de audio.

Un reto fundamental en la codificación de audio es la modelización de la resolución de tiempo/frecuencia de la percepción humana. Señales transitorias, tal como un aplauso, requieren una alta resolución en el dominio del tiempo, mientras que señales armónicas, tal como un claxon, requieren resolución alta en el dominio de la frecuencia para representarse de forma precisa mediante un flujo de datos codificado. Pero es un principio bien conocido que resolución de tiempo y frecuencia son inversas entre sí y ninguna transformada sola puede convertir simultáneamente precisión alta en ambos dominios. El diseño de un códec de audio efectivo requiere equilibrar esta compensación entre resolución de tiempo y frecuencia.

Soluciones conocidas a este problema utilizan conmutación de ventana, adaptando el tamaño de transformada a la naturaleza transitoria de la señal de entrada (véase K. Brandenburg y col., "The ISO-MPEG-Audio Codec: A Generic

Standard for Coding of High Quality Digital Audio", Journal of Audio Engineering Society, Vol. 42, N.° 10, Octubre, 1994). Esta adaptación del tamaño de ventana de análisis introduce complejidad adicional y requiere una detección de eventos transitorios en la señal de entrada. Para gestionar la complejidad algorítmica, los procedimientos de conmutación de ventana de la técnica anterior habitualmente limitan el número de diferentes tamaños de ventana a dos. El banco de filtros jerárquico analizado en el presente documento evita este ajuste basto a las características de señal/auditivas representando/procesando la señal de entrada mediante un banco de filtros que proporciona múltiples resoluciones de tiempo/frecuencia en paralelo.

Existen muchos bancos de filtros, conocidos como bancos de filtros híbridos, que descomponen la señal de entrada en una representación de tiempo/frecuencia dada. Por ejemplo, el algoritmo de Capa 3 de MPEG descrito en ISO/IEC 11172-3 utiliza un banco de filtros de espejo de pseudocuadratura seguido por una transformada MDCT en cada subbanda para proporcionar la resolución de frecuencia deseada. En nuestro banco de filtros jerárquico utilizamos una transformada, tal como una MDCT, seguida por la transformada inversa (por ejemplo IMDCT) en grupos de líneas espectrales para realizar una transformación de tiempo/frecuencia flexible de la señal de entrada.

A diferencia de los bancos de filtros híbridos, el banco de filtros jerárquico usa resultados de dos transformadas exteriores superpuestas y consecutivas para calcular transformadas interiores 'superpuestas’. Con el banco de filtros jerárquico es posible agregar más de una transformadas encima de la primera transformada. Esto también es posible con bancos de filtros de la técnica anterior (por ejemplo bancos de filtros de tipo árbol), pero no es práctico debido a la rápida degradación de separación de dominio de frecuencia con el aumento de número de niveles. El banco de filtros jerárquico evita esta degradación de dominio de frecuencia a costa de algo de degradación de dominio de tiempo. Esta degradación de dominio de tiempo puede controlarse, sin embargo, a través de la correcta selección de forma o formas de ventana. Con la selección de la ventana de análisis correcta, los coeficientes de la transformada interior también pueden hacerse invariables a desplazamiento de tiempo iguales al tamaño de la transformada interior (no al tamaño de la transformada más exterior como en enfoques convencionales).

Una ventana adecuada W(x) denominada en el presente documento como la "Ventana de Shmunk", para uso con el banco de filtros jerárquico se define mediante:

En la que x es el índice de muestra de dominio del tiempo (0 < x <= L), y L es la longitud de la ventana en muestras.

La respuesta de frecuencia 2603 de la ventana de Shmunk en comparación con la ventana 2602 derivada de Kaiser-Bessel usada comúnmente se muestra en la Figura 2a. Puede observarse que las dos ventanas son similares en forma pero la atenuación de lóbulos laterales es mayor con la ventana propuesta. La respuesta 2604 de dominio de tiempo de la ventana de Shmunk se muestra en la Figura 2b.

En las Figuras 3 y 4 se ilustra un banco de filtros jerárquico de aplicabilidad general para la provisión de una descomposición de tiempo/frecuencia. El HFB tendría que modificarse como se ha descrito anteriormente para su uso en el códec de audio. En la Figura 3, el número en cada línea discontinua representa el número de contenedores de frecuencia igualmente espaciados en cada nivel (aunque no se calculan todos estos contenedores). Las flechas hacia abajo representan una transformada de MDCT de N puntos que resulta en N/2 subbandas. Las flechas hacia arriba representan una IMDCT que toma N/8 subbandas y transforma las mismas a N/4 muestras de tiempo dentro de una subbanda. Cada cuadrado representa una subbanda. Cada rectángulo representa N/2 subbandas. El banco de filtros jerárquico realiza las siguientes etapas:

(a) Como se muestra en la Figura 5a, las muestras 2702 de señal de entrada se almacenan en memoria intermedia en tramas de N muestras 2704, y cada trama se multiplica por una función 2706 de ventana de N muestras (Figura 5b) para producir N muestras 2708 formadas en ventanas (Figura 5c) (etapa 2900);

(b) Como se muestra en la Figura 3, una transformada de N puntos (representada por la flecha 2802 hacia abajo en la Figura 3) se aplica a las muestras 2708 formadas en ventanas para producir N/2 coeficientes 2804 de transformada (etapa 2902);

(c) Opcionalmente se aplica reducción de timbre a uno o más de los coeficientes 2804 de transformada aplicando una combinación lineal de uno o más coeficientes de transformada adyacentes (etapa 2904);

(d) Los N/2 coeficientes 2804 de transformada se dividen en P grupos de M¡ coeficientes, de tal forma que la

(e) Para cada de P grupos, una transformada inversa de (2* Mi) puntos (representada por la fecha 2806 hacia arriba en la Figura 3) se aplica a los coeficientes de transformada para producir (2* Mi) muestras de subbanda de cada grupo (etapa 2906);

(d) En cada subbanda, las (2* Mi) muestras de subbanda se multiplican por una función 2706 de ventana de (2* Mi) puntos (etapa 2908);

(e) En cada subbanda, las Mi muestras anteriores se superponen y añaden a correspondientes valores actuales para producir Mi nuevas muestras para cada subbanda (etapa 2910);

(f) N se establece igual al anterior Mi y selecciona nuevos valores para P y Mi, y

(g) Las etapas anteriores se repiten (etapa 2912) en una o más de las subbandas de Mi nuevas muestras usando los tamaños de transformada sucesivamente más pequeños para N hasta que se consigue la resolución de tiempo/transformada deseada (etapa 2914). Obsérvese, las etapas pueden iterarse en todas las subbandas, únicamente la menores subbandas o cualquier combinación deseada de las mismas. Si las etapas se iteran en todas las subbandas el HFB es uniforme, de lo contrario no es uniforme.

La gráfica de la respuesta 3300 de frecuencia de una implementación del banco de filtros de la Figura 3 y descrita anteriormente se muestra en la Figura 6 en la que N =128, Mi =16 y P= 4, y las etapas se iteran en las dos menores subbandas en cada etapa.

Las aplicaciones potenciales para este banco de filtros jerárquico van más allá de audio, para procesamiento de video y otros tipos de señales (por ejemplo sísmicas, médicas, otras señales de serie de tiempo). La codificación de y compresión de video tienen requisitos similares para la descomposición de tiempo/frecuencia, y la naturaleza arbitraría de la descomposición proporcionada por el banco de filtros jerárquico puede tener ventajas significativas sobre las técnicas del estado de la técnica actuales a base de Transformada de Coseno Discreta y descomposición de ondícula. El banco de filtros también puede aplicarse en el análisis y procesamiento de mediciones sísmicas o mecánicas, procesamiento de señales biomédicas, análisis y procesamiento de señales naturales o fisiológicas, voz y otras señales de serie de tiempo. Puede extraerse información de dominio de frecuencia de los coeficientes de transformada producidos en cada iteración en resoluciones de frecuencia sucesivamente menores. Asimismo puede extraerse información de dominio de tiempo de las muestras de subbanda de dominio de tiempo producidas en cada iteración en escalas de tiempo sucesivamente más finas.

Banco de filtros jerárquico: subbandas separadas uniformemente

La Figura 7 muestra un diagrama de bloques de una realización ilustrativa del banco de filtros jerárquico 3900, que implementa un banco de filtros de subbandas separadas uniformemente. Para un banco de filtros uniforme Mi =M =N/(2*P). La descomposición de la señal de entrada en señales 3914 de subbanda se describe como se indica a continuación:

1. Muestras 3902 de tiempo de entrada se forman en ventana en N puntos, 50 % tramas 3904 superpuestas. 2. Se realiza una MDCT de N puntos 3906 en cada trama.

3. Los coeficientes de MDCT resultantes se agrupan en P grupos 3908 de M coeficientes en cada grupo.

4. Se realiza una IMDCT de (2*M) puntos 3910 en cada grupo para formar (2*M) muestras 3911 de subbanda de tiempo.

5. Las muestras 3911 de tiempo resultantes se forman en ventana en (2*M) puntos, 50 % tramas superpuestas y añadidas superpuestas (OLA) 3912 para formar M muestras de tiempo en cada subbanda 3914.

En una implementación ilustrativa, N=256, P=32 y M=4. Obsérvese que diferentes tamaños de transformada y agrupamientos de subbanda representados por diferentes elecciones para N, P y M también pueden conseguirse para conseguir una descomposición de tiempo/frecuencia deseada.

Banco de filtros jerárquico: subbandas no separadas uniformemente

En las Figuras 8a y 8b se muestra otra realización de un banco 3000 de filtros jerárquico. En esta realización, algunas de las etapas de banco de filtros están incompletas para producir una transformada con tres diferentes intervalos de frecuencia con los coeficientes de transformada que representan una diferente resolución de frecuencia en cada intervalo. La señal de dominio de tiempo se descompone en estos coeficientes de transformada usando una serie de bancos de filtros de un solo elemento en cascada. El elemento de banco de filtros detallado puede iterarse un número de veces para producir una descomposición de tiempo/frecuencia deseada. Obsérvese que los números para tamaños de memoria intermedia, tamaños de transformada y tamaños de ventana y el uso de la MDCT/IMDCT para la transformada son únicamente para una realización ilustrativa y no limitan el alcance de la presente invención. También pueden usarse otros tamaños de memoria intermedia, ventana y transformada y otros tipos de transformada. En general, las Mi difieren entre sí pero satisfacen la restricción de que la suma de las Mi es igual a N/2.

Como se muestra en la Figura 8b, un único elemento de banco de filtros almacena en memoria intermedia 3022 muestras 3020 de entrada para formar memorias intermedias de 256 muestras 3024, que se forman en ventana 3026 multiplicando las muestras por una función de ventaja de 256 muestras. Las muestras formadas en ventanas 3028 se transforman a través de una MDCT 3030 de 256 puntos para formar 128 coeficientes de transformada 3032. De estos 128 coeficientes, se seleccionan 3034 los 96 coeficientes de frecuencia más alta para salida 3037 y no se procesan adicionalmente. Los 32 coeficientes de frecuencia más baja se transforman inversamente 3042 para producir 64 muestras de dominio de tiempo, que a continuación se forman en ventana 3044 en muestras 3046 y añaden superpuestas 3048 con la trama de salida anterior para producir 32 muestras de salida 3050.

En el ejemplo mostrado en la Figura 8a, el banco de filtros se compone de un elemento de banco de filtros 3004

iterado una vez con un tamaño de memoria intermedia de entrada de 256 muestras seguido por un elemento de banco de filtros 3010 también iterado con un tamaño de memoria intermedia de entrada de 256 muestras. La última etapa 3016 representa un único elemento de banco de filtros abreviado y se compone de las etapas de almacenamiento en memoria intermedia 3022, formación de ventana 3026 y MDCT 3030 únicamente para emitir 128 coeficientes de dominio de frecuencia que representan el intervalo de frecuencias más bajas de 0-1378 Hz.

Por lo tanto, suponiendo una entrada 3002 con una tasa de muestras de 44100 Hz, el banco de filtros mostrado produce 96 coeficientes que representan el intervalo de frecuencia 5513 a 22050 Hz en "Salida1" 3008, 96 coeficientes que representan el intervalo de frecuencia 1379 a 5512 Hz en "Salida2" 3014, y 128 coeficientes que representan el intervalo de frecuencia 0 a 1378 Hz en "Salida3" 3018,

Debería observarse que el uso de MDCT/IMDCT para la transformada/transformada inversa de frecuencia es ilustrativo y pueden aplicarse otras transformaciones de tiempo/frecuencia como parte de la presente invención. Son posibles otros valores para los tamaños de transformada y son posibles otras descomposiciones con este enfoque, expandiendo selectivamente cualquier rama en la jerarquía descrita anteriormente.

Codificación conjunta multicanal de componentes tonales y residuales

El selector 103 de tono en la Figura 1 toma como entrada datos desde el calculador 101 de máscara y la lista de tonos desde el extractor 102 de tonos de múltiples órdenes. El selector 103 de tono primero clasifica la lista de tonos mediante potencia relativa sobre el nivel de enmascaramiento desde el calculador 101 de máscara, formando una ordenación por importancia psicoacústica. La fórmula empleada se proporciona mediante:

en la que:

Ak = amplitud de línea espectral

Mi,k = nivel de enmascaramiento para línea espectral de k en la subtrama de máscara de i

l = longitud de función base en términos de subtramas de máscara

La suma se realiza sobre las subtramas en las que el componente espectral tiene un valor distinto de cero.

El selector 103 de tonos usa a continuación un procedimiento iterativo para determinar qué componentes tonales de la lista de tonos clasificada para la misma trama encajarán en el flujo de bits. En señales de audio estéreo o multicanal, en las que la amplitud de un tono es aproximadamente la misma en más de un canal, únicamente toda la amplitud y fase se almacenan en el canal primario; siendo el canal primario el canal con la mayor amplitud para el componente tonal. Otros canales que tienen características tonales similares almacenan la diferencia del canal primario.

Los datos para cada tamaño de transformada incluyen un número de subtramas, cubriendo el tamaño de transformada más pequeño 2 subtramas; el segundo 4 subtramas; el tercero 8 subtramas; el cuarto 16 subtramas; y el quinto 32 subtramas. Existen 16 subtramas a 1 trama. Datos de tono se agrupan por tamaño de la transformada en la que se encontró la información de tono. Para cada tamaño de transformada, los siguientes datos de componente tonal se cuantifican, codifican por entropía y sitúan en el flujo de bits: posición de subtrama codificada por entropía, posición espectral codificada por entropía, amplitud cuantificada codificada por entropía y fase cuantificada.

En el caso de audio multicanal, para cada componente tonal, se selecciona un canal como el canal primario. La determinación de qué canal debería ser el canal primario puede fijarse o puede hacerse a base de la señal características o criterios perceptuales. El número de canal del canal primario y su amplitud y fase se almacenan en el flujo de bits. Como se muestra en la Figura 9, se almacena una máscara 3602 de bits indicando cuál de los otros canales incluyen el componente tonal indicado y, por lo tanto, deberían codificarse como canales secundarios. La diferencia entre las amplitudes y fases primarias y secundarias se codifican por entropía y almacenan para cada canal secundario en el que está presente el componente tonal. Este ejemplo particular supone que existen 7 canales, y el canal principal es el canal 3. La máscara 3602 de bits indica la presencia del componente tonal en los canales secundarios 1, 4 y 5. No se usa ningún bit para el canal primario.

La salida 4211 del extractor 102 de tonos de múltiples órdenes se compone de tramas de coeficientes de MDCT en una o más resoluciones. El selector 103 de tono determina qué componentes tonales pueden retenerse para inserción en la trama de salida de flujo de bits por el generador 108 de cadena de código, a base de su relevancia a la calidad de señal decodificada. Esos componentes tonales determinados que no encajan en la trama son la salida 110 al decodificador 104 local. El decodificador 104 local toma la salida 110 del selector 103 de tono y sintetiza todos los componentes tonales añadiendo cada componente tonal escalado con coeficientes 2000 de síntesis de

una tabla de consulta (Figura 20) para producir tramas de coeficientes de MDCT (Véase la Figura 16). Estos coeficientes se añaden a la salida 111 del extractor 102 de tonos de múltiples órdenes en el combinador 105 para producir una señal 113 residual en la resolución de MDCT de la última iteración del banco de filtros jerárquico.

Como se muestra en la Figura 10, la señal 113 residual para cada canal se pasa al codificador 107 residual como los coeficientes de MDCT 3908 del banco de filtros jerárquico 3900, antes de las etapas de formación de ventana y superposición-adición 3904 e IMDCT 3910 mostradas en la Figura 7. Las etapas posteriores de IMDCT 3910, formación de ventana y superposición-adición 3912 se realizan para producir 32 subbandas de frecuencia críticamente muestreadas espaciadas igualmente 3914 en el dominio del tiempo para cada canal. Las 32 subbandas, que componen los componentes de muestra de tiempo, se denominan cuadrícula G. Obsérvese que podrían usarse otras realizaciones del banco de filtros jerárquico en un codificador para implementar diferentes descomposiciones de tiempo/frecuencia que las descritas anteriormente y podrían usarse otras transformadas para extraer componentes tonales. Si no se usa un banco de filtros jerárquico para extraer componentes tonales, puede usarse otra forma de banco de filtros para extraer las subbandas pero en una carga de cálculo mayor.

Para audio estéreo o multicanal, se hacen varios cálculos en el bloque 501 de selección de canal para determinar el canal primario y secundario para la codificación de componentes tonales, así como el procedimiento de codificación de componentes tonales (por ejemplo, Izquierda-Derecha o Medio-Lateral). Como se muestra en la Figura 11, un procedimiento 3702 de agrupamiento de canal primero determina cuál de los múltiples canales puede codificarse conjuntamente y todos los canales se forman en grupos con el último grupo estando posiblemente incompleto. Los agrupamientos se determinan por criterios perceptuales de un oyente y eficiencia de codificación, y pueden construirse grupos de canales de combinaciones de más de dos canales (por ejemplo, una señal de 5 canales compuesta de canales L, R, Ls, Rs y C puede agruparse como {L,R}, {Ls, Rs}, {L+R, C}. Los grupos de canales se ordenan a continuación como canales primarios y secundarios. E una realización multicanal ilustrativa, la selección del canal primario se hace a base de la potencia relativa de los canales sobre la trama. Las siguientes ecuaciones definen las potencias relativas:

El modo de agrupamiento también se determina como se muestra en la etapa 3704 de la Figura 11. Los componentes tonales pueden codificarse como representación de Izquierda-Derecha o Medio-Lateral, o la salida de esta etapa puede resultar en un único canal primario únicamente como se muestra mediante las líneas discontinuas. En representación de Izquierda-Derecha, el canal con la mayor potencia para la subbanda se considera el primario y se establece un único bit en el flujo de bits 3706 para la subbanda si el canal derecho es el canal de mayor potencia. Se usa codificación Medio-Lateral para una subbanda si se cumple la siguiente condición para la subbanda:

Para señales multicanal, lo anterior se realiza para cada grupo de canales.

Para una señal estéreo, el cálculo 502 de cuadrícula proporciona una cuadrícula de panoramización estéreo en la que la panoramización estéreo puede reconstruirse difícilmente y aplicarse a la señal residual. La cuadrícula estéreo es 4 subbandas por 4 intervalos de tiempo, cada subbanda en la cuadrícula estéreo cubre 4 subbandas y 32 muestras de la salida del banco 500 de filtros, comenzando con bandas de frecuencia por encima de 3 kHz. Podrían elegirse otros tamaños de cuadrícula, subbandas de frecuencia cubiertas y divisiones de tiempo. Valores en las celdas de la cuadrícula estéreo son la relación de la potencia del canal dado a la del canal primario, para el intervalo de valores cubiertos por la celda. La relación se cuantifica a continuación a la misma tabla que la usada para codificar componentes tonales. Para señales multicanal, la cuadrícula estéreo anterior se calcula para cada grupo de canales.

Para señales multicanal, el cálculo 502 de cuadrícula proporciona múltiples cuadrículas de factor de escala, una por cada grupo de canales, que se insertan en el flujo de bits en orden de su importancia psicoacústica en el dominio espacial. Le calcula la relación de la potencia del canal dado al canal primario para cada grupo de 4 subbandas por 32 muestras. Esta relación se cuantifica a continuación y este valor cuantificado más signo de logaritmo de la relación de potencia se inserta en el flujo de bits.

El cálculo 503 de cuadrícula de factor de escala calcula la cuadrícula G1, que se sitúa en el flujo de bits. Se describe ahora el procedimiento de cálculo de G1. G0 se obtiene primero a partir de G. G0 contiene todas las 32 subbandas pero únicamente la mitad de resolución de tiempo de G. Los contenidos de las celdas en G0 son valores cuantificados del máximo de dos valores vecinos de una subbanda dada de G. Cuantificación (denominada en las siguientes ecuaciones como Cuantificar) se realiza usando la misma tabla de cuantificación logarítmica modificada como se usó para codificar los componentes tonales en el extractor 102 de tonos de múltiples órdenes. Cada celda en G0 se determina por lo tanto mediante:

en la que:

m es el número de subbandas

n es el número de columnas de G0

G1 se obtiene a partir de G0. G1 tiene 11 subbandas superpuestas y 1/8 de la resolución de tiempo de G0, formando una cuadrícula de dimensión de 11 x 8. Cada celda en G1 se cuantifica usando la misma tabla que la \ usada para componentes tonales y encontrada usando la siguiente fórmula:

en la que: Wi es un valor de ponderación obtenido de la Tabla 1 en la Figura 19.

G0 se recalcula a partir de G1 en decodificador 506 de cuadrícula local. En el bloque 507 de cuantificación de muestra de tiempo, se extraen muestras de salida de tiempo ("componentes de muestra de tiempo") del banco de filtros jerárquico (Cuadrícula G), que pasan a través del bloque 504 de selección de nivel de cuantificación, escaladas dividiendo los componentes de muestra de tiempo por los respectivos valores en la recalculada G0 del decodificador 506 de cuadrícula local y cuantificados al número de niveles de cuantificación, como una función de subbanda, determinados por el bloque 504 de selección de nivel de cuantificación. Estas muestras de tiempo cuantificadas se sitúan a continuación en el flujo de datos codificado junto con la cuadrícula G1 cuantificada. En todos los casos, se usa un modelo que refleja la importancia psicoacústica de estos componentes para determinar la prioridad para la operación de almacenamiento de flujo de bits.

En una etapa de mejora adicional para mejorar la ganancia de codificación para algunas señales, pueden procesarse adicionalmente cuadrículas que incluyen G, G1 y cuadrículas parciales aplicando una Transformada de Coseno Discreta bidimensional (DCT) antes de cuantificación y codificación. La correspondiente DCT inversa se aplica en el decodificador tras la cuantificación inversa para reconstruir las cuadrículas originales.

Flujo de bits escalable y mecanismo de escalado

Típicamente, cada trama del flujo de bits maestro incluirá (a) una pluralidad de componentes tonales cuantificados que representan contenidos de dominio de frecuencia a diferentes resoluciones de frecuencia de la señal de entrada, b) componentes de muestra de tiempo residuales cuantificados que representan la residual de dominio de tiempo formada a partir de la diferencia entre los componentes tonales reconstruidos y la señal de entrada, y c) cuadrículas de factor de escala que representan las energías de señal de la señal residual, que se extienden un intervalo de frecuencia de la señal de entrada. Para una señal multicanal cada trama también puede contener d) cuadrículas parciales que representan las relaciones de energía de señal de los canales de señal residuales dentro de grupos de canales y e) una máscara de bits para cada primario especificando la codificación conjunta de canales secundarios para componentes tonales. Normalmente una porción de la tasa de datos disponible en cada trama se asigna desde los componentes tonales (a) y se asigna una porción para los componentes residuales (b, c). Sin embargo, en algunos casos toda la tasa disponible puede asignarse para codificar los componentes tonales. Como alternativa, toda la tasa disponible puede asignarse para codificar los componentes residuales. En casos extremos, únicamente las cuadrículas de factor de escala pueden codificarse, en cuyo caso el decodificador usa una señal de ruido para reconstruir una señal de salida. En la mayoría de aplicaciones reales, el flujo de bits escalado incluirá al menos algunas tramas que contienen componentes tonales y algunas tramas que incluyen cuadrículas de factor de escala.

La estructura y orden de componentes situados en el flujo de bits maestro, según se define mediante la presente invención, proporciona escalabilidad de flujo de datos de intervalo de bits amplia y granularidad fina. Es esta estructura y orden la que permite que el flujo de bits se escale suavemente por mecanismos externos. La Figura 12 representa la estructura y orden de componentes a base del códec de descompresión de audio de la Figura 1 que descompone el flujo de datos original en un conjunto particular de componentes psicoacústicamente relevantes. El flujo de bits escalable usado en este ejemplo se compone de un número de estructuras de datos de Formato de Archivo de Intercambio de Recursos, o RIFF, llamadas "fragmentos", aunque pueden usarse otras estructuras de datos. Este formato de archivo que se conoce bien por los expertos en la materia, permite la identificación del tipo de datos transportados por un fragmento así como la cantidad de datos transportada por un fragmento. Obsérvese que puede usarse cualquier formato de flujo de datos que transporta información con respecto a la cantidad y tipo de datos transportados en sus estructuras de datos de flujo de datos para practicar la presente invención.

La Figura 12 muestra el diseño de un fragmento 900 de trama de tasa de datos escalable, junto con subfragmentos 902, 903, 904, 905, 906, 906, 907, 908, 909, 910 y 912, que comprenden los datos psicoacústicos que se transportan dentro del fragmento 900 de trama. Aunque la Figura 12 únicamente representa ID de fragmento y longitud de fragmento para el fragmento de trama, ID de subfragmento y datos de longitud de subfragmento se incluyen dentro de cada subfragmento. La Figura 12 muestra el orden de subfragmentos en una trama del flujo de bits escalable. Estos subfragmentos contienen los componentes psicoacústicos producidos por el codificador de flujo de bits escalable, con un subfragmento único usado para cada subdominio del flujo de datos codificado. Además de los subfragmentos que se disponen en importancia psicoacústica, ya sea por una decisión o cálculo a priori, los componentes dentro de los subfragmentos también se disponen en importancia psicoacústica. El fragmento 911

nulo, que es el último fragmento en la trama, se usa para empaquetar fragmentos en el caso en el que se requiera que la trama tenga un tamaño constante o específico. Por lo tanto el fragmento 911 no tiene relevancia psicoacústica y es el fragmento psicoacústico menos importante. Fragmento 910 de muestras de tiempo 2 aparece en el lado derecho de la figura y el fragmento psicoacústico más importante, fragmento 902 de cuadrícula 1 aparece en el lado izquierdo de la figura. Operando para eliminar primero datos del fragmento psicoacústicamente menos relevante en el final del flujo de bits, el fragmento 910, y trabajando hacia la eliminación de componentes psicoacústicamente cada vez más relevantes hacia el comienzo del flujo de bits, el fragmento 902, se mantiene la mayor calidad posible para cada reducción sucesiva en tasa de datos. Debería observarse que la mayor tasa de datos, junto con la mayor calidad de audio, capaz de soportarse por el flujo de bits, se define en tiempo de codificación. Sin embargo, la menor tasa de datos después de escalado se define por el nivel de calidad de audio que es aceptable para su uso mediante una aplicación o mediante la restricción de tasa situada en el canal o medios.

Cada componente psicoacústico eliminado no utiliza el mismo número de bits. La resolución de escalado para la implementación actual de la presente invención oscila desde 1 bit para componentes de la menor importancia psicoacústica hasta 32 bits para esos componentes de la mayor importancia psicoacústica. El mecanismo de escalado del flujo de bits no necesita eliminar fragmentos enteros cada vez. Como se ha mencionado anteriormente, componentes dentro de cada fragmento se disponen de modo que los datos más psicoacústicamente importantes se sitúan en el comienzo del fragmento. Por esta razón, pueden eliminarse componentes del final del fragmento, un componente cada vez, mediante un mecanismo de escalado mientras mantiene la mejor calidad de audio posible con cada componente eliminado. En una realización de la presente invención, se eliminan componentes enteros mediante el mecanismo de escalado, mientras en otras realizaciones, pueden eliminarse algunos o todos los componentes. El mecanismo de escalado elimina componentes dentro de un fragmento según se requiera, actualizando el campo de longitud de fragmento del fragmento particular del que se eliminaron los componentes, la longitud 915 de fragmento de trama y la suma 901de control de trama. Como se observará a partir de la descripción detallada de las realizaciones ilustrativas de la presente invención, con longitud de fragmento actualizada para cada fragmento escalado, así como longitud de fragmento de trama actualizada e información de suma de control de trama disponible al decodificador, el decodificador puede procesar apropiadamente el flujo de bits escalado, y automáticamente producir una señal de salida de audio de tasa de muestra fija para distribución al DAC, incluso aunque hay fragmentos dentro del flujo de bits que son componentes faltantes, así como fragmentos que faltan completamente del flujo de bits.

Decodificador de flujo de bits escalable para una topología de codificación residual

La Figura 13 muestra el diagrama de bloques para el decodificador. El analizador 600 de flujo de bits lee información secundaria inicial que consiste en: la tasa de muestras en hercios de la señal codificada antes de codificación, el número de canales de audio, la tasa de datos original del flujo y la tasa de datos codificada. Esta información secundaria inicial permite que la misma reconstruya la tasa de datos completa de la señal original. Adicionalmente el analizador 600 de flujo de bits analiza componentes en el flujo 599 de datos y pasan al elemento de decodificación apropiado: decodificador 601 de tono o decodificador 602 residual. Componentes decodificados a través del decodificador 601 de tono se procesan a través de la transformada 604 de frecuencia inversa que convierte la señal de vuelta al dominio del tiempo. El bloque 608 de superponer-añadir añade los valores de la última mitad de la trama anteriormente decodificada a los valores de la primera mitad de la trama recién decodificada que es la salida de la transformada 604 de frecuencia inversa. Componentes que el analizador 600 de flujo de bits determina que sean parte del procedimiento de decodificación residual se procesan a través del decodificador 602 residual. La salida del decodificador 602 residual, que contiene 32 frecuencia subbandas representadas en el dominio del tiempo, se procesa a través del banco 605 de filtros inverso. El banco 605 de filtros inverso recombina las 32 subbandas en una señal a combinar con la salida del añadir-superponer 608 en el combinador 607. La salida del combinador 607 es la señal de salida decodificada 614.

Para reducir la carga de cálculo, la transformada 604 de frecuencia inversa y el banco 605 de filtros inverso que convierten las señales de vuelta al dominio del tiempo pueden implementarse con un banco de filtros jerárquico inverso, que integra estas operaciones con el combinador 607 para formar la señal 614 de salida de dominio de tiempo decodificada. El uso del banco de filtros jerárquico en el decodificador es novedoso en la forma en que se combinan los componentes tonales con la residual en el banco de filtros jerárquico en el decodificador. Las señales residuales se transforman hacia delante usando MDCT en cada subbanda, y a continuación los componentes tonales se reconstruyen y combinan antes de la última etapa de IMDCT. El enfoque de múltiples resoluciones podría generalizarse para otras aplicaciones (por ejemplo múltiples niveles, diferentes descomposiciones aún se cubrirían mediante este aspecto de la invención).

Banco de filtros jerárquico inverso

Para reducir la complejidad del decodificador, puede usarse el banco de filtros jerárquico para combinar las etapas de la transformada 604 de frecuencia inversa, banco 605 de filtros inverso, añadir-superponer 608 y combinador 607. Como se muestra en la Figura 15, la salida del decodificador 602 residual se pasa a la primera etapa del banco 4000 de filtros jerárquico inverso mientras la salida del decodificador 601 de tono se añade a las muestras residuales en la etapa de mayor resolución de frecuencia antes de la transformada 4010 inversa final. Las muestras

transformadas inversas resultantes se añaden superpuestas a continuación para producir las muestras 4016 de salida lineales.