ES2922799T3 - Señalización de información relacionada con ángulo de obturador - Google Patents

Señalización de información relacionada con ángulo de obturador Download PDFInfo

- Publication number

- ES2922799T3 ES2922799T3 ES20717040T ES20717040T ES2922799T3 ES 2922799 T3 ES2922799 T3 ES 2922799T3 ES 20717040 T ES20717040 T ES 20717040T ES 20717040 T ES20717040 T ES 20717040T ES 2922799 T3 ES2922799 T3 ES 2922799T3

- Authority

- ES

- Spain

- Prior art keywords

- shutter

- frame

- angle

- frames

- frame rate

- Prior art date

- Legal status (The legal status is an assumption and is not a legal conclusion. Google has not performed a legal analysis and makes no representation as to the accuracy of the status listed.)

- Active

Links

Classifications

-

- H—ELECTRICITY

- H04—ELECTRIC COMMUNICATION TECHNIQUE

- H04N—PICTORIAL COMMUNICATION, e.g. TELEVISION

- H04N19/00—Methods or arrangements for coding, decoding, compressing or decompressing digital video signals

- H04N19/30—Methods or arrangements for coding, decoding, compressing or decompressing digital video signals using hierarchical techniques, e.g. scalability

- H04N19/31—Methods or arrangements for coding, decoding, compressing or decompressing digital video signals using hierarchical techniques, e.g. scalability in the temporal domain

-

- H—ELECTRICITY

- H04—ELECTRIC COMMUNICATION TECHNIQUE

- H04N—PICTORIAL COMMUNICATION, e.g. TELEVISION

- H04N19/00—Methods or arrangements for coding, decoding, compressing or decompressing digital video signals

- H04N19/10—Methods or arrangements for coding, decoding, compressing or decompressing digital video signals using adaptive coding

- H04N19/102—Methods or arrangements for coding, decoding, compressing or decompressing digital video signals using adaptive coding characterised by the element, parameter or selection affected or controlled by the adaptive coding

- H04N19/132—Sampling, masking or truncation of coding units, e.g. adaptive resampling, frame skipping, frame interpolation or high-frequency transform coefficient masking

-

- H—ELECTRICITY

- H04—ELECTRIC COMMUNICATION TECHNIQUE

- H04N—PICTORIAL COMMUNICATION, e.g. TELEVISION

- H04N19/00—Methods or arrangements for coding, decoding, compressing or decompressing digital video signals

- H04N19/10—Methods or arrangements for coding, decoding, compressing or decompressing digital video signals using adaptive coding

- H04N19/134—Methods or arrangements for coding, decoding, compressing or decompressing digital video signals using adaptive coding characterised by the element, parameter or criterion affecting or controlling the adaptive coding

- H04N19/146—Data rate or code amount at the encoder output

-

- H—ELECTRICITY

- H04—ELECTRIC COMMUNICATION TECHNIQUE

- H04N—PICTORIAL COMMUNICATION, e.g. TELEVISION

- H04N19/00—Methods or arrangements for coding, decoding, compressing or decompressing digital video signals

- H04N19/10—Methods or arrangements for coding, decoding, compressing or decompressing digital video signals using adaptive coding

- H04N19/169—Methods or arrangements for coding, decoding, compressing or decompressing digital video signals using adaptive coding characterised by the coding unit, i.e. the structural portion or semantic portion of the video signal being the object or the subject of the adaptive coding

- H04N19/17—Methods or arrangements for coding, decoding, compressing or decompressing digital video signals using adaptive coding characterised by the coding unit, i.e. the structural portion or semantic portion of the video signal being the object or the subject of the adaptive coding the unit being an image region, e.g. an object

- H04N19/172—Methods or arrangements for coding, decoding, compressing or decompressing digital video signals using adaptive coding characterised by the coding unit, i.e. the structural portion or semantic portion of the video signal being the object or the subject of the adaptive coding the unit being an image region, e.g. an object the region being a picture, frame or field

-

- H—ELECTRICITY

- H04—ELECTRIC COMMUNICATION TECHNIQUE

- H04N—PICTORIAL COMMUNICATION, e.g. TELEVISION

- H04N19/00—Methods or arrangements for coding, decoding, compressing or decompressing digital video signals

- H04N19/10—Methods or arrangements for coding, decoding, compressing or decompressing digital video signals using adaptive coding

- H04N19/169—Methods or arrangements for coding, decoding, compressing or decompressing digital video signals using adaptive coding characterised by the coding unit, i.e. the structural portion or semantic portion of the video signal being the object or the subject of the adaptive coding

- H04N19/187—Methods or arrangements for coding, decoding, compressing or decompressing digital video signals using adaptive coding characterised by the coding unit, i.e. the structural portion or semantic portion of the video signal being the object or the subject of the adaptive coding the unit being a scalable video layer

-

- H—ELECTRICITY

- H04—ELECTRIC COMMUNICATION TECHNIQUE

- H04N—PICTORIAL COMMUNICATION, e.g. TELEVISION

- H04N19/00—Methods or arrangements for coding, decoding, compressing or decompressing digital video signals

- H04N19/30—Methods or arrangements for coding, decoding, compressing or decompressing digital video signals using hierarchical techniques, e.g. scalability

-

- H—ELECTRICITY

- H04—ELECTRIC COMMUNICATION TECHNIQUE

- H04N—PICTORIAL COMMUNICATION, e.g. TELEVISION

- H04N19/00—Methods or arrangements for coding, decoding, compressing or decompressing digital video signals

- H04N19/46—Embedding additional information in the video signal during the compression process

-

- H—ELECTRICITY

- H04—ELECTRIC COMMUNICATION TECHNIQUE

- H04N—PICTORIAL COMMUNICATION, e.g. TELEVISION

- H04N19/00—Methods or arrangements for coding, decoding, compressing or decompressing digital video signals

- H04N19/70—Methods or arrangements for coding, decoding, compressing or decompressing digital video signals characterised by syntax aspects related to video coding, e.g. related to compression standards

Landscapes

- Engineering & Computer Science (AREA)

- Multimedia (AREA)

- Signal Processing (AREA)

- Compression Or Coding Systems Of Tv Signals (AREA)

- Holo Graphy (AREA)

- Particle Accelerators (AREA)

- Mechanical Light Control Or Optical Switches (AREA)

- Television Systems (AREA)

- Fuel Cell (AREA)

- Indication In Cameras, And Counting Of Exposures (AREA)

- Liquid Crystal (AREA)

- Two-Way Televisions, Distribution Of Moving Picture Or The Like (AREA)

Abstract

Se describen métodos y sistemas para la escalabilidad de la velocidad de fotogramas. Se proporciona soporte para secuencias de video de entrada y salida con velocidad de cuadro variable y ángulo de obturación variable en las escenas, o para secuencias de video de entrada con velocidad de cuadro de entrada y ángulo de obturación de entrada fijos, pero que permite que un decodificador genere una salida de video a una velocidad de cuadro de salida diferente y el ángulo de obturación que los valores de entrada correspondientes. También se presentan técnicas que permiten a un decodificador decodificar de forma más eficiente desde el punto de vista computacional una velocidad de fotogramas objetivo y un ángulo de obturación específicos compatibles con versiones anteriores entre los permitidos. (Traducción automática con Google Translate, sin valor legal)

Description

DESCRIPCIÓN

Señalización de información relacionada con ángulo de obturador

El presente documento se refiere en general a las imágenes. Más particularmente, una realización de la presente invención se refiere a un indicador del ángulo de obturador que indica si la información del ángulo de obturador es fija para todas las subcapas temporales en la secuencia de imágenes de video.

Antecedentes

Como se usa en el presente documento, el término 'rango dinámico' (DR) puede referirse a la capacidad del sistema visual humano (HVS) para percibir un rango de intensidad (por ejemplo, luminancia, luma) en una imagen, por ejemplo, desde los grises más oscuros (negros) a los blancos más brillantes (los más claros). En este sentido, el DR se refiere a una intensidad 'referida a la escena'. El DR también puede referirse a la capacidad de un dispositivo de visualización para renderizar de manera adecuada o aproximada un rango de intensidad de una amplitud particular. En este sentido, el DR se refiere a una intensidad 'referida a la visualización'. A menos que se especifique explícitamente que un sentido particular tiene un significado particular en cualquier punto de la descripción del presente documento, se debe inferir que el término puede usarse en cualquier sentido, por ejemplo, indistintamente.

Como se usa en el presente documento, el término alto rango dinámico (HDR) se refiere a una amplitud de DR que abarca los 14-15 órdenes de magnitud del sistema visual humano (HVS). En la práctica, el DR sobre el cual un ser humano puede percibir simultáneamente una gran amplitud en el rango de intensidad puede estar algo truncado, en relación con HDR.

En la práctica, las imágenes comprenden uno o más componentes de color (por ejemplo, luminancia Y y croma Cb y Cr) donde cada componente de color se representa con una precisión de n bits por píxel (por ejemplo, n=8). Usando la codificación de luminancia lineal, las imágenes en las que n < 8 (por ejemplo, imágenes JPEG en color de 24 bits) se consideran imágenes de rango dinámico estándar (SDR), mientras que las imágenes en las que n > 8 pueden considerarse imágenes de rango dinámico potenciado. Las imágenes HDR también se pueden almacenar y distribuir usando formatos de coma flotante de alta precisión (por ejemplo, 16 bits), como el formato de archivo OpenEXR desarrollado por Industrial Light and Magic.

Actualmente, la distribución de contenido de video de alto rango dinámico, como Dolby Vision de los laboratorios Dolby o HDR10 en Blue-Ray, está limitada a una resolución de 4K (por ejemplo, 4096 x 2160 o 3840 x 2160, y similares) y 60 fotogramas por segundo (fps) por las capacidades de muchos dispositivos de reproducción. En futuras versiones, se anticipa que el contenido de hasta 8K de resolución (por ejemplo, 7680 x 4320) y 120 fps puede estar disponible para su distribución y reproducción. Es deseable que los tipos de contenido futuros sean compatibles con los dispositivos de reproducción existentes para simplificar un ecosistema de contenido de reproducción HDR, como Dolby Vision. Idealmente, los productores de contenido deberían poder adoptar y distribuir futuras tecnologías HDR sin tener que derivar y distribuir también versiones especiales del contenido que sean compatibles con los dispositivos HDR existentes (como HDR10 o Dolby Vision). Como apreciaron los inventores aquí, se desean técnicas mejoradas para la distribución escalable de contenido de video, especialmente contenido HDR.

El documento US 2016/234500 A1 describe la transmisión de datos de imágenes en movimiento a una tasa de fotogramas alta en buenas condiciones, en el que los datos de la segunda imagen en movimiento a una tasa de fotogramas predeterminada se proporcionan mediante el procesamiento de los datos de la primera imagen en movimiento a la tasa de fotogramas predeterminada en unidades de N imágenes consecutivas (N es un número entero mayor o igual a dos), usando un elemento de datos de imagen proporcionado promediando los elementos de datos de imagen de las N imágenes como el elemento de datos de imagen de la primera imagen, y usando los elementos de datos de imagen de la segunda a la N-ésima imagen de las N imágenes como elementos de datos de imagen de la segunda a la N-ésima imagen. Se genera un flujo de video codificando el elemento de datos de imagen de cada imagen en los segundos datos de imagen en movimiento y se transmite el flujo de video generado.

Este documento también describe un campo de un bit de un "shutter_speedjnformation_descriptor" que indica si la información de velocidad de captura SEI está codificada en el flujo de video; el flujo de video puede estar en capas.

Los enfoques descritos en esta sección son enfoques que podrían perseguirse, pero no necesariamente enfoques que hayan sido previamente concebidos o perseguidos. Por lo tanto, a menos que se indique lo contrario, no debe suponerse que cualquiera de los enfoques descritos en esta sección califica como estado de la técnica simplemente en virtud de su inclusión en esta sección. Del mismo modo, no se debe suponer que los problemas identificados con respecto a uno o más enfoques han sido reconocidos en ningún estado de la técnica sobre la base de esta sección, a menos que se indique lo contrario.

Breve descripción de los dibujos

Una realización de la presente invención se ilustra a modo de ejemplo, y no de forma limitativa, en las figuras de los dibujos adjuntos y en los que los mismos números de referencia se refieren a elementos similares y en los que:

la figura 1 representa un proceso de ejemplo para una canalización de entrega de video;

la figura 2 representa un proceso de ejemplo de combinación de fotogramas originales consecutivos para renderizar una tasa de fotogramas de destino en un ángulo de obturador de destino;

la figura 3 muestra una representación de ejemplo de una secuencia de entrada con tasa de fotogramas de entrada variable y ángulo de obturador variable en un contenedor con una tasa de fotogramas fija de acuerdo con una realización de esta invención; y

la figura 4 muestra una representación de ejemplo para la escalabilidad temporal a varias tasas de fotogramas y ángulos de obturador con compatibilidad con versiones anteriores de acuerdo con una realización de esta invención.

Descripción de realizaciones de ejemplo

En el presente documento, se describen ejemplos de realizaciones que se refieren a la escalabilidad de la tasa de fotogramas para la codificación de video. En la siguiente descripción, con fines explicativos, se exponen numerosos detalles específicos para proporcionar una comprensión completa de las diversas realizaciones de la presente invención. Será evidente, sin embargo, que las diversas realizaciones de la presente invención pueden practicarse sin estos detalles específicos. En otros casos, las estructuras y dispositivos bien conocidos no se describen en detalle exhaustivo, para evitar ocluir, complicar u ofuscar innecesariamente las realizaciones de la presente invención.

Sumario

La invención está definida por las reivindicaciones adjuntas y se describe en la sección titulada "Señalización alternativa de información del ángulo de obturador". Las otras realizaciones y ejemplos se proporcionan con fines ilustrativos y no representan realizaciones de la invención excepto cuando se combinan con todas las características definidas respectivamente en la reivindicación independiente.

En una realización de acuerdo con la invención reivindicada, se describe un medio legible por procesador no transitorio de acuerdo con la reivindicación independiente 1.

Ejemplo de canalización de procesamiento de entrega de vídeo

La figura 1 representa un proceso de ejemplo de una canalización 100 de entrega de video convencional que muestra varias etapas desde la captura de video hasta la visualización del contenido de video. Se captura o genera una secuencia de fotogramas 102 de video usando el bloque 105 de generación de imágenes. Los fotogramas 102 de video pueden ser capturados digitalmente (por ejemplo, por una cámara digital) o generados por un ordenador (por ejemplo, usando animación por ordenador) para proporcionar datos 107 de video. Alternativamente, los fotogramas 102 de video pueden ser capturados en película por una cámara de cine. La película se convierte a un formato digital para proporcionar datos 107 de video. En una fase 110 de producción, los datos 107 de video se editan para proporcionar un flujo 112 de producción de video.

Luego, los datos de video del flujo 112 de producción se envían a un procesador en el bloque 115 para la edición posterior a la producción. La edición de posproducción de bloque 115 puede incluir ajustar o modificar los colores o el brillo en áreas particulares de una imagen para potenciar la calidad de la imagen o lograr una apariencia particular para la imagen de acuerdo con la intención creativa del creador del video. Esto a veces se denomina "sincronización de color" o "graduación de color". " Se pueden realizar otras ediciones (por ejemplo, selección y secuenciación de escenas, recorte de imágenes, adición de efectos especiales visuales generados por ordenador, control de vibración o desenfoque, control de tasa de fotogramas, etc.) en el bloque 115 para producir una versión final 117 de la producción para la distribución. Durante la edición de posproducción 115, las imágenes de video se visualizan en una pantalla 125 de referencia. Después de la postproducción 115, los datos de video de la producción final 117 pueden enviarse al bloque 120 de codificación para enviarlos aguas abajo a los dispositivos de decodificación y reproducción, como televisores, decodificadores, salas de cine y similares. En algunas realizaciones, el bloque 120 de codificación puede incluir codificadores de audio y video, como los definidos por ATSC, DVB, DVD, Blu-Ray y otros formatos de entrega, para generar un flujo 122 de bits codificado. En un receptor, el flujo 122 de bits codificado es decodificado por la unidad 130 de decodificación para generar una señal decodificada 132 que representa una aproximación idéntica o cercana de la señal 117. El receptor puede estar unido a una pantalla 140 de destino que puede tener características completamente diferentes a las de la pantalla 125 de referencia. En ese caso, se puede usar un bloque 135 de gestión de pantalla para mapear el rango dinámico de la señal decodificada 132 a las características de la pantalla 140 de destino generando una señal 137 mapeada de pantalla.

Codificación escalable

La codificación escalable ya forma parte de varios estándares de codificación de video, como MPEG-2, AVC y HEVC. En las realizaciones de esta invención, la codificación escalable se amplía para mejorar el rendimiento y la flexibilidad, especialmente en lo que se refiere a contenido HDR de muy alta resolución.

Como se usa en el presente documento, el término "ángulo de obturador" denota un ajuste de obturador ajustable que controla la proporción de tiempo que la película está expuesta a la luz durante cada intervalo de fotogramas. Por ejemplo, en una realización,

El término proviene de obturadores giratorios mecánicos heredados; sin embargo, las cámaras digitales modernas también pueden ajustar su obturador electrónicamente. Los directores de fotografía pueden usar el ángulo de obturador para controlar la cantidad de desenfoque de movimiento o trepidación que se graba en cada fotograma. Téngase en cuenta que en lugar de usar "tiempo de exposición", también se pueden usar términos alternativos, como "duración de exposición", "intervalo de obturador" y "velocidad de obturador". De manera similar, en lugar de usar "intervalo de fotogramas" se puede usar el término "duración de fotogramas". Alternativamente, uno puede reemplazar "intervalo de fotogramas" con "1/tasa de fotogramas". El valor del tiempo de exposición suele ser inferior o igual a la duración de un fotograma. Por ejemplo, un ángulo de obturador de 180 grados indica que el tiempo de exposición es la mitad de la duración del fotograma. En algunas situaciones, el tiempo de exposición puede ser mayor que la duración del fotograma del video codificado, por ejemplo, cuando la tasa de fotogramas codificada es de 120 fps y la tasa de fotogramas del contenido de video asociado antes de la codificación y visualización es de 60 fps.

Considérese, sin limitación, una realización en la que el contenido original se graba (o genera) a una tasa de fotogramas original (por ejemplo, 120 fps) con un ángulo de obturador de 360 grados. Luego, en un dispositivo receptor, se puede reproducir la salida de video a una variedad de tasas de fotogramas iguales o inferiores a la tasa de fotogramas original mediante una combinación judicial de los fotogramas originales, por ejemplo, promediando u otras operaciones conocidas en la técnica.

El proceso de combinación se puede realizar con señales codificadas no lineales (por ejemplo, usando gamma, PQ o HLG), pero la mejor calidad de imagen se obtiene combinando fotogramas en el dominio de la luz lineal convirtiendo primero las señales codificadas no lineales en representaciones ligeras lineales, luego, combinando los fotogramas convertidos, y finalmente recodificando la salida con la función de transferencia no lineal. Este proceso proporciona una simulación más precisa de la exposición de una cámara física que la combinación en el dominio no lineal.

En términos generales, el proceso de combinación de fotogramas se puede expresar en términos de la tasa de fotogramas original, la tasa de fotogramas de destino, el ángulo de obturador de destino y la cantidad de fotogramas que se combinarán como:

n_frames = (target_shutter_angle/360)*(orig¡nal_fram e_rate/target_frame_rate), ( 2 )

que es equivalente a

target_shutter_angle = 360*n_fram es*(target_fram e_rate/orig¡nal_fram e_rate), (3)

donde n_frames es el número de fotogramas combinados, original_frame_rate es la tasa de fotogramas del contenido original, target_frame_rate es la tasa de fotogramas que se representará (donde, target_frame_rate < original_frame_rate) y target_shutter_angle indican la cantidad de desenfoque de movimiento deseado. En este ejemplo, el valor máximo de target_shutter_angle es de 360 grados y corresponde al desenfoque de movimiento máximo. El valor mínimo de target_shutter_angle se puede expresar como 360 *(target_frame_rate/original_frame_rate) y corresponde a un desenfoque de movimiento mínimo. El valor máximo de n_frames se puede expresar como (original_frame_rate/target_frame_rate). Los valores de target_frame_rate y target_shutter_angle deben seleccionarse de modo que el valor de n_frames sea un número entero distinto de cero.

En el caso especial de que la tasa de fotogramas original sea de 120 fps, la ecuación (2) se puede reescribir como

n_frames = ta rge t_shutter_angle /(3*ta rget_ fram e_ra te), (4)

que es equivalente a

target_shutter_angle = 3 *n_ fram es*targe t_ fram e_ra te .

(5)

Las relaciones entre los valores de target_frame_rate, n_frames y target_shutter_angle se muestran en la tabla 1 para el caso de original_frame_rate = 120 fps. En la tabla 1, "NA" indica que no se permite la combinación correspondiente de una tasa de fotogramas de destino y el número de fotogramas combinados.

Tabla 1: Relación entre la tasa de fotogramas de destino, el número de fotogramas combinados y el ángulo de obturador de destino ara una tasa de foto ramas ori inal de 120 f s.

La figura 2 representa un proceso de ejemplo de combinación de fotogramas originales consecutivos para renderizar una tasa de fotogramas de destino en un ángulo de obturador de destino. Dada una secuencia 205 de entrada a 120 fps y un ángulo de obturador de 360 grados, el proceso genera una secuencia 210 de video de salida a 24 fps y un ángulo de obturador de 216 grados al combinar tres de los fotogramas de entrada en un conjunto de cinco fotogramas consecutivos (por ejemplo, los tres primeros fotogramas consecutivos) y descartando los otros dos. Téngase en cuenta que en algunas realizaciones, el fotograma de salida 01 de (210) puede generarse combinando fotogramas 205 de entrada alternativos, como los fotogramas 1, 3 y 5, o los fotogramas 2, 4 y 5, y similares; sin embargo, se espera que la combinación de fotogramas consecutivos produzca una salida de video de mejor calidad.

Es deseable admitir contenido original con tasa de fotogramas variable, por ejemplo, para gestionar el efecto artístico y estilístico. También es deseable que la tasa de fotogramas de entrada variable del contenido original se empaquete en un "contenedor" que tenga una tasa de fotogramas fija para simplificar la producción, el intercambio y la distribución de contenido. Como ejemplo, se presentan tres realizaciones sobre cómo representar los datos de vídeo de tasa de fotogramas variable en un contenedor de tasa de fotogramas fija. Para fines de claridad y sin limitación, las siguientes descripciones usan un contenedor fijo de 120 fps, pero los enfoques pueden extenderse fácilmente a un contenedor de tasa de fotogramas alternativo.

Primera realización (tasa de fotogramas variable)

La primera realización es una descripción explícita del contenido original que tiene una tasa de fotogramas variable (no constante) empaquetado en un contenedor que tiene una tasa de fotogramas constante. Por ejemplo, el contenido original que tiene una tasa de fotogramas diferente, digamos, a 24, 30, 40, 60 o 120 fps, para diferentes escenas, puede empaquetarse en un contenedor que tenga una tasa de fotogramas constante de 120 fps. Para este ejemplo, cada fotograma de entrada se puede duplicar 5x, 4x, 3x, 2x o 1x veces para empaquetarlo en un contenedor común de 120 fps.

La figura 3 representa un ejemplo de una secuencia de vídeo de entrada A con tasa de fotogramas variable y ángulo de obturador variable que se representa en un flujo de bits codificado B con una tasa de fotogramas fija. Luego, en un decodificador, el decodificador reconstruye la secuencia de video de salida C a la tasa de fotogramas y al ángulo de obturador deseados, que pueden cambiar de una escena a otra. Por ejemplo, como se representa en la figura 3, para construir la secuencia B, algunos de los fotogramas de entrada se duplican, algunos se codifican tal cual (sin duplicación) y algunos se copian cuatro veces. Luego, para construir la secuencia C, se selecciona cualquier fotograma de cada conjunto de fotogramas duplicados para generar fotogramas de salida, que coincidan con la tasa de fotogramas y el ángulo de obturador originales.

En esta realización, los metadatos se insertan en el flujo de bits para indicar la tasa de fotogramas original (base) y el ángulo de obturador. Los metadatos pueden señalizarse usando sintaxis de alto nivel, como un conjunto de parámetros de secuencia (SPS), un conjunto de parámetros de imagen (PPS), un encabezado de grupo de sectores o mosaicos, y similares. La presencia de metadatos permite a los codificadores y decodificadores realizar funciones beneficiosas, como:

a) Un codificador puede ignorar fotogramas duplicados, aumentando así la velocidad de codificación y simplificando el procesamiento. Por ejemplo, todas las unidades de árbol de codificación (CTU) en fotogramas duplicados se pueden codificar usando el modo SKIP y el índice de referencia 0 en la LISTA 0 de los fotogramas de referencia, que se refiere a un fotograma decodificado desde el cual se copian los fotogramas duplicados.

b) Un decodificador puede pasar por alto la decodificación de fotogramas duplicados, simplificando así el procesamiento. Por ejemplo, los metadatos en el flujo de bits pueden indicar que un fotograma es un duplicado de un

fotograma previamente decodificado que el decodificador puede reproducir copiando y sin decodificar el nuevo fotograma.

c) Un dispositivo de reproducción puede optimizar el procesamiento descendente indicando la tasa de fotogramas base, por ejemplo, ajustando la conversión de tasa de fotogramas o los algoritmos de reducción de ruido.

Esta realización permite que un usuario final vea contenido renderizado a las tasas de fotogramas previstas por los creadores de contenido. Esta realización no proporciona compatibilidad con versiones anteriores con dispositivos que no admitan la tasa de fotogramas del contenedor, por ejemplo, 120 fps.

Las tablas 2 y 3 muestran una sintaxis de ejemplo de carga útil de secuencia de bytes sin procesar (RBSB) para un conjunto de parámetros de secuencia y un encabezado de grupo de mosaicos, donde los nuevos elementos de sintaxis propuestos se representan en una fuente resaltada. La sintaxis restante sigue la sintaxis de la memoria descriptiva propuesta del códec de video versátil (VVC) (Ref. [2]).

Como ejemplo, en SPS (consúltese la tabla 2), se puede agregar un indicador para habilitar la tasa de fotogramas variable.

sps_vfr_enabled_flag igual a 1 especifica que la secuencia de video codificada (CVS) puede tener contenido de tasa de fotogramas variable. sps_vfr_enabled_flag igual a 0 especifica que la CVS tiene contenido de tasa de fotogramas fija.

En el encabezado de tile_group() (consúltese la tabla 3),

tile_group_vrf_info_present_flag igual a 1 especifica los elementos de sintaxis tile_group_true_fr y tile_group_shutterangle que están presentes en la sintaxis. tile_group_vrf_info_present_flag igual a 0 especifica que los elementos de sintaxis tile_group_true_fr y tile_group_shutterangle no están presentes en la sintaxis.

Cuando tile_group_vrf_info_present_flag no está presente, se infiere que es 0.

tile_group_true_fr indica la tasa de fotogramas real de los datos de video transportados en este flujo de bits.

tile_group_shutterangle indica el ángulo de obturador correspondiente a la tasa de fotogramas real de los datos de video transportados en este flujo de bits.

tile_group_skip_flag igual a 1 especifica que el grupo de mosaicos actual se copia de otro grupo de mosaicos. tile_group_skip_flag igual a 0 especifica que el grupo de mosaicos actual no se copia de otro grupo de mosaicos.

tile_group_copy_pic_order_cnt_lsb especifica el módulo MaxPicOrderCntLsb de conteo de órdenes de imágenes para la imagen previamente decodificada de la cual se copia la imagen actual cuando tile_group_skip_flag se establece en 1.

Tabla 2: Sintaxis RBSP de conjunto de parámetros de ejemplo para contenido con tasa de fotogramas variable

Tabla 3: Ejemplo de sintaxis de encabezado de grupo de mosaico con soporte para contenido con tasa de fotogramas variable

Segunda Realización - Contenedor de tasa de fotogramas fija

La segunda realización permite el caso de uso en el que el contenido original que tiene una tasa de fotogramas fija y un ángulo de obturador puede reproducirse mediante un decodificador a una tasa de fotogramas alternativa y un ángulo de obturador simulado variable, tal como se ilustra en la figura 2. Por ejemplo, en el caso de que el contenido original tenga una tasa de fotogramas de 120 fps y un ángulo de obturador de 360 grados (lo que significa que el obturador está abierto 1/120 de segundo), un decodificador puede generar varias tasas de fotogramas inferiores o iguales a 120 fps Por ejemplo, como se describe en la tabla 1, para decodificar 24 fps con un ángulo de obturador simulado de 216 grados, el decodificador puede combinar tres fotogramas decodificados y mostrarlos a 24 fps. La tabla 4 amplía la tabla 1 e ilustra cómo combinar diferentes números de fotogramas codificados para renderizar a las tasas de fotogramas de destino de salida y los ángulos de obturador de destino deseados. La combinación de los fotogramas se puede realizar mediante un promedio de píxeles simple, mediante un promedio de píxeles ponderado, en el que los píxeles de un determinado fotograma se pueden ponderar más que los píxeles de otros fotogramas y la suma de todos los pesos da como resultado uno, o mediante otros esquemas de interpolación de filtros conocidos en la técnica. En la tabla 4, la función Ce(a,b) indica la combinación de fotogramas codificados a a b, donde la combinación se puede realizar por promedio, promedio ponderado, filtrado y similares.

Tabla 4: Ejemplo de combinación de fotogramas de entrada a 120 fps para generar fotogramas de salida a fps de destino valores del án ulo de obturador

Cuando el valor del ángulo de obturador de destino es inferior a 360 grados, el decodificador puede combinar diferentes conjuntos de fotogramas decodificados. Por ejemplo, de la tabla 1, dada una secuencia original de 120 fps a 360 grados, para generar una secuencia a 40 fps y un ángulo de obturador de 240 grados, un decodificador necesita combinar dos fotogramas de tres fotogramas posibles. Por lo tanto, puede combinar el primer y el segundo fotograma o el segundo y el tercer fotograma. La elección de qué fotogramas combinar puede describirse en términos de una "fase de decodificación" expresada como:

decode_phase = decode_phase_¡dx*(360/n_frames), (6)

donde decode_phase_idx indica el índice de desplazamiento dentro de un conjunto de fotogramas secuenciales que tienen valores de índice en [0, n_frames_max -1], donde n_frames viene dado por la ecuación (2), y

n_frames_max = orig_frame_rate/target_frame_rate. (7)

En general, decode_phase_idx oscila entre [0, n_frames_max-n_frames]. Por ejemplo, para una secuencia original a 120 fps y un ángulo de obturador de 360 grados, para la tasa de fotogramas de destino de 40 fps con un ángulo de obturador de 240 grados, n_frames_max = 120/40 = 3. A partir de la ecuación (2), n_frames = 2, por lo que decode_phase_idx oscila entre [0, 1]. Así, decode_phase_idx = 0 indica seleccionar fotogramas con índice 0 y 1, y decode_phase_idx = 1 indica seleccionar fotogramas con índice 1 y 2.

En esta realización, la tasa de fotogramas variable renderizada prevista por el creador de contenido puede señalarse como metadatos, como un mensaje de información de potenciación suplementaria (SEI) o como información de usabilidad de video (VUI). Opcionalmente, el receptor o un usuario pueden controlar la tasa de fotogramas renderizada. En la tabla 5 se muestra un ejemplo de mensajes SEI de conversión de tasa de fotogramas que especifica la tasa de

fotogramas preferida y el ángulo de obturador del creador de contenido. El mensaje SEI también puede indicar si la combinación de fotogramas se realiza en el dominio de señal codificada (por ejemplo, gamma, PQ, etc.) o en el dominio de luz lineal. Téngase en cuenta que el posprocesamiento requiere un búfer de fotograma además del búfer de imagen del decodificador (DPB). El mensaje SEI puede indicar cuántos búferes de fotogramas adicionales se necesitan, o algún método alternativo para combinar fotogramas. Por ejemplo, para reducir la complejidad, los fotogramas pueden recombinarse con una resolución espacial reducida.

Como se representa en la tabla 4, en ciertas combinaciones de tasas de fotogramas y ángulos de obturador (por ejemplo, a 30 fps y 360 grados o a 24 fps y 288 o 360 grados), un decodificador puede necesitar combinar más de tres fotogramas decodificados, lo que aumenta el número de espacio de búfer requerido por el decodificador. Para reducir la carga del espacio de búfer adicional en el decodificador, en algunas realizaciones, ciertas combinaciones de tasas de fotogramas y ángulos de obturador pueden estar fuera de los límites del conjunto de parámetros de decodificación permitidos (por ejemplo, estableciendo perfiles y niveles de codificación apropiados).

Considerando de nuevo, como ejemplo, el caso de reproducción a 24 fps, un decodificador puede decidir mostrar el mismo fotograma cinco veces para que se muestre a una tasa de fotogramas de salida de 120 fps. Esto es exactamente lo mismo que mostrar el fotograma una sola vez a una tasa de fotogramas de salida de 24 fps. La ventaja de mantener una tasa de fotogramas de salida constante es que una pantalla puede funcionar a una velocidad de reloj constante, lo que hace que todo el hardware sea mucho más simple. Si la pantalla puede variar dinámicamente la velocidad del reloj, entonces puede tener más sentido mostrar el fotograma solo una vez (durante 1/24 de segundo), en lugar de repetir el mismo fotograma cinco veces (cada 1/120 de segundo). El primer enfoque puede dar como resultado una calidad de imagen ligeramente superior, una mejor eficiencia óptica o una mejor eficiencia energética. Consideraciones similares también son aplicables a otras tasas de fotogramas.

La tabla 5 representa un ejemplo de una sintaxis de mensajes SEI de conversión de tasa de fotogramas de acuerdo con una realización.

Tabla 5: Ejemplo de sintaxis de mensaje SEI que permite la conversión de tasa de fotogramas

framerate_conversion_cancel_flag igual a 1 indica que el mensaje SEI cancela la persistencia de cualquier mensaje SEI de conversión de tasa de fotogramas anterior en el orden de salida. framerate_conversion_cancel_flag igual a 0 indica que sigue la información de conversión de tasa de fotogramas.

base_frame_rate especifica la tasa de fotogramas deseada.

base_shutter_angle especifica el ángulo de obturador deseado.

decode_phase_idx_present_flag igual a 1 especifica que la información de la fase de decodificación está presente. decode_phase_idx_present_flag igual a 0 especifica que la información de la fase de decodificación no está presente.

decode_phase_idx indica el índice de desplazamiento dentro de un conjunto de fotogramas secuenciales que tienen valores de índice 0..(n_frames_max-1) donde n_frames_max = 120/base_frame_rate. El valor de decode_phase_idx estará en el rango de 0..(n_frames_max-n_frames), donde n_frames = base_shutter_angle/(3*base_frame_rate). Cuando decode_phase_idx no está presente, se infiere que es 0.

conversion_domain_idc igual a 0 especifica que la combinación de fotogramas se realiza en un dominio lineal. conversion_domain_idc igual a 1 especifica que la combinación de fotogramas se realiza en un dominio no lineal.

num_frame_buffers especifica el número adicional de búferes de fotogramas (sin contar DPB).

framerate_conversion_persistence_flag especifica la persistencia del mensaje SEI de conversión de tasa de fotogramas para la capa actual. framerate_conversion_persistence_flag igual a 0 especifica que el mensaje SEI de conversión de tasa de fotogramas se aplica únicamente a la imagen decodificada actual. Sea picA la imagen actual. framerate_conversion_persistence_flag igual a 1 especifica que el mensaje SEI de conversión de tasa de fotogramas persiste para la capa actual en el orden de salida hasta que una o más de las siguientes condiciones sean verdaderas:

- Comienza una nueva secuencia de vídeo codificada por capas (CLVS) de la capa actual.

- El flujo de bits termina.

- Se emite una imagen picB en la capa actual en una unidad de acceso que contiene un mensaje SEI de conversión de tasa de fotogramas aplicable a la capa actual para la que PicOrderCnt( picB ) es mayor que PicOrderCnt( picA ), donde PicOrderCnt( picB ) y PicOrderCnt( picA ) son los valores PicOrderCntVal de picB y picA, respectivamente, inmediatamente después de la invocación del proceso de decodificación para el recuento del orden de imágenes para picB.

Tercera realización - Entrada codificada en múltiples ángulos de obturador

Una tercera realización es un esquema de codificación que permite la extracción de tasas de subfotogramas del flujo de bits, admitiendo así la compatibilidad con versiones anteriores. En HEVC, esto se logra mediante la escalabilidad temporal. La escalabilidad de capa temporal se habilita mediante la asignación de diferentes valores a un elemento de sintaxis temporal_id para los fotogramas decodificados. De este modo, el flujo de bits puede extraerse simplemente sobre la base de los valores de temporal_id. Sin embargo, el enfoque de estilo HEVC para la escalabilidad temporal no permite renderizar tasas de fotogramas de salida con diferentes ángulos de obturador. Por ejemplo, una tasa de fotogramas base de 60 fps extraída de un original de 120 fps siempre tendrá un ángulo de obturador de 180 grados.

En ATSC 3.0, se describe un método alternativo en el que los fotogramas a 60 fps con ángulos de obturador de 360 grados se emulan como un promedio ponderado de dos fotogramas de 120 fps. A los fotogramas de 60 fps emulados se les asigna un valor de temporal_id de 0 y se combinan con fotogramas originales alternativos de 120 fps a los que se les asigna un valor de temporal_id de 1. Cuando se necesitan 60 fps, el decodificador solo necesita decodificar fotogramas con temporal_id 0. Cuando se necesitan 120 fps, el decodificador puede restar cada temporal_id = 1 fotograma (es decir, un fotograma de 120 fps) de una versión escalada de cada temporal_id = 0 fotogramas correspondiente (es decir, fotograma de 60 fps emulado) para recuperar el correspondiente fotograma original de 120 fps que no se transmitió explícitamente, reconstituyendo así todos los fotogramas originales de 120 fps.

En las realizaciones de esta invención, se describe un nuevo algoritmo que admite múltiples tasas de fotogramas de destino y ángulos de obturador de destino de una manera que es compatible con versiones anteriores (BC). La propuesta es preprocesar el contenido original de 120 fps a una tasa de fotogramas base en varios ángulos de obturador. Luego, en el decodificador, otras tasas de fotogramas en varios ángulos de obturador pueden derivarse simplemente. El enfoque ATSC 3.0 se puede considerar como un caso especial del esquema propuesto, donde los fotogramas con temporal_id=0 llevan fotogramas con un ángulo de obturador de 60 fps@360 y los fotogramas con temporal_id=1 llevan fotogramas con un ángulo de obturador de 60 fps@180.

Como primer ejemplo, como se representa en la figura 4, considere una secuencia de entrada a 120 fps y un ángulo de obturador de 360 que se usa para codificar una secuencia con una tasa de fotogramas de capa base de 40 fps y ángulos de obturador a 120, 240 y 360 grados. En este esquema, el codificador calcula nuevos fotogramas combinando hasta tres de los fotogramas de entrada originales. Por ejemplo, el fotograma codificado 2 (En-2) que representa la entrada a 40 fps y 240 grados se genera al combinar los fotogramas de entrada 1 y 2, y el fotograma codificado 3 (En-3) que representa la entrada a 40 fps y 360 grados se genera combinando el fotograma En-2 con el fotograma de entrada 3. En el decodificador, para reconstruir la secuencia de entrada, el fotograma decodificado 2 (Dec-2) se genera restando el fotograma En-1 del fotograma En-2, y el fotograma decodificado 3 (Dec-3) se genera restando el fotograma En-2 de fotograma En-3. Los tres fotogramas decodificados representan una salida a una tasa de fotogramas base de 120 fps y un ángulo de obturador de 360 grados. Se pueden extrapolar tasas de fotograma y ángulos de obturador adicionales usando los fotogramas decodificados, como se muestra en la tabla 6. En la tabla 6,

la función Cs(a,b) denota la combinación de fotogramas de entrada a a b, donde la combinación se puede realizar promediando, promediando ponderadamente, filtrando y similares.

T l : E m l m in i n f r m n n lín 4 f

Una ventaja de este enfoque es que, como se representa en la tabla 6, todas las versiones de 40 fps se pueden decodificar sin ningún procesamiento adicional. Otra ventaja es que se pueden derivar otras tasas de fotograma en varios ángulos de obturador. Por ejemplo, considere un decodificador que decodifica a 30 fps y un ángulo de obturador de 360. De la tabla 4, la salida corresponde a la secuencia de fotogramas generada por Ce(1,4) = Cs(1,4), Cs(5,8), Cs(9,12) y similares, que coincide con la decodificación secuencia representada también en la tabla 6; sin embargo, en la tabla 6, Cs(5,8) = e6-e4+e8. En una realización, se pueden usar tablas de consulta (LUT) para definir cómo deben combinarse los fotogramas decodificados para generar una secuencia de salida a la tasa de fotogramas de salida especificada y el ángulo de obturador emulado.

En otro ejemplo, se propone combinar hasta cinco fotogramas en el codificador para simplificar la extracción de la capa base de 24 fps en ángulos de obturador de 72, 144, 216, 288 y 360 grados, como se muestra a continuación. Esto es conveniente para el contenido de películas que se presenta mejor a 24 fps en televisores heredados.

Tabla 7: Eem lo de combinación de foto ramas con una línea de base de 24 f s

Como se muestra en la tabla 7, si la tasa de fotogramas de decodificación coincide con la tasa de fotogramas de referencia (24 fps), entonces, en cada grupo de cinco fotogramas (por ejemplo, e1 a e5), un decodificador puede simplemente seleccionar el fotograma en el ángulo de obturador deseado (por ejemplo, e2 para un ángulo de obturador de 144 grados). Para decodificar a una tasa de fotogramas diferente y un ángulo de obturador específico, el decodificador deberá determinar cómo combinar correctamente (digamos, por suma o resta) los fotogramas decodificados. Por ejemplo, para decodificar a 30 fps y un ángulo de obturador de 180 grados, se pueden seguir los siguientes pasos:

a) El decodificador puede considerar un codificador hipotético que transmite a 120 fps y 360 grados sin tener en cuenta la compatibilidad con versiones anteriores, luego, de la tabla 1, el decodificador necesita combinar 2 de 4 fotogramas para generar la secuencia de salida a la tasa de fotogramas deseada y ángulo de obturador. Por ejemplo, como se

muestra en la tabla 4, la secuencia incluye, Ce(1,2) = Avg(sl, s2), Ce(5,6) = Avg(s5, s6) y similares, donde Avg(sl, s2) puede indicar el promedio de fotogramas s i y s2.

b) Dado que, por definición, los fotogramas codificados se pueden expresar como e l = s i, e2 = Avg(sl, s2), e3 = Avg(sl, s3) y similares, se puede deducir fácilmente que la secuencia de fotogramas en el paso a) también se puede expresar como:

• Ce(1,2) = Avg(sl,s2) = e2

• Ce(5,6) = Avg (s5,s6) = Avg(sl,s5) - Avg(sl,s4) s6 = e5-e4+e6

• etc.

Como antes, la combinación adecuada de fotogramas decodificados se puede precalcular y estar disponible como LUT.

Una ventaja del método propuesto es que brinda opciones tanto para los creadores de contenido como para los usuarios; es decir, permite la elección de director/editorial y la elección del usuario. Por ejemplo, el preprocesamiento del contenido en el codificador permite crear una tasa de fotogramas base con varios ángulos de obturador. A cada ángulo de obturador se le puede asignar un valor temporal_id en el rango [0, (n_frames -1)], donde n_frames tiene un valor igual a 120 dividido por la tasa de fotogramas base. (Por ejemplo, para una tasa de fotogramas base de 24 fps, temporal_id está en el rango [0,4]). La elección puede hacerse para optimizar la eficiencia de compresión, o por razones estéticas. En algunos casos de uso, digamos, para la transmisión superior, se pueden codificar y almacenar múltiples flujos de bits con diferentes capas base y ofrecerlos a los usuarios para que los seleccionen.

En un segundo ejemplo de los métodos divulgados, se pueden admitir múltiples tasas de fotogramas compatibles con versiones anteriores. Idealmente, es posible que desee poder decodificar a 24 fotogramas por segundo para obtener una capa base de 24 fps, a 30 fotogramas por segundo para obtener una secuencia de 30 fps, a 60 fotogramas por segundo para obtener una secuencia de 60 fps, y similares. Si no se especifica un ángulo de obturador de destino, se recomienda un ángulo de obturador de destino predeterminado, entre los ángulos de obturador permitidos para las tasas de fotograma de origen y de destino, lo más cerca posible de 180 grados. Por ejemplo, para los valores representados en la tabla 7, los ángulos de obturador de destino preferidos para fps a 120, 60, 40, 30 y 24 son 360, 180, 120, 180 y 216 grados.

A partir de los ejemplos anteriores, se puede observar que la elección de cómo codificar el contenido puede influir en la complejidad de decodificar tasas de fotograma de capa base específicas. Una realización de esta invención consiste en elegir de forma adaptativa el esquema de codificación en función de la tasa de fotogramas de la capa base deseada. Para contenido de películas, esto puede ser de 24 fps, por ejemplo, mientras que para deportes puede ser de 60 fps.

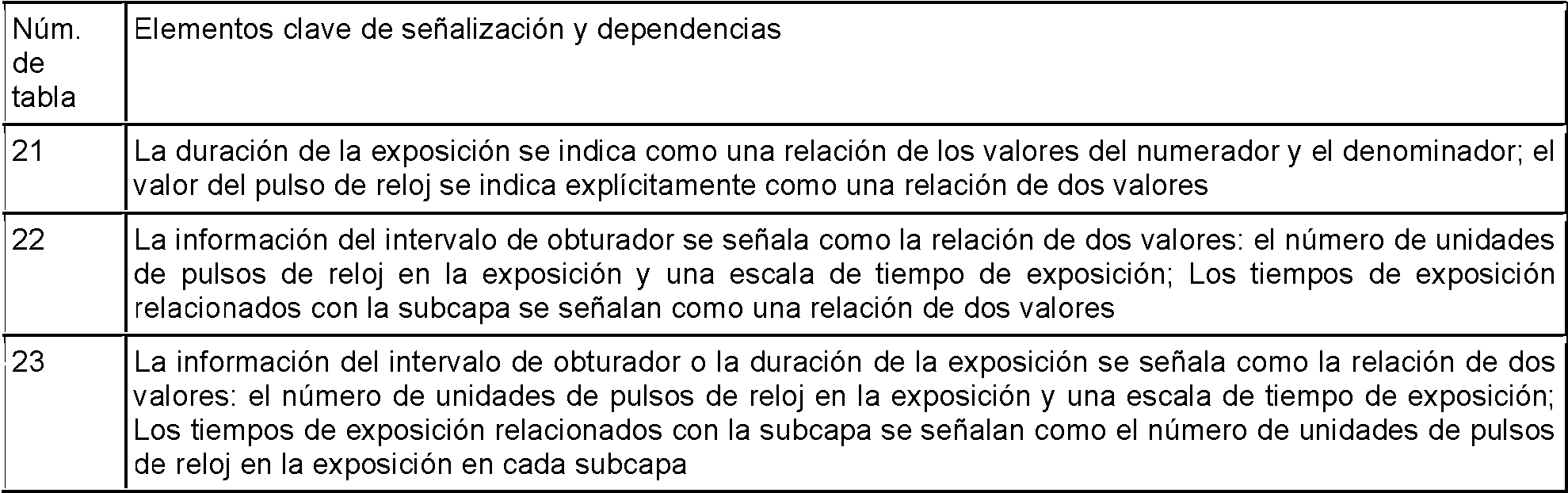

La sintaxis de ejemplo para la realización BC de la presente invención se muestra a continuación y en las tablas 8 y 9.

En SPS (tabla 8), se agregan dos elementos de sintaxis: sps_hfr_BC_enabled_flag y sps_base_framerate (si sps_hfr_BC_enabled_flag se establece en 1).

sps_hfr_BC_enabled_flag igual a 1 especifica que la alta tasa de fotogramas con compatibilidad con versiones anteriores está habilitada en la secuencia de video codificada (CVS). sps_hfr_BC_enabled_flag igual a 0 especifica que la tasa de fotogramas alta con compatibilidad con versiones anteriores no está habilitada en la CVS.

sps_base_framerate especifica la tasa de fotogramas base para la CVS actual.

En el encabezado del grupo de mosaicos, si sps_hfr_BC_enabled_flag se establece en 1, la sintaxis number_avg_frames se envía en el flujo de bits.

[0064]

number_avg_frames especifica el número de fotogramas a la tasa de fotogramas más alta (por ejemplo, 120 fps) que se combinan para generar la imagen actual a la tasa de fotogramas base.

Tabla 8: Sintaxis RBSP de ejemplo para entrada en varios ángulos de obturador

Tabla 9: Sintaxis RBSB de conjunto de parámetros de imagen de ejemplo para entrada en varios ángulos de obturador

Variaciones en la segunda realización (tasa de fotogramas fija)

El estándar de codificación HEVC (H.265) (Ref. [1]) y el estándar de codificación de video versátil en desarrollo (comúnmente conocido como VVC, consúltese Ref. [2]), definen un elemento de sintaxis, pic_struct, que indica si una imagen debe mostrarse como un fotograma o como uno o más campos, y si una imagen decodificada debe repetirse. Se proporciona una

Apéndice.

Es importante tener en cuenta que, como aprecian los inventores, el elemento de sintaxis pic_struct existente puede admitir solo un subconjunto específico de tasas de fotogramas de contenido cuando se usa un contenedor de codificación de tasa de fotogramas fija. Por ejemplo, cuando se usa un contenedor de tasa de fotogramas fija de 60 fps, la sintaxis pic_struct existente, cuando fixed_pic_rate_within_cvs_flag es igual a 1, puede admitir 30 fps mediante la duplicación de fotogramas y 24 fps mediante la duplicación y triplicación de fotogramas en combinación alterna en cada otro fotograma. Sin embargo, cuando se usa un contenedor de tasa de fotogramas fija de 120 fps, la sintaxis pic_struct actual no admite tasas de fotogramas de 24 fps ni 30 fps. Para paliar este problema, se proponen dos nuevos métodos: uno es una extensión de la versión HEVC y el otro no.

Método 1: pic_struct sin compatibilidad con versiones anteriores

VVC aún está en desarrollo, por lo que se puede diseñar la sintaxis con la máxima libertad. En una realización, en pic_struct, se propone eliminar las opciones para duplicar y triplicar fotogramas, usar un valor específico de pic_struct para indicar la repetición arbitraria de fotogramas y agregar un nuevo elemento de sintaxis, num_frame_repetition_minus2, que especifica el número de fotogramas a repetir. Un ejemplo de la sintaxis propuesta se describe en las siguientes tablas, donde la tabla 10 denota cambios sobre la tabla D.2.3 en HEVC y la tabla 11 denota cambios de la tabla D.2 que se muestra en el apéndice.

Tabla 10: Sintaxis de mensaje SEI de temporización de imagen de ejemplo, método 1

num_frame_repetition_minus2 más 2 indica que cuando fixed_pic_rate_within_cvs_flag es igual a 1, el fotograma debe mostrarse num_frame_repetition_minus2 más 2 veces consecutivas en pantallas con un intervalo de actualización de fotograma igual a DpbOutputElementalInterval[ n ] como se indica en la ecuación E-73.

Tabla 11: Eem lo de ic struct revisado de acuerdo con el método 1

Método 2: versión extendida de la versión HEVC de pic_struct

Los decodificadores AVC y HEVC ya están implementados, por lo que es posible que desee simplemente ampliar la sintaxis pic_struct existente sin eliminar las opciones antiguas. En una realización, se añaden un nuevo pic_struct = 13, valor de "extensión de repetición de fotograma", y un nuevo elemento de sintaxis, num_frame_repetition_minus4. Un ejemplo de la sintaxis propuesta se describe en las tablas 12 y 13. Para los valores de pic_struct 0-12, la sintaxis propuesta es idéntica a la de la tabla D.2 (como se muestra en el Apéndice), por lo que esos valores se omiten por simplicidad.

Tabla 12: Sintaxis de mensaje SEI de temporización de imagen de ejemplo, método 2

num_frame_repetition_minus4 más 4 indica que cuando fixed_pic_rate_within_cvs_flag es igual a 1, el fotograma debe mostrarse num_frame_repetition_minus4 más 4 veces consecutivas en pantallas con un intervalo de actualización de fotograma igual a DpbOutputElementalInterval[ n ] como se indica en la ecuación E-73.

T l 1 : E m l i r r vi m 2

En HEVC, el parámetro frame_field_info_present_flag está presente en la información de usabilidad del video (VUI), pero los elementos de sintaxis pic_struct, source_scan_type y duplicate_flag están en el mensaje SEI pic_timing(). En una realización, se propone mover todos los elementos de sintaxis relacionados a VUI, junto con frame_field_info_present_flag. En la tabla 14 se representa un ejemplo de la sintaxis propuesta.

Tabla 14: Sintaxis de parámetros VUI de ejemplo con soporte para el elemento de sintaxis pic_struct revisado

Señalización alternativa de la información del ángulo de obturador

Cuando se trata de tasa de fotogramas variable, es deseable identificar tanto la tasa de fotogramas deseada como el ángulo de obturador deseado. En los estándares de codificación de video anteriores, la "información de usabilidad de video" (VUI) proporciona información esencial para la visualización adecuada del contenido de video, como la relación de aspecto, los colores primarios, el submuestreo de croma, etc. VUI también puede proporcionar información sobre la tasa de fotogramas si la velocidad de imagen fija se establece en 1; sin embargo, no hay soporte para la información del ángulo de obturador. Las realizaciones permiten que se usen diferentes ángulos de obturador para diferentes capas temporales, y un decodificador puede usar información del ángulo de obturador para mejorar el aspecto final en la pantalla.

Por ejemplo, HEVC admite subcapas temporales que esencialmente usan técnicas de caída de fotogramas para pasar de una tasa de fotogramas más alta a una tasa de fotogramas más baja. El principal problema con esto es que el ángulo de obturador efectivo se reduce con cada caída de fotograma. Como ejemplo, se pueden derivar 60 fps de un video de 120 fps eliminando fotogramas alternos; se pueden obtener 30 fps eliminando 3 de 4 fotogramas; y se pueden obtener 24 fps eliminando 4 de 5 fotogramas. Suponiendo un obturador completo de 360 grados para 120 Hz, con una simple caída de fotogramas, los ángulos de obturador para 60 fps, 30 fps y 24 fps son 180, 90 y 72 grados, respectivamente [3]. La experiencia ha demostrado que los ángulos de obturador por debajo de 180 grados son generalmente inaceptables, especialmente con tasas de fotogramas por debajo de 50 Hz. Al proporcionar información sobre el ángulo de obturador, por ejemplo, si se desea que una pantalla produzca un efecto cinematográfico a partir de un video de 120 Hz con un ángulo de obturador reducido para cada capa temporal, se pueden aplicar técnicas inteligentes para mejorar el aspecto final.

En otro ejemplo, es posible que desee admitir una capa temporal diferente (por ejemplo, un flujo de bits secundario de 60 fps dentro de un flujo de bits de 120 fps) con el mismo ángulo de obturador. Entonces, el principal problema es que cuando se muestra un video de 120 fps a 120 Hz, los fotogramas pares/impares tienen un ángulo de obturador efectivo diferente. Si una pantalla tiene la información relacionada, se pueden aplicar técnicas inteligentes para mejorar el aspecto final. Un ejemplo de la sintaxis propuesta se muestra en la tabla 15, donde la tabla de sintaxis de parámetros VUI E.2.1 en HEVc (Ref. [1]) se modifica para admitir la información del ángulo de obturador como se indica. Obsérvese que en otra realización, en lugar de expresar la sintaxis de shutter_angle en grados absolutos, puede expresarse alternativamente como una proporción de la tasa de fotogramas sobre la velocidad del obturador (véase la ecuación (1)).

Tabla 15: Sintaxis de parámetro VUI de ejemplo con soporte del ángulo de obturador

vui_shutter_angle_info_present_flag igual a 1 especifica que la información del ángulo de obturador está presente en la estructura de sintaxis vui_parameters(). vui_shutter_angle_info_present_flag igual a 0 especifica que la información del ángulo de obturador no está presente en la estructura de sintaxis de vui_parameters().

fixed_shutter_angle_within_cvs_flag igual a 1 especifica que la información del ángulo de obturador es la misma para todas las subcapas temporales en la CVS. fixed_shutter_angle_within_cvs_flag igual a 0 especifica que la información del ángulo de obturador puede no ser la misma para todas las subcapas temporales en la CVS.

fixed_shutter_angle especifica el ángulo de obturador en grados dentro de una CVS. El valor de fixed_shutter_angle estará en el rango de 0 a 360.

sub_layer_shutter_angle[ i ] especifica el ángulo de obturador en grados cuando HighestTid es igual a i. El valor de sub_layer_shutter_angle[ i ] estará en el rango de 0 a 360.

Actualización gradual de la tasa de fotogramas dentro de una secuencia de video codificada (CVS)

Los experimentos han demostrado que para el contenido HDR que se muestra en una pantalla HDR, para percibir la misma vibración de movimiento que la reproducción de rango dinámico estándar (SDR) en una pantalla de 100 nits, la tasa de fotogramas debe aumentarse en función del brillo del contenido. En la mayoría de los estándares (AVC, HEVC, VVC, etc.), la tasa de fotogramas del video se puede indicar en la VUI (contenida en SPS) usando los elementos de sintaxis vui_time_scale, vui_num_units_in_tick y elemental_duration_in_tc_minusl[temporal_id_max], por ejemplo, como se muestra en la tabla 16 a continuación (consúltese la Sección E.2.1 en la Ref. [1]).

Tabla 16: Elementos de sintaxis VUI para indicar la tasa de fotogramas en HEVC

Como se explicó en la Ref. [1],

La variable ClockTick se deriva de la siguiente manera y se denomina pulso de reloj:

ClockTick = vui_nuin_units_in_tick -r vui_time_scale

picture_duration = ClockTick * ( elemental_duration_¡n_tc_minusl[ i ] 1 )

frame_rate = l/pic_duration.

Sin embargo, la tasa de fotogramas solo se puede cambiar en instantes de tiempo específicos, por ejemplo, en HEVC, solo en fotogramas de punto de acceso intraaleatorio (IRAP) o al comienzo de una nueva CVS. Para la reproducción HDR, cuando hay un caso de aparición o desaparición gradual, debido a que el brillo de una imagen cambia fotograma por fotograma, es posible que sea necesario cambiar la tasa de fotogramas o la duración de la imagen para cada imagen. Para permitir la actualización de la tasa de fotogramas o la duración de la imagen en cualquier momento (incluso fotograma por fotograma), en una realización, se propone un nuevo mensaje SEI para "tasa de actualización gradual", como se muestra en la tabla 17.

Tabla 17: Sintaxis de eem lo ara admitir la tasa de foto ramas de actualización radual en los mensajes SEI

La definición de la nueva sintaxis num_units_in_tick es la misma que vui_num_units_in_tick, y la definición de time_scale es la misma que la de vui_time_scale.

num_units_in_tick es el número de unidades de tiempo de un reloj que funciona a la frecuencia time_scale Hz que corresponde a un incremento (llamado un pulso de reloj) de un contador de pulsos de reloj. num_units_in_tick debe ser mayor que 0. Un pulso de reloj, en unidades de segundos, es igual al cociente de num_units_in_tick dividido por time_scale. Por ejemplo, cuando la tasa de imagen de una señal de vídeo es de 25 Hz, la escala de tiempo puede ser igual a 27000000 y num_units_in_tick puede ser igual a 1080 000 y, en consecuencia, un pulso de reloj puede ser igual a 0,04 segundos.

time_scale es el número de unidades de tiempo que pasan en un segundo. Por ejemplo, un sistema de coordenadas de tiempo que mide el tiempo usando un reloj de 27 MHz tiene una escala de tiempo de 27 000 000. El valor de time_scale debe ser mayor que 0.

El tiempo de duración de la imagen para la imagen que usa el mensaje SEI gradual_refresh_rate se define como:

picturc_duration = num_units_in_tick 4- timc_scale.

Señalización de la información del ángulo de obturador a través de mensajes SEI

Como se explicó anteriormente, la tabla 15 proporciona un ejemplo de sintaxis de parámetros VUI con soporte del ángulo de obturador. Como ejemplo, y sin limitación, la tabla 18 enumera elementos de sintaxis idénticos, pero ahora como parte de un mensaje SEI para información del ángulo de obturador. Téngase en cuenta que los mensajes SEI se usan solo como ejemplo y que se pueden construir mensajes similares en otras capas de sintaxis de alto nivel, como el conjunto de parámetros de secuencia (SPS), el conjunto de parámetros de imagen (PPS), el encabezado de grupo de sectores o mosaicos, y similares.

Tabla 18: Ejemplo de sintaxis de mensaje SEI para información del ángulo de obturador

El ángulo de obturador se expresa típicamente en grados de 0 a 360 grados. Por ejemplo, un ángulo de obturador de 180 grados indica que la duración de la exposición es la mitad de la duración del fotograma. El ángulo de obturador se puede expresar como: shutter_angle = frame_rate * 360*shutter_speed, donde shutter_speed es la duración de la exposición y frame_rate es la inversa de la duración del fotograma. frame_rate para la subcapa temporal dada Tid puede indicarse mediante num_units_in_tick, time_scale , elemental_duration_in_tc_minusl[Tid]. Por ejemplo, cuando fixed_pic_rate_within_cvs_flag[ Tid ] es igual a 1:

frame_rate = lime_scale / ( num_units_in_tick * (elemental_duration_in_tc_minus 1 [Tid] 1

) ) •

En algunas realizaciones, el valor del ángulo de obturador (por ejemplo, fixed_shutter_angle) puede no ser un número entero, por ejemplo, puede ser 135,75 grados. Para permitir una mayor precisión, en la tabla 21, se puede reemplazar u(9) (9 bits sin signo) con u(16) o alguna otra profundidad de bits adecuada (por ejemplo, 12 bits, 14 bits o más de 16 bits).

En algunas realizaciones, puede ser beneficioso expresar la información del ángulo de obturador en términos de "pulsos de reloj". En VVC, la variable ClockTick se deriva de la siguiente manera:

ClockTick = num units in tick -r time scale (8)

Luego, se puede expresar tanto la duración del fotograma como la duración de la exposición como múltiplos o fracciones de pulsos de reloj:

donde fN y fM son valores de coma flotante y fN < fM.

Luego,

sliuUer_angle = frame_rate * 360*shulter_speed =

= (l/frame_duration)sl=360*exposure_duration = (11) =(exposure_riuration*360)/fratne_riuration = =(fN*ClockTick*360)/(íM*ClockTick) =

- (fN/fM ) * 360 =(Numerador/Denom¡nador) * 360,

donde Numerador y Denominador son números enteros que se aproximan a la relación fN/fM.

La tabla 19 muestra un ejemplo de mensajes SEI indicados por la ecuación (11). En este ejemplo, el ángulo de obturador debe ser mayor que 0 para una cámara del mundo real.

Tabla 19: Ejemplo de mensajes SEI para información del ángulo de obturador en función de los pulsos del reloj

Como se explicó anteriormente, el uso de u(16) (16 bits sin signo) para la precisión del ángulo de obturador se representa como un ejemplo y corresponde a una precisión de: 360/216 = 0,0055. La precisión se puede ajustar en función de aplicaciones reales. Por ejemplo, usando u(8), la precisión es 360/28 = 1,4063.

NOTA: el ángulo de obturador se expresa en grados mayores que 0 pero menores o iguales a 360 grados. Por ejemplo, un ángulo de obturador de 180 grados indica que la duración de la exposición es la mitad de la duración del fotograma.

fixed_shutter_angle_within_cvs_flag igual a 1 especifica que el valor del ángulo de obturador es el mismo para todas las subcapas temporales en la CVS. fixed_shutter_angle_within_cvs_flag igual a 0 especifica que el valor del ángulo de obturador puede no ser el mismo para todas las subcapas temporales en la CVS.

fixed_shutter_angle_numer_minus1 más 1 especifica el numerador usado para derivar el valor del ángulo de obturador. El valor de fixed_shutter_angle_numer_minus1 estará en el rango de 0 a 65535, inclusive.

fixed_shutter_angle_demom_minus1 más 1 especifica el denominador usado para derivar el valor del ángulo de obturador. El valor de fixed_shutter_angle_demom_minus1 estará en el rango de 0 a 65535, inclusive.

El valor de fixed_shutter_angle_numer_minus1 será menor o igual que el valor de fixed_shutter_angle_demom_minus1.

La variable shutterAngle en grados se deriva de la siguiente manera:

shuttcrAngle = 360 * (fixcd_shuttcr_angle_numer_minusl

1) -f (fixcd_shutter_angle_dcmom_m inusl 1))

sub_layer_shutter_angle_numer_minus1[ i ] más 1 especifica el numerador usado para derivar el valor del ángulo de obturador cuando HighestTid es igual a i. El valor de sub_layer_shutter_angle_numer_minus1[ i ] estará en el rango de 0 a 65535, inclusive.

sub_layer_shutter_angle_demom_minus1[ i ] más 1 especifica el denominador usado para derivar el valor del ángulo de obturador cuando HighestTid es igual a i. El valor de sub_layer_shutter_angle_demom_minus1[ i ] estará en el rango de 0 a 65535, inclusive.

El valor de sub_layer_shutter_angle_numer_minus1[ i ] será menor o igual que el valor de sub_layer_shutter_angle_denom_minus1[ i ].

La variable subLayerShutterAngle[ i ] en grados se deriva de la siguiente manera:

subLayerShutterAngle[ i ] = 360 *

(sub_layer_shutter_angle_numer_minusl[ i ] 1) 4-(sub_layer_shutter_angle_demom_minus 1 [ i

J l)

En otra realización, la duración del fotograma (por ejemplo, frame_duration) puede especificarse por algún otro medio. Por ejemplo, en DVB/ATSC, cuando fixed_pic_rate_within_cvs_flag[ Tid ] es igual a 1:

frame_rate = time_scale / ( num_units_in_tick * (elcmcntal_duration_in_tc_minusl [Tid] 1 )) ,

frame_duration = 1 / frame_rate.

La sintaxis en la tabla 19 y en algunas de las tablas posteriores asume que el ángulo de obturador siempre será mayor que cero; sin embargo, el ángulo de obturador = 0 se puede usar para indicar una intención creativa en la que el contenido debe mostrarse sin desenfoque de movimiento. Tal podría ser el caso de gráficos en movimiento, animación, texturas CGI y pantallas mate, etc. Como tal, por ejemplo, señalar el ángulo de obturador = 0 podría ser útil para la decisión de modo en un transcodificador (por ejemplo, para seleccionar modos de transcodificación que conservan los bordes), así como en una pantalla que recibe los metadatos del ángulo de obturador a través de una interfaz CTA o una interfaz 3GPP. Por ejemplo, el ángulo de obturador = 0 podría usarse para indicar a una pantalla que no debe realizar ningún procesamiento de movimiento, como eliminación de ruido, interpolación de fotogramas y similares. En tal realización, los elementos sintácticos fixed_shutter_angle_numer_minus1 y sub_layer_shutter_angle_numer_minus1[ i ] pueden ser reemplazados por los elementos sintácticos fixed_shutter_angle_numer y sub_layer_shutter_angle_numer[i], donde fixed_shutter_angle_numer especifica el numerador usado para derivar el valor del ángulo de obturador. El valor de fixed_shutter_angle_numer estará en el rango de 0 a 65535, inclusive.

sub_layer_shutter_angle_numer[ i ] especifica el numerador usado para derivar el valor del ángulo de obturador cuando HighestTid es igual a i. El valor de sub_layer_shutter_angle_numer[ i ] estará en el rango de 0 a 65535, inclusive.

En otra realización, fixed_shutter_angle_denom_minus1 y sub_layer_shutter_angle_denom_minus1[i] también pueden ser reemplazados por los elementos sintácticos fixed_shutter_angle_denom y sub_layer_shutter_angle_denom[i] además.

En una realización, como se muestra en la tabla 20, se puede reutilizar la sintaxis num_units_in_tick y time_scale definida en SPS estableciendo general_hrd_parameters_present_flag igual a 1 en VVC. En este escenario, el mensaje SEI se puede renombrar como mensaje SEI de duración de exposición.

Tabla 20: Ejemplo de mensajes SEI para señalar la duración de la exposición

fixed_exposure_duration_within_cvs_flag igual a 1 especifica que el valor de duración de exposición efectiva es el mismo para todas las subcapas temporales en la CVS.

fixed_exposure_duration_within_cvs_flag igual a 0 especifica que el valor de duración de exposición efectiva puede no ser el mismo para todas las subcapas temporales en la CVS.

fixed_exposure_duration_numer_minus1 más 1 especifica el numerador usado para derivar el valor de duración de la exposición. El valor de fixed_exposure_duration_numer_minus1 estará en el rango de 0 a 65535, inclusive. fixed_exposure_duration_demom_minus1 más 1 especifica el denominador usado para derivar el valor de duración de la exposición. El valor de fixed_exposure_duration_demom_minus1 estará en el rango de 0 a 65535, inclusive. El valor de fixed_exposure_during_numer_minus1 será menor o igual que el valor de fixed_exposure_duration_demom_minus1.

La variable fixedExposureDuration se deriva de la siguiente manera:

fixedExposurcDuration = ( fíxed_exposure_duration_numer_minusl 1 ) ( fixed_exposure_duration_dcmom_minus1 1 ) * ClockTicks sub_layer_exposure_duration_numer_minus1[ i ] más 1 especifica el numerador usado para derivar el valor de duración de la exposición cuando HighestTid es igual a i. El valor de sub_layer_exposure_duration_numer_minus1[ i ] estará en el rango de 0 a 65535, inclusive.

sub_layer_exposure_duration_demom_minus1[ i ] más 1 especifica el denominador usado para derivar el valor de duración de la exposición cuando HighestTid es igual a i. El valor de sub_layer_exposure_duration_demom_minus1[ i ] estará en el rango de 0 a 65535, inclusive.

El valor de sub_layer_exposure_duration_numer_minus1[ i ] será menor o igual que el valor de sub_layer_exposure_duration_demom_minus1[ i ].

La variable subLayerExposureDuration[ i ] para HigestTid igual a i se deriva de la siguiente manera:

subLaycrExposurcDuralionf i ] = ( sub_layer_exposure_duration_numer_minusl[ i 1 1

) -j-( sub_layer_exposure_duration_demoni_minusl[ i J 1 ) * ClockTicks.

En otra realización, como se muestra en la tabla 21, se puede definir explícitamente clockTick mediante los elementos de sintaxis expo_num_units_in_tick y expo_time_scale. La ventaja aquí es que no depende de si general_hrd_parameters_present_flag se establece igual a 1 en VVC como la realización anterior, luego

clockTick = expo_num_units_in_tick -f expo_time_scale . (12)

Tabla 21: Ejemplo de mensajes SEI para la señalización del tiempo de exposición

expo_num_units_in_tick es el número de unidades de tiempo de un reloj que funciona a la frecuencia time_scale Hz que corresponde a un incremento (llamado pulso de reloj) de un contador de pulsos de reloj. expo_num_units_in_tick debe ser mayor que 0. Un pulso de reloj, definido por la variable clockTick, en unidades de segundos, es igual al cociente de expo_num_units_in_tick dividido por expo_time_scale.

expo_time_scale es el número de unidades de tiempo que pasan en un segundo.

clockTick = expo_num_units_in_tick -f expo_time_scale.

NOTA: Los dos elementos de sintaxis: expo_num_units_in_tick y expo_time_scale se definen para medir la duración de la exposición.

Es un requisito para la conformidad del caudal de bits que clockTick sea menor o igual que ClockTick cuando están presentes num_units_in_tick y time_scale.

fixed_exposure_duration_within_cvs_flag igual a 1 especifica que el valor de duración de exposición efectiva es el mismo para todas las subcapas temporales en la CVS.

fixed_exposure_duration_within_cvs_flag igual a 0 especifica que el valor de duración de exposición efectiva puede no ser el mismo para todas las subcapas temporales en la CVS. Cuando fixed_exposure_duration_within_cvs_flag es igual a 1, la variable fixedExposureDuration se establece igual a clockTick.

sub_layer_exposure_duration_numer_minus1[ i ] más 1 especifica el numerador usado para derivar el valor de duración de la exposición cuando HighestTid es igual a i. El valor de sub_layer_exposure_duration_numer_minus1[ i ] estará en el rango de 0 a 65535, inclusive.

sub_layer_exposure_duration_demom_minus1[ i ] más 1 especifica el denominador usado para derivar el valor de duración de la exposición cuando HighestTid es igual a i. El valor de sub_layer_exposure_duration_demom_minus1[ i ] estará en el rango de 0 a 65535, inclusive.

El valor de sub_layer_exposure_duration_numer_minus1[ i ] será menor o igual que el valor de sub_layer_exposure_duration_demom_minus1[ i ].

La variable subLayerExposureDuration[ i ] para HigestTid igual a i se deduce de la siguiente manera:

subLayerExposurcDuralion[ i ] = ( sub_layer_exposure_duration_numer_minusl[ i 1 1 ) ( sub_layer_exposure_duration_denom_ininusl | ¡ J 1 ) * clockTick.

Como se explicó anteriormente, los parámetros de sintaxis sub_layer_exposure_duration_numer_minus1[ i ] y sub_layer_exposure_duration_denom_minus1[ i ] también pueden ser reemplazados por sub_layer_exposure_duration_numer[ i ] y sub_layer_exposure_duration_denom[ i ].

En otra realización, como se muestra en la tabla 22, se puede definir el parámetro ShutterInterval (es decir, la duración de la exposición) mediante los elementos de sintaxis sii_num_units_in_shutter_interval y sii_time_scale, donde ShutterInterval = sii_num_units_in_shutter_interval sii_time_scale . (13)

Tabla 22: Mensajes SEI de ejemplo para señalización de duración de exposición (información de intervalo del obturador)

Semántica del mensaje SEI de información del intervalo de obturador

El mensaje SEI de información del intervalo de obturador indica el intervalo de obturador para el contenido de video asociado antes de la codificación y visualización; por ejemplo, para el contenido capturado por la cámara, la cantidad de tiempo que un sensor de imagen estuvo expuesto para producir una imagen. sii_num_units_in_shutter_interval especifica el número de unidades de tiempo de un reloj que funciona a la frecuencia sii_time_scale Hz que corresponde a un incremento del contador de pulsos de reloj del obturador. El intervalo de obturador, definido por la variable ShutterInterval, en unidades de segundos, es igual al cociente de sii_num_units_in_shutter_interval dividido por sii_time_scale. Por ejemplo, cuando ShutterInterval es igual a 0,04 segundos, sii_time_scale puede ser igual a 27 000 000 y sii_num_units_in_shutter_interval puede ser igual a 1080 000.

sii_time_scale especifica el número de unidades de tiempo que pasan en un segundo. Por ejemplo, un sistema de coordenadas de tiempo que mide el tiempo usando un reloj de 27 MHz tiene una sii_time_scale de 27000000. Cuando el valor de sii_time_scale es mayor que 0, el valor de ShutterInterval se especifica mediante:

ShutterInterval = sii_num_units_in_shutter_interval -f sii_time_scale De lo contrario (el valor de sii_time_scale es igual a 0), ShutterInterval debe interpretarse como desconocido o no especificado.

NOTA 1: un valor de ShutterInterval igual a 0 puede indicar que el contenido de video asociado incluye contenido de captura de pantalla, contenido generado por ordenador u otro contenido que no es de captura de cámara.

NOTA 2: un valor de ShutterInterval mayor que el valor del inverso de la velocidad de imagen codificada, el intervalo de imagen codificada, puede indicar que la velocidad de imagen codificada es mayor que la velocidad de imagen a la que se creó el contenido de video asociado, por ejemplo, cuando la tasa de imagen codificada es de 120 Hz y la tasa de imagen del contenido de vídeo asociado antes de la codificación y visualización es de 60 Hz. El intervalo codificado para la subcapa temporal dada Tid puede indicarse mediante ClockTick y elemental_duration_in_tc_minus1[ Tid ]. Por ejemplo, cuando fixed_pic_rate_within_cvs_flag[ Tid ] es igual a 1, el intervalo de imagen para la subcapa temporal dada Tid, definida por la variable PictureInterval[ Tid ], puede especificarse mediante: PictureInterval[ Tid ] = ClockTick * ( elemental_duration_in_tc_minus1[ Tid ] 1 ).

fixed_shutter_interval_within_cvs_flag igual a 1 especifica que el valor de ShutterInterval es el mismo para todas las subcapas temporales en la CVS. fixed_shutter_interval_within_cvs_flag igual a 0 especifica que el valor de ShutterInterval puede no ser el mismo para todas las subcapas temporales en la CVS.

sub_layer_shutter_interval_numer[ i ] especifica el numerador usado para derivar el intervalo de obturador de la subcapa, definido por la variable subLayerShutterInterval[ i ], en unidades de segundos, cuando HighestTid es igual a i.

sub_layer_shutter_interval_denom[ i ] especifica el denominador usado para derivar el intervalo de obturador de la subcapa, definido por la variable subLayerShutterInterval[ i ], en unidades de segundos, cuando HighestTid es igual a i.

El valor de subLayerShutterInterval[ i ] para HighestTid igual a i se obtiene de la siguiente manera. Cuando el valor de fixed_shutter_interval_within_cvs_flag es igual a 0 y el valor de sub_layer_shutter_interval_denom[ i ] es mayor que 0:

subLayerShutterIntcrval| i J = ShutterInterval * sub_layer_shutter_interval_numer[ i J

-r sub_layer_shiitter_interval_denom[ i ]

De lo contrario (el valor de sub_layer_shutter_interval_denom[ i ] es igual a 0), subLayerShutterInterval[ i ] debe interpretarse como desconocido o no especificado. Cuando el valor de fixed_shutter_interval_within_cvs_flag no es igual a 0, subLayerShutterInterval[ i ] = ShutterInterval.

En una realización alternativa, en lugar de usar un numerador y un denominador para señalar el intervalo de obturador de la subcapa, se usa un valor único. Un ejemplo de dicha sintaxis se muestra en la tabla 23.

Tabla 23: Mensajes SEI de ejemplo para la señalización del intervalo de obturador

Semántica del mensaje SEI de información del intervalo de obturador

El mensaje SEI de información del intervalo de obturador indica el intervalo de obturador para el contenido de video asociado antes de la codificación y visualización; por ejemplo, para el contenido capturado por la cámara, la cantidad de tiempo que un sensor de imagen estuvo expuesto para producir una imagen.