ES2933452T3 - Procedimiento y dispositivo para la medición de la potencia de refracción local y/o de la distribución de la potencia de refracción de una lente de gafas - Google Patents

Procedimiento y dispositivo para la medición de la potencia de refracción local y/o de la distribución de la potencia de refracción de una lente de gafas Download PDFInfo

- Publication number

- ES2933452T3 ES2933452T3 ES20723300T ES20723300T ES2933452T3 ES 2933452 T3 ES2933452 T3 ES 2933452T3 ES 20723300 T ES20723300 T ES 20723300T ES 20723300 T ES20723300 T ES 20723300T ES 2933452 T3 ES2933452 T3 ES 2933452T3

- Authority

- ES

- Spain

- Prior art keywords

- scene

- spectacle lens

- image

- spectacle

- frame

- Prior art date

- Legal status (The legal status is an assumption and is not a legal conclusion. Google has not performed a legal analysis and makes no representation as to the accuracy of the status listed.)

- Active

Links

Classifications

-

- G—PHYSICS

- G01—MEASURING; TESTING

- G01M—TESTING STATIC OR DYNAMIC BALANCE OF MACHINES OR STRUCTURES; TESTING OF STRUCTURES OR APPARATUS, NOT OTHERWISE PROVIDED FOR

- G01M11/00—Testing of optical apparatus; Testing structures by optical methods not otherwise provided for

- G01M11/02—Testing optical properties

- G01M11/0228—Testing optical properties by measuring refractive power

-

- G—PHYSICS

- G02—OPTICS

- G02C—SPECTACLES; SUNGLASSES OR GOGGLES INSOFAR AS THEY HAVE THE SAME FEATURES AS SPECTACLES; CONTACT LENSES

- G02C13/00—Assembling; Repairing; Cleaning

- G02C13/003—Measuring during assembly or fitting of spectacles

- G02C13/005—Measuring geometric parameters required to locate ophtalmic lenses in spectacles frames

-

- G—PHYSICS

- G02—OPTICS

- G02C—SPECTACLES; SUNGLASSES OR GOGGLES INSOFAR AS THEY HAVE THE SAME FEATURES AS SPECTACLES; CONTACT LENSES

- G02C7/00—Optical parts

- G02C7/02—Lenses; Lens systems ; Methods of designing lenses

- G02C7/06—Lenses; Lens systems ; Methods of designing lenses bifocal; multifocal ; progressive

- G02C7/061—Spectacle lenses with progressively varying focal power

- G02C7/063—Shape of the progressive surface

-

- G—PHYSICS

- G06—COMPUTING OR CALCULATING; COUNTING

- G06T—IMAGE DATA PROCESSING OR GENERATION, IN GENERAL

- G06T7/00—Image analysis

- G06T7/70—Determining position or orientation of objects or cameras

- G06T7/73—Determining position or orientation of objects or cameras using feature-based methods

-

- G—PHYSICS

- G06—COMPUTING OR CALCULATING; COUNTING

- G06T—IMAGE DATA PROCESSING OR GENERATION, IN GENERAL

- G06T7/00—Image analysis

- G06T7/70—Determining position or orientation of objects or cameras

- G06T7/73—Determining position or orientation of objects or cameras using feature-based methods

- G06T7/74—Determining position or orientation of objects or cameras using feature-based methods involving reference images or patches

-

- G—PHYSICS

- G06—COMPUTING OR CALCULATING; COUNTING

- G06T—IMAGE DATA PROCESSING OR GENERATION, IN GENERAL

- G06T7/00—Image analysis

- G06T7/70—Determining position or orientation of objects or cameras

- G06T7/73—Determining position or orientation of objects or cameras using feature-based methods

- G06T7/75—Determining position or orientation of objects or cameras using feature-based methods involving models

Landscapes

- Physics & Mathematics (AREA)

- General Physics & Mathematics (AREA)

- Engineering & Computer Science (AREA)

- Ophthalmology & Optometry (AREA)

- Health & Medical Sciences (AREA)

- Optics & Photonics (AREA)

- Chemical & Material Sciences (AREA)

- Analytical Chemistry (AREA)

- Computer Vision & Pattern Recognition (AREA)

- Theoretical Computer Science (AREA)

- Geometry (AREA)

- General Health & Medical Sciences (AREA)

- Eyeglasses (AREA)

- Testing Of Optical Devices Or Fibers (AREA)

- Eye Examination Apparatus (AREA)

- Investigating Or Analysing Materials By Optical Means (AREA)

Abstract

La invención se refiere a la medición de la potencia de refracción local o de la distribución de la potencia de refracción de un cristal izquierdo y/o derecho (20, 22) de una montura (18). De acuerdo con la invención, al menos una primera imagen de una escena (10) que tiene una pluralidad de puntos de estructura (26) y una lente para gafas izquierda y/o derecha (20, 22) de un marco frontal (18) es capturada por medios de al menos un dispositivo de captura de imagen (30) desde al menos una primera posición de captura (32) que tiene una trayectoria de haz de imágenes para puntos de estructura (26), extendiéndose dicha trayectoria de haz a través de la primera y/o la segunda lente para gafa (20, 22) del marco frontal (18). Se capturan al menos dos imágenes más de la escena (10) mediante el al menos un dispositivo de captura de imágenes (30) desde al menos dos posiciones de captura diferentes (32, 34, 36), (Traducción automática con Google Translate, sin valor legal)

Description

DESCRIPCIÓN

Procedimiento y dispositivo para la medición de la potencia de refracción local y/o de la distribución de la potencia de refracción de una lente de gafas

La invención se refiere a un procedimiento para la medición de la potencia de refracción local y/o de la distribución de la potencia de refracción de una lente de gafas izquierda y/o derecha, preferiblemente en una montura de gafas. La invención se refiere además a un producto de programa informático con un programa informático con un código de programa, así como a un dispositivo para la realización del procedimiento.

Para que un usuario de gafas pueda ver con nitidez, las lentes de gafas en la montura de gafas deben estar correctamente posicionadas y alineadas con los ojos del usuario de las gafas. En principio, la alineación y el posicionamiento correctos son necesarios en todas las lentes de gafas. La alineación y el posicionamiento correctos de las lentes de gafas son especialmente importantes en los diseños de lentes individualizadas, en los diseños de lentes tóricas, en las lentes de gafas con un elevado efecto dióptrico y en las lentes progresivas. Las lentes progresivas permiten a los usuarios de gafas ver con nitidez en diferentes situaciones de uso, por ejemplo, a diferentes distancias, simplemente cambiando la dirección de visión, sin necesidad de una mayor acomodación de los ojos. Según la norma DIN EN ISO 13666:2013-10, apartado 8.3.5, las lentes progresivas son lentes con al menos una superficie progresiva y un efecto dióptrico creciente (positivo) cuando el usuario de las gafas mira hacia abajo. Las lentes individualizadas y/o las lentes progresivas tienen uno o varios puntos de referencia, por ejemplo, un punto de visión de lejos y/o un punto de visión de cerca, cuya posición debe adaptarse a la ubicación de las pupilas de los ojos de un usuario de gafas en función de la situación de uso. El punto de visión de lejos es, según la norma DIN EN ISO 13666:2013-10, apartado 5.16, la posición supuesta del punto de visión en una lente de gafas para la visión a distancia en determinadas condiciones. El punto de visión de cerca es, según la norma DIN EN ISO 13666:2013-10, apartado 5.17, la posición supuesta del punto de visión en una lente de gafas para la visión de cerca en determinadas condiciones. En el caso de los diseños de lentes tóricas, también es necesario orientar correctamente su efecto cilíndrico para un usuario de gafas.

Por el documento WO 2016/207412 A1 se conocen un procedimiento y un dispositivo del tipo citado al principio. Aquí se describe la medición de la potencia de refracción local de una lente de gafas izquierda y/o derecha en una montura de gafas con un dispositivo de medición en el que se dispone la montura de gafas. Este dispositivo de medición contiene un dispositivo de adquisición de imágenes y una pantalla para mostrar una estructura de prueba, cuya posición con respecto al dispositivo de adquisición de imágenes se conoce. Por medio del dispositivo de adquisición de imágenes, la estructura de prueba mostrada en la pantalla se detecta con una trayectoria del haz de imágenes que atraviesa la lente de gafas izquierda y/o derecha en la montura de gafas. Mediante la pantalla se adquiere adicionalmente una sección de la montura de gafas que define un sistema de coordenadas de la montura de gafas. A continuación se determina en una unidad informática la potencia de refracción local de una lente de gafas izquierda y/o derecha mediante el procesamiento de imágenes a partir de la sección adquirida de la montura de gafas y de la imagen detectada de la estructura de prueba, así como de las coordenadas de la estructura de prueba y de la imagen tomada de la estructura de prueba en un sistema de coordenadas referenciado al sistema de coordenadas de la montura de gafas.

El documento EP 2608 109 A1 revela un procedimiento para la determinación de la potencia de refracción de una lente de gafas en posición de uso. En este caso se toman una imagen del usuario de las gafas sin la montura de gafas y una imagen del usuario de las gafas con la montura de gafas y se determina el tamaño del iris en ambas imágenes. A partir de la diferencia de tamaño y de la distancia focal de la cámara se deduce la potencia de refracción de la lente de gafas. Para este procedimiento es necesario que el usuario de las gafas lleve puestas las gafas. Además, este procedimiento no permite ninguna determinación local de la potencia de refracción en los distintos puntos de la lente ni ninguna determinación de las distintas trayectorias de los rayos a través de la lente de gafas.

El documento US 2015/0362998 A1 y el documento US 10,019,140 B1 describen respectivamente procedimientos para la determinación de la distancia de la cara de una persona con respecto a un dispositivo de adquisición de imágenes que detecta esta cara mediante fotogrametría.

Por el documento WO 2016/076530 A1 se conoce un procedimiento para la medición de la potencia de refracción de una gafas, en el que la potencia de refracción de la lente se deduce de la diferencia de tamaño de un objeto entre una fotografía tomada sin la lente de gafas y una fotografía tomada a través de la lente de gafas.

El documento WO 2017/134275 A1 describe la medición de la potencia de refracción local de una lente de gafas izquierda y/o derecha en una montura de gafas mediante la evaluación de al menos una imagen de una lente de gafas izquierda y/o derecha en una montura de gafas tomada con un fondo cuya geometría se conoce o calcula. El procedimiento requiere un conocimiento de la posición de captura de la cámara para poder indicar el eje óptico de la lente de gafas izquierda y/o derecha en una montura de gafas o una potencia de refracción local de la lente de gafas. Aquí no se calculan las coordenadas de los puntos del fondo delante del cual se encuentra la lente de gafas a medir.

El documento US 2015/0029323 A1 describe un dispositivo de procesamiento de imágenes con una memoria y con un procesador acoplado a la memoria que sirve para determinar la propiedad óptica de unas gafas mediante la evaluación de imágenes del usuario de gafas que se capturan por medio de un dispositivo de adquisición de imágenes

y que muestran el usuario de gafas con y sin las gafas. En el documento US 2015/0029323 A1 se propone deducir la potencia de refracción de una lente de gafas en las gafas por medio de la posición espacial de un contorno facial de la cara de un usuario de gafas detectado a través de unas gafas con lentes de gafas y por medio de la posición espacial de un contorno facial detectado de dicha cara sin las gafas.

El objetivo de la invención consiste en determinar de un modo sencillo y con un número reducido de equipos el efecto de enfoque o el efecto dióptrico de una lente de gafas izquierda y/o derecha respectivamente para una distancia lejana y/o una distancia cercana. Especialmente, un objetivo de la invención consiste en determinar con una alta precisión una potencia de refracción local en diferentes puntos de una lente de gafas, es decir, una distribución de la potencia de refracción.

Esta tarea se resuelve mediante el procedimiento indicado en la reivindicación 1 y en la reivindicación 2. En las reivindicaciones dependientes se indican otras variantes perfeccionadas ventajosas de la invención.

En el procedimiento indicado en la reivindicación 1 para la medición de la potencia de refracción local y/o de la distribución de la potencia de refracción de una lente de gafas izquierda y/o derecha en una montura de gafas se toma en un primer paso al menos una primera imagen de una escena desde al menos una primera posición de captura por medio de al menos un dispositivo de adquisición de imágenes, presentando esta al menos una primera imagen al menos un punto estructural y conteniendo la misma una lente de gafas izquierda y/o derecha en una montura de gafas, atravesando la al menos una trayectoria del haz de imágenes para cada uno de estos puntos estructurales la primera o la segunda lente de gafas de la montura de gafas.

En esta invención, por potencia de refracción se entiende el efecto de enfoque o el efecto dióptrico de una lente de gafas. En la presente invención, por efecto de enfoque se entiende el concepto genérico para el efecto esférico y astigmático de una lente de gafas de acuerdo con la definición indicada en la norma DIN EN ISO 13666:2013-10, apartado 9.2. En esta invención, por efecto dióptrico de una lente de gafas se entiende el concepto genérico para el efecto de enfoque y el efecto prismático de la lente de gafas de acuerdo con la definición indicada en la norma DIN EN ISO 13666:2013-10, apartado 9.3. En la presente invención, por el efecto prismático de una lente de gafas se entiende el concepto genérico para la desviación prismática y la posición de base de acuerdo con la definición indicada en la norma DIN En ISO 13666:2013-10, apartado 10.9.

En esta invención, por potencia de refracción local se entiende el efecto de enfoque local o el efecto dióptrico local de una lente de gafas.

En la presente invención, por distribución de la potencia de refracción se entiende el efecto de enfoque resuelto localmente o el efecto dióptrico resuelto locamente de una lente de gafas.

Por una escena, la invención entiende una sección de un entorno que se puede capturar con al menos un dispositivo de adquisición de imágenes, por ejemplo, con al menos una cámara digital integrada, por ejemplo, en un teléfono inteligente o una tableta. Una escena puede ser, por ejemplo, una sección de una habitación de una casa o una sección de una tienda o parte de un paisaje. Sin embargo, una escena también puede incluir una cara o sólo un ojo izquierdo y/o un ojo derecho de un usuario de gafas.

Aquí, por al menos un punto estructural de una escena se entiende un punto geométrico cuya imagen puede reconocerse claramente en al menos una imagen o fotografía de la escena al capturar la escena con al menos un dispositivo de adquisición de imágenes gracias a un brillo y/o color diferente de una imagen de puntos adyacentes a este punto en comparación con la imagen de este punto. Por ejemplo, un punto estructural puede estar situado en una esquina o en un canto de una estructura en la escena.

Sin embargo, el término punto estructural de una escena también abarca aquí un punto en un patrón fijo e invariable en el tiempo, por ejemplo, al menos un punto en un patrón de puntos regulares o irregulares, al menos un punto en un patrón de rayas regulares o irregulares, al menos un punto en un patrón de cuadros regulares o irregulares, al menos un punto en un código de barras, al menos un punto en un código 2D y/o al menos un punto dentro de un texto escrito, por ejemplo, un periódico o un libro, o un dispositivo de visualización electrónico, por ejemplo, una pantalla. Especialmente, al menos un punto estructural fijo invariable en el tiempo en una escena puede ser al menos un punto en una superficie estructurada, por ejemplo, un mantel estructurado, o en un papel pintado estructurado.

No obstante, por el término punto estructural de una escena también se entiende aquí al menos un punto en una escena cuya posición puede variar en el tiempo como, por ejemplo, al menos un punto en la cara de un usuario de gafas que se mueve, por ejemplo, un punto en las cejas, en los labios o un punto situado en el iris. Cuando la posición del al menos un punto estructural en una escena varía en el tiempo, preferiblemente se reconstruye, en la medida de lo posible, su desplazamiento y se tiene en cuenta en la determinación de la potencia de refracción local de una lente de gafas izquierda y/o derecha. En caso de que no sea posible reconstruir el desplazamiento de un punto estructural como éste, resulta ventajoso no tener en cuenta este punto estructural en una determinación de la potencia de refracción local y/o de la distribución de la potencia de refracción de una lente de gafas izquierda y/o derecha.

En la invención, por al menos un dispositivo de adquisición de imágenes se entiende preferiblemente una cámara digital integrada, por ejemplo, en un terminal móvil como un teléfono móvil, un teléfono inteligente o una tableta. La cámara digital puede configurarse como una cámara estereoscópica, como una cámara múltiple, como un sensor de imagen con un objetivo o como un sensor de imagen con al menos dos objetivos y/o como una así llamada cámara

plenóptica. Hay que hacer constar que el terminal móvil antes indicado también puede presentar varios dispositivos de adquisición de imágenes en forma de una cámara digital.

Por un terminal móvil se entiende especialmente un dispositivo que comprende al menos un procesador programable, así como al menos un dispositivo de adquisición de imágenes, por ejemplo, al menos una cámara, y al menos un sensor de aceleración, y que está concebido preferiblemente para ser transportado, es decir, está diseñado con respecto a las dimensiones y al peso de manera que una persona pueda transportarlo. En el terminal móvil pueden estar previstos otros componentes como, por ejemplo, al menos una pantalla, al menos una fuente de luz para, por ejemplo, luz visible de un rango de longitud de onda de 380 nm a 780 nm y/o luz infrarroja de un rango de longitud de onda de 780 nm a 1 mm y/o al menos un receptor de luz con sensibilidad para, por ejemplo, luz visible de un rango de longitud de onda de 380 nm a 780 nm y/o luz infrarroja de un rango de longitud de onda de >780 nm a 1 mm. Ejemplos típicos de terminales móviles de este tipo son los teléfonos inteligentes o las tabletas, que pueden presentar al menos una pantalla, por ejemplo, una pantalla con sensores (pantalla táctil), al menos un dispositivo de adquisición de imágenes, por ejemplo, al menos una cámara, al menos un sensor de aceleración, al menos una fuente de luz, al menos un receptor de luz y otros componentes como interfaces inalámbricas para telefonía móvil o WLAN (LAN inalámbrica).

Aquí, por una trayectoria del haz de imágenes para un punto estructural se entiende el desarrollo de los rayos de luz que provocan una imagen óptica del punto estructural de la escena como una imagen del punto estructural en la imagen de la escena en al menos un dispositivo de adquisición de imágenes. El haz principal de la trayectoria del haz de imágenes para un punto estructural se denomina en lo sucesivo su eje óptico que forma un eje de simetría.

En el procedimiento indicado en la reivindicación 1 se toman, en un paso adicional que puede tener lugar antes o después del primer paso o al mismo tiempo que el primer paso, al menos otras dos imágenes de la escena sin la primera y/o sin la segunda lente de la montura de gafas o sin la montura de gafas que contiene la primera y/o la segunda lente con los puntos estructurales reproducidos en la primera imagen por medio de al menos un dispositivo de adquisición de imágenes desde al menos dos posiciones de captura diferentes, pudiendo al menos una de las posiciones de captura ser idéntica a la al menos una primera posición de captura. En el paso posterior, el al menos un dispositivo de adquisición de imágenes puede ser idéntico o diferente al al menos un dispositivo de adquisición de imágenes del primer paso. Preferiblemente, el al menos un dispositivo de adquisición de imágenes en el paso posterior es idéntico al al menos un dispositivo de adquisición de imágenes del primer paso. A continuación, en un paso de cálculo se determinan las coordenadas de los puntos estructurales en un sistema de coordenadas a partir de las al menos otras dos imágenes de la escena mediante evaluación de imágenes, preferiblemente mediante triangulación. Posteriormente, en un paso de determinación de una potencia de refracción local para al menos una sección de la lente de gafas izquierda y/o para una sección de la lente de gafas derecha, se determina la potencia de refracción local a partir de las coordenadas de los puntos estructurales y de la imagen de los puntos estructurales en la al menos una primera imagen de la escena.

El procedimiento propuesto en la reivindicación 2 para la medición de la potencia de refracción local y/o de la distribución de la potencia de refracción de una lente de gafas izquierda y/o derecha en una montura de gafas prevé en un primer paso tomar, por medio de al menos un dispositivo de adquisición de imágenes, al menos una primera imagen de una escena desde al menos una primera posición de captura, presentando esta al menos una primera imagen al menos un punto estructural e incluyendo la misma una lente de gafas izquierda y/o derecha en una montura de gafas, atravesando la al menos una trayectoria del haz de imágenes para cada uno de estos puntos estructurales la primera o la segunda lente de gafas de la montura de gafas.

Como se ha indicado antes, aquí por la trayectoria del haz de imágenes para un punto estructural se entiende el desarrollo de los rayos de luz que provocan una imagen óptica del punto estructural desde la escena como una imagen del punto estructural en la imagen de la escena tomada por medio de al menos un dispositivo de adquisición de imágenes. El haz principal de la trayectoria del haz de imágenes para un punto estructural se denomina en adelante su eje óptico que forma un eje de simetría.

En un paso adicional, que puede tener lugar antes o después del primer paso o al mismo tiempo que el primer paso, se toman al menos dos imágenes adicionales de la escena con la lente de gafas izquierda y/o derecha en una montura de gafas mediante al menos un dispositivo de adquisición de imágenes desde al menos dos posiciones de captura adicionales diferentes de la primera posición de captura con respectivamente al menos una trayectoria del haz de imágenes para los puntos estructurales representados en la primera imagen, no atravesando esta al menos una trayectoria del haz de imágenes la primera y la segunda lente de gafas de la montura de gafas. A continuación, en un paso posterior, se calculan mediante una evaluación de imágenes, preferiblemente mediante una triangulación, las coordenadas de los puntos estructurales en un sistema de coordenadas a partir de la al menos una trayectoria de haz respectiva de los puntos estructurales que no ha atravesado la lente de gafas izquierda y derecha. Acto seguido, la potencia de refracción local para al menos una sección de la lente de gafas izquierda y/o para al menos una sección de la lente de gafas derecha se determina a partir de las coordenadas de los puntos estructurales y de la imagen de los puntos estructurales en la al menos una primera imagen de la escena.

En una variante perfeccionada ventajosa de un procedimiento antes indicado para la medición de la potencia de refracción local y/o de la distribución de la potencia de refracción de una lente de gafas izquierda y/o derecha, preferiblemente en una montura de gafas, se adquiere una pluralidad de puntos estructurales en una escena a partir de respectivamente al menos una primera posición de captura en respectivamente una primera imagen de la escena,

llevándose a cabo los pasos siguientes a la adquisición por medio de esta respectiva pluralidad de puntos estructurales.

Aquí, por una pluralidad de puntos estructurales se entiende un conjunto de puntos que comprende al menos tres puntos estructurales. Resulta ventajoso que la medición de la potencia de refracción local de una lente de gafas izquierda y/o derecha se realice por medio de al menos 10, preferiblemente al menos 100, muy preferiblemente al menos 1000 y con especial preferencia al menos 10000 puntos estructurales. Resulta ventajoso que la medición de la potencia de refracción local de una lente de gafas izquierda y/o derecha se lleve a cabo mediante un número Z de puntos estructurales para el que se aplica lo siguiente: 100 < Z < 1000.

Midiendo la potencia de refracción local en una pluralidad de puntos diferentes de la lente de gafas izquierda y/o derecha es posible determinar una distribución de la potencia de refracción para la lente de gafas izquierda y/o derecha.

La evaluación de imagen de cada imagen comprende preferiblemente tecnologías de procesamiento de imágenes como, por ejemplo, la clasificación, la segmentación y la triangulación. Con la ayuda del procedimiento para el reconocimiento de objetos, como la segmentación y la clasificación, se analiza cada imagen preferiblemente en busca de objetos de las categorías de escena y/o montura de gafas. Los procedimientos para el reconocimiento de objetos pueden ser tanto de naturaleza clásica como, por ejemplo, la umbralización, la segmentación basada en cantos o regiones, el flujo óptico, como también de naturaleza adaptativa. Si los procedimientos de reconocimiento de objetos son de naturaleza adaptativa, como en la aplicación de algoritmos adaptativos, es necesario entrenar previamente una red neuronal con datos de entrenamiento aumentados. El resultado de cada uno de estos procedimientos de reconocimiento de objetos es la posición, la ubicación y el límite de los objetos, aquí las categorías de escena y/o montura de gafas. Una información adicional es la existencia de los respectivos objetos en las respectivas imágenes. De este modo se puede reconocer, por ejemplo, si una montura de gafas y/o una lente de gafas está presente en la imagen o no. Así, la asignación de si se trata de una primera o de otra imagen también puede llevarse a cabo una vez tomada la imagen respectiva. La asignación de si se trata de una primera imagen o de una segunda imagen puede además llevarse a cabo sin saber si la imagen era una primera imagen o una imagen posterior.

En los procedimientos antes indicados, los puntos estructurales pueden ser sólo respectivamente fijos o respectivamente tanto fijos, como también invariables en el tiempo. Alternativamente, el desplazamiento del al menos un punto estructural puede conocerse en cada caso y/o su desplazamiento puede reconstruirse y tenerse en cuenta en la determinación de la distribución de la potencia de refracción. Preferiblemente, los puntos estructurales son respectivamente fijos, con especial preferencia respectivamente fijos e invariables en el tiempo.

A partir de la distribución de la potencia de refracción de una lente de gafas izquierda y/o derecha o al menos de una sección de una lente de gafas izquierda y/o derecha determinada en uno de los procedimientos descritos anteriormente, se puede deducir la potencia de refracción local en un punto específico de la lente de gafas.

En los procedimientos antes indicados, en el respectivamente primer paso en el que se toma al menos una primera imagen de una escena desde al menos una primera posición de captura por medio de al menos un dispositivo de adquisición de imágenes, se puede detectar opcionalmente el borde o la curva de borde de la lente de gafas izquierda y/o derecha en una montura de gafas.

Preferiblemente, la curva de borde es el límite de la lente de gafas que define la forma y que se encuentra en la superficie delantera de la montura de gafas opuesta a la cara y que, en el caso de las gafas de media montura o de montura completa, coincide parcial o totalmente con el borde interior de la montura de gafas situado en el lado delantero. En el caso de las gafas de montura completa, la curva de borde en la superficie delantera de la montura de gafas opuesta a la cara es igual al borde exterior de lente situado en el lado delantero o al borde interior de montura situado en el lado delantero. En el caso de las gafas de media montura, la curva de borde en la superficie delantera de la montura de las gafas opuesta a la cara es igual al borde exterior de lente situado en el lado delantero o al borde interior de montura situado en el lado delantero, siempre que esté disponible una estructura proporcionada por la montura. Si, en el caso de las gafas de media montura, no está disponible ninguna estructura proporcionada por la montura, la curva de borde en la superficie delantera de la montura opuesta a la cara es igual al borde exterior de lente situado en el lado delantero. En caso de gafas sin montura, no existe ninguna estructura análoga de la montura, es decir, el término curva de borde describe aquí en la superficie delantera de la montura de gafas opuesta a la cara siempre el borde exterior de lente situado en el lado delantero.

Si en el procedimiento indicado en la reivindicación 1 se utiliza un dispositivo de adquisición de imágenes instalado en un terminal móvil y compuesto por al menos dos cámaras digitales, una cámara estereoscópica, una multicámara, un chip de cámara con al menos dos objetivos o una cámara plenóptica, puede ser suficiente con tomar una única imagen de la escena con la montura de gafas que contiene la primera y/o la segunda lente de gafas, presentando esta primera imagen al menos un punto estructural, y con tomar otra única imagen de la escena sin la montura de gafas que contiene la primera y/o la segunda lente de gafas con los mismos puntos estructurales de la primera imagen de una escena. Preferiblemente, para aumentar la precisión del procedimiento según la reivindicación 1, se toman al menos dos imágenes de la escena con la montura de gafas que contiene la primera y/o la segunda lente de gafas y al menos dos imágenes de la escena sin la montura de gafas que contiene la primera y/o la segunda lente de gafas.

Si en el procedimiento indicado en la reivindicación 2 se utiliza un dispositivo de adquisición de imágenes instalado en un terminal móvil y compuesto por al menos dos cámaras digitales, una cámara estereoscópica, una multicámara, un

chip de cámara con al menos dos objetivos o una cámara plenóptica, puede ser suficiente con tomar una única imagen de la escena con la montura de gafas que contiene la primera y/o la segunda lente de gafas, presentando esta primera imagen al menos un punto estructural, atravesando la al menos una trayectoria del haz de imágenes para cada uno de estos puntos estructurales la primera y/o la segunda lente de gafas, y con tomar una única imagen adicional de la escena con la montura de gafas que contiene la primera y/o la segunda lente de gafas, tomándose esta al menos otra imagen desde una posición de captura diferente de la primera posición de captura, de manera que la al menos una trayectoria del haz de imágenes para cada uno de estos puntos estructurales no atraviese la primera y la segunda lente de gafas de la montura de gafas. En esta forma de realización del procedimiento según la reivindicación 2, para aumentar la precisión también se capturan preferiblemente al menos dos primeras imágenes con la montura de gafas y al menos otras dos imágenes de la escena con la montura de gafas desde posiciones de captura diferentes de las dos primeras posiciones de captura.

Para la medición de lentes de gafas con una potencia de refracción muy negativa, es decir, con una sección principal con una potencia de refracción negativa inferior o igual a -3 dpt, resulta ventajoso que la escena para la determinación de la potencia de refracción local y/o de la distribución de la potencia de refracción de una lente de gafas izquierda y/o derecha, respectivamente con preferencia en una montura de gafas, contenga al menos un punto estructural, preferiblemente al menos un punto estructural fijo e invariable en el tiempo, que se detecta a través de una lente de gafas izquierda y/o derecha y que se encuentra a una distancia de la lente de gafas respectivamente a medir que es preferiblemente de entre 5 mm y 200 mm.

En este caso, por la distancia de un punto estructural con respecto a una lente de gafas se entiende respectivamente la separación del punto estructural con respecto al punto de intersección del haz principal de la trayectoria del haz de imágenes en el lado de la lente de gafas orientado hacia el punto estructural. Hay que hacer constar que mediante la adquisición de otras imágenes de la escena desde otras posiciones de captura diferentes es posible, en principio, determinar el haz principal para una imagen óptica en el dispositivo de adquisición de imágenes para cada punto estructural en el rango de distancia antes especificado.

Para la medición de lentes de gafas con una potencia de refracción fuertemente positiva, es decir, con una sección principal con una potencia de refracción positiva mayor o igual a 3 dpt, resulta ventajoso que la escena para determinar la potencia de refracción local y/o la distribución de la potencia de refracción de una lente de gafas izquierda y/o derecha, respectivamente con preferencia en una montura de gafas, contenga al menos un punto estructural, preferiblemente al menos un punto estructural fijo e invariable en el tiempo, que se detecta a través de una lente de gafas izquierda y/o derecha y que tiene una distancia con respecto a la lente de gafas respectivamente a medir que se encuentra preferiblemente delante del punto focal de la sección principal más fuerte. Esta distancia es preferiblemente de entre 5 mm y 100 mm.

Para la medición de lentes de gafas cuya potencia de refracción es baja, es decir, con una sección principal con un potencia de refracción negativa inferior a -3 dpt o con una sección principal con una potencia de refracción positiva superior a 3 dpt, se consiguen buenos resultados de medición para las escenas con al menos un punto estructural, preferiblemente al menos un punto estructural fijo e invariable en el tiempo, cuya distancia con respecto a la lente de gafas respectivamente a medir, preferiblemente en una montura de gafas, es de hasta 600 mm, preferiblemente en un rango de 5 mm a 500 mm.

Una conclusión de la invención consiste especialmente en que la potencia de refracción local y/o la distribución de la potencia de refracción de una lente de gafas puede determinarse con gran precisión con el procedimiento según la invención si la distancia de al menos un punto estructural, preferiblemente de al menos un punto estructural fijo e invariable en el tiempo, en una escena de una lente de gafas en una montura de gafas es de entre 10 mm y 50 mm, preferiblemente de entre 30 mm y 40 mm.

Una forma de realización ventajosa de la invención prevé tomar una pluralidad de primeras imágenes de la escena y una pluralidad de imágenes adicionales de la escena, incluida respectivamente la lente de gafas, debiéndose determinar su potencia de refracción local y/o distribución de la potencia de refracción y encontrándose esta lente de gafas preferiblemente en una montura de gafas. Alternativamente, al tomar la pluralidad de imágenes adicionales, también es posible retirar la montura de gafas de la escena. Para la captura de una pluralidad de primeras imágenes de la escena y de una pluralidad de imágenes adicionales de la escena, resulta ventajoso que éstas abarquen al menos una parte de un hemisferio o un hemisferio respectivamente alrededor de la escena y/o que cubran una pluralidad de posiciones de captura distintas con diferentes direcciones de captura y/o distancias de captura. En concreto, las coordenadas del al menos un punto estructural pueden calcularse a continuación a partir de la pluralidad de imágenes adicionales de la escena.

Un número correspondientemente alto de primeras imágenes tomadas de la escena y de imágenes adicionales tomadas de la escena aumentan la precisión del procedimiento para la medición de la potencia de refracción local y/o de la distribución de la potencia de refracción de una lente de gafas izquierda y/o derecha, preferiblemente en una montura de gafas.

Tomando mediante el dispositivo de adquisición de imágenes una pluralidad de imágenes de la escena, especialmente de la cabeza, mientras el al menos un dispositivo de adquisición de imágenes se desplaza o, en caso de un dispositivo de adquisición de imágenes fijo, mientras la escena, especialmente de la cabeza, gira, mirando el ojo izquierdo y/o el ojo derecho del usuario de gafas de la montura de gafas hacia el dispositivo de adquisición de imágenes desplazado,

calculándose, a partir de la pluralidad de imágenes aquí tomadas de la escena, especialmente de la cabeza, trayectorias del haz de visión para diferentes direcciones de visión del ojo izquierdo y/o del ojo derecho del usuario de gafas de la montura de gafas a través de la lente de gafas izquierda y/o de la lente de gafas derecha y determinándose para cada una de las direcciones de visión una potencia de refracción local k(x, y) de la lente de gafas izquierda y/o de la lente de gafas derecha, es posible determinar la potencia de refracción local de las lentes de gafas en la montura de gafas que lleva el usuario de las gafas para una dirección de visión seleccionada por el usuario de las gafas.

La medición de la potencia de refracción local y/o de la distribución de la potencia de refracción de una lente de gafas izquierda y de una lente de gafas derecha en una montura de gafas permite especialmente establecer una información representativa sobre los así llamados efectos binoculares de un par de gafas, es decir, de una montura de gafas incluidas ambas lentes de gafas. Por un efecto binocular se entiende la valoración del efecto de enfoque o dióptrico de las lentes de gafas izquierda y derecha para una dirección de visión determinada. Un efecto binocular también puede comprender aberraciones de orden superior de la lente como, por ejemplo, el coma, o aberraciones prismáticas.

La medición de la potencia de refracción local y/o de la distribución de la potencia de refracción de una lente de gafas izquierda y de una lente de gafas derecha en una montura de gafas permite detectar si, en caso de una dirección de visión determinada, por ejemplo, el efecto astigmático, que comprende la diferencia de la potencia de refracción en las secciones principales y su dirección, de la lente de gafas se desvía de forma significativa de los valores objetivo binoculares. En este caso, por los valores objetivo binoculares se entiende la refracción determinada subjetivamente que comprende la esfera, el cilindro con eje, así como el prisma con posición de base, de ambos ojos. Para el usuario de las gafas, una desviación de los valores objetivo binoculares no es perceptible o lo es sólo ligeramente si, por ejemplo, la desviación del efecto astigmático de la lente de gafas izquierda y derecha con respecto a los valores objetivo binoculares es la misma. Sin embargo, para el usuario de gafas, esta desviación de los valores objetivo binoculares es claramente perceptible si la desviación del efecto astigmático de la lente de gafas izquierda y derecha con respecto a los valores objetivo binoculares es diferente.

Hay que tener en cuenta que un usuario de gafas percibe como muy desagradable un efecto prismático incorrecto entre la lente de gafas derecha e izquierda. En este caso, un usuario de gafas acepta mejor un efecto prismático nasal incorrecto que un efecto prismático temporal incorrecto y/o un efecto prismático vertical incorrecto.

El procedimiento antes descrito ofrece especialmente la ventaja de que la desviación del efecto prismático de la lente de gafas izquierda y de la lente de gafas derecha con respecto a un valor objetivo binocular en una situación de uso puede determinarse mediante una medición simultánea de una lente de gafas derecha y de una lente de gafas izquierda en una montura de gafas.

Una forma de realización ventajosa de la invención prevé que las coordenadas de los puntos estructurales se calculen mediante la evaluación de los desplazamientos de las imágenes de los puntos estructurales en la escena en las tomas desde diferentes posiciones de captura en un sistema de coordenadas. En este caso pueden utilizarse procedimientos de detección de características, los así llamados "procedimientos de detección de rasgos", por ejemplo, descriptores de características basados en el gradiente como los rasgos SIFT y SURF, o descriptores de características binarios como los rasgos BRIEF o BRISK como se describe, por ejemplo, en el artículo "A comparison of feature descriptors for visual SLAM" de J. Hartmann, J. Klüssendorff y Erik Maehle, European Conference on Mobile Robots 2013, al que se hace referencia en su totalidad y cuya revelación se incluye en la descripción de esta invención.

Las coordenadas de los puntos estructurales pueden referirse a cualquier sistema de coordenadas fijo, especialmente a un sistema de coordenadas definido durante una posición de captura por medio del al menos un dispositivo de adquisición de imágenes. Preferiblemente, este sistema de coordenadas se refiere al sistema de coordenadas de la montura de gafas que puede estar definido por una sección de la montura de las gafas. Por dos sistemas de coordenadas referenciados entre sí se entienden sistemas de coordenadas para los que se conoce cuáles son las coordenadas de un punto o de un vector de un sistema de coordenadas en el otro sistema de coordenadas. Especialmente, mediante la determinación de las distancias entre las coordenadas de los puntos estructurales se puede conseguir que la potencia de refracción local y/o la distribución de la potencia de refracción de una lente de gafas izquierda y/o derecha en una montura de gafas también se pueda determinar por medio de escenas con variaciones en el tiempo como, por ejemplo, la cara de un usuario de gafas.

En otra forma de realización ventajosa de la invención se prevé detectar un desplazamiento de al menos un punto estructural en un sistema de coordenadas mediante la evaluación de las relaciones de adyacencia entre los puntos estructurales en la escena, no teniéndose en cuenta las coordenadas de al menos un punto estructural desplazado en una escena al determinar la potencia de refracción local y/o la distribución de la potencia de refracción para al menos una sección de la lente de gafas derecha y/o de la lente de gafas izquierda en el sistema de coordenadas de la montura de gafas. De este modo se puede conseguir que los movimientos de los puntos estructurales en una escena no influyan en el resultado de la medición de la potencia de refracción local y/o de la distribución de la potencia de refracción de una lente de gafas izquierda y/o derecha en una montura de gafas y no falseen el resultado de la medición.

La invención se basa especialmente en la idea de que la toma de una pluralidad de imágenes de una escena, especialmente la toma de una secuencia de película o secuencia de vídeo de una escena, con al menos un dispositivo de adquisición de imágenes desde diferentes posiciones de captura y/o direcciones de captura permite calcular los así llamados parámetros intrínsecos del al menos un dispositivo de adquisición de imágenes, así como su posición espacial con respecto a la escena mediante el procesamiento de imágenes, por ejemplo, mediante el uso de algoritmos

SLAM, es decir, algoritmos para la localización y mapeo simultáneas (Simultaneous Localization and Mapping), como se describe en la publicación "A. Teichmann et al, Unsupervised intrinsic calibration of depth sensors via SLAM, Robotics: Science and Systems 2013, Berlín Alemania, junio 24 - 28, 2013", al que se hace referencia en su totalidad y cuya revelación se incluye en la descripción de esta invención, si la escena contiene rasgos estructurales característicos con al menos un punto estructural. Aquí resulta ventajoso que la escena contenga rasgos estructurales característicos con una pluralidad de puntos estructurales definidos de forma inequívoca, preferiblemente fijos e invariables en el tiempo. Estos rasgos estructurales característicos pueden ser, por ejemplo, gradientes de luminosidad en los objetos con, por ejemplo, una intersección de dos líneas de canto, colores característicos de los objetos o también formas geométricas características de los objetos.

Por parámetros intrínsecos de un dispositivo de adquisición de imágenes, la presente invención entiende la distancia focal f de una cámara en el dispositivo de adquisición de imágenes, las coordenadas del centro de imagen Zx y Zy, el parámetro de cizallamiento s, así como los parámetros de escalado mx y my como consecuencia de los ejes de coordenadas del plano de imagen escalados de forma diferente. Estos parámetros se combinan en un operador de calibración de cámara

En el marco de la invención, los parámetros intrínsecos de una cámara también pueden ser parámetros de distorsión que sirven para determinar la distorsión de la imagen, especialmente la distorsión radial y tangencial. Los parámetros intrínsecos de un dispositivo de adquisición de imágenes describen cómo se mapea una coordenada 3D de un punto de objeto en un plano de imagen del dispositivo de adquisición de imágenes o cómo se puede calcular la trayectoria del haz correspondiente a partir de un punto dado del plano de imagen en un sistema de coordenadas fijo con respecto al dispositivo de adquisición de imágenes.

La posición de un dispositivo de adquisición de imágenes con respecto a un sistema de coordenadas en el espacio se describe mediante un operador de rotación

_ /^ll ^12 ^13\

R — í R21 R22 R23 ]

'■ R31 R32 R33'

siendo

det R = 1,

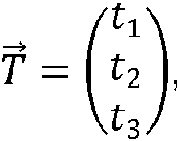

que determina la rotación de la cámara alrededor del centro del sistema de coordenadas, y un vector de traslación

que determina el desplazamiento del centro de la cámara relativamente con respecto al origen del sistema de coordenadas. Una coordenada c en este sistema de coordenadas se reproduce mediante la regla de asignación

y el cálculo de las correspondientes coordenadas bidimensionales no homogéneas por medio de la división del vector resultado por su tercera coordenada en las correspondientes coordenadas 2D en el plano de imagen de la cámara. A la inversa, para una coordenada de píxel bidimensional y en coordenadas homogéneas en el plano de imagen de la cámara mediante la regla de asignación

se puede determinar el haz de luz correspondiente que se reproduce en esta coordenada.

Esto se representa en detalle en el libro "Multiple View Geometry" de R. Hartley y A. Zisserman, Cambridge University Press 2004, páginas 153 a 193, al que se hace referencia en su totalidad y cuya revelación se incluye en la descripción de esta invención.

A partir de la pluralidad de imágenes de una escena se determinan para cada una de las distintas imágenes tomadas, es decir, para cada momento de una toma, la información de un modelo 3D de la escena sin la montura de gafas, la información de la posición y de la ubicación de la montura de gafas en la escena, así como la información de la posición del al menos un dispositivo de adquisición de imágenes en la escena. A partir de aquí se determinan las trayectorias del haz a través de las lentes de gafas para, a continuación, calcular la potencia de refracción local y/o la distribución de la potencia de refracción de la lente de gafas izquierda y/o derecha.

Por lo tanto, una variante perfeccionada ventajosa de la invención prevé utilizar un algoritmo SLAM para el cálculo de las coordenadas del al menos un punto estructural. De este modo se puede aumentar la precisión del cálculo de las coordenadas y de las posiciones de los dispositivos de adquisición de imágenes, así como minimizar el esfuerzo computacional para la determinación de las coordenadas de al menos un punto estructural en una escena y, por consiguiente, mantener reducido el tiempo computacional necesario para ello.

Un algoritmo SLAM permite especialmente calcular, a partir de imágenes de una misma escena que se toman desde diferentes posiciones de captura y que, por este motivo, muestran la escena desde diferentes perspectivas, tanto una geometría tridimensional de la escena, como también las posiciones del al menos un dispositivo de adquisición de imágenes que éste ha asumido respectivamente al tomar imágenes de la escena. Un algoritmo SLAM comprende una rutina de reconocimiento de características, que detecta las características presentes en la escena, y una rutina de correspondencia (Matching-Routine) mediante la cual se reconoce para cada característica en una imagen la característica correspondiente en las imágenes tomadas desde diferentes posiciones de captura. A continuación se crea un modelo tridimensional de la escena a partir de las posiciones correspondientes de cada característica en las capturas de imagen por medio de los parámetros intrínsecos del al menos un dispositivo de adquisición de imágenes y de las posiciones en el espacio correspondientes a las tomas de los dispositivos de adquisición de imágenes.

Un producto de programa informático según la invención incluye un programa informático con un código de programa para la realización de los pasos del procedimiento antes indicados cuando el programa informático se carga en una unidad informática y/o se ejecuta en una unidad informática.

Un dispositivo según la invención para medir la potencia de refracción local y/o la distribución de la potencia de refracción de una lente de gafas izquierda y/o derecha en una montura de gafas contiene al menos un dispositivo de adquisición de imágenes y una unidad informática en la que se carga un programa informático con un código de programa para llevar a cabo los pasos del procedimiento antes indicados.

Un dispositivo de este tipo puede configurarse especialmente como un teléfono inteligente o como una tableta o también como una cámara digital. A continuación se describen ejemplos de realización ventajosos de la invención que se representan esquemáticamente en los dibujos.

La precisión de un algoritmo SLAM, que determina tanto la posición y/o la ubicación del al menos un dispositivo de adquisición de imágenes, como también la posición de los puntos estructurales en la imagen, se determina preferiblemente mediante la calibración del al menos un dispositivo de adquisición de imágenes utilizado. Una calibración como ésta es capaz de asignar a cada coordenada de píxel C del al menos un dispositivo de adquisición de imágenes un haz de luz tridimensional que incide en el respectivo dispositivo de adquisición de imágenes. Matemáticamente, una calibración de este tipo puede expresarse como un operador intrínseco de calibración de cámara K que contiene los parámetros intrínsecos descritos anteriormente. Este operador de calibración de cámara K puede determinarse, por ejemplo, a partir de una imagen de un patrón de calibración especial, por ejemplo, de un patrón de tablero de ajedrez o un patrón de puntos por medio del al menos un dispositivo de adquisición de imágenes. Alternativamente también es posible determinar el operador intrínseco de calibración de cámara K mediante la evaluación de una pluralidad de imágenes de al menos una escena directamente a partir de la pluralidad de imágenes de la escena que pueden basarse en diferentes posiciones de captura.

Por medio de la calibración antes descrita, el algoritmo SLAM puede asignar a cada punto estructural una pluralidad de rayos de luz tridimensionales que inciden en el respectivo dispositivo de adquisición de imágenes y que no atraviesan la lente de gafas izquierda y derecha. A partir de los mismos se pueden determinar las coordenadas de los puntos estructurales en el espacio. A partir de estas coordenadas en el espacio y de las imágenes de los puntos estructurales que se han observado a través de la lente de gafas derecha y/o izquierda mediante la al menos una unidad de imagen, puede determinarse una pluralidad de trayectorias de haz de imágenes que pasan a través de la lente de gafas derecha y/o izquierda y que, tras la refracción a través de la lente de gafas derecha y/o izquierda, alcanzan el respectivo punto estructural conocido. Este modelo de rayos así configurado se utiliza preferiblemente para determinar el efecto dióptrico o la potencia de refracción local o la distribución de la potencia de refracción de la lente de gafas izquierda y/o derecha.

Para el caso de un patrón regular también se detecta su periodicidad mediante la toma de la escena. En otra forma de realización de la invención, la interpretación del aumento local dependiente de la dirección o de la reducción direccional local dependiente de la dirección del patrón a través de al menos la lente de gafas derecha y/o izquierda puede utilizarse para sacar conclusiones sobre su efecto de enfoque local. Según la norma DIN EN ISO 13666:2013-10, apartado 9.2, el efecto de enfoque es el término genérico para el efecto esférico y astigmático de una lente de gafas. Así, el efecto de enfoque local puede determinarse específicamente, por ejemplo, en el punto de visión de lejos y/o en el punto de visión de cerca. Alternativamente, mediante la determinación del efecto de enfoque local en varios puntos de la lente de gafas se puede deducir su distribución de la potencia de refracción.

En otro aspecto, el procedimiento antes descrito puede utilizarse junto con al menos otro procedimiento. En el caso del al menos otro procedimiento puede tratarse, por ejemplo, de un procedimiento para la determinación de un error de refracción de un ojo de un usuario, preferiblemente de un procedimiento según el documento EP 19 170 561.5, comprendiendo dicho procedimiento los siguientes pasos:

a) representación de un carácter en una pantalla, modificándose un parámetro del carácter mostrado en la pantalla;

b) detección de una métrica de movimiento ocular del ojo del usuario en dependencia del carácter representado en la pantalla; y

c) determinación de un momento en el que la métrica del movimiento ocular del ojo del usuario da lugar a un umbral de reconocimiento del usuario para el carácter representado en la pantalla; y

d) determinación de un valor para el error de refracción del ojo del usuario a partir del parámetro determinado en ese momento.

Alternativa o adicionalmente al procedimiento antes descrito, en el caso del al menos otro procedimiento también puede tratarse, por ejemplo, de un procedimiento para la determinación de al menos un parámetro óptico de una lente de gafas, preferiblemente de un procedimiento según la solicitud de patente europea con el número de referencia EP19170551.6, comprendiendo este procedimiento los siguientes pasos:

a) toma de una imagen utilizando una lente de gafas; y

b) determinación de al menos un parámetro óptico de la lente de gafas mediante el procesamiento de imagen de la imagen, comprendiendo la imagen una sección de ojo que rodea los ojos y/o una sección de cara adyacente a los ojos de un usuario de la lente de gafas.

Alternativa o adicionalmente a los procedimientos antes descritos, en el caso del al menos un procedimiento adicional también puede tratarse de un procedimiento para la determinación de un error de refracción de un ojo de un usuario, preferiblemente de un procedimiento según la solicitud de patente europea con el número de referencia EP19170558.1, comprendiendo este procedimiento los siguientes pasos:

a) representación de un carácter en una pantalla, modificándose un parámetro del carácter mostrado en la pantalla;

b) detección de una reacción del usuario en dependencia del carácter representado en la pantalla;

c) determinación de un momento en el que la reacción del usuario da lugar a un reconocimiento del carácter representado en la pantalla; y

d) determinación de un valor para el error de refracción del ojo del usuario a partir del parámetro determinado en el momento, siendo el carácter representado en la pantalla un patrón periódico, comprendiendo el parámetro del patrón representado en la pantalla al menos una frecuencia espacial y determinándose el valor para el error de refracción a partir de la frecuencia espacial del patrón determinada en el momento.

Alternativa o adicionalmente a los procedimientos antes descritos, como al menos un procedimiento adicional también es posible un procedimiento para determinar la distribución de la potencia de refracción de una lente de gafas, preferiblemente un procedimiento según la solicitud de patente europea con el número de referencia EP19170714.0 que permite determinar una potencia de refracción local a partir de la comparación del tamaño y/o de la forma de la imagen de la sección delantera del ojo para una dirección de visión específica. Con esta finalidad se toma al menos una imagen de la sección delantera del ojo con y sin la lente de gafas situada delante y se comparan respectivamente entre sí la imagen con y sin la lente de gafas.

En una aplicación de orden superior, los distintos procedimientos antes descritos, es decir, el procedimiento según la invención, así como el al menos un procedimiento adicional, pueden combinarse para, por ejemplo, obtener, a partir de una comparación de los resultados respectivamente obtenidos, una mayor precisión o una comprobación de la plausibilidad de los resultados obtenidos en los distintos procedimientos. En la aplicación de orden superior, los distintos procedimientos antes descritos pueden llevarse a cabo de forma sucesiva o simultánea. Si los diferentes procedimientos se realizan de forma sucesiva, su orden puede ser independiente de los demás y/o puede tratarse de un orden cualquiera. Si los diferentes procedimientos se realizan de forma sucesiva, puede resultar preferible llevar a cabo en último lugar al menos uno de los procedimientos según la invención para la determinación de la distribución de la potencia de refracción. Una aplicación de orden superior puede ser, por ejemplo, un programa informático que comprenda los distintos procedimientos.

Se muestra en la:

Figura 1 una escena con una montura de gafas y con un dispositivo de adquisición de imágenes dispuesto en diferentes posiciones de captura;

Figura 2 una sección de una primera imagen de la escena tomada por el dispositivo de adquisición de imágenes en una primera posición de captura;

Figura 3 una sección de una segunda imagen de la escena tomada por el dispositivo de adquisición de imágenes en una posición de captura adicional diferente de la primera posición de captura;

Figura 4 un sistema de coordenadas de la escena y un sistema de coordenadas del dispositivo de adquisición de imágenes con una lente de gafas;

Figura 5 un modelo de rayos de una montura de gafas al observar la escena desde dos perspectivas diferentes; Figura 6 una distribución de la potencia de refracción calculada a partir del modelo de rayos de la montura de gafas;

Figura 7 un diagrama de flujo de una configuración de un procedimiento para la medición de una lente de gafas izquierda y/o derecha en una montura de gafas;

Figura 8 un diagrama de flujo de otra configuración de un procedimiento para la medición de una lente de gafas izquierda y/o derecha en una montura de gafas;

Figura 9 otra escena con una montura de gafas y con un dispositivo de adquisición de imágenes dispuesto en diferentes posiciones de captura;

Figura 10 otra escena sin la montura de gafas con el dispositivo de adquisición de imágenes;

Figura 11 otra escena con una montura de gafas y con un dispositivo de adquisición de imágenes dispuesto en diferentes posiciones de captura;

Figura 12 una sección de la imagen de la escena tomada por el dispositivo de adquisición de imágenes en la primera posición de captura;

Figura 13 otra escena sin la montura de gafas con el dispositivo de adquisición de imágenes; y

Figura 14 una sección de la imagen de la escena tomada por el dispositivo de adquisición de imágenes sin la montura de las gafas.

La figura 1 muestra como escena 10 una mesa 12 con un mantel 14 sobre el que se han dispuesto un par de gafas 16 con una montura de gafas 18 y con las lentes de gafas izquierda y derecha 20, 22 alojadas en la misma, además de otros objetos 24 en forma de un cuchillo, de una botella, de una taza y de un libro, así como de un puro. La escena 10 mostrada en la figura 1 es invariable en el tiempo e incluye, como puntos estructurales 26, puntos característicos de un patrón del mantel 14 y de los objetos 24 que definen un sistema de coordenadas 25 de la escena 10, así como puntos característicos de la montura de gafas 18 de las gafas 16.

Para medir la potencia de refracción local de las lentes de gafas izquierda y derecha 20, 22 en las gafas 16, la escena 10 se captura mediante la cámara 28 de un dispositivo de adquisición de imágenes 30 configurado como un teléfono inteligente en una pluralidad de posiciones de captura diferentes 32, 34, 36,..., sujetando un usuario con una mano el teléfono inteligente activado en modo de vídeo y desplazándolo a lo largo de una trayectoria 38. El usuario capta así la escena 10 mediante la cámara 28 del dispositivo de adquisición de imágenes 30 desde diferentes perspectivas. Para el procesamiento de las imágenes de la escena 10 tomadas por medio de la cámara 28, el dispositivo de adquisición de imágenes 30 comprende una unidad informática 40.

La figura 2 es una sección 42 de una primera imagen de la escena 10 con imágenes 26' de puntos estructurales 26 tomada por medio del dispositivo de adquisición de imágenes 30 desde una primera posición de captura 32. En la figura 3 se muestra otra sección 42 de una primera imagen de la escena 10 con imágenes 26' de puntos estructurales 26 tomada por medio del dispositivo de adquisición de imágenes 30 desde otra posición de captura 36 diferente de la primera posición de captura 32.

Cuando el dispositivo de adquisición de imágenes 30 se desplaza relativamente con respecto a la escena 10, como puede verse en la figura 2 y en la figura 3, se captura una pluralidad de puntos estructurales 26 respectivamente con una trayectoria del haz de imágenes que atraviesa o no atraviesa la primera y/o la segunda lente de gafas 20, 22 en la montura de gafas 18 de las gafas 16. Además, a medida que el dispositivo de adquisición de imágenes 30 se desplaza relativamente con respecto a la escena 10, se toman imágenes de la escena 10 que incluyen una sección de la montura de gafas 18 que define un sistema de coordenadas 44 de la montura de gafas 18.

La figura 4 muestra el sistema de coordenadas 25 de la escena 10 y un sistema de coordenadas 46 del dispositivo de adquisición de imágenes 30 con una lente de gafas 20, 22. A partir de las numerosas imágenes tomadas de la escena 10, la unidad informática 40 en el dispositivo de adquisición de imágenes 30 calcula mediante un algoritmo SLAM las coordenadas de los puntos estructurales 26 de un patrón 27 en la escena por medio de un modelo de rayos en un sistema de coordenadas 46 referenciado al dispositivo de adquisición de imágenes 30 y referenciado a su vez al sistema de coordenadas 25 de la escena 10 y al sistema de coordenadas 44 de la montura de gafas 18 de las gafas 16.

La figura 5 muestra un modelo de rayos de las gafas 16 con trayectorias del haz de imágenes guiadas hacia la cámara 28 del dispositivo de adquisición de imágenes 30 con rayos principales 53, 53' para los puntos estructurales 26 cuando la escena 10 se captura desde dos posiciones de captura diferentes 32, 34. Un modelo de rayos como éste no sólo requiere un conocimiento de las posiciones del dispositivo de adquisición de imágenes 30, sino que también requiere un modelo tridimensional para la escena 10, así como un conocimiento de la posición de las gafas 16 mostradas en la figura 1 en la escena 10 y, además, también información sobre qué puntos estructurales 26 en la escena 10 detecta el dispositivo de adquisición de imágenes 30 a través de la lente de gafas izquierda 20 o de la lente de gafas derecha 22 de las gafas 16.

Para calcular el modelo de rayos mostrado en la figura 5 se procede como sigue con referencia a la figura 4:

A partir de la coordenada de píxel en coordenadas homogéneas

de un punto estructural 26 de un patrón 27 de la escena 10 reproducido en la cámara 28 del dispositivo de adquisición de imágenes 30, se determina con un operador de calibración de cámara conocido K un haz principal de una trayectoria del haz de imágenes que incide en la óptica de la cámara en forma de un vector tridimensional en el sistema de coordenadas 46 del dispositivo de adquisición de imágenes de la cámara 28

r0 = K 1 C

siendo

A partir de la posición espacial conocida de la cámara 28 y de su posición espacial en el sistema de coordenadas 25 se pueden determinar el operador de traslación

y el operador de rotación

siendo

det R — 1.

A partir de éstos, se convierte mediante una transformación lineal

¿ — = R d T 1 ■ ( f 0 - T )

desde el sistema de coordenadas 46 de] dispositivo de adquisición de imágenes de la cámara 28 mediante un giro correspondiente al operador de rotación R, en el sistema de coordenadas 25' y a continuación, mediante una traslación correspondiente al operador de traslación T, en el sistema de coordenadas 25 de la escena 10.

Mediante la detección y el seguimiento de puntos estructurales fijos e invariables en el tiempo 26, cuyas trayectorias del haz de imágenes no atraviesan las lentes de gafas, a través de múltiples tomas en diferentes posiciones de captura 32, 34, 36 utilizando algoritmos de coincidencia de características es posible sacar conclusiones para cada uno de estos puntos estructurales 26 sobre su posición en la escena 10 en el sistema de coordenadas 46 del dispositivo de adquisición de imágenes 30 a partir de los parámetros intrínsecos del dispositivo de adquisición de imágenes, así como de la ubicación y de la posición de un dispositivo de adquisición de imágenes en el momento de la captura de una imagen con el mismo.

A partir de cada punto estructural reproducido 26, se calcula un rayo principal 53, 53' que pasa a través de una lente de gafas 20, 22 de las gafas 16 de acuerdo con la posición del dispositivo de adquisición de imágenes 30. A partir del mismo y de la coordenada 3D del punto resulta un modelo de rayos que refleja diferentes condiciones de visión de las mismas gafas 16 en la misma escena 10 y que describe los rayos de imagen que se desvían y que corresponden a diferentes ubicaciones y posiciones de un dispositivo de adquisición de imágenes.

A través de un así llamado enfoque inverso, como se describe, por ejemplo, en la publicación de K.N. Kutukalos y E. Steger, A Theory of Refractive and specular 3D Shape by Light-Path Triangulation, International Journals of Computer Vision, 2008, tomo 76, edición 1, páginas 13 - 29, al que se hace referencia en su totalidad y cuya revelación se incluye en la descripción de esta invención, es posible a partir de este conjunto de datos determinar tanto la posición, como también la forma y la posición, así como el índice de refracción del material de la lente de gafas izquierda y derecha 20, 22 en la montura de gafas 18 de las gafas 16 y, por consiguiente, también su efecto óptico para un usuario de gafas.

Un enfoque inverso es una inversión del así llamado cálculo hacia delante, en el que se calcula en un trazado óptico de rayos, también conocido como Raytracing, el desarrollo de los rayos de luz a través de un sistema óptico compuesto por interfaces ópticas conocidas y por índices de refracción conocidos entre las interfaces. Siempre que se conozcan las interfaces, sus normales y los índices de refracción, es posible calcular de forma inequívoca cada rayo de luz a través del sistema. En el caso del enfoque inverso, se busca una interfaz óptica o un índice de refracción que coincida con un número dado de rayos de luz. Para determinar una magnitud de error, se realiza el cálculo hacia delante utilizando la superficie determinada mediante el enfoque inverso y se lleva a cabo una comparación de los puntos de rayo delante y/o detrás de la interfaz respectiva. Mediante la variación de la superficie a determinar, la magnitud de

error se minimiza específicamente mediante un procedimiento de optimización. Alternativamente a los procedimientos de optimización puros, que pueden determinar el mínimo de una función de error mediante variaciones de los parámetros, también es posible utilizar los aquí así llamados procedimientos de triangulación de la trayectoria de la luz que también se usan en combinación con un procedimiento de optimización. Los procedimientos de este tipo se describen, por ejemplo, en la publicación antes mencionada "K.N. Kutukalos und E. Steger, A Theory of Refractive and specular 3D Shape by Light-Path Triangulation, University of Toronto".

El efecto dióptrico de las lentes de gafas, si se conocen su forma y su índice de refracción, puede calcularse especialmente mediante un cálculo hacia delante de los haces de rayos. El valor de refracción en el vértice de una lente de gafas puede determinarse, por ejemplo, propagando un haz de rayos paralelo, cuyo diámetro es de unos 5 mm y que, por lo tanto, corresponde al tamaño de la pupila del ojo, a través de la lente de gafas de manera que su rayo principal, es decir, su eje óptico, salga de la lente de gafas perpendicularmente por el lado del ojo. En tal caso, el valor del valor de refracción en el vértice es el valor recíproco de la distancia de la superficie de la lente de gafas de la que sale el rayo principal hasta el punto de la cintura del rayo más pequeño o la extensión del haz de rayos. En las lentes de gafas que comprenden al menos un efecto tórico, la extensión dependiente de la dirección del haz de rayos presenta dos mínimos. La distancia de estos dos mínimos con respecto a la superficie de la lente de gafas describe el efecto de los dos cortes principales. La diferencia entre estos dos cortes principales describe el efecto cilíndrico de la lente de gafas. La desviación total del haz principal a través de la lente de gafas debe considerarse como el efecto prismático de la lente de gafas en el punto respectivo.

El así llamado operador de calibración intrínseca de cámara K sirve para la conversión de las coordenadas de píxeles C de la cámara 28 en el dispositivo de adquisición de imágenes 30 en el vector del haz de una trayectoria del haz de imágenes. El operador de calibración de cámara K puede determinarse, por ejemplo, a partir de una toma de un patrón de calibración especial, por ejemplo, un patrón de tablero de ajedrez o un patrón de puntos por medio del dispositivo de adquisición de imágenes. Alternativamente también es posible determinar el operador intrínseco de calibración de cámara K mediante la evaluación de una pluralidad de tomas o imágenes de la escena 10 directamente a partir de tomas o imágenes de la escena 10 basadas en diferentes posiciones de captura 32, 34, 36.

En la figura 6 se puede ver un gráfico 52 en relación con una distribución de la potencia de refracción k(x,y) para la lente de gafas izquierda y derecha 20, 22 calculada mediante el modelo de rayos de las gafas 16 mostrado en la figura 5.

La figura 7 es un diagrama de flujo 54 del procedimiento antes descrito para la medición de una lente de gafas izquierda y/o derecha 20, 22 en unas gafas 16.

En un primer paso S1 se toma al menos una primera imagen de una escena 10 con una pluralidad de puntos estructurales 26 y con una lente de gafas izquierda y/o derecha 20, 22 en un par de gafas 16 y con una sección de la montura de gafas 18 de las gafas 16 que define un sistema de coordenadas 44 de la montura de gafas 18 de las gafas 16 mediante un dispositivo de adquisición de imágenes 30 con una trayectoria del haz de imágenes para los puntos estructurales 26 que pasa a través de la primera y/o de la segunda lente de gafas 20, 22 de las gafas 16.

En un paso S2 que sigue al paso S1, se toman a continuación, mediante el dispositivo de adquisición de imágenes 30, al menos otras dos imágenes de la escena 10 sin la primera y/o sin la segunda lente de gafas 20, 22 de las gafas 16 con los puntos estructurales 26 representados en la primera imagen.

En un paso S3, mediante la evaluación de imágenes se lleva a cabo, a partir de las al menos dos imágenes adicionales de la escena 10, el cálculo de las coordenadas de los puntos estructurales fijos e invariables en el tiempo 26 en el sistema de coordenadas 25 de la escena 10 referenciado al sistema de coordenadas 46 del dispositivo de adquisición de imágenes 30 en las diferentes posiciones de captura.

En un paso S4 que sigue al paso S3, la distribución de la potencia de refracción k(x, y) para al menos una sección de la lente de gafas izquierda 20 se determina en el sistema de coordenadas 44 de la montura de gafas 18 referenciado al sistema de coordenadas 25 de la escena 10 y/o la distribución de la potencia de refracción k(x, y) para al menos una sección de la lente de gafas derecha 22 en un sistema de coordenadas 25 de la escena 10 referenciado al sistema de coordenadas 44 de la montura de gafas 18 se determina a partir de las coordenadas de los puntos estructurales fijos e invariables en el tiempo 26 y de la imagen de los puntos estructurales 26 en la al menos una primera imagen de la escena 10.

La figura 8 muestra un diagrama de flujo 54 para un procedimiento alternativo al procedimiento antes descrito para la medición de una lente de gafas izquierda y/o derecha 20, 22 en unas gafas 16 que se describe a continuación con referencia a las figuras 9 a 12.

De nuevo en un primer paso S1, como se muestra en la figura 9, se toma también mediante un dispositivo de adquisición de imágenes 30 una secuencia de primeras imágenes de una escena 10 invariable en el tiempo con una pluralidad de puntos estructurales 26 y con una lente de gafas izquierda y/o derecha 20, 22 en unas gafas 16 junto con una sección de la montura de gafas 18 que define un sistema de coordenadas 44 de la montura de gafas 18 mostrado en la figura 4.

Como puede verse en la figura 9, la toma de imágenes de la escena 10 se realiza en este caso con trayectorias del haz de imágenes para los puntos estructurales 26 que atraviesan al menos parcialmente la primera y/o la segunda

lente de gafas 20, 22 de las gafas 16 y que se guían al menos parcialmente al lado de la primera y/o de la segunda lente de gafas 20, 22 de las gafas 16.

Como puede verse en la figura 10, en un paso S2 que sigue al paso S1 se toma a continuación una secuencia de otras imágenes de la escena 10 con puntos estructurales fijos e invariables en el tiempo 26, pero sin las gafas 16. En este caso hay que hacer constar que el paso S2 también puede llevarse a cabo antes del o al mismo tiempo que el paso S1.

En un paso S3, el sistema de coordenadas 25 de la escena 10 está referenciado al sistema de coordenadas 44 de la montura de gafas 18, calculándose a continuación las coordenadas de los puntos estructurales 26 en el sistema de coordenadas 25 de la escena 10, referenciado al sistema de coordenadas 46 del dispositivo de adquisición de imágenes 30 en las diferentes posiciones de captura, a partir de la al menos una imagen adicional de la escena 10 mediante la evaluación de imágenes.

A continuación, en un paso S4, la distribución de la potencia de refracción k(x,y) para al menos una sección de la lente de gafas izquierda 20 se determina en el sistema de coordenadas 44 de la montura de gafas 18 referenciado al sistema de coordenadas 25 de la escena 10 y/o la distribución de la potencia de refracción k(x,y) para al menos una sección de la lente de gafas derecha 22 se determina en el sistema de coordenadas 44 de la montura de gafas 18 a partir de las coordenadas de los puntos estructurales 26 y de la imagen de los puntos estructurales 26 en la al menos una primera imagen de la escena 10.

Como se muestra en las figuras 11 a 14, la medición de una lente de gafas izquierda y/o derecha 20, 22 en una montura de gafas 18 también es posible mediante la toma de imágenes de una escena 10 en la que se encuentra un usuario de gafas con gafas y sin gafas. En este caso, como se puede ver en la figura 11, mediante un dispositivo de adquisición de imágenes 30 se toma una secuencia de primeras imágenes de una escena invariable en el tiempo 10 con una pluralidad de puntos estructurales 26 y con una lente de gafas izquierda y/o derecha 20, 22 en una montura de gafas 18 junto con una sección de la montura de gafas 18 que define un sistema de coordenadas 44 de la montura de gafas 18. Como se muestra en la figura 12, la toma de imágenes de la escena 10 se realiza aquí con trayectorias del haz de imágenes para los puntos estructurales 26 que pasan al menos parcialmente a través de la primera y/o de la segunda lente de gafas 20, 22 de las gafas 16 y que se guían al menos parcialmente al lado de la primera y/o de la segunda lente de gafas 20, 22 de las gafas 16.

A continuación, como se puede ver en la figura 13 y en la figura 14, se toma una secuencia de otras imágenes de la escena 10 con puntos estructurales 26 pero sin las gafas 16. Acto seguido, las coordenadas de los puntos estructurales 26 en un sistema de coordenadas 25 de la escena 10 referenciado al sistema de coordenadas 46 del dispositivo de adquisición de imágenes 30 en diferentes posiciones de captura se calculan a partir de la al menos una imagen adicional de la escena 10 mediante la evaluación de imágenes y el sistema de coordenadas 25 de la escena 10 se referencia al sistema de coordenadas 44 de la montura de gafas 18. A continuación, la distribución de la potencia de refracción k(x,y) para al menos una sección de la lente de gafas izquierda 20 se determina en el sistema de coordenadas 44 de la montura de gafas 18 y/o la distribución de la potencia de refracción k(x,y) para al menos una sección de la lente de gafas derecha 22 se determina en el sistema de coordenadas 44 de la montura de gafas 18 a partir de las coordenadas de los puntos estructurales 26 y de la imagen de los puntos estructurales 26 en la al menos una primera imagen de la escena 10.