ES2950876T3 - Restricciones del intervalo dinámico de desplazamiento para el filtrado SAO de desplazamiento de bordes - Google Patents

Restricciones del intervalo dinámico de desplazamiento para el filtrado SAO de desplazamiento de bordes Download PDFInfo

- Publication number

- ES2950876T3 ES2950876T3 ES13815858T ES13815858T ES2950876T3 ES 2950876 T3 ES2950876 T3 ES 2950876T3 ES 13815858 T ES13815858 T ES 13815858T ES 13815858 T ES13815858 T ES 13815858T ES 2950876 T3 ES2950876 T3 ES 2950876T3

- Authority

- ES

- Spain

- Prior art keywords

- video

- video samples

- edge

- value

- samples

- Prior art date

- Legal status (The legal status is an assumption and is not a legal conclusion. Google has not performed a legal analysis and makes no representation as to the accuracy of the status listed.)

- Active

Links

- 238000001914 filtration Methods 0.000 title description 4

- 238000000034 method Methods 0.000 claims abstract description 73

- 238000006073 displacement reaction Methods 0.000 claims description 47

- 238000005457 optimization Methods 0.000 claims description 24

- 238000004590 computer program Methods 0.000 claims description 8

- 238000010586 diagram Methods 0.000 description 36

- 230000003044 adaptive effect Effects 0.000 description 17

- 238000004364 calculation method Methods 0.000 description 12

- 230000007704 transition Effects 0.000 description 5

- 230000007246 mechanism Effects 0.000 description 4

- 238000013139 quantization Methods 0.000 description 4

- 230000008901 benefit Effects 0.000 description 3

- 230000008569 process Effects 0.000 description 3

- 235000002566 Capsicum Nutrition 0.000 description 2

- 239000006002 Pepper Substances 0.000 description 2

- 241000722363 Piper Species 0.000 description 2

- 235000016761 Piper aduncum Nutrition 0.000 description 2

- 235000017804 Piper guineense Nutrition 0.000 description 2

- 235000008184 Piper nigrum Nutrition 0.000 description 2

- 230000006835 compression Effects 0.000 description 2

- 238000007906 compression Methods 0.000 description 2

- 230000001419 dependent effect Effects 0.000 description 2

- 238000005516 engineering process Methods 0.000 description 2

- 230000006870 function Effects 0.000 description 2

- 150000003839 salts Chemical class 0.000 description 2

- 230000006978 adaptation Effects 0.000 description 1

- 238000004422 calculation algorithm Methods 0.000 description 1

- 238000011161 development Methods 0.000 description 1

- 230000018109 developmental process Effects 0.000 description 1

- 230000006872 improvement Effects 0.000 description 1

- 230000009467 reduction Effects 0.000 description 1

Classifications

-

- H—ELECTRICITY

- H04—ELECTRIC COMMUNICATION TECHNIQUE

- H04N—PICTORIAL COMMUNICATION, e.g. TELEVISION

- H04N19/00—Methods or arrangements for coding, decoding, compressing or decompressing digital video signals

- H04N19/65—Methods or arrangements for coding, decoding, compressing or decompressing digital video signals using error resilience

-

- H—ELECTRICITY

- H04—ELECTRIC COMMUNICATION TECHNIQUE

- H04N—PICTORIAL COMMUNICATION, e.g. TELEVISION

- H04N19/00—Methods or arrangements for coding, decoding, compressing or decompressing digital video signals

- H04N19/10—Methods or arrangements for coding, decoding, compressing or decompressing digital video signals using adaptive coding

- H04N19/134—Methods or arrangements for coding, decoding, compressing or decompressing digital video signals using adaptive coding characterised by the element, parameter or criterion affecting or controlling the adaptive coding

- H04N19/146—Data rate or code amount at the encoder output

- H04N19/147—Data rate or code amount at the encoder output according to rate distortion criteria

-

- H—ELECTRICITY

- H04—ELECTRIC COMMUNICATION TECHNIQUE

- H04N—PICTORIAL COMMUNICATION, e.g. TELEVISION

- H04N19/00—Methods or arrangements for coding, decoding, compressing or decompressing digital video signals

- H04N19/10—Methods or arrangements for coding, decoding, compressing or decompressing digital video signals using adaptive coding

- H04N19/102—Methods or arrangements for coding, decoding, compressing or decompressing digital video signals using adaptive coding characterised by the element, parameter or selection affected or controlled by the adaptive coding

- H04N19/117—Filters, e.g. for pre-processing or post-processing

-

- H—ELECTRICITY

- H04—ELECTRIC COMMUNICATION TECHNIQUE

- H04N—PICTORIAL COMMUNICATION, e.g. TELEVISION

- H04N19/00—Methods or arrangements for coding, decoding, compressing or decompressing digital video signals

- H04N19/10—Methods or arrangements for coding, decoding, compressing or decompressing digital video signals using adaptive coding

- H04N19/134—Methods or arrangements for coding, decoding, compressing or decompressing digital video signals using adaptive coding characterised by the element, parameter or criterion affecting or controlling the adaptive coding

- H04N19/136—Incoming video signal characteristics or properties

- H04N19/14—Coding unit complexity, e.g. amount of activity or edge presence estimation

-

- H—ELECTRICITY

- H04—ELECTRIC COMMUNICATION TECHNIQUE

- H04N—PICTORIAL COMMUNICATION, e.g. TELEVISION

- H04N19/00—Methods or arrangements for coding, decoding, compressing or decompressing digital video signals

- H04N19/10—Methods or arrangements for coding, decoding, compressing or decompressing digital video signals using adaptive coding

- H04N19/169—Methods or arrangements for coding, decoding, compressing or decompressing digital video signals using adaptive coding characterised by the coding unit, i.e. the structural portion or semantic portion of the video signal being the object or the subject of the adaptive coding

- H04N19/17—Methods or arrangements for coding, decoding, compressing or decompressing digital video signals using adaptive coding characterised by the coding unit, i.e. the structural portion or semantic portion of the video signal being the object or the subject of the adaptive coding the unit being an image region, e.g. an object

- H04N19/172—Methods or arrangements for coding, decoding, compressing or decompressing digital video signals using adaptive coding characterised by the coding unit, i.e. the structural portion or semantic portion of the video signal being the object or the subject of the adaptive coding the unit being an image region, e.g. an object the region being a picture, frame or field

-

- H—ELECTRICITY

- H04—ELECTRIC COMMUNICATION TECHNIQUE

- H04N—PICTORIAL COMMUNICATION, e.g. TELEVISION

- H04N19/00—Methods or arrangements for coding, decoding, compressing or decompressing digital video signals

- H04N19/10—Methods or arrangements for coding, decoding, compressing or decompressing digital video signals using adaptive coding

- H04N19/169—Methods or arrangements for coding, decoding, compressing or decompressing digital video signals using adaptive coding characterised by the coding unit, i.e. the structural portion or semantic portion of the video signal being the object or the subject of the adaptive coding

- H04N19/182—Methods or arrangements for coding, decoding, compressing or decompressing digital video signals using adaptive coding characterised by the coding unit, i.e. the structural portion or semantic portion of the video signal being the object or the subject of the adaptive coding the unit being a pixel

-

- H—ELECTRICITY

- H04—ELECTRIC COMMUNICATION TECHNIQUE

- H04N—PICTORIAL COMMUNICATION, e.g. TELEVISION

- H04N19/00—Methods or arrangements for coding, decoding, compressing or decompressing digital video signals

- H04N19/10—Methods or arrangements for coding, decoding, compressing or decompressing digital video signals using adaptive coding

- H04N19/189—Methods or arrangements for coding, decoding, compressing or decompressing digital video signals using adaptive coding characterised by the adaptation method, adaptation tool or adaptation type used for the adaptive coding

- H04N19/196—Methods or arrangements for coding, decoding, compressing or decompressing digital video signals using adaptive coding characterised by the adaptation method, adaptation tool or adaptation type used for the adaptive coding being specially adapted for the computation of encoding parameters, e.g. by averaging previously computed encoding parameters

- H04N19/198—Methods or arrangements for coding, decoding, compressing or decompressing digital video signals using adaptive coding characterised by the adaptation method, adaptation tool or adaptation type used for the adaptive coding being specially adapted for the computation of encoding parameters, e.g. by averaging previously computed encoding parameters including smoothing of a sequence of encoding parameters, e.g. by averaging, by choice of the maximum, minimum or median value

-

- H—ELECTRICITY

- H04—ELECTRIC COMMUNICATION TECHNIQUE

- H04N—PICTORIAL COMMUNICATION, e.g. TELEVISION

- H04N19/00—Methods or arrangements for coding, decoding, compressing or decompressing digital video signals

- H04N19/80—Details of filtering operations specially adapted for video compression, e.g. for pixel interpolation

- H04N19/82—Details of filtering operations specially adapted for video compression, e.g. for pixel interpolation involving filtering within a prediction loop

Landscapes

- Engineering & Computer Science (AREA)

- Multimedia (AREA)

- Signal Processing (AREA)

- Computing Systems (AREA)

- Theoretical Computer Science (AREA)

- Compression Or Coding Systems Of Tv Signals (AREA)

- Filters That Use Time-Delay Elements (AREA)

- Networks Using Active Elements (AREA)

- Picture Signal Circuits (AREA)

Abstract

La invención se refiere a un método (100) y a un aparato (200) para procesar adaptativamente muestras de video en un cuadro de señal de video, estando dispuestas las muestras de video en una Unidad de Codificación Más Grande, comprendiendo el método (100): extraer (103) una pluralidad de muestras de vídeo de la Unidad de Codificación Más Grande; calcular (107) un desplazamiento de corrección para una primera muestra de vídeo de la pluralidad de muestras de vídeo extraídas sobre la base de un primer valor de la primera muestra de vídeo y un segundo valor de una segunda muestra de vídeo de la pluralidad de muestras de vídeo extraídas; y ponderar (109) la primera muestra de vídeo con el desplazamiento de corrección. (Traducción automática con Google Translate, sin valor legal)

Description

DESCRIPCIÓN

Restricciones del intervalo dinámico de desplazamiento para el filtrado SAO de desplazamiento de bordes

Campo técnico

La invención se refiere al campo del procesamiento de señales de vídeo.

Antecedentes de la invención

Los métodos de compresión con pérdidas para imágenes fijas, imágenes o fotogramas de señales de vídeo normalmente provocan distorsión de la imagen fija, la imagen o el fotograma de señales de vídeo. Esto significa que puede haber una diferencia entre los valores de los píxeles o muestras de vídeo correspondientes en una señal de origen y una señal reconstruida. La diferencia entre los valores de los píxeles o muestras de vídeo correspondientes en una señal de origen y una señal reconstruida generalmente se denota como error.

En muchos códecs de vídeo estandarizados, por ejemplo, H.264/AVC y H.265/HEVC, hay dos fuentes principales de distorsión: la cuantificación, en donde la intensidad de cuantificación puede definirse mediante un parámetro de cuantificación, QP, y el filtro de desbloqueo adaptativo en bucle, a Df .

El error entre los valores de los píxeles o las muestras de vídeo correspondientes en una señal de origen y una señal reconstruida generalmente se compensa mediante dos mecanismos: la disminución del valor del parámetro de cuantificación y el impacto negativo del filtro de desbloqueo adaptativo en bucle en los valores de error de píxeles o muestras de vídeo ubicadas en regiones cercanas al límite, y compensando directamente los errores.

Para estándares de codificación de vídeo emergentes, por ejemplo, codificación de vídeo de alta eficiencia, HEVC, se proponen dos métodos para la compensación directa de los errores. El primero se llama desplazamiento adaptativo de muestra, SAO, y el segundo se llama filtro de bucle adaptativo, ALF.

En el caso de SAO, si no se restringe la magnitud de un píxel o una muestra de vídeo después de aplicar un desplazamiento de SAO, pueden producirse artefactos causados por ruido de impulso, por ejemplo, ruido de sal y pimienta.

La razón principal por la que aparece ruido de este tipo es que la diferencia entre la magnitud de un píxel o muestra de vídeo bajo consideración y sus píxeles o muestras de vídeo vecinos es demasiado alta. Para aliviar este problema, los estándares de codificación de vídeo, por ejemplo, el estándar H.265/HEVC, restringen el valor absoluto máximo que se puede asignar a los desplazamientos. Por lo tanto, la ganancia de codificación potencialmente alcanzable es limitada. Por lo tanto, es un problema cómo evitar el ruido impulsivo sin una pérdida en la ganancia de codificación.

En el documento de P. List, A. Joch, J. Lainema, G. Bj0ntegaard, M. Karczewicz, "Adaptive Deblocking Filter", IEEE Transactions on Circuits and Systems for video Technology, vol. 13, No. 7, julio de 2003, pp. 614-619, se realiza una clasificación de muestras de vídeo o píxeles usando patrones unidimensionales.

En el documento de K. McCann, W.-J. Han, I.-K. Kim, J.-H. Min, E. Alshina, A. Alshin, T. Lee, J. Chen, V. Seregin, S. Lee, Y.-M. Hong, M.-S. Cheon, N. Shlyakhov, "Samsung's Response to the Call for Proposals on Video Compression Technology", Contribución a la reunión de JCT-VC, JCTVC-A124, Dresde, abril de 2010, se describe el método de corrección extrema. Este método usa un conjunto de patrones bidimensionales predefinidos para clasificar píxeles o muestras de vídeo de la imagen reconstruida.

En el documento de A. Fuldseth, G. Bj0ntegaard, "SAG with LCU-based sintax", contribución de Cisco a la reunión de JCT-VC, JCTVC-H0067, San José, febrero de 2012, se propone no codificar las magnitudes de desplazamiento sino fijar sus valores a 1 o -1 dependiendo de la categoría.

La técnica anterior seleccionada adicional se describe en el documento de CHIH-MING FU ET AL: "Sample Adaptive Offset in the HEVC Standard" IEEE TRANSACTIONS ON CIRCUITS AND SYSTEMS FOR VIDEO TECHNOLOGIE, IEEE SERVICE CENTER, PISCATAWAY, NJ, EE. UU., vol. 22, núm. 12, 1 de diciembre de 2012, páginas 1755-1764.

El documento de Andersson K et al: "AHG6: SAO simplification", 100. REUNIÓN MPEG, documento M24312 o JCTVC-I0073_r1 muestra una restricción del SAO en función de la profundidad de bits.

Compendio de la invención

La presente invención se define por las reivindicaciones independientes. Las reivindicaciones dependientes muestran desarrollos ventajosos adicionales.

Es el objeto de la invención proporcionar un método mejorado para compensar directamente los errores en los fotogramas de la señal de vídeo.

Las realizaciones etiquetadas como realizaciones de la invención a continuación, pero que no caen dentro del alcance de protección definido por las reivindicaciones independientes, deben entenderse como ejemplos útiles para comprender la invención, pero no como realizaciones de la invención. Lo mismo se aplica también a la enseñanza denominada "forma de implementación" así como a la "implementación de la invención".

Este objeto se logra mediante las características de las reivindicaciones independientes. Son evidentes las formas de implementación adicionales a partir de las reivindicaciones dependientes, la descripción y las figuras.

La invención se basa en el hallazgo de que cada muestra de vídeo en el fotograma de señal de vídeo puede procesarse de forma adaptativa.

Según un primer aspecto, la invención se refiere a un método para procesar de manera adaptativa muestras de vídeo en un fotograma de señal de vídeo, estando dispuestas las muestras de vídeo en una unidad de codificación más grande, y el método se define adicionalmente en la reivindicación 1 independiente.

El fotograma de señal de vídeo puede representar una señal de vídeo en un instante de tiempo fijo. El fotograma de señal de vídeo puede comprender una imagen fija o una imagen.

Las muestras de vídeo se pueden caracterizar por una coordenada bidimensional. Las muestras de vídeo se pueden caracterizar además por un espacio de color, por ejemplo, un espacio de color en escala de grises o un espacio de color rojo verde azul (RGB).

El valor de una muestra de vídeo puede ser un número, por ejemplo, 20, 45 o 236. El valor de una muestra de vídeo también puede relacionarse con un canal de color de un espacio de color, por ejemplo, el canal de color rojo del espacio de color rojo verde azul (RGB).

La unidad de codificación más grande, LCU, puede comprender una unidad de árbol de codificación, CTU. La forma de la unidad de codificación más grande puede ser cuadrada, por ejemplo, muestras de vídeo de 16x16 o muestras de vídeo de 64x64, o rectangular, por ejemplo, muestras de vídeo de 8x16 o muestras de vídeo de 64x32.

La clase de desplazamiento de bordes, EO, puede indicar un patrón direccional de la pluralidad de muestras de vídeo extraídas.

La clase de desplazamiento de bordes se puede asignar antes de extraer la pluralidad de muestras de vídeo de la unidad de codificación más grande.

La categoría de desplazamiento de bordes, EO, puede caracterizar una alineación de las muestras de vídeo extraídas entre sí. La categoría de desplazamiento de bordes se puede seleccionar después de extraer la pluralidad de muestras de vídeo de la unidad de codificación más grande.

En una primera forma de implementación del método según el primer aspecto, la clase de desplazamiento de bordes indica un patrón direccional horizontal, un patrón direccional vertical o un patrón direccional diagonal. Por lo tanto, el método puede aprovechar las propiedades direccionales del fotograma de la señal de vídeo.

El patrón direccional horizontal se puede caracterizar por una coordenada vertical fija o una coordenada y fija de la pluralidad de muestras de vídeo extraídas.

El patrón direccional vertical puede caracterizarse por una coordenada horizontal fija o una coordenada x fija de la pluralidad de muestras de vídeo extraídas.

El patrón direccional diagonal se puede caracterizar por una relación lineal entre la coordenada horizontal o la coordenada x y la coordenada vertical o la coordenada y de la pluralidad de muestras de vídeo extraídas. El patrón direccional diagonal puede presentar un ángulo distinto de cero con respecto al eje de coordenadas horizontales o al eje de coordenadas x, por ejemplo, un ángulo de 135° o 45°.

En una segunda forma de implementación del método según la primera forma de implementación, la categoría de desplazamiento de bordes caracteriza una alineación del valle local, una alineación del pico local, una alineación de la esquina cóncava, una alineación de la esquina convexa o una alineación restante de las

muestras de vídeo extraídas entre sí. Por lo tanto, el método puede aprovechar las propiedades de alineación de las muestras de vídeo extraídas entre sí.

La alineación de las muestras de vídeo extraídas puede comprender la alineación de los valores de las muestras de vídeo extraídas.

La alineación del valle local se puede caracterizar por un mínimo local del primer valor de la primera muestra de vídeo en relación con otros valores de otras muestras de vídeo extraídas.

La alineación del pico local puede caracterizarse por un máximo local del primer valor de la primera muestra de vídeo con respecto a otros valores de otras muestras de vídeo extraídas.

La alineación de la esquina cóncava se puede caracterizar por un mínimo del primer valor de la primera muestra de vídeo y un segundo valor de una segunda muestra de vídeo en relación con otros valores de otras muestras de vídeo extraídas. El primer valor de la primera muestra de vídeo y el segundo valor de la segunda muestra de vídeo pueden ser iguales.

La alineación de la esquina convexa puede caracterizarse por un máximo del primer valor de la primera muestra de vídeo y un segundo valor de una segunda muestra de vídeo en relación con otros valores de otras muestras de vídeo extraídas. El primer valor de la primera muestra de vídeo y el segundo valor de la segunda muestra de vídeo pueden ser iguales.

La alineación restante se puede caracterizar por cualquier alineación que difiera de la alineación del valle local, la alineación del pico local, la alineación de la esquina cóncava y la alineación de la esquina convexa. En una tercera forma de implementación del método según la primera forma de implementación del método o, la segunda forma de implementación del método, la clase de desplazamiento de bordes se asigna mediante un procedimiento de optimización de la distorsión de la tasa o la categoría de desplazamiento de bordes se selecciona mediante un procedimiento de optimización de la distorsión de la tasa, el procedimiento de optimización de la distorsión de la tasa que usa una tabla de consulta de distorsión para asignar la clase de desplazamiento de bordes o para seleccionar la categoría de desplazamiento de bordes. Por lo tanto, se puede lograr una asignación optimizada de la clase de desplazamiento de bordes y una selección optimizada de la categoría de desplazamiento de bordes.

El procedimiento de optimización de la distorsión de la tasa, RDO, puede realizar una optimización entre la tasa de una señal de vídeo y la distorsión de una señal de vídeo. El procedimiento de optimización de la distorsión de la tasa puede asignar una clase de desplazamiento de bordes. El procedimiento de optimización de la distorsión de la tasa puede seleccionar además una categoría de desplazamiento de bordes.

La tabla de consulta de distorsión, LUT de distorsión, puede ser usada por el procedimiento de optimización de la distorsión de la tasa para asignar una clase de desplazamiento de bordes y/o para seleccionar una categoría de desplazamiento de bordes.

En otra forma de implementación del método según el primer aspecto como tal o cualquiera de las formas de implementación anteriores del primer aspecto, extraer la pluralidad de muestras de vídeo de la unidad de codificación más grande comprende extraer una pluralidad de muestras de vídeo adyacentes de la unidad de codificación más grande. Por lo tanto, el método puede aprovechar las propiedades de muestras de vídeo ubicadas de cerca.

Las muestras de vídeo adyacentes se pueden caracterizar porque cada muestra de vídeo tiene al menos una muestra de vídeo vecina.

En otra forma de implementación del método según el primer aspecto como tal o cualquiera de las formas de implementación anteriores del primer aspecto, la pluralidad de muestras de vídeo extraídas comprende un número impar de muestras de vídeo, en particular 3 muestras de vídeo. Por lo tanto, la primera muestra de vídeo se puede centrar con respecto a las otras muestras de vídeo de la pluralidad de muestras de vídeo extraídas.

El intervalo de valores permitidos, RAV, se puede caracterizar por un valor mínimo y un valor máximo. El intervalo de valores permitidos puede comprender un conjunto continuo de valores.

La lista de valores permitidos, LAV, puede caracterizarse por un conjunto de valores discretos extraídos del intervalo de valores permitidos.

Según un segundo aspecto, la invención se refiere a un aparato para procesar de forma adaptativa muestras de vídeo en un fotograma de señal de vídeo, estando dispuestas las muestras de vídeo en una unidad de

codificación más grande, comprendiendo el aparato un procesador y estando definido además por la reivindicación 7.

El procesador puede configurarse para ejecutar un programa informático.

El aparato puede configurarse para realizar el método según el primer aspecto como tal o cualquiera de las formas de implementación del primer aspecto.

Otras características del aparato pueden resultar de la funcionalidad del método según el primer aspecto como tal o cualquiera de las formas de implementación del primer aspecto.

En una primera forma de implementación del aparato según el segundo aspecto, el procesador está configurado además para realizar un procedimiento de optimización de la distorsión de la tasa para asignar la clase de desplazamiento de bordes o seleccionar la categoría de desplazamiento de bordes, el procedimiento de optimización de la distorsión de la tasa que usa una tabla de consulta de distorsión para asignar la clase de desplazamiento de bordes o para seleccionar la categoría de desplazamiento de bordes. Por lo tanto, se puede lograr una asignación optimizada de la clase de desplazamiento de bordes y una selección optimizada de la categoría de desplazamiento de bordes.

Según un tercer aspecto, la invención se refiere a un programa informático para realizar el método según el primer aspecto como tal o cualquiera de las formas de implementación del primer aspecto cuando se ejecutan en un ordenador. Por lo tanto, el método se puede realizar de manera eficiente y repetible.

El programa informático se puede proporcionar en forma de un código legible por máquina. El programa informático puede comprender una serie de comandos para un procesador de un ordenador.

El ordenador puede comprender un procesador, una memoria y/o medios de entrada/salida.

El programa informático puede configurarse para realizar el método según el primer aspecto como tal o cualquiera de las formas de implementación del primer aspecto.

Otras características del programa informático pueden resultar de la funcionalidad del método según el primer aspecto como tal o cualquiera de las formas de implementación del primer aspecto.

La invención puede implementarse en hardware y/o software.

Otras realizaciones de la invención se describen con respecto a las siguientes figuras, en las que:

La Fig. 1 muestra un diagrama esquemático de un método para procesar de manera adaptativa muestras de vídeo en un fotograma de señal de vídeo;

La Fig. 2 muestra un diagrama esquemático de un aparato para el procesamiento adaptativo de muestras de vídeo en un fotograma de señal de vídeo;

La Fig. 3 muestra un diagrama esquemático de un esquema de codificación con desplazamiento adaptativo de muestras basado en la unidad de codificación más grande;

La Fig. 4 muestra un diagrama esquemático de cuatro patrones direccionales unidimensionales para la clasificación de muestras de vídeo con desplazamiento de bordes;

La Fig. 5 muestra un diagrama esquemático de cuatro categorías de desplazamiento de bordes;

La Fig. 6 muestra una tabla que comprende definiciones matemáticas de categorías de desplazamiento de bordes;

La Fig. 7 muestra un diagrama esquemático de cuatro patrones direccionales unidimensionales para la clasificación de muestras de vídeo con desplazamiento de bordes que comprenden cinco muestras;

La Fig. 8 muestra un diagrama esquemático del error final después de un filtro de desplazamiento adaptativo de muestras;

La Fig. 9 muestra un diagrama esquemático de un esquema suave para la adaptación del valor de un píxel o muestra de vídeo mientras se aplica un desplazamiento de bordes;

La Fig. 10 muestra un diagrama esquemático de un esquema duro para la adaptación del valor de un píxel o muestra de vídeo mientras se aplica un desplazamiento de bordes;

La Fig. 11 muestra un diagrama esquemático de un esquema de interpolación lineal para patrones de desplazamiento de bordes de cinco muestras;

La Fig. 12 muestra un diagrama esquemático de un esquema de interpolación cúbico para patrones de desplazamiento de bordes de cinco muestras;

La Fig. 13 muestra un diagrama esquemático de un esquema de filtrado para patrones de desplazamiento de bordes de cinco muestras;

La Fig. 14 muestra un diagrama esquemático de las transiciones permitidas desde una categoría de desplazamiento de bordes a otra categoría de desplazamiento de bordes;

La Fig. 15 muestra un diagrama esquemático de una estimación estadística de un procedimiento de optimización de la distorsión de la tasa;

La Fig. 16 muestra un diagrama esquemático de una estructura de una tabla de consulta de distorsión;

La Fig. 17 muestra un diagrama esquemático de un decodificador de vídeo mejorado; y

La Fig. 18 muestra un diagrama esquemático de un decodificador conjunto.

Descripción detallada de las realizaciones de la invención

La Fig. 1 muestra un diagrama esquemático de un método 100 para procesar de forma adaptativa muestras de vídeo en un fotograma de señal de vídeo. Las muestras de vídeo se pueden organizar en una unidad de codificación más grande.

El método 100 puede comprender asignar 101 una clase de desplazamiento de bordes a la pluralidad de muestras de vídeo extraídas, indicando la clase de desplazamiento de bordes un patrón direccional de la pluralidad de muestras de vídeo extraídas, extraer 103 una pluralidad de muestras de vídeo de la unidad de codificación más grande, seleccionar 105 una categoría de desplazamiento de bordes de una pluralidad de categorías de desplazamiento de bordes para la pluralidad de muestras de vídeo extraídas, caracterizando la categoría de desplazamiento de bordes una alineación de las muestras de vídeo extraídas entre sí, siendo asignadas la pluralidad de categorías de desplazamiento de bordes a la clase de desplazamiento de bordes; calcular 107 un desplazamiento de corrección para una primera muestra de vídeo de la pluralidad de muestras de vídeo extraídas sobre la base de un primer valor de la primera muestra de vídeo y un segundo valor de una segunda muestra de vídeo de la pluralidad de muestras de vídeo extraídas. De este modo, se puede determinar una categoría de desplazamiento de bordes para cada una de las muestras de vídeo de la pluralidad de muestras de vídeo.

El método comprende además ponderar 109 la primera muestra de vídeo con el desplazamiento de corrección. De este modo, se puede realizar la corrección adaptativa de muestras de vídeo de la pluralidad de muestras de vídeo con el desplazamiento de corrección que se determina adaptando el valor de desplazamiento al intervalo o la lista de valores de desplazamiento permitidos.

El método puede comprender además determinar los valores de desplazamiento de intensidad para las categorías de desplazamiento de bordes entre las etapas 101 y 103.

El método puede comprender además calcular un intervalo o lista de valores de desplazamientos permitidos para cada una de las muestras de vídeo de la pluralidad de muestras de vídeo entre las etapas 103 y 107.

La Fig. 2 muestra un diagrama esquemático de un aparato 200 para procesar de forma adaptativa muestras de vídeo en un fotograma de señal de vídeo. Las muestras de vídeo se pueden organizar en una unidad de codificación más grande.

El aparato 200 puede comprender un procesador 201 que está configurado para extraer una pluralidad de muestras de vídeo de la unidad de codificación más grande, estando configurado el procesador 201 para calcular un desplazamiento de corrección para una primera muestra de vídeo de la pluralidad de muestras de vídeo extraídas sobre la base de un primer valor de la primera muestra de vídeo y un segundo valor de una segunda muestra de vídeo de la pluralidad de muestras de vídeo extraídas, y el procesador 201 que está configurado para ponderar la primera muestra de vídeo con el desplazamiento de corrección.

El procesador 201 puede configurarse además para asignar una clase de desplazamiento de bordes a la pluralidad de muestras de vídeo extraídas, indicando la clase de desplazamiento de bordes un patrón direccional de la pluralidad de muestras de vídeo extraídas, y el procesador 201 puede configurarse además

para seleccionar una categoría de desplazamiento de bordes de una pluralidad de categorías de desplazamiento de bordes para la pluralidad de muestras de vídeo extraídas, caracterizando la categoría de desplazamiento de bordes una alineación de las muestras de vídeo extraídas entre sí, asignándose la pluralidad de categorías de desplazamiento de bordes a la clase de desplazamiento de bordes.

El procesador 201 puede configurarse además para realizar un procedimiento de optimización de la distorsión de la tasa para asignar la clase de desplazamiento de bordes o seleccionar la categoría de desplazamiento de bordes, usando el procedimiento de optimización de la distorsión de la tasa una tabla de consulta de distorsión para asignar la clase de desplazamiento de bordes o para seleccionar la categoría de desplazamiento de bordes.

El procesador 201 puede configurarse para ejecutar un programa informático.

La Fig. 3 muestra un diagrama 300 esquemático de un esquema de codificación con desplazamiento adaptativo de muestras basado en la unidad de codificación más grande.

La idea del desplazamiento adaptativo de muestras, SAO, es compensar los errores directamente usando un desplazamiento que se suma o resta de los valores de píxeles o muestras de vídeo seleccionados, y la clasificación como un mecanismo para seleccionar dichos píxeles o muestras de vídeo a las que se aplica el desplazamiento. SAO comprende dos tipos de desplazamientos: desplazamiento de bordes, EO, y desplazamiento de banda, BO. Estos tipos también se denominan tipos SAO.

En el caso de EO, la clasificación de las muestras de vídeo se basa en la comparación entre las muestras de vídeo actuales y las muestras de vídeo vecinas. En el caso de BO, la clasificación de las muestras de vídeo se basa en los valores de las muestras de vídeo. BO implica que se añade un desplazamiento a todas las muestras de vídeo de la misma banda. Por ejemplo, en la versión final del estándar H.265/HEVC, SAO puede estar basado en la unidad de codificación más grande, LCU. Esto significa que los parámetros de SAO se pueden calcular para cada LCU, que se pueden codificar usando EO o BO. Si los dos tipos de SAO no son rentables en términos de la teoría de la distorsión de la tasa o la teoría RD, se puede desactivar el SAO.

SAO puede considerarse como un filtro en bucle que se coloca después del ADF. La invención se refiere principalmente a EO.

En el lado del codificador para imágenes o fotogramas de vídeo colocados en un búfer de imágenes decodificadas, DPB, y en el lado del decodificador, la magnitud resultante de un píxel o muestra de vídeo cambiada por SAO se calcula usando la siguiente fórmula:

en donde p denota la magnitud del píxel o muestra de vídeo antes del filtro SAO, y Asao denota el valor de desplazamiento.

La Fig. 4 muestra un diagrama 400 esquemático de cuatro patrones direccionales unidimensionales para la clasificación de muestras de vídeo con desplazamiento de bordes.

El patrón direccional A se relaciona con un patrón direccional horizontal (clase de EO = 0). El patrón direccional B se relaciona con un patrón direccional vertical (clase de EO = 1). El patrón direccional C se relaciona con un patrón direccional diagonal de 135° (clase de EO = 2). El patrón direccional D se relaciona con un patrón direccional diagonal de 45° (clase de EO = 3).

Inicialmente, se ha propuesto el uso de patrones bidimensionales para la clasificación de píxeles o muestras de vídeo. Sin embargo, una clasificación de este tipo puede ser intensiva desde el punto de vista de cálculo. Para mantener un equilibrio razonable entre la complejidad y la eficiencia de la codificación, EO puede usar cuatro patrones direccionales unidimensionales para la clasificación de muestras de vídeo: horizontal, vertical, 135° en diagonal y 45° en diagonal, en donde la etiqueta "c" representa una muestra de vídeo actual y las etiquetas "a" y "b" representan dos muestras de vídeo vecinas. Según estos patrones direccionales, se pueden especificar cuatro clases de EO, y cada clase de EO puede corresponder a un patrón direccional.

En el lado del codificador, se puede seleccionar una clase de EO para cada LCU que habilita EO. Basado en la optimización de la distorsión de la tasa, RDO, la mejor clase de Eo puede incorporarse o enviarse en el flujo de bits como información adicional. Para una clase de EO dada, cada muestra de vídeo dentro de la LCU puede clasificarse en una de cinco categorías.

La figura 5 muestra un diagrama 500 esquemático de cuatro categorías de desplazamiento de bordes.

El valor de muestra de vídeo actual, etiquetado como "c", se puede comparar con sus dos vecinos a lo largo del patrón unidimensional seleccionado. Las categorías 1 y 4 están asociadas con un valle local y un pico local a lo largo del patrón unidimensional seleccionado, respectivamente. Las categorías 2 y 3 están asociadas con esquinas cóncavas y convexas a lo largo del patrón unidimensional seleccionado, respectivamente.

A diferencia de los desplazamientos BO cuyo signo está escrito explícitamente, el signo de los desplazamientos EO se puede definir implícitamente usando sus categorías, a saber: para las categorías 1 y 2 de EO, el desplazamiento puede ser positivo, es decir, puede ser mayor que cero, y para las categorías 3 y 4 de EO, el desplazamiento puede ser negativo, es decir, puede ser menor que cero. Si la muestra de vídeo actual no pertenece a las categorías 1 a 4 de EO, entonces puede pertenecer a la categoría 0 y es posible que EO no se aplique a esta muestra de vídeo.

La Fig. 6 muestra una tabla 600 que comprende definiciones matemáticas de categorías de desplazamiento de bordes.

La definición matemática se relaciona con las categorías de desplazamiento de bordes que se muestran en la Fig. 5.

La Fig. 7 muestra un diagrama 700 esquemático de cuatro patrones direccionales unidimensionales para la clasificación de muestras de vídeo con desplazamiento de bordes que comprenden cinco muestras de vídeo. En los estándares de codificación de vídeo emergentes, por ejemplo, el perfil principal del estándar H.265/HEVC, SAO puede usar un patrón direccional que comprende 3 muestras de vídeo, es decir, la longitud de cada patrón direccional es igual a 3. El número de las muestras de vídeo en los patrones direccionales unidimensionales también se pueden aumentar, por ejemplo, a 5 muestras de vídeo.

La Fig. 8 muestra un diagrama 800 esquemático del error final después de un filtro de desplazamiento adaptativo de muestras. El error final se representa para el iésimo píxel o muestra de vídeo después del filtro SAO para diferentes valores de desplazamiento de EO y los errores de píxel o muestra de vídeo antes del filtro SAO. |Δi| denota el valor absoluto de Δi.

La idea de EO es reconocer muestras de vídeo extremas mediante un clasificador fijo que compara cada muestra de vídeo con sus vecinas y corregir esas muestras de vídeo extremas sin señalar explícitamente su ubicación. En general, puede haber una diferencia entre el valor veo(/) del desplazamiento de EO para la categoría jésima y el error e/ para el iésimo píxel o muestra de vídeo antes del filtro SAO:

Evidentemente, la mejora de la calidad para el iésimo píxel o muestra de vídeo es máxima si Δi(J) = 0. Esto significa que el error final del iésimo píxel o muestra de vídeo después del filtro SAO es igual a 0. En el diagrama 800, se presenta la dependencia del error final del iésimo píxel o muestra de vídeo después del filtro SAO en e/ y veo. Esto muestra el hecho de que el error final del iésimo píxel o muestra de vídeo después de aplicar un desplazamiento EO al píxel o muestra de vídeo puede aumentar o hacerse mayor. Por lo tanto, puede ser razonable restringir de forma adaptativa el valor del desplazamiento de EO para evitar aumentar el error final. Además, los píxeles o muestras de vídeo que pertenecen a la misma clase de EO y categoría de EO pueden tener diferentes valores de εi. En el caso del filtro SAO casual, el desplazamiento de EO puede ser constante para todos los píxeles o muestras de vídeo pertenecientes a la misma clase de EO y categoría de EO. Actualmente no existen mecanismos que permitan cambiar individualmente el valor del desplazamiento de EO para cada píxel o muestra de vídeo que pertenezca a la misma clase de EO y categoría de EO.

En una forma de implementación, puede haber una diferencia entre los valores de desplazamiento de SAO y los errores reales para píxeles o muestras de vídeo según:

en donde vsao es el valor del desplazamiento de SAO y e/ es el valor de un error real para el píxel i que pertenece a una categoría dada.

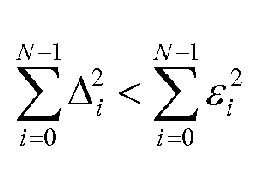

En una forma de implementación, la siguiente desigualdad debe ser correcta para lograr una ganancia de codificación:

en donde N es el número de píxeles o muestras de vídeo que pertenecen a la categoría dada.

En una forma de implementación, los píxeles o muestras de vídeo con errores mayores (por ejemplo, 3, 4, 5, etc.) pueden afectar a la distorsión total considerablemente más que los píxeles o muestras de vídeo con errores menores (por ejemplo, 1 o 2) debido al grado cuadrático usado en la desigualdad.

En una forma de implementación, la invención se basa en la idea de maximizar el valor de desplazamiento para minimizar los errores más grandes y cortar de manera adaptativa el valor de desplazamiento para píxeles o muestras de vídeo con errores menores usando el valor de píxeles o muestras de vídeo vecinas y más información.

La Fig. 9 muestra un diagrama 900 esquemático de un esquema suave para la adaptación del valor de un píxel o muestra de vídeo mientras se aplica un desplazamiento de bordes.

La Fig. 10 muestra un diagrama 1000 esquemático de un esquema duro para la adaptación del valor de un píxel o muestra de vídeo mientras se aplica un desplazamiento de bordes.

La Fig.11 muestra un diagrama 1100 esquemático de un esquema de interpolación lineal para patrones de desplazamiento de bordes de cinco muestras.

La Fig. 12 muestra un diagrama 1200 esquemático de un esquema de interpolación cúbico para patrones de desplazamiento de bordes de cinco muestras.

La Fig. 13 muestra un diagrama 1300 esquemático de un esquema de filtrado para patrones de desplazamiento de bordes de cinco muestras.

La idea básica de la invención es proporcionar mecanismos de adaptación que proporcionarán un intervalo de valores permitidos, RAV, o una lista de valores permitidos, LAV, para un píxel o muestra de vídeo bajo consideración mientras se aplica le aplica un desplazamiento de EO. En general, este intervalo o esta lista se puede definir usando las magnitudes del píxel o muestra de vídeo bajo consideración y sus píxeles o muestras de vídeo vecinos y su ubicación relativa entre sí. Hay diferentes formas de realizarlo. En particular, se presentan dos formas en la Fig. 9 y la Fig. 10, respectivamente.

En el caso mostrado en la Fig. 9, el valor final de un píxel o muestra de vídeo debe ubicarse en el intervalo marcado por la línea RAV. El intervalo, por ejemplo, sus valores máximo y mínimo, depende de la magnitud del píxel o muestra de vídeo bajo consideración y sus dos píxeles o muestras de vídeo vecinos. Los tres píxeles o muestras de vídeo pertenecen al mismo patrón de EO. Esta variante se llama esquema suave.

En una forma de implementación, es posible individualizar implícitamente el proceso de aplicación a cada píxel o muestra de vídeo. Se puede calcular un intervalo de valores permitidos, RAV, para el píxel o la muestra de vídeo C sujeto a los valores de sus vecinos A y B.

En el caso mostrado en la Fig. 10, la interpolación lineal se usa para restringir el intervalo de los valores que se pueden asignar al píxel o muestra de vídeo bajo consideración. En este caso, el valor de la muestra de vídeo final no puede ser mayor que el valor definido por la línea discontinua para las categorías 1 y 2 de EO y no puede ser menor que el valor definido por la línea discontinua para las categorías 3 y 4 de EO. Esta variante se llama esquema duro.

En una forma de implementación, la línea de puntos no debe cruzarse después de aplicar un desplazamiento a un valor píxel o de muestra de vídeo. Por lo tanto, es deseable corregir el valor recibido después de aplicarle un desplazamiento. Esta variante puede representar una de las muchas funciones de corte posibles. Una solución más suave puede ser cortar los nuevos valores de píxeles o muestras de vídeo si estos valores están fuera de RAV.

Es notable que existen otras variantes para definir un intervalo o una lista de los valores permitidos para un píxel o una muestra de vídeo bajo consideración mientras se le aplica un desplazamiento de EO. Por ejemplo, es posible definir el valor mínimo y máximo del intervalo de valores permitidos, RAV.

En algunas situaciones, para reducir la complejidad de cálculo del procedimiento de RDO, es razonable introducir un parámetro adicional que define la etapa Vetapa de iteración, es decir, el desplazamiento de EO puede no tomar todos los valores pertenecientes al RAV sino aquellos valores que son múltiplos de la etapa Vetapa.

En este caso, el RAV se transforma en una lista de valores permitidos, LAV.

Teniendo en cuenta las variantes con una mayor longitud de los patrones de EO, se pueden usar otras variantes para definir el RAV y el LAV, como se muestra en la Fig. 11, Fig. 12 y Fig. 13.

La Fig. 14 muestra un diagrama 1400 esquemático de las transiciones permitidas desde una categoría de desplazamiento de bordes a otra categoría de desplazamiento de bordes.

La idea básica de la invención es restringir las transiciones de una categoría de desplazamiento de bordes a otra categoría de desplazamiento de bordes. Las transiciones permitidas pueden comprender: 1 a 0, 1 a 2, 2 a 0, 3 a 0, 4 a 0 y 4 a 3. Las transiciones prohibidas pueden comprender: 1 a 3, 1 a 4, 2 a 1, 2 a 3, 2 a 4, 3 a 1, 3 a 2, 3 a 4, 4 a 1 y 4 a 2.

La Fig. 15 muestra un diagrama 1500 esquemático de una estimación estadística de un procedimiento de optimización de la distorsión de la tasa.

Para lograr una ganancia de codificación alta, se puede usar un procedimiento especial de optimización de la distorsión de la tasa, RDO, para seleccionar dichos parámetros de SAO que proporcionen el coste de distorsión de la tasa, RDC, menor. Los parámetros de SAO pueden contener los siguientes datos: tipos de SAO, clase de EO en el caso de que se seleccione EO, valores de desplazamiento que comprendan valores absolutos de desplazamiento de EO para cada categoría de EO si se selecciona EO, en donde en este caso, el signo del desplazamiento puede definirse usando la categoría de EO y los valores de desplazamiento para cada banda de BO si se selecciona BO.

El procedimiento de RDO para SAO comprende, al menos, las siguientes etapas: 1. Recopilación de los datos estadísticos para todas las clases de EO y bandas de BO; 2. Cálculo de RDC para diferentes parámetros de SAO; 3. Seleccionar dichos parámetros de SAO que proporcionen el RDC menor.

Por lo general, cada proceso de RDO puede ser muy intensivo desde el punto de vista de cálculo. Para reducir la complejidad de cálculo de SAO, se puede desarrollar un algoritmo para el cálculo rápido de distorsión. Para proporcionar una implementación eficiente de la invención, es deseable realizar una optimización de la distorsión de la tasa, RDO, para una decisión de modo rápida y robusta en cada LCU. El procedimiento de RDO puede comprender las siguientes etapas: 1. Estimación de estadísticas; 2. Selección de parámetros. La estimación de estadísticas se puede realizar como se representa en la Fig. 15.

La figura 16 muestra un diagrama 1600 esquemático de una estructura de una tabla de consulta de distorsión. Cada píxel o muestra de vídeo que tenga una categoría distinta de cero y un desplazamiento máximo puede actualizar la tabla de consulta de distorsión, LUT de distorsión. Su estructura se representa en la Fig. 16. Esta tabla se puede indexar por un desplazamiento de umbral, que puede ser igual al valor absoluto del desplazamiento máximo calculado para el píxel o la muestra de vídeo estimado. Los parámetros almacenados para cada índice de la LUT de distorsión para el patrón y la categoría de SAO pueden comprender, por ejemplo, un recuento de píxeles y una distorsión total.

Por lo tanto, es posible aplicar cálculos de distorsión para calcular la distorsión para el desplazamiento de umbral dado. Por lo tanto, para obtener la distorsión total para el desplazamiento k, se puede usar la siguiente ecuación:

di, recuentoi son los valores de distorsión y recuento para el umbral de desplazamiento i, calcDist(desplazamiento, d, recuento) es una función de distorsión que calcula la distorsión para el valor de desplazamiento dado. M indica un desplazamiento máximo.

Los valores de distorsión y recuento se pueden calcular según las siguientes ecuaciones:

recuento.

El intervalo seleccionado en la Fig. 16 denota desplazamientos que no se truncan durante el cálculo de la distorsión, mientras que los parámetros almacenados en el intervalo no seleccionado pueden usarse en el cálculo de la distorsión en el contexto de los valores de desplazamiento restringidos.

La etapa de selección de parámetros del procedimiento de RDO se puede realizar con el nuevo procedimiento de cálculo de la distorsión.

La figura 17 muestra un diagrama 1700 esquemático de un decodificador de vídeo mejorado.

Según una forma de implementación, un módulo de iSAO puede reemplazar un módulo de SAO tanto en un decodificador como en un codificador, por ejemplo, un decodificador y codificador de HEVC.

La figura 18 muestra un diagrama 1800 esquemático de un decodificador, por ejemplo, un decodificador de SAO/iSAO conjunto. El decodificador de iSAO puede implementar el método para procesar de forma adaptativa muestras de vídeo en un fotograma de señal de vídeo.

Se puede introducir un nuevo módulo denotado como corrector de desplazamiento. Usando un conjunto de datos, que está marcado como datos de SAO adicionales, se puede corregir el valor de desplazamiento. El conjunto de datos puede comprender los valores de dos píxeles o muestras de vídeo vecinos (A y B), y el valor y la categoría de SAO de un píxel o muestra de vídeo dado (C).

Según el diagrama del decodificador, se puede implementar como un decodificador de SAO/iSAO conjunto que puede funcionar en dos modos. Uno de los dos modos está definido por la señal de selección de SAO/iSAO. Puede controlar los estados de dos conmutadores que pueden conectar el corrector de desplazamiento al sumador que calcula el nuevo valor de un píxel o una muestra de vídeo dado, o seleccionar una ruta de derivación.

A diferencia de un decodificador de SAO, un codificador de SAO puede comprender un módulo para la optimización de la distorsión de la tasa, RDO, para calcular dichos desplazamientos que pueden proporcionar la mayor ganancia de codificación. En el caso de un codificador de iSAO, este módulo puede diferir de un módulo correspondiente para SAO casual. El procedimiento de RDO para iSAO puede ser una generalización del procedimiento de RDO usado en SAO casual. Por lo tanto, el procedimiento de RDO de iSAO también se puede usar para SAO casual.

A diferencia de SAO casual, el valor de un desplazamiento se puede aplicar de manera adaptativa a cada píxel o muestra de vídeo. El valor real del desplazamiento puede depender de los valores de dos píxeles o muestras de vídeo vecinos (A y B). Por lo tanto, es posible calcular el valor absoluto máximo del desplazamiento que no se corta.

Al calcular las categorías de píxeles o muestras de vídeo para cada patrón, se puede rellenar una tabla de consulta (LUT) en la que se puede almacenar la cantidad de píxeles o muestras de vídeo y su distorsión real, sujetos a su valor absoluto máximo de desplazamiento. Usando esta LUT, es posible acelerar el cálculo en el bucle de RDO. Además, los resultados de cálculos intermedios de etapas anteriores, por ejemplo, con otros valores de desplazamiento, también se pueden almacenar para evitar nuevos cálculos.

En una forma de implementación, la invención se refiere a la codificación de vídeo y, en particular, a los filtros usados para mejorar imágenes o fotogramas de vídeo reconstruidos después de una compresión con pérdida.

En una forma de implementación, la invención restringe de manera adaptativa un intervalo o una lista de valores que se pueden asignar a una magnitud de píxel o muestra de vídeo después de aplicar un desplazamiento de Eo sujeto a las magnitudes de píxeles o muestras de vídeo vecinos y su ubicación relativa entre sí.

En una forma de implementación, la invención evita que aparezca ruido impulsivo, por ejemplo, ruido de sal y pimienta, causado por SAO en imágenes o fotogramas de vídeo decodificados. Por lo tanto, permite mejorar la calidad subjetiva de las secuencias de vídeo decodificadas.

En una forma de implementación, se puede lograr una ganancia de codificación objetiva medida como una tasa de BD o una reducción de la tasa de bits delta de Bjontegaard debido a la eliminación de restricciones sobre el valor absoluto máximo que se puede asignar a los desplazamientos de EO.

En una forma de implementación, el método posee una baja complejidad de cálculo tanto en el lado del codificador como en el del decodificador en comparación con otros métodos para aumentar la eficiencia de codificación de SAO.

En una forma de implementación, la invención se refiere a un método para el procesamiento de desplazamiento adaptativo de datos de vídeo procesados que comprende: recibir los datos de vídeo procesados; seleccionar una región para los datos de vídeo procesados; especificar la clase de procesamiento para la región y el valor de desplazamiento para la clase; y compensar dicha región de los datos de vídeo procesados basándose en dicho valor de desplazamiento, que se corrige de forma adaptativa para píxeles de clase distinta de cero de dicha región según algunas condiciones, por ejemplo, la diferencia entre píxeles vecinos.

En una forma de implementación, la corrección adaptativa se realiza usando el cálculo de desplazamiento máximo.

En una forma de implementación, la corrección adaptativa se realiza usando desplazamientos mínimos y máximos.

En una forma de implementación, se usan patrones direccionales con una longitud que difiere de 3.

En una forma de implementación, la especificación de clase y desplazamiento se realiza usando optimización de la distorsión de la tasa.

En una forma de implementación, se define un desplazamiento máximo usando un esquema duro.

En una forma de implementación, se define un desplazamiento máximo usando un esquema suave.

En una forma de implementación, la interpolación del píxel o muestra de vídeo se usa para definir un desplazamiento máximo.

En una forma de implementación, el procedimiento de RDO usa una LUT de distorsión.

En una forma de implementación, la invención se refiere a un método y un aparato para el cálculo mejorado del desplazamiento adaptativo de la muestra.

En una forma de implementación, la invención permite una tasa de BD reducida en comparación con SAO casual.

En una forma de implementación, la invención puede ser compatible con SAO casual.

Claims (9)

1. Método (100) para procesar de manera adaptativa muestras de vídeo en un fotograma de señal de vídeo, estando dispuestas las muestras de vídeo en una unidad de codificación más grande, el método (100) que comprende:

extraer (103) una pluralidad de muestras de vídeo de la unidad de codificación más grande; asignar (101) una clase de desplazamiento de bordes a la pluralidad de muestras de vídeo extraídas, indicando la clase de desplazamiento de bordes un patrón direccional de la pluralidad de muestras de vídeo extraídas; y

seleccionar (107) una categoría de desplazamiento de bordes de una pluralidad de categorías de desplazamiento de bordes para la pluralidad de muestras de vídeo extraídas, comparando un valor de muestra de vídeo actual con valores de sus dos vecinos a lo largo del patrón direccional, caracterizando la categoría de desplazamiento de bordes una alineación de las muestras de vídeo extraídas entre sí, asignándose la pluralidad de categorías de desplazamiento de bordes a la clase de desplazamiento de bordes,

calcular (109) un desplazamiento de corrección para la muestra de vídeo actual de la pluralidad de muestras de vídeo extraídas sobre la base del valor de la muestra de vídeo actual y un segundo valor de una segunda muestra de vídeo de la pluralidad de muestras de vídeo extraídas; y

sumar el desplazamiento de corrección al valor de la muestra de vídeo actual, o

restar el desplazamiento de corrección del valor de la muestra de vídeo actual, y

en donde el desplazamiento de corrección para la muestra de vídeo actual de la pluralidad de muestras de vídeo extraídas se calcula sobre la base de un intervalo de valores permitidos o una lista de valores permitidos que consiste en un conjunto de valores discretos extraídos del intervalo de valores permitidos,

caracterizado por que

el intervalo de valores permitidos es una diferencia entre el valor de un píxel actual y un resultado que se obtiene interpolando linealmente un valor asociado a una posición del píxel actual en función de sus dos píxeles vecinos a lo largo del patrón direccional indicado por la clase de desplazamiento de bordes.

2. Método (100) de la reivindicación 1, en donde la clase de desplazamiento de bordes indica un patrón direccional horizontal, un patrón direccional vertical o un patrón direccional diagonal.

3. Método (100) de la reivindicación 1 o 2, en donde la categoría de desplazamiento de bordes caracteriza una alineación del valle local, una alineación del pico local, una alineación de la esquina cóncava, una alineación de la esquina convexa o una alineación restante de las muestras de vídeo extraídas entre sí.

4. Método (100) de la reivindicación 1, 2 o 3, en donde la clase de desplazamiento de bordes se asigna mediante un procedimiento de optimización de la distorsión de la tasa o la categoría de desplazamiento de bordes se selecciona mediante un procedimiento de optimización de la distorsión de la tasa, el procedimiento de optimización de la distorsión de la tasa usa una tabla de consulta de distorsión para asignar (101) la clase de desplazamiento de bordes o seleccionar (107) la categoría de desplazamiento de bordes.

5. Método (100) de cualquiera de las reivindicaciones anteriores, en donde extraer (103) la pluralidad de muestras de vídeo de la unidad de codificación más grande comprende extraer una pluralidad de muestras de vídeo adyacentes de la unidad de codificación más grande.

6. Método (100) de cualquiera de las reivindicaciones anteriores, en donde la pluralidad de muestras de vídeo extraídas comprende un número impar de muestras de vídeo, en particular 3 muestras de vídeo.

7. Aparato (200) para procesar de manera adaptativa muestras de vídeo en un fotograma de señal de vídeo, estando dispuestas las muestras de vídeo en una unidad de codificación más grande, el aparato (200) que comprende:

un procesador (201) que está configurado

para extraer (103) una pluralidad de muestras de vídeo de la unidad de codificación más grande, y asignar (101) una clase de desplazamiento de bordes a la pluralidad de muestras de vídeo extraídas, indicando la clase de desplazamiento de bordes un patrón direccional de la pluralidad de muestras de vídeo extraídas, y estado el procesador (201) configurado además para seleccionar (107) una categoría de desplazamiento de bordes de una pluralidad de categorías de desplazamiento de bordes para la pluralidad de muestras de vídeo extraídas, comparando un valor de muestra de vídeo actual con valores de sus dos vecinos a lo largo del patrón

direccional, caracterizando la categoría de desplazamiento de bordes una alineación de las muestras de vídeo extraídas entre sí, asignándose la pluralidad de categorías de desplazamiento de bordes a la clase de desplazamiento de bordes,

el procesador (201) que está configurado además para calcular (109) un desplazamiento de corrección para la muestra de vídeo actual de la pluralidad de muestras de vídeo extraídas sobre la base del valor de la muestra de vídeo actual y un segundo valor de una segunda muestra de vídeo de la pluralidad de muestras de vídeo extraídas,

el procesador (201) que está configurado para sumar el desplazamiento de corrección al valor de la muestra de vídeo actual, o restar el desplazamiento de corrección del valor de la muestra de vídeo actual, y

el procesador (201) que está configurado además para calcular (109) el desplazamiento de corrección para la muestra de vídeo actual de la pluralidad de muestras de vídeo extraídas sobre la base de un intervalo de valores permitidos o una lista de valores permitidos consistente en un conjunto de valores discretos extraídos del intervalo de valores permitidos,

caracterizado por que

el intervalo de valores permitidos es una diferencia entre el valor de un píxel actual y un resultado que se obtiene interpolando linealmente un valor asociado a una posición del píxel actual en función de sus dos píxeles vecinos a lo largo del patrón direccional indicado por la clase de desplazamiento de bordes.

8. Aparato (200) de la reivindicación 7, el procesador (201) que está configurado además para realizar un procedimiento de optimización de la distorsión de la tasa para asignar (101) la clase de desplazamiento de bordes o seleccionar (107) la categoría de desplazamiento de bordes, usando el procedimiento de optimización de la distorsión de la tasa una tabla de consulta de distorsión para asignar (101) la clase de desplazamiento de bordes o seleccionar (107) la categoría de desplazamiento de bordes.

9. Programa informático que comprende instrucciones que, cuando el programa es ejecutado por un ordenador, hacen que el ordenador realice el método (100) de las reivindicaciones 1 a 6.

Applications Claiming Priority (1)

| Application Number | Priority Date | Filing Date | Title |

|---|---|---|---|

| PCT/RU2013/000443 WO2014193261A1 (en) | 2013-05-30 | 2013-05-30 | Offset dynamic range constraints for edge offset sao filtering |

Publications (1)

| Publication Number | Publication Date |

|---|---|

| ES2950876T3 true ES2950876T3 (es) | 2023-10-16 |

Family

ID=49917222

Family Applications (1)

| Application Number | Title | Priority Date | Filing Date |

|---|---|---|---|

| ES13815858T Active ES2950876T3 (es) | 2013-05-30 | 2013-05-30 | Restricciones del intervalo dinámico de desplazamiento para el filtrado SAO de desplazamiento de bordes |

Country Status (10)

| Country | Link |

|---|---|

| US (5) | US10694212B2 (es) |

| EP (2) | EP4221203A3 (es) |

| CN (1) | CN105230015B (es) |

| DK (1) | DK3005696T3 (es) |

| ES (1) | ES2950876T3 (es) |

| FI (1) | FI3005696T3 (es) |

| HU (1) | HUE062908T2 (es) |

| PL (1) | PL3005696T3 (es) |

| PT (1) | PT3005696T (es) |

| WO (1) | WO2014193261A1 (es) |

Families Citing this family (1)

| Publication number | Priority date | Publication date | Assignee | Title |

|---|---|---|---|---|

| ES2950876T3 (es) * | 2013-05-30 | 2023-10-16 | Huawei Tech Co Ltd | Restricciones del intervalo dinámico de desplazamiento para el filtrado SAO de desplazamiento de bordes |

Family Cites Families (11)

| Publication number | Priority date | Publication date | Assignee | Title |

|---|---|---|---|---|

| US9161041B2 (en) * | 2011-01-09 | 2015-10-13 | Mediatek Inc. | Apparatus and method of efficient sample adaptive offset |

| US9008170B2 (en) * | 2011-05-10 | 2015-04-14 | Qualcomm Incorporated | Offset type and coefficients signaling method for sample adaptive offset |

| CA2840045C (en) * | 2011-06-23 | 2019-10-22 | Sharp Kabushiki Kaisha | Offset decoding device, offset encoding device, image filter device, and data structure |

| US9253482B2 (en) * | 2011-11-08 | 2016-02-02 | Texas Insturments Incorporated | Method and apparatus for sample adaptive offset without sign coding |

| BR112014012351A2 (pt) * | 2011-11-08 | 2017-05-30 | Motorola Mobility Llc | dispositivos e métodos para codificação e/ou de sinalização de deslocamento adaptado de amostra |

| WO2013103893A1 (en) * | 2012-01-05 | 2013-07-11 | General Instrument Corporation | Devices and methods for multipass sample adaptive offset coding |

| US9955152B2 (en) * | 2012-02-07 | 2018-04-24 | Sun Patent Trust | Image coding method and image decoding method |

| US10587898B2 (en) * | 2012-03-12 | 2020-03-10 | Sun Patent Trust | Image coding method, and image decoding method |

| ES2637166T3 (es) * | 2012-04-05 | 2017-10-11 | Telefonaktiebolaget Lm Ericsson (Publ) | Filtrado adaptativo de muestra con corrimientos |

| KR102166335B1 (ko) * | 2013-04-19 | 2020-10-15 | 삼성전자주식회사 | Sao 파라미터를 시그널링하는 비디오 부호화 방법 및 그 장치, 비디오 복호화 방법 및 그 장치 |

| ES2950876T3 (es) * | 2013-05-30 | 2023-10-16 | Huawei Tech Co Ltd | Restricciones del intervalo dinámico de desplazamiento para el filtrado SAO de desplazamiento de bordes |

-

2013

- 2013-05-30 ES ES13815858T patent/ES2950876T3/es active Active

- 2013-05-30 EP EP23171234.0A patent/EP4221203A3/en active Pending

- 2013-05-30 PL PL13815858.9T patent/PL3005696T3/pl unknown

- 2013-05-30 CN CN201380076732.2A patent/CN105230015B/zh active Active

- 2013-05-30 EP EP13815858.9A patent/EP3005696B1/en active Active

- 2013-05-30 WO PCT/RU2013/000443 patent/WO2014193261A1/en not_active Ceased

- 2013-05-30 DK DK13815858.9T patent/DK3005696T3/da active

- 2013-05-30 HU HUE13815858A patent/HUE062908T2/hu unknown

- 2013-05-30 FI FIEP13815858.9T patent/FI3005696T3/fi active

- 2013-05-30 PT PT138158589T patent/PT3005696T/pt unknown

-

2015

- 2015-11-24 US US14/950,742 patent/US10694212B2/en active Active

-

2020

- 2020-05-11 US US16/871,247 patent/US11303934B2/en active Active

-

2022

- 2022-03-29 US US17/707,354 patent/US11758192B2/en active Active

-

2023

- 2023-07-26 US US18/359,226 patent/US12081800B2/en active Active

-

2024

- 2024-07-19 US US18/778,443 patent/US20250047904A1/en active Pending

Also Published As

| Publication number | Publication date |

|---|---|

| FI3005696T3 (fi) | 2023-08-08 |

| WO2014193261A1 (en) | 2014-12-04 |

| CN105230015B (zh) | 2019-04-26 |

| EP4221203A3 (en) | 2023-10-25 |

| CN105230015A (zh) | 2016-01-06 |

| PT3005696T (pt) | 2023-07-19 |

| DK3005696T3 (da) | 2023-07-31 |

| US11758192B2 (en) | 2023-09-12 |

| US11303934B2 (en) | 2022-04-12 |

| US20160080776A1 (en) | 2016-03-17 |

| US20230388550A1 (en) | 2023-11-30 |

| US20250047904A1 (en) | 2025-02-06 |

| EP4221203A2 (en) | 2023-08-02 |

| EP3005696A1 (en) | 2016-04-13 |

| EP3005696B1 (en) | 2023-06-28 |

| US20220312038A1 (en) | 2022-09-29 |

| US10694212B2 (en) | 2020-06-23 |

| PL3005696T3 (pl) | 2023-08-07 |

| HUE062908T2 (hu) | 2023-12-28 |

| US20200275128A1 (en) | 2020-08-27 |

| US12081800B2 (en) | 2024-09-03 |

Similar Documents

| Publication | Publication Date | Title |

|---|---|---|

| JP7731581B2 (ja) | 画像符号化/復号化方法、装置、及びビットストリームを保存した記録媒体 | |

| US10834396B2 (en) | Bilateral filter for predicted video data | |

| RU2696552C1 (ru) | Способ и устройство для видеокодирования | |

| US9628822B2 (en) | Low complexity sample adaptive offset encoding | |

| KR102755171B1 (ko) | 비디오 코딩에서 비선형 적응적 루프 필터링을 위한 방법 및 장치 | |

| US20210360238A1 (en) | Method and Apparatus for Reduction of In-Loop Filter Buffer | |

| US20120177107A1 (en) | Apparatus and Method of Sample Adaptive Offset for Video Coding | |

| EP3155813A1 (en) | System and method for highly content adaptive quality restoration filtering for video coding | |

| KR20230124051A (ko) | 결합된 루프 필터링 | |

| US20250047904A1 (en) | Method and apparatus for adaptively processing video samples in a video signal frame | |

| US20190222846A1 (en) | Method and apparatus for video coding with sample adaptive offset | |

| CN114125445B (zh) | 解码方法、装置、设备及机器可读存储介质 | |

| CN110771166B (zh) | 帧内预测装置和方法、编码、解码装置、存储介质 | |

| CN114640847A (zh) | 编解码方法、装置及其设备 | |

| CN119586124A (zh) | 用于视频编解码的具有色度分类器的自适应环路滤波器的方法和装置 | |

| CN117478895A (zh) | 数据处理方法、装置、设备 | |

| CN121488482A (zh) | 环路滤波中统一分类的方法和装置 | |

| HK40064082B (en) | Decoding method, apparatus, device, and machine-readable storage medium | |

| CN120419176A (zh) | 用于视频编解码的自适应环路滤波器子形状选择的方法和装置 | |

| HK40064082A (en) | Decoding method, apparatus, device, and machine-readable storage medium |