JP2014106962A - 瞳の動きを利用した命令入力装置及び命令入力方法 - Google Patents

瞳の動きを利用した命令入力装置及び命令入力方法 Download PDFInfo

- Publication number

- JP2014106962A JP2014106962A JP2013128852A JP2013128852A JP2014106962A JP 2014106962 A JP2014106962 A JP 2014106962A JP 2013128852 A JP2013128852 A JP 2013128852A JP 2013128852 A JP2013128852 A JP 2013128852A JP 2014106962 A JP2014106962 A JP 2014106962A

- Authority

- JP

- Japan

- Prior art keywords

- frequency

- pupil

- screen

- movement

- unit

- Prior art date

- Legal status (The legal status is an assumption and is not a legal conclusion. Google has not performed a legal analysis and makes no representation as to the accuracy of the status listed.)

- Granted

Links

Images

Classifications

-

- G—PHYSICS

- G06—COMPUTING OR CALCULATING; COUNTING

- G06T—IMAGE DATA PROCESSING OR GENERATION, IN GENERAL

- G06T7/00—Image analysis

- G06T7/20—Analysis of motion

-

- G—PHYSICS

- G06—COMPUTING OR CALCULATING; COUNTING

- G06F—ELECTRIC DIGITAL DATA PROCESSING

- G06F3/00—Input arrangements for transferring data to be processed into a form capable of being handled by the computer; Output arrangements for transferring data from processing unit to output unit, e.g. interface arrangements

- G06F3/01—Input arrangements or combined input and output arrangements for interaction between user and computer

- G06F3/011—Arrangements for interaction with the human body, e.g. for user immersion in virtual reality

- G06F3/013—Eye tracking input arrangements

-

- G—PHYSICS

- G06—COMPUTING OR CALCULATING; COUNTING

- G06F—ELECTRIC DIGITAL DATA PROCESSING

- G06F3/00—Input arrangements for transferring data to be processed into a form capable of being handled by the computer; Output arrangements for transferring data from processing unit to output unit, e.g. interface arrangements

- G06F3/01—Input arrangements or combined input and output arrangements for interaction between user and computer

- G06F3/03—Arrangements for converting the position or the displacement of a member into a coded form

Landscapes

- Engineering & Computer Science (AREA)

- Theoretical Computer Science (AREA)

- General Engineering & Computer Science (AREA)

- Physics & Mathematics (AREA)

- General Physics & Mathematics (AREA)

- Human Computer Interaction (AREA)

- Multimedia (AREA)

- Computer Vision & Pattern Recognition (AREA)

- User Interface Of Digital Computer (AREA)

- Position Input By Displaying (AREA)

Abstract

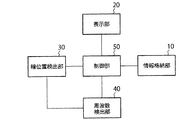

【解決手段】瞳の動きを利用した命令入力装置において、各物体の周波数に対応する命令を格納する情報格納部10、各物体が当該周波数で動くように各物体を画面上に表示する表示部20、時間帯別ユーザーの瞳の位置を検出する瞳位置検出部30、上記瞳位置検出部が検出した時間帯別ユーザーの瞳の位置に基づいて周波数を検出する周波数検出部40、及び上記情報格納部に格納されている各周波数に対応する命令に基づき、上記周波数検出部が検出した周波数に対応する命令を認識する制御部50を含む。

【選択図】図1

Description

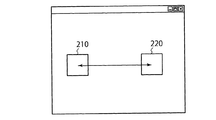

1)図2aに示すように、画面上の一側に位置する物体210と他側に位置する物体220を周期的に互いに交替して見せる方式。したがって、ユーザーの瞳は、周期的に一側の物体210と他側の物体220を交替して見つめることになり周波数検出が可能である。

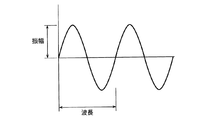

2)図2bに示すように、画面上で特定物体の動きが正弦波形(sine wave)を有するように連続的に動く方式。

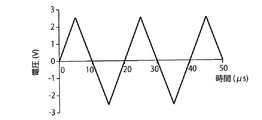

3)図2cに示すように、画面上で特定物体の動きが三角波形(triangular wave)を有するように連続的に動く方式。

30:瞳位置検出部 40:周波数検出部

50:制御部

Claims (10)

- 各物体の周波数に対応する命令を格納する情報格納部;

各物体が当該周波数で動くように各物体を画面上に表示する表示部;

時間帯別ユーザーの瞳の位置を検出する瞳位置検出部;

上記瞳位置検出部が検出した時間帯別ユーザーの瞳の位置に基づいて周波数を検出する周波数検出部;及び

上記情報格納部に格納されている各周波数に対応する命令に基づいて、上記周波数検出部が検出した周波数に対応する命令を認識する制御部;

を含む瞳の動きを利用した命令入力装置。 - 上記制御部は、

上記画面上の一側と他側で物体が周期的に交替して現われるように上記表示部を制御する、ことを特徴とする請求項1記載の瞳の動きを利用した命令入力装置。 - 上記制御部は、

上記画面上で物体の動きが正弦波形(sine wave)を有するように上記表示部を制御する、ことを特徴とする請求項1記載の瞳の動きを利用した命令入力装置。 - 上記制御部は、

上記画面上で物体の動きが三角波形(triangular wave)を有するように上記表示部を制御する、ことを特徴とする請求項1記載の瞳の動きを利用した命令入力装置。 - 上記制御部は、

上記画面上で一つ以上の物体が当該周波数を有するように上記表示部を制御する、ことを特徴とする請求項1記載の瞳の動きを利用した命令入力装置。 - 情報格納部が、各物体の周波数に対応する命令を格納する段階;

表示部が、各物体が当該周波数で動くように各物体を画面上に表示する段階;

瞳位置検出部が、時間帯別ユーザーの瞳の位置を検出する段階;

周波数検出部が、上記検出された時間帯別ユーザーの瞳の位置に基づいて周波数を検出する段階;及び

制御部が、上記情報格納部に格納されている各周波数に対応する命令に基づいて、上記検出された周波数に対応する命令を認識する段階;

を含む瞳の動きを利用した命令入力方法。 - 上記表示段階は、

上記画面上の一側と他側で物体が周期的に交替して現われるように各物体を画面上に表示する、ことを特徴とする請求項6記載の瞳の動きを利用した命令入力方法。 - 上記表示段階は、

上記画面上で物体の動きが正弦波形(sine wave)を有するように各物体を画面上に表示する、ことを特徴とする請求項6記載の瞳の動きを利用した命令入力方法。 - 上記表示段階は、

上記画面上で物体の動きが三角波形(triangular wave)を有するように各物体を画面上に表示する、ことを特徴とする請求項6記載の瞳の動きを利用した命令入力方法。 - 上記表示段階は、

上記画面上で一つ以上の物体が当該周波数を有するように各物体を画面上に表示する、ことを特徴とする請求項6記載の瞳の動きを利用した命令入力方法。

Applications Claiming Priority (2)

| Application Number | Priority Date | Filing Date | Title |

|---|---|---|---|

| KR1020120135334A KR101354321B1 (ko) | 2012-11-27 | 2012-11-27 | 눈동자의 움직임을 이용한 명령 입력 장치 및 그 방법 |

| KR10-2012-0135334 | 2012-11-27 |

Publications (2)

| Publication Number | Publication Date |

|---|---|

| JP2014106962A true JP2014106962A (ja) | 2014-06-09 |

| JP6096069B2 JP6096069B2 (ja) | 2017-03-15 |

Family

ID=50269409

Family Applications (1)

| Application Number | Title | Priority Date | Filing Date |

|---|---|---|---|

| JP2013128852A Expired - Fee Related JP6096069B2 (ja) | 2012-11-27 | 2013-06-19 | 瞳の動きを利用した命令入力装置及び命令入力方法 |

Country Status (5)

| Country | Link |

|---|---|

| US (1) | US20140145949A1 (ja) |

| JP (1) | JP6096069B2 (ja) |

| KR (1) | KR101354321B1 (ja) |

| CN (1) | CN103838368B (ja) |

| DE (1) | DE102013209500B4 (ja) |

Families Citing this family (1)

| Publication number | Priority date | Publication date | Assignee | Title |

|---|---|---|---|---|

| KR101879387B1 (ko) * | 2017-03-27 | 2018-07-18 | 고상걸 | 시선 방향 추적결과의 교정 방법 |

Citations (4)

| Publication number | Priority date | Publication date | Assignee | Title |

|---|---|---|---|---|

| JP2000010722A (ja) * | 1998-06-18 | 2000-01-14 | Mr System Kenkyusho:Kk | 視線ユーザ・インタフェース装置、そのインタフェース方法、コンピュータ装置、その制御方法、およびプログラム記憶媒体 |

| JP2008206830A (ja) * | 2007-02-27 | 2008-09-11 | Tokyo Univ Of Science | 統合失調症診断装置及びプログラム |

| WO2009093435A1 (ja) * | 2008-01-25 | 2009-07-30 | Panasonic Corporation | 脳波インタフェースシステム、脳波インタフェース装置、方法およびコンピュータプログラム |

| WO2009150747A1 (ja) * | 2008-06-13 | 2009-12-17 | パイオニア株式会社 | 視線入力によるユーザーインターフェース装置、ユーザーインターフェース方法、ユーザーインターフェースプログラム、及びユーザーインターフェースプログラムが記録された記録媒体 |

Family Cites Families (12)

| Publication number | Priority date | Publication date | Assignee | Title |

|---|---|---|---|---|

| KR19990021540A (ko) * | 1997-08-30 | 1999-03-25 | 윤종용 | 눈의 시선각도를 이용한 입력장치 |

| US6243076B1 (en) * | 1998-09-01 | 2001-06-05 | Synthetic Environments, Inc. | System and method for controlling host system interface with point-of-interest data |

| ES2258972T3 (es) * | 2000-05-16 | 2006-09-16 | Swisscom Mobile Ag | Procedimiento y terminal para entrar instrucciones. |

| DE10121392A1 (de) | 2001-05-02 | 2002-11-21 | Bosch Gmbh Robert | Vorrichtung zur Steuerung von Geräten mittels Blickrichtung |

| KR100520050B1 (ko) * | 2003-05-12 | 2005-10-11 | 한국과학기술원 | 응시방향 기반의 머리착용형 컴퓨터 인터페이스 장치 및방법 |

| DE102004005816B4 (de) | 2004-02-06 | 2007-02-08 | Audi Ag | Kraftfahrzeug |

| FR2912274B1 (fr) * | 2007-02-02 | 2009-10-16 | Binocle Sarl | Procede de commande a partir d'un signal oculaire volontaire, notamment pour une prise de vues |

| KR100960269B1 (ko) * | 2008-10-07 | 2010-06-07 | 한국과학기술원 | 눈동자 시선 추정 장치 및 추정 방법 |

| CN101477405B (zh) * | 2009-01-05 | 2010-11-24 | 清华大学 | 基于左右视野两个频率刺激的稳态视觉诱发脑机接口方法 |

| CN101943982B (zh) * | 2009-07-10 | 2012-12-12 | 北京大学 | 基于被跟踪的眼睛运动的图像操作 |

| CN102087582B (zh) * | 2011-01-27 | 2012-08-29 | 广东威创视讯科技股份有限公司 | 一种自动滚屏的方法及装置 |

| US20130144537A1 (en) * | 2011-12-03 | 2013-06-06 | Neuro Analytics and Technologies, LLC | Real Time Assessment During Interactive Activity |

-

2012

- 2012-11-27 KR KR1020120135334A patent/KR101354321B1/ko active Active

-

2013

- 2013-05-20 US US13/897,791 patent/US20140145949A1/en not_active Abandoned

- 2013-05-22 DE DE102013209500.7A patent/DE102013209500B4/de active Active

- 2013-06-06 CN CN201310223802.4A patent/CN103838368B/zh active Active

- 2013-06-19 JP JP2013128852A patent/JP6096069B2/ja not_active Expired - Fee Related

Patent Citations (4)

| Publication number | Priority date | Publication date | Assignee | Title |

|---|---|---|---|---|

| JP2000010722A (ja) * | 1998-06-18 | 2000-01-14 | Mr System Kenkyusho:Kk | 視線ユーザ・インタフェース装置、そのインタフェース方法、コンピュータ装置、その制御方法、およびプログラム記憶媒体 |

| JP2008206830A (ja) * | 2007-02-27 | 2008-09-11 | Tokyo Univ Of Science | 統合失調症診断装置及びプログラム |

| WO2009093435A1 (ja) * | 2008-01-25 | 2009-07-30 | Panasonic Corporation | 脳波インタフェースシステム、脳波インタフェース装置、方法およびコンピュータプログラム |

| WO2009150747A1 (ja) * | 2008-06-13 | 2009-12-17 | パイオニア株式会社 | 視線入力によるユーザーインターフェース装置、ユーザーインターフェース方法、ユーザーインターフェースプログラム、及びユーザーインターフェースプログラムが記録された記録媒体 |

Also Published As

| Publication number | Publication date |

|---|---|

| KR101354321B1 (ko) | 2014-02-05 |

| JP6096069B2 (ja) | 2017-03-15 |

| CN103838368B (zh) | 2018-01-26 |

| DE102013209500B4 (de) | 2026-03-05 |

| CN103838368A (zh) | 2014-06-04 |

| DE102013209500A1 (de) | 2014-05-28 |

| US20140145949A1 (en) | 2014-05-29 |

Similar Documents

| Publication | Publication Date | Title |

|---|---|---|

| JP7191714B2 (ja) | デジタルデバイスとの対話のための直接的なポインティング検出のためのシステムおよび方法 | |

| US9703373B2 (en) | User interface control using gaze tracking | |

| US11439473B2 (en) | Surgical control apparatus, surgical control method, and program | |

| US9264702B2 (en) | Automatic calibration of scene camera for optical see-through head mounted display | |

| US20210049360A1 (en) | CONTROLLER GESTURES IN VIRTUAL, AUGMENTED, AND MIXED REALITY (xR) APPLICATIONS | |

| US10168787B2 (en) | Method for the target recognition of target objects | |

| EP3079042B1 (en) | Device and method for displaying screen based on event | |

| US9727130B2 (en) | Video analysis device, video analysis method, and point-of-gaze display system | |

| RU2016113960A (ru) | Наголовное устройство отображения и способ управления наголовным устройством отображения | |

| US10466780B1 (en) | Systems and methods for eye tracking calibration, eye vergence gestures for interface control, and visual aids therefor | |

| JP2019039988A5 (ja) | ||

| CN104182046A (zh) | 眼控提醒方法、眼控图像显示方法及显示系统 | |

| CN116648683A (zh) | 用于选择对象的方法和系统 | |

| KR101470243B1 (ko) | 시선 검출 장치 및 그 시선 검출 방법 | |

| KR100916836B1 (ko) | 지시형 제스처를 인식하는 방법 및 장치 | |

| van der Meulen et al. | What are we missing? Adding eye-tracking to the hololens to improve gaze estimation accuracy | |

| JP6144363B2 (ja) | 3dビジュアルコンテンツの自動評価のための技術 | |

| US20160187990A1 (en) | Method and apparatus for processing gesture input | |

| CN113093907A (zh) | 人机交互方法、系统、设备及存储介质 | |

| CN106155290A (zh) | 利用视线追踪的菜单选择设备 | |

| US9465989B2 (en) | User authentication apparatus and method using movement of pupil | |

| JP6096069B2 (ja) | 瞳の動きを利用した命令入力装置及び命令入力方法 | |

| CN103870146B (zh) | 一种信息处理方法及电子设备 | |

| US11334151B2 (en) | Display apparatus, display method, program, and non-transitory computer-readable information recording medium | |

| Kar et al. | Eye-gaze systems-an analysis of error sources and potential accuracy in consumer electronics use cases |

Legal Events

| Date | Code | Title | Description |

|---|---|---|---|

| A621 | Written request for application examination |

Free format text: JAPANESE INTERMEDIATE CODE: A621 Effective date: 20160404 |

|

| TRDD | Decision of grant or rejection written | ||

| A01 | Written decision to grant a patent or to grant a registration (utility model) |

Free format text: JAPANESE INTERMEDIATE CODE: A01 Effective date: 20170120 |

|

| A977 | Report on retrieval |

Free format text: JAPANESE INTERMEDIATE CODE: A971007 Effective date: 20170118 |

|

| A61 | First payment of annual fees (during grant procedure) |

Free format text: JAPANESE INTERMEDIATE CODE: A61 Effective date: 20170215 |

|

| R150 | Certificate of patent or registration of utility model |

Ref document number: 6096069 Country of ref document: JP Free format text: JAPANESE INTERMEDIATE CODE: R150 |

|

| R250 | Receipt of annual fees |

Free format text: JAPANESE INTERMEDIATE CODE: R250 |

|

| R250 | Receipt of annual fees |

Free format text: JAPANESE INTERMEDIATE CODE: R250 |

|

| R250 | Receipt of annual fees |

Free format text: JAPANESE INTERMEDIATE CODE: R250 |

|

| R250 | Receipt of annual fees |

Free format text: JAPANESE INTERMEDIATE CODE: R250 |

|

| R250 | Receipt of annual fees |

Free format text: JAPANESE INTERMEDIATE CODE: R250 |

|

| LAPS | Cancellation because of no payment of annual fees |