JP2017016384A - 混合係数パラメータ学習装置、混合生起確率算出装置、及び、これらのプログラム - Google Patents

混合係数パラメータ学習装置、混合生起確率算出装置、及び、これらのプログラム Download PDFInfo

- Publication number

- JP2017016384A JP2017016384A JP2015132347A JP2015132347A JP2017016384A JP 2017016384 A JP2017016384 A JP 2017016384A JP 2015132347 A JP2015132347 A JP 2015132347A JP 2015132347 A JP2015132347 A JP 2015132347A JP 2017016384 A JP2017016384 A JP 2017016384A

- Authority

- JP

- Japan

- Prior art keywords

- occurrence probability

- probability

- vector

- neural network

- mixing coefficient

- Prior art date

- Legal status (The legal status is an assumption and is not a legal conclusion. Google has not performed a legal analysis and makes no representation as to the accuracy of the status listed.)

- Pending

Links

Images

Landscapes

- Machine Translation (AREA)

Abstract

【課題】混合生起確率の正確性を向上させる混合係数パラメータ学習装置を提供する。【解決手段】混合係数パラメータ学習装置30は、ニューラルネットワーク言語モデル演算装置10に隠れ層ベクトル及び生起確率を要求する第1生起確率要求手段312と、他言語モデル演算装置20に生起確率を要求する第2生起確率入力手段313と、隠れ層ベクトルから混合係数を算出する第1混合係数算出手段314と、確率的勾配降下法により、写像ベクトルを更新する写像ベクトル更新手段315と、更新率を減少させる更新率減少手段317と、終了条件を満たすまで、写像ベクトル更新手段315に写像ベクトルを更新させる終了条件判定手段316とを備える。【選択図】図2

Description

本願発明は、混合係数の算出に必要なパラメータを学習する混合係数パラメータ学習装置、ニューラルネットワーク確率モデルと他の確率モデルとの混合生起確率を算出する混合生起確率算出装置、及び、これらのプログラムに関する。

統計的言語モデル(以後、「言語モデル」)とは、ある言語又はドメインにおいて、単語系列w1w2…wnが生起する確率p(w1w2…wn)を計算する手段、及び、その手段によって計算するのに必要な各種統計量の一覧として定義される。言語モデルによって言語の生起を確率モデル化することは、統計的自然言語処理の最も基本的な技術の一つであり、音声認識、機械翻訳をはじめとする各種自然言語処理技術に用いられている。

なお、言語モデルとは、ある言語、又は、その言語の特定分野における表現(単語系列)生起の確率モデルのことであり、一般的には予め与えられた当該言語又はその言語の当該分野のコーパスから学習する。

また、コーパスとは、ある言語又はその言語の特定分野で観測された単語系列の実例である。

また、w1,w2,wnは、単語を表す。

また、コーパスとは、ある言語又はその言語の特定分野で観測された単語系列の実例である。

また、w1,w2,wnは、単語を表す。

単語系列の生起確率p(w1w2…wn)は、一般的には、系列の各単語がそれ以前の単語系を前文脈として生起する確率の積、すなわち、p(w1)×p(w2|w1)×p(w3|w1w2)×…×p(wn|w1w2…wn−1)としてモデル化される。つまり、言語モデルは、前文脈が与えられた条件下での次単語生起の予測モデルであると言える。

言語モデルの最も一般的な実現手法は、n−gram言語モデルである。このn−gram言語モデルは、前記条件となる前文脈を直近のn−1単語に制限し(但し、nは1以上の整数)、学習コーパスから、n−1単語の列である前文脈の異なり毎に次単語生起頻度を収集した結果に基づき、各前文脈条件下の次単語生起確率を推定するものである。

n−gram言語モデルでは、精度よく次単語の生起確率を推定するために長い前文脈を参照する(大きな値のnを用いる)必要がある。また、n−gram言語モデルでは、各前文脈に対して十分な実例を集める必要があるが、長い前文脈を用いるほど前文脈の異なりが増加するため、正確性を向上させるために非常に大きな学習コーパスを用意する必要がある。

近年、このn−gram言語モデルに対して、ニューラルネットワークを用いた言語モデル実現手法が提案されている。この手法は、ニューラルネットワークを用いて、各単語を表すものとして、固定次元で各次元が実数値である単語表現ベクトルへの写像を学習し、前文脈として単語列の各単語に対応する単語表現ベクトルの組み合わせを用いるものである。

例えば、非特許文献1に記載のNNLM(Neural Network Language Model)は、図5のようなニューラルネットワークを構築する。以後、言語モデルについて、有限個|V|種類の単語のみを扱うものとし、各単語は1〜|V|の数値として表すことにする。このとき、|V|種類の単語の中には、必ず文頭を表す特殊な単語を含むものとする。ここで、各単語wに対応する予め定めた固定次元数mの単語表現ベクトルをC(w)とする。また、単語系列w1w2…wtの生起に関して、単語wtのn−1個の前文脈を表すn−1個の単語表現ベクトルを連結したn×m次元の入力ベクトルx(t)=[C(wt−n+1),…,C(wt−2),C(wt−1)]から予め定めた固有次元数hのベクトルへの線形写像をHx(t)とする。

なお、前文脈の長さがn−1未満である(すなわちt<nである)場合には、単語w1の前にn−t個の文頭を表す単語を補うことで入力ベクトルx(t)を作成するものとする。

なお、前文脈の長さがn−1未満である(すなわちt<nである)場合には、単語w1の前にn−t個の文頭を表す単語を補うことで入力ベクトルx(t)を作成するものとする。

また、線形写像Hx(t)の各次元を非線形関数f(例えば、双曲線正接関数tanh)で変換した隠れ層ベクトルz(t)から|V|次元ベクトルy(t)への線形写像をUz(t)とする。

また、y(t)の各次元を式(1)に示す関数で変換した|V|次元ベクトルを出力ベクトルp(t)とする。この場合、次単語がwtである確率を以下の式(1)〜式(3)のように定義する(但し、yiはyのi次元の値)。

また、入力ベクトルx(t)の(t)は、前文脈w1w2…wt−1に後続する次単語wtの生起確率に関わる入力ベクトルxを意味する(他のベクトルも同様)。

また、図5の‘○’はベクトルの要素を表す。

また、y(t)の各次元を式(1)に示す関数で変換した|V|次元ベクトルを出力ベクトルp(t)とする。この場合、次単語がwtである確率を以下の式(1)〜式(3)のように定義する(但し、yiはyのi次元の値)。

また、入力ベクトルx(t)の(t)は、前文脈w1w2…wt−1に後続する次単語wtの生起確率に関わる入力ベクトルxを意味する(他のベクトルも同様)。

また、図5の‘○’はベクトルの要素を表す。

n,m,hを予め設定し、学習コーパスの各単語wtに対して、前文脈wt−n+1,…,wt−2,wt−1をニューラルネットワークに入力して次単語生起の確率分布を出力(順方向伝搬)し、出力ベクトルと正解ベクトルとの交差エントロピー誤差をニューラルネットワークに逆方向伝搬させながら、以下の式(4)〜式(6)のように単語表現ベクトルC、入力層から隠れ層への重みH、隠れ層から出力層への重みUを確率的勾配降下法により更新する(但し、εは更新率)。これを学習コーパス全体で何回か繰り返すことによって学習を実現する。

なお、正解ベクトルとは、単語wtの生起確率を1とし、それ以外の単語の生起確率を0としたベクトルである。

なお、正解ベクトルとは、単語wtの生起確率を1とし、それ以外の単語の生起確率を0としたベクトルである。

単語表現ベクトルCの学習の結果、類似した単語が近い単語表現ベクトルに写像され、Hの学習の結果、類似した単語が近い隠れ層ベクトルに写像されるので、小規模な学習コーパスから学習した場合でも高い正確性を得ることができる。

また、NNLMとは異なる手法として、非特許文献2に記載のRNNLM(Recurrent Neural Network Language Model)が提案されている。前記したように、NNLMでは、単語wtに対して予め定めたn−1個の単語wt−n+1,…,wt−2,wt−1から前文脈を表す隠れ層ベクトルz(t)を計算する。一方、このRNNLMは、図6のように、隠れ層ベクトルz(t)を、1つ前の単語wt−1及びこの単語wt−1に対する前文脈を表す隠れ層ベクトルz(t−1)から計算する。これにより、RNNLMは、明示的な前文脈長nを与えることなく、長い前文脈を反映した次単語生起の予測を行うことを可能にする。

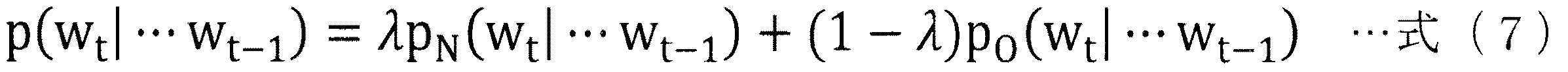

一般的には、これらニューラルネットワーク言語モデルは、他の言語モデル(例えば、n−gram言語モデル)と組み合わせて用いられる。具体的には、ニューラルネットワーク言語モデルによる生起確率をpN、他の言語モデルによる生起確率をpO、混合比率をλとする。この場合、以下の式(7)のように、λ:1−λの比率で両言語モデルの生起確率pN,pOを混合したものを混合生起確率pとして算出する。

なお、式(7)では、λが混合係数を表す。通常、混合係数λは、学習済みの両言語モデルを用意した上で、別途用意したテストコーパスに対して最も正確性が高くなる値を決定し、決定した値を固定的に用いる。

このように生起確率を混合するには、以下のような理由がある。

1)ニューラルネットワーク言語モデルでは学習コーパスに表れなかった単語(未知語)の生起確率を推定する一般的手法がないが、n−gram言語モデルでは未知語に適切な生起確率を割り当てることができる。

2)ニューラルネットワーク言語モデルは学習のための計算量がn−gram言語モデルと比較して非常に大きいため、ニューラルネットワーク言語モデルで小規模のドメインに特化した学習コーパスを用いて学習し、より広範囲の大規模な学習コーパスから学習したn−gram言語モデルと組み合わせることが現実的である。

1)ニューラルネットワーク言語モデルでは学習コーパスに表れなかった単語(未知語)の生起確率を推定する一般的手法がないが、n−gram言語モデルでは未知語に適切な生起確率を割り当てることができる。

2)ニューラルネットワーク言語モデルは学習のための計算量がn−gram言語モデルと比較して非常に大きいため、ニューラルネットワーク言語モデルで小規模のドメインに特化した学習コーパスを用いて学習し、より広範囲の大規模な学習コーパスから学習したn−gram言語モデルと組み合わせることが現実的である。

A Neural Probabilistic Language Model,Yoshua Bengio et.al,Journal of Machine Learning Research 3,(2003),1137-1155

Static Language Model based on Neural Network,Tomas Mikolov

しかし、ニューラルネットワーク言語モデルでは、前文脈に関係なく固定的な混合係数を用いているため、混合生起確率の正確性が低くなるという問題がある。例えば、前文脈「私は」の次に表れる単語を正確に予測するためには巨大な学習コーパスで学習する必要がある。一方、前文脈「私は山にいきまし」の次に表れる単語は「た」「て」くらいしかあり得ず、小規模な学習コーパスで学習しても正確に予測可能である。すなわち、ニューラルネットワーク言語モデルでは、前文脈に応じて異なる混合係数を用いることで、混合生起確率の正確性を向上させることができる。

本願発明は、前記した課題に鑑みて、混合生起確率の正確性を向上させる混合係数パラメータ学習装置、混合生起確率算出装置、及び、これらのプログラムを提供することを課題とする。

前記した課題に鑑みて、本願発明に係る混合係数パラメータ学習装置は、ニューラルネットワーク確率モデルと前記ニューラルネットワーク確率モデル以外の他の確率モデルとのそれぞれで求めた前要素系列に対する次要素の生起確率を混合するときの混合係数の算出に必要なパラメータを学習する混合係数パラメータ学習装置であって、第1生起確率入力手段と、第2生起確率入力手段と、第1混合係数算出手段と、写像ベクトル更新手段と、更新率減少手段と、終了条件判定手段とを備える構成とした。

かかる構成によれば、混合係数パラメータ学習装置は、第1生起確率入力手段によって、前記ニューラルネットワーク確率モデルの隠れ層ベクトルと、前記ニューラルネットワーク確率モデルで求めた生起確率とが入力される。

すなわち、学習済みのニューラルネットワーク確率モデルに前要素系列を入力すると、ニューラルネットワーク確率モデルの隠れ層ベクトルとして、汎化された前要素の表現が得られる。従って、学習済みのニューラルネットワーク確率モデルの隠れ層ベクトルから混合係数への写像ベクトルを学習すれば、前要素系列に応じた混合係数を求めることが可能となる。

混合係数パラメータ学習装置は、第2生起確率入力手段によって、前記他の確率モデルで求めた生起確率が入力される。

混合係数パラメータ学習装置は、第1混合係数算出手段によって、予め設定された写像ベクトルにより前記隠れ層ベクトルを実数値のスカラに線形写像し、前記実数値のスカラをシグモイド関数で非線形変換することで、前記混合係数を算出する。

混合係数パラメータ学習装置は、第1混合係数算出手段によって、予め設定された写像ベクトルにより前記隠れ層ベクトルを実数値のスカラに線形写像し、前記実数値のスカラをシグモイド関数で非線形変換することで、前記混合係数を算出する。

混合係数パラメータ学習装置は、写像ベクトル更新手段によって、前記ニューラルネットワーク確率モデルと前記他の確率モデルとのそれぞれで求めた生起確率、前記混合係数、及び、予め設定された更新率を用いた確率的勾配降下法により、前記パラメータとしての前記写像ベクトルを更新する。

混合係数パラメータ学習装置は、更新率減少手段によって、予め設定された更新率減少規則に従って前記更新率を減少させる。

混合係数パラメータ学習装置は、終了条件判定手段によって、予め設定された終了条件を満たすか否かを判定し、前記終了条件を満たすまで、減少させた前記更新率で前記写像ベクトル更新手段に前記写像ベクトルを更新させる。例えば、この終了条件は、更新率を減少させても、生起確率が変化しないという条件である。

混合係数パラメータ学習装置は、終了条件判定手段によって、予め設定された終了条件を満たすか否かを判定し、前記終了条件を満たすまで、減少させた前記更新率で前記写像ベクトル更新手段に前記写像ベクトルを更新させる。例えば、この終了条件は、更新率を減少させても、生起確率が変化しないという条件である。

また、前記した課題に鑑みて、本願発明に係る混合生起確率算出装置は、ニューラルネットワーク確率モデルと前記ニューラルネットワーク確率モデル以外の他の確率モデルとのそれぞれで求めた前要素系列に対する次要素の生起確率を混合した混合生起確率を算出する混合生起確率算出装置であって、第3生起確率入力手段と、第4生起確率入力手段と、第2混合係数算出手段と、混合生起確率算出手段とを備える構成とした。

かかる構成によれば、混合生起確率算出装置は、第3生起確率入力手段によって、前記ニューラルネットワークの隠れ層ベクトルと、前記ニューラルネットワーク確率モデルで求めた生起確率とが入力される。

混合生起確率算出装置は、第4生起確率入力手段によって、前記他の確率モデルで求めた生起確率が入力される。

混合生起確率算出装置は、第4生起確率入力手段によって、前記他の確率モデルで求めた生起確率が入力される。

混合生起確率算出装置は、第2混合係数算出手段によって、本願発明に係る混合係数パラメータ学習装置が学習した写像ベクトルで前記隠れ層ベクトルを実数値のスカラに線形写像し、前記実数値のスカラをシグモイド関数で非線形変換することで、前要素系列に応じた混合係数を算出する。

混合生起確率算出装置は、混合生起確率算出手段によって、前要素系列に応じた前記混合係数を用いて、前記ニューラルネットワーク確率モデルと前記他の確率モデルとで求めた前記次要素の生起確率を混合することで、前記混合生起確率を算出する。

本願発明は、以下のような優れた効果を奏する。

本願発明によれば、学習済みのニューラルネットワーク確率モデルの隠れ層ベクトルから混合係数への写像ベクトルを学習する。これにより、前要素系列に応じた混合係数が求められるので、混合生起確率の正確性を向上させることができる。

本願発明によれば、学習済みのニューラルネットワーク確率モデルの隠れ層ベクトルから混合係数への写像ベクトルを学習する。これにより、前要素系列に応じた混合係数が求められるので、混合生起確率の正確性を向上させることができる。

以下、本願発明の実施形態に係る混合生起確率算出システム1について説明する。

最初に、図1を参照し、写像ベクトルの学習手順と、混合生起確率の算出手順とを説明する。その後、混合生起確率算出システム1の構成について説明する。

最初に、図1を参照し、写像ベクトルの学習手順と、混合生起確率の算出手順とを説明する。その後、混合生起確率算出システム1の構成について説明する。

ここで、前文脈(前要素系列)を表現したh次元の隠れ層ベクトルを持ち、この隠れ層ベクトルからの写像として次単語の生起確率を演算するニューラルネットワーク言語モデル演算装置10があることとする。このニューラルネットワーク言語モデル演算装置10は、生起確率の計算に必要な各統計量が学習コーパス等により学習済みであることとする。

また、n−gram言語モデル等の他の言語モデルで次単語の生起確率を推定する他言語モデル演算装置20(図2)があることとする。この他言語モデル演算装置20では、生起確率の計算に必要な各統計量が学習コーパス等により学習済みであることとする。

なお、他言語モデル演算装置20の各統計量を学習するために用いる学習コーパス等は、前記のニューラルネットワーク言語モデル演算装置10の各統計量を学習するために用いた学習コーパスと同一である必要はない。

なお、他言語モデル演算装置20の各統計量を学習するために用いる学習コーパス等は、前記のニューラルネットワーク言語モデル演算装置10の各統計量を学習するために用いた学習コーパスと同一である必要はない。

<写像ベクトルの学習手順>

ニューラルネットワーク言語モデル演算装置10に前文脈を入力すると、隠れ層ベクトルとして、汎化された前文脈の表現が得られる。そこで、本願発明は、図1のように、ニューラルネットワーク言語モデル演算装置10に、隠れ層ベクトルzから混合係数λへの写像を行う処理を追加し、この写像ベクトルSを学習することとする。

ニューラルネットワーク言語モデル演算装置10に前文脈を入力すると、隠れ層ベクトルとして、汎化された前文脈の表現が得られる。そこで、本願発明は、図1のように、ニューラルネットワーク言語モデル演算装置10に、隠れ層ベクトルzから混合係数λへの写像を行う処理を追加し、この写像ベクトルSを学習することとする。

具体的には、ニューラルネットワーク言語モデルによる処理に以下の式(8)及び式(9)の処理を加えることで、前文脈…wt−1が与えられたときの次単語wtの生起確率の算出に必要な混合係数λ(t)を計算するようにする。

なお、式(8)は、実数値のスカラs(t)から混合係数λ(t)へのシグモイド関数による非線形変換を表している。

また、式(9)は、隠れ層ベクトルz(t)から実数値のスカラs(t)への線形写像Sz(t)を表している。また、式(9)では、bがバイアス値を表している。

また、式(9)は、隠れ層ベクトルz(t)から実数値のスカラs(t)への線形写像Sz(t)を表している。また、式(9)では、bがバイアス値を表している。

写像ベクトルS及びバイアス値bの学習は、何らかの学習コーパス中の各単語wtについて、生起確率pN(wt|…wt−1)と生起確率pO(wt|…wt−1)とを式(8)で定義される混合係数λ(t)を用いて、以下の式(10)に従って混合した混合生起確率p(wt|…wt−1)が最大となるように、以下の手順1〜手順3で行う。

なお、学習コーパスは、ニューラルネットワーク言語モデルや別の言語モデルの学習に用いたコーパスと同じもの、又は、そのコーパスと異なるものでもよい。

また、生起確率pN(wt|…wt−1)は、前文脈…wt−1をニューラルネットワーク言語モデルに与えて得られる次単語wtの生起確率である。

また、生起確率pO(wt|…wt−1)は、前文脈…wt−1を他の言語モデルに与えて得られる次単語wtの生起確率である。

また、生起確率pN(wt|…wt−1)は、前文脈…wt−1をニューラルネットワーク言語モデルに与えて得られる次単語wtの生起確率である。

また、生起確率pO(wt|…wt−1)は、前文脈…wt−1を他の言語モデルに与えて得られる次単語wtの生起確率である。

手順1.更新率εを予め設定する。

手順2.学習コーパス中の各単語wtに対して以下の(a)〜(c)の処理を実行する。

(a)ニューラルネットワーク言語モデル演算装置10に適宜(NNMLのように前文脈が固定されている場合、その長さで区切った)前文脈…wt−1を入力して順方向伝搬を行うことで、隠れ層ベクトルz(t)及び次単語wtの生起確率pN(wt|…wt−1)を求める。同様に、他の言語モデルの生起確率pO(wt|…wt−1)を求める。

手順2.学習コーパス中の各単語wtに対して以下の(a)〜(c)の処理を実行する。

(a)ニューラルネットワーク言語モデル演算装置10に適宜(NNMLのように前文脈が固定されている場合、その長さで区切った)前文脈…wt−1を入力して順方向伝搬を行うことで、隠れ層ベクトルz(t)及び次単語wtの生起確率pN(wt|…wt−1)を求める。同様に、他の言語モデルの生起確率pO(wt|…wt−1)を求める。

(b)隠れ層から順方向伝搬を行うことで、混合係数λ(t)を求める。すなわち、式(8)及び式(9)を用いて、混合係数λ(t)を求める。

(c)確率的勾配降下法により写像ベクトルSを更新する。すなわち、h次元の写像ベクトルSの各次元Siを、以下の式(11)及び式(12)のように混合係数λ(t)が反映された確率的勾配降下法により更新する。

さらに、式(9)のバイアス値bも学習の対象となる。このため、以下の式(13)及び式(14)のようにバイアス値bも更新する。

手順2(c)において、写像ベクトルSを更新する際、ニューラルネットワーク言語モデルによる過学習を防止するため、一例として式(15)のように、正則化を行ってもよい。さらに、バイアス値bについても、写像ベクトルSと同様、正則化を行ってもよい。

なお、式(15)では、βが正則化係数を表す。例えば、正則化係数βは、更新率εより小さな値とする。

なお、式(15)では、βが正則化係数を表す。例えば、正則化係数βは、更新率εより小さな値とする。

手順3.所定の終了条件に合致するまで、手順2に戻って処理を繰り返す。このとき、所定の更新率減少規則に従って、更新率εを減少させる。

なお、終了条件及び更新率減少規則の詳細は、後記する。

なお、終了条件及び更新率減少規則の詳細は、後記する。

<混合生起確率の算出手順>

次単語wtの生起確率の計算は、前記した学習結果を用いて、以下の手順4〜手順6で行う。

次単語wtの生起確率の計算は、前記した学習結果を用いて、以下の手順4〜手順6で行う。

手順4.ニューラルネットワーク言語モデル演算装置に適宜(NNMLのように前文脈が固定されている場合、その長さで区切った)前文脈…wt−1を入力して順方向伝搬を行うことで、隠れ層ベクトルz(t)及び次単語wtの生起確率pN(wt|…wt−1)を求める。同様に、他の言語モデルの生起確率pO(wt|…wt−1)を求める。

なお、この手順4は、写像ベクトルSの学習手順2(a)と同じ処理である。

なお、この手順4は、写像ベクトルSの学習手順2(a)と同じ処理である。

手順5.隠れ層から順方向伝搬を行うことで、混合係数λ(t)を求める。すなわち、学習した写像ベクトルS及びバイアス値bを式(9)に代入して、混合係数λ(t)を求める。なお、この手順5は、写像ベクトルSの学習手順2(b)と同じ処理である。

手順6.式(16)を用いて、混合生起確率p(wt|…wt−1)を求める。

手順6.式(16)を用いて、混合生起確率p(wt|…wt−1)を求める。

図2を参照し、本願発明の実施形態に係る混合生起確率算出システム1の構成について説明する。

混合生起確率算出システム1は、ニューラルネットワーク言語モデルで求めた生起確率pNと、他の言語モデルで求めた生起確率pOとを混合した混合生起確率Pを算出するものである。図2のように、混合生起確率算出システム1は、ニューラルネットワーク言語モデル演算装置10と、他言語モデル演算装置20と、混合係数パラメータ学習装置30と、混合生起確率算出装置40とを備える。

[ニューラルネットワーク言語モデル演算装置の構成]

ニューラルネットワーク言語モデル演算装置10は、ニューラルネットワーク言語モデルにより、生起確率pNを演算するものである。例えば、ニューラルネットワーク言語モデル演算装置10は、隠れ層を用いるニューラルネットワーク(例えば、NNLM、RNNLM)を用いることができる。

ニューラルネットワーク言語モデル演算装置10は、ニューラルネットワーク言語モデルにより、生起確率pNを演算するものである。例えば、ニューラルネットワーク言語モデル演算装置10は、隠れ層を用いるニューラルネットワーク(例えば、NNLM、RNNLM)を用いることができる。

具体的には、ニューラルネットワーク言語モデル演算装置10は、前文脈w1,w2,…,wt−1が入力されると、当該前文脈に後続する単語wtの生起確率pN(wt|…wt−1)を演算する。また、ニューラルネットワーク言語モデル演算装置10は、ニューラルネットワークの出力層ベクトルp(t)を演算する際、ニューラルネットワークの入力層ベクトルx(t)から算出した隠れ層ベクトルz(t)を記憶し、記憶した隠れ層ベクトルz(t)を混合係数パラメータ学習装置30又は混合生起確率算出装置40に出力する。

NNLMの場合、ニューラルネットワーク言語モデル演算装置10は、参照可能な前文脈の長さが、前文脈の末尾から所定の単語数n−1までに限定される(nは1以上の整数)。

例えば、前文脈がw1,w2,…,wt−1の場合、参照可能な前文脈がwt−n+1,wt-n+1,…,wt−1となる。

ニューラルネットワーク言語モデル演算装置10は、入力された前文脈の各単語に対応した単語表現ベクトルC(w)を記憶し、長さn−1の前文脈wt−n+1,wt-n+1,…,wt−1が入力されると、その各単語に応じた単語表現ベクトルC(w)を連結してニューラルネットワークの入力層ベクトルx(t)に設定する。そして、ニューラルネットワーク言語モデル演算装置10は、順方向伝搬を行い、ニューラルネットワークの隠れ層ベクトルz(t)及び出力層ベクトルp(t)を算出する。

出力層ベクトルp(t)は、単語の異なり数の次元を持つベクトルであり、ベクトルの各次元の値がその次元に対応した単語の生起確率を表す。なお、隠れ層ベクトルz(t)を「前文脈w1,w2,…,wt−1の隠れ層表現」と呼ぶ。

例えば、前文脈がw1,w2,…,wt−1の場合、参照可能な前文脈がwt−n+1,wt-n+1,…,wt−1となる。

ニューラルネットワーク言語モデル演算装置10は、入力された前文脈の各単語に対応した単語表現ベクトルC(w)を記憶し、長さn−1の前文脈wt−n+1,wt-n+1,…,wt−1が入力されると、その各単語に応じた単語表現ベクトルC(w)を連結してニューラルネットワークの入力層ベクトルx(t)に設定する。そして、ニューラルネットワーク言語モデル演算装置10は、順方向伝搬を行い、ニューラルネットワークの隠れ層ベクトルz(t)及び出力層ベクトルp(t)を算出する。

出力層ベクトルp(t)は、単語の異なり数の次元を持つベクトルであり、ベクトルの各次元の値がその次元に対応した単語の生起確率を表す。なお、隠れ層ベクトルz(t)を「前文脈w1,w2,…,wt−1の隠れ層表現」と呼ぶ。

RNNLMの場合、ニューラルネットワーク言語モデル演算装置10は、内部にこれまで順に入力された単語系列w1,w2,…を前文脈とする隠れ層ベクトルzを記憶している。初期状態において、隠れ層ベクトルzは、ニューラルネットワーク言語モデル演算装置10に固有の初期値に設定される。

ニューラルネットワーク言語モデル演算装置10は、i番目の単語wiを入力すると、当該単語wiに対応した次元のみが1で、他のすべての次元が0であるベクトルを入力層x(i)に設定する。そして、ニューラルネットワーク言語モデル演算装置10は、入力層x(i)及び記憶している前入力の隠れ層ベクトルz(i)から順方向伝搬を行い、ニューラルネットワークの隠れ層ベクトルz(i+1)及び出力層ベクトルp(i+1)を算出する。単語w1,w2,…,wt−1までの入力及び順方向伝搬が終了したとき、隠れ層ベクトルz(t)は、前記したNNLMを用いた場合の「前文脈w1,w2,…,wt−1の隠れ層表現」と同様のものになる。すなわち、ニューラルネットワーク言語モデル演算装置10は、隠れ層ベクトルz(t)を用いた順方向伝搬により出力層ベクトルp(t)を算出し、次単語の生起確率pNを求める。

ニューラルネットワーク言語モデル演算装置10は、i番目の単語wiを入力すると、当該単語wiに対応した次元のみが1で、他のすべての次元が0であるベクトルを入力層x(i)に設定する。そして、ニューラルネットワーク言語モデル演算装置10は、入力層x(i)及び記憶している前入力の隠れ層ベクトルz(i)から順方向伝搬を行い、ニューラルネットワークの隠れ層ベクトルz(i+1)及び出力層ベクトルp(i+1)を算出する。単語w1,w2,…,wt−1までの入力及び順方向伝搬が終了したとき、隠れ層ベクトルz(t)は、前記したNNLMを用いた場合の「前文脈w1,w2,…,wt−1の隠れ層表現」と同様のものになる。すなわち、ニューラルネットワーク言語モデル演算装置10は、隠れ層ベクトルz(t)を用いた順方向伝搬により出力層ベクトルp(t)を算出し、次単語の生起確率pNを求める。

なお、ニューラルネットワーク言語モデル演算装置10は、学習済みであり(学習データにより順方向伝搬のための写像行列が適切な値に設定済みであり)、その学習結果が記憶されていることとする。

また、ニューラルネットワーク言語モデル演算装置10は、一般的な構成のため、これ以上の説明を省略する。

また、ニューラルネットワーク言語モデル演算装置10は、一般的な構成のため、これ以上の説明を省略する。

[他言語モデル演算装置の構成]

他言語モデル演算装置20は、ニューラルネットワーク言語モデル以外の他の言語モデル(例えば、n−gram言語モデル)により、生起確率pOを演算するものである。具体的には、他言語モデル演算装置20は、前文脈w1,w2,…,wt−1が入力されると、当該前文脈に後続する任意の単語wtの生起確率pO(wt|…wt−1)を演算して出力する。

他言語モデル演算装置20は、ニューラルネットワーク言語モデル以外の他の言語モデル(例えば、n−gram言語モデル)により、生起確率pOを演算するものである。具体的には、他言語モデル演算装置20は、前文脈w1,w2,…,wt−1が入力されると、当該前文脈に後続する任意の単語wtの生起確率pO(wt|…wt−1)を演算して出力する。

なお、他言語モデル演算装置20は、確率値の計算に必要な各種パラメータが予め設定されていることとする。

また、他言語モデル演算装置20は、一般的な構成のため、これ以上の説明を省略する。

また、他言語モデル演算装置20は、一般的な構成のため、これ以上の説明を省略する。

[混合係数パラメータ学習装置の構成]

混合係数パラメータ学習装置30は、ニューラルネットワーク言語モデルと他の言語モデルとのそれぞれで求めた生起確率pN,pOを混合するときの混合係数λの算出に必要なパラメータを学習するものである。

混合係数パラメータ学習装置30は、ニューラルネットワーク言語モデルと他の言語モデルとのそれぞれで求めた生起確率pN,pOを混合するときの混合係数λの算出に必要なパラメータを学習するものである。

図2のように、混合係数パラメータ学習装置30は、混合係数パラメータ記憶手段301と、学習パラメータ記憶手段302と、学習データ記憶手段303と、混合係数記憶手段304と、初期化手段311と、第1生起確率要求手段(第1生起確率入力手段)312と、第2生起確率要求手段(第2生起確率入力手段)313と、第1混合係数算出手段314と、写像ベクトル更新手段315と、終了条件判定手段316と、更新率減少手段317とを備える。

混合係数パラメータ記憶手段301は、混合係数λの算出に必要な混合係数パラメータを記憶するメモリ、ハードディスク等の記憶手段である。具体的には、混合係数パラメータ記憶手段301は、写像ベクトルS、バイアス値b等の混合係数パラメータを記憶する。この写像ベクトルSは、ニューラルネットワークの隠れ層ベクトルzの次元数hと同一次元数である。

学習パラメータ記憶手段302は、写像ベクトルSの学習に必要なパラメータを記憶するメモリ、ハードディスク等の記憶手段である。具体的には、学習パラメータ記憶手段302は、更新率ε、正則化係数β等の学習パラメータを記憶する。

学習データ記憶手段303は、写像ベクトルSの学習に必要な学習データである単語列を記憶するメモリ、ハードディスク等の記憶手段である。この学習データは、ニューラルネットワーク言語モデル演算装置10及び他言語モデル演算装置20で学習に用いたものと同一でなくともよい。

混合係数記憶手段304は、混合係数λを記憶するメモリ、ハードディスク等の記憶手段である。

混合係数記憶手段304は、混合係数λを記憶するメモリ、ハードディスク等の記憶手段である。

初期化手段311は、混合係数パラメータ及び学習パラメータの初期化を行うものである。具体的には、初期化手段311は、混合係数パラメータ記憶手段301の写像ベクトルSの各次元の値、および、バイアス値bを乱数で初期化する。また、初期化手段311は、学習パラメータ記憶手段302の更新率ε及び正則化係数βを予め設定した値で初期化する。

第1生起確率要求手段312は、学習データ記憶手段303の前文脈をニューラルネットワーク言語モデル演算装置10に出力することで、隠れ層ベクトルz及び生起確率pNを要求するものである。この要求に応じて、第1生起確率要求手段312は、ニューラルネットワーク言語モデル演算装置10から、隠れ層ベクトルz及び生起確率pNが入力される。そして、第1生起確率要求手段312は、入力された隠れ層ベクトルz及び生起確率pNを第1混合係数算出手段314及び写像ベクトル更新手段315に出力する。

第2生起確率要求手段313は、学習データ記憶手段303の前文脈を他言語モデル演算装置20に出力することで、生起確率pOを要求するものである。ここで、第2生起確率要求手段313は、第1生起確率要求手段312と同一の前文脈を他言語モデル演算装置20に出力する。この要求に応じて、第2生起確率要求手段313は、他言語モデル演算装置20から、生起確率pOが入力される。そして、第2生起確率要求手段313は、入力された生起確率pOを写像ベクトル更新手段315に出力する。

第1混合係数算出手段314は、式(9)を用いて、混合係数パラメータ記憶手段301の写像ベクトルSにより、第1生起確率要求手段312から入力された隠れ層ベクトルzを実数値のスカラsに線形写像するものである。また、第1混合係数算出手段314は、式(8)を用いて、実数値のスカラsをシグモイド関数で非線形変換することで、混合係数λを算出する。そして、第1混合係数算出手段314は、算出した混合係数λを混合係数記憶手段304に記憶する。

写像ベクトル更新手段315は、第1生起確率要求手段312からの生起確率pN、第2生起確率要求手段313からの生起確率pO、混合係数記憶手段304の混合係数λ、及び、学習パラメータ記憶手段302の更新率εを用いた確率的勾配降下法により、混合係数記憶手段304の写像ベクトルSを更新するものである。つまり、写像ベクトル更新手段315は、式(11)及び式(12)で表される確率的勾配降下法を用いて、写像ベクトルSを更新する。

終了条件判定手段316は、予め設定された終了条件を満たすか否かを判定し、この終了条件を満たすまで、後記する更新率減少手段317が減少させた更新率εで写像ベクトル更新手段315に写像ベクトルSを更新させるものである。例えば、終了条件判定手段316は、予め設定した回数だけ更新率εを減少させて混合生起確率pの値が変化しなかった場合、終了条件を満たすと判定する。

ここで、終了条件を満たしていない場合、終了条件判定手段316は、更新率減少手段317に更新率εの減少を指令する。その後、終了条件判定手段316は、第1生起確率要求手段312、第2生起確率要求手段313、第1混合係数算出手段314、及び、写像ベクトル更新手段315に処理の再実行を指令する。

一方、終了条件を満たしている場合、終了条件判定手段316は、処理を終了する。

なお、図2では、終了条件判定手段316からの指令信号を破線で図示した。

一方、終了条件を満たしている場合、終了条件判定手段316は、処理を終了する。

なお、図2では、終了条件判定手段316からの指令信号を破線で図示した。

更新率減少手段317は、予め設定された更新率減少規則に従って、必要に応じて学習パラメータ記憶手段302の更新率εを減少させるものである。例えば、更新率減少規則としては、更新率εの値から予め設定した値を減算するという規則があげられる。

[混合生起確率算出装置の構成]

混合生起確率算出装置40は、ニューラルネットワーク言語モデルと他の確率モデルとのそれぞれで求めた生起確率pN,pOを混合した混合生起確率pを算出するものである。図2のように、混合生起確率算出装置40は、対象データ記憶手段401と、混合生起確率記憶手段402と、第3生起確率要求手段(第3生起確率入力手段)411と、第4生起確率要求手段(第4生起確率入力手段)412と、第2混合係数算出手段413と、混合生起確率算出手段414とを備える。

混合生起確率算出装置40は、ニューラルネットワーク言語モデルと他の確率モデルとのそれぞれで求めた生起確率pN,pOを混合した混合生起確率pを算出するものである。図2のように、混合生起確率算出装置40は、対象データ記憶手段401と、混合生起確率記憶手段402と、第3生起確率要求手段(第3生起確率入力手段)411と、第4生起確率要求手段(第4生起確率入力手段)412と、第2混合係数算出手段413と、混合生起確率算出手段414とを備える。

対象データ記憶手段401は、混合生起確率pの算出対象となる前文脈及び次単語を表す単語列を記憶するメモリ、ハードディスク等の記憶手段である。この対象データ記憶手段401の単語列は、学習データ記憶手段303の単語列と異なるものである。

混合生起確率記憶手段402は、混合生起確率pを記憶するメモリ、ハードディスク等の記憶手段である。

混合生起確率記憶手段402は、混合生起確率pを記憶するメモリ、ハードディスク等の記憶手段である。

第3生起確率要求手段411は、対象データ記憶手段401の前文脈をニューラルネットワーク言語モデル演算装置10に出力することで、隠れ層ベクトルz及び生起確率pNを要求するものである。この要求に応じて、第3生起確率要求手段411は、ニューラルネットワーク言語モデル演算装置10から、隠れ層ベクトルz及び生起確率pNが入力される。そして、第3生起確率要求手段411は、入力された隠れ層ベクトルz及び生起確率pNを第2混合係数算出手段413及び混合生起確率算出手段414に出力する。

第4生起確率要求手段412は、対象データ記憶手段401の前文脈を他言語モデル演算装置20に出力することで、生起確率pOを要求するものである。ここで、第4生起確率要求手段412は、第3生起確率要求手段411と同一の前文脈を他言語モデル演算装置20に出力する。この要求に応じて、第4生起確率要求手段412は、他言語モデル演算装置20から、生起確率pOが入力される。そして、第4生起確率要求手段412は、入力された生起確率pOを混合生起確率算出手段414に出力する。

第2混合係数算出手段413は、式(9)を用いて、混合係数パラメータ記憶手段301の写像ベクトルSにより、第3生起確率要求手段411から入力された隠れ層ベクトルzを実数値のスカラsに線形写像するものである。また、第2混合係数算出手段413は、式(8)を用いて、実数値のスカラsをシグモイド関数で非線形変換することで、混合係数λを算出する。そして、第2混合係数算出手段413は、算出した混合係数を混合係数記憶手段304に記憶する。

混合生起確率算出手段414は、混合係数記憶手段304の混合係数λを用いて、第3生起確率要求手段411から入力された生起確率pNと、第4生起確率要求手段412から入力された生起確率pOとを混合することで、混合生起確率pを算出するものである。そして、混合生起確率算出手段414は、算出した混合生起確率pを混合生起確率記憶手段402に記憶する。

[混合係数パラメータ学習装置の動作]

図3を参照し、混合係数パラメータ学習装置30の動作について説明する(適宜図2参照)。

図3を参照し、混合係数パラメータ学習装置30の動作について説明する(適宜図2参照)。

混合係数パラメータ学習装置30は、初期化手段311によって、写像ベクトルS、バイアス値b等の混合係数パラメータを初期化する(ステップS1)。

混合係数パラメータ学習装置30は、初期化手段311によって、更新率ε、正則化係数β等の学習パラメータを初期化する(ステップS2)。

混合係数パラメータ学習装置30は、カウンタiの値を1に初期化する(ステップS3)。

混合係数パラメータ学習装置30は、初期化手段311によって、更新率ε、正則化係数β等の学習パラメータを初期化する(ステップS2)。

混合係数パラメータ学習装置30は、カウンタiの値を1に初期化する(ステップS3)。

混合係数パラメータ学習装置30は、第1生起確率要求手段312によって、学習データ記憶手段303の単語列w1,w2,…,wNのうち、先頭からi−1個の単語列w1,w2,…,wi−1を前文脈としてニューラルネットワーク言語モデル演算装置10に出力する。

混合係数パラメータ学習装置30は、第1生起確率要求手段312によって、ニューラルネットワーク言語モデル演算装置10から、隠れ層ベクトルz(i)及び次単語wiの生起確率pN(wi|w1w2…wi−1)が入力される(ステップS4)。

混合係数パラメータ学習装置30は、第1生起確率要求手段312によって、ニューラルネットワーク言語モデル演算装置10から、隠れ層ベクトルz(i)及び次単語wiの生起確率pN(wi|w1w2…wi−1)が入力される(ステップS4)。

混合係数パラメータ学習装置30は、第2生起確率要求手段313によって、ステップS4と同一の前文脈w1,w2,…,wi−1を他言語モデル演算装置20に出力する。

混合係数パラメータ学習装置30は、第2生起確率要求手段313によって、他言語モデル演算装置20から、次単語wiの生起確率pO(wi|w1w2…wi−1)が入力される(ステップS5)。

混合係数パラメータ学習装置30は、第2生起確率要求手段313によって、他言語モデル演算装置20から、次単語wiの生起確率pO(wi|w1w2…wi−1)が入力される(ステップS5)。

混合係数パラメータ学習装置30は、第1混合係数算出手段314によって、ステップS4で入力された隠れ層のベクトルz(i)及び写像ベクトルSを用いて、式(8)及び式(9)に従って混合係数λ(i)を算出する(ステップS6)

混合係数パラメータ学習装置30は、写像ベクトル更新手段315によって、ステップS4で入力された生起確率pN(wi|w1w2…wi−1)と、ステップS5で入力された生起確率pO(wi|w1w2…wi−1)と、ステップS6で算出した混合係数λ(i)と、更新率εとを用いて、式(11)及び式(12)で写像ベクトルSを更新する(ステップS7)。

混合係数パラメータ学習装置30は、カウンタiをインクリメントする(ステップS8)。

混合係数パラメータ学習装置30は、カウンタiが単語最大数N以下であるか否かを判定する(ステップS9)。

カウンタiが単語最大数N以下の場合(ステップS9でYes)、混合係数パラメータ学習装置30は、ステップS4の処理に戻る。

混合係数パラメータ学習装置30は、カウンタiが単語最大数N以下であるか否かを判定する(ステップS9)。

カウンタiが単語最大数N以下の場合(ステップS9でYes)、混合係数パラメータ学習装置30は、ステップS4の処理に戻る。

カウンタiが単語最大数N以下でない場合(ステップS9でNo)、混合係数パラメータ学習装置30は、終了条件判定手段316によって、終了条件を満たすか否かを判定する(ステップS10)。

終了条件を満たす場合(ステップS10でYes)、混合係数パラメータ学習装置30は、処理を終了する。

終了条件を満たす場合(ステップS10でYes)、混合係数パラメータ学習装置30は、処理を終了する。

終了条件を満たさない場合(ステップS10でNo)、混合係数パラメータ学習装置30は、更新率減少手段317によって、更新率減少規則に従って、必要に応じて更新率εを減少させ(ステップS11)、ステップS3の処理に戻る。

[混合生起確率算出装置の動作]

図4を参照し、混合生起確率算出装置40の動作について説明する(適宜図1参照)。

図4を参照し、混合生起確率算出装置40の動作について説明する(適宜図1参照)。

混合生起確率算出装置40は、第3生起確率要求手段411によって、対象データ記憶手段401の単語列w1,w2,…,wt−1を前文脈としてニューラルネットワーク言語モデル演算装置10に出力する。

混合生起確率算出装置40は、第3生起確率要求手段411によって、ニューラルネットワーク言語モデル演算装置10から、隠れ層ベクトルz及び次単語wtの生起確率pN(wt|w1w2…wt−1)が入力される(ステップS21)。

混合生起確率算出装置40は、第3生起確率要求手段411によって、ニューラルネットワーク言語モデル演算装置10から、隠れ層ベクトルz及び次単語wtの生起確率pN(wt|w1w2…wt−1)が入力される(ステップS21)。

混合生起確率算出装置40は、第4生起確率要求手段412によって、ステップS21と同一の前文脈w1,w2,…,wt−1を他言語モデル演算装置20に出力する。

混合生起確率算出装置40は、第4生起確率要求手段412によって、他言語モデル演算装置20から、次単語wiの生起確率pO(wt|w1w2…wt−1)が入力される(ステップS22)。

混合生起確率算出装置40は、第4生起確率要求手段412によって、他言語モデル演算装置20から、次単語wiの生起確率pO(wt|w1w2…wt−1)が入力される(ステップS22)。

混合生起確率算出装置40は、第2混合係数算出手段413によって、ステップS21で入力された隠れ層のベクトルz及び写像ベクトルSを用いて、式(8)及び式(9)に従って混合係数λ(t)を算出する(ステップS23)

混合生起確率算出装置40は、混合生起確率算出手段414によって、ステップ21で入力された生起確率pN(wt|w1w2…wt−1)とステップ22で入力された生起確率pO(wt|w1,w2,…,wt−1)との混合生起確率p(wt|w1w2…wt−1)を、式(16)で算出する(ステップS24)。

[作用・効果]

以上のように、混合生起確率算出システム1は、ニューラルネットワーク言語モデルにより写像ベクトルSを学習し、学習した写像ベクトルSにより前文脈に応じた混合係数を求めている。これにより、混合生起確率算出システム1は、n−gram言語モデル等の他の言語モデルと混合して混合生起確率pを算出する際、従来よりも混合生起確率pの正確性を向上させることができる。

以上のように、混合生起確率算出システム1は、ニューラルネットワーク言語モデルにより写像ベクトルSを学習し、学習した写像ベクトルSにより前文脈に応じた混合係数を求めている。これにより、混合生起確率算出システム1は、n−gram言語モデル等の他の言語モデルと混合して混合生起確率pを算出する際、従来よりも混合生起確率pの正確性を向上させることができる。

(変形例)

以上、本願発明の各実施形態を詳述してきたが、本願発明は前記した実施形態に限られるものではなく、本願発明の要旨を逸脱しない範囲の設計変更等も含まれる。

以上、本願発明の各実施形態を詳述してきたが、本願発明は前記した実施形態に限られるものではなく、本願発明の要旨を逸脱しない範囲の設計変更等も含まれる。

前記した実施形態では、混合係数パラメータ学習装置が混合係数パラメータ記憶手段及び混合係数記憶手段を備えることとして説明したが、本願発明は、これに限定されない。つまり、混合生起確率算出装置が混合係数パラメータ記憶手段及び混合係数記憶手段を備えてもよい。

前記した実施形態では、本願発明を言語モデルに適用する例を説明したが、本願発明が適用可能な確率モデルはこれに限定されず、何らかの記号系列に後続して生起する記号の生起確率モデル一般に適用することができる。

前記した実施形態では、正則化を行うこととして説明したが、本願発明は、正則化を行わなくともよい。

前記した実施形態では、バイアス値bを用いることとして説明したが、本願発明は、バイアス値bを用いなくともよい。この場合、前記した式(9)の代わりに以下の式(17)を用いることになる。

前記した実施形態では、バイアス値bを用いることとして説明したが、本願発明は、バイアス値bを用いなくともよい。この場合、前記した式(9)の代わりに以下の式(17)を用いることになる。

前記した実施形態では、混合係数パラメータ学習装置を独立したハードウェアとして説明したが、本願発明は、これに限定されない。例えば、混合係数パラメータ学習装置は、コンピュータが備えるCPU、メモリ、ハードディスク等のハードウェア資源を協調動作させる混合係数パラメータ学習プログラムで実現することもできる。このプログラムは、通信回線を介して配布してもよく、CD−ROMやフラッシュメモリ等の記録媒体に書き込んで配布してもよい。

また、混合生起確率算出装置は、混合係数パラメータ学習装置と同様、混合生起確率算出プログラムで実現することもできる。

また、混合生起確率算出装置は、混合係数パラメータ学習装置と同様、混合生起確率算出プログラムで実現することもできる。

1 混合生起確率算出システム

10 ニューラルネットワーク言語モデル演算装置

20 他言語モデル演算装置

30 混合係数パラメータ学習装置

301 混合係数パラメータ記憶手段

302 学習パラメータ記憶手段

303 学習データ記憶手段

304 混合係数記憶手段

311 初期化手段

312 第1生起確率要求手段(第1生起確率入力手段)

313 第2生起確率要求手段(第2生起確率入力手段)

314 第1混合係数算出手段

315 写像ベクトル更新手段

316 終了条件判定手段

317 更新率減少手段

40 混合生起確率算出装置

401 対象データ記憶手段

402 混合生起確率記憶手段

411 第3生起確率要求手段(第3生起確率入力手段)

412 第4生起確率要求手段(第4生起確率入力手段)

413 第2混合係数算出手段

414 混合生起確率算出手段

10 ニューラルネットワーク言語モデル演算装置

20 他言語モデル演算装置

30 混合係数パラメータ学習装置

301 混合係数パラメータ記憶手段

302 学習パラメータ記憶手段

303 学習データ記憶手段

304 混合係数記憶手段

311 初期化手段

312 第1生起確率要求手段(第1生起確率入力手段)

313 第2生起確率要求手段(第2生起確率入力手段)

314 第1混合係数算出手段

315 写像ベクトル更新手段

316 終了条件判定手段

317 更新率減少手段

40 混合生起確率算出装置

401 対象データ記憶手段

402 混合生起確率記憶手段

411 第3生起確率要求手段(第3生起確率入力手段)

412 第4生起確率要求手段(第4生起確率入力手段)

413 第2混合係数算出手段

414 混合生起確率算出手段

Claims (5)

- ニューラルネットワーク確率モデルと前記ニューラルネットワーク確率モデル以外の他の確率モデルとのそれぞれで求めた前要素系列に対する次要素の生起確率を混合するときの混合係数の算出に必要なパラメータを学習する混合係数パラメータ学習装置であって、

前記ニューラルネットワーク確率モデルの隠れ層ベクトルと、前記ニューラルネットワーク確率モデルで求めた生起確率とが入力される第1生起確率入力手段と、

前記他の確率モデルで求めた生起確率が入力される第2生起確率入力手段と、

予め設定された写像ベクトルにより前記隠れ層ベクトルを実数値のスカラに線形写像し、前記実数値のスカラをシグモイド関数で非線形変換することで、前記混合係数を算出する第1混合係数算出手段と、

前記ニューラルネットワーク確率モデルと前記他の確率モデルとのそれぞれで求めた生起確率、前記混合係数、及び、予め設定された更新率を用いた確率的勾配降下法により、前記パラメータとしての前記写像ベクトルを更新する写像ベクトル更新手段と、

予め設定された更新率減少規則に従って前記更新率を減少させる更新率減少手段と、

予め設定された終了条件を満たすか否かを判定し、前記終了条件を満たすまで、減少させた前記更新率で前記写像ベクトル更新手段に前記写像ベクトルを更新させる終了条件判定手段と、

を備えることを特徴とする混合係数パラメータ学習装置。 - 前記写像ベクトル更新手段は、前記写像ベクトルを更新するときに正則化を行うことを特徴とする請求項1に記載の混合係数パラメータ学習装置。

- ニューラルネットワーク確率モデルと前記ニューラルネットワーク確率モデル以外の他の確率モデルとのそれぞれで求めた前要素系列に対する次要素の生起確率を混合した混合生起確率を算出する混合生起確率算出装置であって、

前記ニューラルネットワークの隠れ層ベクトルと、前記ニューラルネットワーク確率モデルで求めた生起確率とが入力される第3生起確率入力手段と、

前記他の確率モデルで求めた生起確率が入力される第4生起確率入力手段と、

請求項1に記載の混合係数パラメータ学習装置が学習した写像ベクトルで前記隠れ層ベクトルを実数値のスカラに線形写像し、前記実数値のスカラをシグモイド関数で非線形変換することで、混合係数を算出する第2混合係数算出手段と、

前記混合係数を用いて、前記ニューラルネットワーク確率モデルと前記他の確率モデルとで求めた前記次要素の生起確率を混合することで、前記混合生起確率を算出する混合生起確率算出手段と、

を備えることを特徴とする混合生起確率算出装置。 - コンピュータを、請求項1又は請求項2に記載の混合係数パラメータ学習装置として機能させるための混合係数パラメータ学習プログラム。

- コンピュータを、請求項3に記載の混合生起確率算出装置として機能させるための混合生起確率算出プログラム。

Priority Applications (1)

| Application Number | Priority Date | Filing Date | Title |

|---|---|---|---|

| JP2015132347A JP2017016384A (ja) | 2015-07-01 | 2015-07-01 | 混合係数パラメータ学習装置、混合生起確率算出装置、及び、これらのプログラム |

Applications Claiming Priority (1)

| Application Number | Priority Date | Filing Date | Title |

|---|---|---|---|

| JP2015132347A JP2017016384A (ja) | 2015-07-01 | 2015-07-01 | 混合係数パラメータ学習装置、混合生起確率算出装置、及び、これらのプログラム |

Publications (1)

| Publication Number | Publication Date |

|---|---|

| JP2017016384A true JP2017016384A (ja) | 2017-01-19 |

Family

ID=57829182

Family Applications (1)

| Application Number | Title | Priority Date | Filing Date |

|---|---|---|---|

| JP2015132347A Pending JP2017016384A (ja) | 2015-07-01 | 2015-07-01 | 混合係数パラメータ学習装置、混合生起確率算出装置、及び、これらのプログラム |

Country Status (1)

| Country | Link |

|---|---|

| JP (1) | JP2017016384A (ja) |

Cited By (7)

| Publication number | Priority date | Publication date | Assignee | Title |

|---|---|---|---|---|

| JP2018055670A (ja) * | 2016-09-27 | 2018-04-05 | パナソニックIpマネジメント株式会社 | 類似文生成方法、類似文生成プログラム、類似文生成装置及び類似文生成システム |

| JP2019046188A (ja) * | 2017-09-01 | 2019-03-22 | 日本電信電話株式会社 | 文生成装置、文生成学習装置、文生成方法、及びプログラム |

| JP2019139629A (ja) * | 2018-02-14 | 2019-08-22 | 株式会社Nttドコモ | 機械翻訳装置、翻訳学習済みモデル及び判定学習済みモデル |

| WO2019171925A1 (ja) * | 2018-03-08 | 2019-09-12 | 日本電信電話株式会社 | 言語モデルを利用する装置、方法及びプログラム |

| CN112771523A (zh) * | 2018-08-14 | 2021-05-07 | 北京嘀嘀无限科技发展有限公司 | 用于检测生成域的系统和方法 |

| CN114731171A (zh) * | 2019-11-13 | 2022-07-08 | 美光科技公司 | 混合用于处理模式选择的系数数据 |

| US12237918B2 (en) | 2016-11-30 | 2025-02-25 | Micron Technology, Inc. | Wireless devices and systems including examples of mixing coefficient data specific to a processing mode selection |

-

2015

- 2015-07-01 JP JP2015132347A patent/JP2017016384A/ja active Pending

Cited By (10)

| Publication number | Priority date | Publication date | Assignee | Title |

|---|---|---|---|---|

| JP2018055670A (ja) * | 2016-09-27 | 2018-04-05 | パナソニックIpマネジメント株式会社 | 類似文生成方法、類似文生成プログラム、類似文生成装置及び類似文生成システム |

| US12237918B2 (en) | 2016-11-30 | 2025-02-25 | Micron Technology, Inc. | Wireless devices and systems including examples of mixing coefficient data specific to a processing mode selection |

| JP2019046188A (ja) * | 2017-09-01 | 2019-03-22 | 日本電信電話株式会社 | 文生成装置、文生成学習装置、文生成方法、及びプログラム |

| JP2019139629A (ja) * | 2018-02-14 | 2019-08-22 | 株式会社Nttドコモ | 機械翻訳装置、翻訳学習済みモデル及び判定学習済みモデル |

| JP7122835B2 (ja) | 2018-02-14 | 2022-08-22 | 株式会社Nttドコモ | 機械翻訳装置、翻訳学習済みモデル及び判定学習済みモデル |

| WO2019171925A1 (ja) * | 2018-03-08 | 2019-09-12 | 日本電信電話株式会社 | 言語モデルを利用する装置、方法及びプログラム |

| JP2019159464A (ja) * | 2018-03-08 | 2019-09-19 | 日本電信電話株式会社 | 言語モデルを利用する装置、方法及びプログラム |

| CN112771523A (zh) * | 2018-08-14 | 2021-05-07 | 北京嘀嘀无限科技发展有限公司 | 用于检测生成域的系统和方法 |

| CN114731171A (zh) * | 2019-11-13 | 2022-07-08 | 美光科技公司 | 混合用于处理模式选择的系数数据 |

| US12237862B2 (en) | 2019-11-13 | 2025-02-25 | Micron Technology, Inc. | Mixing coefficient data for processing mode selection |

Similar Documents

| Publication | Publication Date | Title |

|---|---|---|

| JP2017016384A (ja) | 混合係数パラメータ学習装置、混合生起確率算出装置、及び、これらのプログラム | |

| US12190232B2 (en) | Asychronous training of machine learning model | |

| Fan et al. | Nonlinear time series: nonparametric and parametric methods | |

| US20190244604A1 (en) | Model learning device, method therefor, and program | |

| CN112084301B (zh) | 文本修正模型的训练方法及装置、文本修正方法及装置 | |

| US12450465B2 (en) | Scalable partially shared multi-task neural network system, method, and program | |

| Li et al. | An adaptive importance sampling algorithm for Bayesian inversion with multimodal distributions | |

| US11380301B2 (en) | Learning apparatus, speech recognition rank estimating apparatus, methods thereof, and program | |

| YiFei et al. | Metamodel-assisted hybrid optimization strategy for model updating using vibration response data | |

| CN118571254B (zh) | 深度学习模型的训练方法及语音合成方法 | |

| JP7349811B2 (ja) | 訓練装置、生成装置及びグラフ生成方法 | |

| CN116402154A (zh) | 一种基于神经网络的本征值求解方法及设备 | |

| CN108475346B (zh) | 神经随机访问机器 | |

| de Bézenac et al. | Optimal unsupervised domain translation | |

| WO2024188311A1 (zh) | 对神经网络进行训练的方法及更新神经网络参数的优化器 | |

| CN120239861A (zh) | 分数插值扩散模型 | |

| JP2018180045A (ja) | 音響モデル学習装置、モデル学習装置、モデル学習方法、およびプログラム | |

| Dong et al. | A stochastic approximation-Langevinized ensemble Kalman filter algorithm for state space models with unknown parameters | |

| CN116894778A (zh) | 一种用于图像生成的扩散模型采样方法和装置 | |

| CN121145732A (zh) | 一种基于潜在扩散模型的不可压缩湍流流场预测方法 | |

| CN109117471B (zh) | 一种词语相关度的计算方法及终端 | |

| CN120409566A (zh) | 一种大语言模型权重与激活联合量化方法及系统 | |

| Zhu et al. | A hybrid model for nonlinear regression with missing data using quasilinear kernel | |

| JP2019075003A (ja) | 近似計算装置、近似計算方法及びプログラム | |

| WO2025007017A1 (en) | Auxiliary neural network for fast adaptation of pre-trained neural networks |