JP7584576B2 - Live communication system using characters - Google Patents

Live communication system using characters Download PDFInfo

- Publication number

- JP7584576B2 JP7584576B2 JP2023100943A JP2023100943A JP7584576B2 JP 7584576 B2 JP7584576 B2 JP 7584576B2 JP 2023100943 A JP2023100943 A JP 2023100943A JP 2023100943 A JP2023100943 A JP 2023100943A JP 7584576 B2 JP7584576 B2 JP 7584576B2

- Authority

- JP

- Japan

- Prior art keywords

- input

- character

- distributor

- viewer

- viewing device

- Prior art date

- Legal status (The legal status is an assumption and is not a legal conclusion. Google has not performed a legal analysis and makes no representation as to the accuracy of the status listed.)

- Active

Links

Images

Landscapes

- Two-Way Televisions, Distribution Of Moving Picture Or The Like (AREA)

- Management, Administration, Business Operations System, And Electronic Commerce (AREA)

- Information Transfer Between Computers (AREA)

- User Interface Of Digital Computer (AREA)

Description

特許法第30条第2項適用 (1)平成30年9月18日にApple Inc.のTestFlight(https://developer.apple.com/jp/testflight/)を介して発表。 (2)平成30年10月4日にhttps://iriam.com/およびhttps://twitter.com/iriam_officialにて発表。 (3)平成30年10月4日にhttps://itunes.apple.com/jp/app/iriam-%E3%82%A4%E3%83%AA%E3%82%A2%E3%83%A0/id1358057296?mt=8にて発表。 (4)平成30年10月4日にhttps://play.google.com/store/apps/details?id=jp.co.duo7.vr.iriamにて発表。 (5)平成31年4月27日および平成31年4月28日に、ニコニコ超会議2019にて発表。 (6)平成31年4月27日および平成31年4月28日に、ニコニコ生放送(https://live.nicovideo.jp/gate/lv319512297およびhttps://live.nicovideo.jp/gate/lv319512342)にて発表。Application of Article 30, Paragraph 2 of the Patent Act (1) Announced on September 18, 2018 via Apple Inc.'s TestFlight (https://developer.apple.com/jp/testflight/). (2) Announced on October 4, 2018 at https://iriam.com/ and https://twitter.com/iriam_official. (3) Announced on October 4, 2018 at https://itunes.apple. com/jp/app/iriam-%E3%82%A4%E3%83%AA%E3%82%A2%E3%83%A0/id1358057296? mt=8. (4) Announced on October 4, 2018 at https://play.google.com/store/apps/details? id=jp.co.duo7.vr.iriam. (5) Announced at Niconico Chokaigi 2019 on April 27, 2019 and April 28, 2019. (6) The results will be announced on Niconico Live Broadcast (https://live.nicovideo.jp/gate/lv319512297 and https://live.nicovideo.jp/gate/lv319512342) on April 27, 2019 and April 28, 2019.

本発明は、通信ネットワークを介した視覚的なコミュニケーション技術、に関する。 The present invention relates to visual communication technology via a communication network.

スマートフォンの普及にともない、SNS(Social Networking Service)を介したコミュニケーションが一般化している。SNSでは、テキストだけでなく写真や動画像などさまざまなコンテンツを気軽に共有できる。SNSは、人と人との「絆(つながり)」を強く感じさせるツールである。 With the spread of smartphones, communication via SNS (Social Networking Services) has become common. SNS allows you to easily share a variety of content, including not only text but also photos and videos. SNS is a tool that gives you a strong sense of the "bonds" (connections) between people.

一方、コンピュータゲームの分野においては、ユーザがキャラクタ(コンピュータ)と会話をしながらプレイするゲームも多い。ユーザは、現実には存在しないキャラクタに対して強い思い入れをもつことが多い。 On the other hand, in the field of computer games, there are many games in which the user plays while having a conversation with a character (computer). Users often form strong feelings for characters that do not exist in reality.

キャラクタは、ゲームデザイナーによってつくられた仮想的存在であり、人間のような実在感をもたない。その一方、キャラクタは、非実在感に起因する独特の魅力をもつ。本発明者らは、キャラクタ特有の魅力と人間特有の「リアルなつながり」の双方を取り込むことにより、新しいコミュニケーション方法を提案できるのではないかと考えた。 Characters are virtual entities created by game designers and do not have the same sense of reality as humans. However, characters have a unique charm that stems from their sense of unreality. The inventors thought that by incorporating both the unique charm of characters and the "realistic connection" that is unique to humans, they might be able to propose a new method of communication.

具体的には、配信者(人間)と視聴者(人間)の会話を想定する。配信者は、ちょうどテレビアニメの声優のようにキャラクタの代弁者となり、キャラクタを通して視聴者と会話する。このようなコミュニケーションを想定した場合、視聴者はキャラクタと言葉以上の関わりをもつことができれば、視聴者のキャラクタに対する思い入れをいっそう強めることができると考えられる。 Specifically, we consider a conversation between a streamer (human) and a viewer (human). The streamer acts as a spokesperson for the character, just like a voice actor in a television anime, and converses with the viewer through the character. If we consider this type of communication, we believe that if the viewer can have a relationship with the character that goes beyond words, this will further strengthen the viewer's attachment to the character.

本発明は、上記認識に基づいて完成された発明であり、その主たる目的は、キャラクタを介したコミュニケーションにおいて、特に、キャラクタと視聴者の非言語コミュニケーションを深化させるための技術、を提供することにある。 The present invention was completed based on the above recognition, and its main purpose is to provide technology for deepening non-verbal communication between characters and viewers in communication via characters.

本発明のある態様におけるライブ通信システムは、配信者により操作される配信装置と視聴者により操作される視聴装置を含む。

配信装置は、配信者を撮像する撮像部と、配信者の撮像画像から、配信者の動作の特徴を示す動作情報を生成する動作情報生成部と、配信者の手の位置に対応する第1手座標を検出する第1手検出部と、配信者から第1メッセージを受け付ける第1メッセージ取得部と、動作情報、第1手座標および第1メッセージを送信する送信部と、を備える。

視聴装置は、動作情報、第1手座標および第1メッセージを受信する受信部と、視聴者の手の位置に対応する第2手座標を検出する第2手検出部と、視聴装置の画面にキャラクタを動画表示させ、動作情報に応じてキャラクタを動作させる視聴キャラクタ表示部と、キャラクタの動作に合わせて第1メッセージを出力する第1メッセージ出力部と、第1手座標および第2手座標に基づいて、配信者の手画像である第1手および視聴者の手画像である第2手を視聴装置の画面に表示させる手表示部と、を備える。

手表示部は、第1手座標と第2手座標の距離が第1の閾値以内であるとき、第1手と第2手の握手を表示させる。

A live communication system according to an embodiment of the present invention includes a distribution device operated by a distributor and a viewing device operated by a viewer.

The distribution device includes an imaging unit that images the broadcaster, a motion information generation unit that generates motion information indicating characteristics of the broadcaster's motion from the captured image of the broadcaster, a first hand detection unit that detects first hand coordinates corresponding to the position of the broadcaster's hand, a first message acquisition unit that accepts a first message from the broadcaster, and a transmission unit that transmits the motion information, the first hand coordinates, and the first message.

The viewing device includes a receiving unit that receives movement information, a first hand coordinate, and a first message, a second hand detection unit that detects a second hand coordinate corresponding to the position of the viewer's hand, a viewing character display unit that displays a moving image of a character on the screen of the viewing device and moves the character according to the movement information, a first message output unit that outputs a first message in accordance with the character's movement, and a hand display unit that displays a first hand, which is an image of the distributor's hand, and a second hand, which is an image of the viewer's hand, on the screen of the viewing device based on the first hand coordinate and the second hand coordinate.

The hand display unit displays a handshake between the first hand and the second hand when the distance between the first hand coordinates and the second hand coordinates is within a first threshold value.

本発明によれば、キャラクタを介した豊かなコミュニケーションを実現しやすくなる。 The present invention makes it easier to realize rich communication through characters.

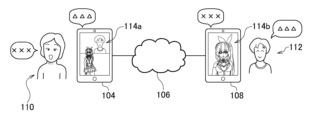

図1は、ライブ通信システム100のハードウェア構成図である。

ライブ通信システム100においては、サーバ102に対して、複数の配信装置104a、104b・・・104m(以下、まとめて言うときや特に区別しないときには「配信装置104」と総称する)および複数の視聴装置108a、108b・・・108n(以下、まとめて言うときや特に区別しないときには「視聴装置108」と総称する)がインターネット106を介して接続される。配信装置104としては、スマートフォンを想定しているが、ラップトップPCなどの汎用コンピュータであってもよい。視聴装置108としては大型のタッチパッドを想定しているが、スマートフォンなどの他の情報機器であってもよい。

FIG. 1 is a diagram showing the hardware configuration of a

In the

配信装置104を使用するユーザを「配信者」とよぶ。視聴装置108を使用するユーザを「視聴者」とよぶ。配信者がサービスの提供者となり、視聴者がサービスの享受者となる。

A user who uses the

サーバ102には、デジタルサイネージ装置300が接続される。デジタルサイネージ装置300は配信者と視聴者の会話をライブ中継または録画再生する。詳細については図16以降に関連して後述する。ライブ通信システム100にとってデジタルサイネージ装置300は必須構成ではない。

A

図2は、ライブ通信システム100による会話サービスを説明するための模式図である。

本出願人による特許文献2に開示したライブ通信システム100においては、1つの配信装置104に対して多数の視聴装置108が同時接続し、1対多通信を前提として説明した。本実施形態にけるライブ通信システム100は、配信者110と視聴者112が1対1通信にて会話するものとして説明する。

FIG. 2 is a schematic diagram for explaining a conversation service provided by the

The

配信者110にはあらかじめキャラクタが対応づけられる。配信装置104には配信者110に対応づけられる配信キャラクタ114aが表示される。視聴装置108にも視聴キャラクタ114bが表示される。配信キャラクタ114aと視聴キャラクタ114bはまったく同じキャラクタである。以下、配信キャラクタ114aと視聴キャラクタ114bを特に区別しないときには単に「キャラクタ114」とよぶ。

A character is assigned to the

配信者110が配信装置104の前でしゃべると、その音声データは視聴装置108に送信される。配信装置104は配信者110の口の動きを検出し、配信キャラクタ114aの口も動かす。また、これに連動して、視聴装置108は視聴キャラクタ114bの口も動かす。視聴者112には、配信者ではなく、あたかも視聴キャラクタ114bが自らの意思でしゃべっているように見える。いわば、配信者110は「声優」としてキャラクタ114の代弁者となる。以下、配信者110により入力される音声メッセージを「第1メッセージ」とよぶ。

When the

視聴者112が視聴装置108の前でしゃべると、その音声データは視聴者112本人の撮像画像(動画像)とともに配信装置104に送信される。以下、視聴者112により入力される音声メッセージを「第2メッセージ」とよぶ。特許文献2においては、視聴者112はテキストにより第2メッセージを入力するとして説明したが、本実施形態においては配信者110および視聴者112はお互いに音声にて会話をする。配信者110は視聴者112の容姿を見ることができるが(図7に関連して後述)、視聴者112は配信者110が演じる視聴キャラクタ114bだけを視認する。

When the

キャラクタ114の基本設定(キャラクタ114の容姿や表情変化の豊かさなど)と配信者110の声質や会話力によって、キャラクタ114の個性がかたちづくられる。

The personality of the

視聴者112は、普段はスマートフォンなどでキャラクタ114と1対多の会話を楽しみながら、キャラクタ114に対する思い入れを深めていく(特許文献2参照)。本実施形態においては、思い入れを深めたキャラクタ114との「握手会(1対1で会える機会)」を想定する。視聴者112は、ライブ通信システム100の運営者がセッティングする会場(以下、「イベント会場」とよぶ)に来場する。イベント会場では、視聴者112はキャラクタ114と1対1の音声会話を楽しむことができる。ただし、会話の「制限時間」は1分間に設定される。会話においては、後述の方法により会話だけでなく握手も楽しむことができる。

The

図3は、会話ブース302の外観図である。

イベント会場には、キャラクタ114ごとに会話ブース302が用意される。視聴者112は、お気に入りのキャラクタ114に対応する会話ブース302に並ぶ。視聴者112はネームプレートをつけておく。視聴者112は順番が来たら会話ブース302に入る。会話ブース302は、衝立により仕切られた半閉鎖空間であり、視聴者112がキャラクタ114との会話に集中しやすい構成となっている。会話ブース302の正面には視聴装置108が設置され、視聴装置108に視聴キャラクタ114bが表示される。会話ブース302においては、視聴者112は、普段は他の視聴者112たちとともに多人数で会話をしているアイドルのようなキャラクタ114との会話時間を独占できる。

FIG. 3 is an external view of

At the event venue, a

視聴装置108の上部には視聴者112を撮像するためのカメラ304が取り付けられる。視聴者112の撮像画像は配信装置104に転送される。視聴装置108の下部にはプレゼントボックス306が設置される。視聴者112は、帽子や花束などのプレゼント(以下、「グッズ」とよぶ)をプレゼントボックス306の投入口308に投入できる。グッズ(物理的なオブジェクト)にはタグが設置されており、投入口308の内部にある検出装置310によってグッズのID(以下、「グッズID」とよぶ)が検出される。グッズの投入に関しては図14,図15に関連して後述する。

A

図4は、配信装置104およびサーバ102の機能ブロック図である。

配信装置104およびサーバ102の各構成要素は、CPU(Central Processing Unit)および各種コプロセッサなどの演算器、メモリやストレージといった記憶装置、それらを連結する有線または無線の通信線を含むハードウェアと、記憶装置に格納され、演算器に処理命令を供給するソフトウェアによって実現される。コンピュータプログラムは、デバイスドライバ、オペレーティングシステム、それらの上位層に位置する各種アプリケーションプログラム、また、これらのプログラムに共通機能を提供するライブラリによって構成されてもよい。以下に説明する各ブロックは、ハードウェア単位の構成ではなく、機能単位のブロックを示している。

視聴装置108およびデジタルサイネージ装置300についても同様である。

FIG. 4 is a functional block diagram of the

Each component of the

The same applies to the

(配信装置104)

配信装置104は、ユーザインタフェース処理部116、撮像部118、データ処理部120、通信部122およびデータ格納部124を含む。

通信部122は、通信処理を担当する。撮像部118は、配信者110を撮像する。ユーザインタフェース処理部116は、配信者110からの操作を受け付けるほか、画像表示や音声出力など、ユーザインタフェースに関する処理を担当する。データ格納部124はキャラクタ114の画像データを含む各種データを格納する。データ処理部120は、通信部122、ユーザインタフェース処理部116、撮像部118により取得されたデータおよびデータ格納部124に格納されているデータに基づいて各種処理を実行する。データ処理部120は、ユーザインタフェース処理部116、撮像部118、通信部122およびデータ格納部124のインタフェースとしても機能する。

(Distribution device 104)

The

The

通信部122は、送信部148と受信部150を含む。

The

ユーザインタフェース処理部116は、配信者110からの入力を受け付ける入力部126と配信者110に各種情報を出力する出力部128を含む。

入力部126は、動作検出部130と第1メッセージ取得部132を含む。動作検出部130は、撮像部118を介して配信者110の表情や体の動きを検出する。第1メッセージ取得部132は、配信者110の発話から第1メッセージ(音声メッセージ)を取得する。

動作検出部130は、第1手検出部134を含む。第1手検出部134は、配信者110の手の動きを検出する。

The user

The

The

出力部128は、配信キャラクタ表示部138、第2メッセージ出力部140、手表示部142、装飾部312、オブジェクト表示部314およびライブ画像出力部332を含む。

配信キャラクタ表示部138は、配信キャラクタ114aを表示させる。第2メッセージ出力部140は視聴者112による第2メッセージ(音声メッセージ)を出力する。手表示部142は、キャラクタ114(配信者110)および視聴者112の手を模した画像(後述)を画面表示させる。装飾部312は、キャラクタ114と視聴者112が握手をしたときなどの所定の機会において視覚的効果として各種装飾画像を表示させる。握手と装飾画像については図9、図10、図11、図13等に関連して後述する。オブジェクト表示部314は、視聴者112からプレゼントされたグッズに対応する画像(以下、「グッズ画像」とよぶ)を画面表示させる。グッズ画像(仮想オブジェクト)の画面表示については図15に関連して後述する。ライブ画像出力部332は視聴者112の撮像画像を動画表示させる(図7に関連して後述する)。

The

The delivery

データ処理部120は、動作情報生成部144を含む。

動作情報生成部144は、動作検出部130の検出結果から「動作情報」を生成する。動作情報とは、配信者110の表情を示す特徴ベクトル(例:眉の角度、目や口の開度を示す数値、配信者110と配信装置104との相対的な位置関係(前後左右)を示す数値など、配信者110の動作状態を示す数値データである。

The

The motion

(サーバ102)

サーバ102は、通信部152、ライブ制御部154およびデータ格納部156を含む。

通信部152は、通信処理を担当する。データ格納部156は各種データを格納する。ライブ制御部154は、通信部152により取得されたデータおよびデータ格納部156に格納されているデータに基づいて配信装置104と視聴装置108のコミュニケーションを仲介・統括する。ライブ制御部154は、通信部152およびデータ格納部156のインタフェースとしても機能する。

データ格納部156は、複数のキャラクタ114のデータを格納するキャラクタ格納部158を含む。また、データ格納部156は、グッズIDとグッズ画像を対応づけて登録する。

(Server 102)

The

The

The

図5は、視聴装置108の機能ブロック図である。

視聴装置108は、ユーザインタフェース処理部162、データ処理部166、通信部164、撮像部316およびデータ格納部168を含む。

通信部164は、通信処理を担当する。ユーザインタフェース処理部162は、視聴者112からの操作を受け付けるほか、画像表示や音声出力など、ユーザインタフェースに関する処理を担当する。撮像部316は、カメラ304を介して視聴者112を撮像する。データ格納部168はキャラクタ114の画像データを含む各種データを格納する。配信装置104と視聴装置108はどちらもキャラクタ114のデータをそれぞれ格納する。データ処理部166は、通信部164およびユーザインタフェース処理部162により取得されたデータおよびデータ格納部168に格納されているデータに基づいて各種処理を実行する。データ処理部166は、ユーザインタフェース処理部162、通信部164、撮像部316およびデータ格納部168のインタフェースとしても機能する。

FIG. 5 is a functional block diagram of the

The

The

通信部122は、送信部186と受信部190を含む。

The

ユーザインタフェース処理部162は、視聴者112からの入力を受け付ける入力部170と視聴者112に各種情報を出力する出力部172を含む。

入力部170は、第2メッセージ取得部174、第2手検出部318、オブジェクト投入部320およびオブジェクト特定部322を含む。第2メッセージ取得部174は、視聴者112の発話から第2メッセージ(音声メッセージ)を取得する。第2手検出部318は、視聴者112の手の動きを検出する。オブジェクト投入部320は、投入口308へのグッズ(物理オブジェクト)の投入を検出する。オブジェクト特定部322は、投入口308に投入されたグッズのグッズIDを読み取ることにより、グッズの種類を特定する。グッズIDが特定されたとき、通信部164の送信部186はグッズIDをサーバ102に送信する。

The user

The

出力部172は、視聴キャラクタ表示部180、第1メッセージ出力部182、手表示部324、装飾部326、オブジェクト表示部328および幕表示部330を含む。

視聴キャラクタ表示部180は、視聴装置108に視聴キャラクタ114bを表示させる。第1メッセージ出力部182は配信者110による第1メッセージを視聴装置108から音声出力する。手表示部324は、キャラクタ114(配信者110)および視聴者112の手の画像を画面表示させる。装飾部326は、各種装飾画像を表示させる。オブジェクト表示部328は、視聴者112がプレゼントしたグッズに対応するグッズ画像を画面表示させる。幕表示部330は会話の開始時と終了時に幕を模した画像を表示させる。幕については図12に関連して後述する。

The

The viewing

データ処理部166は、会話管理部290を含む。会話管理部290は、視聴者112とキャラクタ114の会話時間を管理する。会話管理部290は、所定の制限時間、たとえば、1分間が経過したとき視聴者112とキャラクタ114の会話を終了させる。

The

図6は、視聴装置108に表示される視聴者会話画面196の画面図である。

視聴キャラクタ表示部180は、おしゃべりの相手として選ばれた視聴キャラクタ114bを動画表示させる。視聴者112は、視聴装置108において視聴キャラクタ114bとの会話を楽しむ。視聴者112からは配信者110の姿が見えることはない。視聴者112は、配信者110ではなく、視聴キャラクタ114bそのものと会話しているかのような感覚を楽しむことができる。視聴装置108の第1メッセージ出力部182は、視聴キャラクタ114bを担当する配信者110からの音声(第1メッセージ)を出力する。視聴者112は、視聴キャラクタ114bに音声で話しかける(第2メッセージ)。サーバ102のライブ制御部154は、第1メッセージおよび第2メッセージを中継する。

FIG. 6 is a diagram showing a

The viewing

図7は、配信装置104に表示される配信者会話画面206の画面図である。

図7に示す配信者会話画面206は、配信キャラクタ114a(視聴キャラクタ114bに対応)を担当する配信者110の配信装置104に表示される。配信者会話画面206は、視聴者表示領域336とキャラクタ表示領域334に上下分割される。配信キャラクタ表示部138は、配信キャラクタ114aをキャラクタ表示領域334に動画表示させる。視聴キャラクタ114bと配信キャラクタ114aは同一キャラクタであり、動きも同じである。配信者110は、自らの分身である配信キャラクタ114aの動きを配信装置104にて確認しながら視聴者112と会話する。配信者110は、配信装置104に向かって音声にて第1メッセージを入力する。送信部148は第1メッセージをサーバ102に送信し、サーバ102のライブ制御部154は第1メッセージを視聴装置108に配信する。

FIG. 7 is a diagram showing the

The

第2メッセージ出力部140は、視聴者112からの音声(第2メッセージ)を出力する。視聴者112の撮像画像は視聴装置108からサーバ102を介して配信装置104に送信される。ライブ画像出力部332は視聴者112の撮像画像(動画像)を視聴者表示領域336に表示させる。配信者110は視聴者112の様子(態度や表情)を見ながら、視聴者112と会話できる。

The second

配信装置104のカメラ208(撮像部118)は、配信者110を撮像する。動作検出部130は、撮像画像から配信者110の表情および動作を検出し、動作情報生成部144は動作情報を生成する。配信キャラクタ表示部138は、動作情報に基づいて配信キャラクタ114aの動きを決定する。視聴キャラクタ114bも同じ動作情報に基づいて視聴装置108にて動画表示される。

The camera 208 (imaging unit 118) of the

以上のように、視聴者112は視聴キャラクタ114bと音声にて会話する。配信者110は視聴キャラクタ114bとして視聴者112と会話する。視聴者112は配信者110の姿を見ることはできないが、配信者110は視聴者112と配信キャラクタ114a双方の姿を見ながら会話する。

As described above, the

図8は、配信装置104および視聴装置108の双方においてキャラクタ114を表示させる処理のシーケンス図である。

配信装置104の動作検出部130は、配信者110の動作を検出する(S10)。動作情報生成部144は、動作情報を生成する(S12)。動作情報は、配信者110の表情、体の角度、配信者110の撮像部118からの遠近などを示す数値データである(S12)。

FIG. 8 is a sequence diagram of a process for displaying the

The

配信装置104の送信部148は、サーバ102経由にて、視聴装置108に動作情報を送信する(S14)。配信キャラクタ表示部138は、動作情報に基づいて配信キャラクタ114aの動画像を生成し(S16)、配信装置104に配信キャラクタ114aを動画表示させる(S18)。

The

一方、視聴装置108の視聴キャラクタ表示部180も、受信された動作情報に基づいて視聴キャラクタ114bの動画像を生成し(S20)、視聴装置108に視聴キャラクタ114bを動画表示させる(S22)。

Meanwhile, the viewing

配信キャラクタ114aと視聴キャラクタ114bは、同一のキャラクタであり、かつ、同一の動作情報に基づいて動きが決まるため、配信装置104および視聴装置108それぞれにおいて配信キャラクタ114aと視聴キャラクタ114bは同じ姿にて同じ動作を行う。

The distributed

配信装置104は、キャラクタ114の動画像(キャラクタ画像)そのものを視聴装置108に送信しているのではなく、キャラクタ114の動作を定義する動作情報のみを送信している。動画像そのものを送信するよりも送信データ量が少ないため、配信キャラクタ114aと視聴キャラクタ114bそれぞれの動きを速やかに連動させやすい。いいかえれば、動作情報が配信キャラクタ114aの動きとして反映されるまでの時間と、同じ動作情報が視聴キャラクタ114bの動きとして反映されるまでの時間の差分が小さいため、視聴者112はキャラクタ114(配信者110)との快適な会話を楽しむことができる。

The

第1メッセージ(音声メッセージ)と動作情報は一体化して配信装置104から視聴装置108に送信されてもよい。この場合には、視聴キャラクタ114bの動作と音声メッセージがずれにくくなる。また、動画像そのものではなく、動画像を決定するための動作情報を送信することは、インターネット106に対する通信負荷を抑制する上でも有効である。

The first message (audio message) and the action information may be transmitted from the

配信者110が体を左右に傾けると、動作検出部130は体の傾斜を検出する。動作情報生成部144は、傾斜角および傾斜方向を動作情報に含める。視聴キャラクタ表示部180は、動作情報にしたがって、視聴キャラクタ114bを傾斜させる。配信キャラクタ表示部138も、同じ動作情報にしたがって配信キャラクタ114aを傾斜させる。このように、配信者110が体を左右に傾けると、配信側と視聴側双方のキャラクタ114は配信者110に合わせて体を傾ける。配信者110が体を前後に傾けたときにも、キャラクタ114は同様にして体を前後させる。動作検出部130は、配信者110の前傾後傾を撮像画像に映る配信者110の大きさから認識すればよい。

When the

一般的には、体の傾斜に人間の心理が現れるといわれる。たとえば、会話に興味をもっているときに人間は前傾姿勢(聞こうという体勢)になりやすく、動揺しているときには体は左右に揺れるともいわれる。配信者110の体の動きをキャラクタ114にも反映させることにより、視聴者112はキャラクタ114(配信者110)の心理を感じ取ることができる。

It is generally said that a person's psychology is reflected in the way their body tilts. For example, it is said that when a person is interested in a conversation, they tend to lean forward (as if they are about to listen), and when they are upset, their body sways from side to side. By reflecting the body movements of the

配信者110が表情を変化させるとき、動作検出部130は配信者110の表情、具体的には、目の大きさ、口の形、眉毛の角度、眉間のシワの深さや方向などを検出する。動作情報生成部144は、これらの検出値に基づいて表情を定義する特徴ベクトルを生成する。特徴ベクトルは動作情報の一部となる。配信者110が片目をつぶったとき(ウィンク)、視聴キャラクタ表示部180は視聴キャラクタ114bをウィンクさせる。配信キャラクタ114aについても同様である。

When the

このほかにも、舌を出す、口角を上げるなど、さまざまな表情を特徴ベクトル(動作情報)で数値表現することにより、配信者110の表情もキャラクタ114に反映させることができる。配信者110が微笑むときにはキャラクタ114も微笑む。配信者110が口をすぼめるとキャラクタ114も口をすぼめる。配信者110の表情とキャラクタ114の表情を連動させることにより、視聴者112はキャラクタ114の存在をいっそう身近に感じることができる。

In addition, by numerically expressing various facial expressions, such as sticking out the tongue or turning up the corners of the mouth, using feature vectors (motion information), the facial expression of the

図9は、視聴者112がキャラクタ114と握手する前の視聴装置108の画面図である。

視聴者112が視聴装置108の画面(以下、単に「視聴画面」とよぶ)にタッチしたとき、視聴装置108の第2手検出部318はタッチ地点の座標(以下、「第2手座標346」とよぶ)を検出する。配信者110が配信装置104の画面(以下、単に「配信画面」とよぶ)にタッチしたとき、配信装置104の第1手検出部134はタッチ地点の座標(以下、「第1手座標340」とよぶ)を検出する。視聴装置108は第2手座標346を配信装置104に送信し、配信装置104は第1手座標340を視聴装置108に送信する。視聴画面と配信画面には同一の座標系が設定されているものとする。たとえば、配信画面における第1手座標340が(x1,y1)のときには、視聴画面における第1手座標340も(x1,y1)となる。第2手座標346についても同様である。

FIG. 9 is a diagram showing the screen of the

When the

視聴装置108の手表示部324は、第1手座標340に第1手342を表示させる。第1手342は視聴キャラクタ114b(配信者110)の手を模した画像である。図9においては、視聴キャラクタ114bの画像とは別に第1手342を表示しているが、視聴キャラクタ114b本人の手を第1手座標340の位置に動かしてもよい。手表示部324は、また、視聴者112がタッチした地点である第2手座標346に第2手344を表示させる。第2手344は視聴者112の手を模した画像である。

配信装置104の手表示部142も、配信画面に第1手342と第2手344を表示させる。

The

The

配信者110と視聴者112の双方がそれぞれ配信画面と視聴画面にタッチしているとき「握手可能状態」となる。一方、いずれか一方が画面から手を離すと「握手不能状態」となる。握手可能状態にあるとき、手表示部142は、第1手座標340と第2手座標346の距離(以下、「手距離d」とよぶ)を定期的に計算する。配信装置104の手表示部142も同様である。

When both the

図10は、視聴者112がキャラクタ114と握手したときの視聴装置108の画面図である。

握手可能状態にあるときであって、手距離dが第1閾値以内となったとき、手表示部324は第2手344と第1手342が握手する画像である握手画像338を表示させる。すなわち、配信者110と視聴者112がタッチ状態のまま互いの指(タッチ地点)を近づけることで「握手」が成立する。装飾部326は、握手が成立したとき、第1手342および第2手344の周辺に星型の装飾画像360を表示させる。装飾画像360は、握手の達成を演出する。

FIG. 10 is a diagram showing the screen of the

When the handshake is possible and the hand distance d is within the first threshold, the

このように、配信者110と視聴者112がそれぞれのタッチ地点を近づけることにより、視聴キャラクタ114b(二次元)と視聴者112(三次元)の「次元」を超えた握手が可能となる。会話だけではなく、キャラクタ114の手を握った、キャラクタ114が手を握ってくれたという感覚を視聴者112にもたせることにより、視聴者112とキャラクタ114の出会いをいっそう盛り上げることができる。

配信装置104においても同様の処理方法により、握手画像338が表示される。

In this way, by bringing the

A

図11は、握手の動きを説明するための模式図である。

時刻t1における第1手座標340を「第1手座標340(t1)」のように表記する。時刻t1においては、第1手座標340(t1)と第2手座標346(t1)の握手が成立しているものとする。また、第1手座標340(t1)と第2手座標346(t1)の手距離d(t1)は第2閾値以内であるとする。握手成立後も、手距離dが第2閾値以内である限り握手は継続する。

FIG. 11 is a schematic diagram for explaining the handshake movement.

The first hand coordinate 340 at time t1 is expressed as "first hand coordinate 340 (t1)". At time t1, a handshake between the first hand coordinate 340 (t1) and the second hand coordinate 346 (t1) is established. Also, the hand distance d (t1) between the first hand coordinate 340 (t1) and the second hand coordinate 346 (t1) is assumed to be within a second threshold. Even after the handshake is established, the handshake continues as long as the hand distance d is within the second threshold.

手表示部142は、第1手座標340(t1)と第2手座標346(t1)の中間点である握手点348(t1)に握手画像338(第1手342と第2手344)を表示させる。第1手座標340と第2手座標346が十分に近づけば、第2手座標346と第1手座標340が完全一致しなくても第1手342と第2手344の握手は成立する。

The

次に、時刻t2において第1手座標340と第2手座標346はそれぞれ変位したとする。時刻t2における手距離d(t2)も第2閾値以内であるとする。握手は維持され、握手点348は変位する。握手画像338は握手点348(t1)から握手点348(t2)に移動するため、握手の「動き」が表現される。握手画像338が所定距離以上移動したとき、あるいは、握手画像338が所定速度以上で移動したとき、装飾部326は装飾画像360を追加する。このような制御方法によれば、キャラクタ114(配信者110)と視聴者112が息を合わせて第1手342と第2手344をいっしょに動かすことで、いいかえれば、第1手座標340と第2手座標346の手距離dが第2閾値よりも大きくならないようにお互いの手をタイミングよく動かすことで握手を続けることができる。また、握手を続けるほど多数の装飾画像360を出現させることにより、握手の場面を盛り上げることができる。

Next, the first hand coordinate 340 and the second hand coordinate 346 are each displaced at time t2. The hand distance d (t2) at time t2 is also within the second threshold. The handshake is maintained, and the

第1閾値と第2閾値は同一でもよいが、上述したように第1閾値よりも第2閾値を大きく設定してもよい。この場合には、第1手座標340と第2手座標346を十分に近づけなければ握手できないが、いったん握手できればほどけにくいという操作感を実現できる。このような設定によれば、視聴者112はキャラクタ114との握手を継続しやすくなる。

The first and second thresholds may be the same, or, as described above, the second threshold may be set to be greater than the first threshold. In this case, it is possible to realize a feeling of operation in which, although a handshake is not possible unless the first hand coordinate 340 and the second hand coordinate 346 are brought close enough, once a handshake is made, it is difficult to come undone. With such a setting, it becomes easier for the

なお、配信装置104においても同様の表示がなされるため、配信者110も視聴者112と握手する感覚を共有する。特に、配信者110は視聴者表示領域336において視聴者112の姿や表情を視認できるため、視聴者112がキャラクタ114と握手をしているときの楽しさや嬉しさを感じとることができる。

In addition, since the same display is also made on the

図12は、キャラクタ114との会話開始時における視聴装置108の画面図である。

視聴者112は、会話ブース302に入るとき、視聴装置108の幕表示部330は視聴画面に幕350を表示させる。幕350により視聴キャラクタ114bは当初は遮蔽されている。視聴者がキャラクタ114を呼びかける、会話ブース302への入室を人感センサで検出する、あるいは、配信者110からの開幕指示入力がなされる、などを契機として、幕表示部330は幕350が開く動画像を表示させる。幕350の後ろにキャラクタ114が表示される。幕350が開いてお目当てのキャラクタ114が現れる演出により、視聴者112とキャラクタ114の対面を演出する。

FIG. 12 is a diagram showing the screen of the

When the

幕表示部330は所定の開幕時間をかけて幕350を開ける演出を実行する。本実施形態における開幕時間は3秒間である。幕350の開幕あるいは閉幕に際しては、視聴装置108の出力部172は所定のオープニング音楽を流してもよい。

The

開幕後、会話管理部290は会話時間を計測する。制限時間(例:1分間)が経過したとき、会話管理部290は幕表示部330に指示して幕350を閉じさせる。幕表示部330は幕350が閉じていく動画像を表示させることでキャラクタ114を徐々に遮蔽する。幕表示部330は所定の閉幕時間をかけて幕350を閉じる演出を実行する。本実施形態における閉幕時間は10秒間であるとする。

After the opening, the

開幕時間よりも閉幕時間を長くすることで、視聴者112に「名残惜しい気持ち」をいだかせることができる。ゆっくりと閉幕させてキャラクタ114を少しずつ隠していくことにより、キャラクタ114との別れを惜しむ時間を演出し、キャラクタ114に再会したいという気持ちを視聴者112に喚起させることができる。幕350が完全に閉じるとキャラクタ114が隠され、会話時間は終了する。会話時間が終了すると、配信者110は視聴装置108から出て、次の配信者110が会話ブース302に入室する。

なお、配信装置104にも幕表示部を設け、配信画面においても同様の制御方法により幕350を表示してもよい。

Making the closing time longer than the opening time can make the

It should be noted that

図13は、視聴者112がキャラクタ114にタッチしたときの視聴装置108の画面図である。

視聴者112は、握手に限らず、視聴キャラクタ114bにタッチすることもできる。視聴者112は、視聴キャラクタ114bの頭部にタッチし、頭部をこする操作をすることで、第2手344(視聴者112の手)で視聴キャラクタ114bを「撫でる」ことができる。より具体的には、第2手検出部318は、タッチに際して第2手座標346を検出し、第2手座標346の検出地点が視聴キャラクタ114bの頭部領域にあるかを判定する。頭部領域をタッチしたときであって、第2手座標346が往復運動をするとき、第2手検出部318は「撫でる」操作がなされていると判定する。

FIG. 13 is a diagram showing the screen of the

The

視聴キャラクタ114bを撫でるとき、装飾部326は、頭部付近にハート型の装飾画像360を表示させる。視聴キャラクタ114bを撫でれば撫でるほど、装飾部326は多くの装飾画像360を表示させる。視聴者112は、第2手344をつかって視聴キャラクタ114bを撫でることにより、キャラクタ114に対する親愛の情を行動表現できる。視聴キャラクタ表示部180は、視聴者112が視聴キャラクタ114bの頭部を撫でたとき、視聴キャラクタ114bの動作と表情を変化させる。たとえば、眼を閉じる、微笑む、くすぐったがる、肩をすくめるなどの動作や表情により、撫でる操作に対するキャラクタ114のリアクションを表現する。

When the viewed

このほかにも、視聴者112は視聴キャラクタ114bの頬にタッチしてスワイプすることにより、視聴キャラクタ114bの頬を引っ張るアクションを実行してもよい。また、眼や胸のように、視聴キャラクタ114bに触ってはいけない領域(以下、「不適切領域」とよぶ)を設定してもよい。視聴者112が第2手344により不適切領域をタッチしたときには、会話管理部290は会話の制限時間を短縮してもよいし、会話を打ち切って閉幕させてもよい。会話管理部290は不適切領域へのタッチが検出されるごとに会話時間を短縮するとしてもよい。装飾部326は、不適切領域へのタッチが検出されたときには警告を示す装飾画像360を表示させてもよい。このような制御方法によれば、視聴者112は視聴キャラクタ114bを無分別にタッチしなくなるため、視聴者112にキャラクタ114の人格を尊重する気持ちをもたせることができる。視聴者112がキャラクタ114を不快にさせないように関わろうとすることは、キャラクタ114の実在感をいっそう高めることに寄与する。

In addition, the

上述したように会話時間の終了時には幕350がゆっくりと閉幕する。視聴者112は幕350の向こうに消えていくキャラクタ114を幕350の隙間からタッチすることで名残惜しい気持ちを行動表現できる。

As mentioned above, when the conversation time ends, the

図14は、キャラクタ114にグッズをプレゼントしたときの処理過程を示すシーケンス図である。

視聴者112は、お気に入りのキャラクタ114のためにグッズをプレゼントすることもできる。イベント会場では、花束、帽子、リボン、お菓子などさまざまなグッズ(物理オブジェクト)が販売されている。これらのグッズは物理的実体であり、グッズIDを記録したタグが貼付されている。このタグはRFID(Radio Frequency IDentifier)タグでもよいし、QRコード(登録商標)を記録したシールであってもよい。

FIG. 14 is a sequence diagram showing the process when a gift is given to the

The

視聴者112は、購入したグッズをプレゼントボックス306に投入することで、キャラクタ114にグッズをプレゼントする。オブジェクト投入部320は、まず、検出装置310によりグッズの通過を検出する(S30)。オブジェクト特定部322はグッズIDを光学的に読み取る(S32)。視聴装置108の送信部186は、グッズIDをサーバ102に送信する(S34)。サーバ102の通信部152は、グッズ画像(仮想オブジェクト)のデータを配信装置104と視聴装置108に送信する(S36、S37)。

The

配信装置104のオブジェクト表示部314は、グッズ画像を配信画面に表示させる(S38)。同様にして、視聴装置108のオブジェクト表示部328は、グッズ画像を視聴画面に表示させる(S40)。サーバ102のライブ制御部154は、プレゼントされたグッズについて、グッズID、提供日時、提供した視聴者112のユーザIDと提供された配信者110(キャラクタ114)のキャラクタIDを対応づけて購入履歴として登録する(S42)。以上の処理過程により、視聴者112からキャラクタ114にグッズがプレゼントされる。

The

図15は、キャラクタ114にグッズを提供したときの視聴装置108の画面図である。

視聴者112は、帽子(物理的実体としてのグッズ)を購入し、これをキャラクタ114にプレゼントしたとする。このとき、オブジェクト表示部314は帽子画像212(仮想的実体としてのグッズ画像)を表示させる。図15においては、視聴キャラクタ114bはプレゼントされた帽子画像212をかぶっている。視聴者112は、自分がプレゼントした帽子をキャラクタ114が着用してくれれば、自分の真心がキャラクタ114に通じたかのような満足感を味わえる。3次元の帽子が2次元の帽子画像212に変換されるため、視聴者112はキャラクタ114との「次元を超えたつながり」をいっそう感じることができる。また、視聴者112は、グッズをプレゼントすることにより、お気に入りのキャラクタ114のファッションの変化を楽しむことができる。視聴者112は、同時に複数種類のグッズをキャラクタ114にプレゼントしてもよい。

FIG. 15 is a diagram showing the screen of the

It is assumed that the

グッズの購入金額の一部はキャラクタ114を演じる配信者110に配分される。また、実際に購入されたグッズは配信者110に与えられてもよい。視聴者112はグッズを購入することでキャラクタ114に対する愛情や応援する気持ちを表現できる。グッズ収入をインセンティブとすることにより、配信者110にも会話力向上など「愛されるための努力」を促すことができる。

A portion of the purchase price of the goods is allocated to the

図16は、デジタルサイネージ装置300の外観図である。

デジタルサイネージ装置300は、不特定多数の通行者を対象とした大型の広告表示装置である。本実施形態におけるデジタルサイネージ装置300は、駅や広場などに立てられる自立型の構造物であるとして説明する。

FIG. 16 is an external view of the

The

図1に関連して説明したように、デジタルサイネージ装置300はサーバ102と接続される。デジタルサイネージ装置300は、配信者110(キャラクタ114)と視聴者112の会話をライブ中継する。デジタルサイネージ装置300のには、視聴装置108と同様の表示形式にてキャラクタ114が表示される。画面下部には会話表示領域362が設けられ、第1メッセージ(配信者110の音声)と第2メッセージ(視聴者112の音声)はいずれもテキスト表示される。通行者は、デジタルサイネージ装置300を視認することにより、キャラクタ114(配信者110)と視聴者112の会話を楽しむことができる。デジタルサイネージ装置300で会話を公開することは、配信者110にとってもキャラクタ114の魅力を多くの人にアピールする機会となる。ただし、視聴者112とキャラクタ114の会話をデジタルサイネージ装置300にて公開する場合には、視聴者112の承諾を取ることが必須条件である。

As described in relation to FIG. 1, the

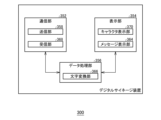

図17は、デジタルサイネージ装置300の機能ブロック図である。

デジタルサイネージ装置300は、通信部352、表示部354およびデータ処理部356を含む。

通信部352は、通信処理を担当する。表示部354は画像を表示する。データ処理部356は、通信部352により取得されたデータに基づいて各種処理を実行する。データ処理部356は、通信部352および表示部354のインタフェースとしても機能する。

FIG. 17 is a functional block diagram of the

The

The

通信部352は、送信部358と受信部368を含む。

The

データ処理部356は、文字変換部366を含む。サーバ102のライブ制御部154は第1メッセージと第2メッセージをデジタルサイネージ装置300にも送信する。文字変換部366は、第1メッセージおよび第2メッセージを音声から文字列(テキスト)に変換する。

The

表示部354は、キャラクタ表示部370とメッセージ表示部364を含む。キャラクタ表示部370は、サーバ102から動作情報を受信し、キャラクタ114を表示させる。メッセージ表示部364は文字変換された各種メッセージを会話表示領域362に表示させる。

The

<総括>

以上、実施形態に基づいて、ライブ通信システム100について説明した。

本実施形態によれば、会話ブース302において、視聴者112はキャラクタ114と1対1の会話を楽しめるだけでなく、「握手」を模した操作をできるため、視聴者112とキャラクタ114(配信者110)の親密度をいっそう高めることができる。配信者110と視聴者112が同時に画面にタッチし、かつ、二人が指を近づけることで握手が成立する。握手を成立させるためには視聴者112とキャラクタ114(配信者110)には暗黙の意思疎通が必要となる。握手が成立したときに配信者110はキャラクタ114と呼吸が合ったかのような、意思が疎通したかのような独特の感覚をもつことができる。

<Summary>

The

According to this embodiment, in the

また、握手が成立したとき、キャラクタ114(配信者110)と視聴者112はお互いの指が離れすぎないように動かすことで握手を揺らすことができる。握手を揺らすほど、多数の装飾画像360が表示される。視聴者112とキャラクタ114(配信者110)が息を合わせて握手を継続することで、視聴者112はキャラクタ114に対する親近感をいっそう高めることができる。

In addition, when a handshake is established, the character 114 (distributor 110) and

本実施形態においては、幕350によって会話の開始と終了を演出する。幕350が開いてキャラクタ114を登場させることにより、キャラクタ114と1対1で会話できる貴重な機会に対する視聴者112の期待感を効果的に高めることができる。また、会話終了時には幕350はゆっくりと閉まるので、キャラクタ114と別れることの名残惜しさを演出できる。視聴者112は、幕350によって隠されていくキャラクタ114に対して最後になにか伝えようという気持ちになりやすい。また、この名残惜しさがキャラクタ114との再会を望む気持ちを視聴者112に喚起させることができる。

In this embodiment, the

視聴者112は、キャラクタ114本人にタッチすることにより、握手以外のスキンシップを楽しむことができる。一方、視聴者112がキャラクタ114の不適切領域をタッチしたときには会話時間短縮などのペナルティが与えられる。配信者110は、以後、不適切行為をした視聴者112との握手を拒否することで「拒否感」を表現してもよい。このような制御方法によれば、相手の人格性を尊重したキャラクタ114との関わり方を視聴者112に促すことができる。

By touching the

デジタルサイネージ装置300において、キャラクタ114と視聴者112の会話をライブ中継または録画表示することにより、キャラクタ114とのライブ通信会話に興味を持たない、あるいは、ライブ通信会話を知らなかったユーザにも、ライブ通信システム100の魅力を広く伝えることができる。また、配信者110にとっても、キャラクタ114の容姿や会話力を広くアピールできる機会となるため、配信者110という仕事に対する誇りを高める上でもデジタルサイネージ装置300は有用と考えられる。

By broadcasting live or recording and displaying the conversation between the

視聴者112は、グッズを購入し、これをキャラクタ114にプレゼントできる。視聴装置108にはグッズ(三次元オブジェクト)に対応するグッズ画像(二次元オブジェクト)が表示される。このため、仮想の世界の住人であるキャラクタ114に対して、実在の世界のグッズをプレゼントすることで、視聴者112にはキャラクタ114に対する親愛の情を示す機会が提供される。

The

なお、本発明は上記実施形態や変形例に限定されるものではなく、要旨を逸脱しない範囲で構成要素を変形して具体化することができる。上記実施形態や変形例に開示されている複数の構成要素を適宜組み合わせることにより種々の発明を形成してもよい。また、上記実施形態や変形例に示される全構成要素からいくつかの構成要素を削除してもよい。 The present invention is not limited to the above-described embodiments and modifications, and can be embodied by modifying the components without departing from the spirit of the invention. Various inventions may be formed by appropriately combining multiple components disclosed in the above-described embodiments and modifications. In addition, some components may be deleted from all the components shown in the above-described embodiments and modifications.

[変形例]

<手あそび>

図18は、キャラクタ114との手遊びをするときの視聴装置108の画面図である。

本実施形態においては、配信者110と視聴者112はそれぞれ配信画面と視聴画面にタッチすることで第1手342と第2手344を表示させるとして説明した。変形例として、配信画面等へのタッチではなく、画像認識により配信者110と視聴者112の手の位置を検出してもよい。配信者110と視聴者112は、たとえば、白い手袋を嵌めてもよい。この場合には、第1手検出部134および第2手検出部318は、撮像画像から配信者110と視聴者112の手の位置をより確実に認識しやすくなる。

[Modification]

<Hand games>

FIG. 18 is a diagram showing the screen of the

In the present embodiment, the

第1手検出部134は配信者110の手を画像認識により検出し、手の検出位置に基づいて第1手座標340を特定する。撮像画像に映る物体の位置を画面に投影することで画面上の座標に変換する技術は既知技術の応用により可能である。同様にして、第2手検出部318は視聴者112の手の位置を画像認識により検出し、第2手座標346を特定する。

The first

第1手検出部134は、配信者110の手の位置だけでなく手の形状(手指の状態)を画像認識する。第2手検出部318も、視聴者112の手の形状を画像認識する。手表示部142等は、配信者110および視聴者112それぞれの手の形状に基づいて第1手342および第2手344の手の形状を変化させる。このような制御方法によれば、たとえば、視聴者112はキャラクタ114(配信者110)との「じゃんけん」のような手遊びを楽しむこともできる。

The first

視聴者112の顔の向きは配信者110から視認できる。配信者110の顔の向きはキャラクタ114の動作として反映される。手の形状だけでなく顔の向きも相互認識できれば「あっち向いてホイ」のような体をつかった遊びも可能である。手遊びの勝敗は配信者110と視聴者112が自主的に判断してもよいし、サーバ102に「勝敗判定部」を設けてもよい。勝敗判定部は、たとえば、じゃんけんの場合には配信者110の手の形状と視聴者112の手の形状それぞれから「グー」「チョキ」「パー」を認識し、キャラクタ114(配信者110)と視聴者112のどちらが勝ったかを判定する。

The face direction of the

また、勝敗に応じて、視聴者112にメリットまたはデメリットを与えてもよい。たとえば、手遊びに勝てば会話時間を延長してもよいし、視聴者112に頼まれたセリフをキャラクタ114(配信者110)が発話するとしてもよいし、キャラクタ114にキーホルダーなどのノベルティを与えるとしてもよい。

In addition, the

<キャラクタ114との撮影>

配信者110はキャラクタ114と記念撮影をしてもよい。視聴装置108の撮像部316は視聴者112を撮像する。視聴装置108のデータ処理部166は「画像生成部」を備えてもよい。画像生成部は、視聴者112の撮像画像とキャラクタ114を合成することで2ショットの記念写真を生成する。視聴装置108の送信部186は、記念写真を視聴者112の携帯端末に送信してもよい。

<Photo taken with

The

記念写真に限らず動画撮影によるショートムービーを作成してもよい。視聴者112は、記念撮影にあたってキャラクタ114にポーズを要求してもよいし、言ってほしいセリフを求めてもよい。キャラクタ114の動画像と視聴者112の撮像画像(動画像)を組み合わせて視聴者112とキャラクタ114が映るショートムービーを来場記念として視聴者112にプレゼントしてもよい。

In addition to commemorative photographs, short movies may be created by shooting moving images. The

<手の動かし方>

視聴者112がキャラクタ114をタッチしたときの手の動かし方によって、キャラクタ114への関わり方を表現してもよい。たとえば、視聴者112が視聴画面をタッチしたまま手をゆっくりと左右に動かすときには第2手344によりやさしくキャラクタ114を撫でている様子を表現してもよい。具体的には、第2手検出部318は視聴者112の手の動きを検出し、手の動く速度が所定範囲内であれば「撫でる」と判定してもよい。また、視聴者112が手をすばやく動かすときには、第2手344がキャラクタ114を叩いている様子を表現してもよい。この場合には、不適切行為としてキャラクタ114にペナルティを与えてもよい。キャラクタ114へのタッチ箇所だけでなくタッチ方法によって、装飾部326はさまざまな装飾画像360を画面表示させてもよい。

<How to move your hands>

The

<その他>

ライブ制御部154は、不適切行為をしたキャラクタ114をブラックリストに登録してもよい。ライブ制御部154は、キャラクタ114に会いに来た視聴者112、視聴者112から提供されたグッズのほか、視聴者112による不適切行為の有無を登録してもよい。会話の開始にあたっては、ライブ制御部154は配信者110に対して視聴者112に関する各種の属性情報を送信して提示する。配信者110はこの属性情報を参照することにより、初めて会いに来た視聴者112なのか、前回プレゼントをくれた視聴者112なのかなどさまざまな個人情報を確認できるため、多種多様な視聴者112(ファン)に対して適切な対応が可能となる。たとえば、前回の会話のときに帽子をくれた視聴者112であれば、帽子をくれたお礼をすることによりこの視聴者112はキャラクタ114が自分を覚えてくれていたことを知って安心するかもしれない。

<Other>

The

同様にして、不適切行為(不適切領域へのタッチや不愉快な発言など)をしたことのある視聴者112に対しては、キャラクタ114(配信者110)は握手拒否や会話時間の短縮などにより視聴者112に不快感を伝えることができる。このような方法によれば、キャラクタ114(アイドル)に対する視聴者112(ファン)のマナーが醸成されていくため、視聴者112のキャラクタ114を一人格として尊重する気持ちを高めやすくなる。また、こういったマナーはキャラクタ114の実在感や重要感をいっそう高め点においても有効であると考えられる。

Similarly, for

本実施形態においては、キャラクタ114の画像とは別に第1手342を表示するとして説明した。手表示部324等はキャラクタ114そのものを動かすことで視聴者112とキャラクタ114の握手を表現してもよい。また、視聴者112がキャラクタ114の手をタッチすることで握手を成立させてもよい。

In this embodiment, the

視聴装置108の出力部172は、握手が成立したとき効果音を出力してもよいし、内蔵バイブレータにより視聴者112に触感を与えてもよい。また、出力部172は、会話ブース302に設置される照明装置(図示せず)を操作して、握手が成立したときに照明光量や照明色を変化させることで握手を演出してもよい。出力部172は、効果などの演出をキャラクタ114ごと、あるいは、握手の回数や時間ごとに異ならせてもよい。装飾部326はキャラクタ114ごとに複数種類の装飾画像360を表示してもよい。

The

配信装置104は「文字変換部」を備えてもよい。配信装置104の文字変換部は第1メッセージ(音声)と第2メッセージ(音声)を文字変換し、配信画面に表示させてもよい。このような制御方法によれば配信者110は視聴者112との会話内容を確認しながら会話を続けることができる。ライブ制御部154は、キャラクタ114(配信者110)と視聴者112の会話を文字情報として記録しておき、会話開始時においては配信者110に過去の会話記録を提供してもよい。過去の会話記録を提供することにより配信者110は多数の視聴者112に対してきめ細かい対応をしやすくなる。

The

本実施形態においては握手について説明したが、握手に限らず手合わせやハイタッチをしてもよい。視聴者112は視聴画面に手のひらを載せる。配信者110も配信画面に手のひらを載せる。二人の手座標が所定範囲内に近づいたとき、手表示部324等は手合わせやハイタッチなどのアニメーションを表示させてもよい。このときにも、装飾部326は装飾画像360を表示させてもよい。

In this embodiment, a handshake has been described, but it is not limited to a handshake; a clap of hands or a high-five may also be used. The

<他の応用例>

ライブ通信システム100は、無人店舗による接客にも利用できる。たとえば、現在、コンビニエンスストアなどで普及しつつあるセルフレジに視聴装置108を設置してもよい。遠隔地にいる店員(配信者110)はキャラクタ114として来店者(視聴者112)と対話する。来店者はキャラクタ114と対話しながら買い物を楽しむことができる。また、服などの買い物についてキャラクタ114(配信者110)からアドバイスを受けてもよい。ライブ通信システム100を応用すれば、来店者は無人店舗であっても接客の温かみを感じることができる。また、配信者110を店舗に常駐させる必要がないため、店舗側としても運営負担を軽減できるメリットがある。

<Other application examples>

The

店舗に限らず、老人ホームや幼稚園など、遠隔地からのキャラクタ114を介した会話サービスも考えられる。キャラクタ114という非日常性と配信者110の実在感を融合させることにより、キャラクタ114を相手とする気安さと配信者110の人格性を融合させる。配信者110は同時に複数の視聴者112に対して接客できることもメリットである。

In addition to stores, conversation

ライブ通信システム100を使った遠隔授業も考えられる。たとえば、英語教師が配信者110となり、生徒が視聴者112となる。配信者110(英語教師)はキャラクタ114として視聴者112(生徒)に遠隔地から英語レッスンサービスを提供してもよい。

Remote lessons using the

ライブ通信システム100により、キャラクタ114同士のディスカッションも可能である。たとえば、ユーザXはキャラクタ114xを演じ、ユーザYはキャラクタ114yを演じるとする。ユーザXの通信端末にはキャラクタ114yが表示され、ユーザYの通信端末にはキャラクタ114xが表示される。このような制御方法によれば、ユーザXとユーザYはお互いにキャラクタ114という「仮面」をかぶった状態で匿名的な会話を楽しむことができる。このほかにも遠隔宴会(合同コンパ)なども考えられる。ユーザはキャラクタ114を介して出会うため容姿ではなく人格本位の会話ができる可能性がある。

The

100 ライブ通信システム、102 サーバ、104 配信装置、106 インターネット、108 視聴装置、110 配信者、112 視聴者、114 キャラクタ、114a 配信キャラクタ、114b 視聴キャラクタ、116 ユーザインタフェース処理部、118 撮像部、120 データ処理部、122 通信部、124 データ格納部、126 入力部、128 出力部、130 動作検出部、132 第1メッセージ取得部、134 第1手検出部、138 配信キャラクタ表示部、140 第2メッセージ出力部、142 手表示部、144 動作情報生成部、148 送信部、150 受信部、152 通信部、154 ライブ制御部、156 データ格納部、158 キャラクタ格納部、162 ユーザインタフェース処理部、164 通信部、166 データ処理部、168 データ格納部、170 入力部、172 出力部、174 第2メッセージ取得部、180 視聴キャラクタ表示部、182 第1メッセージ出力部、186 送信部、190 受信部、196 視聴者会話画面、206 配信者会話画面、208 カメラ、212 帽子画像、290 会話管理部、300 デジタルサイネージ装置、302 会話ブース、304 カメラ、306 プレゼントボックス、308 投入口、310 検出装置、312 装飾部、314 オブジェクト表示部、316 撮像部、318 第2手検出部、320 オブジェクト投入部、322 オブジェクト特定部、324 手表示部、326 装飾部、328 オブジェクト表示部、330 幕表示部、332 ライブ画像出力部、334 キャラクタ表示領域、336 視聴者表示領域、338 握手画像、340 第1手座標、342 第1手、344 第2手、346 第2手座標、348 握手点、350 幕、352 通信部、354 表示部、356 データ処理部、358 送信部、360 装飾画像、362 会話表示領域、364 メッセージ表示部、366 文字変換部、368 受信部、370 キャラクタ表示部、d 手距離 100 live communication system, 102 server, 104 distribution device, 106 Internet, 108 viewing device, 110 distributor, 112 viewer, 114 character, 114a distribution character, 114b viewing character, 116 user interface processing unit, 118 imaging unit, 120 data processing unit, 122 communication unit, 124 data storage unit, 126 input unit, 128 output unit, 130 motion detection unit, 132 first message acquisition unit, 134 first hand detection unit, 138 distribution character display unit, 140 second message output unit, 142 hand display unit, 144 motion information generation unit, 148 transmission unit, 150 reception unit, 152 communication unit, 154 live control unit, 156 data storage unit, 158 character storage unit, 162 user interface processing unit, 164 communication unit, 166 Data processing unit, 168 Data storage unit, 170 Input unit, 172 Output unit, 174 Second message acquisition unit, 180 Viewing character display unit, 182 First message output unit, 186 Transmission unit, 190 Reception unit, 196 Viewer conversation screen, 206 Distributor conversation screen, 208 Camera, 212 Hat image, 290 Conversation management unit, 300 Digital signage device, 302 Conversation booth, 304 Camera, 306 Present box, 308 Insertion port, 310 Detection device, 312 Decoration unit, 314 Object display unit, 316 Imaging unit, 318 Second hand detection unit, 320 Object insertion unit, 322 Object identification unit, 324 Hand display unit, 326 Decoration unit, 328 Object display unit, 330 Curtain display unit, 332 Live image output unit, 334 Character display area, 336 Viewer display area, 338 handshake image, 340 first hand coordinates, 342 first hand, 344 second hand, 346 second hand coordinates, 348 handshake point, 350 curtain, 352 communication unit, 354 display unit, 356 data processing unit, 358 transmission unit, 360 decorative image, 362 conversation display area, 364 message display unit, 366 character conversion unit, 368 reception unit, 370 character display unit, d hand distance

Claims (13)

前記配信装置は、

配信者を撮像する撮像部と、

配信者の撮像画像から、配信者の動作の特徴を示す動作情報を生成する動作情報生成部と、

配信者の入力の位置に対応する第1入力座標を検出する第1入力検出部と、

前記動作情報および前記第1入力座標を送信する送信部と、を備え、

前記視聴装置は、

前記動作情報および前記第1入力座標を受信する受信部と、

視聴者の入力の位置に対応する第2入力座標を検出する第2入力検出部と、

前記視聴装置の画面にキャラクタを動画表示させ、前記動作情報に応じて前記キャラクタを動作させる視聴キャラクタ表示部と、

前記第1入力座標および前記第2入力座標が所定位置関係を満たすか否かを判定し、前記所定位置関係を満たす場合に、前記視聴装置の画面において所定表示を行う所定表示部と、を備え、

前記視聴装置の前記所定表示部は、前記配信者及び前記視聴者の双方の入力が維持されている状態にあるときのみ、前記所定位置関係を満たすか否かを判定することを特徴とするライブ通信システム。 A distribution device operated by a distributor and a viewing device operated by a viewer,

The distribution device includes:

An imaging unit that images a broadcaster;

a motion information generating unit that generates motion information indicating characteristics of the motion of the distributor from a captured image of the distributor;

a first input detection unit that detects a first input coordinate corresponding to a position of an input by a distributor;

a transmission unit that transmits the motion information and the first input coordinates,

The viewing device includes:

a receiving unit that receives the motion information and the first input coordinates;

a second input detection unit that detects second input coordinates corresponding to a position of a viewer's input;

a viewing character display unit that displays a moving image of a character on a screen of the viewing device and moves the character in accordance with the action information;

a predetermined display unit that determines whether the first input coordinates and the second input coordinates satisfy a predetermined positional relationship, and performs a predetermined display on a screen of the viewing device when the predetermined positional relationship is satisfied,

A live communication system characterized in that the specified display unit of the viewing device determines whether the specified positional relationship is satisfied only when input from both the distributor and the viewer is maintained .

前記配信装置は、The distribution device includes:

配信者を撮像する撮像部と、An imaging unit that images a broadcaster;

配信者の撮像画像から、配信者の動作の特徴を示す動作情報を生成する動作情報生成部と、a motion information generating unit that generates motion information indicating characteristics of the motion of the distributor from a captured image of the distributor;

配信者の入力の位置に対応する第1入力座標を検出する第1入力検出部と、a first input detection unit that detects a first input coordinate corresponding to a position of an input by a distributor;

前記動作情報および前記第1入力座標を送信する送信部と、を備え、a transmission unit that transmits the motion information and the first input coordinates,

前記視聴装置は、The viewing device includes:

前記動作情報および前記第1入力座標を受信する受信部と、a receiving unit that receives the motion information and the first input coordinates;

視聴者の入力の位置に対応する第2入力座標を検出する第2入力検出部と、a second input detection unit that detects second input coordinates corresponding to a position of a viewer's input;

前記視聴装置の画面にキャラクタを動画表示させ、前記動作情報に応じて前記キャラクタを動作させる視聴キャラクタ表示部と、a viewing character display unit that displays a moving image of a character on a screen of the viewing device and moves the character in accordance with the action information;

前記第1入力座標および前記第2入力座標が所定位置関係を満たすか否かを判定し、前記所定位置関係を満たす場合に、前記視聴装置の画面において所定表示を行う所定表示部と、を備え、a predetermined display unit that determines whether the first input coordinates and the second input coordinates satisfy a predetermined positional relationship, and performs a predetermined display on a screen of the viewing device when the predetermined positional relationship is satisfied,

前記視聴装置の前記所定表示部は、前記所定表示の開始後、前記第1入力座標および前記第2入力座標が前記所定位置関係を満たさなくなったとき前記所定表示を解消することを特徴とするライブ通信システム。A live communication system characterized in that the specified display unit of the viewing device cancels the specified display when, after the specified display has started, the first input coordinates and the second input coordinates no longer satisfy the specified positional relationship.

前記配信装置は、The distribution device includes:

配信者を撮像する撮像部と、An imaging unit that images a broadcaster;

配信者の撮像画像から、配信者の動作の特徴を示す動作情報を生成する動作情報生成部と、a motion information generating unit that generates motion information indicating characteristics of the motion of the distributor from a captured image of the distributor;

配信者の入力の位置に対応する第1入力座標を検出する第1入力検出部と、a first input detection unit that detects a first input coordinate corresponding to a position of an input by a distributor;

前記動作情報および前記第1入力座標を送信する送信部と、を備え、a transmitter for transmitting the motion information and the first input coordinates,

前記視聴装置は、The viewing device includes:

前記動作情報および前記第1入力座標を受信する受信部と、a receiving unit that receives the motion information and the first input coordinates;

視聴者の入力の位置に対応する第2入力座標を検出する第2入力検出部と、a second input detection unit that detects second input coordinates corresponding to a position of a viewer's input;

前記視聴装置の画面にキャラクタを動画表示させ、前記動作情報に応じて前記キャラクタを動作させる視聴キャラクタ表示部と、a viewing character display unit that displays a moving image of a character on a screen of the viewing device and moves the character in accordance with the action information;

前記第1入力座標および前記第2入力座標が所定位置関係を満たすか否かを判定し、前記所定位置関係を満たす場合に、前記視聴装置の画面において所定表示を行う所定表示部と、を備え、a predetermined display unit that determines whether the first input coordinates and the second input coordinates satisfy a predetermined positional relationship, and performs a predetermined display on a screen of the viewing device when the predetermined positional relationship is satisfied,

前記配信装置の前記第1入力検出部は、前記配信装置の画面に配信者がタッチしたときのタッチ地点に基づいて前記第1入力座標を検出し、the first input detection unit of the broadcasting device detects the first input coordinates based on a touch point when a broadcaster touches a screen of the broadcasting device;

前記視聴装置の前記第2入力検出部は、前記視聴装置の画面に視聴者がタッチしたときのタッチ地点に基づいて前記第2入力座標を検出することを特徴とするライブ通信システム。A live communication system, characterized in that the second input detection unit of the viewing device detects the second input coordinates based on a touch point when a viewer touches a screen of the viewing device.

前記配信装置は、The distribution device includes:

配信者を撮像する撮像部と、An imaging unit that images a broadcaster;

配信者の撮像画像から、配信者の動作の特徴を示す動作情報を生成する動作情報生成部と、a motion information generating unit that generates motion information indicating characteristics of the motion of the distributor from a captured image of the distributor;

配信者の入力の位置に対応する第1入力座標を検出する第1入力検出部と、a first input detection unit that detects a first input coordinate corresponding to a position of an input by a distributor;

前記動作情報および前記第1入力座標を送信する送信部と、を備え、a transmission unit that transmits the motion information and the first input coordinates,

前記視聴装置は、The viewing device includes:

前記動作情報および前記第1入力座標を受信する受信部と、a receiving unit that receives the motion information and the first input coordinates;

視聴者の入力の位置に対応する第2入力座標を検出する第2入力検出部と、a second input detection unit that detects second input coordinates corresponding to a position of a viewer's input;

前記視聴装置の画面にキャラクタを動画表示させ、前記動作情報に応じて前記キャラクタを動作させる視聴キャラクタ表示部と、a viewing character display unit that displays a moving image of a character on a screen of the viewing device and moves the character in accordance with the action information;

前記第1入力座標および前記第2入力座標が所定位置関係を満たすか否かを判定し、前記所定位置関係を満たす場合に、前記視聴装置の画面において所定表示を行う所定表示部と、を備え、a predetermined display unit that determines whether the first input coordinates and the second input coordinates satisfy a predetermined positional relationship, and performs a predetermined display on a screen of the viewing device when the predetermined positional relationship is satisfied,

前記視聴装置の前記視聴キャラクタ表示部は、視聴者が前記視聴装置の画面において前記キャラクタをタッチしたとき、前記キャラクタのタッチ部位およびタッチ態様の双方または一方に応じて前記キャラクタの反応を変化させることを特徴とするライブ通信システム。A live communication system characterized in that the viewing character display unit of the viewing device changes the reaction of the character depending on both or either of the touched area and touch manner of the character when a viewer touches the character on the screen of the viewing device.

前記配信装置は、The distribution device includes:

配信者を撮像する撮像部と、An imaging unit that images a broadcaster;

配信者の撮像画像から、配信者の動作の特徴を示す動作情報を生成する動作情報生成部と、a motion information generating unit that generates motion information indicating characteristics of the motion of the distributor from a captured image of the distributor;

配信者の入力の位置に対応する第1入力座標を検出する第1入力検出部と、a first input detection unit that detects a first input coordinate corresponding to a position of an input by a distributor;

前記動作情報および前記第1入力座標を送信する送信部と、を備え、a transmission unit that transmits the motion information and the first input coordinates,

前記視聴装置は、The viewing device includes:

前記動作情報および前記第1入力座標を受信する受信部と、a receiving unit that receives the motion information and the first input coordinates;

視聴者の入力の位置に対応する第2入力座標を検出する第2入力検出部と、a second input detection unit that detects second input coordinates corresponding to a position of a viewer's input;

前記視聴装置の画面にキャラクタを動画表示させ、前記動作情報に応じて前記キャラクタを動作させる視聴キャラクタ表示部と、a viewing character display unit that displays a moving image of a character on a screen of the viewing device and moves the character in accordance with the action information;

前記第1入力座標および前記第2入力座標が所定位置関係を満たすか否かを判定し、前記所定位置関係を満たす場合に、前記視聴装置の画面において所定表示を行う所定表示部と、を備え、a predetermined display unit that determines whether the first input coordinates and the second input coordinates satisfy a predetermined positional relationship, and performs a predetermined display on a screen of the viewing device when the predetermined positional relationship is satisfied,

前記視聴装置は、前記キャラクタを介した配信者と視聴者の会話中において、前記キャラクタの所定部位をタッチしたときには、配信者と視聴者の会話時間を短縮する会話管理部、を更に備えることを特徴とするライブ通信システム。The viewing device is a live communication system further characterized in that it includes a conversation management unit that shortens the conversation time between the broadcaster and the viewer when a specified part of the character is touched during a conversation between the broadcaster and the viewer via the character.

前記配信装置は、The distribution device includes:

配信者を撮像する撮像部と、An imaging unit that images a broadcaster;

配信者の撮像画像から、配信者の動作の特徴を示す動作情報を生成する動作情報生成部と、a motion information generating unit that generates motion information indicating characteristics of the motion of the distributor from a captured image of the distributor;

配信者の入力の位置に対応する第1入力座標を検出する第1入力検出部と、a first input detection unit that detects a first input coordinate corresponding to a position of an input by a distributor;

前記動作情報および前記第1入力座標を送信する送信部と、を備え、a transmission unit that transmits the motion information and the first input coordinates,

前記視聴装置は、The viewing device includes:

前記動作情報および前記第1入力座標を受信する受信部と、a receiving unit that receives the motion information and the first input coordinates;

視聴者の入力の位置に対応する第2入力座標を検出する第2入力検出部と、a second input detection unit that detects second input coordinates corresponding to a position of a viewer's input;

前記視聴装置の画面にキャラクタを動画表示させ、前記動作情報に応じて前記キャラクタを動作させる視聴キャラクタ表示部と、a viewing character display unit that displays a moving image of a character on a screen of the viewing device and moves the character in accordance with the action information;

前記第1入力座標および前記第2入力座標が所定位置関係を満たすか否かを判定し、前記所定位置関係を満たす場合に、前記視聴装置の画面において所定表示を行う所定表示部と、を備え、a predetermined display unit that determines whether the first input coordinates and the second input coordinates satisfy a predetermined positional relationship, and performs a predetermined display on a screen of the viewing device when the predetermined positional relationship is satisfied,

前記視聴装置は、The viewing device includes:

視聴者による物理オブジェクトの投入を検出するオブジェクト投入部と、an object insertion unit that detects an insertion of a physical object by a viewer;

前記投入された物理オブジェクトのIDを検出するオブジェクト特定部と、an object identification unit for detecting an ID of the thrown physical object;

前記検出されたIDに対応する仮想オブジェクトを前記視聴装置の画面に表示させるオブジェクト表示部と、を更に備えることを特徴とするライブ通信システム。and an object display unit that displays a virtual object corresponding to the detected ID on a screen of the viewing device.

配信者の撮像画像から、配信者の動作の特徴を示す動作情報を生成する機能と、

配信者の入力の位置に対応する第1入力座標を検出する機能と、

前記動作情報および前記第1入力座標を送信する機能と、を配信装置において発揮させる第1のプログラムと、

前記動作情報および前記第1入力座標を受信する機能と、

視聴者の入力の位置に対応する第2入力座標を検出する機能と、

視聴装置の画面にキャラクタを動画表示させ、前記動作情報に応じて前記キャラクタを動作させる機能と、

前記第1入力座標および前記第2入力座標が所定位置関係を満たすか否かを判定し、前記所定位置関係を満たす場合に、前記視聴装置の画面において所定表示を行う機能と、を視聴装置において発揮させる第2のプログラムと、を含み、

前記所定表示を行う機能は、前記配信者及び前記視聴者の双方の入力が維持されている状態にあるときのみ、前記所定位置関係を満たすか否かを判定することを特徴とするライブ通信プログラム。 The function of capturing images of the broadcaster,

A function of generating motion information indicating characteristics of the motion of the distributor from a captured image of the distributor;

A function of detecting a first input coordinate corresponding to a position of an input by a distributor;

a first program causing a distribution device to perform a function of transmitting the motion information and the first input coordinates;

receiving the motion information and the first input coordinate;

detecting a second input coordinate corresponding to a position of the viewer's input;

a function of displaying a moving image of a character on a screen of a viewing device and moving the character in accordance with the motion information;

a second program for causing the viewing device to perform a function of determining whether or not the first input coordinates and the second input coordinates satisfy a predetermined positional relationship, and, if the predetermined positional relationship is satisfied, performing a predetermined display on a screen of the viewing device ;

A live communication program characterized in that the function of performing the specified display determines whether the specified positional relationship is satisfied only when input from both the distributor and the viewer is maintained .

配信者の撮像画像から、配信者の動作の特徴を示す動作情報を生成する機能と、A function of generating motion information indicating characteristics of the motion of the distributor from a captured image of the distributor;

配信者の入力の位置に対応する第1入力座標を検出する機能と、A function of detecting a first input coordinate corresponding to a position of an input by a distributor;

前記動作情報および前記第1入力座標を送信する機能と、を配信装置において発揮させる第1のプログラムと、a first program causing a distribution device to perform a function of transmitting the motion information and the first input coordinates;

前記動作情報および前記第1入力座標を受信する機能と、receiving the motion information and the first input coordinate;

視聴者の入力の位置に対応する第2入力座標を検出する機能と、detecting a second input coordinate corresponding to a position of the viewer's input;

視聴装置の画面にキャラクタを動画表示させ、前記動作情報に応じて前記キャラクタを動作させる機能と、a function of displaying a moving image of a character on a screen of a viewing device and moving the character in accordance with the motion information;

前記第1入力座標および前記第2入力座標が所定位置関係を満たすか否かを判定し、前記所定位置関係を満たす場合に、前記視聴装置の画面において所定表示を行う機能と、を視聴装置において発揮させる第2のプログラムと、を含み、a second program for causing the viewing device to perform a function of determining whether or not the first input coordinates and the second input coordinates satisfy a predetermined positional relationship, and, if the predetermined positional relationship is satisfied, performing a predetermined display on a screen of the viewing device;

前記所定表示を行う機能は、前記所定表示の開始後、前記第1入力座標および前記第2入力座標が前記所定位置関係を満たさなくなったとき前記所定表示を解消することを特徴とするライブ通信プログラム。A live communication program characterized in that the function of performing the specified display cancels the specified display when the first input coordinate and the second input coordinate no longer satisfy the specified positional relationship after the specified display has started.

配信者の撮像画像から、配信者の動作の特徴を示す動作情報を生成する機能と、A function of generating motion information indicating characteristics of the motion of the distributor from a captured image of the distributor;

配信者の入力の位置に対応する第1入力座標を検出する機能と、A function of detecting a first input coordinate corresponding to a position of an input by a distributor;

前記動作情報および前記第1入力座標を送信する機能と、を配信装置において発揮させる第1のプログラムと、a first program causing a distribution device to perform a function of transmitting the motion information and the first input coordinates;

前記動作情報および前記第1入力座標を受信する機能と、receiving the motion information and the first input coordinate;

視聴者の入力の位置に対応する第2入力座標を検出する機能と、detecting a second input coordinate corresponding to a position of the viewer's input;

視聴装置の画面にキャラクタを動画表示させ、前記動作情報に応じて前記キャラクタを動作させる機能と、a function of displaying a moving image of a character on a screen of a viewing device and moving the character in accordance with the motion information;

前記第1入力座標および前記第2入力座標が所定位置関係を満たすか否かを判定し、前記所定位置関係を満たす場合に、前記視聴装置の画面において所定表示を行う機能と、を視聴装置において発揮させる第2のプログラムと、を含み、a second program for causing the viewing device to perform a function of determining whether or not the first input coordinates and the second input coordinates satisfy a predetermined positional relationship, and, if the predetermined positional relationship is satisfied, performing a predetermined display on a screen of the viewing device;

前記第1入力座標を検出する機能は、前記配信装置の画面に配信者がタッチしたときのタッチ地点に基づいて前記第1入力座標を検出し、the function of detecting the first input coordinates detects the first input coordinates based on a touch point when a broadcaster touches a screen of the broadcasting device;

前記第2入力座標を検出する機能は、前記視聴装置の画面に視聴者がタッチしたときのタッチ地点に基づいて前記第2入力座標を検出することを特徴とするライブ通信プログラム。A live communication program, characterized in that the function of detecting the second input coordinates detects the second input coordinates based on a touch point when a viewer touches the screen of the viewing device.

配信者の撮像画像から、配信者の動作の特徴を示す動作情報を生成する機能と、A function of generating motion information indicating characteristics of the motion of the distributor from a captured image of the distributor;

配信者の入力の位置に対応する第1入力座標を検出する機能と、A function of detecting a first input coordinate corresponding to a position of an input by a distributor;

前記動作情報および前記第1入力座標を送信する機能と、を配信装置において発揮させる第1のプログラムと、a first program causing a distribution device to perform a function of transmitting the motion information and the first input coordinates;

前記動作情報および前記第1入力座標を受信する機能と、receiving the motion information and the first input coordinate;

視聴者の入力の位置に対応する第2入力座標を検出する機能と、detecting a second input coordinate corresponding to a position of the viewer's input;

視聴装置の画面にキャラクタを動画表示させ、前記動作情報に応じて前記キャラクタを動作させる機能と、a function of displaying a moving image of a character on a screen of a viewing device and moving the character in accordance with the motion information;

前記第1入力座標および前記第2入力座標が所定位置関係を満たすか否かを判定し、前記所定位置関係を満たす場合に、前記視聴装置の画面において所定表示を行う機能と、を視聴装置において発揮させる第2のプログラムと、を含み、a second program for causing the viewing device to perform a function of determining whether or not the first input coordinates and the second input coordinates satisfy a predetermined positional relationship, and, if the predetermined positional relationship is satisfied, performing a predetermined display on a screen of the viewing device;

前記キャラクタを動作させる機能は、視聴者が前記視聴装置の画面において前記キャラクタをタッチしたとき、前記キャラクタのタッチ部位およびタッチ態様の双方または一方に応じて前記キャラクタの反応を変化させることを特徴とするライブ通信プログラム。A live communication program characterized in that the function of moving the character changes the reaction of the character depending on both or either of the touched part and the touch manner of the character when a viewer touches the character on the screen of the viewing device.

配信者の撮像画像から、配信者の動作の特徴を示す動作情報を生成する機能と、A function of generating motion information indicating characteristics of the motion of the distributor from a captured image of the distributor;

配信者の入力の位置に対応する第1入力座標を検出する機能と、A function of detecting a first input coordinate corresponding to a position of an input by a distributor;

前記動作情報および前記第1入力座標を送信する機能と、を配信装置において発揮させる第1のプログラムと、a first program causing a distribution device to perform a function of transmitting the motion information and the first input coordinates;

前記動作情報および前記第1入力座標を受信する機能と、receiving the motion information and the first input coordinate;

視聴者の入力の位置に対応する第2入力座標を検出する機能と、detecting a second input coordinate corresponding to a position of the viewer's input;

視聴装置の画面にキャラクタを動画表示させ、前記動作情報に応じて前記キャラクタを動作させる機能と、a function of displaying a moving image of a character on a screen of a viewing device and moving the character in accordance with the motion information;

前記第1入力座標および前記第2入力座標が所定位置関係を満たすか否かを判定し、前記所定位置関係を満たす場合に、前記視聴装置の画面において所定表示を行う機能と、を視聴装置において発揮させる第2のプログラムと、を含み、a second program for causing the viewing device to perform a function of determining whether or not the first input coordinates and the second input coordinates satisfy a predetermined positional relationship, and, if the predetermined positional relationship is satisfied, performing a predetermined display on a screen of the viewing device;

前記第2のプログラムは、前記キャラクタを介した配信者と視聴者の会話中において、前記キャラクタの所定部位をタッチしたときには、配信者と視聴者の会話時間を短縮する機能を視聴装置において更に発揮させることを特徴とするライブ通信プログラム。The second program is a live communication program that further causes the viewing device to exhibit a function of shortening the conversation time between the broadcaster and the viewer when a specified part of the character is touched during a conversation between the broadcaster and the viewer via the character.

配信者の撮像画像から、配信者の動作の特徴を示す動作情報を生成する機能と、A function of generating motion information indicating characteristics of the motion of the distributor from a captured image of the distributor;

配信者の入力の位置に対応する第1入力座標を検出する機能と、A function of detecting a first input coordinate corresponding to a position of an input by a distributor;

前記動作情報および前記第1入力座標を送信する機能と、を配信装置において発揮させる第1のプログラムと、a first program causing a distribution device to perform a function of transmitting the motion information and the first input coordinates;

前記動作情報および前記第1入力座標を受信する機能と、receiving the motion information and the first input coordinate;

視聴者の入力の位置に対応する第2入力座標を検出する機能と、detecting a second input coordinate corresponding to a position of the viewer's input;

視聴装置の画面にキャラクタを動画表示させ、前記動作情報に応じて前記キャラクタを動作させる機能と、a function of displaying a moving image of a character on a screen of a viewing device and moving the character in accordance with the motion information;

前記第1入力座標および前記第2入力座標が所定位置関係を満たすか否かを判定し、前記所定位置関係を満たす場合に、前記視聴装置の画面において所定表示を行う機能と、を視聴装置において発揮させる第2のプログラムと、を含み、a second program for causing the viewing device to perform a function of determining whether or not the first input coordinates and the second input coordinates satisfy a predetermined positional relationship, and, if the predetermined positional relationship is satisfied, performing a predetermined display on a screen of the viewing device;

前記第2のプログラムは、The second program is

視聴者による物理オブジェクトの投入を検出する機能と、A function to detect the insertion of physical objects by viewers;

前記投入された物理オブジェクトのIDを検出する機能と、detecting an ID of the inserted physical object;

前記検出されたIDに対応する仮想オブジェクトを前記視聴装置の画面に表示させる機能と、を視聴装置において更に発揮させることを特徴とするライブ通信プログラム。and a function of displaying a virtual object corresponding to the detected ID on a screen of the viewing device.

Priority Applications (1)

| Application Number | Priority Date | Filing Date | Title |

|---|---|---|---|

| JP2023100943A JP7584576B2 (en) | 2019-08-01 | 2023-06-20 | Live communication system using characters |

Applications Claiming Priority (2)

| Application Number | Priority Date | Filing Date | Title |

|---|---|---|---|

| JP2019141981A JP7300925B2 (en) | 2019-08-01 | 2019-08-01 | Live communication system with characters |

| JP2023100943A JP7584576B2 (en) | 2019-08-01 | 2023-06-20 | Live communication system using characters |

Related Parent Applications (1)

| Application Number | Title | Priority Date | Filing Date |

|---|---|---|---|

| JP2019141981A Division JP7300925B2 (en) | 2019-08-01 | 2019-08-01 | Live communication system with characters |

Publications (2)

| Publication Number | Publication Date |

|---|---|

| JP2023126237A JP2023126237A (en) | 2023-09-07 |

| JP7584576B2 true JP7584576B2 (en) | 2024-11-15 |

Family

ID=74664121

Family Applications (2)

| Application Number | Title | Priority Date | Filing Date |

|---|---|---|---|

| JP2019141981A Active JP7300925B2 (en) | 2019-08-01 | 2019-08-01 | Live communication system with characters |

| JP2023100943A Active JP7584576B2 (en) | 2019-08-01 | 2023-06-20 | Live communication system using characters |

Family Applications Before (1)

| Application Number | Title | Priority Date | Filing Date |

|---|---|---|---|

| JP2019141981A Active JP7300925B2 (en) | 2019-08-01 | 2019-08-01 | Live communication system with characters |

Country Status (1)

| Country | Link |

|---|---|

| JP (2) | JP7300925B2 (en) |

Families Citing this family (4)

| Publication number | Priority date | Publication date | Assignee | Title |

|---|---|---|---|---|

| CN115469735A (en) * | 2021-05-28 | 2022-12-13 | 北京字节跳动网络技术有限公司 | Gesture-based interaction method, device and client |

| JP7012979B1 (en) * | 2021-07-21 | 2022-01-31 | 株式会社WithLIVE | Programs and information processing equipment |

| JP2023173388A (en) * | 2022-05-25 | 2023-12-07 | 株式会社 ディー・エヌ・エー | Systems, methods, and programs for providing live streaming services |

| JP7335572B1 (en) * | 2022-09-30 | 2023-08-30 | グリー株式会社 | Information processing system, control method, and server device |

Citations (3)

| Publication number | Priority date | Publication date | Assignee | Title |

|---|---|---|---|---|

| JP2001160154A (en) | 1999-12-02 | 2001-06-12 | Nippon Telegr & Teleph Corp <Ntt> | Avatar display device, avatar display method, and storage medium in virtual space communication system |

| JP2016212564A (en) | 2015-05-01 | 2016-12-15 | 日本電信電話株式会社 | Social touch control device |

| JP2018032384A (en) | 2017-07-18 | 2018-03-01 | 株式会社コロプラ | Method and device for assisting communication in virtual space and program enabling computer to execute method |

Family Cites Families (2)

| Publication number | Priority date | Publication date | Assignee | Title |

|---|---|---|---|---|

| JP6342024B1 (en) | 2017-02-10 | 2018-06-13 | 株式会社コロプラ | Method for providing virtual space, program for causing computer to execute the method, and information processing apparatus for executing the program |

| JP6543403B1 (en) | 2018-12-12 | 2019-07-10 | グリー株式会社 | Video distribution system, video distribution method and video distribution program |

-

2019

- 2019-08-01 JP JP2019141981A patent/JP7300925B2/en active Active

-

2023

- 2023-06-20 JP JP2023100943A patent/JP7584576B2/en active Active

Patent Citations (3)

| Publication number | Priority date | Publication date | Assignee | Title |

|---|---|---|---|---|

| JP2001160154A (en) | 1999-12-02 | 2001-06-12 | Nippon Telegr & Teleph Corp <Ntt> | Avatar display device, avatar display method, and storage medium in virtual space communication system |

| JP2016212564A (en) | 2015-05-01 | 2016-12-15 | 日本電信電話株式会社 | Social touch control device |

| JP2018032384A (en) | 2017-07-18 | 2018-03-01 | 株式会社コロプラ | Method and device for assisting communication in virtual space and program enabling computer to execute method |

Also Published As

| Publication number | Publication date |

|---|---|

| JP2021027420A (en) | 2021-02-22 |

| JP7300925B2 (en) | 2023-06-30 |

| JP2023126237A (en) | 2023-09-07 |

Similar Documents

| Publication | Publication Date | Title |

|---|---|---|

| JP7584576B2 (en) | Live communication system using characters | |

| JP7389855B2 (en) | Video distribution system, video distribution method, and video distribution program for live distribution of videos including character object animations generated based on the movements of distribution users | |

| JP7489642B2 (en) | PROGRAM, OBJECT DRAWING METHOD AND INFORMATION PROCESSING SYSTEM | |

| WO2019234879A1 (en) | Information processing system, information processing method and computer program | |

| JP2018094326A (en) | Event control system, and event notification system and program | |

| JP2020039029A (en) | Video distribution system, video distribution method, and video distribution program | |

| JP7379427B2 (en) | Video distribution system, video distribution method, and video distribution program for live distribution of videos including character object animations generated based on the movements of distribution users | |

| JP7264941B2 (en) | Program, information processing device and information processing method | |

| CN116097292A (en) | Influencer flow customization for a viewer of interest | |

| US20160320833A1 (en) | Location-based system for sharing augmented reality content | |

| JP2025176097A (en) | Information processing system, information processing method and information processing program | |

| JP7479618B2 (en) | Information processing program, information processing method, and information processing device | |

| JP6979539B2 (en) | Information processing system, display method and computer program | |

| JP2021007198A (en) | Video distribution system, video distribution method, information processing device, video distribution program and video viewing program | |

| KR20200041839A (en) | Method for providing virtual reality userinterface for viewing broadcastand apparatus using the same | |

| CN116438801A (en) | Information processing device, information processing method, program, and information processing system | |

| JP2024133362A (en) | Live communication system using characters | |

| JP7709706B2 (en) | PROGRAM, INFORMATION PROCESSING METHOD, AND INFORMATION PROCESSING SYSTEM | |

| JP7333528B2 (en) | Program, information processing method and information processing apparatus | |

| KR102082670B1 (en) | Method for providing virtual reality userinterface for viewing broadcastand apparatus using the same | |

| JP7691073B2 (en) | Terminal device control program, terminal device, terminal device control method, server device control program, server device, and server device control method | |

| CN105516785A (en) | Communication system, communication method and server for transmitting human-shaped doll image or video | |

| US20250030924A1 (en) | Information processing system and information processing method | |

| CN116457750A (en) | Information processing device, information processing method, program, and information processing system |

Legal Events

| Date | Code | Title | Description |

|---|---|---|---|

| RD02 | Notification of acceptance of power of attorney |

Free format text: JAPANESE INTERMEDIATE CODE: A7422 Effective date: 20230627 |

|

| A521 | Request for written amendment filed |

Free format text: JAPANESE INTERMEDIATE CODE: A821 Effective date: 20230627 |

|

| A521 | Request for written amendment filed |

Free format text: JAPANESE INTERMEDIATE CODE: A523 Effective date: 20230719 |

|

| A621 | Written request for application examination |

Free format text: JAPANESE INTERMEDIATE CODE: A621 Effective date: 20230719 |

|

| RD04 | Notification of resignation of power of attorney |

Free format text: JAPANESE INTERMEDIATE CODE: A7424 Effective date: 20230915 |

|

| A977 | Report on retrieval |

Free format text: JAPANESE INTERMEDIATE CODE: A971007 Effective date: 20240726 |

|

| A131 | Notification of reasons for refusal |

Free format text: JAPANESE INTERMEDIATE CODE: A131 Effective date: 20240813 |

|

| A521 | Request for written amendment filed |

Free format text: JAPANESE INTERMEDIATE CODE: A523 Effective date: 20240924 |

|

| TRDD | Decision of grant or rejection written | ||

| A01 | Written decision to grant a patent or to grant a registration (utility model) |

Free format text: JAPANESE INTERMEDIATE CODE: A01 Effective date: 20241008 |

|

| A61 | First payment of annual fees (during grant procedure) |

Free format text: JAPANESE INTERMEDIATE CODE: A61 Effective date: 20241105 |

|

| R150 | Certificate of patent or registration of utility model |

Ref document number: 7584576 Country of ref document: JP Free format text: JAPANESE INTERMEDIATE CODE: R150 |