KR20170052976A - 모션을 수행하는 전자 장치 및 그 제어 방법 - Google Patents

모션을 수행하는 전자 장치 및 그 제어 방법 Download PDFInfo

- Publication number

- KR20170052976A KR20170052976A KR1020150155160A KR20150155160A KR20170052976A KR 20170052976 A KR20170052976 A KR 20170052976A KR 1020150155160 A KR1020150155160 A KR 1020150155160A KR 20150155160 A KR20150155160 A KR 20150155160A KR 20170052976 A KR20170052976 A KR 20170052976A

- Authority

- KR

- South Korea

- Prior art keywords

- electronic device

- motion

- motion data

- data

- user

- Prior art date

- Legal status (The legal status is an assumption and is not a legal conclusion. Google has not performed a legal analysis and makes no representation as to the accuracy of the status listed.)

- Withdrawn

Links

Images

Classifications

-

- G—PHYSICS

- G06—COMPUTING OR CALCULATING; COUNTING

- G06F—ELECTRIC DIGITAL DATA PROCESSING

- G06F3/00—Input arrangements for transferring data to be processed into a form capable of being handled by the computer; Output arrangements for transferring data from processing unit to output unit, e.g. interface arrangements

- G06F3/01—Input arrangements or combined input and output arrangements for interaction between user and computer

- G06F3/017—Gesture based interaction, e.g. based on a set of recognized hand gestures

-

- H—ELECTRICITY

- H04—ELECTRIC COMMUNICATION TECHNIQUE

- H04N—PICTORIAL COMMUNICATION, e.g. TELEVISION

- H04N7/00—Television systems

- H04N7/14—Systems for two-way working

- H04N7/141—Systems for two-way working between two video terminals, e.g. videophone

- H04N7/147—Communication arrangements, e.g. identifying the communication as a video-communication, intermediate storage of the signals

-

- B—PERFORMING OPERATIONS; TRANSPORTING

- B25—HAND TOOLS; PORTABLE POWER-DRIVEN TOOLS; MANIPULATORS

- B25J—MANIPULATORS; CHAMBERS PROVIDED WITH MANIPULATION DEVICES

- B25J11/00—Manipulators not otherwise provided for

- B25J11/0005—Manipulators having means for high-level communication with users, e.g. speech generator, face recognition means

- B25J11/0015—Face robots, animated artificial faces for imitating human expressions

-

- B—PERFORMING OPERATIONS; TRANSPORTING

- B25—HAND TOOLS; PORTABLE POWER-DRIVEN TOOLS; MANIPULATORS

- B25J—MANIPULATORS; CHAMBERS PROVIDED WITH MANIPULATION DEVICES

- B25J9/00—Program-controlled manipulators

- B25J9/16—Program controls

- B25J9/1679—Program controls characterised by the tasks executed

-

- G—PHYSICS

- G05—CONTROLLING; REGULATING

- G05B—CONTROL OR REGULATING SYSTEMS IN GENERAL; FUNCTIONAL ELEMENTS OF SUCH SYSTEMS; MONITORING OR TESTING ARRANGEMENTS FOR SUCH SYSTEMS OR ELEMENTS

- G05B19/00—Program-control systems

- G05B19/02—Program-control systems electric

- G05B19/18—Numerical control [NC], i.e. automatically operating machines, in particular machine tools, e.g. in a manufacturing environment, so as to execute positioning, movement or co-ordinated operations by means of program data in numerical form

- G05B19/402—Numerical control [NC], i.e. automatically operating machines, in particular machine tools, e.g. in a manufacturing environment, so as to execute positioning, movement or co-ordinated operations by means of program data in numerical form characterised by control arrangements for positioning, e.g. centring a tool relative to a hole in the workpiece, additional detection means to correct position

-

- G—PHYSICS

- G06—COMPUTING OR CALCULATING; COUNTING

- G06F—ELECTRIC DIGITAL DATA PROCESSING

- G06F3/00—Input arrangements for transferring data to be processed into a form capable of being handled by the computer; Output arrangements for transferring data from processing unit to output unit, e.g. interface arrangements

- G06F3/16—Sound input; Sound output

- G06F3/165—Management of the audio stream, e.g. setting of volume, audio stream path

-

- G—PHYSICS

- G06—COMPUTING OR CALCULATING; COUNTING

- G06V—IMAGE OR VIDEO RECOGNITION OR UNDERSTANDING

- G06V40/00—Recognition of biometric, human-related or animal-related patterns in image or video data

- G06V40/10—Human or animal bodies, e.g. vehicle occupants or pedestrians; Body parts, e.g. hands

- G06V40/16—Human faces, e.g. facial parts, sketches or expressions

- G06V40/174—Facial expression recognition

- G06V40/176—Dynamic expression

-

- G—PHYSICS

- G06—COMPUTING OR CALCULATING; COUNTING

- G06V—IMAGE OR VIDEO RECOGNITION OR UNDERSTANDING

- G06V40/00—Recognition of biometric, human-related or animal-related patterns in image or video data

- G06V40/20—Movements or behaviour, e.g. gesture recognition

- G06V40/23—Recognition of whole body movements, e.g. for sport training

-

- H04M1/72522—

-

- G—PHYSICS

- G05—CONTROLLING; REGULATING

- G05B—CONTROL OR REGULATING SYSTEMS IN GENERAL; FUNCTIONAL ELEMENTS OF SUCH SYSTEMS; MONITORING OR TESTING ARRANGEMENTS FOR SUCH SYSTEMS OR ELEMENTS

- G05B2219/00—Program-control systems

- G05B2219/30—Nc systems

- G05B2219/35—Nc in input of data, input till input file format

- G05B2219/35585—Motion command profile

-

- G—PHYSICS

- G05—CONTROLLING; REGULATING

- G05B—CONTROL OR REGULATING SYSTEMS IN GENERAL; FUNCTIONAL ELEMENTS OF SUCH SYSTEMS; MONITORING OR TESTING ARRANGEMENTS FOR SUCH SYSTEMS OR ELEMENTS

- G05B2219/00—Program-control systems

- G05B2219/30—Nc systems

- G05B2219/43—Speed, acceleration, deceleration control ADC

- G05B2219/43162—Motion control, movement speed combined with position

-

- G—PHYSICS

- G06—COMPUTING OR CALCULATING; COUNTING

- G06F—ELECTRIC DIGITAL DATA PROCESSING

- G06F2200/00—Indexing scheme relating to G06F1/04 - G06F1/32

- G06F2200/16—Indexing scheme relating to G06F1/16 - G06F1/18

- G06F2200/163—Indexing scheme relating to constructional details of the computer

- G06F2200/1637—Sensing arrangement for detection of housing movement or orientation, e.g. for controlling scrolling or cursor movement on the display of an handheld computer

-

- H—ELECTRICITY

- H04—ELECTRIC COMMUNICATION TECHNIQUE

- H04M—TELEPHONIC COMMUNICATION

- H04M2201/00—Electronic components, circuits, software, systems or apparatus used in telephone systems

- H04M2201/50—Telephonic communication in combination with video communication

-

- H—ELECTRICITY

- H04—ELECTRIC COMMUNICATION TECHNIQUE

- H04M—TELEPHONIC COMMUNICATION

- H04M2250/00—Details of telephonic subscriber devices

- H04M2250/12—Details of telephonic subscriber devices including a sensor for measuring a physical value, e.g. temperature or motion

Landscapes

- Engineering & Computer Science (AREA)

- Theoretical Computer Science (AREA)

- Human Computer Interaction (AREA)

- Physics & Mathematics (AREA)

- General Physics & Mathematics (AREA)

- General Engineering & Computer Science (AREA)

- Multimedia (AREA)

- Health & Medical Sciences (AREA)

- General Health & Medical Sciences (AREA)

- Audiology, Speech & Language Pathology (AREA)

- Signal Processing (AREA)

- Manufacturing & Machinery (AREA)

- Automation & Control Theory (AREA)

- Oral & Maxillofacial Surgery (AREA)

- Computer Vision & Pattern Recognition (AREA)

- Psychiatry (AREA)

- Social Psychology (AREA)

- Robotics (AREA)

- Mechanical Engineering (AREA)

- User Interface Of Digital Computer (AREA)

- Telephone Function (AREA)

Abstract

전자 장치는, 외부 음성을 음성 데이터로 처리하는 마이크, 사용자 모션을 센싱하는 센서, 다른 전자 장치와 통신 세션을 형성하는 통신 모듈, 상기 통신 모듈 및 상기 센서에 전기적으로 연결된 프로세서 및 상기 프로세서에 전기적으로 연결된 메모리를 포함하고, 상기 메모리는, 실행시에 상기 프로세서가, 상기 센싱된 사용자 모션에 대응하는 모션 데이터를 생성하고, 상기 음성 데이터 및 상기 모션 데이터를 시간적으로 동기화하여, 상기 통신 세션을 통하여, 상기 다른 전자 장치로 송신하는 인스트럭션을 저장할 수 있다.

Description

본 발명은 모션을 수행하는 전자 장치 및 그 제어 방법에 관한 것으로, 더욱 상세하게는 인간의 행동을 모사하는 모션을 수행하는 전자 장치 및 그 제어 방법에 관한 것이다.

근자에 들어서, 카메라를 탑재한 이동통신장치, 예를 들어 스마트폰에 대한 수요가 꾸준하게 증가하고 있다. 종래의 스마트폰은 마이크를 통하여 획득한 사용자 음성과 카메라를 통하여 촬영한 사용자의 이미지를, 착신자의 전자 장치로 전송하는 방식으로 영상 통화 기능을 제공한다. 사용자는, 영상 통화 기능을 이용함으로써, 착신자의 모습을 스마트폰의 디스플레이를 통하여 확인할 수 있으며, 착신자 또한 발신자의 모습을 확인할 수 있다.

다만, 종래에는 영상 통화 기능을 제공하는 전자 장치만이 개시될뿐, 통화 시 사용자의 행동을 송수신하는 전자 장치가 제공된 바는 없다.

상술한 바와 같이, 통화시 사용자의 행동을 송수신함으로써, 인간의 행동을 모사하는 전자 장치 및 그 제어 방법이 제공된 바는 없다. 본 발명의 다양한 실시예들은, 사용자의 행동을 송수신이 가능하며, 수신된 행동에 대한 정보를 이용하여 모션을 수행할 수 있는 전자 장치 및 그 제어 방법을 제공할 수 있다.

본 발명의 다양한 실시예에서, 전자 장치는, 외부 음성을 음성 데이터로 처리하는 마이크; 사용자 모션을 센싱하는 센서; 다른 전자 장치와 통신 세션을 형성하는 통신 모듈; 상기 통신 모듈 및 상기 센서에 전기적으로 연결된 프로세서; 및 상기 프로세서에 전기적으로 연결된 메모리를 포함하고, 상기 메모리는, 실행시에 상기 프로세서가, 상기 센싱된 사용자 모션에 대응하는 모션 데이터를 생성하고, 상기 음성 데이터 및 상기 모션 데이터를 시간적으로 동기화하여, 상기 통신 세션을 통하여, 상기 다른 전자 장치로 송신하는 인스트럭션을 저장할 수 있다.

본 발명의 다양한 실시예에서, 전자 장치의 제어 방법은, 외부 음성에 대한 음성 데이터를 획득하는 동작; 사용자 모션을 센싱하는 동작; 상기 센싱된 사용자 모션에 대응하는 모션 데이터를 생성하고, 상기 음성 데이터 및 상기 모션 데이터를 시간적으로 동기화하여, 다른 전자 장치로 송신하는 동작을 포함할 수 있다.

본 발명의 다양한 실시예들에 의하여, 사용자의 행동을 송수신이 가능하며, 수신된 행동에 대한 정보를 이용하여 모션을 수행할 수 있는 전자 장치 및 그 제어 방법이 제공될 수 있다. 이에 따라, 보다 실사감을 주는 통화 기능이 제공될 수 있다. 아울러, 사용자가 프라이버시를 원하는 통화를 원하는 경우에도, 영상을 제공하지 않아도 사용자의 행동을 모사할 수 있는 전자 장치가 제공됨에 따라서, 영상 통화와 같은 사실감을 주는 통화 기능이 제공될 수 있다.

도 1a는 본 발명의 다양한 실시예에 따른 전자 장치 및 네트워크의 블록도를 도시한다.

도 1b는 본 발명의 다양한 실시예에 따른 구현예를 설명하기 위한 개념도를 도시한다.

도 2a는 다양한 실시예에 따른 전자 장치의 블록도이다.

도 2b는 본 발명의 다양한 실시예에 따른 전자 장치의 블록도를 도시한다.

도 3은 다양한 실시예에 따른 프로그램 모듈의 블록도이다.

도 4는 본 발명의 다양한 실시예에 따른 전자 장치가 이용하는 소프트웨어를 설명하기 위한 블록도를 도시한다.

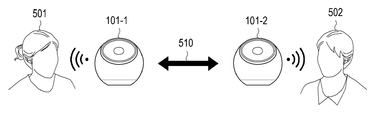

도 5는 본 발명과의 비교를 위한 비교예에 따른 전자 장치의 동작을 설명하기 위한 개념도를 도시한다.

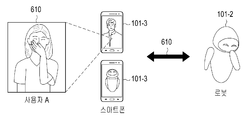

도 6a 및 6b는 본 발명의 다양한 실시예에 따른 전자 장치의 동작을 설명하기 위한 개념도를 도시한다.

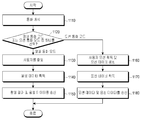

도 7a 및 7b는 본 발명의 다양한 실시예에 따른 전자 장치의 제어 방법을 설명하기 위한 흐름도를 도시한다.

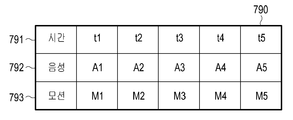

도 7c는 본 발명의 다양한 실시예에 따른 합성 데이터의 예시를 도시한다.

도 8은 본 발명의 다양한 실시예에 따른 전자 장치의 제어 방법을 설명하기 위한 흐름도를 도시한다.

도 9는 본 발명의 다양한 실시예에 따른 캐퍼빌리티 정보의 예시이다.

도 10a 및 10b는 본 발명의 다양한 실시예에 따른 전자 장치의 동작을 설명하기 위한 개념도를 도시한다.

도 11은 본 발명의 다양한 실시예에 따른 전자 장치의 제어 방법의 흐름도를 도시한다.

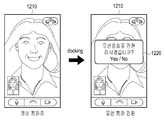

도 12a 및 12b는 본 발명의 다양한 실시예에 따른 모드 선택을 설명하기 위한 개념도를 도시한다.

도 13a 및 13b는 본 발명의 다양한 실시예에 따른 전자 장치의 동작을 설명하기 위한 흐름도를 도시한다.

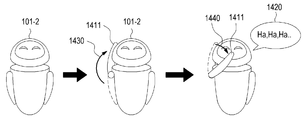

도 14a 및 14b는 본 발명의 다양한 실시예에 따른 전자 장치의 동작을 설명하기 위한 개념도들을 도시한다.

도 14c는 본 발명의 다양한 실시예에 따른 모션 데이터의 예시이다.

도 15는 본 발명의 다양한 실시예에 따른 전자 장치의 제어 방법을 설명하기 위한 흐름도를 도시한다.

도 16은 본 발명의 다양한 실시예에 따른 전자 장치의 제어 방법의 흐름도를 도시한다.

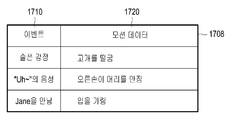

도 17은 이벤트 및 모션 데이터 사이의 연관 정보의 예시를 도시한다.

도 18a 및 18b는 본 발명의 다양한 실시예에 따른 전자 장치의 동작을 설명하기 위한 흐름도를 도시한다.

도 19는 본 발명의 다양한 실시예에 따른 전자 장치의 제어 방법을 설명하기 위한 흐름도를 도시한다.

도 1b는 본 발명의 다양한 실시예에 따른 구현예를 설명하기 위한 개념도를 도시한다.

도 2a는 다양한 실시예에 따른 전자 장치의 블록도이다.

도 2b는 본 발명의 다양한 실시예에 따른 전자 장치의 블록도를 도시한다.

도 3은 다양한 실시예에 따른 프로그램 모듈의 블록도이다.

도 4는 본 발명의 다양한 실시예에 따른 전자 장치가 이용하는 소프트웨어를 설명하기 위한 블록도를 도시한다.

도 5는 본 발명과의 비교를 위한 비교예에 따른 전자 장치의 동작을 설명하기 위한 개념도를 도시한다.

도 6a 및 6b는 본 발명의 다양한 실시예에 따른 전자 장치의 동작을 설명하기 위한 개념도를 도시한다.

도 7a 및 7b는 본 발명의 다양한 실시예에 따른 전자 장치의 제어 방법을 설명하기 위한 흐름도를 도시한다.

도 7c는 본 발명의 다양한 실시예에 따른 합성 데이터의 예시를 도시한다.

도 8은 본 발명의 다양한 실시예에 따른 전자 장치의 제어 방법을 설명하기 위한 흐름도를 도시한다.

도 9는 본 발명의 다양한 실시예에 따른 캐퍼빌리티 정보의 예시이다.

도 10a 및 10b는 본 발명의 다양한 실시예에 따른 전자 장치의 동작을 설명하기 위한 개념도를 도시한다.

도 11은 본 발명의 다양한 실시예에 따른 전자 장치의 제어 방법의 흐름도를 도시한다.

도 12a 및 12b는 본 발명의 다양한 실시예에 따른 모드 선택을 설명하기 위한 개념도를 도시한다.

도 13a 및 13b는 본 발명의 다양한 실시예에 따른 전자 장치의 동작을 설명하기 위한 흐름도를 도시한다.

도 14a 및 14b는 본 발명의 다양한 실시예에 따른 전자 장치의 동작을 설명하기 위한 개념도들을 도시한다.

도 14c는 본 발명의 다양한 실시예에 따른 모션 데이터의 예시이다.

도 15는 본 발명의 다양한 실시예에 따른 전자 장치의 제어 방법을 설명하기 위한 흐름도를 도시한다.

도 16은 본 발명의 다양한 실시예에 따른 전자 장치의 제어 방법의 흐름도를 도시한다.

도 17은 이벤트 및 모션 데이터 사이의 연관 정보의 예시를 도시한다.

도 18a 및 18b는 본 발명의 다양한 실시예에 따른 전자 장치의 동작을 설명하기 위한 흐름도를 도시한다.

도 19는 본 발명의 다양한 실시예에 따른 전자 장치의 제어 방법을 설명하기 위한 흐름도를 도시한다.

이하, 본 문서의 다양한 실시예가 첨부된 도면을 참조하여 기재된다. 그러나, 이는 본 문서에 기재된 기술을 특정한 실시 형태에 대해 한정하려는 것이 아니며, 본 문서의 실시예의 다양한 변경(modifications), 균등물(equivalents), 및/또는 대체물(alternatives)을 포함하는 것으로 이해되어야 한다. 도면의 설명과 관련하여, 유사한 구성요소에 대해서는 유사한 참조 부호가 사용될 수 있다.

본 문서에서, "가진다," "가질 수 있다," "포함한다," 또는 "포함할 수 있다" 등의 표현은 해당 특징(예: 수치, 기능, 동작, 또는 부품 등의 구성요소)의 존재를 가리키며, 추가적인 특징의 존재를 배제하지 않는다.

본 문서에서, "A 또는 B," "A 또는/및 B 중 적어도 하나," 또는 "A 또는/및 B 중 하나 또는 그 이상"등의 표현은 함께 나열된 항목들의 모든 가능한 조합을 포함할 수 있다. 예를 들면, "A 또는 B," "A 및 B 중 적어도 하나," 또는 "A 또는 B 중 적어도 하나"는, (1) 적어도 하나의 A를 포함, (2) 적어도 하나의 B를 포함, 또는 (3) 적어도 하나의 A 및 적어도 하나의 B 모두를 포함하는 경우를 모두 지칭할 수 있다.

본 문서에서 사용된 "제 1," "제 2," "첫째," 또는 "둘째,"등의 표현들은 다양한 구성요소들을, 순서 및/또는 중요도에 상관없이 수식할 수 있고, 한 구성요소를 다른 구성요소와 구분하기 위해 사용될 뿐 해당 구성요소들을 한정하지 않는다. 예를 들면, 제 1 사용자 기기와 제 2 사용자 기기는, 순서 또는 중요도와 무관하게, 서로 다른 사용자 기기를 나타낼 수 있다. 예를 들면, 본 문서에 기재된 권리 범위를 벗어나지 않으면서 제 1 구성요소는 제 2 구성요소로 명명될 수 있고, 유사하게 제 2 구성요소도 제 1 구성요소로 바꾸어 명명될 수 있다.

어떤 구성요소(예: 제 1 구성요소)가 다른 구성요소(예: 제 2 구성요소)에 "(기능적으로 또는 통신적으로) 연결되어((operatively or communicatively) coupled with/to)" 있다거나 "접속되어(connected to)" 있다고 언급된 때에는, 상기 어떤 구성요소가 상기 다른 구성요소에 직접적으로 연결되거나, 다른 구성요소(예: 제 3 구성요소)를 통하여 연결될 수 있다고 이해되어야 할 것이다. 반면에, 어떤 구성요소(예: 제 1 구성요소)가 다른 구성요소(예: 제 2 구성요소)에 "직접 연결되어" 있다거나 "직접 접속되어" 있다고 언급된 때에는, 상기 어떤 구성요소와 상기 다른 구성요소 사이에 다른 구성요소(예: 제 3 구성요소)가 존재하지 않는 것으로 이해될 수 있다.

본 문서에서 사용된 표현 "~하도록 구성된(또는 설정된)(configured to)"은 상황에 따라, 예를 들면, "~에 적합한(suitable for)," "~하는 능력을 가지는(having the capacity to)," "~하도록 설계된(designed to)," "~하도록 변경된(adapted to)," "~하도록 만들어진(made to)," 또는 "~를 할 수 있는(capable of)"과 바꾸어 사용될 수 있다. 용어 "~하도록 구성된(또는 설정된)"은 하드웨어적으로 "특별히 설계된(specifically designed to)" 것만을 반드시 의미하지 않을 수 있다. 대신, 어떤 상황에서는, "~하도록 구성된 장치"라는 표현은, 그 장치가 다른 장치 또는 부품들과 함께 "~할 수 있는" 것을 의미할 수 있다. 예를 들면, 문구 "A, B, 및 C를 수행하도록 구성된(또는 설정된) 프로세서"는 해당 동작을 수행하기 위한 전용 프로세서(예: 임베디드 프로세서), 또는 메모리 장치에 저장된 하나 이상의 소프트웨어 프로그램들을 실행함으로써, 해당 동작들을 수행할 수 있는 범용 프로세서(generic-purpose processor)(예: CPU 또는 application processor)를 의미할 수 있다.

본 문서에서 사용된 용어들은 단지 특정한 실시예를 설명하기 위해 사용된 것으로, 다른 실시예의 범위를 한정하려는 의도가 아닐 수 있다. 단수의 표현은 문맥상 명백하게 다르게 뜻하지 않는 한, 복수의 표현을 포함할 수 있다. 기술적이거나 과학적인 용어를 포함해서 여기서 사용되는 용어들은 본 문서에 기재된 기술 분야에서 통상의 지식을 가진 자에 의해 일반적으로 이해되는 것과 동일한 의미를 가질 수 있다. 본 문서에 사용된 용어들 중 일반적인 사전에 정의된 용어들은, 관련 기술의 문맥상 가지는 의미와 동일 또는 유사한 의미로 해석될 수 있으며, 본 문서에서 명백하게 정의되지 않는 한, 이상적이거나 과도하게 형식적인 의미로 해석되지 않는다. 경우에 따라서, 본 문서에서 정의된 용어일지라도 본 문서의 실시예들을 배제하도록 해석될 수 없다.

본 문서의 다양한 실시예들에 따른 전자 장치는, 예를 들면, 스마트폰(smartphone), 태블릿 PC(tablet personal computer), 이동 전화기(mobile phone), 영상 전화기, 전자책 리더기(e-book reader), 데스크탑 PC(desktop personal computer), 랩탑 PC(laptop personal computer), 넷북 컴퓨터(netbook computer), 워크스테이션(workstation), 서버, PDA(personal digital assistant), PMP(portable multimedia player), MP3 플레이어, 모바일 의료기기, 카메라(camera), 또는 웨어러블 장치(wearable device) 중 적어도 하나를 포함할 수 있다. 다양한 실시예에 따르면, 웨어러블 장치는 액세서리형(예: 시계, 반지, 팔찌, 발찌, 목걸이, 안경, 콘택트 렌즈, 또는 머리 착용형 장치(head-mounted-device(HMD)), 직물 또는 의류 일체형(예: 전자 의복), 신체 부착형(예: 스킨 패드(skin pad) 또는 문신), 또는 생체 이식형(예: implantable circuit) 중 적어도 하나를 포함할 수 있다.

어떤 실시예들에서, 전자 장치는 가전 제품(home appliance)일 수 있다. 가전 제품은, 예를 들면, 텔레비전, DVD(digital video disk) 플레이어, 오디오, 냉장고, 에어컨, 청소기, 오븐, 전자레인지, 세탁기, 공기 청정기, 셋톱 박스(set-top box), 홈 오토매이션 컨트롤 패널(home automation control panel), 보안 컨트롤 패널(security control panel), TV 박스(예: 삼성 HomeSyncTM, 애플TVTM, 또는 구글 TVTM), 게임 콘솔(예: XboxTM, PlayStationTM), 전자 사전, 전자 키, 캠코더(camcorder), 또는 전자 액자 중 적어도 하나를 포함할 수 있다.

다른 실시예에서, 전자 장치는, 각종 의료기기(예: 각종 휴대용 의료측정기기(혈당 측정기, 심박 측정기, 혈압 측정기, 또는 체온 측정기 등), MRA(magnetic resonance angiography), MRI(magnetic resonance imaging), CT(computed tomography), 촬영기, 또는 초음파기 등), 네비게이션(navigation) 장치, 위성 항법 시스템(GNSS(global navigation satellite system)), EDR(event data recorder), FDR(flight data recorder), 자동차 인포테인먼트(infotainment) 장치, 선박용 전자 장비(예: 선박용 항법 장치, 자이로 콤파스 등), 항공 전자기기(avionics), 보안 기기, 차량용 헤드 유닛(head unit), 산업용 또는 가정용 로봇, 금융 기관의 ATM(automatic teller's machine), 상점의 POS(point of sales), 또는 사물 인터넷 장치(internet of things)(예: 전구, 각종 센서, 전기 또는 가스 미터기, 스프링클러 장치, 화재경보기, 온도조절기(thermostat), 가로등, 토스터(toaster), 운동기구, 온수탱크, 히터, 보일러 등) 중 적어도 하나를 포함할 수 있다.

어떤 실시예에 따르면, 전자 장치는 가구(furniture) 또는 건물/구조물의 일부, 전자 보드(electronic board), 전자 사인 수신 장치(electronic signature receiving device), 프로젝터(projector), 또는 각종 계측 기기(예: 수도, 전기, 가스, 또는 전파 계측 기기 등) 중 적어도 하나를 포함할 수 있다. 다양한 실시예에서, 전자 장치는 전술한 다양한 장치들 중 하나 또는 그 이상의 조합일 수 있다. 어떤 실시예에 따른 전자 장치는 플렉서블 전자 장치일 수 있다. 또한, 본 문서의 실시예에 따른 전자 장치는 전술한 기기들에 한정되지 않으며, 기술 발전에 따른 새로운 전자 장치를 포함할 수 있다.

이하, 첨부 도면을 참조하여, 다양한 실시예에 따른 전자 장치가 설명된다. 본 문서에서, 사용자라는 용어는 전자 장치를 사용하는 사람 또는 전자 장치를 사용하는 장치(예: 인공지능 전자 장치)를 지칭할 수 있다.

도 1a을 참조하여, 다양한 실시예에서의, 네트워크 환경(100) 내의 전자 장치(101)가 기재된다. 전자 장치(101)는 버스(110), 프로세서(120), 메모리(130), 입출력 인터페이스(150), 디스플레이(160), 및 통신 모듈(170)을 포함할 수 있다. 어떤 실시예에서는, 전자 장치(101)는, 구성요소들 중 적어도 하나를 생략하거나 다른 구성요소를 추가적으로 구비할 수 있다.

버스(110)는, 예를 들면, 구성요소들(110-170)을 서로 연결하고, 구성요소들 간의 통신(예: 제어 메시지 및/또는 데이터)을 전달하는 회로를 포함할 수 있다.

프로세서(120)는, 중앙처리장치(central processing unit(CPU)), 어플리케이션 프로세서(application processor(AP)), 커뮤니케이션 프로세서(communication processor(CP)) 그래픽 프로세서(graphicprocessor(GP), 멀티 칩 패키지(multi chip package(MCP)) 또는 이미지 프로세서(image processor(IP))중 하나 또는 그 이상을 포함할 수 있다. 프로세서(120)는, 예를 들면, 전자 장치(101)의 적어도 하나의 다른 구성요소들의 제어 및/또는 통신에 관한 연산이나 데이터 처리를 실행할 수 있다.

메모리(130)는, 휘발성 및/또는 비휘발성 메모리를 포함할 수 있다. 메모리(130)는, 예를 들면, 전자 장치(101)의 적어도 하나의 다른 구성요소에 관계된 명령 또는 데이터를 저장할 수 있다. 한 실시예에 따르면, 메모리(130)는 소프트웨어 및/또는 프로그램(140)을 저장할 수 있다. 프로그램(140)은, 예를 들면, 커널(141), 미들웨어(143), 어플리케이션 프로그래밍 인터페이스(application programming interface(API))(145), 및/또는 어플리케이션 프로그램(또는 "어플리케이션")(147) 등을 포함할 수 있다. 커널(141), 미들웨어(143), 또는 API(145)의 적어도 일부는, 운영 시스템(operating system(OS))으로 지칭될 수 있다.

커널(141)은, 예를 들면, 다른 프로그램들(예: 미들웨어(143), API(145), 또는 어플리케이션 프로그램(147))에 구현된 동작 또는 기능을 실행하는 데 사용되는 시스템 리소스들(예: 버스(110), 프로세서(120), 또는 메모리(130) 등)을 제어 또는 관리할 수 있다. 또한, 커널(141)은 미들웨어(143), API(145), 또는 어플리케이션 프로그램(147)에서 전자 장치(101)의 개별 구성요소에 접근함으로써, 시스템 리소스들을 제어 또는 관리할 수 있는 인터페이스를 제공할 수 있다.

미들웨어(143)는, 예를 들면, API(145) 또는 어플리케이션 프로그램(147)이 커널(141)과 통신하여 데이터를 주고받을 수 있도록 중개 역할을 수행할 수 있다.

또한, 미들웨어(143)는 어플리케이션 프로그램(147)으로부터 수신된 하나 이상의 작업 요청들을 우선 순위에 따라 처리할 수 있다. 예를 들면, 미들웨어(143)는 어플리케이션 프로그램(147) 중 적어도 하나에 전자 장치(101)의 시스템 리소스(예: 버스(110), 프로세서(120), 또는 메모리(130) 등)를 사용할 수 있는 우선 순위를 부여할 수 있다. 예컨대, 미들웨어(143)는 상기 적어도 하나에 부여된 우선 순위에 따라 상기 하나 이상의 작업 요청들을 처리함으로써, 상기 하나 이상의 작업 요청들에 대한 스케쥴링 또는 로드 밸런싱 등을 수행할 수 있다.

API(145)는, 예를 들면, 어플리케이션(147)이 커널(141) 또는 미들웨어(143)에서 제공되는 기능을 제어하기 위한 인터페이스로, 예를 들면, 파일 제어, 창 제어, 영상 처리, 또는 문자 제어 등을 위한 적어도 하나의 인터페이스 또는 함수(예: 명령어)를 포함할 수 있다.

입출력 인터페이스(150)는, 예를 들면, 사용자 또는 다른 외부 기기로부터 입력된 명령 또는 데이터를 전자 장치(101)의 다른 구성요소(들)에 전달할 수 있는 인터페이스의 역할을 할 수 있다. 또한, 입출력 인터페이스(150)는 전자 장치(101)의 다른 구성요소(들)로부터 수신된 명령 또는 데이터를 사용자 또는 다른 외부 기기로 출력할 수 있다. 입출력 인터페이스(150)는 터치 입력 장치, 음성 입력부, 다양한 원격 제어 장치 등을 포함할 수 있다. 입출력 인터페이스(150)는 사용자에게 특정 서비스를 제공하기 위한 적어도 하나 이상의 수단일 수 있다. 예를 들어 전달해야 하는 정보가 소리인 경우에는 해당 입출력 인터페이스(150)는 스피커가 될 수 있으며, 텍스트 또는 영상 컨텐츠인 경우에는 디스플레이 장치가 될 수 있다. 또한 사용자가 전자 장치(101)에 근접하지 않은 상황에서 서비스를 제공하기 위하여 출력해야 하는 데이터는 통신 모듈 통하여 적어도 하나 이상의 다른 전자 장치로 전달되어 출력될 수 있으며, 이때 다른 전자 장치는 스피커 또는 다른 디스플레이 장치가 될 수 있다.

디스플레이(160)는, 예를 들면, 액정 디스플레이(liquid crystal display(LCD)), 발광 다이오드(light-emitting diode(LED)) 디스플레이, 유기 발광 다이오드(organic light-emitting diode(OLED)) 디스플레이, 또는 마이크로 전자기계 시스템(microelectromechanical systems(MEMS)) 디스플레이, 또는 전자종이(electronic paper) 디스플레이를 포함할 수 있다. 디스플레이(160)는, 예를 들면, 사용자에게 각종 콘텐츠(예: 텍스트, 이미지, 비디오, 아이콘, 또는 심볼 등)을 표시할 수 있다. 디스플레이(160)는, 터치 스크린을 포함할 수 있으며, 예를 들면, 전자 펜 또는 사용자의 신체의 일부를 이용한 터치, 제스쳐, 근접, 또는 호버링 입력을 수신할 수 있다.

통신 모듈(170)은, 예를 들면, 전자 장치(101)와 외부 장치(예: 제 1 외부 전자 장치(102), 제 2 외부 전자 장치(104), 또는 서버(106)) 간의 통신을 설정할 수 있다. 예를 들면, 통신 모듈(170)은 무선 통신 또는 유선 통신을 통해서 네트워크(162)에 연결되어 외부 장치(예: 제 2 외부 전자 장치(104) 또는 서버(106))와 통신할 수 있다. 상기 통신 모듈(170)은 다른 전자 장치와 적어도 하나 이상의 데이터를 송,수신할 수 있는 수단으로 적어도 하나 이상의 (통신표준),WIFI, Zigbee, Bluetooth, LTE, 3G, IR 등의 프로토콜을 통하여 다른 전자 장치와 통신할 수 있다

무선 통신은, 예를 들면, 셀룰러 통신 프로토콜로서, 예를 들면, LTE(long-term evolution), LTE-A(LTE Advance), CDMA(code division multiple access), WCDMA(wideband CDMA), UMTS(universal mobile telecommunications system), WiBro(Wireless Broadband), 또는 GSM(Global System for Mobile Communications) 등 중 적어도 하나를 사용할 수 있다. 또한, 무선 통신은, 예를 들면, 근거리 통신(164)을 포함할 수 있다. 근거리 통신(164)은, 예를 들면, WiFi(wireless fidelity), 블루투스(Bluetooth), NFC(near field communication), 또는 GNSS(global navigation satellite system) 등 중 적어도 하나를 포함할 수 있다. GNSS는 사용 지역 또는 대역폭 등에 따라, 예를 들면, GPS(Global Positioning System), Glonass(Global Navigation Satellite System), Beidou Navigation Satellite System(이하 “Beidou”) 또는 Galileo, the European global satellite-based navigation system 중 적어도 하나를 포함할 수 있다. 이하, 본 문서에서는, “GPS”는 “GNSS”와 혼용되어 사용(interchangeably used)될 수 있다. 유선 통신은, 예를 들면, USB(universal serial bus), HDMI(high definition multimedia interface), RS-232(recommended standard232), 또는 POTS(plain old telephone service) 등 중 적어도 하나를 포함할 수 있다. 네트워크(162)는 통신 네트워크(telecommunications network), 예를 들면, 컴퓨터 네트워크(computer network)(예: LAN 또는 WAN), 인터넷, 또는 전화 망(telephone network) 중 적어도 하나를 포함할 수 있다.

제 1 및 제 2 외부 전자 장치(102, 104) 각각은 전자 장치(101)와 동일한 또는 다른 종류의 장치일 수 있다. 한 실시예에 따르면, 서버(106)는 하나 또는 그 이상의 서버들의 그룹을 포함할 수 있다. 다양한 실시예에 따르면, 전자 장치(101)에서 실행되는 동작들의 전부 또는 일부는 다른 하나 또는 복수의 전자 장치(예: 전자 장치(102,104), 또는 서버(106)에서 실행될 수 있다. 한 실시예에 따르면, 전자 장치(101)가 어떤 기능이나 서비스를 자동으로 또는 요청에 의하여 수행해야 할 경우에, 전자 장치(101)는 기능 또는 서비스를 자체적으로 실행시키는 대신에 또는 추가적으로, 그와 연관된 적어도 일부 기능을 다른 장치(예: 전자 장치(102, 104), 또는 서버(106))에게 요청할 수 있다. 다른 전자 장치(예: 전자 장치(102, 104), 또는 서버(106))는 요청된 기능 또는 추가 기능을 실행하고, 그 결과를 전자 장치(101)로 전달할 수 있다. 전자 장치(101)는 수신된 결과를 그대로 또는 추가적으로 처리하여 요청된 기능이나 서비스를 제공할 수 있다. 이를 위하여, 예를 들면, 클라우드 컴퓨팅, 분산 컴퓨팅, 또는 클라이언트-서버 컴퓨팅 기술이 이용될 수 있다.

도 1b는 본 발명의 다양한 실시예에 따른 구현예를 설명하기 위한 개념도를 도시한다.

도 1b에 도시된 바와 같이, 전자 장치(101)는 로봇의 형태로 구현될 수 있다. 전자 장치(101)는 헤드(head)부(190) 및 바디(body)부(193)를 포함할 수 있다. 헤드부(190)는 바디부(193)의 상측에 배치될 수 있다. 헤드부(190) 및 바디부(193)는, 하나의 실시예에서 사람의 헤드와 바디에 대응되는 형상으로 구현될 수 있다. 예를 들어, 헤드부(190)는 사람의 얼굴의 형상에 대응되도록 하는 전면 커버(161)를 포함할 수 있다. 전자 장치(101)는 전면 커버(161)에 대응되는 위치에 배치되는 디스플레이(160)를 포함할 수 있다. 예를 들어, 디스플레이(160)는 전면 커버(161)의 내측에 배치될 수 있으며, 이 경우에 전면 커버(161)는 투명 재질 또는 반투명 재질로 구성될 수 있다. 또는, 전면 커버(161)는 임의의 화면을 디스플레이할 수 있는 소자일 수도 있으며, 이 경우에 전면 커버(161) 및 디스플레이(160)는 하나의 하드웨어로 구현될 수도 있다. 전면 커버(161)는 사용자와 인터랙션하는 방향을 나타내는 곳으로 이미지 센싱을 위한 적어도 하나이상의 다양한 센서와, 음성을 취득하기 위한 적어도 하나 이상의 마이크, 기구적인 눈 구조, 화면 출력을 위한 디스플레이 일 수 있으며, 방향 구분이 되지 않는 형태에서는 불빛 또는 일시적인 기구 변경을 통하여 표시 할 수도 있으며, 사용자와 인터랙션 할 때 사용자 방향으로 향하는 적어도 하나 이상의 H/W 또는 기구 구조를 포함할 수 있다.

헤드부(190)는 통신 모듈(170) 및 센서(171)를 더 포함할 수도 있다. 통신 모듈(170)은 송신 장치로부터 메시지를 수신할 수 있으며, 수신 장치로 변환된 메시지를 송신할 수도 있다. 다른 실시예에서는, 통신 모듈(170)이 마이크로 구현될 수도 있으며, 이 경우에는 사용자로부터의 음성을 수신할 수도 있다. 또 다른 실시예에서는, 통신 모듈(170)은 스피커로 구현될 수도 있으며, 이 경우에는 변환된 메시지를 음성으로 출력할 수도 있다.

센서(171)는 외부 환경에 대한 적어도 하나의 정보를 획득할 수 있다. 예를 들어, 센서(171)는 카메라로 구현될 수도 있으며, 이 경우에는 외부 환경을 촬영할 수 있다. 전자 장치(101)는 촬영 결과에 따라 수신자를 식별할 수도 있다. 센서(171)는 전자 장치(101)에 수신자가 근접함을 센싱할 수 있다. 센서(171)는 근접 정보에 따라 수신자의 근접을 센싱할 수도 있으며, 또는 수신자가 이용하는 전자 장치로부터의 신호에 기초하여 수신자의 근접을 센싱할 수도 있다. 뿐만 아니라, 센서(171)는 사용자의 행동, 위치를 센싱할 수도 있다.

구동부(191)는 헤드부(190)를 움직이게 할 수 있는 적어도 하나의 모터를 포함할 수 있으며, 예를 들어 헤드부(190)의 방향을 변경할 수 있다. 이동 및 다른 구성 요소를 기구적으로 변경하기 위하여 사용될 수 있다. 또한 구동부(191)의 형태는 적어도 하나 이상의 축을 중심으로 하여 상,하 또는 좌,우의 움직임이 가능한 형태일 수 있으며, 그 형태는 다양하게 구현될 수 있다. 전원부(192)는 전자 장치(101)가 이용하는 전원을 공급할 수 있다.

프로세서(120)는 송신자로부터의 메시지를 통신 모듈(170) 또는 센서(171)를 통하여 획득할 수 있다. 프로세서(120)는 적어도 하나의 메시지 분석 모듈을 포함할 수 있다. 적어도 하나의 메시지 분석 모듈은 발신자가 생성한 메시지에서 수신자에게 전달 하고자 하는 주요 내용을 추출하거나 또는 내용을 분류(classify)할 수 있다.

메모리(130)는 사용자에게 서비스를 제공하는 것과 관련된 정보를 영속적 또는 일시적으로 저장할 수 있는 저장소로, 상기 전자 장치의 내부에 존재할 수 있으며, 또는 네트워크를 통하여, 클라우드 또는 다른 서버에 존재할 수 있다. 상기 메모리(130)에는 사용자 인증을 위한 개인 정보 또는 사용자에게 서비스를 제공하는 방식에 관련된 속성 관련 정보 또는 전자 장치(101)와 인터랙션 할 수 있는 다양한 수단들 간에 관계를 파악할 수 있는 정보가 저장될 수 있다. 이때의 관계 정보는 전자 장치(101)의 사용에 따라 정보가 갱신 또는 학습되어 변경될 수도 있다. 프로세서(120)는 전자 장치(101)의 통제를 담당하며, 센서(171), 입출력 인터페이스(150), 통신 모듈(170) 및 메모리(130)를 기능적으로 제어하여 사용자에게 서비스를 제공할 수 있게 한다. 또한 상기 프로세서(120) 또는 메모리(130)의 적어도 일부분에 전자 장치(101)가 획득할 수 있는 정보를 판단할 수 있는 정보 판단부가 포함될 수 있으며, 이 때 정보 판단부는 센서(171) 또는 통신 모듈(170)을 통하여 획득한 정보에서 서비스를 위한 적어도 하나 이상의 데이터를 추출할 수도 있다.

한편, 전자 장치(101)가 로봇 형태로 구현된다는 것은 단순히 예시적인 것이며, 그 구현 형태에는 제한이 없다. 예를 들어, 전자 장치(101)는 로봇 하나의 개체로 형성되는 스탠드얼론(Standalone) 타입으로 구현될 수 있다. 전자 장치(101)는 태블릿 PC 또는 스마트폰을 고정시키는 도킹 스테이션(docking station) 타입으로 구현될 수도 있다. 또한, 전자 장치(101)는 이동성 여부에 따라서 고정/이동형 타입으로 구분될 수도 있으며, 이동형 타입에는 바퀴(wheel)를 이용한 이동형 타입, 캐터필러(caterpillar)를 이용한 이동형 타입, 다리 움직임(leg moving)을 이용한 이동형 타입(2족, 4족 모두 포함), 날아다니는(flying) 이동형 타입이 있을 수 있다.

전자 장치(101)는 외부 음성을 음성 데이터로 처리하는 마이크(미도시) 및 사용자 모션을 센싱하는 센서(미도시)를 더 포함할 수도 있다. 통신 모듈(170)은 다른 전자 장치와 통신 세션을 형성할 수 있다. 본 발명의 다양한 실시예에서, 메모리(130)는 실행시에 상기 프로세서(120)가, 상기 센싱된 사용자 모션에 대응하는 모션 데이터를 생성하고, 상기 음성 데이터 및 상기 모션 데이터를 시간적으로 동기화하여, 상기 통신 세션을 통하여, 상기 다른 전자 장치로 송신하는 인스트럭션을 저장할 수 있다.

본 발명의 다양한 실시예에서, 메모리(130)는 실행시에 상기 프로세서(120)가, 상기 음성 데이터 및 상기 모션 데이터를 기설정된 프로토콜에 따라 합성한 합성 데이터를 생성하고, 상기 합성 데이터를 상기 통신 세션을 통하여, 상기 다른 전자 장치로 송신하는 인스트럭션을 저장할 수 있다.

본 발명의 다양한 실시예에서, 상기 모션 데이터는, 상기 다른 전자 장치에 포함된 적어도 하나의 모터를 구동하기 위한 정보를 포함할 수 있다. 상기 모션 데이터는, 모터 식별 정보, 구동 시간, 구동 방향, 구동 정도 및 구동 속도 중 적어도 하나를 포함할 수 있다. 상기 모션 데이터는, 모터 식별 정보, 구동 시간, 구동 방향, 구동 정도 및 구동 속도 중 적어도 하나에 대응하는 파라미터를 포함하며, 상기 다른 전자 장치는, 상기 파라미터에 대응하는 모터 식별 정보, 구동 시간, 구동 방향, 구동 정도 및 구동 속도 중 적어도 하나를 이용하여, 상기 다른 전장지에 포함된 적어도 하나의 모터를 구동할 수 있다.

본 발명의 다양한 실시예에서, 메모리(130)는 실행시에 상기 프로세서(120)가, 상기 다른 전자 장치의 캐퍼빌리티 정보를 획득하고, 상기 캐퍼빌리티 정보에 기초하여, 상기 모션 데이터를 생성하는 인스트럭션을 저장할 수 있다. 상기 캐퍼빌리티 정보는, 상기 다른 전자 장치의 물리적 정보, 성장 모델 및 관계 모델 중 적어도 하나를 포함할 수 있다.

본 발명의 다양한 실시예에서, 전자 장치(101)는 카메라를 더 포함할 수 있으며, 메모리(130)는 실행시에 상기 프로세서(120)가, 영상 통화를 수행할지 또는 모션 통화를 수행할지 여부를 선택받고, 상기 영상 통화가 선택된 경우에는, 상기 카메라로부터 출력되는 이미지를 상기 음성 데이터와 시간적으로 동기화하여 상기 다른 전자 장치로 송신하고, 상기 모션 통화가 선택된 경우에는, 상기 모션 데이터를 상기 음성 데이터와 시간적으로 동기화하여 상기 다른 전자 장치로 송신하는 인스트럭션을 저장할 수 있다.

본 발명의 다양한 실시예에서, 전자 장치(101)는 적어도 하나의 모터; 및 스피커를 더 포함하고, 메모리(130)는 실행시에 상기 프로세서(120)가, 상기 다른 전자 장치로부터 다른 전자 장치의 모션 데이터 및 다른 전자 장치의 음성 데이터를 획득하고, 상기 다른 전자 장치의 모션 데이터에 기초하여, 상기 적어도 하나의 모터를 구동하며, 상기 다른 전자 장치의 음성 데이터를 상기 스피커를 통하여 출력하는 인스트럭션을 저장할 수 있다.

본 발명의 다양한 실시예에서, 상기 메모리(130)는, 이벤트 및 상기 이벤트에 대응하는 모션 데이터 사이의 연관 정보를 저장하고, 실행시에 상기 프로세서(120)가, 상기 이벤트를 검출하면, 상기 이벤트에 대응하는 모션 데이터를 반영하여 상기 모션 데이터를 생성하는 인스트럭션을 저장할 수 있다.

본 발명의 다양한 실시예에서, 상기 메모리(130)는, 사용자 및 상기 사용자에 대응하는 모션 데이터 사이의 연관 정보를 저장하고, 실행시에 상기 프로세서(120)가, 상기 사용자를 식별하고, 상기 식별된 사용자에 대응하는 모션 데이터를 반영하여 상기 모션 데이터를 생성하는 인스트럭션을 저장할 수 있다.

도 2a는 다양한 실시예에 따른 전자 장치(201)의 블록도이다. 전자 장치(201)는, 예를 들면, 도 1에 도시된 전자 장치(101)의 전체 또는 일부를 포함할 수 있다. 전자 장치(201)는 하나 이상의 프로세서(예: AP(application processor))(210), 통신 모듈(220), 가입자 식별 모듈(224), 메모리(230), 센서 모듈(240), 입력 장치(250), 디스플레이(260), 인터페이스(270), 오디오 모듈(280), 카메라 모듈(291), 전력 관리 모듈(295), 배터리(296), 인디케이터(297), 및 모터(298) 를 포함할 수 있다.

프로세서(210)는, 예를 들면, 운영 체제 또는 응용 프로그램을 구동하여 프로세서(210)에 연결된 다수의 하드웨어 또는 소프트웨어 구성요소들을 제어할 수 있고, 각종 데이터 처리 및 연산을 수행할 수 있다. 프로세서(210)는, 예를 들면, SoC(system on chip) 로 구현될 수 있다. 한 실시예에 따르면, 프로세서(210)는 GPU(graphic processing unit) 및/또는 이미지 신호 프로세서(image signal processor)를 더 포함할 수 있다. 프로세서(210)는 도 2a에 도시된 구성요소들 중 적어도 일부(예: 셀룰러 모듈(221))를 포함할 수도 있다. 프로세서(210) 는 다른 구성요소들(예: 비휘발성 메모리) 중 적어도 하나로부터 수신된 명령 또는 데이터를 휘발성 메모리에 로드(load)하여 처리하고, 다양한 데이터를 비휘발성 메모리에 저장(store)할 수 있다.

통신 모듈(220)은, 도 1의 통신 모듈(170)과 동일 또는 유사한 구성을 가질 수 있다. 통신 모듈(220)은, 예를 들면, 셀룰러 모듈(221), WiFi 모듈(223), 블루투스 모듈(225), GNSS 모듈(227)(예: GPS 모듈, Glonass 모듈, Beidou 모듈, 또는 Galileo 모듈), NFC 모듈(228) 및 RF(radio frequency) 모듈(229)를 포함할 수 있다.

셀룰러 모듈(221)은, 예를 들면, 통신망을 통해서 음성 통화, 영상 통화, 문자 서비스, 또는 인터넷 서비스 등을 제공할 수 있다. 한 실시예에 따르면, 셀룰러 모듈(221)은 가입자 식별 모듈(예: SIM 카드)(224)을 이용하여 통신 네트워크 내에서 전자 장치(201)의 구별 및 인증을 수행할 수 있다. 한 실시예에 따르면, 셀룰러 모듈(221)은 프로세서(210)가 제공할 수 있는 기능 중 적어도 일부 기능을 수행할 수 있다. 한 실시예에 따르면, 셀룰러 모듈(221)은 커뮤니케이션 프로세서(CP: communication processor)를 포함할 수 있다.

WiFi 모듈(223), 블루투스 모듈(225), GNSS 모듈(227) 또는 NFC 모듈(228) 각각은, 예를 들면, 해당하는 모듈을 통해서 송수신되는 데이터를 처리하기 위한 프로세서를 포함할 수 있다. 어떤 실시예에 따르면, 셀룰러 모듈(221), WiFi 모듈(223), 블루투스 모듈(225), GNSS 모듈(227) 또는 NFC 모듈(228) 중 적어도 일부(예: 두 개 이상)는 하나의 integrated chip(IC) 또는 IC 패키지 내에 포함될 수 있다.

RF 모듈(229)은, 예를 들면, 통신 신호(예: RF 신호)를 송수신할 수 있다. RF 모듈(229)은, 예를 들면, 트랜시버(transceiver), PAM(power amp module), 주파수 필터(frequency filter), LNA(low noise amplifier), 또는 안테나 등을 포함할 수 있다. 다른 실시예에 따르면, 셀룰러 모듈(221), WiFi 모듈(223), 블루투스 모듈(225), GNSS 모듈(227) 또는 NFC 모듈(228) 중 적어도 하나는 별개의 RF 모듈을 통하여 RF 신호를 송수신할 수 있다.

가입자 식별 모듈(224)은, 예를 들면, 가입자 식별 모듈을 포함하는 카드 및/또는 내장 SIM(embedded SIM)을 포함할 수 있으며, 고유한 식별 정보(예: ICCID(integrated circuit card identifier)) 또는 가입자 정보(예: IMSI(international mobile subscriber identity))를 포함할 수 있다.

메모리(230)(예: 메모리(130))는, 예를 들면, 내장 메모리(232) 또는 외장 메모리(234)를 포함할 수 있다. 내장 메모리(232)는, 예를 들면, 휘발성 메모리(예: DRAM(dynamic RAM), SRAM(static RAM), 또는 SDRAM(synchronous dynamic RAM) 등), 비휘발성 메모리(non-volatile Memory)(예: OTPROM(one time programmable ROM), PROM(programmable ROM), EPROM(erasable and programmable ROM), EEPROM(electrically erasable and programmable ROM), mask ROM, flash ROM, 플래시 메모리(예: NAND flash 또는 NOR flash 등), 하드 드라이브, 또는 솔리드 스테이트 드라이브(solid state drive(SSD)) 중 적어도 하나를 포함할 수 있다.

외장 메모리(234)는 플래시 드라이브(flash drive), 예를 들면, CF(compact flash), SD(secure digital), Micro-SD(micro secure digital), Mini-SD(mini secure digital), xD(extreme digital), MMC(multi-media card) 또는 메모리 스틱(memory stick) 등을 더 포함할 수 있다. 외장 메모리(234)는 다양한 인터페이스를 통하여 전자 장치(201)와 기능적으로 및/또는 물리적으로 연결될 수 있다.

센서 모듈(240)은, 예를 들면, 물리량을 계측하거나 전자 장치(201)의 작동 상태를 감지하여, 계측 또는 감지된 정보를 전기 신호로 변환할 수 있다. 센서 모듈(240)은, 예를 들면, 제스처 센서(240A), 자이로 센서(240B), 기압 센서(240C), 마그네틱 센서(240D), 가속도 센서(240E), 그립 센서(240F), 근접 센서(240G), 컬러(color) 센서(240H)(예: RGB(red, green, blue) 센서), 생체 센서(240I), 온/습도 센서(240J), 조도 센서(240K), 또는 UV(ultra violet) 센서(240M) 중의 적어도 하나를 포함할 수 있다. 추가적으로 또는 대체적으로(additionally or alternatively), 센서 모듈(240)은, 예를 들면, 후각 센서(E-nose sensor), EMG 센서(electromyography sensor), EEG 센서(electroencephalogram sensor), ECG 센서(electrocardiogram sensor), IR(infrared) 센서, 홍채 센서 및/또는 지문 센서를 포함할 수 있다. 센서 모듈(240)은 그 안에 속한 적어도 하나 이상의 센서들을 제어하기 위한 제어 회로를 더 포함할 수 있다. 어떤 실시예에서는, 전자 장치(201)는 프로세서(210)의 일부로서 또는 별도로, 센서 모듈(240)을 제어하도록 구성된 프로세서를 더 포함하여, 프로세서(210)가 슬립(sleep) 상태에 있는 동안, 센서 모듈(240)을 제어할 수 있다.

입력 장치(250)는, 예를 들면, 터치 패널(touch panel)(252),(디지털) 펜 센서(pen sensor)(254), 키(key)(256), 또는 초음파(ultrasonic) 입력 장치(258)를 포함할 수 있다. 터치 패널(252)은, 예를 들면, 정전식, 감압식, 적외선 방식, 또는 초음파 방식 중 적어도 하나의 방식을 사용할 수 있다. 또한, 터치 패널(252)은 제어 회로를 더 포함할 수도 있다. 터치 패널(252)은 택타일 레이어(tactile layer)를 더 포함하여, 사용자에게 촉각 반응을 제공할 수 있다.

(디지털) 펜 센서(254)는, 예를 들면, 터치 패널의 일부이거나, 별도의 인식용 쉬트(sheet)를 포함할 수 있다. 키(256)는, 예를 들면, 물리적인 버튼, 광학식 키, 또는 키패드를 포함할 수 있다. 초음파 입력 장치(258)는 마이크(예: 마이크(288))를 통해, 입력 도구에서 발생된 초음파를 감지하여, 상기 감지된 초음파에 대응하는 데이터를 확인할 수 있다.

디스플레이(260)(예: 디스플레이(160))는 패널(262), 홀로그램 장치(264), 또는 프로젝터(266)를 포함할 수 있다. 패널(262)은, 도 1의 디스플레이(160)와 동일 또는 유사한 구성을 포함할 수 있다. 패널(262)은, 예를 들면, 유연하게(flexible), 투명하게(transparent), 또는 착용할 수 있게(wearable) 구현될 수 있다. 패널(262)은 터치 패널(252)과 하나의 모듈로 구성될 수도 있다. 홀로그램 장치(264)는 빛의 간섭을 이용하여 입체 영상을 허공에 보여줄 수 있다. 프로젝터(266)는 스크린에 빛을 투사하여 영상을 표시할 수 있다. 스크린은, 예를 들면, 전자 장치(201)의 내부 또는 외부에 위치할 수 있다. 한 실시예에 따르면, 디스플레이(260)는 패널(262), 홀로그램 장치(264), 또는 프로젝터(266)를 제어하기 위한 제어 회로를 더 포함할 수 있다.

인터페이스(270)는, 예를 들면, HDMI(high-definition multimedia interface)(272), USB(universal serial bus)(274), 광 인터페이스(optical interface)(276), 또는 D-sub(D-subminiature)(278)를 포함할 수 있다. 인터페이스(270)는, 예를 들면, 도 1에 도시된 통신 모듈(170)에 포함될 수 있다. 추가적으로 또는 대체적으로(additionally and alternatively), 인터페이스(270)는, 예를 들면, MHL(mobile high-definition link) 인터페이스, SD(secure digital) 카드/MMC(multi-media card) 인터페이스, 또는 IrDA(infrared data association) 규격 인터페이스를 포함할 수 있다.

오디오 모듈(280)은, 예를 들면, 소리(sound)와 전기 신호를 쌍방향으로 변환시킬 수 있다. 오디오 모듈(280)의 적어도 일부 구성요소는, 예를 들면, 도 1 에 도시된 입출력 인터페이스(150)에 포함될 수 있다. 오디오 모듈(280)은, 예를 들면, 스피커(282), 리시버(284), 이어폰(286), 또는 마이크(288) 등을 통해 입력 또는 출력되는 소리 정보를 처리할 수 있다.

카메라 모듈(291)은, 예를 들면, 정지 영상 및 동영상을 촬영할 수 있는 장치로서, 한 실시예에 따르면, 하나 이상의 이미지 센서(예: 전면 센서 또는 후면 센서), 렌즈, ISP(image signal processor), 또는 플래시(flash)(예: LED 또는 xenon lamp 등)를 포함할 수 있다.

전력 관리 모듈(295)은, 예를 들면, 전자 장치(201)의 전력을 관리할 수 있다. 한 실시예에 따르면, 전력 관리 모듈(295)은 PMIC(power management integrated circuit), 충전 IC(charger integrated circuit), 또는 배터리 또는 연료 게이지(battery or fuel gauge)를 포함할 수 있다. PMIC는, 유선 및/또는 무선 충전 방식을 가질 수 있다. 무선 충전 방식은, 예를 들면, 자기공명 방식, 자기유도 방식 또는 전자기파 방식 등을 포함하며, 무선 충전을 위한 부가적인 회로, 예를 들면, 코일 루프, 공진 회로, 또는 정류기 등을 더 포함할 수 있다. 배터리 게이지는, 예를 들면, 배터리(296)의 잔량, 충전 중 전압, 전류, 또는 온도를 측정할 수 있다. 배터리(296)는, 예를 들면, 충전식 전지(rechargeable battery) 및/또는 태양 전지(solar battery)를 포함할 수 있다.

인디케이터(297)는 전자 장치(201) 또는 그 일부(예: 프로세서(210))의 특정 상태, 예를 들면, 부팅 상태, 메시지 상태 또는 충전 상태 등을 표시할 수 있다. 모터(298)는 전기적 신호를 기계적 진동으로 변환할 수 있고, 진동(vibration), 또는 햅틱(haptic) 효과 등을 발생시킬 수 있다. 도시되지는 않았으나, 전자 장치(201)는 모바일 TV 지원을 위한 처리 장치(예: GPU)를 포함할 수 있다. 모바일 TV 지원을 위한 처리 장치는, 예를 들면, DMB(digital multimedia broadcasting), DVB(digital video broadcasting), 또는 미디어플로(mediaFloTM) 등의 규격에 따른 미디어 데이터를 처리할 수 있다.

본 문서에서 기술된 구성요소들 각각은 하나 또는 그 이상의 부품(component)으로 구성될 수 있으며, 해당 구성요소의 명칭은 전자 장치의 종류에 따라서 달라질 수 있다. 다양한 실시예에서, 전자 장치는 본 문서에서 기술된 구성요소 중 적어도 하나를 포함하여 구성될 수 있으며, 일부 구성요소가 생략되거나 또는 추가적인 다른 구성요소를 더 포함할 수 있다. 또한, 다양한 실시예에 따른 전자 장치의 구성요소들 중 일부가 결합되어 하나의 개체(entity)로 구성됨으로써, 결합되기 이전의 해당 구성요소들의 기능을 동일하게 수행할 수 있다.

도 2b는 본 발명의 다양한 실시예에 따른 전자 장치의 블록도를 도시한다. 도 2b에 도시된 바와 같이, 프로세서(210)는 영상인식 모듈(241)과 연결될 수 있다. 아울러, 프로세서는 행동 모듈(244)과 연결될 수 있다. 영상인식 모듈(241)은 2차원 카메라(242) 및 뎁스 카메라(243) 중 적어도 하나를 포함할 수 있다. 영상 인식 모듈(241)은 촬영 결과를 기초로 인식을 수행할 수 있으며, 인식 결과를 프로세서(210)에게 전달할 수 있다. 행동 모듈(244)는 얼굴 표정 모터(245), 바디 포즈 모터(245) 및 이동 모터(247) 중 적어도 하나를 포함할 수 있다. 프로세서(210)는 얼굴 표정 모터(245), 바디 포즈 모터(246) 및 이동 모터(247) 중 적어도 하나를 제어하여, 로봇 형태로 구현된 전자 장치(101)의 움직임을 제어할 수 있다. 전자 장치(101)는 도 2a의 구성 요소에 추가적으로 도 2b의 구성 요소를 포함할 수도 있다.

도 3은 다양한 실시예에 따른 프로그램 모듈의 블록도이다. 한 실시예에 따르면, 프로그램 모듈(310)(예: 프로그램(140))은 전자 장치(예: 전자 장치(101))에 관련된 자원을 제어하는 운영 체제(operating system(OS)) 및/또는 운영 체제 상에서 구동되는 다양한 어플리케이션(예: 어플리케이션 프로그램(147))을 포함할 수 있다. 운영 체제는, 예를 들면, 안드로이드(android), iOS, 윈도우즈(windows), 심비안(symbian), 타이젠(tizen), 또는 바다(bada) 등이 될 수 있다.

프로그램 모듈(310)은 커널(320), 미들웨어(330), 어플리케이션 프로그래밍 인터페이스(application programming interface (API))(360), 및/또는 어플리케이션(370)을 포함할 수 있다. 프로그램 모듈(310)의 적어도 일부는 전자 장치 상에 프리로드(preload) 되거나, 외부 전자 장치(예: 전자 장치(102, 104), 서버(106) 등)로부터 다운로드(download) 가능하다.

커널(320)(예: 커널(141))은, 예를 들면, 시스템 리소스 매니저(321) 및/또는 디바이스 드라이버(323)를 포함할 수 있다. 시스템 리소스 매니저(321)는 시스템 리소스의 제어, 할당, 또는 회수 등을 수행할 수 있다. 한 실시예에 따르면, 시스템 리소스 매니저(321)는 프로세스 관리부, 메모리 관리부, 또는 파일 시스템 관리부 등을 포함할 수 있다. 디바이스 드라이버(323)는, 예를 들면, 디스플레이 드라이버, 카메라 드라이버, 블루투스 드라이버, 공유 메모리 드라이버, USB 드라이버, 키패드 드라이버, WiFi 드라이버, 오디오 드라이버, 또는 IPC(inter-process communication) 드라이버를 포함할 수 있다.

미들웨어(330)는, 예를 들면, 어플리케이션(370)이 공통적으로 필요로 하는 기능을 제공하거나, 어플리케이션(370)이 전자 장치 내부의 제한된 시스템 자원을 효율적으로 사용할 수 있도록 API(360)를 통해 다양한 기능들을 어플리케이션(370)으로 제공할 수 있다. 한 실시예에 따르면, 미들웨어(330)(예: 미들웨어(143))는 런타임 라이브러리(335), 어플리케이션 매니저(application manager)(341), 윈도우 매니저(window manager)(342), 멀티미디어 매니저(multimedia manager)(343), 리소스 매니저(resource manager)(344), 파워 매니저(power manager)(345), 데이터베이스 매니저(database manager)(346), 패키지 매니저(package manager)(347), 연결 매니저(connectivity manager)(348), 통지 매니저(notification manager)(349), 위치 매니저(location manager)(350), 그래픽 매니저(graphic manager)(351), 또는 보안 매니저(security manager)(352) 중 적어도 하나를 포함할 수 있다.

런타임 라이브러리(335)는, 예를 들면, 어플리케이션(370)이 실행되는 동안에 프로그래밍 언어를 통해 새로운 기능을 추가하기 위해 컴파일러가 사용하는 라이브러리 모듈을 포함할 수 있다. 런타임 라이브러리(335)는 입출력 관리, 메모리 관리, 또는 산술 함수에 대한 기능 등을 수행할 수 있다.

어플리케이션 매니저(341)는, 예를 들면, 어플리케이션(370) 중 적어도 하나의 어플리케이션의 생명 주기(life cycle)를 관리할 수 있다. 윈도우 매니저(342)는 화면에서 사용하는 GUI 자원을 관리할 수 있다. 멀티미디어 매니저(343)는 다양한 미디어 파일들의 재생에 필요한 포맷을 파악하고, 해당 포맷에 맞는 코덱(codec)을 이용하여 미디어 파일의 인코딩(encoding) 또는 디코딩(decoding)을 수행할 수 있다. 리소스 매니저(344)는 어플리케이션(370) 중 적어도 어느 하나의 어플리케이션의 소스 코드, 메모리 또는 저장 공간 등의 자원을 관리할 수 있다.

파워 매니저(345)는, 예를 들면, 바이오스(BIOS: basic input/output system) 등과 함께 동작하여 배터리(battery) 또는 전원을 관리하고, 전자 장치의 동작에 필요한 전력 정보 등을 제공할 수 있다. 데이터베이스 매니저(346)는 어플리케이션(370) 중 적어도 하나의 어플리케이션에서 사용할 데이터베이스를 생성, 검색, 또는 변경할 수 있다. 패키지 매니저(347)는 패키지 파일의 형태로 배포되는 어플리케이션의 설치 또는 업데이트를 관리할 수 있다.

연결 매니저(348)는, 예를 들면, WiFi 또는 블루투스 등의 무선 연결을 관리할 수 있다. 통지 매니저(349)는 도착 메시지, 약속, 근접성 알림 등의 사건(event)을 사용자에게 방해되지 않는 방식으로 표시 또는 통지할 수 있다. 위치 매니저(350)는 전자 장치의 위치 정보를 관리할 수 있다. 그래픽 매니저(351)는 사용자에게 제공될 그래픽 효과 또는 이와 관련된 사용자 인터페이스를 관리할 수 있다. 보안 매니저(352)는 시스템 보안 또는 사용자 인증 등에 필요한 제반 보안 기능을 제공할 수 있다. 한 실시예에 따르면, 전자 장치(예: 전자 장치(101))가 전화 기능을 포함한 경우, 미들웨어(330)는 전자 장치의 음성 또는 영상 통화 기능을 관리하기 위한 통화 매니저(telephony manager)를 더 포함할 수 있다.

미들웨어(330)는 전술한 구성요소들의 다양한 기능의 조합을 형성하는 미들웨어 모듈을 포함할 수 있다. 미들웨어(330)는 차별화된 기능을 제공하기 위해 운영 체제의 종류 별로 특화된 모듈을 제공할 수 있다. 또한, 미들웨어(330)는 동적으로 기존의 구성요소를 일부 삭제하거나 새로운 구성요소들을 추가할 수 있다.

API(360)(예: API(145))는, 예를 들면, API 프로그래밍 함수들의 집합으로, 운영 체제에 따라 다른 구성으로 제공될 수 있다. 예를 들면, 안드로이드 또는 iOS의 경우, 플랫폼 별로 하나의 API 셋을 제공할 수 있으며, 타이젠(tizen)의 경우, 플랫폼 별로 두 개 이상의 API 셋을 제공할 수 있다.

어플리케이션(370)(예: 어플리케이션 프로그램(147))은, 예를 들면, 홈(371), 다이얼러(372), SMS/MMS(373), IM(instant message)(374), 브라우저(375), 카메라(376), 알람(377), 컨택트(378), 음성 다이얼(379), 이메일(380), 달력(381), 미디어 플레이어(382), 앨범(383), 또는 시계(384), 건강 관리(health care)(예: 운동량 또는 혈당 등을 측정), 또는 환경 정보 제공(예: 기압, 습도, 또는 온도 정보 등을 제공) 등의 기능을 수행할 수 있는 하나 이상의 어플리케이션을 포함할 수 있다.

한 실시예에 따르면, 어플리케이션(370)은 전자 장치(예: 전자 장치(101))와 외부 전자 장치(예: 전자 장치(102, 104)) 사이의 정보 교환을 지원하는 어플리케이션(이하, 설명의 편의 상, "정보 교환 어플리케이션")을 포함할 수 있다. 정보 교환 어플리케이션은, 예를 들면, 외부 전자 장치에 특정 정보를 전달하기 위한 알림 전달(notification relay) 어플리케이션, 또는 외부 전자 장치를 관리하기 위한 장치 관리(device management) 어플리케이션을 포함할 수 있다.

예를 들면, 알림 전달 어플리케이션은 전자 장치의 다른 어플리케이션(예: SMS/MMS 어플리케이션, 이메일 어플리케이션, 건강 관리 어플리케이션, 또는 환경 정보 어플리케이션 등)에서 발생된 알림 정보를 외부 전자 장치(예: 전자 장치(102, 104))로 전달하는 기능을 포함할 수 있다. 또한, 알림 전달 어플리케이션은, 예를 들면, 외부 전자 장치로부터 알림 정보를 수신하여 사용자에게 제공할 수 있다.

장치 관리 어플리케이션은, 예를 들면, 전자 장치와 통신하는 외부 전자 장치(예: 전자 장치(102, 104))의 적어도 하나의 기능(예: 외부 전자 장치 자체(또는, 일부 구성 부품)의 턴-온/턴-오프 또는 디스플레이의 밝기(또는, 해상도) 조절), 외부 전자 장치에서 동작하는 어플리케이션 또는 외부 전자 장치에서 제공되는 서비스(예: 통화 서비스 또는 메시지 서비스 등)를 관리(예: 설치, 삭제, 또는 업데이트)할 수 있다.

한 실시예에 따르면, 어플리케이션(370)은 외부 전자 장치(예: 전자 장치(102, 104))의 속성(에 따라 지정된 어플리케이션(예: 모바일 의료 기기의 건강 관리 어플리케이션 등)을 포함할 수 있다. 한 실시예에 따르면, 어플리케이션(370)은 외부 전자 장치(예: 서버(106) 또는 전자 장치(102, 104))로부터 수신된 어플리케이션을 포함할 수 있다. 한 실시예에 따르면, 어플리케이션(370)은 프리로드 어플리케이션(preloaded application) 또는 서버로부터 다운로드 가능한 제3자 어플리케이션(third party application)을 포함할 수 있다. 도시된 실시예에 따른 프로그램 모듈(310)의 구성요소들의 명칭은 운영 체제의 종류에 따라서 달라질 수 있다.

도 4는 본 발명의 다양한 실시예에 따른 전자 장치가 이용하는 소프트웨어를 설명하기 위한 블록도를 도시한다.

운영체제(410)는 전자 장치(101)의 리소스 분배 및 잡스케쥴링 프로세스 처리 등 일반적인 운영체제의 역할을 함과 동시에 다양한 하드웨어 장치(402,403,404,405,406)들을 제어하고 하드웨어 장치(402,403,404,405,406)에서 입력된 신호들을 처리할 수 있다.

미들웨어(430)는 신호 처리된 데이터를 이용하여, 사용자의 3D 제스처 인식 (431), 사용자의 얼굴 위치를 검출하고 추적하거나 얼굴 인식을 통한 인증을 수행(432), 센서 정보 처리(433), 대화 엔진 구동(434), 음성 합성(435), 오디오 신호에 대한 입력 위치 추적(DOA, Direct of Arrival)(436), 음성 인식(437)를 수행할 수 있다.

지능 프레임 워크(450)는 멀티모달 융합 블록(451), 사용자 패턴학습 블록(452), 행동제어블록(453)을 포함할 수 있다. 멀티모달 융합 블록(451)은 미들웨어(430)에서 처리된 각종 정보를 취합하고 관리할 수 있다. 사용자 패턴 학습 블록(452)은 멀티 모달 융합 모듈 정보를 이용하여 사용자의 생활 패턴, 선호도 등의 유의미한 정보를 추출하고 학습할 수 있다. 행동제어블록(453)은 전자장치(101)가 사용자에게 피드백할 정보를 전자장치의 움직임(movement), 그래픽(graphics), 빛(Lighting), 음성, 응답, 소리(speech,audio) 등으로 표현할 수 있다. 모터(460)는 움직임을 표현하며, 디스플레이(470)는 그래픽, 빛을 표현하며, 스피커(480)는 음성, 응답, 소리를 표현할 수 있다.

데이터베이스(420)는 지능 프레임 워크(450)에서 학습한 정보를 사용자에 따라 저장할 수 있다. 데이터베이스(420)는 사용자 모델 데이터베이스와 전자 장치의 행동제어를 위한 모션 데이터 데이터베이스 및 기타 정보를 저장하는 저장소로 구성될 수 있다. 데이터베이스(420)내의 정보들은 다른 전자 장치(401)와 공유될 수 있다.

도 5는 본 발명과의 비교를 위한 비교예에 따른 전자 장치의 동작을 설명하기 위한 개념도를 도시한다.

도 5에 도시된 바와 같이, 제 1 전자 장치(101-1)는 제 1 사용자(501)를 카메라 모듈 등을 통하여 촬영할 수 있다. 제 1 전자 장치(101-1)는 아울러 제 1 사용자(501)로부터의 음성을 마이크 등을 통하여 획득할 수 있다. 제 2 전자 장치(101-2)는 제 2 사용자(502)를 카메라 모듈 등을 통하여 촬영할 수 있다. 제 2 전자 장치(101-2)는 아울러 제 2 사용자(502)로부터의 음성을 마이크 등을 통하여 획득할 수 있다. 제 1 전자 장치(101-1) 및 제 2 전자 장치(101-2)는 통신 세션(communication session)을 형성(form)할 수 있다.

제 1 전자 장치(101-1)는 제 1 사용자(501)를 촬영한 동영상을 구성하는 이미지와, 제 1 사용자(501)로부터 획득한 음성 데이터를 포함하는 정보(510)를 통신 세션을 통하여 제 2 전자 장치(101-2)로 송신할 수 있다. 제 2 전자 장치(101-2)는 제 2 사용자(502)를 촬영한 동영상을 구성하는 이미지와, 제 2 사용자(502)로부터 획득한 음성 데이터를 포함하는 정보(510)를 통신 세션을 통하여 제 1 전자 장치(101-1)로 송신할 수 있다. 제 1 전자 장치(101-1)는 제 2 전자 장치(101-2)로부터 수신된 이미지를 표시하면서, 음성 데이터를 출력할 수 있다. 제 2 전자 장치(101-2)는 제 1 전자 장치(101-1)로부터 수신된 이미지를 표시하면서, 음성 데이터를 출력할 수 있다. 이에 따라, 제 1 사용자(501)는 제 2 사용자(502)의 모습을 보면서 음성을 들을 수 있어, 사실감있는 영상 통화 기능을 제공받을 수 있다.

도 6a 및 6b는 본 발명의 다양한 실시예에 따른 전자 장치의 동작을 설명하기 위한 개념도를 도시한다.

도 6a를 참조하면, 제 1 전자 장치(101-1)는 외부의 이미지(610)를 카메라 모듈 등을 통하여 촬영할 수 있다. 본 발명의 다양한 실시예에서, 제 1 전자 장치(101-1)는 모션 통화가 시작되는 시점에서부터 기설정된 간격으로 외부 환경을 촬영할 수 있으며, 이에 따라 복수 개의 이미지를 획득할 수 있다. 아울러, 제 1 전자 장치(101-1)는 외부의 음성을 마이크 등을 통하여 획득할 수 있다.

제 2 전자 장치(101-2)는 외부의 이미지(620)를 카메라 모듈 등을 통하여 촬영할 수 있다. 본 발명의 다양한 실시예에서, 제 2 전자 장치(101-2)는 모션 통화가 시작되는 시점에서부터 기설정된 간격으로 외부 환경을 촬영할 수 있으며, 이에 따라 복수 개의 이미지를 획득할 수 있다. 아울러, 제 2 전자 장치(101-1)는 외부의 음성을 마이크 등을 통하여 획득할 수 있다.

제 1 전자 장치(101-1) 및 제 2 전자 장치(101-2)는 통신 세션(communication session)을 형성(form)할 수 있다. 여기에서, 통신 세션은 제 1 전자 장치(101-1) 및 제 2 전자 장치(101-2) 사이에 배치된 중계 장치, 예를 들어 AP(access point), 또는 중계 서버 등에 의하여 형성될 수 있다.

제 1 전자 장치(101-1)는 촬영한 복수 개의 이미지(610) 각각에서 사용자를 식별할 수 있다. 예를 들어, 제 1 전자 장치(101-1)는 이미지(610)에 대하여 인물 인식 알고리즘을 적용함으로써, 이미지(610) 각각에서 사용자를 식별할 수 있다. 제 1 전자 장치(101-1)는 복수 개의 이미지(610) 사이의 차이에 기초하여 모션 데이터를 생성할 수 있다.

본 발명의 다양한 실시예에서, 제 1 전자 장치(101-1)는 적외선 조사 장치 및 적외선 센서를 포함할 수 있다. 제 1 전자 장치(101-1)는 적외선을 조사한 후, 반사된 적외선을 센싱할 수 있다. 제 1 전자 장치(101-1)는 반사된 적외선의 세기 또는 세기의 변화량을 측정할 수 있으며, 이를 이용하여 사용자 모션을 추정할 수 있다.

본 발명의 다양한 실시예에서, 제 1 전자 장치(101-1)는 복수 개의 이미지(610) 사이의 차이에 기초하여, 사용자의 모션을 추정할 수 있다. 제 1 전자 장치(101-1)는 추정된 모션에 대응하는 전자 장치의 모션 데이터를 생성할 수 있다. 예를 들어, 제 1 전자 장치(101-1)는 복수 개의 이미지(610)를 분석함으로써, 제 1 전자 장치(101-1)의 외부에 존재하는 사용자가 왼 팔을 입으로 가린다는 사용자의 모션을 추정할 수 있다. 본 발명의 다양한 실시예에서, 제 1 전자 장치(101-1)는 2차원 이미지 분석을 통하여 인체 스켈레톤 변화를 분석하여 사용자의 모션을 추정할 수 있다. 본 발명의 다양한 실시예에서, 제 1 전자 장치(101-1)는 스테레오 카메라(stereo camera)를 포함할 수도 있으며, 스테레오 카메라로부터 인식된 특징점 인식 및 특징점의 이동 정보에 기초하여 사용자의 모션을 추정할 수도 있다. 본 발명의 다양한 실시예에서, 제 1 전자 장치(101-1)는 DVS(Dynamic Vision Sensor)를 포함할 수도 있으며, 2차원 데이터 중 변환된 픽셀 정보를 이용하여 사용자 모션을 추정할 수도 있다.

본 발명의 다양한 실시예에서, 제 1 전자 장치(101-1)는 적외선 센서 및 카메라를 함께 이용하여 사용자 모션을 추정할 수도 있다. 예를 들어, 제 1 전자 장치(101-1)는 structured light camera를 포함할 수도 있으며, 패턴화(patterned)된 적외선을 이용하여 전이(shift)량을 분석함으로써, 사용자 모션을 추정할 수 있다. 또는, 제 1 전자 장치(101-1)는 ToF(time of flight) 카메라를 포함할 수도 있으며, 적외선의 비행(flight) 시간과 반사된 적외선의 위상차를 이용하여 사용자 모션을 추정할 수도 있다.

본 발명의 다양한 실시예에서, 제 1 전자 장치(101-1)는 초음파 센서를 포함할 수도 있으며, 초음파 센서의 측정 데이터를 이용하여 사용자 모션을 추정할 수도 있다. 본 발명의 다양한 실시예에서, 제 1 전자 장치(101-1)는 주위의 RF 신호의 변화를 검출할수도 있으며(예를 들어, AllseeTM, Wi-seeTM), 검출된 RF 신호의 변화에 기초하여 사용자 모션을 추정할 수도 있다. 본 발명의 다양한 실시예에서, 제 1 전자 장치(101-1)는 전기장을 형성시킬 수도 있으며, 형성된 전기장의 변경을 이용하여 사용자 모션을 추정할 수도 있다. 이 경우, 전기장의 형성 및 검출을 위한 전극의 개수 및 위치에는 제한이 없다. 본 발명의 다양한 실시예에서, 제 1 전자 장치(101-1)는 열화상 카메라를 이용하여 물체의 온도 차이를 감지할 수도 있으며, 감지된 물체의 온도 차이를 이용하여 사용자 모션을 추정할 수도 있다. 한편, 또 다른 실시예에서, 제 1 전자 장치(101-1)는, 키넥티스TM와 같은 사용자 모션을 센싱할 수 있는 장치로부터 획득된 정보로부터 바로 사용자 모션을 획득할 수도 있다.

제 1 전자 장치(101-1)는 추정된 사용자의 모션에 대응하는 전자 장치의 모션 데이터를 생성할 수 있다. 예를 들어, 제 1 전자 장치(101-1)는 전자 장치(101-1)의 오른팔을 구동할 수 있는 모터의 구동 시간, 구동 방향, 구동 정도 및 구동 속도를 포함하는 모션 데이터를 생성할 수 있다. 모션 데이터는 전자 장치에 포함된 모터를 구동할 수 있는 정보일 수 있으며, 데이터 포맷에는 제한이 없다 .

제 1 전자 장치(101-1)는 모션 데이터 및 음성 데이터를 포함하는 정보(610)를 제 2 전자 장치(101-2)로 송신할 수 있다. 여기에서, 정보(610)는 모션 데이터 및 음성 데이터를 포함할 수 있다. 예를 들어, 제 1 전자 장치(101-1)는 모션 데이터 및 음성 데이터를 순차적으로 송신할 수 있다. 또는, 정보(610)는 모션 데이터 및 음성 데이터를 이용하여 합성된 합성 데이터의 포맷으로 구현될 수도 있다.

제 2 전자 장치(101-2)는 수신된 정보(610)를 이용하여 모션을 수행할 수 있다. 제 2 전자 장치(101-2)는 모션 데이터를 수신하여, 수신된 모션 데이터에 기초하여 모터를 구동할 수 있다. 또는, 제 2 전자 장치(101-2)는 수신된 정보(610)인 합성 데이터를 파싱하여 모션 데이터를 획득하고, 파싱된 모션 데이터에 기초하여 모터를 구동할 수 있다. 예를 들어, 도 6a에서와 같이, 제 2 전자 장치(101-2)는 모션 데이터에 기초하여 모터를 구동시킴으로써 제 2 전자 장치(101-2)의 왼 팔을 헤드부의 상대적으로 하측 부근으로 이동시킬 수 있다. 이에 따라, 제 2 전자 장치(101-2)는 제 1 전자 장치(101-1)의 사용자의 모션을 모사할 수 있다. 한편, 제 2 전자 장치(101-2)는 음성 데이터를 출력할 수 있다. 음성 데이터 및 모션 데이터는 동기화되어 정보(610)로서 송신될 수 있으며, 이에 따라 제 2 전자 장치(101-2)는 모션을 수행하면서, 음성 데이터를 출력할 수 있다. 예를 들어, 제 1 전자 장치(101-1)의 사용자가 왼 팔로 입을 가리면서 "HaHaHa"라는 음성을 발화한 경우에는, 제 1 전자 장치(101)는 왼 팔로 입을 가리기 위한 모션 데이터 및 "HaHaHa"의 음성 데이터를 동기화한 정보(610)를 제 2 전자 장치(101-2)로 송신할 수 있다. 제 2 전자 장치(101-2)는 모션 데이터를 수행하는 시점에서, "HaHaHa"의 음성 데이터를 출력함으로써, 사실감 있는 모션 통화 기능을 제공할 수 있다.

한편, 제 1 전자 장치(101-1)는 제 2 전자 장치(101-2)로부터 모션 데이터 및 음성 데이터를 포함한 정보를 수신할 수 있다. 제 1 전자 장치(101-1) 또한 수신된 정보에 기초하여 모션을 수행하면서 음성을 출력할 수 있어, 양방향 모션 통화 기능이 제공될 수 있다.

도 6b는 본 발명의 다양한 실시예에 따른 전자 장치의 동작을 설명하기 위한 개념도이다. 도 6b에서는, 도 6a와는 대조적으로, 제 3 전자 장치(101-3)는 모션을 수행하기 위한 모터를 포함하지 않을 수도 있다. 이 경우, 제 3 전자 장치(101-3)는 촬영된 이미지로부터 생성한 모션 데이터 및 마이크를 통하여 획득된 음성 데이터를 포함하는 정보(610)를 제 2 전자 장치(101-2)로 송신할 수 있다. 한편, 제 2 전자 장치(101-2)는 촬영된 이미지로부터 생성한 모션 데이터 및 마이크를 통하여 획득된 음성 데이터를 포함하는 정보를 제 3 전자 장치(101-3)로 송신할 수 있다. 제 3 전자 장치(101-3)는 수신된 정보를 이용하여 아바타의 동작을 변경하여 표시할 수 있다. 제 3 전자 장치(101-3)는 제 2 전자 장치(101-2)의 사용자에 대응하는 아바타를 디스플레이상에 표시할 수 있다. 제 3 전자 장치(101-3)는 제 2 전자 장치(101-2)로부터 수신된 모션 데이터에 기초하여 아바타의 형상을 변경하여 표시함으로써, 마치 아바타가 제 2 전자 장치(101-2)의 모션 데이터에 대응하여 움직이는듯하도록 표시할 수 있다.

도 7a 및 7b는 본 발명의 다양한 실시예에 따른 전자 장치의 제어 방법을 설명하기 위한 흐름도를 도시한다.

710 동작에서, 제 1 전자 장치(101-1) 및 제 2 전자 장치(101-2)는 통신 세션을 형성할 수 있다. 본 발명의 다양한 실시예에서, 제 1 전자 장치(101-1) 및 제 2 전자 장치(101-2)는 모션 통화 기능을 제공하기 위한 어플리케이션을 실행할 수 있다. 예를 들어, 제 1 전자 장치(101-1)는 제 2 전자 장치(101-2)에게 통화 요청을 송신할 수 있으며, 제 2 전자 장치(101-2)가 수신된 통화 요청에 대한 통화 응답을 송신하는 경우에, 제 1 전자 장치(101-1) 및 제 2 전자 장치(101-2) 사이에 통신 세션이 형성될 수 있다. 도 7a의 실시예에서는, 제 1 전자 장치(101-1) 및 제 2 전자 장치(101-2)가 직접 통신 세션을 형성하는 것과 같이 나타났지만, 이는 단순히 예시적인 것으로, 예를 들어 중계 서버 또는 AP와 같은 다양한 엔티티들이 통신 세션 형성을 수행할 수 있다. 더욱 상세하게, 제 1 전자 장치(101-1)는 근처의 제 1 AP와 통신을 수행할 수 있으며, 제 1 AP는 중계 서버(예를 들어, 관리 서버)와 통신을 수행할 수 있으며, 중계 서버는 제 2 전자 장치(101-2)의 근처의 제 2 AP와 통신을 수행할 수 있으며, 제 2 AP는 제 2 전자 장치(101-2)와 통신을 수행할 수 있다. 여기에서, 통신을 수행한다는 것은 신호를 송수신할 수 있음을 의미할 수 있다.

720 동작에서 , 제 1 전자 장치(101-1)는 사용자 모션을 획득할 수 있다. 제 1 전자 장치(101-1)는 외부 환경을 촬영할 수 있다. 제 1 전자 장치(101-1)는 외부 환경을 기설정된 간격으로 촬영할 수 있으며, 이에 따라 복수 개의 이미지를 획득할 수 있다. 제 1 전자 장치(101-1)는 복수 개의 이미지를 분석함에 따라 사용자 모션을 획득할 수 있다. 더욱 상세하게, 제 1 전자 장치(101-1)는 동영상을 구성하는 복수 개의 이미지 각각에서 사용자를 식별할 수 있다. 제 1 전자 장치(101-1)는 얼굴 인식 알고리즘 또는 인물 인식 알고리즘 등을 통하여 복수 개의 이미지 각각에서 사용자를 식별할 수 있다. 제 1 전자 장치(101-1)는 인식 결과를 이용하여, 복수 개의 이미지 각각에서 사용자의 인체의 자세를 판단할 수 있다. 제 1 전자 장치(101-1)가 사용자의 인체의 자세를 판단하는 방식은, 스켈레톤 분석 방식, 메시(mesh) 분석 방식 등의 다양한 공개된 기술이 이용될 수 있으며, 그 종류에는 제한이 없다. 제 1 전자 장치(101-1)는 이미지 촬영 시점에서 뎁스 카메라(depth)를 이용한 뎁스 이미지를 획득할 수도 있으며, 획득된 뎁스 이미지를 추가적으로 이용하여 사용자의 인체의 자세를 판단할 수도 있다. 제 1 전자 장치(101-1)는 사용자의 인체의 자세의 변화를 판단할 수 있다. 예를 들어, 제 1 전자 장치(101-1)는 제 1 시점에서의 사용자의 인체의 자세와 제 2 시점에서의 사용자의 자세 사이의 변화를 판단할 수 있으며, 판단된 변화를 이용하여 사용자 모션을 판단할 수 있다. 본 발명의 다양한 실시예에서, 제 1 전자 장치(101-1)는 이미지의 오브젝트의 위치 변경에 따라 사용자 모션을 판단할 수도 있다. 예를 들어, 제 1 전자 장치(101-1)는 스켈레톤 또는 메시 등의 모델링 과정 없이, 제 1 이미지에서의 제 1 오브젝트, 예를 들어 사용자의 손의 위치와 제 2 이미지에서의 제 1 오브젝트의 위치를 비교하여, 동일 오브젝트의 위치 변화에 기초하여 사용자 모션을 판단할 수도 있다. 한편, 상술한 바와 같이, 제 1 전자 장치(101-1)는 종래의 모션 인식 센서 또는 뎁스 이미지 결과 분석에 기초하여 사용자 모션을 판단할 수도 있다. 뿐만 아니라, 본 발명은 상술한 다양한 방식에 따라 사용자 모션을 판단할 수도 있으며, 그 판단 과정에는 제한이 없다 .

730 동작에서, 제 1 전자 장치(101-1)는 모션 데이터를 생성할 수 있다. 제 1 전자 장치(101-1)는 사용자 모션에 기초하여 모션 데이터를 생성할 수 있다. 여기에서, 모션 데이터는 제 1 전자 장치(101-1) 또는 제 2 전자 장치(101-2)가 모션을 수행할 수 있도록 하는 데이터일 수 있다. 예를 들어, 모션 데이터는 제 1 전자 장치(101-1) 또는 제 2 전자 장치(101-2)에 포함된 모터의 구동 시간, 구동 방향, 구동 정도 및 구동 속도 중 적어도 하나를 포함할 수 있다. 제 1 전자 장치(101-1)는 모션 데이터에 대응하여, 모터의 구동 시간, 구동 방향, 구동 정도 및 구동 속도 중 적어도 하나를 결정함으로써 모션 데이터를 생성할 수 있다. 예를 들어, 제 1 전자 장치(101-1)가, 촬영된 복수 개의 이미지 분석을 통하여, 사용자가 왼팔을 들어 입을 가리는 사용자 모션을 획득한 경우를 상정하도록 한다. 제 1 전자 장치(101-1)는 사용자 모션에 대응하여, 예를 들어 표 1과 같은 모션 데이터를 생성할 수 있다.

| 구동 시간 | 구동 모터 | 구동 정보 |

| t1 | 왼쪽 어깨 모터 | 구동 방향: A 구동 정도: θ1 구동 속도: v1 |

| t2 | 왼쪽 어깨 모터 | 구동 방향: A 구동 정도: θ2 구동 속도: v2 |

| t3 | 왼쪽 팔꿈치 모터 | 구동 방향: A 구동 정도: θ3 구동 속도: v3 |

| t4 | 왼쪽 팔꿈치 모터 | 구동 방향: A 구동 정도: θ4 구동 속도: v4 |

| t5 | 왼쪽 팔꿈치 모터 | 구동 방향: B 구동 정도: θ5 구동 속도: v5 |

| t6 | 왼쪽 손목 모터 | 구동 방향: A 구동 정도: θ6 구동 속도: v6 |

| t7 | 왼쪽 손목 모터 | 구동 방향: B 구동 정도: θ7 구동 속도: v7 |

본 발명의 다양한 실시예에서, 제 1 전자 장치(101-1)는 사용자 모션으로부터 모션 데이터를 연산할 수 있다. 또는, 제 1 전자 장치(101-1)는 사용자 모션과 모션 데이터 사이의 연관 관계를 미리 저장할 수 있으며, 판단된 사용자 모션에 대응하는 모션 데이터를 선택할 수도 있다. 이 경우, 제 1 전자 장치(101-1)는 표 1과 같은 모션 데이터를 송신하지 않고, 모션 데이터의 인덱스 또는 파라미터 등의 모션 데이터를 식별할 수 있는 정보만을 제 2 전자 장치(101-2)로 송신할 수도 있다. 예를 들어, 제 1 전자 장치(101-1) 및 제 2 전자 장치(101-2)는 "입가리기"의 파라미터에 대응하여 표 1과 같은 모션 데이터를 미리 저장할 수 있다. 제 1 전자 장치(101-1)는 "입가리기"의 파라미터를 포함하는 모션 데이터를 제 2 전자 장치(101-2)로 송신할 수 있으며, 제 2 전자 장치(101-2)는 "입가리기" 파라미터에 대응하여 표 1과 같이 모터를 구동시킬 수 있다. 이에 따라, 제 1 전자 장치(101-1)가 제 2 전자 장치(101-2)에 송신하는 데이터량이 감소할 수도 있다.

740 동작에서, 제 1 전자 장치(101-1)는 음성 데이터를 획득할 수 있다. 750 동작에서, 제 1 전자 장치(101-1)는 모션 데이터 및 음성 데이터를 제 2 전자 장치(101-2)로 송신할 수 있다. 제 1 전자 장치(101-1)는 모션 데이터 및 음성 데이터를 동기화하여 송신할 수 있다.

760 동작에서, 제 2 전자 장치(101-2)는 사용자 음성을 출력할 수 있다. 770 동작에서, 제 2 전자 장치(101-2)는 모션 데이터에 따라, 적어도 하나의 구동 모듈, 예를 들어 모터를 구동시킬 수 있다. 예를 들어, 제 2 전자 장치(101-2)는 표 1과 같은 모션 데이터를 이용하여 모터를 구동시킬 수 있다. 이에 따라, 제 2 전자 장치(101-2)는 제 1 전자 장치(101-1)에서 판단된 사용자 모션을 수행할 수 있다. 이에 따라, 제 2 전자 장치(101-2)는 제 1 전자 장치(101-1)의 사용자의 모션을 모사하듯이 구동할 수 있다.

한편, 도 7a의 실시예에서는, 제 1 전자 장치(101-1)가 사용자 모션에 대응하는 모션 데이터를 생성하는 것과 같이 설명되었지만, 이는 단순히 예시적인 것이다. 본 발명의 다양한 실시예에서, 제 1 전자 장치(101-1)는 사용자 모션을 제 2 전자 장치(101-2)로 송신할 수 있으며, 제 2 전자 장치(101-2)가 사용자 모션에 대응하는 모션 데이터를 생성할 수도 있다. 또 다른 실시예에서, 제 1 전자 장치(101-1)는 복수 개의 이미지를 제 2 전자 장치(101-2)로 송신할 수 있으며, 제 2 전자 장치(101-2)는 복수 개의 이미지의 분석 결과에 기초하여 사용자 모션을 판단할 수 있으며, 판단된 사용자 모션을 이용하여 모션 데이터를 생성할 수도 있다.

한편, 도 7a의 실시예에서는, 제 1 전자 장치(101-1)가 복수 개의 이미지 분석 결과를 이용하여, 사용자 모션을 판단하고, 판단된 사용자 모션에 기초하여 모션 데이터를 생성하는 것과 같이 도시되어 있지만, 사용자 모션은 설명의 편의를 위한 것일 수 있다. 예를 들어, 제 1 전자 장치(101-1)는 복수 개의 이미지 분석 결과를 이용하여 곧바로 모션 데이터를 생성할 수도 있다.

본 발명의 다양한 실시예에서, 제 1 전자 장치(101-1)는 이미지 분석을 통한 사용자 표정을 사용자 모션으로서 획득할 수도 있다. 제 1 전자 장치(101-1)는 사용자 표정을 포함한 사용자 모션 또는 모션 데이터를 제 2 전자 장치(101-2)로 송신할 수 있다. 제 2 전자 장치(101-2)는 사용자 표정을 구현하기 위한 모터를 구동하여 사용자 표정을 표현하거나, 또는 디스플레이에 사용자 표현에 대응하는 화면을 표시함으로써 사용자 표현을 표현할 수도 있다.

도 7b는 본 발명의 다양한 실시예에 의한 전자 장치의 동작을 설명하기 위한 흐름도를 도시한다. 도 7b의 설명 중 도 7a와 중복되는 부분 중 일부는 생략하도록 한다.

상술한 바와 같이, 730 동작 및 740 동작에서, 제 1 전자 장치(101-1)는 모션 데이터 및 음성 데이터를 획득할 수 있다. 745 동작에서, 제 1 전자 장치(101-1)는 모션 데이터 및 음성 데이터를 합성한 합성 데이터를 생성할 수 있다. 도 7c는 본 발명의 다양한 실시예에 따른 합성 데이터의 예시이다. 도 7c에 도시된 바와 같이, 본 발명의 다양한 실시예에 따른 합성 데이터(790)는 구동 시간(791) 별로 음성 데이터(792) 및 모션 데이터(793)를 포함할 수 있다. 제 1 전자 장치(101-1)는 음성 데이터(792) 및 모션 데이터(793)를 동기화하여 합성 데이터(790)를 생성할 수 있다.

751 동작에서, 제 1 전자 장치(101-1)는 합성 데이터를 제 2 전자 장치(101-2)로 송신할 수 있다. 755 동작에서, 제 2 전자 장치(101-2)는 합성 데이터를 파싱(parsing)하여, 음성 데이터 및 모션 데이터를 획득할 수 있다. 이에 따라, 760 동작 및 770 동작에서, 제 2 전자 장치(101-2)는 음성 데이터를 출력하고, 모션 데이터를 이용하여 적어도 하나의 구동 모듈, 예를 들어 모터를 구동시킬 수 있다.

상술한 바와 같이, 본 발명의 다양한 실시예에 의한 전자 장치는, 음성 데이터 및 모션 데이터를 송신하는 것이 아니라, 특정한 데이터 형식으로 합성 데이터를 생성하여 송신할 수도 있다.

도 8은 본 발명의 다양한 실시예에 따른 전자 장치의 제어 방법을 설명하기 위한 흐름도를 도시한다.

810 동작에서, 제 1 전자 장치(101-1) 및 제 2 전자 장치(101-2)는 통신 세션을 형성할 수 있다.

815 동작에서, 제 1 전자 장치(101-1)는 제 2 전자 장치(101-2)의 캐퍼빌리티(capability) 정보를 수신할 수 있다. 도 9는 본 발명의 다양한 실시예에 따른 캐퍼빌리티 정보의 예시이다. 캐퍼빌리티 정보(910)는, 물리적 정보(911), 성장 모델(912) 및 관계 모델(913) 중 적어도 하나를 포함할 수 있다. 물리적 정보(911)는 전자 장치가 포함하고 있는 하드웨어 등에 대한 정보일 수 있다. 예를 들어, 물리적 정보(911)는 전자 장치가 고정형 타입인지 이동형 타입인지, 사용자 표정은 디스플레이로 표현되는지 모터의 조합으로 표현되는지, 고개는 상하 좌우로 돌릴 수 있는 타입인지, 팔이 있는지, 팔을 움직일 수 있다면 팔 관절은 몇 개 인지, 손가락 제어는 가능한지, 허리는 돌아가는지, 허리를 굽힐 수 있는지 등에 대한 정보를 포함할 수 있다. 물리적 정보(911)는, 전자 장치가 바퀴로 움직이는지, 다리로 움직이는지, 다리는 관절을 가지고 있는지, 날개는 가지고 있는지 등에 대한 정보를 포함할 수도 있다.

성장 모델(912)은 전자 장치의 성장 정도에 따른 하드웨어 이용 가능 여부를 나타낼 수 있다. 본 발명의 다양한 실시예에 따른 전자 장치는 성장 모델(912)에 따라 하드웨어 기능 중 일부 기능을 제한할 수 있다. 예를 들어, 전자 장치는 성장 모델(912)에 따른 연령이 초기인 경우에는 하드웨어 기능 중 다수의 기능을 제한할 수 있으며, 연령이 증가함에 따라 제한된 하드웨어 기능을 해제할 수 있다. 이에 따라, 전자 장치는 모션 수행 능력이 진화하는 것과 같은 효과를 창출할 수 있다. 예를 들어, 연령이 상대적으로 낮은 시점에서는, 전자 장치는 손가락 관절을 구동하는 하드웨어의 기능을 제한할 수 있으며, 이에 따라 손가락으로 하트 제스처를 표현할 수 없도록 제한할 수 있다. 전자 장치는 연령이 증가할수록, 손가락 관절을 구동하는 하드웨어의 기능 제한을 해제하여, 손가락으로 하트 제스처를 표현할 수 있도록 제어할 수 있다.

관계 모델(913)은 전자 장치와 사용자의 관계를 반영한 하드웨어 제어 정보일 수 있다. 전자 장치는 특정 사용자와의 인터랙션(interaction) 시 자주 이용하던 제스처 또는 표정을 미리 저장할 수 있으며, 이를 관계 모델(913)로서 저장할 수 있다.

상술한 바와 같이, 제 1 전자 장치(101-1)는 다양한 제 2 전자 장치(101-2)의 캐퍼빌리티 정보를 수신할 수 있다. 한편, 도 8의 실시예에서는, 제 1 전자 장치(101-1)가 제 2 전자 장치(101-2)로부터 직접 캐퍼빌리티 정보를 수신하는 것과 같이 도시되어 있지만, 이는 단순히 예시적인 것이다. 본 발명의 다양한 실시예에서, 제 1 전자 장치(101-1)는 서버로부터 제 2 전자 장치(101-2)의 캐퍼빌리티 정보를 수신할 수도 있다. 또는, 제 1 전자 장치(101-1)는 전자 장치별 캐퍼빌리티 정보를 미리 저장할 수도 있으며, 통신 세션 형성 과정 등에서 획득된 제 2 전자 장치(101-2)의 식별 정보에 대응하는 제 2 전자 장치(101-2)의 캐퍼빌리티 정보를 판단할 수도 있다.

820 동작에서, 제 1 전자 장치(101-1)는 사용자 모션을 획득할 수 있다. 상술한 바와 같이, 제 1 전자 장치(101-1)는 촬영한 복수 개의 이미지 분석 결과를 이용하여, 사용자 모션을 획득할 수 있다.

830 동작에서, 제 1 전자 장치(101-1)는 사용자 모션 및 제 2 전자 장치(101-2)의 캐퍼빌리티 정보에 기초하여 모션 데이터를 생성할 수 있다. 예를 들어, 제 1 전자 장치(101-1)는 사용자 모션에 대응하는 표 1과 같은 모션 데이터를 생성할 수 있다. 한편, 제 1 전자 장치(101-1)는 제 2 전자 장치(101-2)가 "왼쪽 팔꿈치 모터" 및 "왼쪽 어깨 모터"를 포함하는 캐퍼빌리티 정보를 획득할 수 있다. 즉, 제 1 전자 장치(101-1)는 제 2 전자 장치(101-2)가 "왼쪽 손목 모터"를 포함하지 않는다는 제 2 전자 장치(101-2)의 캐퍼빌리티 정보를 획득할 수 있다. 이에 따라, 제 1 전자 장치(101-1)는 표 1의 모션 데이터를 표 2와 같이 수정할 수 있다.

| 구동 시간 | 구동 모터 | 구동 정보 |

| t1 | 왼쪽 어깨 모터 | 구동 방향: A 구동 정도: θ1 구동 속도: v1 |

| t2 | 왼쪽 어깨 모터 | 구동 방향: A 구동 정도: θ2 구동 속도: v2 |

| t3 | 왼쪽 팔꿈치 모터 | 구동 방향: A 구동 정도: θ3 구동 속도: v3 |

| t4 | 왼쪽 팔꿈치 모터 | 구동 방향: A 구동 정도: θ4 구동 속도: v4 |

| t5 | 왼쪽 팔꿈치 모터 | 구동 방향: B 구동 정도: θ5 구동 속도: v5 |

| t6 | 구동 정보 없음 | 구동 정보 없음 |

| t7 | 구동 정보 없음 | 구동 정보 없음 |

제 1 전자 장치(101-1)는 t6 및 t7의 구동 시간에서 설정된 왼쪽 손목 모터가 제 2 전자 장치(101-2)에 포함되지 않는 것에 대응하여, t6 및 t7의 구동 시간에 대응하는 구동 정보를 삭제할 수 있다. 즉, 제 1 전자 장치(101-1)는 제 2 전자 장치(101-2)의 물리적 정보에 기초하여 모션 데이터를 생성할 수 있다. 본 발명의 다양한 실시예에서, 제 1 전자 장치(101-1)는 제 2 전자 장치(101-2)의 성장 모델 또는 관계 모델에 기초하여 모션 데이터를 생성할 수도 있다. 예를 들어, 제 1 전자 장치(101-1)는 제 2 전자 장치(101-2)의 성장 모델에 따른 연령이 낮다는 정보에 기초하여, 낮은 연령에서 수행이 제한된 왼쪽 손목 모터의 구동을 제한하여 표 2와 같은 모션 데이터를 생성할 수도 있다. 또는, 제 1 전자 장치(101-1)는 제 2 전자 장치(101-2)와 사용자 사이의 관계 모델에 기초하여, 추가적인 동작을 표 1과 같은 모션 데이터에 추가하여, 모션 데이터를 생성할 수도 있다. 상술한 바에 따라서, 도 9에서와 같이, 제 1 전자 장치(101-1)는 사용자 모션(920)을 캐퍼빌리티 정보(910)를 이용하여, 모션 데이터(930)를 생성할 수 있다.

840 동작에서, 제 1 전자 장치(101-1)는 음성 데이터를 생성할 수 있다. 850 동작에서, 제 1 전자 장치(101-1)는 모션 데이터 및 음성 데이터를 제 2 전자 장치(101-2)로 송신할 수 있다.

860 동작에서, 제 2 전자 장치(101-2)는 음성 데이터를 출력할 수 있다. 870 동작에서, 제 2 전자 장치(101-2)는 모션 데이터에 따라, 적어도 하나의 구동 모듈, 예를 들어 모터를 제어할 수 있다. 제 2 전자 장치(101-2)는, 예를 들어 표 2와 같은 모션 데이터를 수신하였으므로, 왼쪽 손목 모터를 포함하지 않더라도 모션 데이터에 따라 모터를 구동시킬 수 있다. 한편, 본 발명의 다양한 실시예에서, 제 2 전자 장치(101-2)는 캐퍼빌리티 정보가 반영되지 않은 모션 데이터를 수신할 수도 있으며, 이 경우에는 자신에게 설정된 캐퍼빌리티 정보에 기초하여 모션 데이터를 수정하여 모션을 수행할 수도 있으며, 이는 도 10a 및 10b를 참조하여 더욱 상세하게 설명하도록 한다.

도 10a 및 10b는 본 발명의 다양한 실시예에 따른 전자 장치의 동작을 설명하기 위한 개념도를 도시한다.

도 10a를 참조하면, 제 1 전자 장치(101-1)는 센서(1001)로부터 획득된 이미지에 대하여, 이미지 처리(1012)를 수행할 수 있다. 제 1 전자 장치(101-1)는 이미지 처리(1012) 결과에 기초하여 표정(1013), 헤드 모션(1015), 상반신 모션(1017) 및 하반신 모션(1019)을 획득할 수 있다. 제 1 전자 장치(101-1)는 표정 모델링(1014), 헤드 모션 모델링(1016), 상반신 모션 모델링(1018) 및 하반신 모션 모델링(1020)을 수행할 수 있다. 여기에서, 모델링은 모션 데이터를 생성하는 과정으로, 모터의 구동 정보를 생성하는 것일 수 있다. 한편, 제 1 전자 장치(101-1)는 제 2 전자 장치(101-2)가 하반신 구동 모터를 포함하지 않는다는 물리적 정보(1011)를 획득할 수 있다. 이에 따라, 제 1 전자 장치(101-1)는 하반신 모션 획득(1019) 및 하반신 모션 모델링(1020) 과정을 수행하지 않을 수도 있다. 제 1 전자 장치(101-1)는 하반신 관련 정보를 포함하지 않는 모션 데이터(1021)를 생성할 수 있다. 제 1 전자 장치(101-1)는 마이크(1002)를 통하여 획득된 음성 데이터에 대하여, 음성 처리(1030)를 수행할 수 있으며, 모션 데이터 및 음성 데이터를 합성한 합성 데이터(1022)를 생성할 수 있다. 제 1 전자 장치(101-1)는 합성 데이터를 송신(1023)할 수 있다.

도 10b에서는, 수신측 전자 장치가 모션 데이터를 수정하는 과정을 설명한다. 제 2 전자 장치(101-2)는 합성 데이터를 수신(1031)할 수 있다. 여기에서, 합성 데이터는 하반신 관련 데이터까지 포함한 모션 데이터를 포함한 것으로 상정한다. 제 2 전자 장치(101-2)는 수신된 합성 데이터를 분리(1032)할 수 있다. 제 2 전자 장치(101-2)는 모션 데이터(1033)를 추출할 수 있다. 제 2 전자 장치(101-2)는 표정 데이터(1041), 헤드 모션 데이터(1051), 상반신 모션 데이터(1061) 및 하반신 모션 데이터(1071)를 추출할 수 있다. 제 2 전자 장치(101-2)는 로봇 표정 생성(1042), 로봇 헤드 모터 제어(1052), 로봇 상반신 모터 제어(1062), 로봇 하반신 모터 제어(1072) 각각을 위한 데이터를 생성할 수 있다. 제 2 전자 장치(101-2)는 생성된 데이터를 이용하여 디스플레이(1043)과 모터(1053,1063,1073)를 구동시킬 수 있다. 한편, 제 2 전자 장치(101-2)는 자신의 캐퍼빌리티 정보를 이용하여, 하반신 모션 데이터(1071)를 추출하지 않으며, 추후 동작을 수행하지 않을 수도 있다. 제 2 전자 장치(101-2)는 음성 데이터를 처리(1081)할 수 있으며, 스피커(1082)를 통하여 출력할 수 있다.

도 11은 본 발명의 다양한 실시예에 따른 전자 장치의 제어 방법의 흐름도를 도시한다.

1110 동작에서, 전자 장치(101-1)는 통화를 개시할 수 있다. 1120 동작에서, 전자 장치(101-1)는 영상 통화 모드 또는 모션 통화 모드 중 하나를 선택할 수 있다. 본 발명의 다양한 실시예에서, 전자 장치(101-1)는 사용자 입력에 따라 두 모드 중 하나의 모드를 선택할 수 있거나 또는 영상 통화 모드 또는 모션 통화 모드 각각에 대한 실행 조건이 검출된지 여부에 따라 두 모드 중 하나의 모드를 선택할 수도 있다.

영상 통화 모드가 선택된 경우에는, 1130 동작에서, 전자 장치(101)는 사용자를 포함하는 외관을 촬영할 수 있다. 1140 동작에서, 전자 장치(101)는 음성 데이터를 획득할 수 있다. 1150 동작에서, 전자 장치(101)는 촬영 결과 및 음성 데이터를 송신할 수 있다. 수신측의 전자 장치는 촬영 결과를 표시하면서, 음성 데이터를 출력함으로써 영상 통화가 수행될 수 있다.

모션 통화 모드가 선택된 경우에는, 1160 동작에서, 전자 장치(101)는 사용자 모션을 획득하고 모션 데이터를 생성할 수 있다. 1170 동작에서, 전자 장치(101)는 음성 데이터를 획득할 수 있다. 1180 동작에서, 전자 장치(101)는 모션 데이터 및 음성 데이터를 송신할 수 있다. 수신측의 전자 장치는 모션 데이터에 따라 모션을 수행하면서, 음성 데이터를 출력함으로써 모션 통화가 수행될 수 있다.

도 12a 및 12b는 본 발명의 다양한 실시예에 따른 모드 선택을 설명하기 위한 개념도를 도시한다.

도 12a는 본 발명의 다양한 실시예에 따른 전자 장치(101)가 표시하는 그래픽 사용자 인터페이스일 수 있다. 도 12a에 도시된 바와 같이, 전자 장치(101)는 영상 통화에 대응하는 화면(1210)을 표시할 수 있다. 한편, 전자 장치(101)는 모션 통화로의 전환을 가능하게 하는 그래픽 사용자 인터페이스(1220)를 화면(1210) 상에 표시할 수도 있다. 전자 장치(101)가 모션 통화로의 전환 입력을 검출하면, 전자 장치(101)는 모션 통화로 모드를 전환하여, 모션 데이터를 송신할 수 있다.

도 12b는 또 다른 실시예에 의한 모드 전환을 설명한다. 도 12b를 참조하면, 전자 장치(1202)는 로봇(1202)에 도킹(docking)(1210)될 수 있다. 여기에서, 로봇(1202)은 모션 수행이 가능한 모터를 가진 전자 장치를 지칭할 수 있다. 전자 장치(1202)는 로봇(1202)에 도킹(1210)됨에 따라서 물리적으로 연결되어 함께 움직일 수 있으며, 데이터를 송수신할 수 있다. 즉, 전자 장치(1202)에서 수신된 모션 데이터를 로봇(1202)으로 출력할 수 있으며, 로봇(1202)은 모션 데이터에 대응하는 모션을 수행할 수 있다. 전자 장치(1201)가 로봇(1202)에 도킹(1210)되면, 전자 장치(1201)는 영상 통화 모드로부터 모션 통화 모드로 모드 전환을 수행할 수 있다. 또 다른 실시예에서, 전자 장치(1201)는 수신측 전자 장치가 도킹되었다는 정보에 기초하여, 영상 통화 모드로부터 모션 통화 모드로 모드 전환을 수행할 수도 있다.

도 13a 및 13b는 본 발명의 다양한 실시예에 따른 전자 장치의 동작을 설명하기 위한 흐름도를 도시한다.

우선, 도 13a를 참조하면, 1310 동작에서, 제 1 전자 장치(101-1) 및 제 2 전자 장치(101-2)는 통신 세션을 형성할 수 있다. 1320 동작에서, 제 1 전자 장치(101-1)는 사용자 모션을 획득할 수 있다. 상술한 동작들에 대하여서는 상세하게 설명하였기 때문에, 여기에서의 상세한 설명은 생략하도록 한다.

1325 동작에서, 제 1 전자 장치(101-1)는 제 1 전자 장치(101-1)를 이용하는 사용자를 식별하고, 식별된 사용자에 대응하는 모션 속성을 획득할 수 있다. 예를 들어, 제 1 전자 장치(101-1)는 촬영된 이미지를 분석하여, 분석 결과를 이용하여 이미지 내의 인물을 식별할 수 있다. 또는, 제 1 전자 장치(101-1)는 미리 설정된 사용자 정보에 기초하여 사용자를 식별할 수도 있다. 모션 속성은, 사용자별로 설정된 사용자 모션 또는 모션 데이터를 지칭할 수 있다. 예를 들어, 제 1 전자 장치(101-1)는 표 3과 같은 모션 속성을 미리 저장할 수 있다.

| 사용자 | 모션 속성 |

| James | 머리를 만지는 모션 속성 |

| Ted | 입을 가리는 모션 속성 |

상술한 바와 같이, 제 1 전자 장치(101-1)는 사용자별로 사용자 모션을 포함하는 모션 속성을 저장할 수 있다. 또 다른 실시예에서, 제 1 전자 장치(101-1)는 사용자별로 모션 데이터, 즉 모터의 구동 정보를 저장할 수도 있다.

1330 동작에서, 제 1 전자 장치(101-1)는 사용자 모션 및 모션 속성에 기초하여 모션 데이터를 생성할 수 있다. 본 발명의 다양한 실시예에서, 제 1 전자 장치(101-1)는 사용자 모션에 기초하여 제 1 모션 데이터를 생성한 후, 모션 속성에 따른 제 2 모션 데이터를 제 1 모션 데이터에 반영함으로써 모션 데이터를 생성할 수 있다.

1340 동작에서, 제 1 전자 장치(101-1)는 음성 데이터를 획득할 수 있다. 1350 동작에서, 제 1 전자 장치(101-1)는 모션 데이터 및 음성 데이터를 제 2 전자 장치(101-2)로 송신할 수 있다. 제 1 전자 장치(101-1)는 모션 데이터 및 음성 데이터를 분리하여 제 2 전자 장치(101-2)로 송신하거나 또는 두 데이터를 합성한 합성 데이터를 제 2 전자 장치(101-2)로 송신할 수 있다.

1360 동작에서, 제 2 전자 장치(101-2)는 음성 데이터를 출력할 수 있다. 1370 동작에서, 제 2 전자 장치(101-2)는 모션 데이터에 따라, 적어도 하나의 구동 모듈, 예를 들어 모터를 제어할 수 있다. 사용자별 모션 속성이 반영됨에 따라서, 제 2 전자 장치(101-2)는 보다 제 1 전자 장치(101-1)의 사용자와 유사한 모션을 모사할 수 있다.

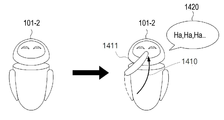

도 13b는 또 다른 실시예에 의한 전자 장치의 동작을 설명하기 위한 흐름도를 도시한다. 도 13b는, 도 14a 내지 14c를 참조하여 더욱 상세하게 설명하도록 한다. 도 14a 및 14b는 본 발명의 다양한 실시예에 따른 전자 장치의 동작을 설명하기 위한 개념도들을 도시한다. 도 14c는 본 발명의 다양한 실시예에 따른 모션 데이터의 예시이다.

도 13b를 참조하면, 1310 동작에서, 제 1 전자 장치(101-1)는 제 2 전자 장치(101-2)와 통신 세션을 형성할 수 있다. 1320 동작에서, 제 1 전자 장치(101-1)는 사용자 모션을 획득할 수 있다. 1330 동작에서, 제 1 전자 장치(101-1)는 모션 데이터를 생성할 수 있다. 1340 동작에서, 제 1 전자 장치(101-1)는 음성 데이터를 획득할 수 있다. 1350 동작에서, 제 1 전자 장치(101-1)는 모션 데이터 및 음성 데이터를 제 2 전자 장치(101-2)로 송신할 수 있다.

1360 동작에서, 제 2 전자 장치(101-2)는 음성 데이터를 출력할 수 있다. 1365 동작에서, 제 2 전자 장치(101-2)는 송신자, 즉 제 1 전자 장치(101-1)의 사용자를 식별하고, 식별된 송신자에 대응하는 모션 속성을 획득할 수 있다. 예를 들어, 제 2 전자 장치(101-2)는 표 3과 같은 모션 속성을 미리 저장할 수 있다. 제 2 전자 장치(101-2)는 송신자가 James인 것을 식별할 수 있으며, 이에 대응하여 James의 모션 속성인 머리를 만지는 모션을, 수신된 모션 데이터에 반영할 수 있다. 1370 동작에서, 제 2 전자 장치(101-2)는 모션 데이터에 따라, 적어도 하나의 구동 모듈, 예를 들어 모터를 제어할 수 있다. 이에 따라, 제 2 전자 장치(101-2)는 수신된 모션 데이터에 의한 모션에 추가적으로 James가 자주 하는 머리를 만지는 모션을 수행할 수 있다.

예를 들어, 제 2 전자 장치(101-2)는 도 14a에서와 같이, 수신된 모션 데이터에 의한 오른팔(1411)을 헤드부 하부로 이동시키는 모션(1410)과 함께 음성 데이터(1420)를 출력할 수 있다. 한편, 도 14b에서와 같이, 제 2 전자 장치(101-2)는 수신된 모션 데이터에 송신자의 모션 속성을 반영하여, 오른팔(1411)을 헤드부 상부로 이동시키는 모션(1430)을 수행하고, 이후에 오른팔(1411)을 헤드부 하부로 이동시키는 모션(1411)을 수행할 수 있다.

이에 따라, 제 2 전자 장치(101-2)는 도 14c와 같은 합성 데이터(1490)를 생성할 수 있다. 모션 데이터(1490)는 구동 시간(1491)별로 음성 데이터(1492) 및 모션 데이터(1493)를 포함할 수 있다. 제 2 전자 장치(101-2)는 송신자의 모션 속성에 대응하는 추가 모션 데이터(1494)를 기존의 모션 데이터(1493)에 추가할 수 있다.

도 15는 본 발명의 다양한 실시예에 따른 전자 장치의 제어 방법을 설명하기 위한 흐름도를 도시한다.

1510 동작에서, 전자 장치(101)는 제 1 사용자의 모션을 센싱할 수 있다. 상술한 바와 같이, 전자 장치(101)는 복수 개의 이미지 분석 또는 모션 센서로부터의 데이터에 기초하여 제 1 사용자의 모션을 센싱할 수 있다.

1520 동작에서, 전자 장치(101)는 센싱된 제 1 사용자의 모션을 분석하여 모션 데이터를 생성할 수 있다. 예를 들어, 전자 장치(101)는 제 1 사용자의 모션에 대응하여 모터의 구동 정보를 생성함으로써 모션 데이터를 생성할 수 있다.

1530 동작에서, 전자 장치(101)는 제 1 사용자를 식별할 수 있다. 1540 동작에서, 전자 장치(101)는 제 1 사용자의 식별 정보 및 생성된 모션 데이터를 연관하여 저장할 수 있다. 예를 들어, 전자 장치(101)는 표 3과 같이, 제 1 사용자의 식별 정보 및 생성된 모션 데이터를 연관하여 저장할 수 있다. 전자 장치(101)는 저장된 식별 정보 및 생성된 모션 데이터를 다른 전자 장치로 송신할 수도 있다.

도 16은 본 발명의 다양한 실시예에 따른 전자 장치의 제어 방법의 흐름도를 도시한다.

1610 동작에서, 전자 장치(101)는 제 1 사용자의 모션을 센싱할 수 있다. 1620 동작에서, 전자 장치(101)는 센싱된 제 1 사용자의 모션을 분석하여 모션 데이터를 생성할 수 있다.

1630 동작에서, 전자 장치(101)는 제 1 사용자의 모션을 센싱하는 도중에 발생된 이벤트를 검출할 수 있다. 본 발명의 다양한 실시예에서, 전자 장치(101)는 제 1 사용자의 모션을 센싱하는 도중에, 전자 장치(101)가 포함한 하드웨어를 통하여 검출되는 이벤트 또는 다른 전자 장치로부터 수신한 이벤트를 검출할 수 있다. 예를 들어, 전자 장치(101)는 제 1 사용자가 오른손으로 머리를 만지는 사용자 모션을 센싱하는 도중에, "Uh~"라는 음성을 마이크를 통하여 검출할 수 있다.

1640 동작에서, 전자 장치(101)는 제 1 사용자를 식별할 수 있다. 1650 동작에서, 전자 장치(101)는 제 1 사용자의 식별 정보와 생성된 모션 데이터 및 검출된 이벤트를 연관하여 저장할 수 있다. 예를 들어, 전자 장치(101)는 도 17과 같이, 이벤트(1710) 및 모션 데이터(1720)가 연관된 연관 정보(1708)를 사용자별로 저장할 수 있다. 예를 들어, 전자 장치(101)는 사용자의 음성 분석 또는 사용자의 생체 신호 분석을 통하여 사용자의 슬픈 감정을 사용자 모션 센싱 도중에 검출할 수 있다. 이에 따라, 전자 장치(101)는 사용자의 슬픈 감정과 고개를 떨구는 모션 데이터를 연관하여 저장할 수 있다. 아울러, 전자 장치(101)는 사용자가 Jane로 식별되는 인물과 함께 있다는 이벤트를 사용자가 입을 가리는 사용자 모션 센싱 도중에 검출할 수 있다. 도 17에서와 같이, 전자 장치(101)가 모션 데이터와 연관하여 저장하는 이벤트의 종류에는 제한이 없으며, 하나의 모션 데이터에 대하여 복수 개의 이벤트가 연관되어 저장될 수도 있다.

도 18a 및 18b는 본 발명의 다양한 실시예에 따른 전자 장치의 동작을 설명하기 위한 흐름도를 도시한다.

도 18a를 우선 참조하면, 1810 동작에서, 제 1 전자 장치(101-1)는 제 2 전자 장치(101-2)와 통신 세션을 형성할 수 있다. 1820 동작에서, 제 1 전자 장치(101-1)는 사용자 모션을 획득할 수 있다. 1825 동작에서, 제 1 전자 장치(101-1)는 이벤트를 검출할 수 있다. 1830 동작에서, 제 1 전자 장치(101-1)는 검출된 이벤트와 사용자 모션을 이용하여 모션 데이터를 생성할 수 있다. 예를 들어, 제 1 전자 장치(101-1)는 사용자 모션을 이용하여 제 1 모션 데이터를 생성할 수 있으며, 추가적으로 검출된 이벤트에 대응하는 제 2 모션 데이터를 제 1 모션 데이터에 반영하여 최종적으로 모션 데이터를 생성할 수 있다. 1840 동작에서, 제 1 전자 장치(101-1)는 음성 데이터를 획득할 수 있다. 1850 동작에서, 제 1 전자 장치(101-1)는 모션 데이터 및 음성 데이터를 제 2 전자 장치(101-2)로 송신할 수 있다. 본 발명의 다양한 실시예에서, 제 1 전자 장치(101-1)는 모션 데이터 및 음성 데이터를 합성한 합성 데이터를 제 2 전자 장치(101-2)로 송신할 수도 있다. 1860 동작에서, 제 2 전자 장치(101-2)는 음성 데이터를 출력할 수 있다. 1870 동작에서, 제 2 전자 장치(101-2)는 모션 데이터에 따라 적어도 하나의 구동 모듈, 예를 들어 모터를 구동할 수 있다. 예를 들어, 제 1 전자 장치(101-1)는 사용자로부터 "Uh~"의 음성을 검출할 수 있으며, 이에 대응하여 오른손이 머리를 만지는 모션 데이터를 반영한 모션 데이터를 제 2 전자 장치(101-2)로 송신할 수 있다. 이에 대응하여, 제 2 전자 장치(101-2)는 "Uh~"라는 음성 데이터를 출력하는 시점에서, 제 2 전자 장치(101-2)의 오른손이 헤드부쪽으로 이동하도록 모터를 구동시킬 수 있다.

도 18b를 참조하면, 1810 동작에서, 제 1 전자 장치(101-1)는 제 2 전자 장치(101-2)와 통신 세션을 형성할 수 있다. 1820 동작에서, 제 1 전자 장치(101-1)는 사용자 모션을 획득할 수 있다. 1831 동작에서, 제 1 전자 장치(101-1)는 사용자 모션을 이용하여 모션 데이터를 생성할 수 있다. 1840 동작에서, 제 1 전자 장치(101-1)는 음성 데이터를 획득할 수 있다. 1850 동작에서, 제 1 전자 장치(101-1)는 모션 데이터 및 음성 데이터를 제 2 전자 장치(101-2)로 송신할 수 있다. 본 발명의 다양한 실시예에서, 제 1 전자 장치(101-1)는 모션 데이터 및 음성 데이터를 합성한 합성 데이터를 제 2 전자 장치(101-2)로 송신할 수도 있다. 1860 동작에서, 제 2 전자 장치(101-2)는 음성 데이터를 출력할 수 있다. 1865 동작에서, 제 2 전자 장치(101-2)는 음성 데이터를 분석하여 이벤트를 검출할 수 있다. 예를 들어, 제 2 전자 장치(101-2)는 수신된 음성 데이터로부터 "Uh~"의 음성을 검출할 수 있다. 1867 동작에서, 제 2 전자 장치(101-2)는 검출된 이벤트에 대응하는 모션 특징을 획득할 수 있다. 예를 들어, 제 2 전자 장치(101-2)는 도 17과 같은 연관 정보를 미리 저장할 수 있으며, 이를 이용하여 "Uh~"라는 음성에 대응하는 오른손이 머리를 만지는 모션 특징을 획득할 수 있다. 1870 동작에서, 제 2 전자 장치(101-2)는 모션 데이터 및 모션 특징에 따라, 적어도 하나의 구동 모듈, 예를 들어 모터를 구동할 수 있다.

도 19는 본 발명의 다양한 실시예에 따른 전자 장치의 제어 방법을 설명하기 위한 흐름도를 도시한다.

1910 동작에서, 전자 장치(101)는 음성 데이터를 수신할 수 있다. 상술한 실시예와는 대조적으로, 전자 장치(101)는 다른 전자 장치로부터 모션 데이터를 제외한 음성 데이터만을 수신할 수 있다.

1920 동작에서, 전자 장치(101)는 음성 데이터를 분석할 수 있다. 전자 장치(101)는 예를 들어, 음성 데이터로부터 "Uh~"라는 음성을 식별할 수 있다.

1930 동작에서, 전자 장치(101)는 음성 데이터 분석 결과에 대응하는 발신자 모션 특징을 획득할 수 있다. 예를 들어, 전자 장치(101)는 도 17과 같은 연관 정보를 미리 저장할 수 있으며, 이를 이용하여 "Uh~"라는 음성에 대응하는 오른손이 머리를 만지는 모션 특징을 획득할 수 있다.

1940 동작에서, 전자 장치(101)는 발신자 모션 특징에 대응하여, 적어도 하나의 구동 모듈, 예를 들어 모터를 구동할 수 있다. 예를 들어, 전자 장치(101)는 "Uh~"라는 음성에 대응하는 오른손이 머리를 만지는 모션 특징을 구동하도록 모터를 구동할 수 있다.

본 발명의 다양한 실시예에서, 전자 장치의 제어 방법은, 외부 음성에 대한 음성 데이터를 획득하는 동작; 사용자 모션을 센싱하는 동작; 상기 센싱된 사용자 모션에 대응하는 모션 데이터를 생성하고, 상기 음성 데이터 및 상기 모션 데이터를 시간적으로 동기화하여, 다른 전자 장치로 송신하는 동작을 포함할 수 있다.

본 발명의 다양한 실시예에서, 전자 장치의 제어 방법은, 상기 음성 데이터 및 상기 모션 데이터를 기설정된 프로토콜에 따라 합성한 합성 데이터를 생성하는 동작; 및 상기 합성 데이터를 상기 다른 전자 장치로 송신하는 동작을 더 포함할 수 있다.

본 발명의 다양한 실시예에서, 상기 모션 데이터는, 상기 다른 전자 장치에 포함된 적어도 하나의 모터를 구동하기 위한 정보를 포함할 수 있다.

본 발명의 다양한 실시예에서, 상기 모션 데이터는, 모터 식별 정보, 구동 시간, 구동 방향, 구동 정도 및 구동 속도 중 적어도 하나를 포함할 수 있다.

본 발명의 다양한 실시예에서, 상기 모션 데이터는, 모터 식별 정보, 구동 시간, 구동 방향, 구동 정도 및 구동 속도 중 적어도 하나에 대응하는 파라미터를 포함하며, 상기 다른 전자 장치는, 상기 파라미터에 대응하는 모터 식별 정보, 구동 시간, 구동 방향, 구동 정도 및 구동 속도 중 적어도 하나를 이용하여, 상기 다른 전자 장치에 포함된 적어도 하나의 모터를 구동할 수 있다.

본 발명의 다양한 실시예에서, 전자 장치의 제어 방법은, 상기 다른 전자 장치의 캐퍼빌리티 정보를 획득하는 동작; 및 상기 캐퍼빌리티 정보에 기초하여, 상기 모션 데이터를 생성하는 동작을 더 포함할 수 있다.

본 발명의 다양한 실시예에서, 상기 캐퍼빌리티 정보는, 상기 다른 전자 장치의 물리적 정보, 성장 모델 및 관계 모델 중 적어도 하나를 포함할 수 있다.

본 발명의 다양한 실시예에서, 전자 장치의 제어 방법은, 영상 통화를 수행할지 또는 모션 통화를 수행할지 여부를 선택받는 동작; 상기 영상 통화가 선택된 경우에는, 획득된 이미지를 상기 음성 데이터와 시간적으로 동기화하여 상기 다른 전자 장치로 송신하는 동작; 및 상기 모션 통화가 선택된 경우에는, 상기 모션 데이터를 상기 음성 데이터와 시간적으로 동기화하여 상기 다른 전자 장치로 송신하는 동작을 더 포함할 수 있다.

본 발명의 다양한 실시예에서, 전자 장치의 제어 방법은, 상기 다른 전자 장치로부터 다른 전자 장치의 모션 데이터 및 다른 전자 장치의 음성 데이터를 획득하는 동작; 상기 다른 전자 장치의 모션 데이터에 기초하여, 상기 전자 장치의 적어도 하나의 모터를 구동하는 동작; 및 상기 다른 전자 장치의 음성 데이터를 상기 전자 장치의 스피커를 통하여 출력하는 동작을 더 포함할 수 있다.

본 발명의 다양한 실시예에서, 전자 장치의 제어 방법은, 이벤트 및 상기 이벤트에 대응하는 모션 데이터 사이의 연관 정보를 독출하는 동작; 및 상기 이벤트를 검출하면, 상기 이벤트에 대응하는 모션 데이터를 반영하여 상기 모션 데이터를 생성하는 동작을 더 포함할 수 있다.

본 발명의 다양한 실시예에서, 전자 장치의 제어 방법은, 사용자 및 상기 사용자에 대응하는 모션 데이터 사이의 연관 정보를 독출하는 동작; 상기 사용자를 식별하는 동작; 및 상기 식별된 사용자에 대응하는 모션 데이터를 반영하여 상기 모션 데이터를 생성하는 동작을 더 포함할 수 있다.

상기 전자 장치의 전술한 구성요소들 각각은 하나 또는 그 이상의 부품(component)으로 구성될 수 있으며, 해당 구성 요소의 명칭은 전자 장치의 종류에 따라서 달라질 수 있다. 다양한 실시예에서, 전자 장치는 전술한 구성요소 중 적어도 하나를 포함하여 구성될 수 있으며, 일부 구성요소가 생략되거나 또는 추가적인 다른 구성요소를 더 포함할 수 있다. 또한, 다양한 실시예에 따른 전자 장치의 구성 요소들 중 일부가 결합되어 하나의 개체(entity)로 구성됨으로써, 결합되기 이전의 해당 구성 요소들의 기능을 동일하게 수행할 수 있다.

본 문서에서 사용된 용어 “모듈”은, 예를 들면, 하드웨어, 소프트웨어 또는 펌웨어(firmware) 중 하나 또는 둘 이상의 조합을 포함하는 단위(unit)를 의미할 수 있다. “모듈”은, 예를 들면, 유닛(unit), 로직(logic), 논리 블록(logical block), 부품(component), 또는 회로(circuit) 등의 용어와 바꾸어 사용(interchangeably use)될 수 있다. “모듈”은, 일체로 구성된 부품의 최소 단위 또는 그 일부가 될 수 있다. “모듈”은 하나 또는 그 이상의 기능을 수행하는 최소 단위 또는 그 일부가 될 수도 있다. “모듈”은 기계적으로 또는 전자적으로 구현될 수 있다. 예를 들면,“모듈”은, 알려졌거나 앞으로 개발될, 어떤 동작들을 수행하는 ASIC(application-specific integrated circuit) 칩, FPGAs(field-programmable gate arrays) 또는 프로그램 가능 논리 장치(programmable-logic device) 중 적어도 하나를 포함할 수 있다.

다양한 실시예에 따른 장치(예: 모듈들 또는 그 기능들) 또는 방법(예: 동작들)의 적어도 일부는, 예컨대, 프로그램 모듈의 형태로 컴퓨터로 읽을 수 있는 저장매체(computer-readable storage media)에 저장된 명령어로 구현될 수 있다. 상기 명령어는, 프로세서(예: 프로세서(120))에 의해 실행될 경우, 상기 하나 이상의 프로세서가 상기 명령어에 해당하는 기능을 수행할 수 있다. 컴퓨터로 읽을 수 있는 저장매체는, 예를 들면, 상기 메모리(130)가 될 수 있다.

상기 컴퓨터로 판독 가능한 기록 매체는, 하드디스크, 플로피디스크, 마그네틱 매체(magnetic media)(예: 자기테이프), 광기록 매체(optical media)(예: CD-ROM(compact disc read only memory), DVD(digital versatile disc), 자기-광 매체(magneto-optical media)(예: 플롭티컬 디스크(floptical disk)), 하드웨어 장치(예: ROM(read only memory), RAM(random access memory), 또는 플래시 메모리 등) 등을 포함할 수 있다. 또한, 프로그램 명령에는 컴파일러에 의해 만들어지는 것과 같은 기계어 코드뿐만 아니라 인터프리터 등을 사용해서 컴퓨터에 의해서 실행될 수 있는 고급 언어 코드를 포함할 수 있다. 상술한 하드웨어 장치는 다양한 실시예의 동작을 수행하기 위해 하나 이상의 소프트웨어 모듈로서 작동하도록 구성될 수 있으며, 그 역도 마찬가지다.

다양한 실시예에 따른 모듈 또는 프로그램 모듈은 전술한 구성요소들 중 적어도 하나 이상을 포함하거나, 일부가 생략되거나, 또는 추가적인 다른 구성요소를 더 포함할 수 있다. 다양한 실시예에 따른 모듈, 프로그램 모듈 또는 다른 구성요소에 의해 수행되는 동작들은 순차적, 병렬적, 반복적 또는 휴리스틱(heuristic)한 방법으로 실행될 수 있다. 또한, 일부 동작은 다른 순서로 실행되거나, 생략되거나, 또는 다른 동작이 추가될 수 있다.

본 발명의 다양한 실시예에 따르면, 명령들을 저장하고 있는 저장 매체에 있어서, 상기 명령들은 적어도 하나의 프로세서에 의하여 실행될 때에 상기 적어도 하나의 프로세서로 하여금 적어도 하나의 동작을 수행하도록 설정된 것으로서, 상기 적어도 하나의 동작은, 외부 음성에 대한 음성 데이터를 획득하는 동작; 사용자 모션을 센싱하는 동작; 상기 센싱된 사용자 모션에 대응하는 모션 데이터를 생성하고, 상기 음성 데이터 및 상기 모션 데이터를 시간적으로 동기화하여, 다른 전자 장치로 송신하는 동작을 포함할 수 있다.

그리고 본 문서에 개시된 실시예는 개시된, 기술 내용의 설명 및 이해를 위해 제시된 것이며, 본 개시의 범위를 한정하는 것은 아니다. 따라서, 본 개시의 범위는, 본 개시의 기술적 사상에 근거한 모든 변경 또는 다양한 다른 실시예를 포함하는 것으로 해석되어야 한다.

Claims (22)

- 전자 장치에 있어서,

외부 음성을 음성 데이터로 처리하는 마이크;

사용자 모션을 센싱하는 센서;

다른 전자 장치와 통신 세션을 형성하는 통신 모듈;

상기 통신 모듈 및 상기 센서에 전기적으로 연결된 프로세서; 및

상기 프로세서에 전기적으로 연결된 메모리

를 포함하고,

상기 메모리는, 실행시에 상기 프로세서가,

상기 센싱된 사용자 모션에 대응하는 모션 데이터를 생성하고,

상기 음성 데이터 및 상기 모션 데이터를 시간적으로 동기화하여, 상기 통신 세션을 통하여, 상기 다른 전자 장치로 송신하는 인스트럭션을 저장하는 전자 장치. - 제 1 항에 있어서,

상기 메모리는, 실행시에 상기 프로세서가,

상기 음성 데이터 및 상기 모션 데이터를 기설정된 프로토콜에 따라 합성한 합성 데이터를 생성하고,

상기 합성 데이터를 상기 통신 세션을 통하여, 상기 다른 전자 장치로 송신하는 인스트럭션을 저장하는 전자 장치. - 제 1 항에 있어서,

상기 모션 데이터는, 상기 다른 전자 장치에 포함된 적어도 하나의 모터를 구동하기 위한 정보를 포함하는 전자 장치. - 제 3 항에 있어서,

상기 모션 데이터는, 모터 식별 정보, 구동 시간, 구동 방향, 구동 정도 및 구동 속도 중 적어도 하나를 포함하는 전자 장치. - 제 3 항에 있어서,

상기 모션 데이터는, 모터 식별 정보, 구동 시간, 구동 방향, 구동 정도 및 구동 속도 중 적어도 하나에 대응하는 파라미터를 포함하며,

상기 다른 전자 장치는, 상기 파라미터에 대응하는 모터 식별 정보, 구동 시간, 구동 방향, 구동 정도 및 구동 속도 중 적어도 하나를 이용하여, 상기 다른 전자 장치에 포함된 적어도 하나의 모터를 구동하는 전자 장치. - 제 1 항에 있어서,

상기 메모리는, 실행시에 상기 프로세서가,

상기 다른 전자 장치의 캐퍼빌리티 정보를 획득하고,

상기 캐퍼빌리티 정보에 기초하여, 상기 모션 데이터를 생성하는 인스트럭션을 저장하는 전자 장치. - 제 6 항에 있어서,

상기 캐퍼빌리티 정보는, 상기 다른 전자 장치의 물리적 정보, 성장 모델 및 관계 모델 중 적어도 하나를 포함하는 전자 장치. - 제 1 항에 있어서,

카메라

를 더 포함하고,

상기 메모리는, 실행시에 상기 프로세서가,

영상 통화를 수행할지 또는 모션 통화를 수행할지 여부를 선택받고,

상기 영상 통화가 선택된 경우에는, 상기 카메라로부터 출력되는 이미지를 상기 음성 데이터와 시간적으로 동기화하여 상기 다른 전자 장치로 송신하고,

상기 모션 통화가 선택된 경우에는, 상기 모션 데이터를 상기 음성 데이터와 시간적으로 동기화하여 상기 다른 전자 장치로 송신하는 인스트럭션을 저장하는 전자 장치. - 제 1 항에 있어서,

적어도 하나의 모터; 및

스피커

를 더 포함하고,

상기 메모리는, 실행시에 상기 프로세서가,

상기 다른 전자 장치로부터 다른 전자 장치의 모션 데이터 및 다른 전자 장치의 음성 데이터를 획득하고,

상기 다른 전자 장치의 모션 데이터에 기초하여, 상기 적어도 하나의 모터를 구동하며,

상기 다른 전자 장치의 음성 데이터를 상기 스피커를 통하여 출력하는 인스트럭션을 저장하는 전자 장치. - 제 1 항에 있어서,

상기 메모리는, 이벤트 및 상기 이벤트에 대응하는 모션 데이터 사이의 연관 정보를 저장하고,

상기 메모리는, 실행시에 상기 프로세서가,

상기 이벤트를 검출하면, 상기 이벤트에 대응하는 모션 데이터를 반영하여 상기 모션 데이터를 생성하는 인스트럭션을 저장하는 전자 장치. - 제 1 항에 있어서,

상기 메모리는, 사용자 및 상기 사용자에 대응하는 모션 데이터 사이의 연관 정보를 저장하고,

상기 메모리는, 실행시에 상기 프로세서가,

상기 사용자를 식별하고,

상기 식별된 사용자에 대응하는 모션 데이터를 반영하여 상기 모션 데이터를 생성하는 인스트럭션을 저장하는 전자 장치. - 전자 장치의 제어 방법에 있어서,

외부 음성에 대한 음성 데이터를 획득하는 동작;

사용자 모션을 센싱하는 동작; 및

상기 센싱된 사용자 모션에 대응하는 모션 데이터를 생성하고, 상기 음성 데이터 및 상기 모션 데이터를 시간적으로 동기화하여, 다른 전자 장치로 송신하는 동작

을 포함하는 전자 장치의 제어 방법. - 제 12 항에 있어서,

상기 음성 데이터 및 상기 모션 데이터를 기설정된 프로토콜에 따라 합성한 합성 데이터를 생성하는 동작; 및

상기 합성 데이터를 상기 다른 전자 장치로 송신하는 동작을

더 포함하는 전자 장치의 제어 방법. - 제 12 항에 있어서,

상기 모션 데이터는, 상기 다른 전자 장치에 포함된 적어도 하나의 모터를 구동하기 위한 정보를 포함하는 전자 장치의 제어 방법. - 제 14 항에 있어서,

상기 모션 데이터는, 모터 식별 정보, 구동 시간, 구동 방향, 구동 정도 및 구동 속도 중 적어도 하나를 포함하는 전자 장치의 제어 방법. - 제 14 항에 있어서,

상기 모션 데이터는, 모터 식별 정보, 구동 시간, 구동 방향, 구동 정도 및 구동 속도 중 적어도 하나에 대응하는 파라미터를 포함하며,

상기 다른 전자 장치는, 상기 파라미터에 대응하는 모터 식별 정보, 구동 시간, 구동 방향, 구동 정도 및 구동 속도 중 적어도 하나를 이용하여, 상기 다른 전자 장치에 포함된 적어도 하나의 모터를 구동하는 전자 장치의 제어 방법. - 제 12 항에 있어서,

상기 다른 전자 장치의 캐퍼빌리티 정보를 획득하는 동작; 및

상기 캐퍼빌리티 정보에 기초하여, 상기 모션 데이터를 생성하는 동작

을 더 포함하는 전자 장치의 제어 방법. - 제 17 항에 있어서,

상기 캐퍼빌리티 정보는, 상기 다른 전자 장치의 물리적 정보, 성장 모델 및 관계 모델 중 적어도 하나를 포함하는 전자 장치의 제어 방법. - 제 12 항에 있어서,

영상 통화를 수행할지 또는 모션 통화를 수행할지 여부를 선택받는 동작;

상기 영상 통화가 선택된 경우에는, 획득된 이미지를 상기 음성 데이터와 시간적으로 동기화하여 상기 다른 전자 장치로 송신하는 동작; 및

상기 모션 통화가 선택된 경우에는, 상기 모션 데이터를 상기 음성 데이터와 시간적으로 동기화하여 상기 다른 전자 장치로 송신하는 동작

을 더 포함하는 전자 장치의 제어 방법. - 제 12 항에 있어서,

상기 다른 전자 장치로부터 다른 전자 장치의 모션 데이터 및 다른 전자 장치의 음성 데이터를 획득하는 동작;

상기 다른 전자 장치의 모션 데이터에 기초하여, 상기 전자 장치의 적어도 하나의 모터를 구동하는 동작; 및

상기 다른 전자 장치의 음성 데이터를 상기 전자 장치의 스피커를 통하여 출력하는 동작

을 더 포함하는 전자 장치의 제어 방법. - 제 12 항에 있어서,

이벤트 및 상기 이벤트에 대응하는 모션 데이터 사이의 연관 정보를 독출하는 동작; 및

상기 이벤트를 검출하면, 상기 이벤트에 대응하는 모션 데이터를 반영하여 상기 모션 데이터를 생성하는 동작

을 더 포함하는 전자 장치의 제어 방법. - 제 12 항에 있어서,

사용자 및 상기 사용자에 대응하는 모션 데이터 사이의 연관 정보를 독출하는 동작;

상기 사용자를 식별하는 동작; 및

상기 식별된 사용자에 대응하는 모션 데이터를 반영하여 상기 모션 데이터를 생성하는 동작

을 더 포함하는 전자 장치의 제어 방법.

Priority Applications (2)

| Application Number | Priority Date | Filing Date | Title |

|---|---|---|---|

| KR1020150155160A KR20170052976A (ko) | 2015-11-05 | 2015-11-05 | 모션을 수행하는 전자 장치 및 그 제어 방법 |

| US15/235,706 US20170134694A1 (en) | 2015-11-05 | 2016-08-12 | Electronic device for performing motion and control method thereof |

Applications Claiming Priority (1)

| Application Number | Priority Date | Filing Date | Title |

|---|---|---|---|

| KR1020150155160A KR20170052976A (ko) | 2015-11-05 | 2015-11-05 | 모션을 수행하는 전자 장치 및 그 제어 방법 |

Publications (1)

| Publication Number | Publication Date |

|---|---|

| KR20170052976A true KR20170052976A (ko) | 2017-05-15 |

Family

ID=58663987

Family Applications (1)

| Application Number | Title | Priority Date | Filing Date |

|---|---|---|---|

| KR1020150155160A Withdrawn KR20170052976A (ko) | 2015-11-05 | 2015-11-05 | 모션을 수행하는 전자 장치 및 그 제어 방법 |

Country Status (2)

| Country | Link |

|---|---|

| US (1) | US20170134694A1 (ko) |

| KR (1) | KR20170052976A (ko) |

Cited By (5)

| Publication number | Priority date | Publication date | Assignee | Title |

|---|---|---|---|---|

| KR20190010295A (ko) * | 2017-07-21 | 2019-01-30 | 윤영섭 | 치매 예방 로봇 |

| KR20190081902A (ko) * | 2017-12-29 | 2019-07-09 | 서울시립대학교 산학협력단 | 원통형 곡면 디스플레이 및 이를 포함하는 로봇 |

| KR20200023671A (ko) * | 2018-08-14 | 2020-03-06 | 엘지전자 주식회사 | 차량에 구비된 차량용 로봇 및 차량용 로봇의 제어방법 |

| KR102215256B1 (ko) * | 2019-11-18 | 2021-02-15 | 주식회사 인공지능연구원 | 동기화된 음성과 동작을 지원하는 멀티미디어 저작 장치 및 그 방법 |

| KR20250000353A (ko) * | 2023-06-26 | 2025-01-03 | 트라이콤텍 주식회사 | 5g 기반의 메타버스 모션동기화 시스템 및 이를 이용한 메타버스 모션동기화 방법 |

Families Citing this family (7)

| Publication number | Priority date | Publication date | Assignee | Title |

|---|---|---|---|---|

| US11140372B2 (en) * | 2017-01-26 | 2021-10-05 | D-Box Technologies Inc. | Capturing and synchronizing motion with recorded audio/video |

| US10698068B2 (en) | 2017-03-24 | 2020-06-30 | Samsung Electronics Co., Ltd. | System and method for synchronizing tracking points |

| KR102090636B1 (ko) * | 2018-09-14 | 2020-03-18 | 엘지전자 주식회사 | 로봇, 로봇 시스템 및 그 동작 방법 |

| WO2020241951A1 (ko) * | 2019-05-31 | 2020-12-03 | 엘지전자 주식회사 | 인공지능 학습방법 및 이를 이용하는 로봇의 동작방법 |

| US11475618B2 (en) | 2020-05-11 | 2022-10-18 | Sony Interactive Entertainment Inc. | Dynamic vision sensor for visual audio processing |

| CN113289322A (zh) * | 2020-08-28 | 2021-08-24 | 国华(广州)投资发展有限公司 | 一种室内运动模拟装置 |

| JP2025124424A (ja) * | 2024-02-14 | 2025-08-26 | ヤマハ株式会社 | データ処理方法およびデータ処理装置 |

Family Cites Families (19)

| Publication number | Priority date | Publication date | Assignee | Title |

|---|---|---|---|---|

| US6337552B1 (en) * | 1999-01-20 | 2002-01-08 | Sony Corporation | Robot apparatus |

| US20020095613A1 (en) * | 1997-07-25 | 2002-07-18 | Shinya Matsuoka | Synchronizing motion and time-based data for transfer between a server and a client |

| JPH11126017A (ja) * | 1997-08-22 | 1999-05-11 | Sony Corp | 記憶媒体、ロボット、情報処理装置、並びに電子ペットシステム |

| EP0973129A3 (en) * | 1998-07-17 | 2005-01-12 | Matsushita Electric Industrial Co., Ltd. | Motion image data compression system |

| US6445978B1 (en) * | 1999-05-10 | 2002-09-03 | Sony Corporation | Robot device and method for controlling the same |

| US6507773B2 (en) * | 2001-06-14 | 2003-01-14 | Sharper Image Corporation | Multi-functional robot with remote and video system |

| JP2003205483A (ja) * | 2001-11-07 | 2003-07-22 | Sony Corp | ロボットシステム及びロボット装置の制御方法 |

| JP2003283604A (ja) * | 2002-03-20 | 2003-10-03 | Oki Electric Ind Co Ltd | 表情伝送機能付情報端末装置 |

| US20090044112A1 (en) * | 2007-08-09 | 2009-02-12 | H-Care Srl | Animated Digital Assistant |

| US9418705B2 (en) * | 2010-08-26 | 2016-08-16 | Blast Motion Inc. | Sensor and media event detection system |

| US20120239396A1 (en) * | 2011-03-15 | 2012-09-20 | At&T Intellectual Property I, L.P. | Multimodal remote control |

| US20130335405A1 (en) * | 2012-06-18 | 2013-12-19 | Michael J. Scavezze | Virtual object generation within a virtual environment |

| US9654120B2 (en) * | 2012-07-26 | 2017-05-16 | Qualcomm Incorporated | System and method of determining an oscillator gain |

| JP6102111B2 (ja) * | 2012-07-27 | 2017-03-29 | 富士通株式会社 | 送信装置、通信装置、データ送信プログラム及びデータ送信方法 |

| JP5916566B2 (ja) * | 2012-08-29 | 2016-05-11 | アルパイン株式会社 | 情報システム |

| JP6093040B2 (ja) * | 2013-03-14 | 2017-03-08 | インテル コーポレイション | サービスを提供するための装置、方法、コンピュータプログラム及び記憶媒体 |

| EP2972669B1 (en) * | 2013-03-14 | 2019-07-24 | Intel Corporation | Depth-based user interface gesture control |

| US20140310764A1 (en) * | 2013-04-12 | 2014-10-16 | Verizon Patent And Licensing Inc. | Method and apparatus for providing user authentication and identification based on gestures |

| US9358685B2 (en) * | 2014-02-03 | 2016-06-07 | Brain Corporation | Apparatus and methods for control of robot actions based on corrective user inputs |

-

2015

- 2015-11-05 KR KR1020150155160A patent/KR20170052976A/ko not_active Withdrawn

-

2016

- 2016-08-12 US US15/235,706 patent/US20170134694A1/en not_active Abandoned

Cited By (5)

| Publication number | Priority date | Publication date | Assignee | Title |

|---|---|---|---|---|

| KR20190010295A (ko) * | 2017-07-21 | 2019-01-30 | 윤영섭 | 치매 예방 로봇 |

| KR20190081902A (ko) * | 2017-12-29 | 2019-07-09 | 서울시립대학교 산학협력단 | 원통형 곡면 디스플레이 및 이를 포함하는 로봇 |

| KR20200023671A (ko) * | 2018-08-14 | 2020-03-06 | 엘지전자 주식회사 | 차량에 구비된 차량용 로봇 및 차량용 로봇의 제어방법 |

| KR102215256B1 (ko) * | 2019-11-18 | 2021-02-15 | 주식회사 인공지능연구원 | 동기화된 음성과 동작을 지원하는 멀티미디어 저작 장치 및 그 방법 |

| KR20250000353A (ko) * | 2023-06-26 | 2025-01-03 | 트라이콤텍 주식회사 | 5g 기반의 메타버스 모션동기화 시스템 및 이를 이용한 메타버스 모션동기화 방법 |

Also Published As

| Publication number | Publication date |

|---|---|

| US20170134694A1 (en) | 2017-05-11 |

Similar Documents

| Publication | Publication Date | Title |

|---|---|---|

| US10217349B2 (en) | Electronic device and method for controlling the electronic device | |

| KR102559625B1 (ko) | 증강 현실 출력 방법 및 이를 지원하는 전자 장치 | |

| KR102264806B1 (ko) | 스크린 미러링 서비스 제공방법 및 장치 | |

| KR20170052976A (ko) | 모션을 수행하는 전자 장치 및 그 제어 방법 | |

| US20170046123A1 (en) | Device for providing sound user interface and method thereof | |

| US10586390B2 (en) | Virtual reality electronic device for displaying combined graphic object and image frame and corresponding computer-readable recording medium | |

| KR102561572B1 (ko) | 센서 활용 방법 및 이를 구현한 전자 장치 | |

| KR20180083587A (ko) | 전자 장치 및 그의 동작 방법 | |

| EP3469787B1 (en) | Electronic device and computer-readable recording medium for displaying images | |

| CN117492522A (zh) | 电子设备以及用于显示其运行的应用的历史的方法 | |

| CN108141490B (zh) | 用于处理图像的电子设备及其控制方法 | |

| KR20160105242A (ko) | 스크린 미러링 서비스 제공장치 및 방법 | |