CN112364725B - 基于小型无人机群的棉花虫害立体监测方法与系统 - Google Patents

基于小型无人机群的棉花虫害立体监测方法与系统 Download PDFInfo

- Publication number

- CN112364725B CN112364725B CN202011162451.7A CN202011162451A CN112364725B CN 112364725 B CN112364725 B CN 112364725B CN 202011162451 A CN202011162451 A CN 202011162451A CN 112364725 B CN112364725 B CN 112364725B

- Authority

- CN

- China

- Prior art keywords

- cotton

- unmanned aerial

- aerial vehicle

- monitoring

- depth

- Prior art date

- Legal status (The legal status is an assumption and is not a legal conclusion. Google has not performed a legal analysis and makes no representation as to the accuracy of the status listed.)

- Active

Links

Images

Classifications

-

- G—PHYSICS

- G06—COMPUTING OR CALCULATING; COUNTING

- G06V—IMAGE OR VIDEO RECOGNITION OR UNDERSTANDING

- G06V20/00—Scenes; Scene-specific elements

- G06V20/10—Terrestrial scenes

- G06V20/188—Vegetation

-

- G—PHYSICS

- G01—MEASURING; TESTING

- G01N—INVESTIGATING OR ANALYSING MATERIALS BY DETERMINING THEIR CHEMICAL OR PHYSICAL PROPERTIES

- G01N21/00—Investigating or analysing materials by the use of optical means, i.e. using sub-millimetre waves, infrared, visible or ultraviolet light

- G01N21/84—Systems specially adapted for particular applications

-

- G—PHYSICS

- G01—MEASURING; TESTING

- G01N—INVESTIGATING OR ANALYSING MATERIALS BY DETERMINING THEIR CHEMICAL OR PHYSICAL PROPERTIES

- G01N21/00—Investigating or analysing materials by the use of optical means, i.e. using sub-millimetre waves, infrared, visible or ultraviolet light

- G01N21/84—Systems specially adapted for particular applications

- G01N21/88—Investigating the presence of flaws or contamination

- G01N21/8851—Scan or image signal processing specially adapted therefor, e.g. for scan signal adjustment, for detecting different kinds of defects, for compensating for structures, markings, edges

-

- G—PHYSICS

- G06—COMPUTING OR CALCULATING; COUNTING

- G06F—ELECTRIC DIGITAL DATA PROCESSING

- G06F18/00—Pattern recognition

- G06F18/20—Analysing

- G06F18/21—Design or setup of recognition systems or techniques; Extraction of features in feature space; Blind source separation

- G06F18/214—Generating training patterns; Bootstrap methods, e.g. bagging or boosting

-

- G—PHYSICS

- G06—COMPUTING OR CALCULATING; COUNTING

- G06F—ELECTRIC DIGITAL DATA PROCESSING

- G06F18/00—Pattern recognition

- G06F18/20—Analysing

- G06F18/24—Classification techniques

-

- G—PHYSICS

- G06—COMPUTING OR CALCULATING; COUNTING

- G06N—COMPUTING ARRANGEMENTS BASED ON SPECIFIC COMPUTATIONAL MODELS

- G06N3/00—Computing arrangements based on biological models

- G06N3/02—Neural networks

- G06N3/04—Architecture, e.g. interconnection topology

- G06N3/045—Combinations of networks

-

- G—PHYSICS

- G06—COMPUTING OR CALCULATING; COUNTING

- G06N—COMPUTING ARRANGEMENTS BASED ON SPECIFIC COMPUTATIONAL MODELS

- G06N3/00—Computing arrangements based on biological models

- G06N3/02—Neural networks

- G06N3/08—Learning methods

-

- G—PHYSICS

- G06—COMPUTING OR CALCULATING; COUNTING

- G06Q—INFORMATION AND COMMUNICATION TECHNOLOGY [ICT] SPECIALLY ADAPTED FOR ADMINISTRATIVE, COMMERCIAL, FINANCIAL, MANAGERIAL OR SUPERVISORY PURPOSES; SYSTEMS OR METHODS SPECIALLY ADAPTED FOR ADMINISTRATIVE, COMMERCIAL, FINANCIAL, MANAGERIAL OR SUPERVISORY PURPOSES, NOT OTHERWISE PROVIDED FOR

- G06Q50/00—Information and communication technology [ICT] specially adapted for implementation of business processes of specific business sectors, e.g. utilities or tourism

- G06Q50/02—Agriculture; Fishing; Forestry; Mining

-

- G—PHYSICS

- G06—COMPUTING OR CALCULATING; COUNTING

- G06T—IMAGE DATA PROCESSING OR GENERATION, IN GENERAL

- G06T7/00—Image analysis

- G06T7/80—Analysis of captured images to determine intrinsic or extrinsic camera parameters, i.e. camera calibration

-

- G—PHYSICS

- G01—MEASURING; TESTING

- G01N—INVESTIGATING OR ANALYSING MATERIALS BY DETERMINING THEIR CHEMICAL OR PHYSICAL PROPERTIES

- G01N21/00—Investigating or analysing materials by the use of optical means, i.e. using sub-millimetre waves, infrared, visible or ultraviolet light

- G01N21/84—Systems specially adapted for particular applications

- G01N2021/8466—Investigation of vegetal material, e.g. leaves, plants, fruits

-

- G—PHYSICS

- G01—MEASURING; TESTING

- G01N—INVESTIGATING OR ANALYSING MATERIALS BY DETERMINING THEIR CHEMICAL OR PHYSICAL PROPERTIES

- G01N21/00—Investigating or analysing materials by the use of optical means, i.e. using sub-millimetre waves, infrared, visible or ultraviolet light

- G01N21/84—Systems specially adapted for particular applications

- G01N21/88—Investigating the presence of flaws or contamination

- G01N21/8851—Scan or image signal processing specially adapted therefor, e.g. for scan signal adjustment, for detecting different kinds of defects, for compensating for structures, markings, edges

- G01N2021/8887—Scan or image signal processing specially adapted therefor, e.g. for scan signal adjustment, for detecting different kinds of defects, for compensating for structures, markings, edges based on image processing techniques

-

- G—PHYSICS

- G06—COMPUTING OR CALCULATING; COUNTING

- G06T—IMAGE DATA PROCESSING OR GENERATION, IN GENERAL

- G06T2207/00—Indexing scheme for image analysis or image enhancement

- G06T2207/20—Special algorithmic details

- G06T2207/20081—Training; Learning

-

- G—PHYSICS

- G06—COMPUTING OR CALCULATING; COUNTING

- G06T—IMAGE DATA PROCESSING OR GENERATION, IN GENERAL

- G06T2207/00—Indexing scheme for image analysis or image enhancement

- G06T2207/20—Special algorithmic details

- G06T2207/20084—Artificial neural networks [ANN]

-

- G—PHYSICS

- G06—COMPUTING OR CALCULATING; COUNTING

- G06T—IMAGE DATA PROCESSING OR GENERATION, IN GENERAL

- G06T2207/00—Indexing scheme for image analysis or image enhancement

- G06T2207/30—Subject of image; Context of image processing

- G06T2207/30181—Earth observation

- G06T2207/30188—Vegetation; Agriculture

Landscapes

- Engineering & Computer Science (AREA)

- Theoretical Computer Science (AREA)

- Physics & Mathematics (AREA)

- General Physics & Mathematics (AREA)

- Life Sciences & Earth Sciences (AREA)

- Data Mining & Analysis (AREA)

- General Health & Medical Sciences (AREA)

- Health & Medical Sciences (AREA)

- Artificial Intelligence (AREA)

- Computer Vision & Pattern Recognition (AREA)

- Evolutionary Computation (AREA)

- General Engineering & Computer Science (AREA)

- Mathematical Physics (AREA)

- Pathology (AREA)

- Biomedical Technology (AREA)

- Biophysics (AREA)

- Computational Linguistics (AREA)

- Bioinformatics & Computational Biology (AREA)

- Molecular Biology (AREA)

- Computing Systems (AREA)

- Bioinformatics & Cheminformatics (AREA)

- Software Systems (AREA)

- Business, Economics & Management (AREA)

- Chemical & Material Sciences (AREA)

- Analytical Chemistry (AREA)

- Biochemistry (AREA)

- Immunology (AREA)

- Evolutionary Biology (AREA)

- Economics (AREA)

- General Business, Economics & Management (AREA)

- Animal Husbandry (AREA)

- Marine Sciences & Fisheries (AREA)

- Mining & Mineral Resources (AREA)

- Multimedia (AREA)

- Marketing (AREA)

- Signal Processing (AREA)

- Agronomy & Crop Science (AREA)

- Primary Health Care (AREA)

- Strategic Management (AREA)

- Tourism & Hospitality (AREA)

Abstract

本发明公开了一种基于小型无人机群的棉花虫害立体监测方法与系统,包括:包括:在地面站的地图模块上划定监测的棉田区域,根据无人机群的飞机数量划分若干个监测单元;通过数传模块将每个监测点位置发送给对应的无人机,无人机群根据任务规划飞行至监测点;无人机基于立体视觉技术,获得冠层的深度及正下方垄沟的深度,依据深度信息飞行至棉花植株的上、中、下部;无人机采集棉花植株的侧面图像并且进行虫害侵蚀分类,同时将虫害信息发送至地面站;地面站在接收到所有监测点的虫害信息之后,基于贪心算法生成施药无人机的作业路径规划。本发明可近距离有效监测棉花中部和底部出现的虫害信息,快速有效监测大范围棉田的虫害分布情况。

Description

技术领域

本发明涉及无人机遥感的技术领域,尤其是指一种基于小型无人机群的棉花虫害立体监测方法与系统。

背景技术

蚜虫和红蜘蛛等虫害侵蚀是棉花生产管理过程中面临的主要问题,对棉花的产量和质量有重要影响。采用无人机遥感监测棉田的虫害分布情况,可以为虫害防控的施药作业提供决策依据,有望在保证药效的前提下减少化学药剂的使用。然而,蚜虫和红蜘蛛等主要棉花害虫大多位于棉花的中部和下部,传统无人机遥感仅能采集到棉花顶部冠层的信息,因此无法对位于棉花中部和下部的虫害信息进行评估。

发明内容

本发明的目的在于克服现有技术的缺点与不足,提出了一种基于小型无人机群的棉花虫害立体监测方法与系统,克服传统无人机遥感无法获取棉花中下层信息的不足,可以同时对棉花上中下层的虫害信息进行监测,从而客观全面评估棉花所遭受的虫害胁迫程度。

为实现上述目的,本发明所提供的技术方案如下:

基于小型无人机群的棉花虫害立体监测方法,包括以下步骤:

S1、在地面站的地图模块上划定监测的棉田区域,根据无人机群的无人机数量划分若干个监测单元;对每个监测单元,地面站划分等间距的二维监测点,通过数传模块将每个监测点位置发送给对应的无人机,所述无人机的机载芯片驱动无人机以统一高度飞行至指定位置;

S2、到达指定位置后,所述无人机将云台双目相机垂直向下,采集正下方的棉田图像,所述无人机的机载芯片通过有线连接实时获取云台双目相机采集的图片,基于SSD模型检测出棉花冠层和棉田垄沟的位置,所述无人机的机载芯片控制无人机飞行至距离最近的棉田垄沟,使得棉田垄沟的位置位于所采集图像的正中间;

S3、所述无人机基于立体视觉技术,获得冠层的深度及正下方垄沟的深度,依据深度信息飞行至棉花植株的上部、中部、下部;

S4、所述无人机在到达棉花植株的每个位置时,将云台双目相机水平放置,采集棉花植株的侧面图像,所述无人机的机载芯片根据所采集的棉花侧面图像,基于卷积神经网络进行虫害侵蚀分类;

S5、所述无人机在完成棉花虫害的立体监测之后,上升至下降前的高度,通过机载数传模块将监测点的GPS坐标、棉花上中下层的虫害侵蚀类别发送给地面站;所述地面站在接收到监测单元中所有无人机的监测报告之后,该监测单元的监测任务完成,开始下一个监测单元的监测任务;

S6、在所有监测单元的监测任务完成之后,所述地面站接收到所有监测点的虫害信息,仅保留出现虫害的监测点的位置信息,基于贪心算法生成施药无人机的作业路径规划,至此,无人机群的棉花虫害立体监测任务完成。

进一步,所述步骤S1包括以下步骤:

S101、在地面站的地图模块上划定整个待监测的棉田区域,计算棉田区域的宽度和高度;其中,所述待监测的棉田区域仅包含航空植保作业中常见的矩形区域;

S102、地面站根据小型无人机群的无人机数量及单个无人机的监测范围,计算监测单元的面积;所述监测单元的面积按下面公式计算:

wunit=a×wplane

hunit=b×hplane

式中,wunit和hunit是监测单元的宽度和高度,wplane和hplane是单个无人机监测范围的宽度和高度,a×b是无人机群的无人机数量;其中,a代表无人机群在横向上的无人机数量,b代表无人机群在纵向上的无人机数量;所述地面站根据监测单元的宽度和高度计算监测单元的数量,所述监测单元的数量按下面公式计算:

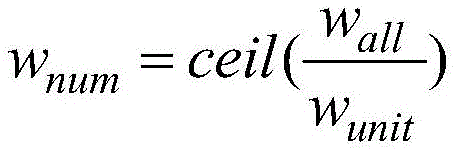

其中,wnum和hnum是监测单元在横向和纵向上的数量,wall和hall是整个待监测棉田区域的宽度和高度,ceil函数代表向上取整操作;

S103、所述地面站在二维空间上,将第一个监测区域划分为等间距的a×b个监测点;其中,监测点的数量与无人机群的无人机数量相等,每个监测点对应于一台无人机;所述地面站基于数传模块,将监测点的位置发送给对应的无人机;所述无人机的机载芯片,根据机载数传模块接收到监测点位置信息,以统一高度驱动无人机飞行至指定位置。

进一步,所述步骤S2包括以下步骤:

S201、获取用于棉花冠层和棉田垄沟检测的SSD模型,任务开始前将该SSD模型部署在每一台无人机上;其中,获取用于棉花冠层和棉田垄沟检测的SSD模型的步骤,包括:

S2011、基于应用场景,设计SSD模型的网络结构,所述SSD模型包括特征提取、先验框匹配和非极大值抑制;其中,所述先验框匹配的置信度计算中,预测类别的数量需设置为2;

S2012、采集棉花田块的无人机图像,对其中棉花冠层和棉田垄沟的位置和类别进行标记,形成棉花冠层和棉田垄沟检测的数据集;将所述数据集用于SSD模型训练,计算位置误差和置信度误差,反向调整SSD模型的参数数值;

S202、所述无人机在到达监测点位置后,将云台双目相机垂直向下采集正下方的图像,通过USB有线连接将采集到的图像传送至机载芯片;机载芯片调用训练好的SSD模型,检测出棉花冠层和棉田垄沟的位置;

S203、所述无人机搜索距离最近的棉花垄沟位置,控制无人机飞行至垄沟中心上方,使得棉田垄沟的中心位置位于无人机图像的中心区域;其中,所述距离最近的棉田垄沟的确定依据,是棉田垄沟中心与图像中心距离最短;所述无人机位置调整方向和幅度,基于距离最近的棉田垄沟中心与图像中心的相对位置关系确定。

进一步,所述步骤S3包括以下步骤:

S301、在任务开始之前,对每台无人机的双目相机进行标定,获得所述双目相机的内外参数,包括相机内参数、畸变系数、左右相机的位置参数;

S302、在到达棉田垄沟正上方之后,所述无人机采集正下方的双目图像,基于相机的畸变系数进行畸变校正,计算左右相机图像中匹配的像素对,基于相机内外参数计算匹配的像素对的深度信息;

S303、基于SSD模型输出的棉花冠层和垄沟位置的信息,计算正下方垄沟区域的像素深度的平均值,以及与正下方垄沟相邻的棉花冠层的像素深度的平均值,计算棉花植株的上部、中部、下部的深度信息;其中,所述棉花植株的上部、中部、下部的深度信息由以下公式计算:

depthup=depthcrown+0.1×(depthditch-depthcrown)

depthmiddle=depthcrown+0.5×(depthditch-depthcrown)

depthdown=depthcrown+0.8×(depthditch-depthcrown)

其中,depthup、depthmiddle、depthdown分别代表棉花上部、中部、底部的深度;depthcrown和depthditch分别代表棉花冠层和棉田垄沟的深度;所述无人机在到达棉花植株上、中、下部之前,由所述无人机的机载芯片控制无人机依次下降三个幅度,这三个幅度由以下公式计算:

margin1=depthcrown+0.1×(depthditch-depthcrown)

margin2=0.4×(depthditch-depthcrown)

margin3=0.3×(depthditch-depthcrown)

其中,margin1代表无人机第一次下降的幅度,margin2代表无人机第二次下降的幅度,margin3代表无人机第三次下降的幅度。

进一步,所述步骤S4包括以下步骤:

S401、获取用于棉花虫害侵蚀分类的卷积神经网络,在任务开始前部署在每一台无人机上;其中,获取用于棉花虫害侵蚀分类的卷积神经网络的步骤,包括:

S4011、基于应用场景,设计用于棉花虫害侵蚀分类的卷积神经网络,所述卷积神经网络包括卷积层、激活层、池化层和全连接层,最后一个全连接层的输出为一个1×4的矩阵,分别代表正常、轻度、中度、重度的概率分布;

S4012、采集棉花侧面的无人机图像,根据地面调查结果进行标记,形成棉花虫害分类的数据集;将所述数据集用于卷积神经网络的训练,基于负对数似然法计算卷积神经网络输出与类别标记的差异作为误差,反向调整卷积神经网络的参数数值;

S402、在所述无人机到达棉花植株的每个位置时,将无人机的云台双目相机水平放置,采集棉花植株的侧面图像,通过USB连接线实时传输给无人机的机载芯片;所述无人机的机载芯片调用训练好的卷积神经网络,对棉花植株侧面的图像进行虫害分类。

进一步,所述步骤S6包括以下步骤:

S601、在所有监测单元的监测任务完成之后,所述地面站接收到所有监测点的虫害信息,忽略农情正常的监测点信息,仅保留出现虫害的监测点的位置信息,形成的监测信息表如下所示:

P1(x1,y1),P2(x2,y2),......,Pn(xn,yn)

其中,n代表保留的出现虫害的监测点的个数,Pn代表第n个点的坐标,(xn,yn)分别代表第n个点的经度、纬度;

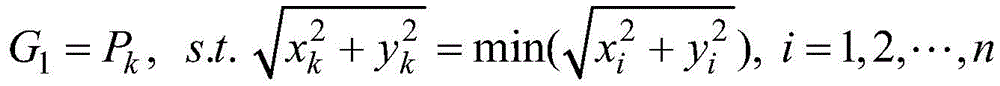

S602、基于贪心算法生成施药无人机的作业路径规划,首先确定规划路径的第一个作业点G1,确定规则为经纬度的二维范数最小,如下所示:

其中,(xk,yk)代表所述规划路径下一个作业点的经度和纬度,(xi,yi)代表监测信息表中第i个点的经度和纬度,k是1到n之间的一个整数;

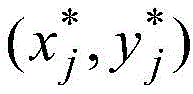

当所述贪心算法将第一个作业点G1加入规划路径后,将对应的点Pk从监测信息表中删除;所述贪心算法继续在监测信息表中搜索下一个作业点,确定依据为该点与规划路径中所有作业点的坐标差异的二维范数最小,如下所示:

其中,(xi,yi)代表监测信息表中的第i个点Pi的经度和纬度,代表规划路径中的第j个作业点Gj的经度和纬度,t代表当前监测信息表中监测点数量,s代表当前规划路径中作业点的数量,l是1到s之间的一个整数;所述贪心算法将作业点Gs+1加入规划路径,将对应的点Pk从监测信息表中删除;所述贪心算法重复执行上述过程,当监测信息表保留的信息点为空,则路径规划完成。

基于小型无人机群的棉花虫害立体监测系统,包括:

棉花冠层及垄沟位置检测单元,用于检测无人机图像中棉花冠层和垄沟的位置;其中,所述棉花冠层及垄沟位置检测单元包含特征提取、先验框匹配和非极大值抑制;所述先验框匹配的置信度计算中,预测类别的数量需设置为2,分别对应棉花及非棉花两种类别;

棉花冠层及垄沟深度计算单元,用于估算无人机正下方的垄沟及周围棉花冠层的深度;所述棉花冠层及垄沟深度估算单元包含相机标定、图像像素深度计算、棉花冠层及垄沟深度计算;其中,所述相机标定获得双目相机的内外参数;所述图像像素深度计算是根据相机的畸变系数进行畸变校正,计算左右相机图像中匹配的像素对,基于相机内外参数计算匹配的像素对的深度信息;所述棉花冠层及垄沟深度计算是根据棉花冠层和垄沟位置的信息,计算正下方垄沟区域的像素深度的平均值作为棉花垄沟深度,计算与正下方垄沟相邻的棉花冠层的像素深度的平均值作为棉花冠层深度;

棉花虫害立体监测单元,用于对棉花上部、中部、下部进行图像采集及虫害等级分类;其中,无人机位于棉花垄沟位置上方,到达棉花上、中、下部所需要下降的幅度由棉花冠层及垄沟位置的深度信息计算得到,所述图像采集由无人机到达棉花指定部位后将云台双目相机水平放置并进行图像采集获得,所述虫害等级分类由机载芯片调用预先训练好的卷积神经网络完成;

作业路径规划单元,用于在监测信息表基础上,以耗能最小化原则生成施药无人机的行进路径规划;其中,所述监测信息表包括所有出现虫害的监测点的位置信息,所述位置信息包括监测点的经度和纬度;所述施药无人机的行进路径规划,在所述监测信息表基础上由贪心算法动态规划获得,能够在保证遍历所有虫害位置的前提下实现无人机耗能最小。

本发明与现有技术相比,具有如下优点与有益效果:

本发明基于小型无人机群,在棉花不同部位进行虫害监测,从而获得棉花所遭受的虫害胁迫信息。通过单目视觉技术,引导无人机飞行至棉花株间的垄沟位置;基于双目视觉技术,测量冠层及垄沟的深度,引导无人机下降至棉花的上部、中部、下部,从而可以在棉花的不同部位进行图像采集及虫害分析。本发明的技术流程能够克服传统无人机无法获得棉花中下部信息的不足,可以全面客观评估棉花所遭受的虫害胁迫程度;由于本发明是基于小型无人机群进行监测作业,能够保证检测系统的作业效率,可以快速全面采集并解析棉花所遭受的虫害胁迫信息。总之,本发明能够近距离有效监测棉花中部和底部出现的虫害信息,避免传统无人机遥感无法收集到棉花中下层虫害信息的局限,能够快速有效监测大范围棉田的虫害分布情况,为植保无人机的精准施药作业提供决策信息。

附图说明

图1为本发明方法的流程示意图。

图2为本发明系统的架构图。

图3为待监测棉田区域的层级划分示意图。

具体实施方式

下面结合具体实施例对本发明作进一步说明。

参见图1所示,本实施例所提供的基于小型无人机群的棉花虫害立体监测方法,包括以下步骤:

S1、在地面站的地图模块上划定监测的棉田区域,根据无人机群的无人机数量划分若干个监测单元;对每个监测单元,地面站划分等间距的二维监测点,通过数传模块将每个监测点位置发送给对应的无人机,所述无人机的机载芯片驱动无人机以统一高度飞行至指定位置;其包括以下步骤:

S101、在地面站的地图模块上划定整个待监测的棉田区域,计算棉田区域的宽度和高度;其中,所述待监测的棉田区域仅包含航空植保作业中常见的矩形区域;

S102、地面站根据小型无人机群的无人机数量及单个无人机的监测范围,计算监测单元的面积;所述监测单元的面积按下面公式计算:

wunit=a×wplane

hunit=b×hplane

式中,wunit和hunit是监测单元的宽度和高度,wplane和hplane是单个无人机监测范围的宽度和高度,a×b是无人机群的无人机数量;其中,a代表无人机群在横向上的无人机数量,b代表无人机群在纵向上的无人机数量;所述地面站根据监测单元的宽度和高度计算监测单元的数量,所述监测单元的数量按下面公式计算:

其中,wnum和hnum是监测单元在横向和纵向上的数量,wall和hall是整个待监测棉田区域的宽度和高度,ceil函数代表向上取整操作;

S103、所述地面站在二维空间上,将第一个监测区域划分为等间距的a×b个监测点;其中,监测点的数量与无人机群的无人机数量相等,每个监测点对应于一台无人机;所述地面站基于数传模块,将监测点的位置发送给对应的无人机;所述无人机的机载芯片,根据机载数传模块接收到监测点位置信息,以统一高度驱动无人机飞行至指定位置。

S2、到达指定位置后,所述无人机将云台双目相机垂直向下,采集正下方的棉田图像,所述无人机的机载芯片通过有线连接实时获取云台双目相机采集的图片,基于SSD模型检测出棉花冠层和棉田垄沟的位置,所述无人机的机载芯片控制无人机飞行至距离最近的棉田垄沟,使得棉田垄沟的位置位于所采集图像的正中间;其包括以下步骤:

S201、获取用于棉花冠层和棉田垄沟检测的SSD模型,任务开始前将该SSD模型部署在每一台无人机上;其中,获取用于棉花冠层和棉田垄沟检测的SSD模型的步骤,包括:

S2011、基于应用场景,设计SSD模型的网络结构,所述SSD模型包括特征提取、先验框匹配和非极大值抑制;其中,所述先验框匹配的置信度计算中,预测类别的数量需设置为2;

S2012、采集棉花田块的无人机图像,对其中棉花冠层和棉田垄沟的位置和类别进行标记,形成棉花冠层和棉田垄沟检测的数据集;将所述数据集用于SSD模型训练,计算位置误差和置信度误差,反向调整SSD模型的参数数值;

S202、所述无人机在到达监测点位置后,将云台双目相机垂直向下采集正下方的图像,通过USB有线连接将采集到的图像传送至机载芯片;机载芯片调用训练好的SSD模型,检测出棉花冠层和棉田垄沟的位置;

S203、所述无人机搜索距离最近的棉花垄沟位置,控制无人机飞行至垄沟中心上方,使得棉田垄沟的中心位置位于无人机图像的中心区域;其中,所述距离最近的棉田垄沟的确定依据,是棉田垄沟中心与图像中心距离最短;所述无人机位置调整方向和幅度,基于距离最近的棉田垄沟中心与图像中心的相对位置关系确定。

S3、所述无人机基于立体视觉技术,获得冠层的深度及正下方垄沟的深度,依据深度信息飞行至棉花植株的上部、中部、下部;其包括以下步骤:

S301、在任务开始之前,对每台无人机的双目相机进行标定,获得所述双目相机的内外参数,包括相机内参数、畸变系数、左右相机的位置参数;

S302、在到达棉田垄沟正上方之后,所述无人机采集正下方的双目图像,基于相机的畸变系数进行畸变校正,计算左右相机图像中匹配的像素对,基于相机内外参数计算匹配的像素对的深度信息;

S303、基于SSD模型输出的棉花冠层和垄沟位置的信息,计算正下方垄沟区域的像素深度的平均值,以及与正下方垄沟相邻的棉花冠层的像素深度的平均值,计算棉花植株的上部、中部、下部的深度信息;其中,所述棉花植株的上部、中部、下部的深度信息由以下公式计算:

depthup=depthcrown+0.1×(depthditch-depthcrown)

depthmiddle=depthcrown+0.5×(depthditch-depthcrown)

depthdown=depthcrown+0.8×(depthditch-depthcrown)

其中,depthup、depthmiddle、depthdown分别代表棉花上部、中部、底部的深度;depthcrown和depthditch分别代表棉花冠层和棉田垄沟的深度;所述无人机在到达棉花植株上、中、下部之前,由所述无人机的机载芯片控制无人机依次下降三个幅度,这三个幅度由以下公式计算:

margin1=depthcrown+0.1×(depthditch-depthcrown)

margin2=0.4×(depthditch-depthcrown)

margin3=0.3×(depthditch-depthcrown)

其中,margin1代表无人机第一次下降的幅度,margin2代表无人机第二次下降的幅度,margin3代表无人机第三次下降的幅度。

S4、所述无人机在到达棉花植株的每个位置时,将云台双目相机水平放置,采集棉花植株的侧面图像,所述无人机的机载芯片根据所采集的棉花侧面图像,基于卷积神经网络进行虫害侵蚀分类;其包括以下步骤:

S401、获取用于棉花虫害侵蚀分类的卷积神经网络,在任务开始前部署在每一台无人机上;其中,获取用于棉花虫害侵蚀分类的卷积神经网络的步骤,包括:

S4011、基于应用场景,设计用于棉花虫害侵蚀分类的卷积神经网络,所述卷积神经网络包括卷积层、激活层、池化层和全连接层,最后一个全连接层的输出为一个1×4的矩阵,分别代表正常、轻度、中度、重度的概率分布;

S4012、采集棉花侧面的无人机图像,根据地面调查结果进行标记,形成棉花虫害分类的数据集;将所述数据集用于卷积神经网络的训练,基于负对数似然法计算卷积神经网络输出与类别标记的差异作为误差,反向调整卷积神经网络的参数数值;

S402、在所述无人机到达棉花植株的每个位置时,将无人机的云台双目相机水平放置,采集棉花植株的侧面图像,通过USB连接线实时传输给无人机的机载芯片;所述无人机的机载芯片调用训练好的卷积神经网络,对棉花植株侧面的图像进行虫害分类。

S5、所述无人机在完成棉花虫害的立体监测之后,上升至下降前的高度,通过机载数传模块将监测点的GPS坐标、棉花上中下层的虫害侵蚀类别发送给地面站;所述地面站在接收到监测单元中所有无人机的监测报告之后,该监测单元的监测任务完成,开始下一个监测单元的监测任务;

S6、在所有监测单元的监测任务完成之后,所述地面站接收到所有监测点的虫害信息,仅保留出现虫害的监测点的位置信息,基于贪心算法生成施药无人机的作业路径规划,至此,无人机群的棉花虫害立体监测任务完成;其包括以下步骤:

S601、在所有监测单元的监测任务完成之后,所述地面站接收到所有监测点的虫害信息,忽略农情正常的监测点信息,仅保留出现虫害的监测点的位置信息,形成的监测信息表如下所示:

P1(x1,y1),P2(x2,y2),......,Pn(xn,yn)

其中,n代表保留的出现虫害的监测点的个数,Pn代表第n个点的坐标,(xn,yn)分别代表第n个点的经度、纬度;

S602、基于贪心算法生成施药无人机的作业路径规划,首先确定规划路径的第一个作业点G1,确定规则为经纬度的二维范数最小,如下所示:

其中,(xk,yk)代表所述规划路径下一个作业点的经度和纬度,(xi,yi)代表监测信息表中第i个点的经度和纬度,k是1到n之间的一个整数。

当所述贪心算法将第一个作业点G1加入规划路径后,将对应的点Pk从监测信息表中删除;所述贪心算法继续在监测信息表中搜索下一个作业点,确定依据为该点与规划路径中所有作业点的坐标差异的二维范数最小,如下所示:

其中,(xi,yi)代表监测信息表中的第i个点Pi的经度和纬度,代表规划路径中的第j个作业点Gj的经度和纬度,t代表当前监测信息表中监测点数量,s代表当前规划路径中作业点的数量,l是1到s之间的一个整数;所述贪心算法将作业点Gs+1加入规划路径,将对应的点Pk从监测信息表中删除;所述贪心算法重复执行上述过程,当监测信息表保留的信息点为空,则路径规划完成。

参见图2所示,本实施例也提供了一种基于小型无人机群的棉花虫害立体监测系统,包括:

棉花冠层及垄沟位置检测单元,用于检测无人机图像中棉花冠层和垄沟的位置;其中,所述棉花冠层及垄沟位置检测单元包含特征提取、先验框匹配和非极大值抑制;所述先验框匹配的置信度计算中,预测类别的数量需设置为2,分别对应棉花及非棉花两种类别;

棉花冠层及垄沟深度计算单元,用于估算无人机正下方的垄沟及周围棉花冠层的深度;所述棉花冠层及垄沟深度估算单元包含相机标定、图像像素深度计算、棉花冠层及垄沟深度计算;其中,所述相机标定获得双目相机的内外参数;所述图像像素深度计算是根据相机的畸变系数进行畸变校正,计算左右相机图像中匹配的像素对,基于相机内外参数计算匹配的像素对的深度信息;所述棉花冠层及垄沟深度计算是根据棉花冠层和垄沟位置的信息,计算正下方垄沟区域的像素深度的平均值作为棉花垄沟深度,计算与正下方垄沟相邻的棉花冠层的像素深度的平均值作为棉花冠层深度;

棉花虫害立体监测单元,用于对棉花上部、中部、下部进行图像采集及虫害等级分类;其中,无人机位于棉花垄沟位置上方,到达棉花上、中、下部所需要下降的幅度由棉花冠层及垄沟位置的深度信息计算得到,所述图像采集由无人机到达棉花指定部位后将云台双目相机水平放置并进行图像采集获得,所述虫害等级分类由机载芯片调用预先训练好的卷积神经网络完成;

作业路径规划单元,用于在监测信息表基础上,以耗能最小化原则生成施药无人机的行进路径规划;其中,所述监测信息表包括所有出现虫害的监测点的位置信息,所述位置信息包括监测点的经度和纬度;所述施药无人机的行进路径规划,在所述监测信息表基础上由贪心算法动态规划获得,能够在保证遍历所有虫害位置的前提下实现无人机耗能最小。

参见图3所示,为本实施例中待监测棉田区域的层级划分示意图,监测区域划分为若干个监测单元,监测单元中又包含若干个监测点。其中,所述监测区域是整个待监测的棉田区域,本实施例中监测区域仅包含植保作业中常见的矩形区域;所述监测单元为小型无人机群单次所能监测的棉田区域,该监测单元大小由小型无人机群的数量、飞行高度、航向及旁向重叠率等确定;所述监测点为一个小型无人机的监测位置,该位置包含经度信息和纬度信息,两个相邻监测点的距离由无人机飞行高度、航向及旁向重叠率等确定。当某个监测单元的监测任务完成后,小型无人机群同时以统一高度平移飞向下一个监测单元;若在田块边缘位置,小型无人机群部分无人机位于监测单元之外,则该部分无人机保持悬停状态,在该监测单元监测任务完成之后飞行下一个监测单元。

以上所述实施例只为本发明之较佳实施例,并非以此限制本发明的实施范围,故凡依本发明之形状、原理所作的变化,均应涵盖在本发明的保护范围内。

Claims (6)

1.基于小型无人机群的棉花虫害立体监测方法,其特征在于,包括以下步骤:

S1、在地面站的地图模块上划定监测的棉田区域,根据无人机群的无人机数量划分若干个监测单元;对每个监测单元,地面站划分等间距的二维监测点,通过数传模块将每个监测点位置发送给对应的无人机,所述无人机的机载芯片驱动无人机以统一高度飞行至指定位置;

S2、到达指定位置后,所述无人机将云台双目相机垂直向下,采集正下方的棉田图像,所述无人机的机载芯片通过有线连接实时获取云台双目相机采集的图片,基于SSD模型检测出棉花冠层和棉田垄沟的位置,所述无人机的机载芯片控制无人机飞行至距离最近的棉田垄沟,使得棉田垄沟的位置位于所采集图像的正中间;

S3、所述无人机基于立体视觉技术,获得冠层的深度及正下方垄沟的深度,依据深度信息飞行至棉花植株的上部、中部、下部,包括以下步骤:

S301、在任务开始之前,对每台无人机的双目相机进行标定,获得所述双目相机的内外参数,包括相机内参数、畸变系数、左右相机的位置参数;

S302、在到达棉田垄沟正上方之后,所述无人机采集正下方的双目图像,基于相机的畸变系数进行畸变校正,计算左右相机图像中匹配的像素对,基于相机内外参数计算匹配的像素对的深度信息;

S303、基于SSD模型输出的棉花冠层和垄沟位置的信息,计算正下方垄沟区域的像素深度的平均值,以及与正下方垄沟相邻的棉花冠层的像素深度的平均值,计算棉花植株的上部、中部、下部的深度信息;其中,所述棉花植株的上部、中部、下部的深度信息由以下公式计算:

depthup=depthcrown+0.1×(depthditch-depthcrown)

depthmiddle=depthcrown+0.5×(depthditch-depthcrown)

depthdown=depthcrown+0.8×(depthditch-depthcrown)

其中,depthup、depthmiddle、depthdown分别代表棉花上部、中部、底部的深度;depthcrown和depthditch分别代表棉花冠层和棉田垄沟的深度;所述无人机在到达棉花植株上、中、下部之前,由所述无人机的机载芯片控制无人机依次下降三个幅度,这三个幅度由以下公式计算:

m arg in1=depthcrown+0.1×(depthditch-depthcrown)

m arg in2=0.4×(depthditch-depthcrown)

m arg in3=0.3×(depthditch-depthcrown)

其中,m arg in1代表无人机第一次下降的幅度,m arg in2代表无人机第二次下降的幅度,m arg in3代表无人机第三次下降的幅度;

S4、所述无人机在到达棉花植株的每个位置时,将云台双目相机水平放置,采集棉花植株的侧面图像,所述无人机的机载芯片根据所采集的棉花侧面图像,基于卷积神经网络进行虫害侵蚀分类;

S5、所述无人机在完成棉花虫害的立体监测之后,上升至下降前的高度,通过机载数传模块将监测点的GPS坐标、棉花上中下层的虫害侵蚀类别发送给地面站;所述地面站在接收到监测单元中所有无人机的监测报告之后,该监测单元的监测任务完成,开始下一个监测单元的监测任务;

S6、在所有监测单元的监测任务完成之后,所述地面站接收到所有监测点的虫害信息,仅保留出现虫害的监测点的位置信息,基于贪心算法生成施药无人机的作业路径规划,至此,无人机群的棉花虫害立体监测任务完成。

2.根据权利要求1所述的基于小型无人机群的棉花虫害立体监测方法,其特征在于,所述S1包括以下步骤:

S101、在地面站的地图模块上划定整个待监测的棉田区域,计算棉田区域的宽度和高度;其中,所述待监测的棉田区域仅包含航空植保作业中常见的矩形区域;

S102、地面站根据小型无人机群的无人机数量及单个无人机的监测范围,计算监测单元的面积;所述监测单元的面积按下面公式计算:

wunit=a×wplane

hunit=b×hplane

式中,wunit和hunit是监测单元的宽度和高度,wplane和hplane是单个无人机监测范围的宽度和高度,a×b是无人机群的无人机数量;其中,a代表无人机群在横向上的无人机数量,b代表无人机群在纵向上的无人机数量;所述地面站根据监测单元的宽度和高度计算监测单元的数量,所述监测单元的数量按下面公式计算:

其中,wnum和hnum是监测单元在横向和纵向上的数量,wall和hall是整个待监测棉田区域的宽度和高度,ceil函数代表向上取整操作;

S103、所述地面站在二维空间上,将第一个监测区域划分为等间距的a×b个监测点;其中,监测点的数量与无人机群的无人机数量相等,每个监测点对应于一台无人机;所述地面站基于数传模块,将监测点的位置发送给对应的无人机;所述无人机的机载芯片,根据机载数传模块接收到监测点位置信息,以统一高度驱动无人机飞行至指定位置。

3.根据权利要求1所述的基于小型无人机群的棉花虫害立体监测方法,其特征在于,所述S2包括以下步骤:

S201、获取用于棉花冠层和棉田垄沟检测的SSD模型,任务开始前将该SSD模型部署在每一台无人机上;其中,获取用于棉花冠层和棉田垄沟检测的SSD模型的步骤,包括:

S2011、基于应用场景,设计SSD模型的网络结构,所述SSD模型包括特征提取、先验框匹配和非极大值抑制;其中,所述先验框匹配的置信度计算中,预测类别的数量需设置为2;

S2012、采集棉花田块的无人机图像,对其中棉花冠层和棉田垄沟的位置和类别进行标记,形成棉花冠层和棉田垄沟检测的数据集;将所述数据集用于SSD模型训练,计算位置误差和置信度误差,反向调整SSD模型的参数数值;

S202、所述无人机在到达监测点位置后,将云台双目相机垂直向下采集正下方的图像,通过USB有线连接将采集到的图像传送至机载芯片;机载芯片调用训练好的SSD模型,检测出棉花冠层和棉田垄沟的位置;

S203、所述无人机搜索距离最近的棉花垄沟位置,控制无人机飞行至垄沟中心上方,使得棉田垄沟的中心位置位于无人机图像的中心区域;其中,所述距离最近的棉田垄沟的确定依据,是棉田垄沟中心与图像中心距离最短;所述无人机位置调整方向和幅度,基于距离最近的棉田垄沟中心与图像中心的相对位置关系确定。

4.根据权利要求1所述的基于小型无人机群的棉花虫害立体监测方法,其特征在于,所述S4包括以下步骤:

S401、获取用于棉花虫害侵蚀分类的卷积神经网络,在任务开始前部署在每一台无人机上;其中,获取用于棉花虫害侵蚀分类的卷积神经网络的步骤,包括:

S4011、基于应用场景,设计用于棉花虫害侵蚀分类的卷积神经网络,所述卷积神经网络包括卷积层、激活层、池化层和全连接层,最后一个全连接层的输出为一个1×4的矩阵,分别代表正常、轻度、中度、重度的概率分布;

S4012、采集棉花侧面的无人机图像,根据地面调查结果进行标记,形成棉花虫害分类的数据集;将所述数据集用于卷积神经网络的训练,基于负对数似然法计算卷积神经网络输出与类别标记的差异作为误差,反向调整卷积神经网络的参数数值;

S402、在所述无人机到达棉花植株的每个位置时,将无人机的云台双目相机水平放置,采集棉花植株的侧面图像,通过USB连接线实时传输给无人机的机载芯片;所述无人机的机载芯片调用训练好的卷积神经网络,对棉花植株侧面的图像进行虫害分类。

5.根据权利要求1所述的基于小型无人机群的棉花虫害立体监测方法,其特征在于,所述S6包括以下步骤:

S601、在所有监测单元的监测任务完成之后,所述地面站接收到所有监测点的虫害信息,忽略农情正常的监测点信息,仅保留出现虫害的监测点的位置信息,形成的监测信息表如下所示:

P1(x1,y1),P2(x2,y2),......,Pn(xn,yn)

其中,n代表保留的出现虫害的监测点的个数,Pn代表第n个点的坐标,(xn,yn)分别代表第n个点的经度、纬度;

S602、基于贪心算法生成施药无人机的作业路径规划,首先确定规划路径的第一个作业点G1,确定规则为经纬度的二维范数最小,如下所示:

其中,(xk,yk)代表所述规划路径下一个作业点的经度和纬度,(xi,yi)代表监测信息表中第i个点的经度和纬度,k是1到n之间的一个整数;

当所述贪心算法将第一个作业点G1加入规划路径后,将对应的点Pk从监测信息表中删除;所述贪心算法继续在监测信息表中搜索下一个作业点,确定依据为该点与规划路径中所有作业点的坐标差异的二维范数最小,如下所示:

6.基于小型无人机群的棉花虫害立体监测系统,其特征在于,包括:

棉花冠层及垄沟位置检测单元,用于检测无人机图像中棉花冠层和垄沟的位置;其中,所述棉花冠层及垄沟位置检测单元包含特征提取、先验框匹配和非极大值抑制;所述先验框匹配的置信度计算中,预测类别的数量需设置为2,分别对应棉花及非棉花两种类别;

棉花冠层及垄沟深度计算单元,用于估算无人机正下方的垄沟及周围棉花冠层的深度;所述棉花冠层及垄沟深度估算单元包含相机标定、图像像素深度计算、棉花冠层及垄沟深度计算;其中,所述相机标定获得双目相机的内外参数;所述图像像素深度计算是根据相机的畸变系数进行畸变校正,计算左右相机图像中匹配的像素对,基于相机内外参数计算匹配的像素对的深度信息;所述棉花冠层及垄沟深度计算是根据棉花冠层和垄沟位置的信息,计算正下方垄沟区域的像素深度的平均值作为棉花垄沟深度,计算与正下方垄沟相邻的棉花冠层的像素深度的平均值作为棉花冠层深度;

棉花虫害立体监测单元,用于对棉花上部、中部、下部进行图像采集及虫害等级分类;其中,无人机位于棉花垄沟位置上方,到达棉花上、中、下部所需要下降的幅度由棉花冠层及垄沟位置的深度信息计算得到,所述图像采集由无人机到达棉花指定部位后将云台双目相机水平放置并进行图像采集获得,所述虫害等级分类由机载芯片调用预先训练好的卷积神经网络完成;

作业路径规划单元,用于在监测信息表基础上,以耗能最小化原则生成施药无人机的行进路径规划;其中,所述监测信息表包括所有出现虫害的监测点的位置信息,所述位置信息包括监测点的经度和纬度;所述施药无人机的行进路径规划,在所述监测信息表基础上由贪心算法动态规划获得,能够在保证遍历所有虫害位置的前提下实现无人机耗能最小。

Priority Applications (1)

| Application Number | Priority Date | Filing Date | Title |

|---|---|---|---|

| CN202011162451.7A CN112364725B (zh) | 2020-10-27 | 2020-10-27 | 基于小型无人机群的棉花虫害立体监测方法与系统 |

Applications Claiming Priority (1)

| Application Number | Priority Date | Filing Date | Title |

|---|---|---|---|

| CN202011162451.7A CN112364725B (zh) | 2020-10-27 | 2020-10-27 | 基于小型无人机群的棉花虫害立体监测方法与系统 |

Publications (2)

| Publication Number | Publication Date |

|---|---|

| CN112364725A CN112364725A (zh) | 2021-02-12 |

| CN112364725B true CN112364725B (zh) | 2022-04-01 |

Family

ID=74510905

Family Applications (1)

| Application Number | Title | Priority Date | Filing Date |

|---|---|---|---|

| CN202011162451.7A Active CN112364725B (zh) | 2020-10-27 | 2020-10-27 | 基于小型无人机群的棉花虫害立体监测方法与系统 |

Country Status (1)

| Country | Link |

|---|---|

| CN (1) | CN112364725B (zh) |

Families Citing this family (5)

| Publication number | Priority date | Publication date | Assignee | Title |

|---|---|---|---|---|

| CN113378701B (zh) * | 2021-06-08 | 2023-02-14 | 华南理工大学 | 一种基于无人机的地面多agv状态监测方法 |

| CN113298733B (zh) * | 2021-06-09 | 2023-02-14 | 华南理工大学 | 一种基于隐式边缘先验的尺度渐进的图像补全方法 |

| CN114489113B (zh) * | 2021-12-15 | 2024-02-23 | 北京市农林科学院智能装备技术研究中心 | 一种去雄无人机控制方法及系统 |

| CN117877024B (zh) * | 2024-03-13 | 2024-08-20 | 江西省农业科学院蔬菜花卉研究所 | 一种基于大数据的苦瓜枯萎病监测方法及系统 |

| CN120831351B (zh) * | 2025-09-10 | 2025-12-16 | 甘肃省农业科学院植物保护研究所 | 一种多维度取样的绿肥果园生态系统蚜虫数量检测方法 |

Citations (2)

| Publication number | Priority date | Publication date | Assignee | Title |

|---|---|---|---|---|

| CN107832655A (zh) * | 2017-02-21 | 2018-03-23 | 石河子大学 | 一种基于无人机近地面成像的航拍系统及棉花产量估测方法 |

| CN108447075A (zh) * | 2018-02-08 | 2018-08-24 | 烟台欣飞智能系统有限公司 | 一种无人机监测系统及其监测方法 |

Family Cites Families (1)

| Publication number | Priority date | Publication date | Assignee | Title |

|---|---|---|---|---|

| US11263707B2 (en) * | 2017-08-08 | 2022-03-01 | Indigo Ag, Inc. | Machine learning in agricultural planting, growing, and harvesting contexts |

-

2020

- 2020-10-27 CN CN202011162451.7A patent/CN112364725B/zh active Active

Patent Citations (2)

| Publication number | Priority date | Publication date | Assignee | Title |

|---|---|---|---|---|

| CN107832655A (zh) * | 2017-02-21 | 2018-03-23 | 石河子大学 | 一种基于无人机近地面成像的航拍系统及棉花产量估测方法 |

| CN108447075A (zh) * | 2018-02-08 | 2018-08-24 | 烟台欣飞智能系统有限公司 | 一种无人机监测系统及其监测方法 |

Non-Patent Citations (2)

| Title |

|---|

| A two-stage classification approach for the detection of spider mite- infested cotton using UAV multispectral imagery;Huasheng Huang et.al;《Remote Sensing Letters》;20180823;第1-2页 * |

| Detection and Location of Dead Trees with Pine Wilt Disease Based on Deep Learning and UAV Remote Sensing;Xiaoling Deng et.al;《AgriEngineering》;20200321;第1-2页 * |

Also Published As

| Publication number | Publication date |

|---|---|

| CN112364725A (zh) | 2021-02-12 |

Similar Documents

| Publication | Publication Date | Title |

|---|---|---|

| CN112364725B (zh) | 基于小型无人机群的棉花虫害立体监测方法与系统 | |

| AU2013245476B2 (en) | Tree metrology system | |

| JP6918672B2 (ja) | 劣化診断システム | |

| CN113920474B (zh) | 一种智能监管柑橘种植态势的物联网系统及方法 | |

| CN110770791A (zh) | 一种基于点云地图的图像边界获取方法、设备及飞行器 | |

| CN119413149A (zh) | 一种基于无人机的风电场地形测绘方法及系统 | |

| CN119597003A (zh) | 一种分布式光伏电站无人机巡检方法及系统 | |

| CN115657706B (zh) | 基于无人机的地貌测量方法及系统 | |

| KR101771492B1 (ko) | 복수의 센서를 탑재한 무인 비행체를 이용하는 매핑 방법 및 시스템 | |

| CN111339826B (zh) | 一种滑坡无人机线性传感器网络框架检测系统 | |

| CN117406789A (zh) | 基于图像分析的多无人机桥梁支座巡检航线自动规划方法 | |

| CN118115882B (zh) | 一种基于多源感知融合的农业机器人巡检识别方法 | |

| CN115661245B (zh) | 一种基于无人机的大尺度火线瞬时定位方法 | |

| CN115689795A (zh) | 基于无人机遥感的山地果园作物长势分析方法及系统 | |

| CN119001753A (zh) | 一种无人机航拍的高精度地形测绘处理方法及系统 | |

| CN111833435A (zh) | 无人机近地遥感成熟作物密度高通量测量方法 | |

| CN118170164A (zh) | 一种光伏电站施工巡视方法 | |

| CN114064737A (zh) | 一种基于无人机的大型鲸类时空分布调查方法和系统 | |

| CN113989682B (zh) | 一种基于无人机遥感的航标巡检系统及巡检方法 | |

| CN121232852A (zh) | 一种无人机智能巡田系统 | |

| CN120949807A (zh) | 一种基于地形评估与进近成本分析的无人机自主择址方法 | |

| CN113780086B (zh) | 一种基于无人机的远程自然资源动态监测方法 | |

| CN117687424B (zh) | 基于无人机的全自动低空遥感无感巡检监测系统 | |

| CN118470091A (zh) | 基于无人机遥感的西兰花花球尺寸与位置二维分布实时构建方法及系统 | |

| CN119206053A (zh) | 一种基于无人机平台的田间作物表型原位精细全景三维重构装置及生长状态检测方法 |

Legal Events

| Date | Code | Title | Description |

|---|---|---|---|

| PB01 | Publication | ||

| PB01 | Publication | ||

| SE01 | Entry into force of request for substantive examination | ||

| SE01 | Entry into force of request for substantive examination | ||

| GR01 | Patent grant | ||

| GR01 | Patent grant |